本文作为系列教程的开篇,会带你从零开始,完成环境搭建、4 种核心模型调用方式的学习,最终跑通属于你的第一个 AI Agent。

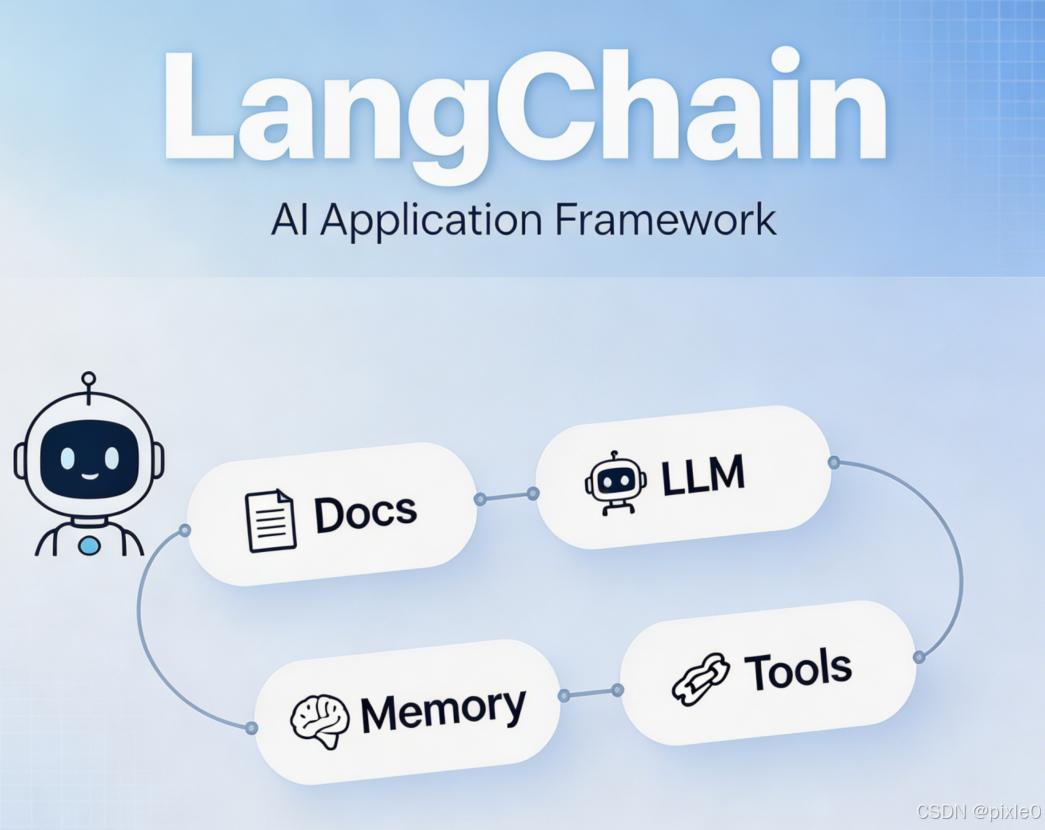

LangChain 是一个用于构建大语言模型(LLM)应用的 Python 框架。它把复杂的 AI 开发流程抽象成标准化的组件:模型调用、提示词管理、工具集成、链式编排、记忆存储——让你像搭积木一样快速搭建智能体(Agent)。

简单来说,如果你曾经用 OpenAI API 写过几十行代码才实现一个带上下文的对话机器人,LangChain 能帮你用几行代码搞定,并且轻松切换不同模型、添加工具能力、管理对话状态。

2025年10月20日推出全新1.0版本(目前最新v1.2)后,最大的变化是引入了 create_agent 这个超级工厂函数。它将模型、工具、记忆和提示词“一键集成”。从此告别了 “复杂链式” 调用,极大降低了开发门槛。

v1.0之后版本把之前需要几十行代码才能实现的功能,压缩到了几行,新手不用再被繁杂的组件概念劝退,能快速聚焦到 AI 应用的核心逻辑开发。

请确保你的 Python 版本 >= 3.10。

//查看python版本 python --version # 确认版本 ≥ 3.10 推荐使用 pipenv 管理依赖,pipenv搭建隔离的虚拟环境,避免依赖包冲突,不会污染全局 Python 环境

(1)安装 pipenv

pip install pipenv (2)创建项目目录并初始化虚拟环境

# 创建项目文件夹 mkdir langchain-demo # 进入项目目录 cd langchain-demo # 初始化虚拟环境,并指定 Python 版本(请确保本地已安装该版本) pipenv --python 3.13 #cmd窗口 set PIPENV_VENV_IN_PROJECT=1 或

#powershell $env:PIPENV_VENV_IN_PROJECT = 1 后再初始化。或者把PIPENV_VENV_IN_PROJECT添加到全局环境变量就不需要每次初始化设置。

(3)激活虚拟环境

#激活虚拟环境 pipenv shell # 安装 langchain 核心包 pipenv install langchain langchain-community langchain-openai langgraph 各依赖包说明:

- langchain:构建大语言模型应用的核心框架,提供链式调用、工具集成、记忆管理等基础组件。

- langgraph:基于图结构的状态化编排工具,用于构建复杂、可控、可回溯的多步骤AI工作流(智能体)

- langchain-openai:兼容 OpenAI 格式的模型接入,适配国内绝大多数开源模型平台

- langchain-community:LangChain 社区维护的第三方集成库,包含大量非官方核心支持的组件(如各种向量数据库、API 工具等)

如果下载慢,建议配置国内镜像源(推荐):

(1)临时设置

通过设置环境变量 PIP_INDEX_URL 来临时指定镜像源,它只在当前的 PowerShell 窗口中有效。关闭该窗口后,环境变量就会丢失。

Windows (PowerShell):

#设置阿里云源 $env:PIP_INDEX_URL="https://mirrors.aliyun.com/pypi/simple" #安装依赖包 pipenv install langchain langchain-community langchain-openai langgraph (2)永久设置

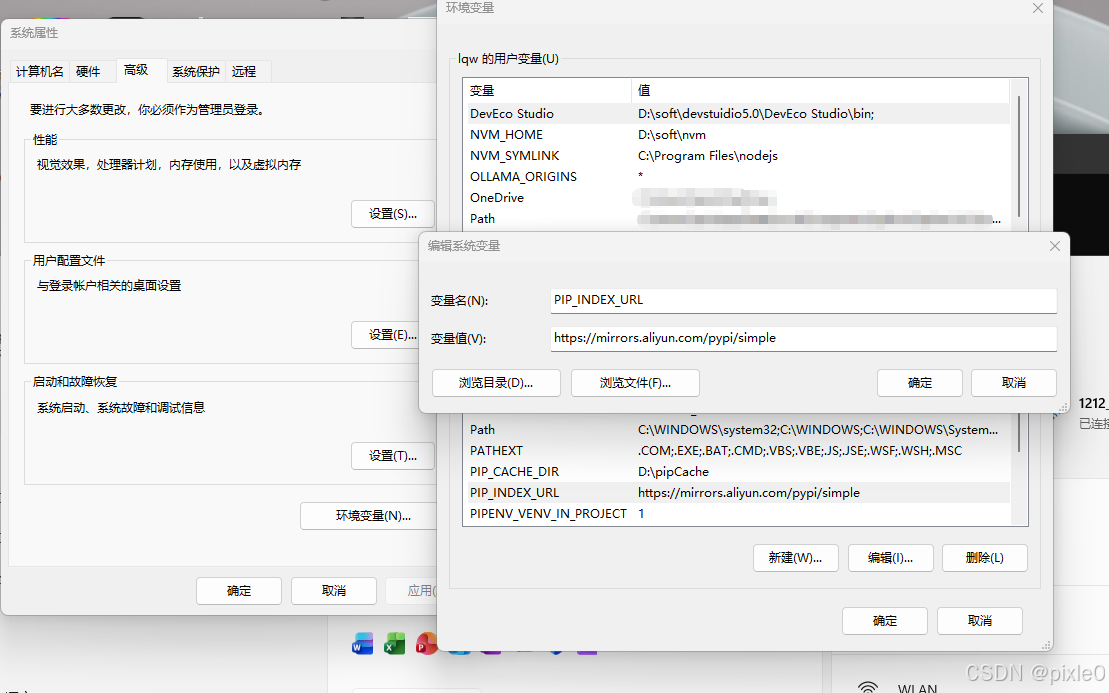

通过系统环境变量(推荐,所有终端生效)

步骤:

打开“系统属性” → “高级” → “环境变量”。

在“用户变量”或“系统变量”中点击“新建”。

- 变量名:PIP_INDEX_URL

- 变量值:https://mirrors.aliyun.com/pypi/simple

确定保存后,重新打开终端 即可生效。

常用国内镜像源地址:

- 阿里云:https://mirrors.aliyun.com/pypi/simple

- 清华源:https://pypi.tuna.tsinghua.edu.cn/simple

- 中科大:https://pypi.mirrors.ustc.edu.cn/simple

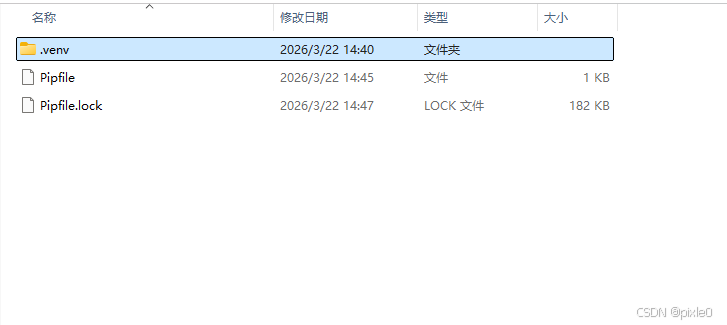

依赖包安装完成,可在项目根目录看到如下文件结构:

- .venv: (注意:如果未设置 PIPENV_VENV_IN_PROJECT,虚拟环境不会出现在项目目录,而是位于全局目录)Python 虚拟环境,内部包含安装依赖包、解释器、可执行脚本、配置等文件

- Pipfile:是 Pipenv 的依赖声明文件,类似于其他语言中的 package.json(Node.js),它用来记录项目所需的 Python 包及其版本范围,以及 Python 解释器信息

- Pipfile.lock:是 精确锁定依赖版本 的文件,类似于其他语言中的 package-lock.json(Node.js),记录了所有包及其子依赖的确切版本、哈希值以及来源信息。由 Pipenv 根据 Pipfile 自动生成并维护。

国内开发者推荐使用 【硅基流动】或【阿里百炼】,无需翻墙且支持主流开源模型,并有免费额度或者完全免费低配版模型,用来学习调式基本够用。

以硅基流动为例,获取 API Key 的步骤:

下面我们将讲解当前v1.2版本支持 4 种模型调用方式,以访问千问模型为示例。在项目根目录创建demo.py

早期版本写法,统一的模型初始化入口,通过字符串指定模型

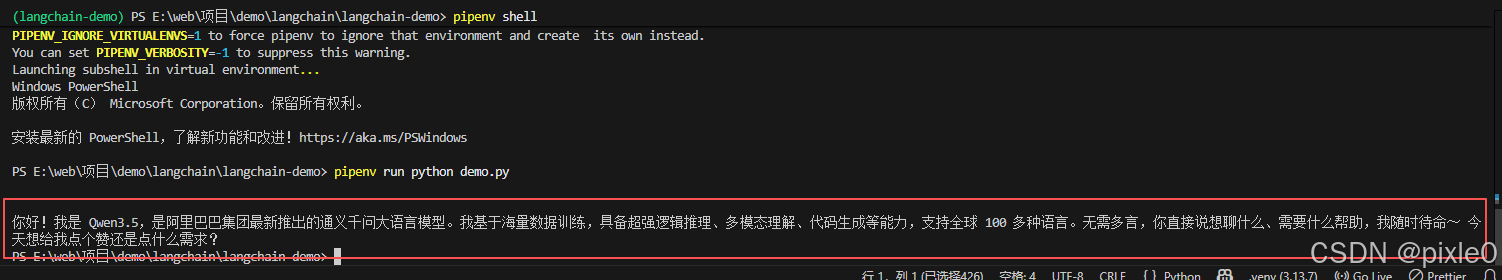

from langchain.chat_models import init_chat_model #api_key从硅基流动后台获取 API_KEY = "sk-lxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx" llm = init_chat_model( model="Qwen/Qwen3.5-4B", #模型名称 model_provider="openai", # 模型厂商,兼容 OpenAI 格式 base_url="https://api.siliconflow.cn/v1", # 硅基流动的 API 地址 api_key=API_KEY , #你的-api-key ) response = llm.invoke("你好,你是谁?") #和模型对话 print(response.content)#你好!我是 Qwen3.5,是阿里巴巴集团最新推出的通义千问大语言模型。我基于海量数据训练,具备超强逻辑推理、多模态理解、代码生成等能力,支持全球 100 多种语言。无需多言,你直接说想聊什么、需要什么帮助,我随时待命~ 今 天想给我点个赞还是点什么需求? 运行脚本:

pipenv run python demo.py 输出结果:

如果你熟悉 OpenAI 的调用方式,可以直接使用 ChatOpenAI,国内大部分模型例如硅基流动、DeepSeek、本地模型(如 Ollama)都提供 OpenAI 兼容接口:

from langchain_openai import ChatOpenAI # api_key从硅基流动后台获取 API_KEY = "sk-lxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx" llm = ChatOpenAI( model="Qwen/Qwen2.5-7B-Instruct",#模型名称 base_url="https://api.siliconflow.cn/v1", #硅基流动的 API 地址 api_key=API_KEY,#你的-api-key ) response = llm.invoke("你好,你是谁?") print(response.content) (1)ChatTongyi(通义千问)使用

dashscope 是阿里官方 SDK,需一并安装:

pipenv install dashscope 代码:

from langchain_community.chat_models import ChatTongyi # api_key 从阿里云 DashScope(灵积)或百炼 平台获取 API_KEY = "sk-lxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx" llm = ChatTongyi( model="qwen-max", # 模型名称 dashscope_api_key=API_KEY #你的-api-key ) response = llm.invoke("你好,你是谁?") print(response.content) (2)ChatDeepSeek(deepseek)使用

安装依赖

pipenv install langchain-deepseek 代码

from langchain_deepseek import ChatDeepSeek # api_key 从deepseek开发者平台获取 API_KEY = "sk-lxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx" llm = ChatDeepSeek( model="deepseek-chat", api_key=API_KEY, extra_body={"thinking": {"type": "enabled"}}, # 强制开启思考模式 ) response = llm.invoke("你好,你是谁?") print(response.content) (3)ChatOllama(Ollama本地部署)使用

from langchain_community.chat_models import ChatOllama llm = ChatOllama( model="qwen2.5:7b", #模型名称 base_url="http://localhost:11434") #模型访问地址 response = llm.invoke("你好,你是谁?") print(response.content) 更多 主流厂商专用 Chat Model 请访问官方文档地址:https://docs.langchain.com/oss/python/integrations/chat

前面的三种方式都是“单次对话”,而 create_agent 则是让模型拥有“能力”(工具)和“记忆”(多轮对话)。这是 v1.0以上 版本的核心亮点。

from langchain.agents import create_agent from langchain.tools import tool from langchain_openai import ChatOpenAI # api_key从硅基流动后台获取 API_KEY = "sk-lxxxxxxxxxxxxxxxxxxxxxxxxxx" # 定义工具:让模型知道它能调这个函数 @tool def get_weather(city: str) -> str: """获取指定城市的天气""" # 模拟天气情况,实际项目中调用天气API return f"{city}今天的天气阴转多云,气温20°C" # 初始化模型,可以选择之前介绍3种方法中任意一种来构建 llm = ChatOpenAI( model="Qwen/Qwen2.5-7B-Instruct", # 模型名称 base_url="https://api.siliconflow.cn/v1", # 硅基流动的 API 地址 api_key=API_KEY, # 你的-api-key temperature=0.1, # 控制回答的随机性,0-1之间 ) # 创建Agent agent = create_agent(model=llm, tools=[get_weather]) # 模型 # 可用工具列表 # 运行 Agent(单轮对话)-问题1 response = agent.invoke({"messages": [{"role": "user", "content": "你好,你是谁?"}]}) print(f"【问题1】:{response["messages"][-1].content}") # 运行 Agent(单轮对话)-问题2 response = agent.invoke( {"messages": [{"role": "user", "content": "厦门的天气怎么样?"}]} ) print(f"【问题2】:{response["messages"][-1].content}") 从运行结果能看出模型会根据问题自行判断是否调用我们定义的 get_weather 工具,并根据工具返回的结果生成回复,而不是瞎编天气。

create_agent方式的核心优势: 模型获得"手"(工具)和"脑"(记忆),能自主规划、执行、纠错、完成复杂任务,成为真正能对话的智能体。

生产环境API_KEY不应该直接写在代码中,一旦代码被激活成功教程或者分享,密钥就会泄露。

.env 文件是一个环境变量配置文件,通常用于存放项目中的敏感信息(如 API Key、数据库密码等),避免将它们硬编码在代码里。开发、测试、生产环境可能使用不同的 API Key。通过 .env 可以轻松切换配置,而不需要修改代码。

1. 安装 python-dotenv

pipenv install python-dotenv 2 .创建 .env文件并写入数据

在项目根目录创建 .env文件,写入api_key

API_KEY=sk-lxxxxxxxxxxxxxxxxxxxxxxxxxxxxx 3. 在Python中使用

使用示例

import os from dotenv import load_dotenv# 加载 .env 文件(默认在当前目录查找) load_dotenv()

api_key = os.getenv(“API_KEY”)

完整结合 LangChain 的示例

import os from dotenv import load_dotenv from langchain_openai import ChatOpenAI load_dotenv()llm = ChatOpenAI(

model="Qwen/Qwen2.5-7B-Instruct",#模型名称 base_url="https://api.siliconflow.cn/v1", #硅基流动的 API 地址 api_key= os.getenv("API_KEY"),#你的-api-key )

response = llm.invoke(“你好,你是谁?”) print(response.content)

我们对上面的示例进行简单修改就能变成多轮输入式对话

import os from dotenv import load_dotenv from langchain_openai import ChatOpenAI load_dotenv()# api_key从硅基流动后台获取 API_KEY = os.getenv(‘API_KEY’)

llm = ChatOpenAI(

model="Qwen/Qwen3-8B",#模型名称 base_url="https://api.siliconflow.cn/v1", #硅基流动的 API 地址 api_key=API_KEY,#你的-api-key )

#循环对话 while True:

question=input('请输入问题:').strip()#用户输入问题 if question in ['quit','exit','退出']: #遇到退出指令结束对话 break else: response = llm.invoke(question) print(f"答:{response.content}",end=" “)

运行效果:

到此,你已经成功完成了 LangChain v1.2 的环境搭建,并且掌握了四种不同的方式来调用大模型。学会了:

- LangChain 是什么以及 v1.0版本以后 的核心变化

- 使用 pipenv 搭建 Python 虚拟环境

- 安装 langchain 核心依赖包

- 申请并配置模型 API Key

- 4 种模型调用方法:init_chat_model、ChatOpenAI、专用 Chat Model 类、create_agent

- 与模型多轮输入式对话

有了这个基础,我们就能继续深入探索 LangChain 的更多功能了,在后续的文章继续介绍,敬请期待!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/260699.html