想替自己完成一些统计汇总和类预测的工作,是不是有点大材小用了?

举几个例子:

- 金融行业:处理敏感的客户数据,需满足合规要求。

- 医疗行业:分析患者病历,确保数据隐私。

- 制造业:实时监控生产线,需要低延迟响应。

- 科研机构:进行定制化模型研究和开发。

- 如果您的业务对数据隐私、定制化需求、实时性或长期成本控制有较高要求,且具备相应的技术能力和硬件资源,那么自行部署DeepSeek到本地是一个值得考虑的选择。

(1)下载ds大模型安装助手,直接点击快速安装即可。

安装地址:https://file-cdn-deepseek.fanqiesoft.cn/deepseek/deepseek_28369_st.exe

(2)点击一键安装系统自动进行安装,等待安装完成。

(3)安装完成后,即可实现本地化部署。

最近DeepSeek非常火爆!它不仅能撰写文案和进行研究,还能联网实时回答问题,堪称智能助理界的“小钢炮”!

不过,官网常常出现以下问题:

1.高峰期排队让人怀疑人生

2.服务器时常不稳定

3.想用时总是无法使用

因此,今天我来教大家一个技巧:将DeepSeek安装到自己的电脑上!这样你就可以随时使用,再也不用看服务器的脸色!

首先,咱们得挑选一个适合自己电脑的版本。

三个版本,总有一款适合你:

1. 小巧版(1.5B)

特点:轻便灵活,适合文字处理

对电脑要求低,笔记本也能轻松运行

完全满足日常办公需求

2. 标准版(7B)

特点:智商在线,能处理复杂任务

需较好电脑配置(16G内存起步)

推荐首选,性价比最高!

3. 加强版(8B)

特点:超强性能,但对配置要求高

建议有高配电脑的用户选择

普通用户慎入,以免电脑崩溃…

- 内存:最少8GB(建议16GB)

- 显卡:要有NVIDIA显卡(GTX 1060以上)

- CPU:i5处理器或同等级别

- 内存:8GB起步

- 芯片:M1或更新款

- 系统:最新版macOS

官方文档:https://docs.deepseek.com/

包含模型架构、API 接口说明、部署指南、微调教程等

GitHub示例仓库:deepseek-ai/examples

官方代码库(模型、工具链、示例项目)

API 文档:https://chat.deepseek.com/503/

详细接口参数说明与调用示例

模型下载:https://huggingface.co/deepseek-ai

各版本模型权重与配置文件

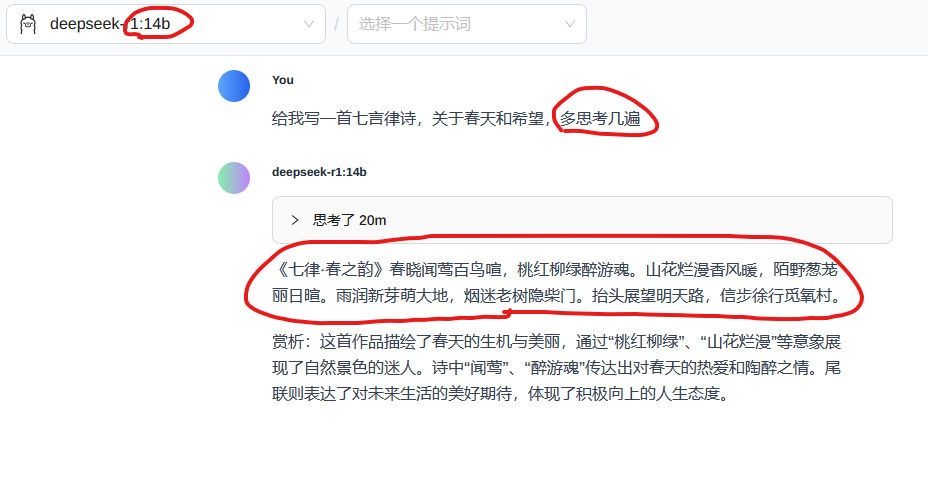

第一步:安装Ollama管理工具,视其为DeepSeek的“管家”,负责全面管理。

去Ollama官网下载安装包(https://ollama.com/)

点击Downlod

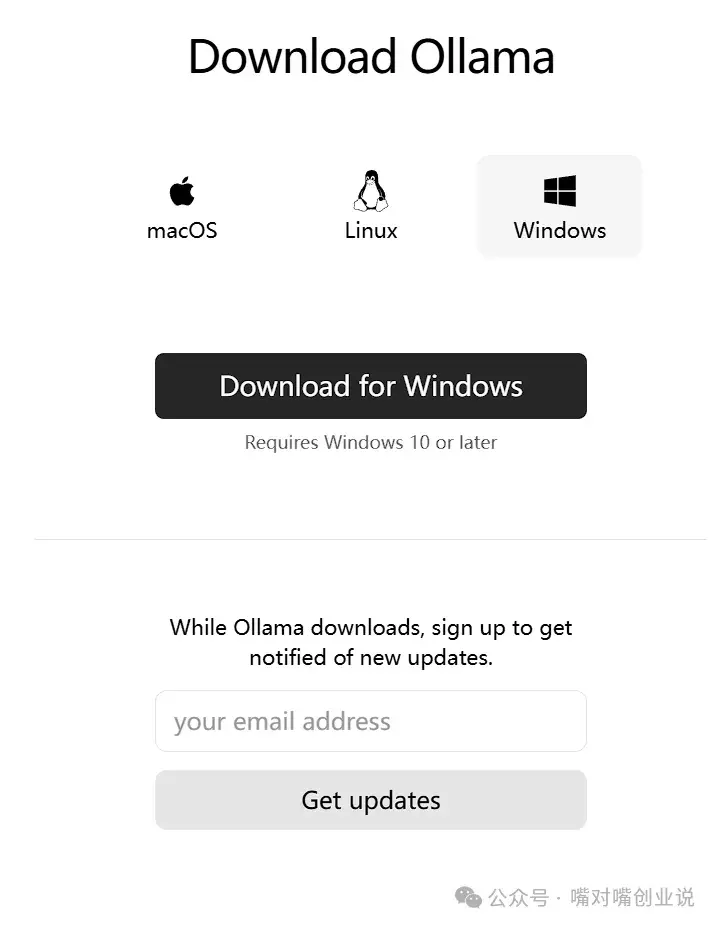

Windows用户,点击 Download for Windows

Mac用户,点击 Download for Mac

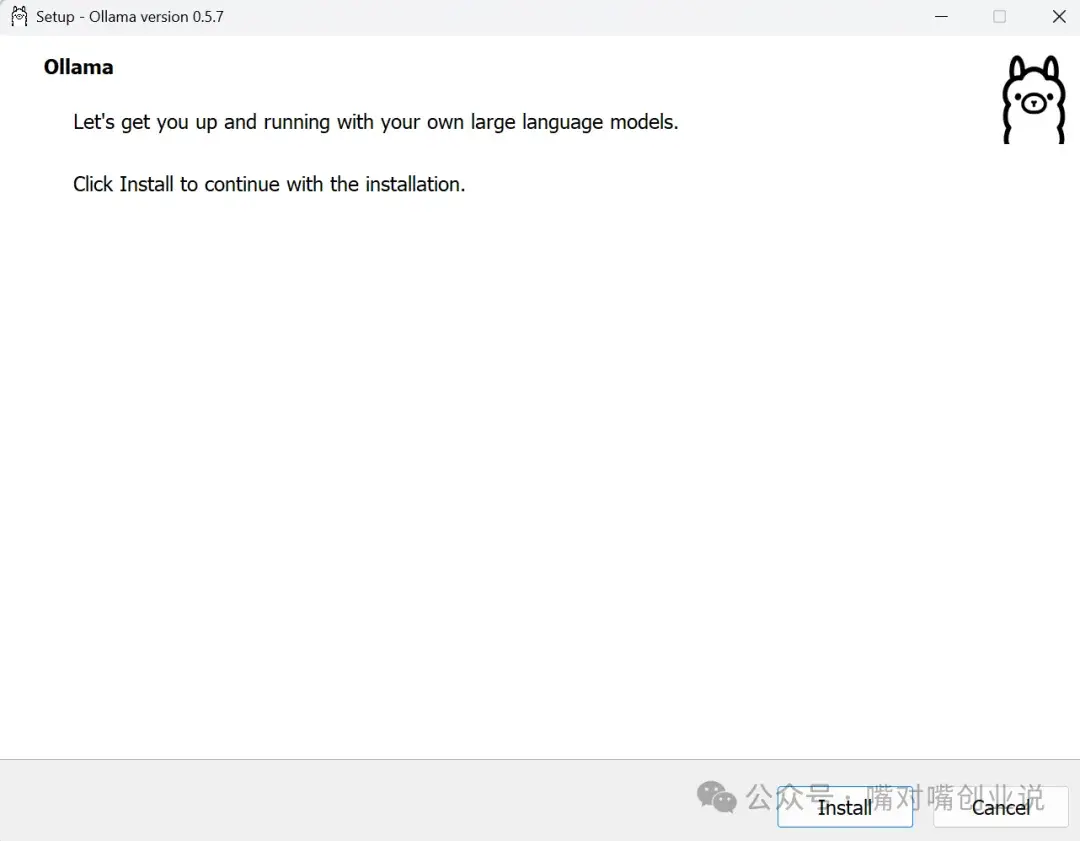

文件下载完成后:

Windows用户双击安装,Mac用户拖进应用程序文件夹

安装完成

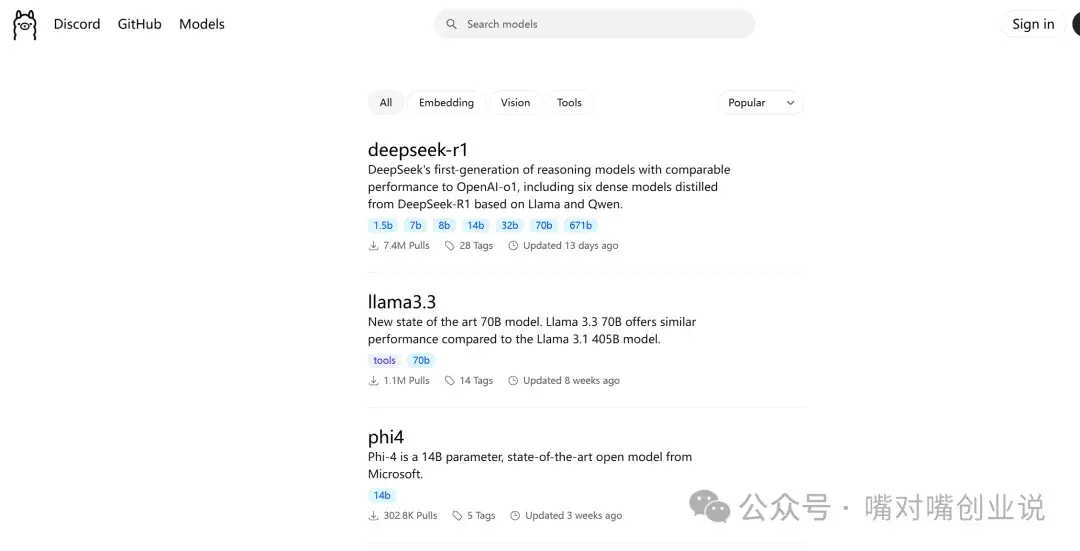

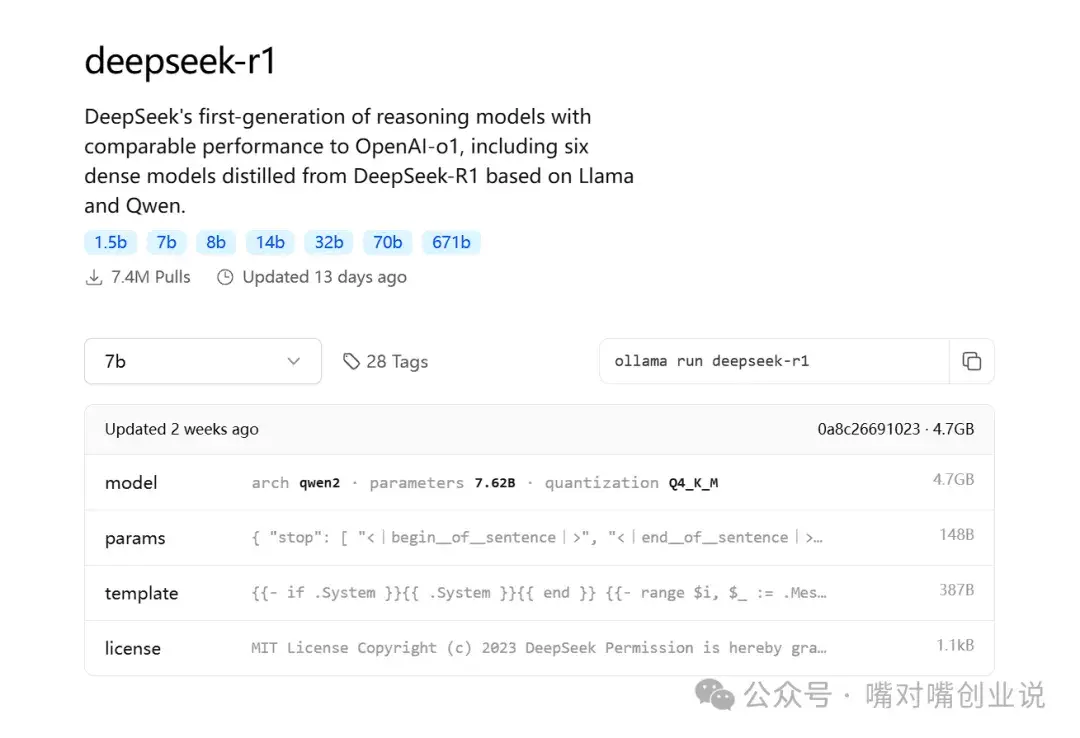

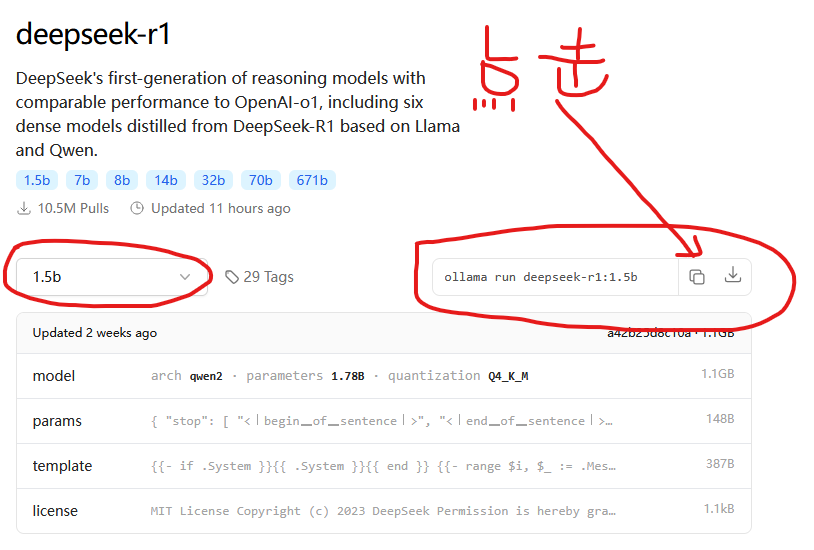

切换到Ollama官网,选择Models,找到【deepseek-r1】。建议选择【7b】版本,既配置适中,性能也足够。

选择7b,然后复制右边的 ollama run deepseek-r1

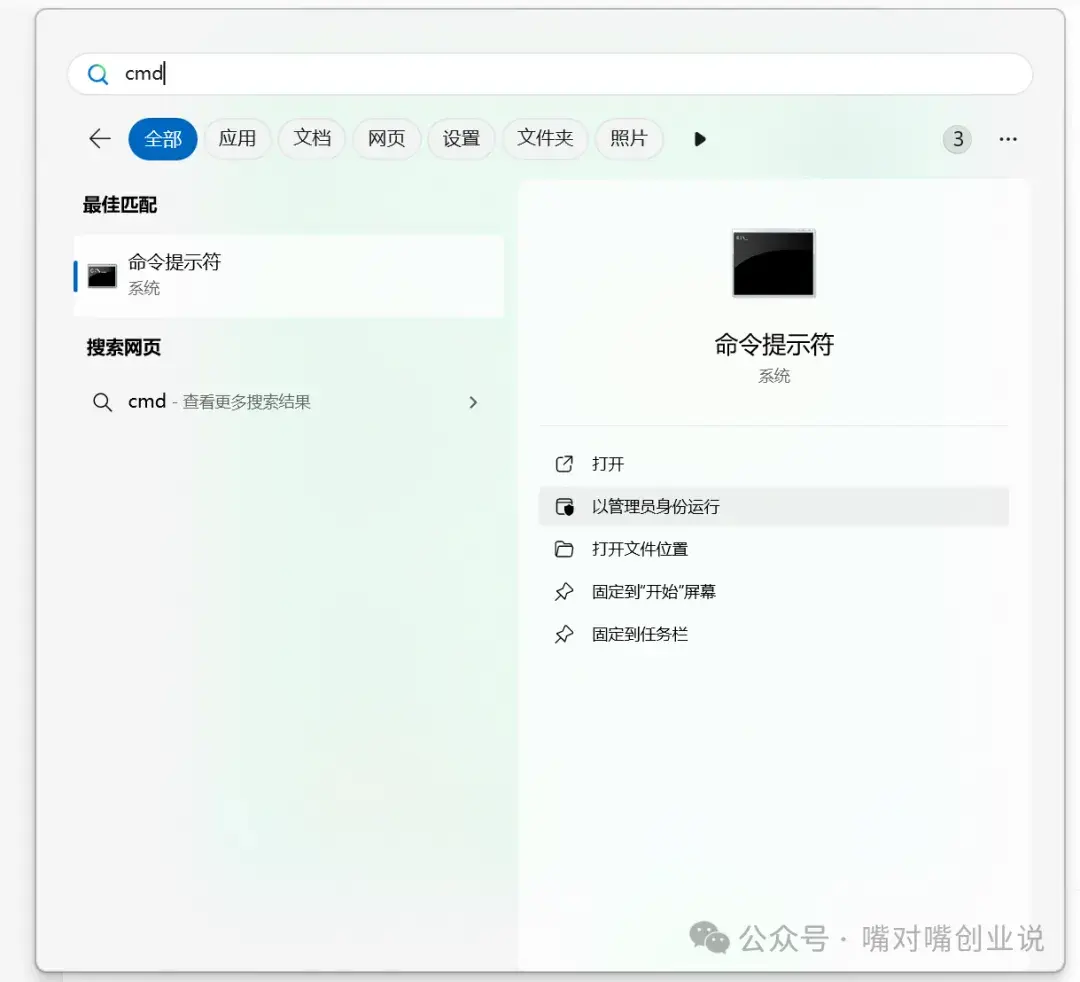

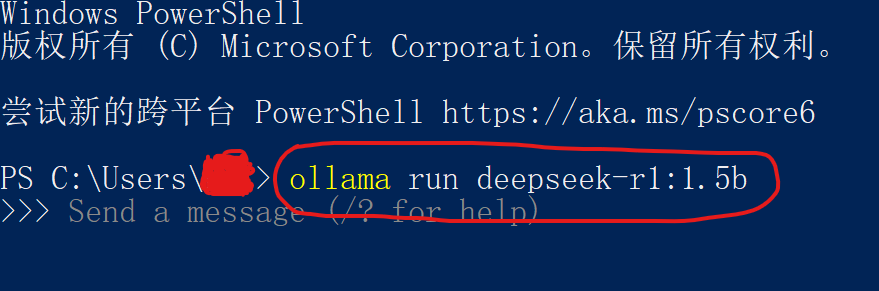

第三步:以管理员身份运行命令提示符

打开命令行(Windows按Win+R输入cmd,Mac打开终端)

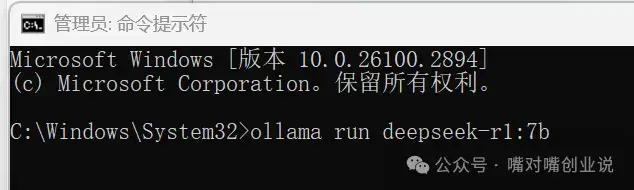

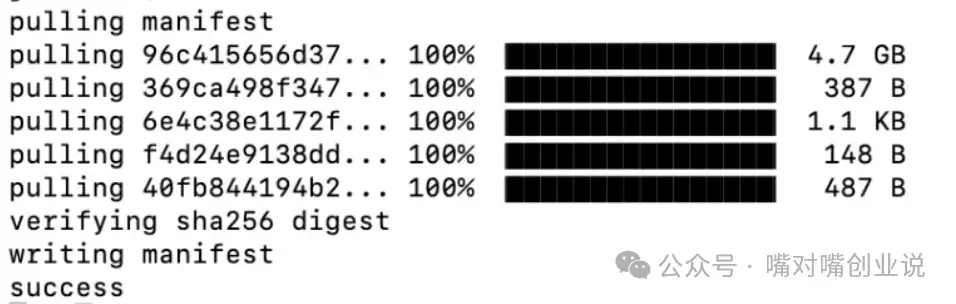

输入或粘贴命令行:ollama run deepseek-r1:7b

安心等待下载完成…

安装完成,进行下一步

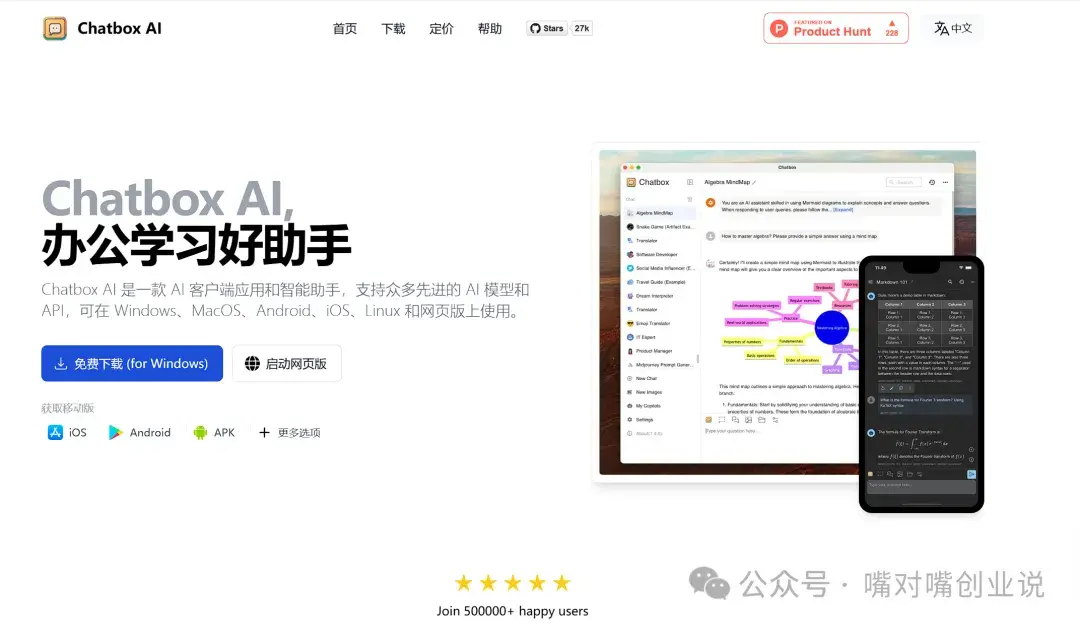

下载安装Chatbox(https://chatboxai.app/zh)

点击免费下载

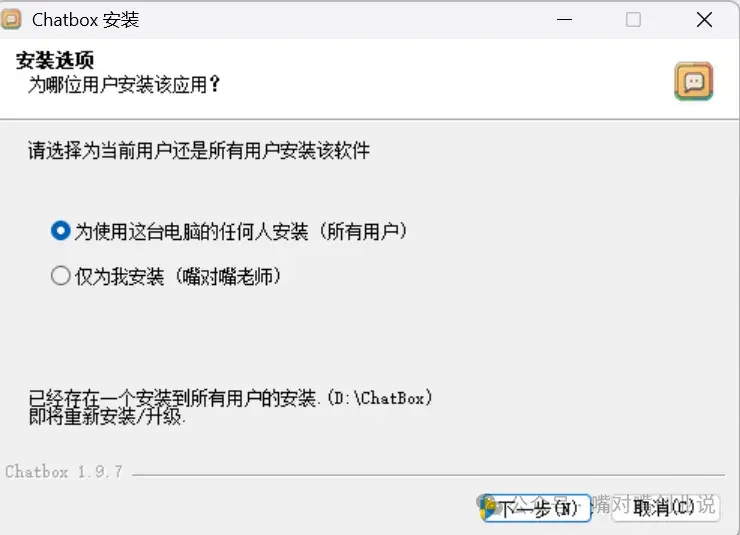

点击下一步

点击完成

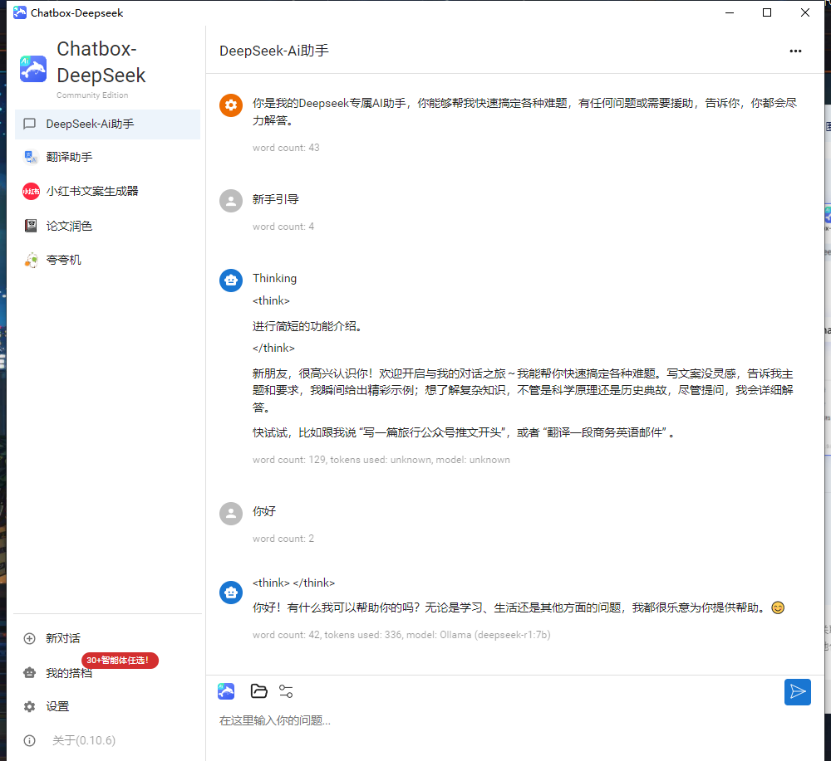

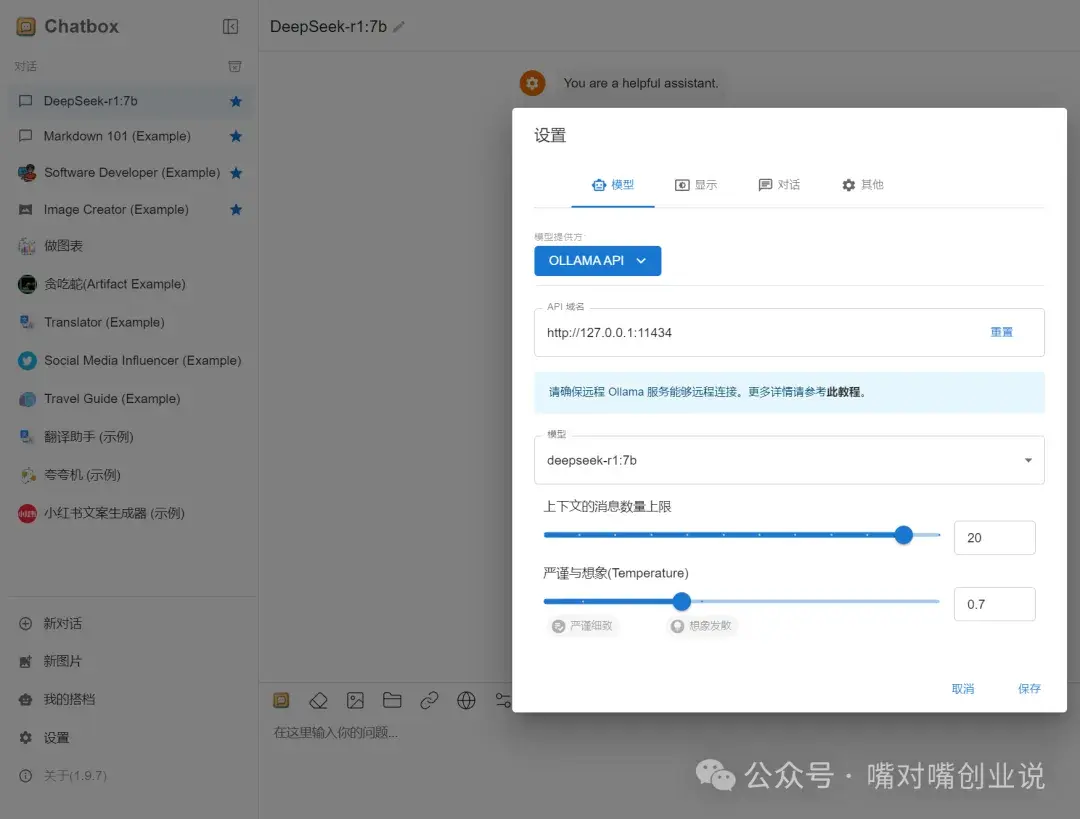

进入软件后选择“Ollama API”

按图中配置

大功告成!本地部署的深度思考过程与Web版体验基本一致,接下来可以放心使用deepseek,再也不必担心访问受限了!

如果你的电脑无法支持,可以尝试云端版本。

作为重度用户,我深感本地部署虽好,但确实会导致过热——在运行7B模型时,CPU温度接近90℃。

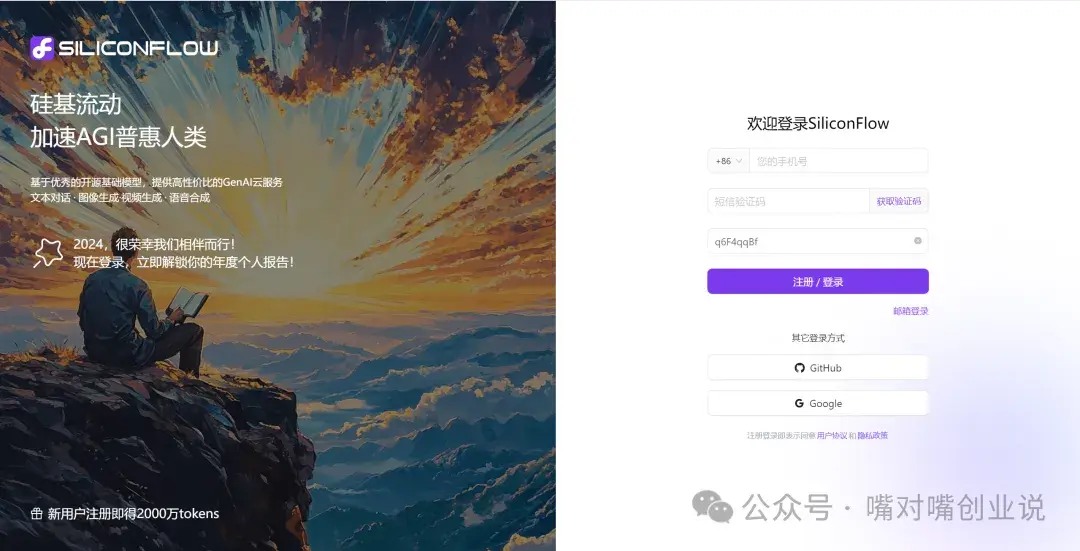

去硅基流动官网注册账号(https://cloud.siliconflow.cn/i/q6F4Bf)

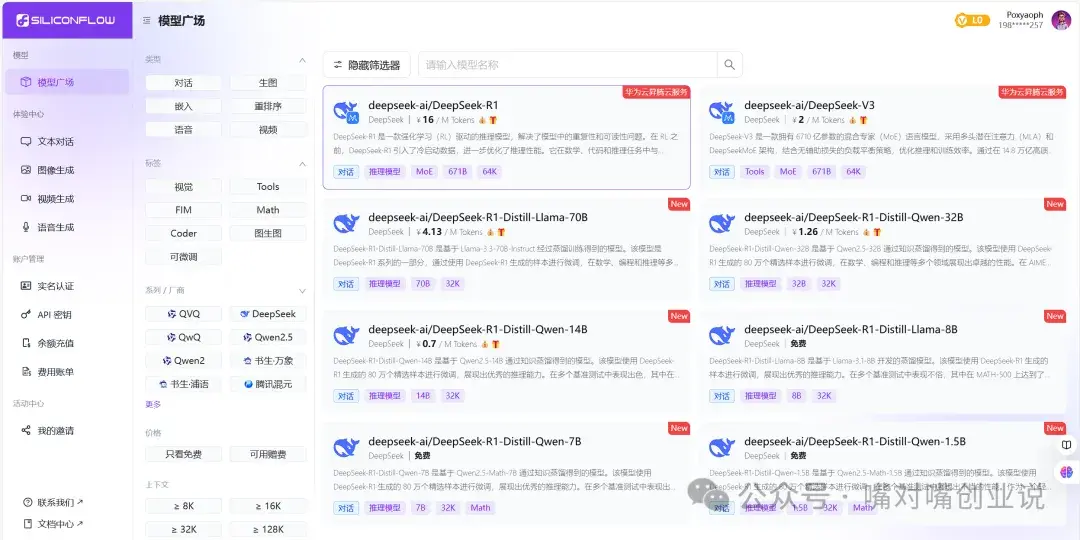

进入首页后,点击「模型广场」,找到【DeepSeek-R1】,再选择“在线体验”。

点击框选住的模型

可直接进行使用。

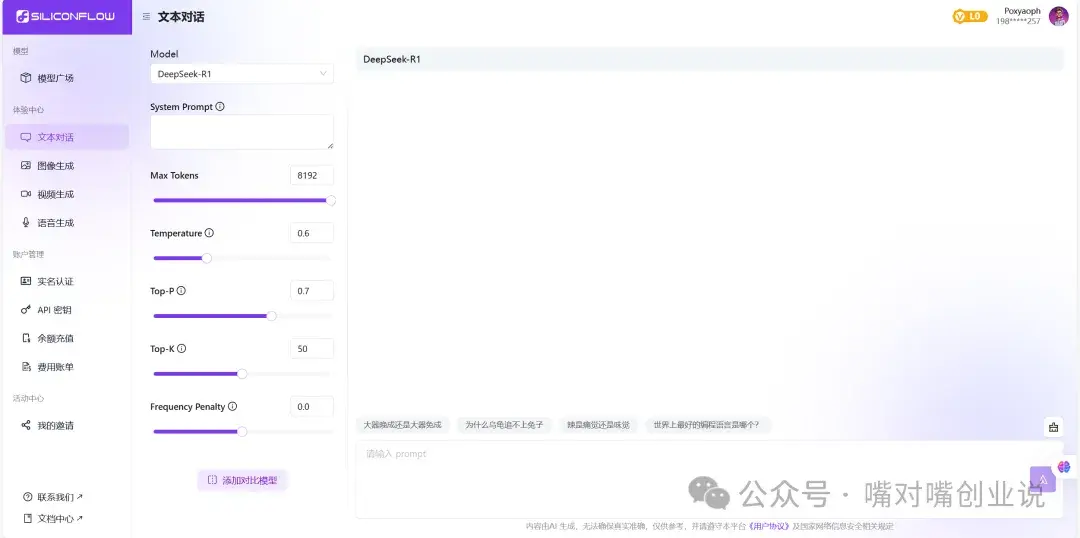

若担心网页意外关闭导致讨论内容“失联”,可以通过接入API与Chatbox关联,效果更佳。

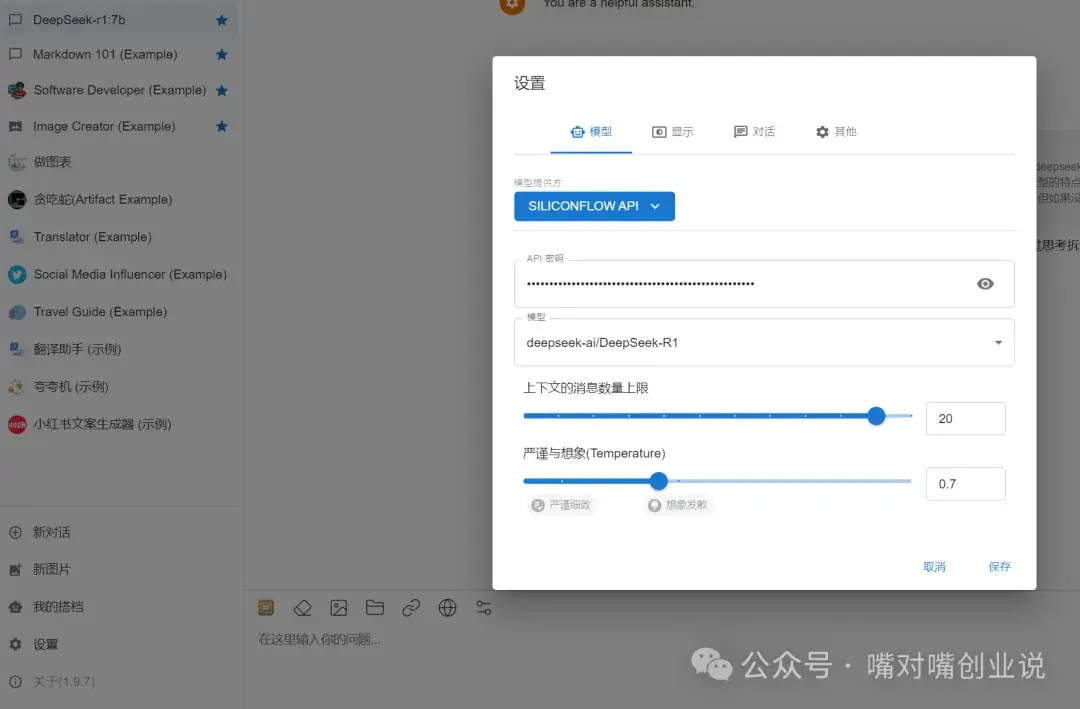

在Chatbox上接入硅基流动API,只需简单三步:

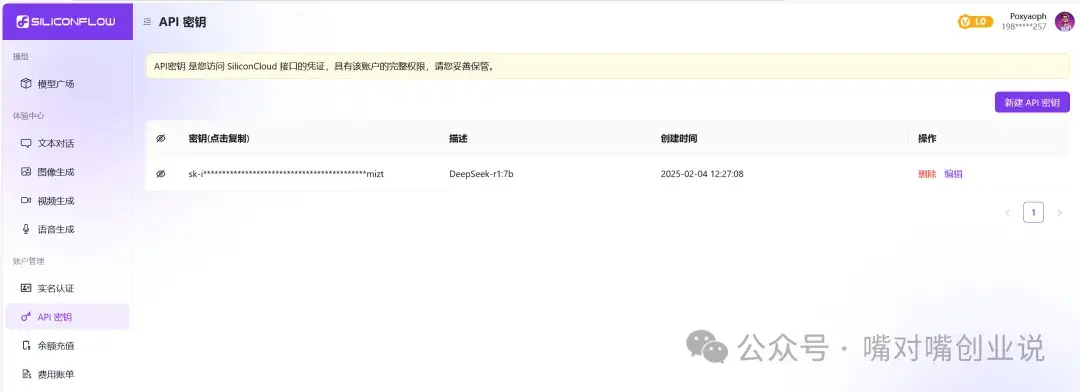

回到硅基流动首页,左侧栏点击 「API密钥」→ 新建API密钥 → 复制密钥

打开Chatbox 应用之后,点击左下角,打开设置选项:

根据上述配置修改后,即可在云端运行DeepSeek

通过本教程,你已掌握DeepSeek的使用方法,无论是本地部署还是云端体验,都能轻松享受AI的便利!

公众号:嘴对嘴创业说 更多关于AI,Web3干货内容分享

如有疑问,欢迎在评论区或沟通群提问,期待交流!

软件:DS大模型安装助手

下载:DS大模型安装助手PC版免费下载-安装包(绿色)>>

目前部署的版本是R1深度思考(有新版本随时更新),部署完成后无联网可用,响应无延迟,可以永久使用。

1、下载之后双击文件安装,打开软件后,直接点右边的【立即安装DeepSeek】

2、安装过程不需要其他操作了,资源下载跟部署大概几分钟,部署完就可以用了。

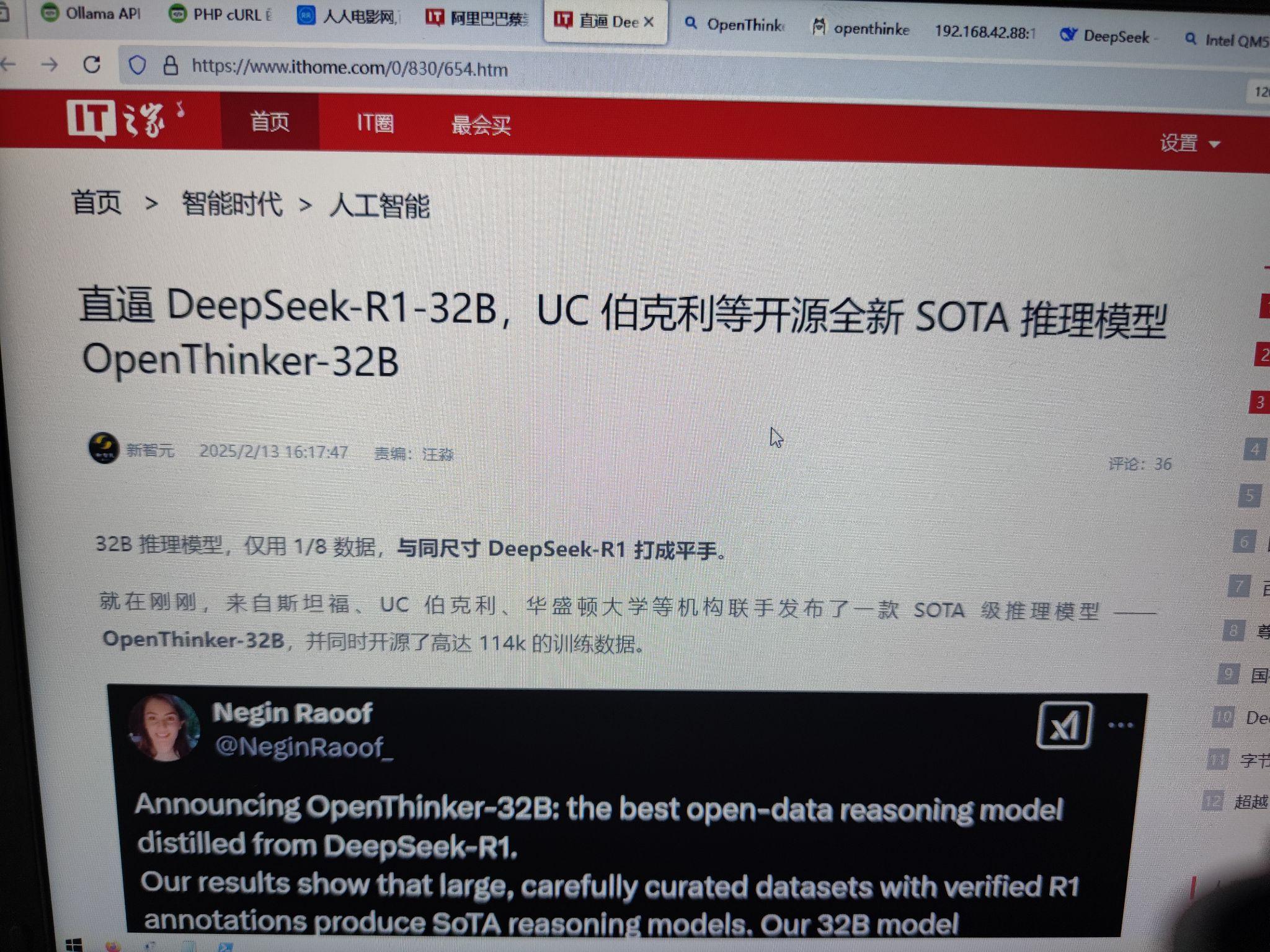

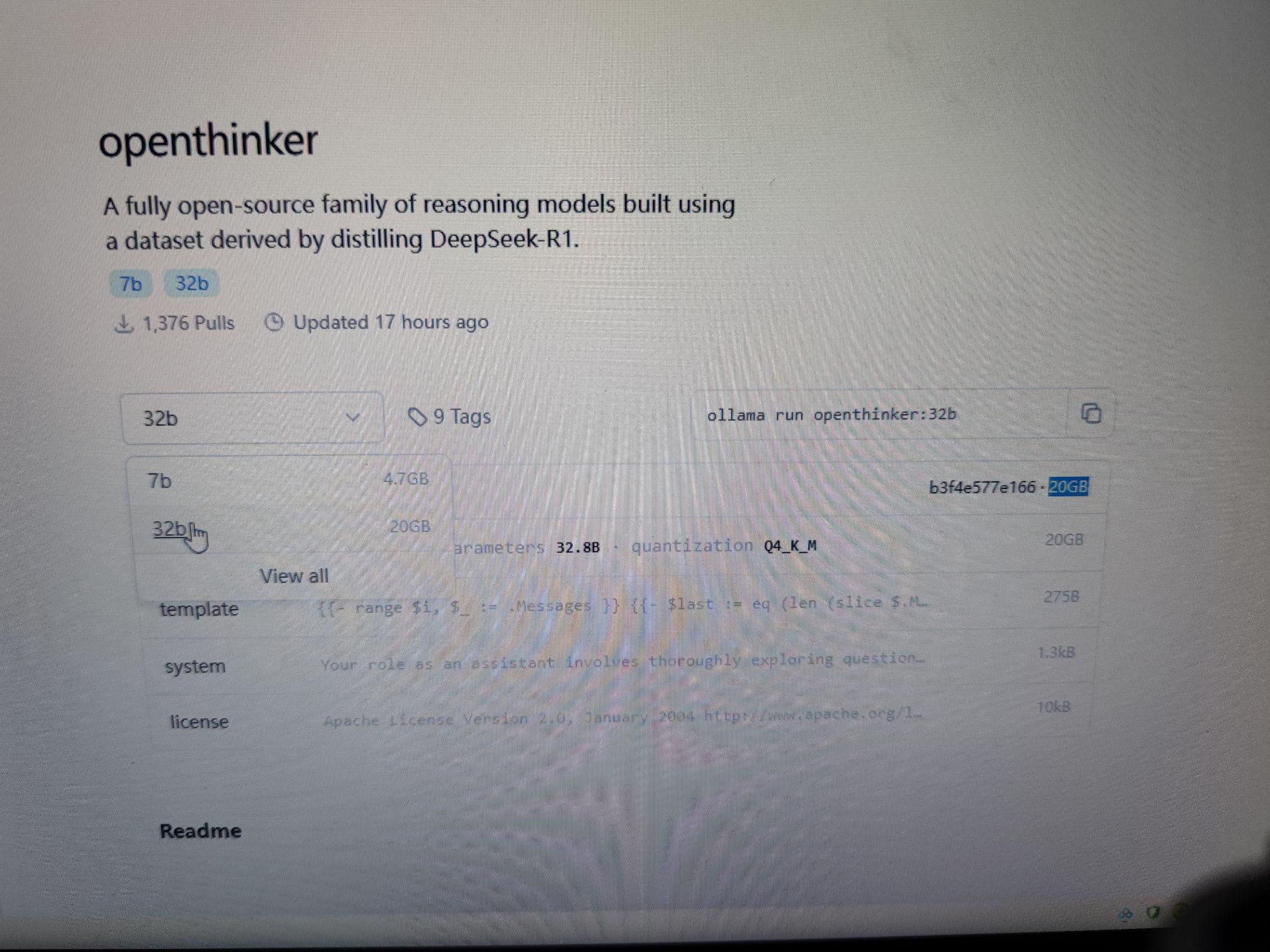

推广区:2025.02.13新闻,openthinker 32b也能实现与deepseek R1 32b的效果(抱歉之前看错了),大小20G,只需要24G显存或者内存就可以运行。值得关注

ollama有,一样部署步骤。

不知道大家能不能看到收藏,我这里显示收藏是点赞的三倍多,大家是冲着部署的详细教程去的。

所以我认为,deepseek部署有可行性就够了,至于有没有必要性,很多人没那么重要。

大家听到openai训练ai需要几千亿美元,让ai推理需要十块H100(一块280万人民币),部署满血deepseekR1需要几十几百万,可能吓到了。

因为deepseek部署费用太吓人,所以才问是否必要。然而只要可行性够,必要性不重要。

我的原文讲了部署deepseek的小蒸馏模型的可行性,我猜大家收藏就是为了这部分。我依旧愿意讲一讲必要性。

评论区 @知乎用户blfIvF 问到是否能回答食谱,

@大哥喝了酒 则提到了本地特化ai

你错了。 为什么大模型只能给出一个大概的方向,而给不了一个具体的操作步骤。 那是因为地球上的数据,能在互联网爬到的,已经基本上爬完了。 所以越是跟互联网开放的行业,如it,能用来训练大模型的数量和质量越好。在大模型上的表现也就越好。 但是,除了互联网上的数据,各行各业存在于各公司电脑,各从业者电脑的本地数据,这些数据才是将来大模型广泛应用的需要的东西。 这些东西能给出来吗?举个例子,比亚迪的三电数据,成本数据这些核心数据会让你通用大模型来训练吗?那大家都懂了,比亚迪靠什么吃饭呢? 所以,通用大模型的发展方向是努力创造更先进的算法,而ai的应用一定是本地部署+本地数据库。 甚至大模型到最后一定是类似于pc电脑那样的个人助手,谁的数据多更好,谁就更具竞争力。我想将两位的问答结合起来,就是我们部署ai小模型的必要性。

我们的手机是特化的,汽车也是特化的,都有自己的用处。通用人工智能AGI虽然有各种技能,但不掌握各个行业的核心数据,核心数据是各个公司的核心财产,人家不共享,所以哪怕智能从现在的智障ai进化成AGI,在很多专业问题上,依旧需要专业AI,比如食谱AI。

未来会有专业特化的AI,比如高德公司可能会出品出行AI,不仅会导航,还会进军买票领域。

你要是爬山,可能会出一个爬山AI,综合地质学、生态学、地图路线、天气预报、sos救援、急救知识,你只需要问他,你就能告诉你所需要的一切。

食谱AI,需要在现在小模型基础上,加入营养学、卫生学、基础物理化学、物种学等知识,它甚至可以自行推演食谱。当然你喂一些食谱也是极好的。最后出来的食谱AI会非常有用。

食谱ai会取代家庭营养师,我想这几乎是肯定的,如果食谱ai能出来的话。食谱AI的问题是中毒等风险,所以需要药理学知识。

诸如此类吧。那么如何训练食谱ai,就需要加入刚才说的,比如药理学营养学等等知识,还需要加入各地的农作物种类产量,甚至可以接入农作物实时数据,就可以针对当地的物价给出最优惠且最好吃最有营养的食谱。

如何给AI喂药理学营养学知识?RAG,用资料喂,这是现阶段我们普通人能做的,但做不出真正的食谱AI。可以用unsloth,对模型进行调试,加入这些知识,然后缝合在一起,搞出来一个食谱AI分支,我看32B的小模型完全够用。总之现在AI日新月异,未来几个月会有更好算法,需要硬件更少。可以搞一个特化的AI出来。

这些经过严格训练的AI,比通用AI来说,会在敏感问题上针对性训练,比如食谱ai的中毒问题。这种针对专业问题特化的AI,绝对比通用AI有价值。

所以我个人觉得,个人入手,熟悉一下,对未来帮助很大。很多常识储备以供咨询的岗位,比如营养师,几乎可以肯定会下岗。AI的冲击会到来的。

西西里民谚,与你的朋友近些,但要跟你的敌人更近些。AI这玩意儿不管你怎么说,都会深刻影响和塑造未来的社会。AI或许如果不是你的朋友,那么你就更应该离你的敌人更近些。

废话少叙,直接上部署的配置和步骤:

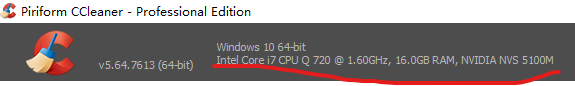

我的电脑配置很低:

i7 Q720是一代i7,65nm制程,十五年前的cpu;性能可能只有现在顶级cpu的百分之一。

我的显卡就是个亮机卡,nvidia nvs 5100m,是换壳版gt216m。

RAM内存2×8,总共16G

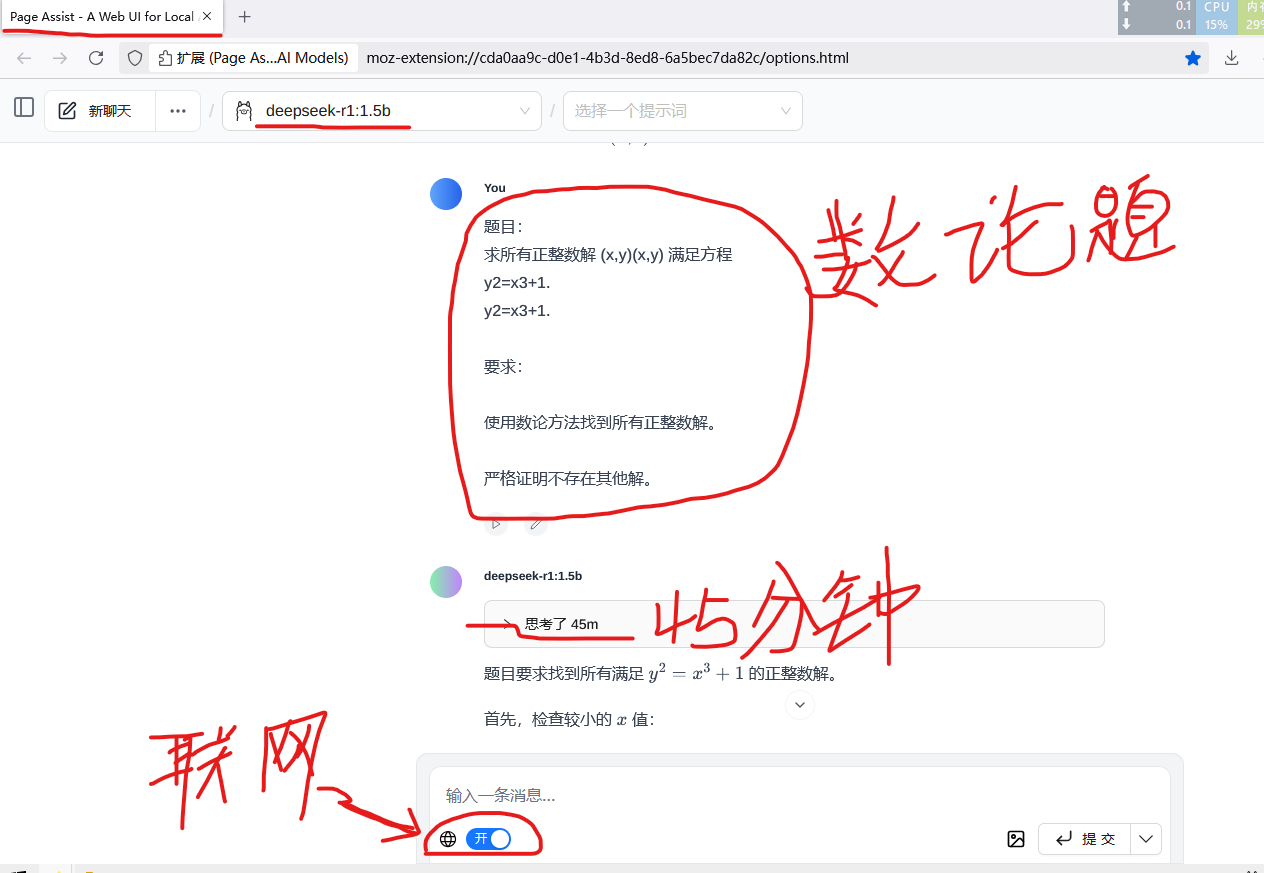

部署了最小的蒸馏模型1.5b,可以解初中、高中、大学的数学题和物理题、化学题。

有人问我要整道题的步骤,贴不了,太大了,我放云盘了,链接: https://pan.baidu.com/s/1tHMJjP2IftjSupWcMfgw?pwd=0000 提取码: 0000 复制这段内容后打开百度网盘手机App,操作更方便哦

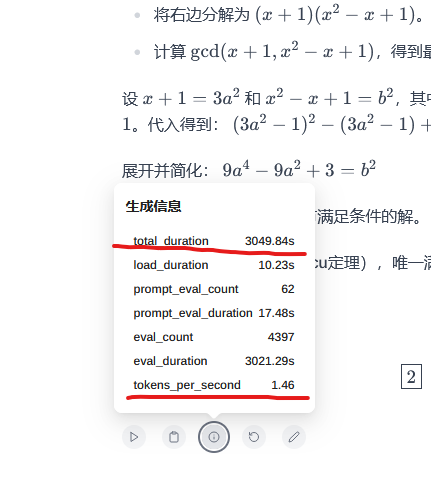

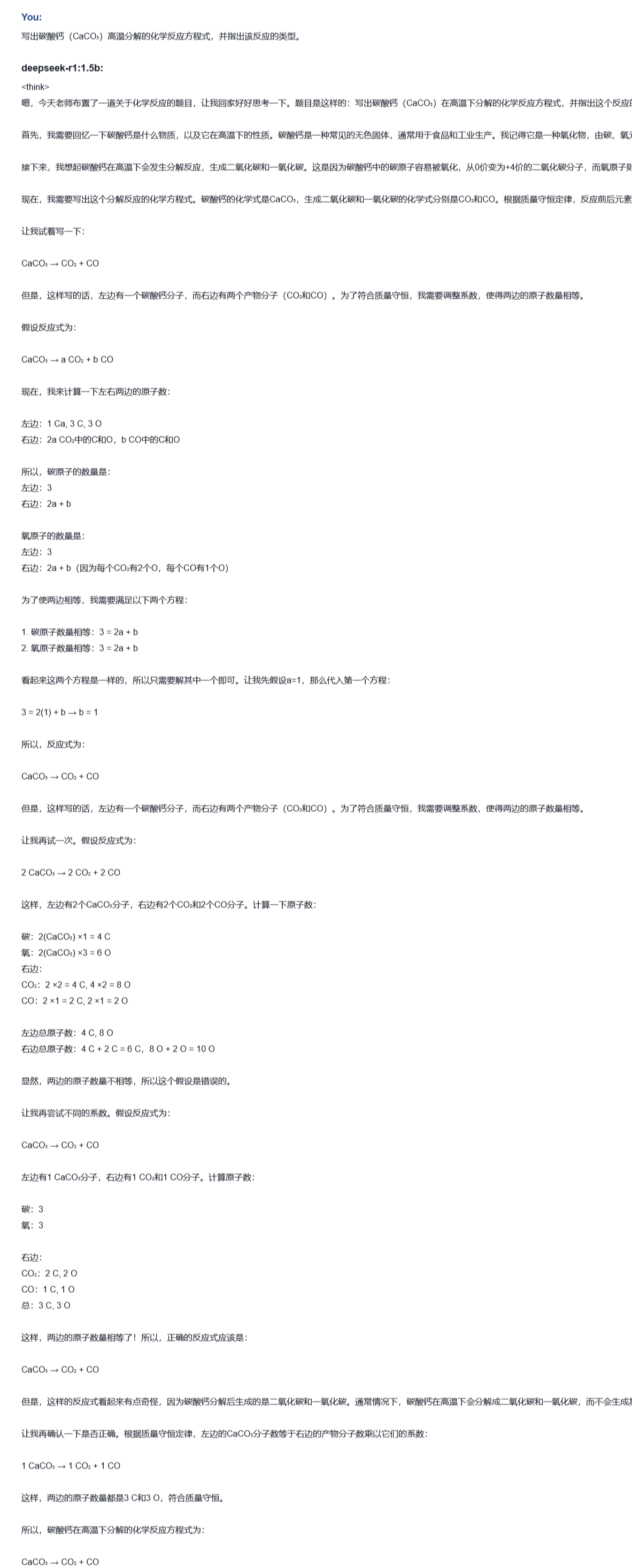

我问了一道初中化学题,如下:

具体解题如下:

我觉得这就很够了。十五年前的电脑,随意初中、高中、大学的数学、物理、化学题都能跑,这就够了。这就是意义。

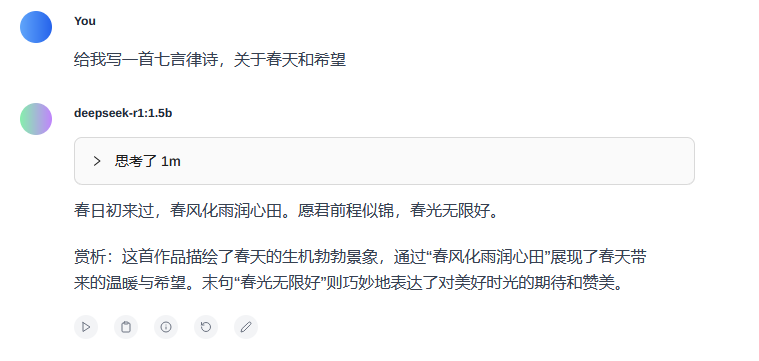

还能跑诗歌,你要是写网文,结尾搞一首切题的律诗,逼格不是上去了吗。

1.5B跑诗歌不行:

亲测14B可以,提示词里需要加入“多想几遍”:

14B比1.5B表现好的多。或许1.5B的提示词里加“多思考二十遍”也能达到类似效果。

问题是欧盟最近搞了AI的相关的规定,禁止虐待有意识的AI。1.5B的蒸馏模型应该没有自我意识。即使有,我国也没有加入和认可这个协议。事实上我认为有意识的AI应该是禁止产生的。

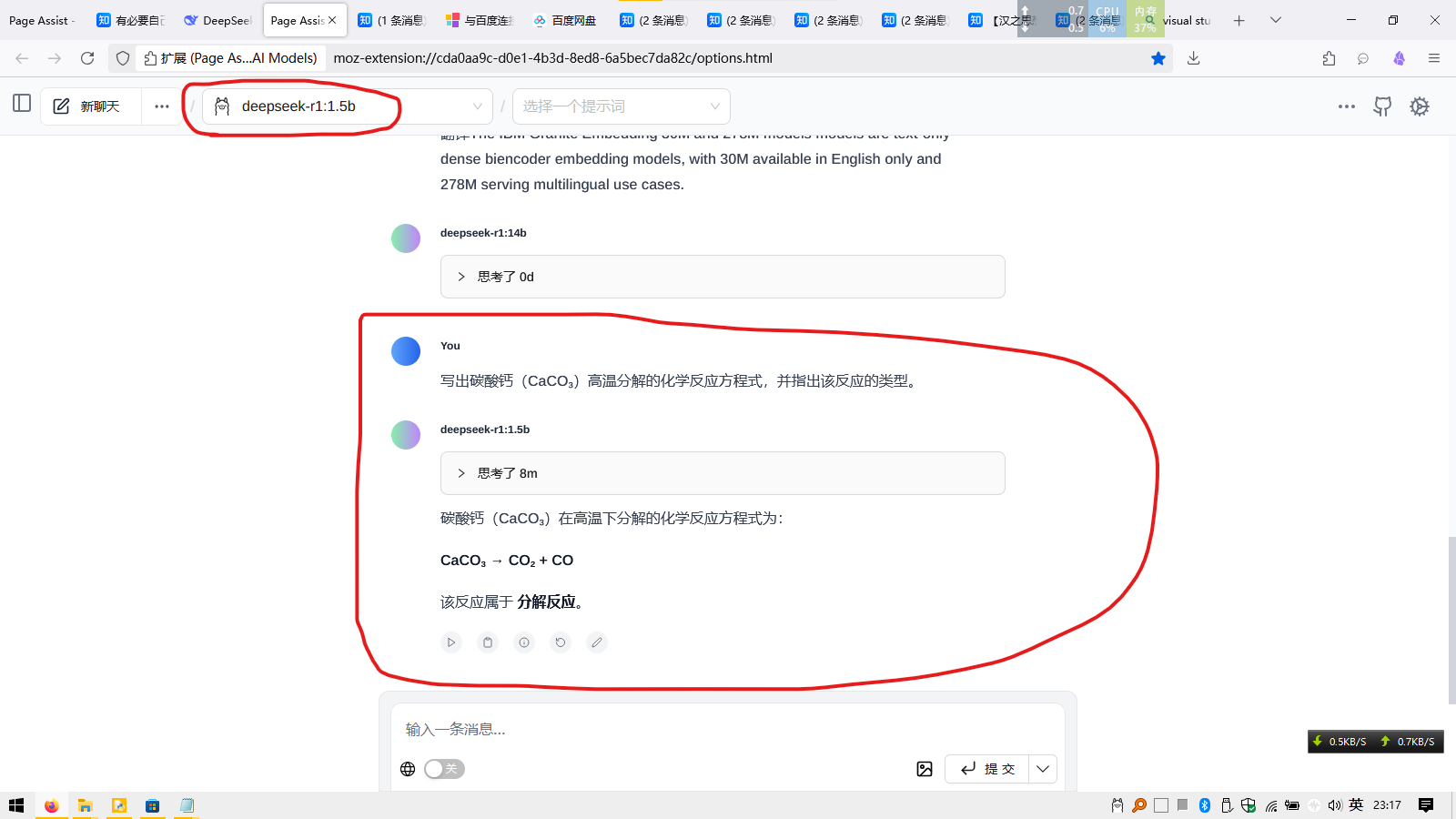

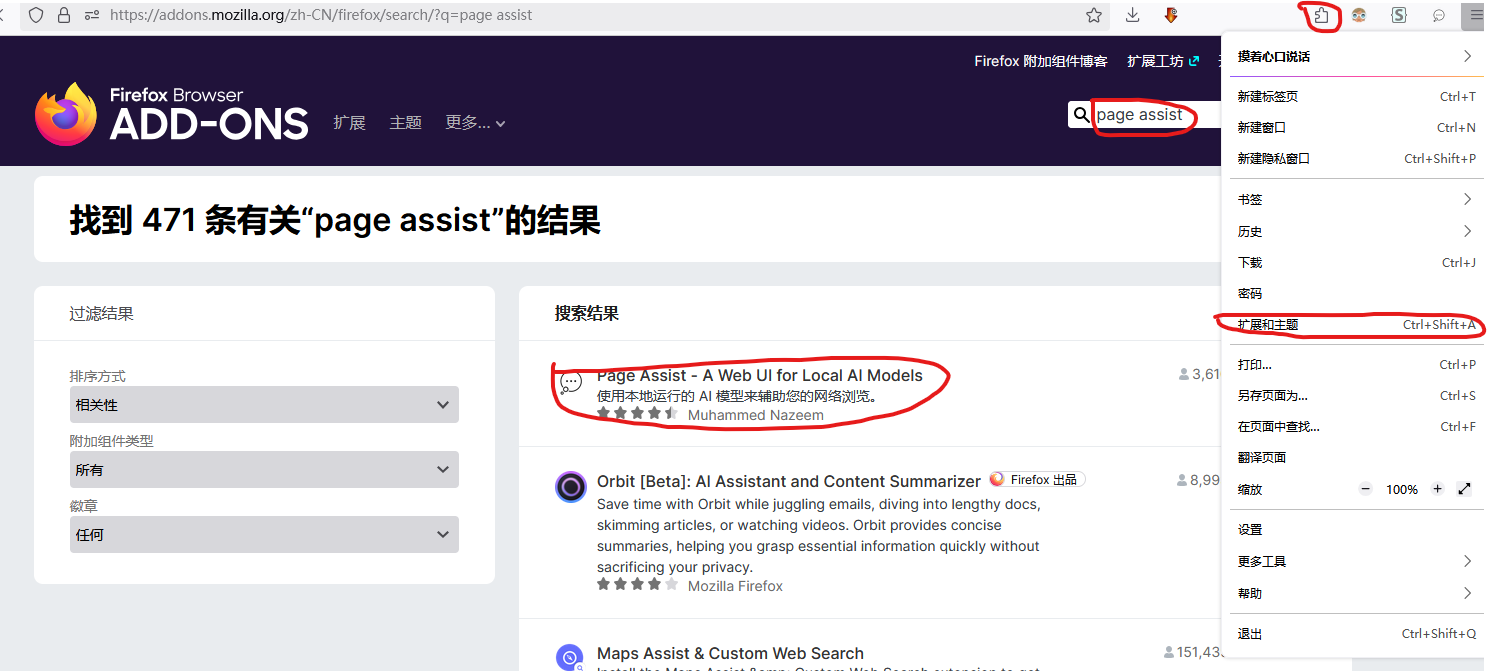

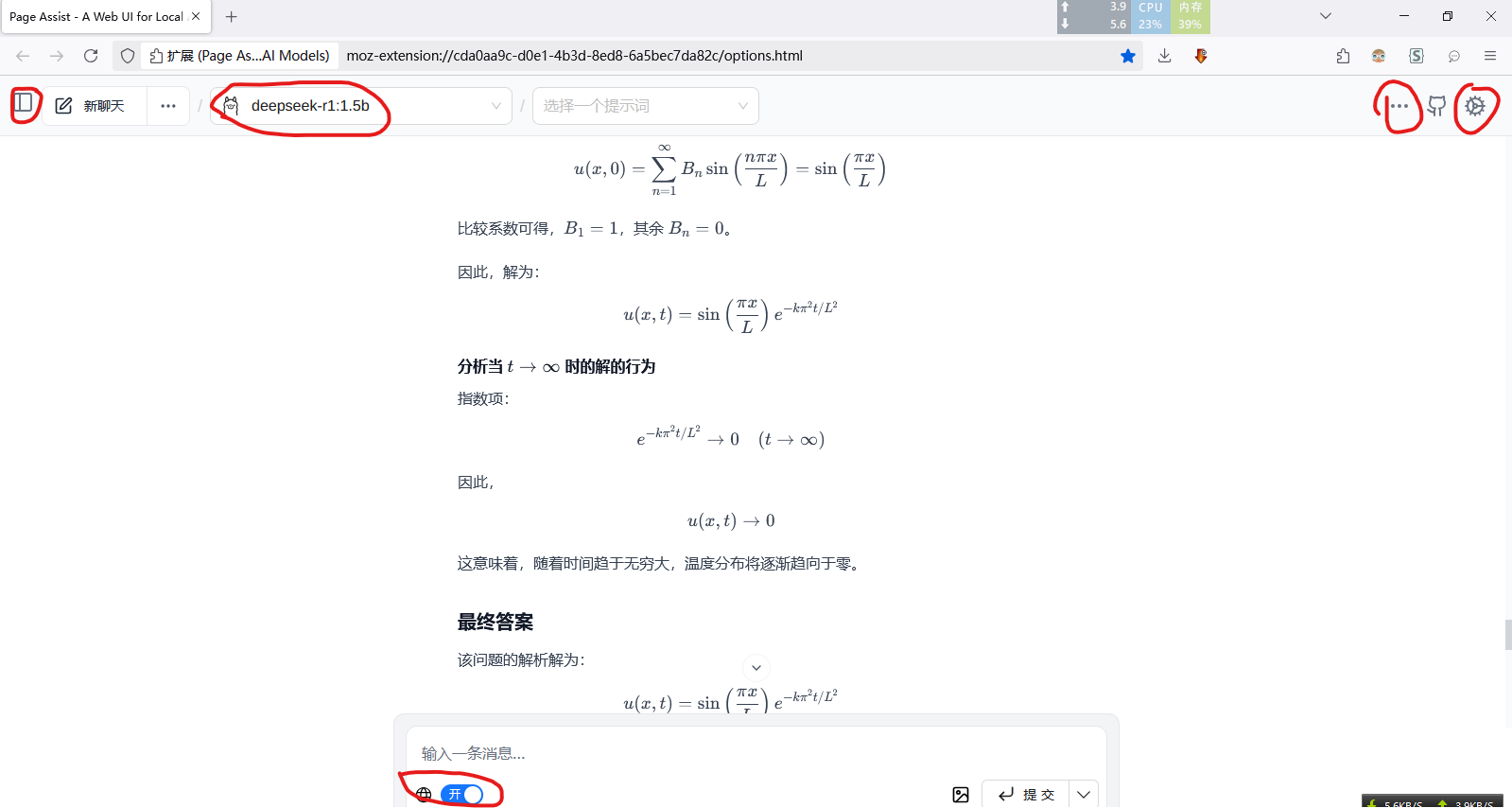

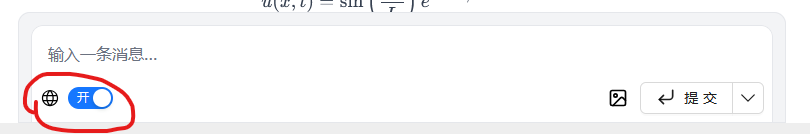

推荐用ollama+page assist插件。

下载ollama(ollama.com/),据说不好下载,有的地区下载不了。我也是当初花了半个小时到处找的。

七百多兆,我上传了

链接: https://pan.baidu.com/s/1aY0G7D4rpCe8pD-saRZehw?pwd=0000 提取码: 0000

下载后运行,

然后去ollama官网找代码。点到deepseek那,复制代码,用cmd运行,它自动从网上下载模型。

就下载完毕了。

代码如下:

ollama run deepseek-r1:1.5b ollama run deepseek-r1:7b ollama run deepseek-r1:14b ollama run deepseek-r1:32b据说32B的比较合适,看内存,数据的大小如果大于内存,肯定不行。

你的电脑系统也需要占用总内存的大概30%,剩下的内存你看够不够。

有个邪法,你把硬盘调成内存,具体步骤自己百度。整出500G的内存也能运行471G完整版的deepseekR1,缺点是奇慢无比(内存花半个小时的问题,用这个办法需要几天几个星期),而且你的硬盘会很快坏掉。这个基本上是极端不推荐,因为没有意义。

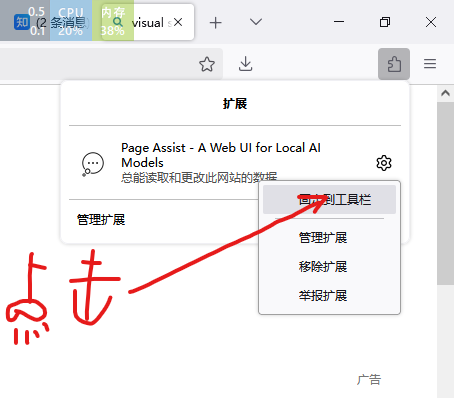

page assist是浏览器插件,Chrome的需要魔法,我推荐firefox,不用魔法,而且火狐浏览器挺好,我一直用不惯Chrome。

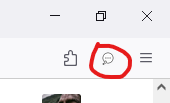

下载完,安装完,就可以在浏览器里调,把page assist图标放浏览器显眼处,打开,设置一通,别问我,你不是白痴,你要相信自己。

设置一项项点开,有把握的就修改,没把握的就默认。

page asaist甚至允许deepseek本地模型联网,比chatbox强多了。

你可以问时间,天气只怕不行,也不能推荐电影票。

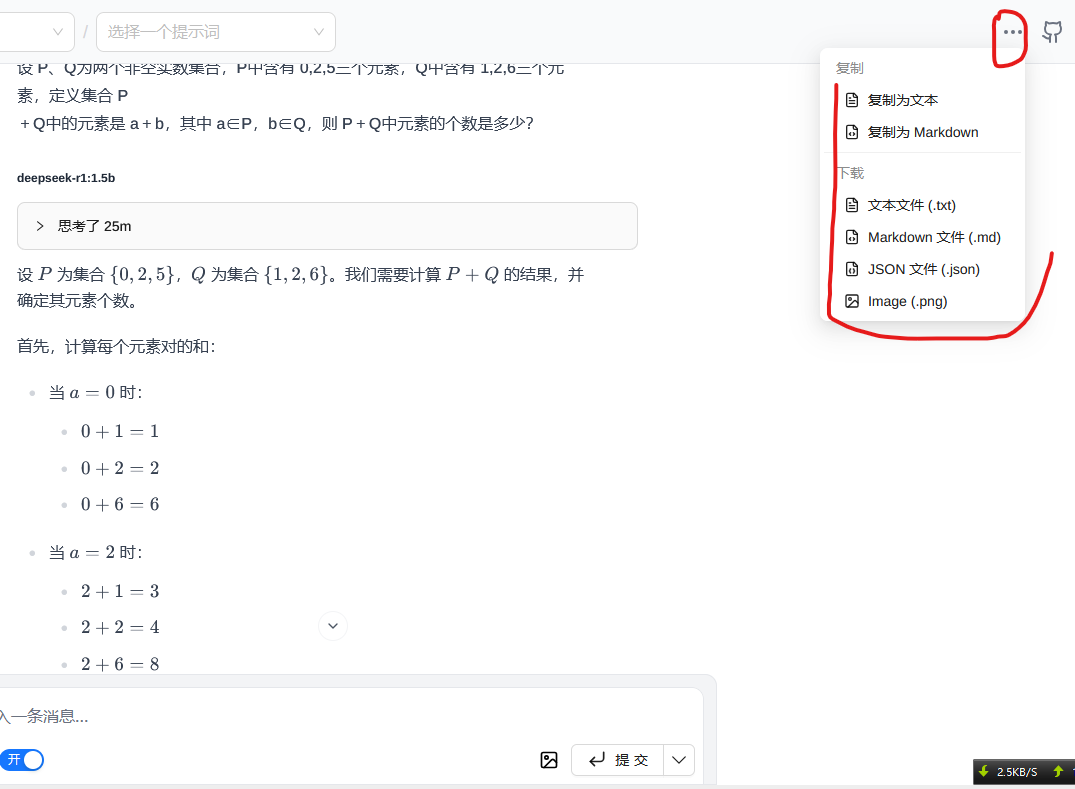

聊天数据还可以报保存为json文件等。

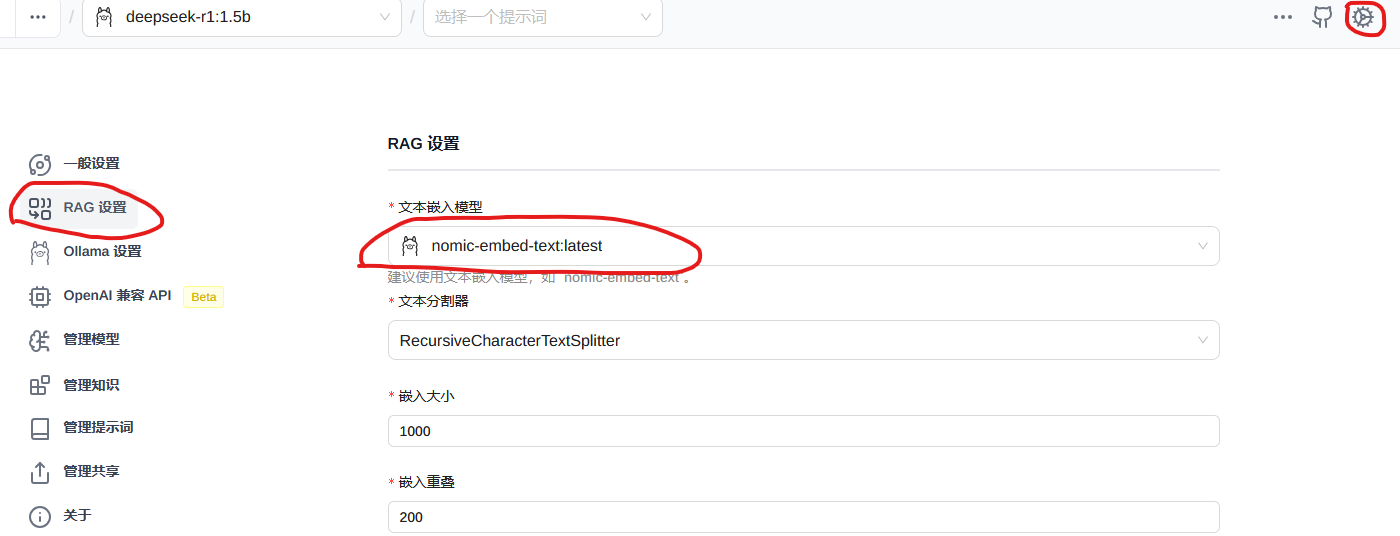

甚至还能RAG。也就是你喂他一些文档,他总结给你说。

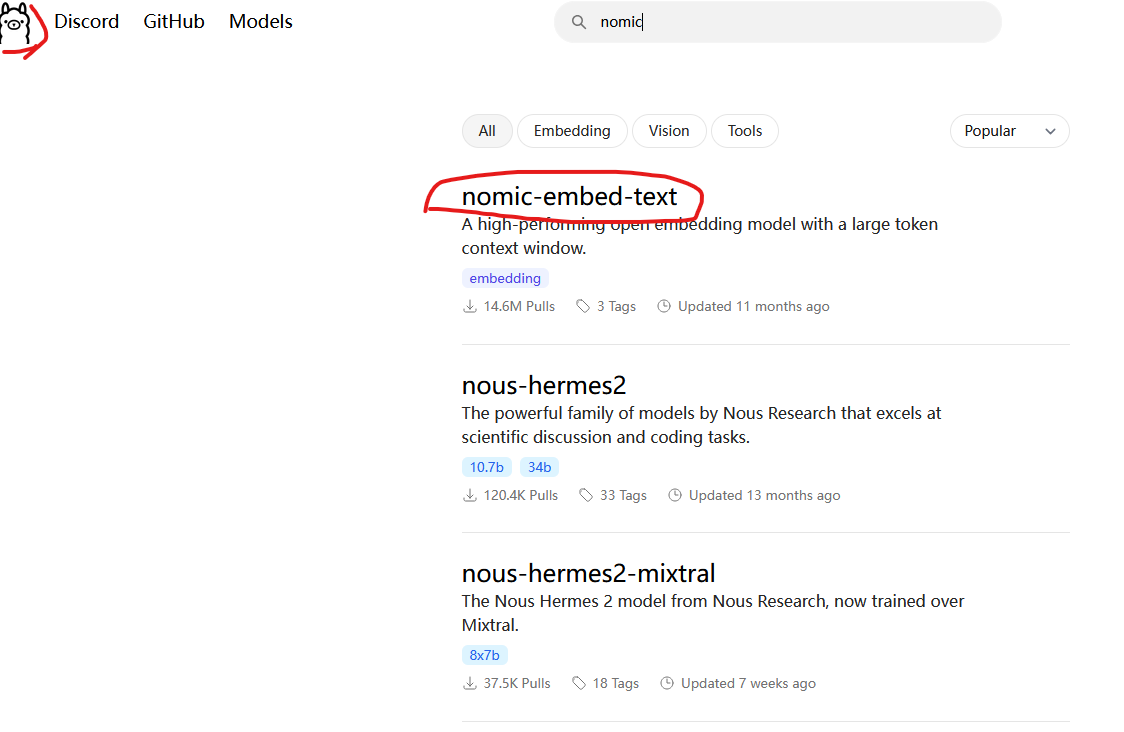

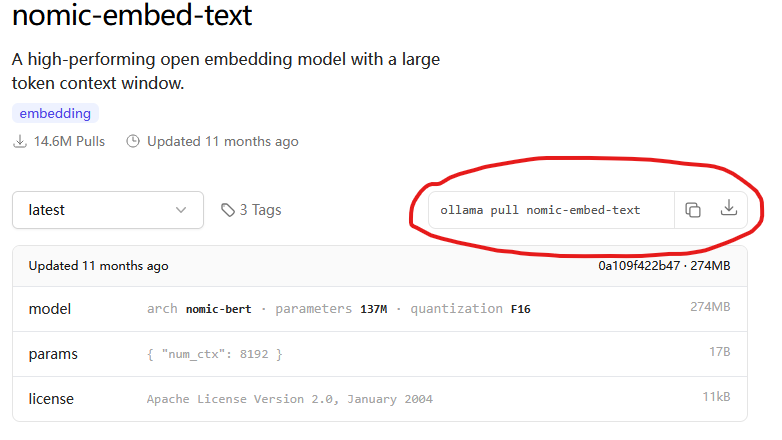

这个nomic-embed-latest也是从ollama下的

这个插件太强了,还能调黑色,免得晚上亮瞎狗眼

总结就三条:

部署很简单

性能很出色

配置可以很落后

什么10块h100(一块280万人民币),完全不需要,本地简单用是可以的。

能不能运行,看内存,内存只要够,区别只是快慢。现在8g内存才二三十块钱,两条就是16g内存,也就五六十块钱,插上就能跑。

不要被deepseekR1几万几百万人民币的硬件价格吓到,最小巧的1.5b已经很牛逼了。你去看看别的模型,参数还在几百M大有人在,零点几b而已,不到ds最小蒸馏模型的五分之一。所以最小蒸馏模型并不意味着它弱啊,他只是跟完整deepseek比才小。

像个宠物,给它一点问题,逗一逗它,多好。

需要注意的是:

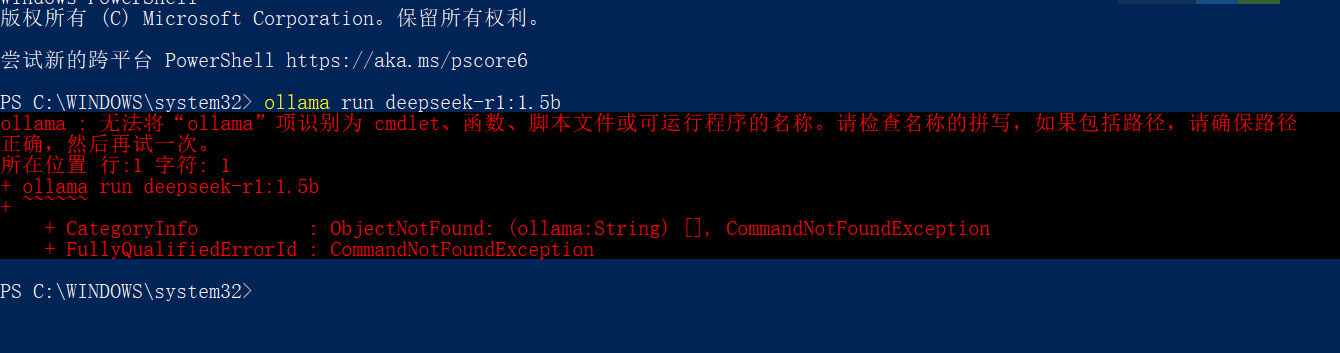

用cmd运行代码的时候,第一ollama需要处于运行状态,第二,你大概率是不能用管理员权限下的cmd运行代码,因为ollama在个人文件夹里,所以不要以管理员权限运行cmd。

第二个难点,ollama.exe在哪儿,在这:

C:\Users\用户名\AppData\Local\Programs\Ollama

把用户名改为自己的用户名即可。

一般都会在开始菜单里生成快捷方式的。

第三个难点,如何把page assist图标放在浏览器上

第四,如果你要用chrome也行,这是page assist的插件链接: https://pan.baidu.com/s/1Bug9amFTcJo_6BPW0FKmsA?pwd=0000 提取码: 0000 复制这段内容后打开百度网盘手机App,操作更方便哦

需要解压成文件夹,然后在chrome的扩展程序里打开开发者模式,选择“加载已解压的扩展程序”就可以了。

egde浏览器不行。

有点当年在windows7贴吧手把手帮助萌新的感觉了捏

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/250460.html