- Agent开发首选框架:LangChain

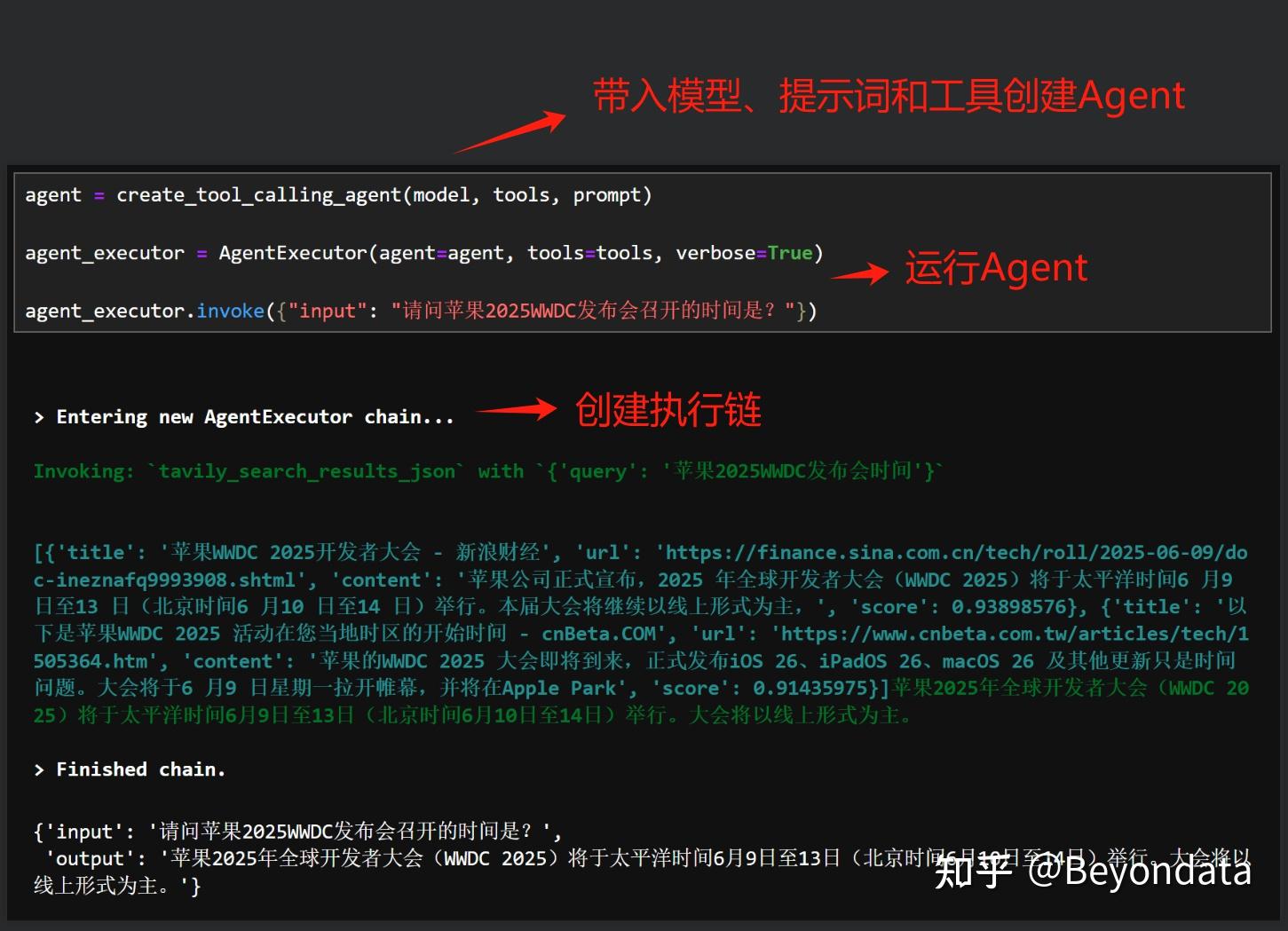

说到现阶段目前最流行、最通用的Agent开发框架,毫无疑问,肯定是LangChain。LangChain作为2022年就已经开源的元老级开发框架,历经数年的发展,其功能和生态都已非常完善,并且拥有数量众多的开发者。在我们团队统计的今年第一季度大模型岗位JD中,有90%以上的Agent开发岗位要求掌握LangChain,可以说LangChain就是目前最通用、最流行的Agent开发框架没有之一。

- LangChain的技术架构思路

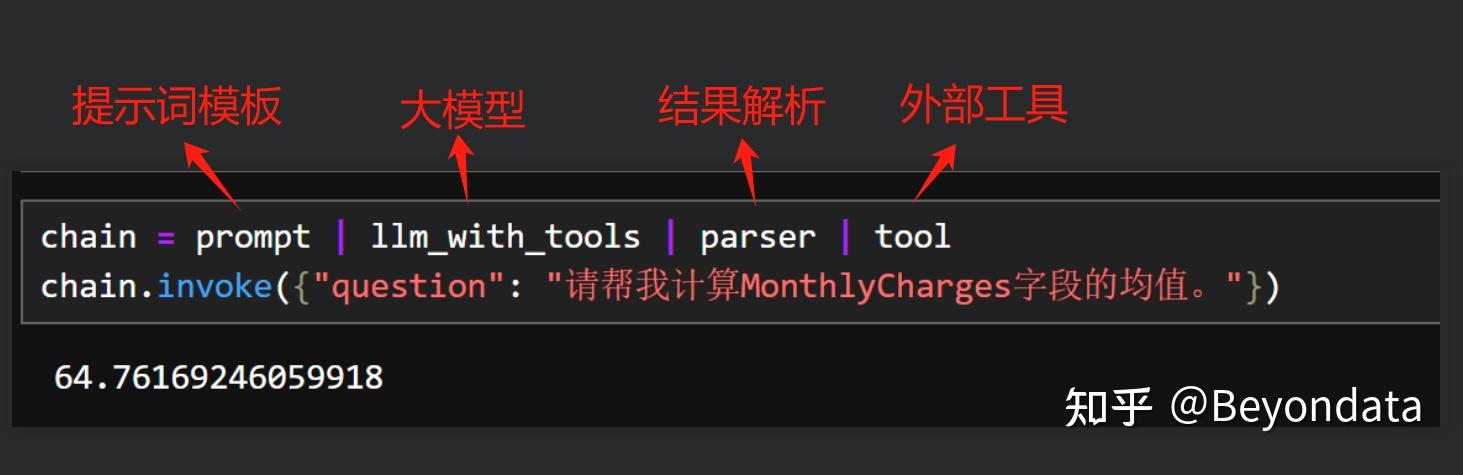

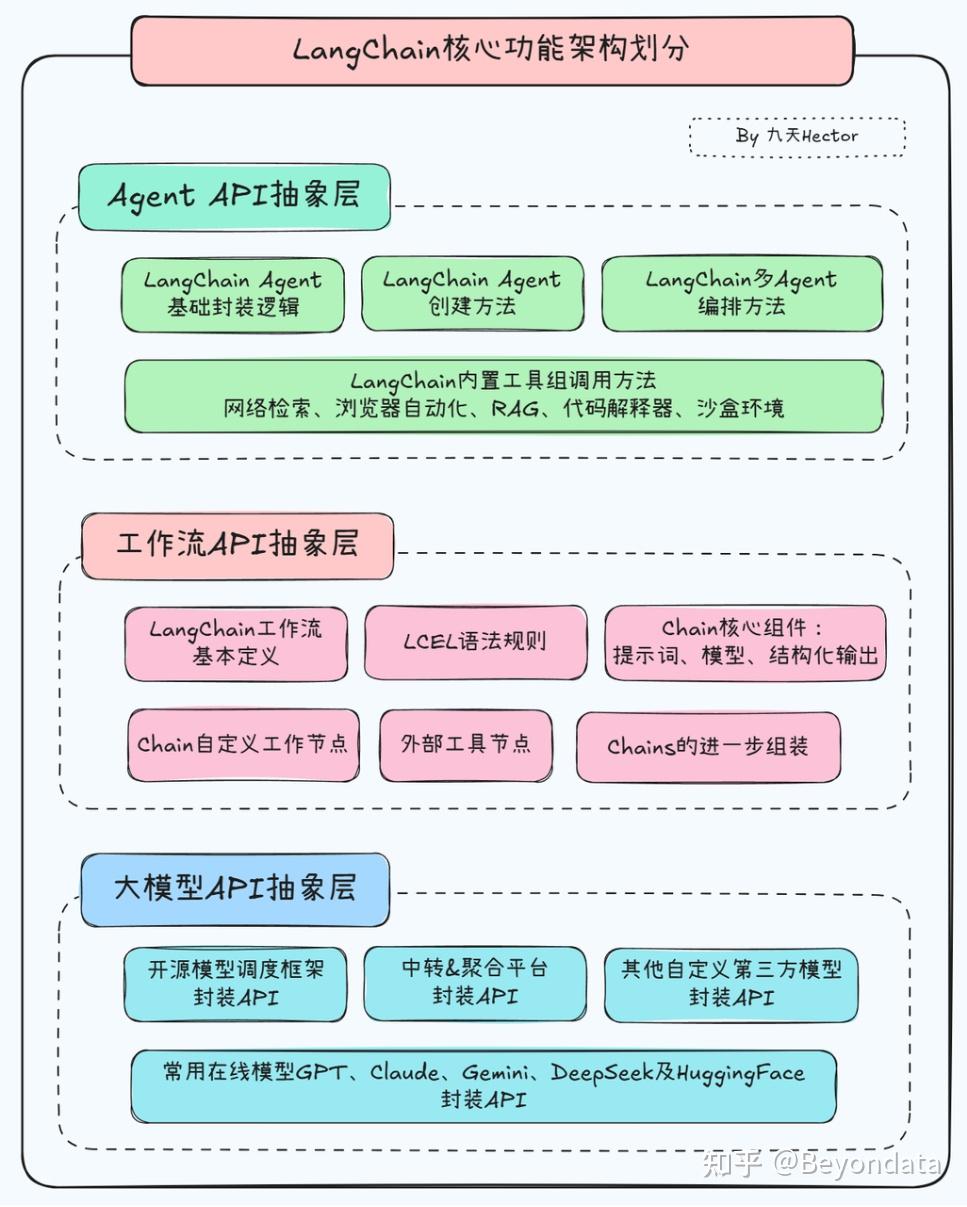

不过,由于LangChain诞生时间较早,在2022年末,GPT-3.5刚诞生之时,开发者对大模型的想象主要是希望用其搭建一个又一个工作流,而这也成为LangChain的核心技术目标,LangChain中“Chain”就是指链、也就是搭建工作流的意思。

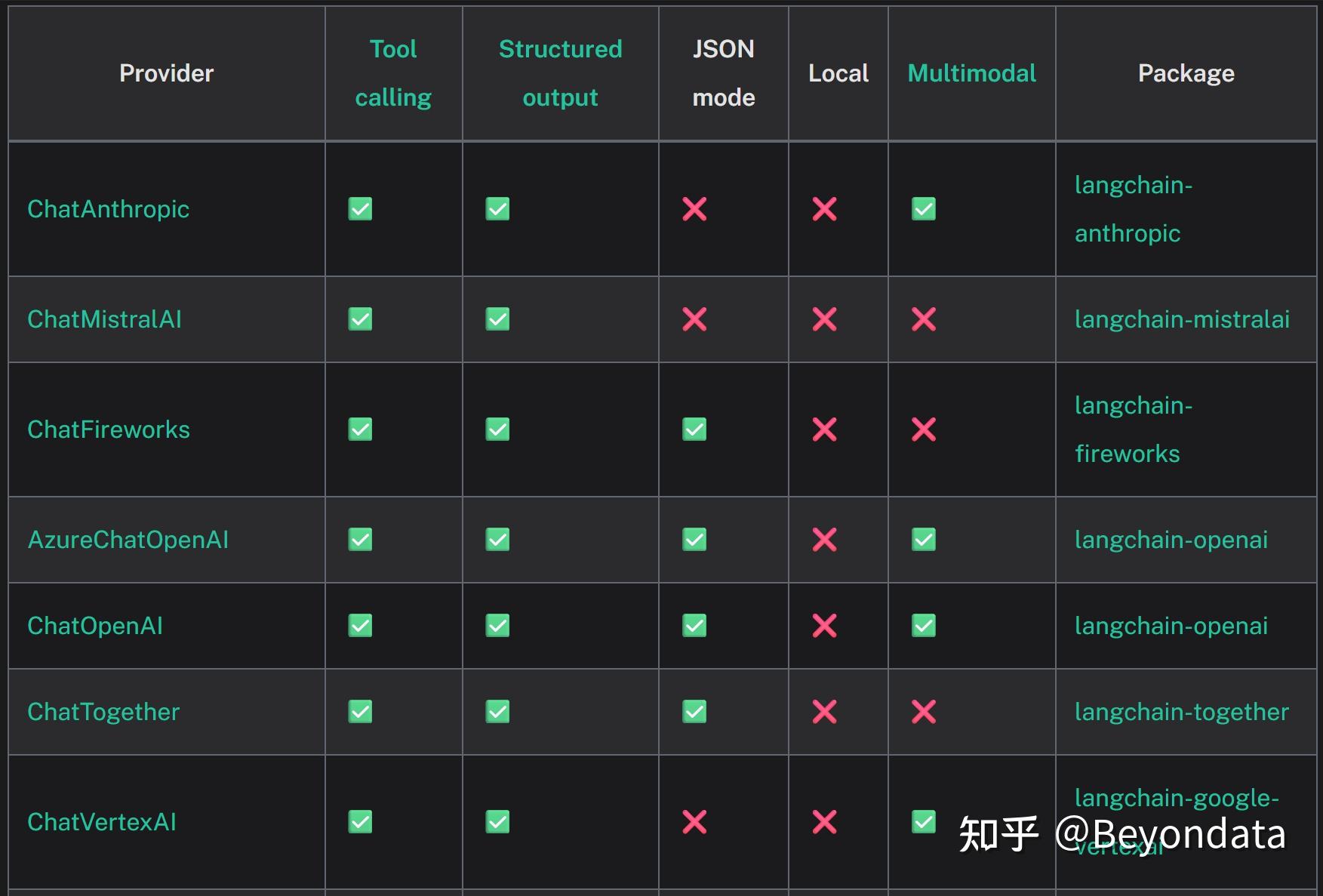

而且当时Function calling功能尚未诞生、大模型普遍性能较弱,并且2023年各类大模型百花齐放,但接口混乱、且上下文很短,开发者调用和开发都非常麻烦。因此,LangChain初始的核心架构有两层,第一层是围绕各类模型接入设置统一的接口,而为了让各类模型接入更加统一和稳定,LangChain不惜为不同的模型单独开发一个库,例如要接入Claude模型,我们就需要提前安装langchain-anthropic,而如果要接入DeepSeek模型,则需要安装langchain-deepseek。这么做虽然过程麻烦,但却能很好的保障开发过程的稳定性。

各类模型接入列表:https://python.langchain.com/docs/integrations/chat/

但是,大模型基座模型能力在飞速进化,例如目前最新一代的大模型,不仅拥有非常强悍的外部工具识别和调用能力,还原生就支持多工具并联和串联调用,而开发者对于大模型应用开发的需求也在快速变化,单纯的构建这种线性的工作流,可拓展性并不强。

不过,伴随着Agent开发飞速发展,很快LangChain就意识到,要真正满足新一代Agent开发需求,仅靠Agent API是完全不够的,因此在23年下半年,LangChain开源了一个实验性质项目——LangGraph。

更多体系教学,公号【赋范空间】打99

- LangGraph核心技术概念

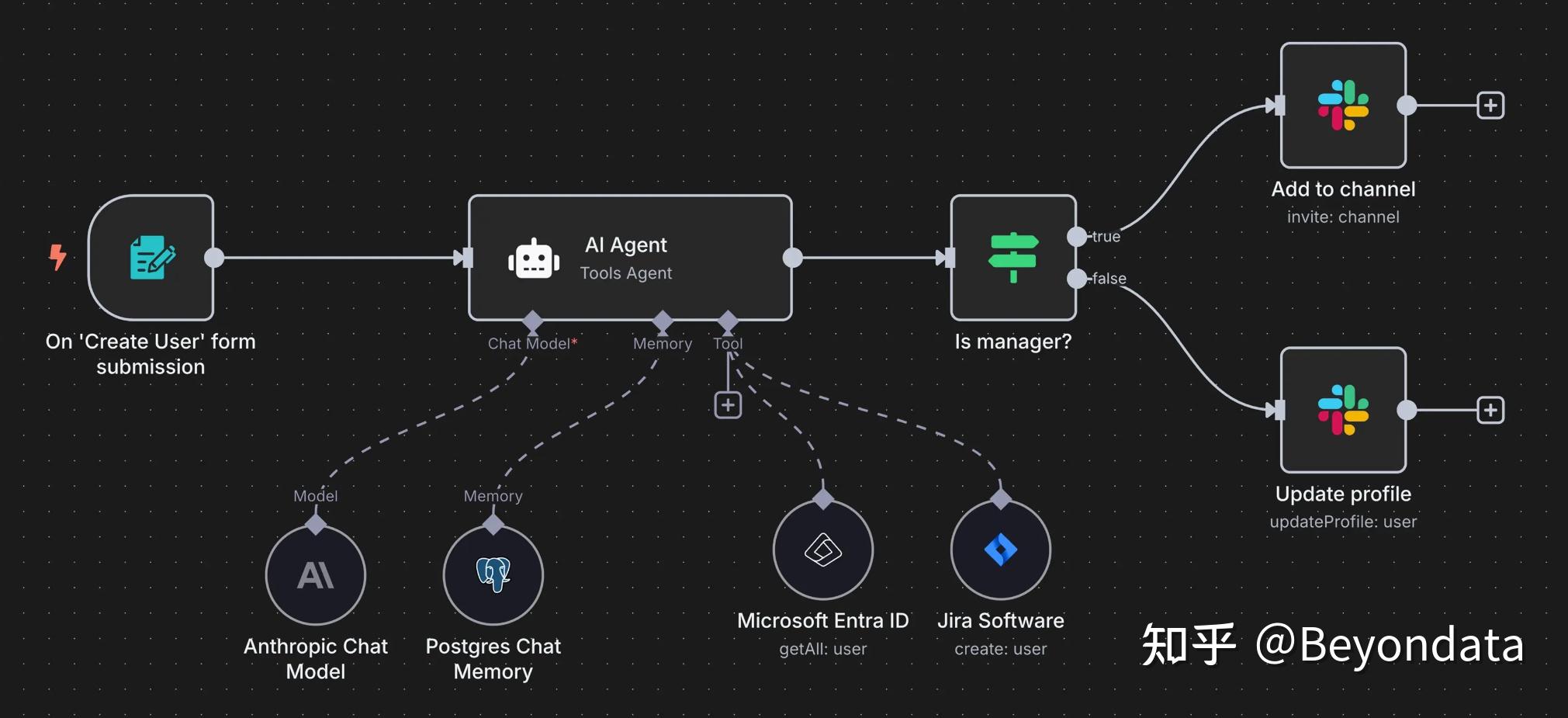

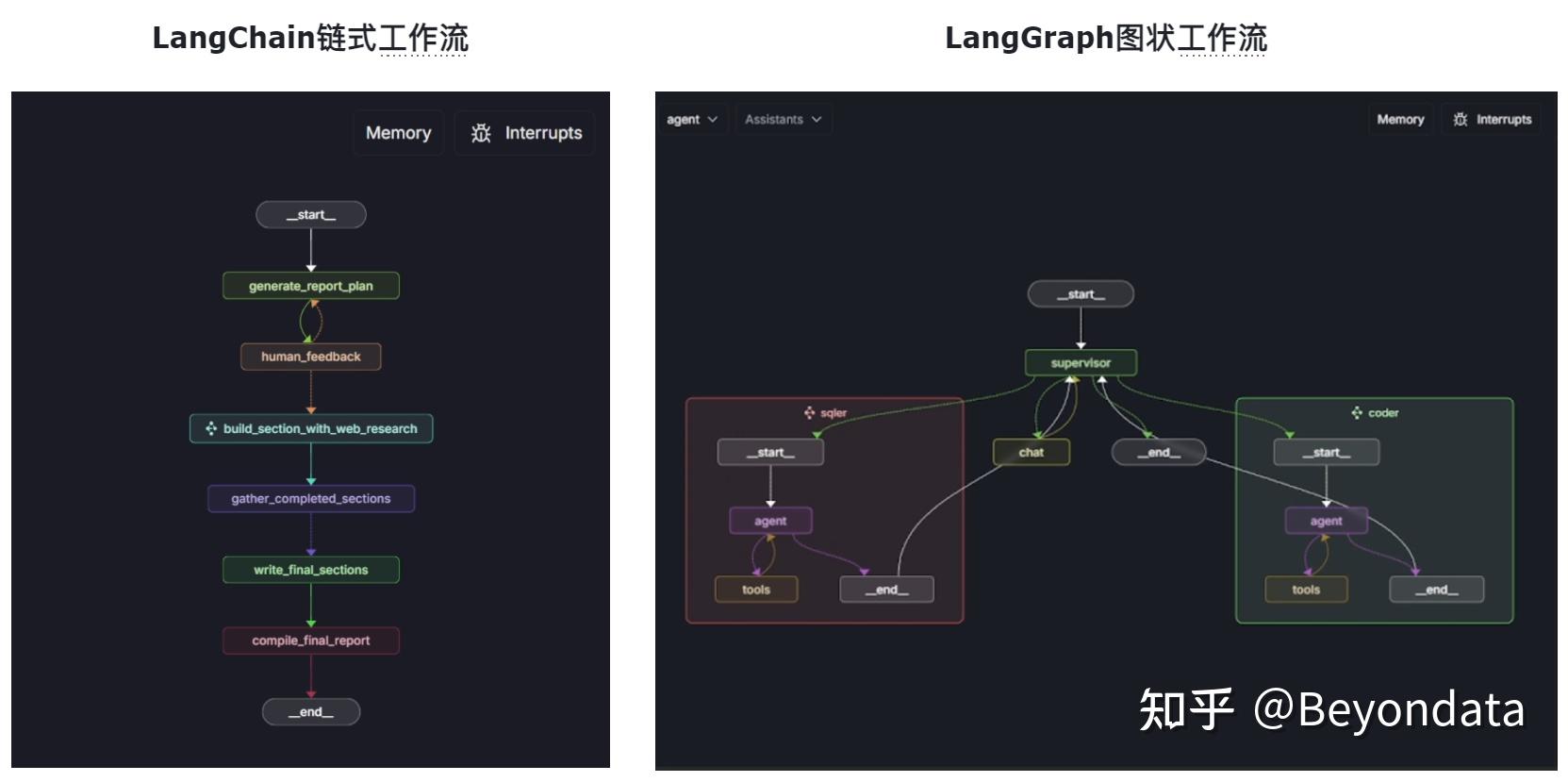

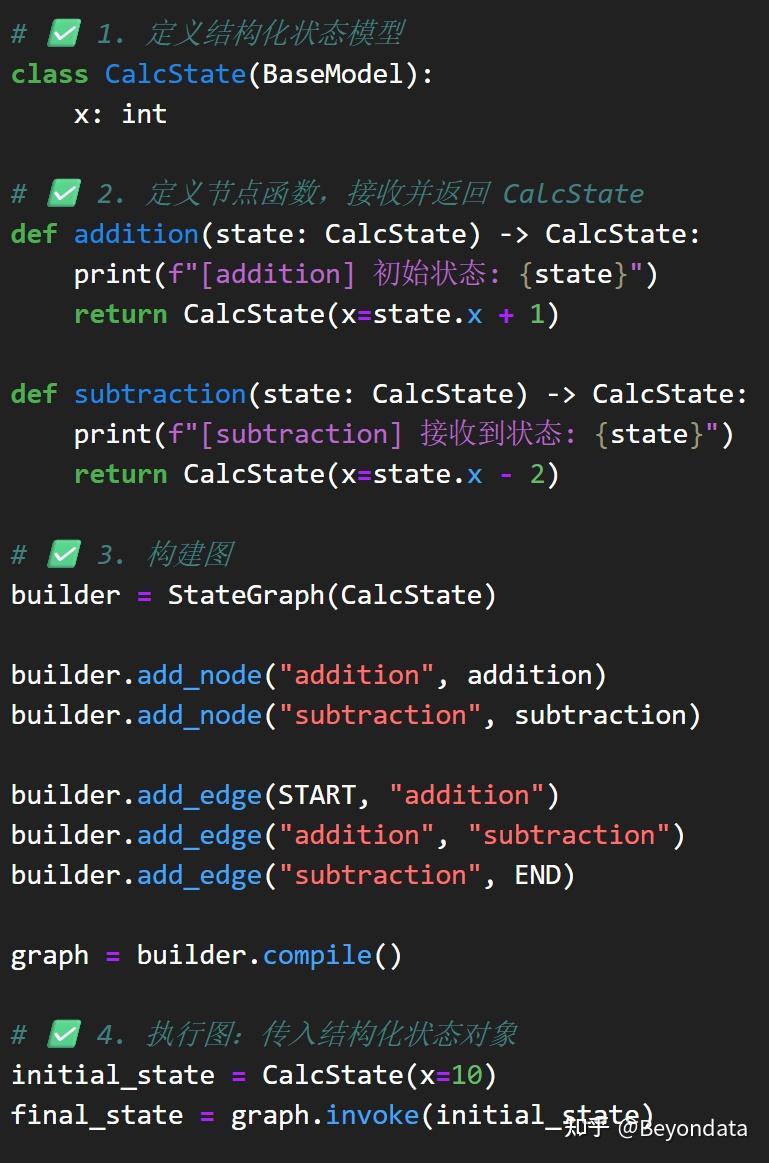

LangGraph和LangChain同宗同源,底层架构完全相同、接口完全相通。从开发者角度来说,LangGraph也是使用LangChain底层API来接入各类大模型、LangGraph也完全兼容LangChain内置的一系列工具。换而言之,LangGraph的核心功能都是依托LangChain来完成。但是和LangChain的链式工作流哲学完全不同的是,LangGraph的基础哲学是构建图结构的工作流,并引入“状态”这一核心概念来描绘任务执行情况,从而拓展了LangChain LCEL链式语法的功能灵活程度。

- LangGraph的本质:LangChain的高级编排工具

不过需要注意的是,LangGraph是基于LangChain进行的构建,无论图结构多复杂,单独每个任务执行链路仍然是现行的,其背后仍然是靠着LangChain的Chain来实现的。因此我们可以这么来描述LangChain和LangGraph之间的关系,LangGraph是LangChain工作流的高级编排工具,其中“高级”之处就是LangGraph能按照图结构来编排工作流。

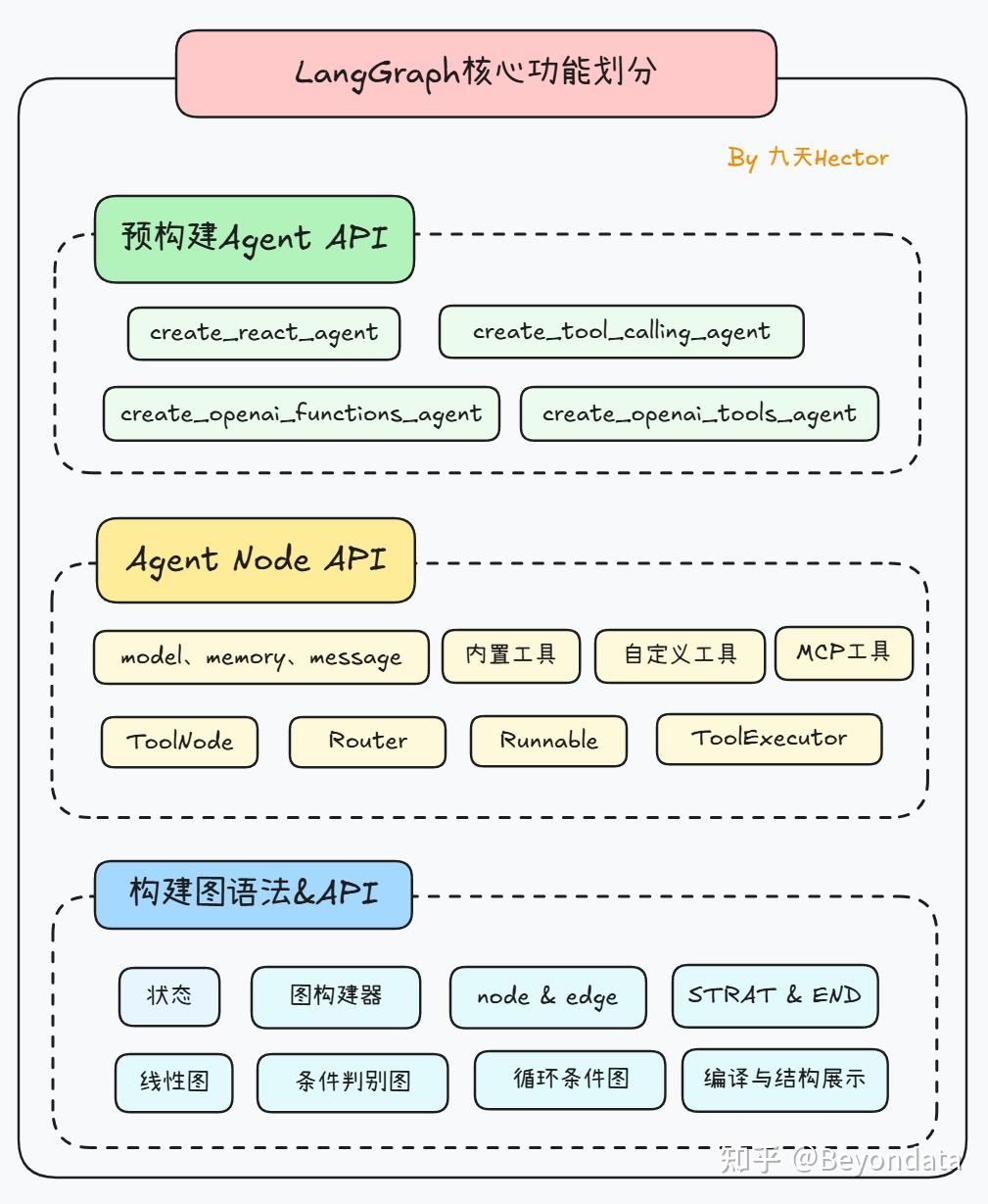

- LangGraph的技术架构

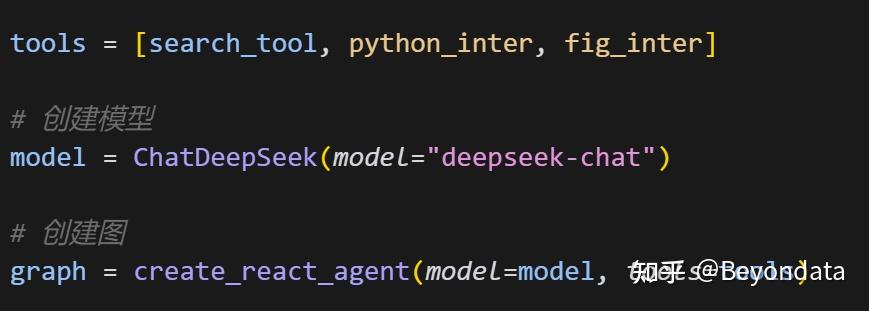

- LangGraph的高层封装API

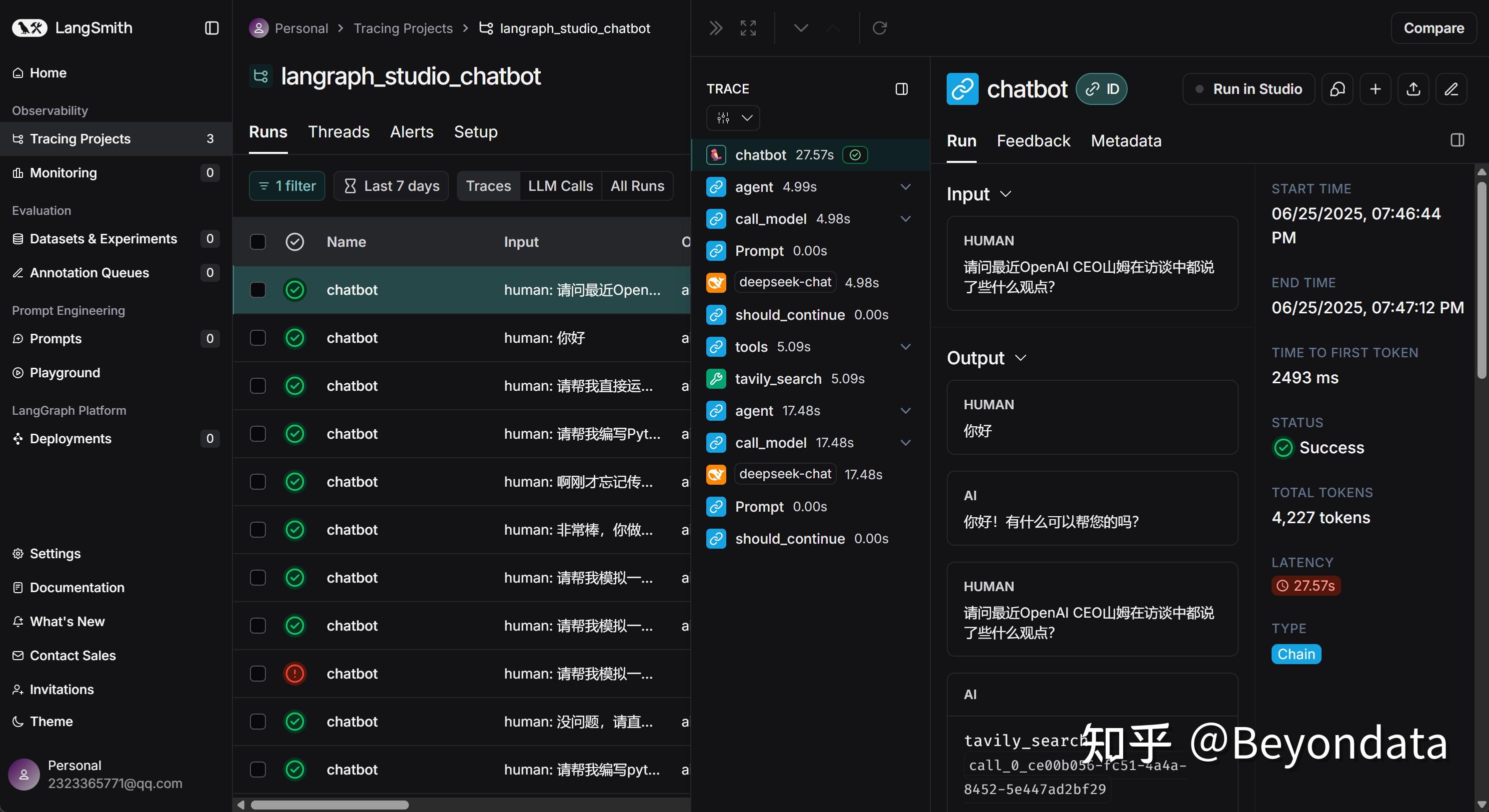

- LangGraph运行监控框架:LangSmith

LangSmith官网地址:https://docs.smith.langchain.com/

LangSmith 是一款用于构建、调试、可视化和评估 LLM 工作流的全生命周期开发平台。它聚焦的不是模型训练,而是我们在构建 AI 应用(尤其是多工具 Agent、LangChain/Graph)时的「可视化调试」、「性能评估」与「运维监控」。

| 功能类别 | 描述 | 场景 |

| 调试追踪(Trace Debugging) | 可视化展示每个 LLM 调用、工具调用、Prompt、输入输出 | Agent 调试、Graph 调用链分析 |

| 评估(Evaluation) | 支持自动评估多个输入样本的回答质量,可自定义评分维度 | 批量测试 LLM 表现、A/B 对比 |

| 会话记录(Sessions / Runs) | 每次 chain 或 agent 的运行都会被记录为一个 Run,可溯源 | Agent 问题诊断、用户问题分析 |

| Prompt 管理器(Prompt Registry) | 保存、版本控制、调用历史 prompt | 多版本 prompt 迭代测试 |

| 流量监控(Telemetry) | 实时查看运行次数、错误率、响应时间等 | 在生产环境中监控 Agent 质量 |

| Dataset 管理 | 管理自定义测试集样本,支持自动化评估 | 微调前评估、数据对比实验 |

| LangGraph 可视化 | 对 LangGraph 中每个节点运行情况进行实时可视化展示 | Graph 执行追踪 |

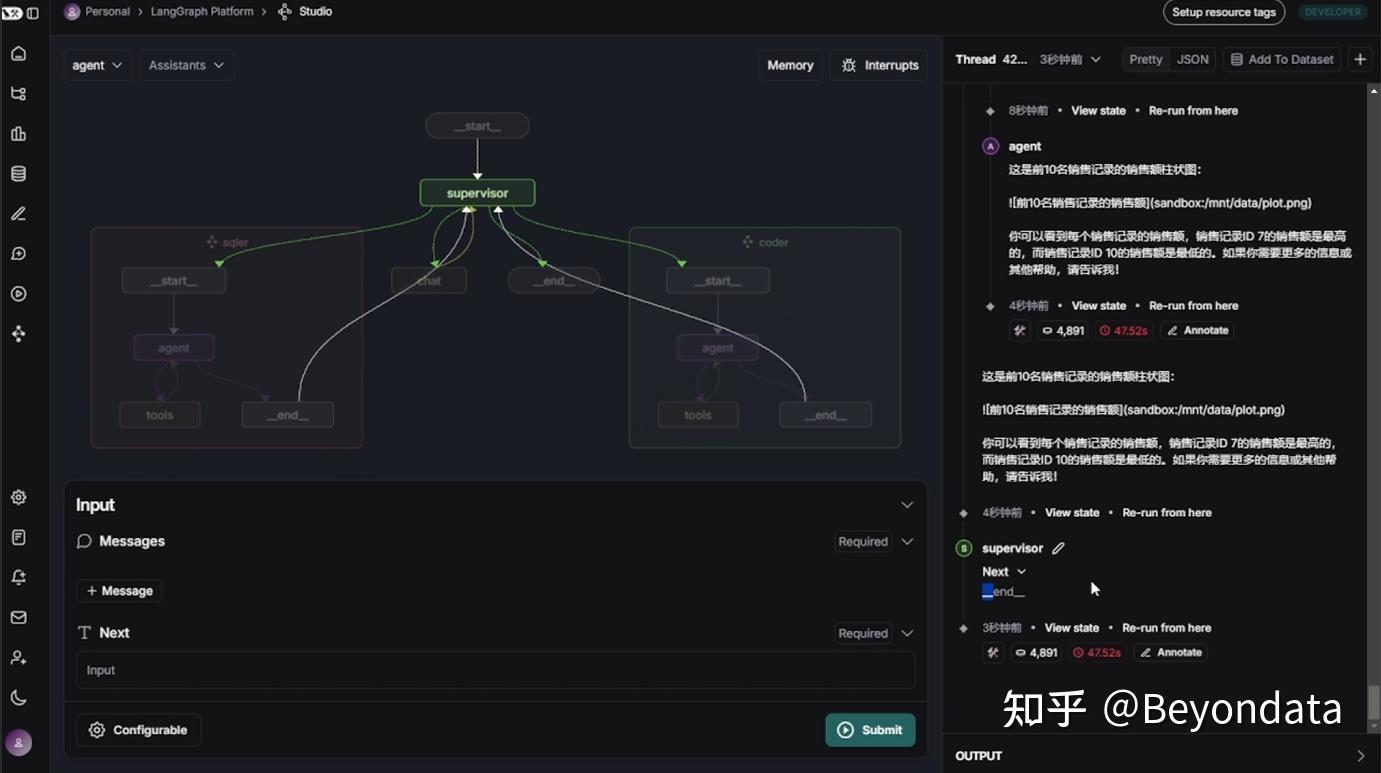

- LangGraph图结构可视化与调试框架:LangGraph Studio

LangGraph Studio官网地址:https://www.langgraph.dev/studio

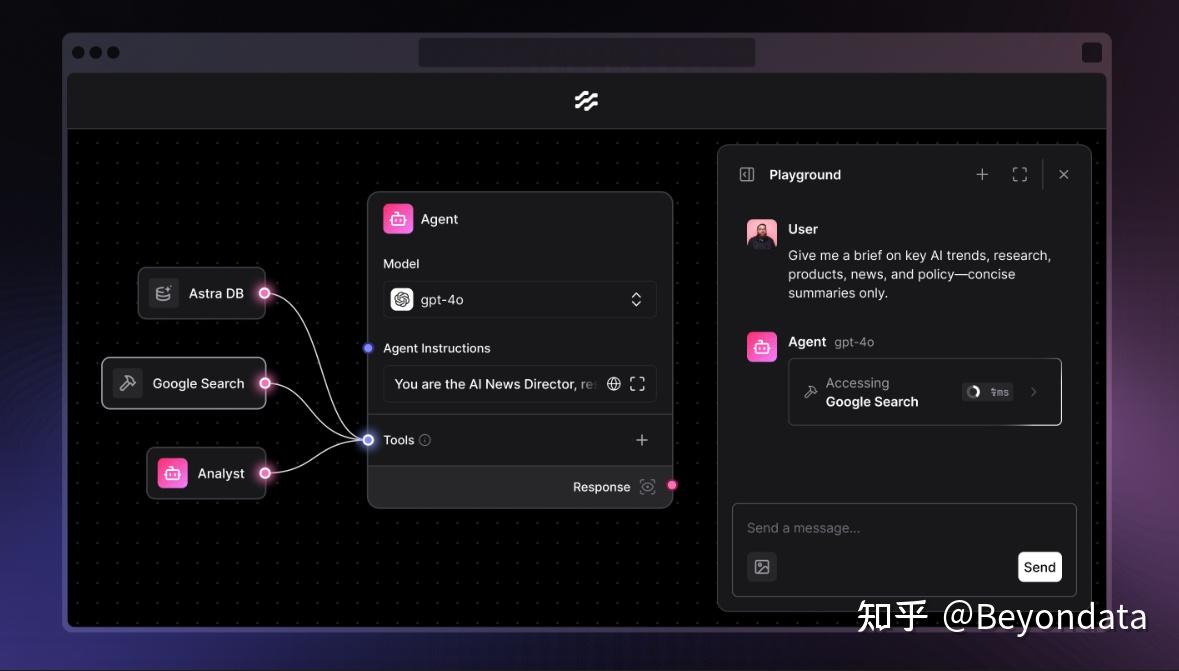

LangGraph Studio 是一个用于可视化构建、测试、分享和部署智能体流程图的图形化 IDE + 运行平台。

| 功能模块 | 说明 | 应用场景 |

| Graph 编辑器 | 以拖拽方式创建节点(工具、模型、Router)并连接 | 零代码构建 LangGraph |

| 节点配置器 | 每个节点可配置 LLM、工具、Router 逻辑、Memory | 灵活定制 Agent 控制流 |

| ▶️ 即时测试 | 输入 prompt 可在浏览器中运行整个图 | 实时测试执行结果 |

| 云端保存 / 分享 | 将构建的 Graph 保存为公共 URL / 私人项目 | 团队协作,Demo 分享 |

| Tool 插件管理 | 可连接自定义工具(MCP)、HTTP API、Python 工具 | 插件式扩展 Agent 功能 |

| Router 分支节点 | 创建条件分支,支持 if/else 路由 | 决策型智能体 |

| 上传文档 / 多模态 | 可以上传文件(如 PDF)并嵌入进图中处理流程 | RAG 结构、OCR、图文问答等 |

| Prompt 输入/预览 | 编辑 prompt 并观察其运行效果 | Prompt 工程调试 |

| 一键部署 | 将 Graph 部署为可被 Agent Chat UI 使用的 Assistant | 快速集成到前端 |

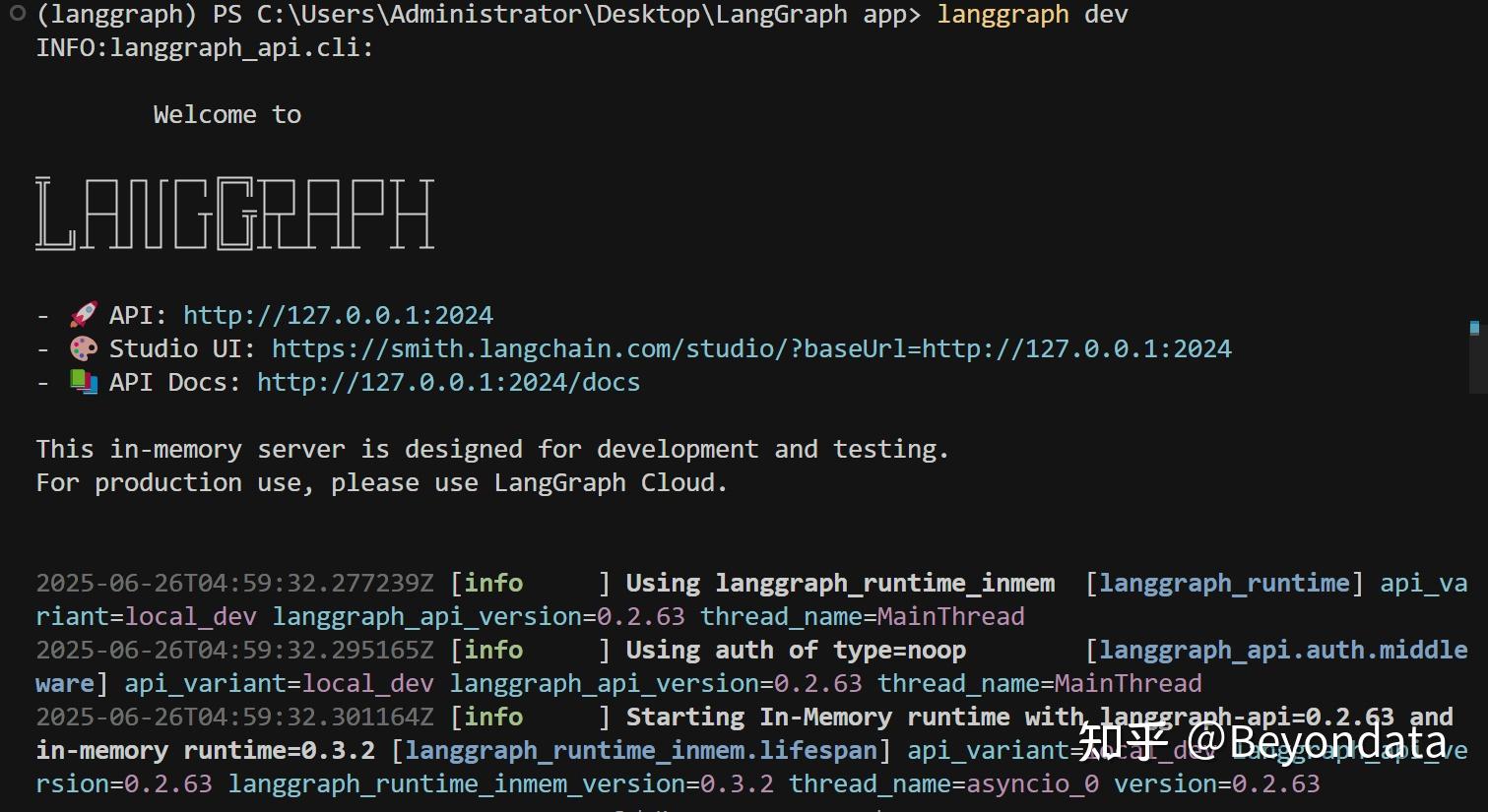

- LangGraph服务部署工具:LangGraph Cli

LangGraph Cli官网地址:https://www.langgraph.dev/ (需要代理环境)

LangGraph CLI 是用于本地启动、调试、测试和托管 LangGraph 智能体图的开发者命令行工具。

| 功能类别 | 命令示例 | 说明 |

| ✅ 启动 Graph 服务 | langgraph dev | 启动 Graph 的开发服务器,供前端(如 Agent Chat UI)调用 |

| 测试 Graph 输入 | langgraph run graph:graph –input ‘{“input”: “你好”}’ | 本地 CLI 输入测试,输出结果 |

| 管理项目结构 | langgraph init | 初始化一个标准 Graph 项目目录结构 |

| 部署 Graph(未来) | langgraph deploy(预留) | 发布 graph 至 LangGraph 云端(已对接 Studio) |

| 显示 Assistant 列表 | langgraph list | 显示当前 graph 中有哪些 assistant(即 entrypoint) |

| 重载运行时 | 自动热重载 | 修改 graph.py 时,dev 模式自动重启生效 |

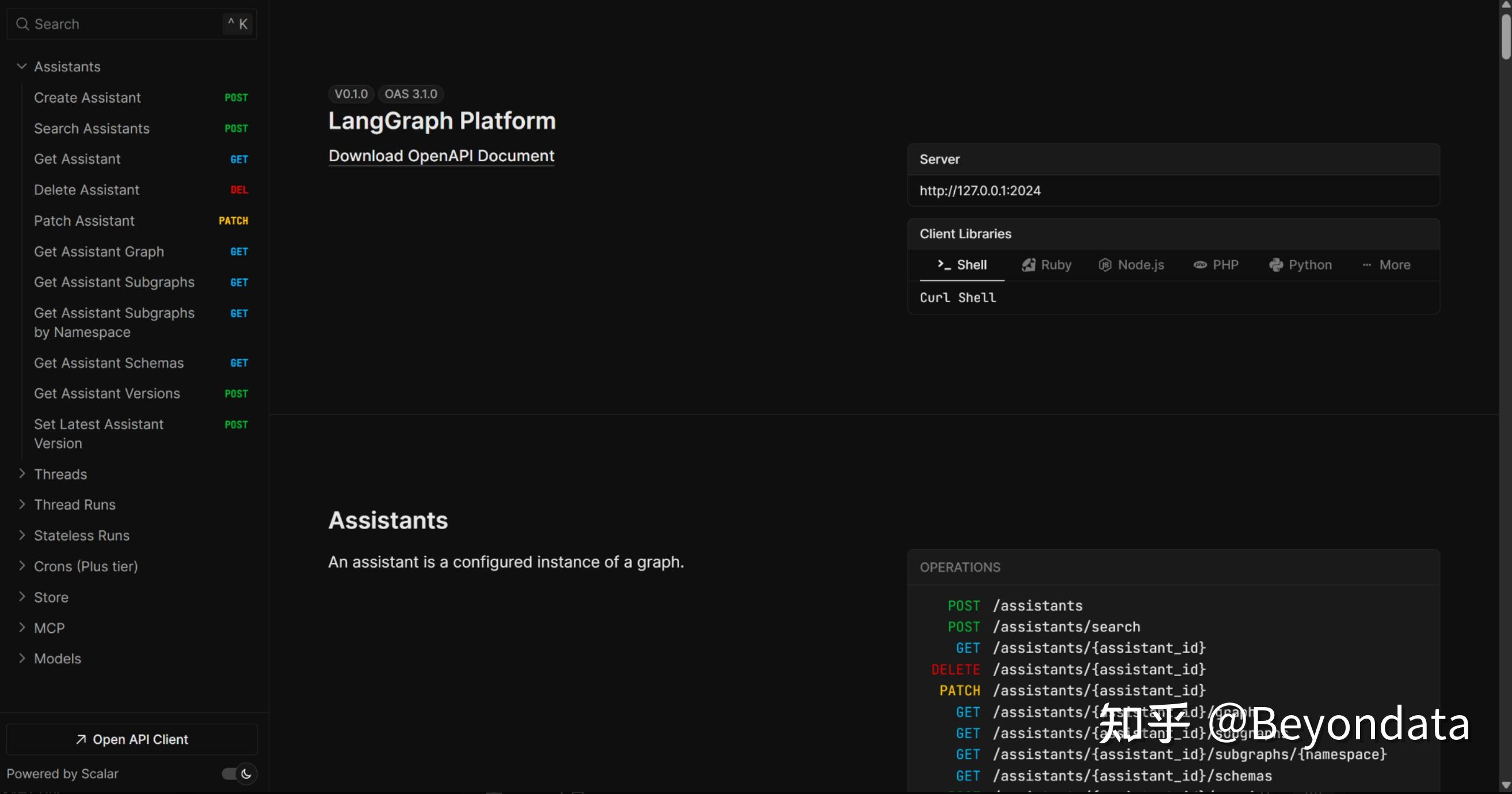

而一旦应用成功部署上线,LangGraph Cli还会非常贴心的提供后端接口说明文档:

而对于LangGraph构建的智能体,除了能够本地部署外,官方也提供了云托管服务,借助LangGraph Platform,开发者可以将构建的智能体 Graph部署到云端,并允许公开访问,同时支持支持长时间运行、文件上传、外部 API 调用、Studio 集成等功能。

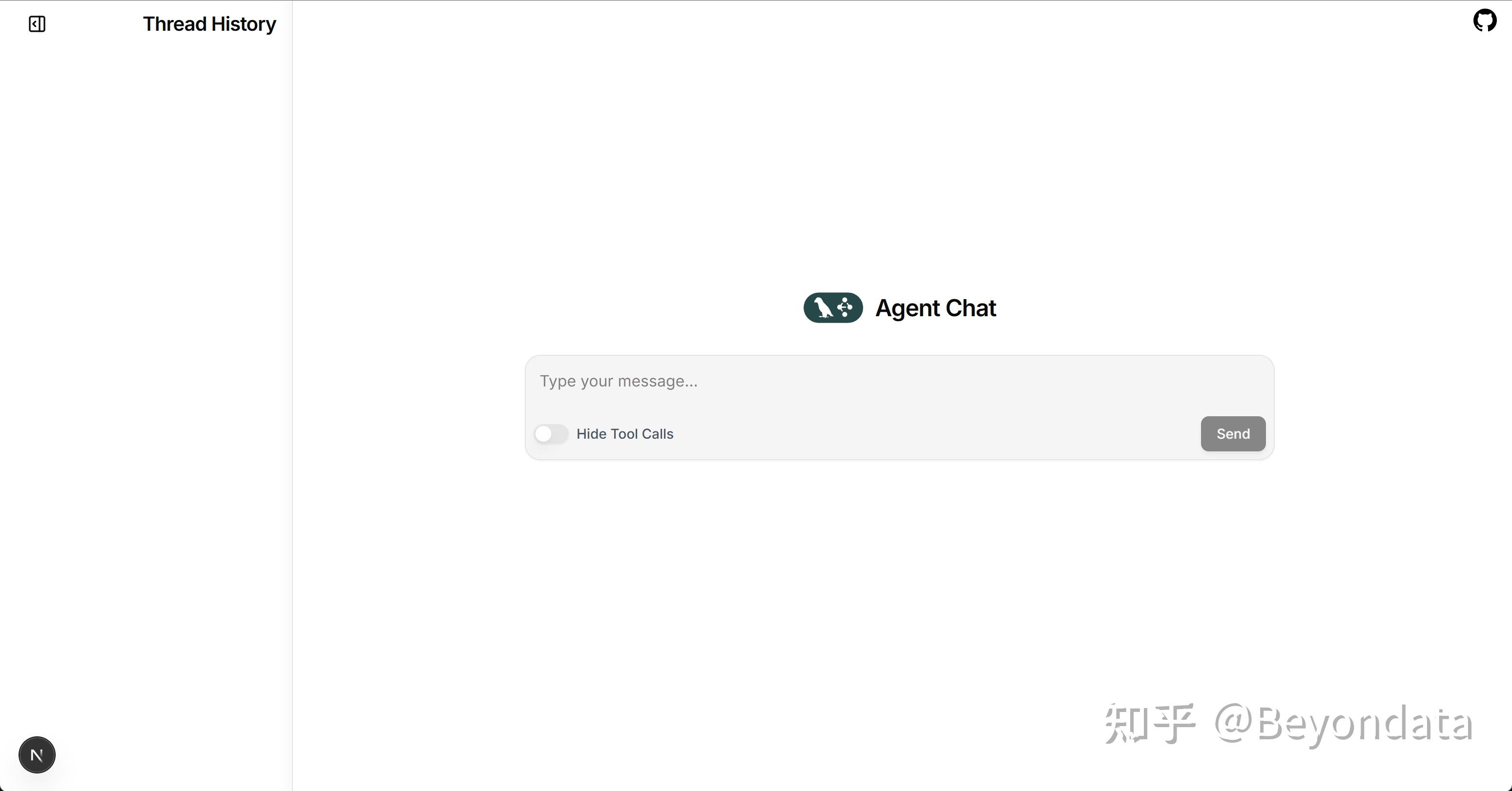

- LangGraph Agent前端可视化工具:Agent Chat UI

| 功能模块 | 描述 | 应用场景 |

| 多轮对话框 | 类似 ChatGPT 的输入区域,支持多轮上下文 | 用户提问,Agent 回复 |

| 工具调用轨迹显示 | 显示每个调用的工具、参数、结果(结构化) | Agent 推理透明化 |

| 上传 PDF / 图片 | 支持上传文档、图片、嵌入多模态输入 | RAG、OCR、图像问答 |

| 文件面板 | 可查看上传历史文件、删除、重新引用 | 管理文档输入 |

| Assistant 切换 | 支持切换不同 Assistant(Graph entry) | 一键切换模型能力(如 math / weather) |

| 插件支持 | 与 MCP 工具、LangGraph 图打通 | 工具式 Agent 调用 |

| 调试视图 | 显示每轮 Agent 的思维过程和中间状态 | Prompt 调试、模型行为分析 |

| 云部署支持 | 支持接入远端 Graph API(如 dev 服务器) | 前后端分离部署 |

| 与 LangSmith 对接(可选) | 若后端启用 tracing,可同步显示运行 trace | 调试闭环 |

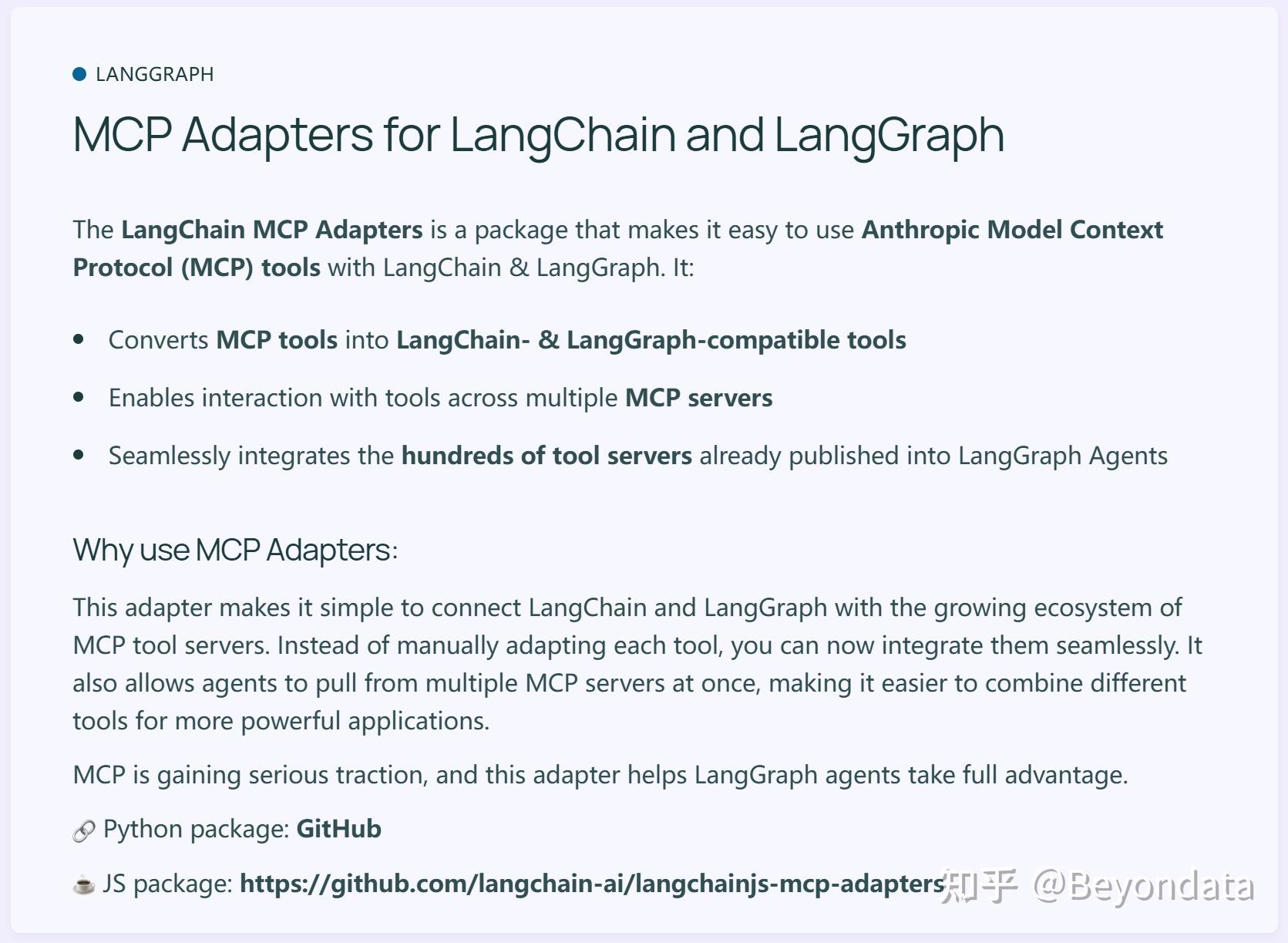

- LangGraph内置工具库与MCP调用组件

此外,LangChain是最早支持MCP的开发框架之一,借助langchain-mcp-adapters,LangChain和LangGraph便可快速接入各类MCP工具。

- LangGraph VS LangGraph

更多体系教学,公号【赋范空间】打99

- LangGraph VS OpenAI Agents SDK

- LangGraph VS 谷歌ADK

本文较长,建议点赞收藏,以免遗失。更多AI大模型应用开发学习视频内容和资料,尽在聚客AI学院(官网-聚客AI学院大模型应用开发微调项目实践课程学习平台)

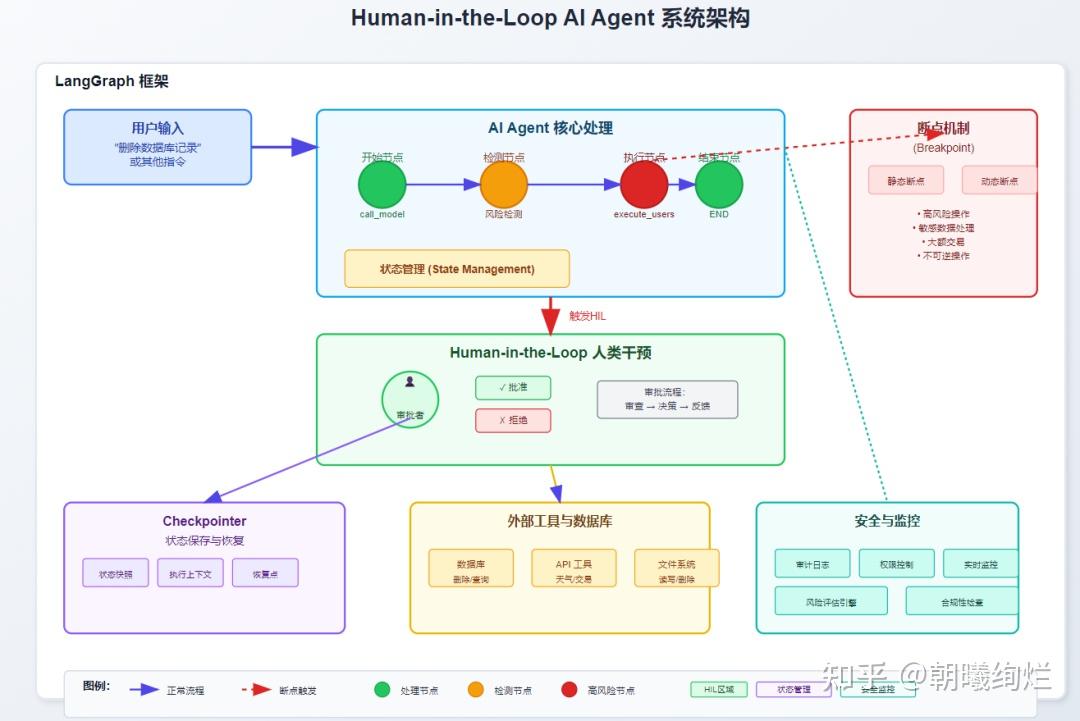

前言:Human-in-the-Loop(HIL)是一种AI系统设计模式,它允许人类在AI Agent的决策过程中介入并提供反馈或决策。在HIL系统中,AI Agent在执行某些关键操作前会暂停,等待人类的审批或输入,然后再继续执行。 这种模式特别适用于高风险或敏感的操作场景

在金融交易、数据库管理、医疗诊断等高危场景中,AI Agent的自主决策存在两类核心风险:

- 不可逆操作(如删除数据库记录、大额转账)

- 模糊决策场景(如医疗方案推荐)

传统解决方案采用全流程人工审批,导致效率骤降50%以上。而HIL架构通过精准断点控制,仅在关键节点介入,实现效率与安全的动态平衡。

class State(TypedDict):user_input: str model_response: str user_approval: str # 人类决策状态容器- 通过有向图节点(开始/检测/执行/结束)流转任务

- 执行节点(红色)自动隔离高风险操作

| 断点类型 | 触发机制 | 适用场景 |

|---|---|---|

| 静态断点 | 预置在execute_users节点前 | 已知高危操作(如DELETE) |

| 动态断点 | 实时检测交易金额>阈值 | 金融风控等弹性场景 |

memory = MemorySaver() # 状态快照存储 graph = builder.compile(checkpointer=memory, interrupt_before=[“execute_users”])

- 保存运行时上下文(变量/环境/执行位置)

- 人类决策后从断点精确恢复执行

tool_node = ToolNode(tools) # 封装外部API workflow.add_conditional_edges(“agent”, should_continue, { "continue": "action", "run_tool": "action", # 高风险工具调用路径 "end": END

})

- 动态拦截delete_weather_from_db等危险工具调用

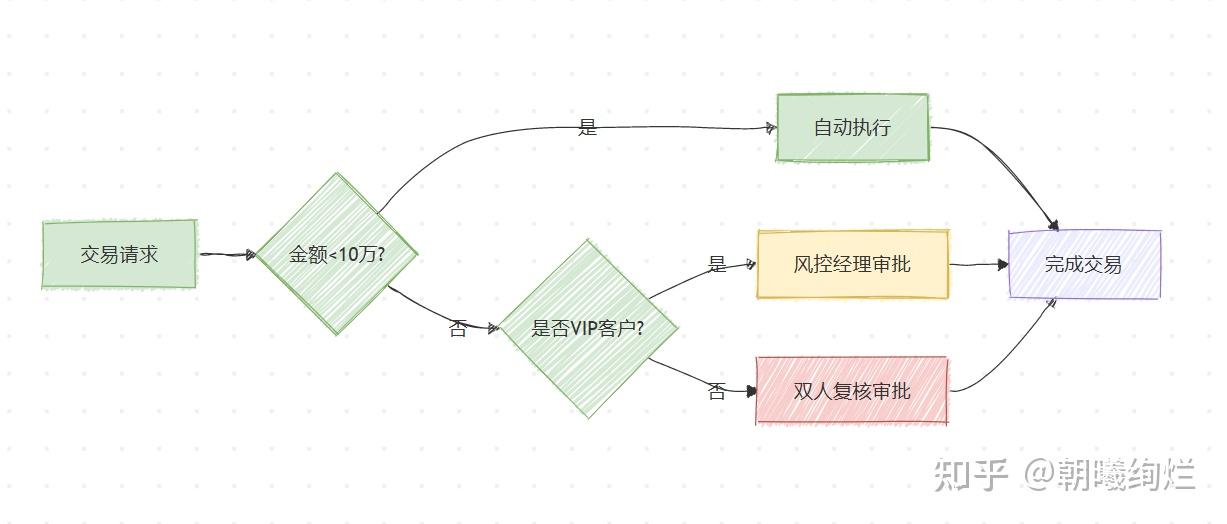

AI Agent处理用户转账请求,当金额>10万元时触发人工审批

# 动态断点检测逻辑 def should_continue(state): last_msg = state["messages"][-1] if last_msg.tool_calls and last_msg.tool_calls[0]["name"] == "bank_transfer": transfer_amount = parse_amount(last_msg.tool_calls[0]["args"]) # 解析交易金额 if transfer_amount > : # 动态阈值检测 return "require_approval" # 触发审批断点 return "continue"

# 审批节点绑定 workflow.add_conditional_edges(“agent”, should_continue, {

"require_approval": "approval_node", # 转向人工审批 "continue": "action"

})

- 用户输入:”向账户6217转账150万元”

- Agent解析请求,识别为bank_transfer工具调用

- 动态断点检测金额超阈值 → 暂停并保存状态

- 风控人员收到审批请求(含转账详情/风险评估)

- 人工决策后更新状态: snapshot.values[“user_approval”] = “批准” # 或“拒绝”

- Agent从断点继续执行或终止

- 增量状态存储:仅保存变更数据(Delta State)减少序列化开销

- 断点预测预热:提前加载审批人员工作台减少等待延迟

- 审批超时熔断:设置2小时自动拒绝机制防止流程阻塞

# 四眼原则审批实现 def quadruple_approval(state): approvals = state.get("approvals", []) if len(approvals) < 4: raise InterruptionRequired # 触发二次中断 return all(approval == "通过" for approval in approvals[-4:])

笔者结语:随着AI技术的不断进步,AI Agent将在更多领域发挥重要作用。然而,技术的力量必须与人类的智慧相结合,才能真正实现安全、高效的自动化。 Human-in-the-Loop(HIL)正是实现这一目标的关键技术。由于文章篇幅有限,关于AI Agent相关技术知识点,我整理成了一个2W字的文档,粉丝朋友自行领取:《想要读懂AI Agent(智能体),看这里就够了》

如果本次分享对你有所帮助,记得告诉身边有需要的朋友,"我们正在经历的不仅是技术迭代,而是认知革命。当人类智慧与机器智能形成共生关系,文明的火种将在新的维度延续。"在这场波澜壮阔的文明跃迁中,主动拥抱AI时代,就是掌握打开新纪元之门的密钥,让每个人都能在智能化的星辰大海中,找到属于自己的航向。

简单来说:

1、LangGraph是一种用“图”的方式配置AI Agent的技术,是Langchain生态的一部分。因为Agent要用到Function Call、Tools和执行代码,程序的运行流程有时候是个黑盒子,比如LLM的返回也许就触发不了Tools,造成了Agent的运行难于定义与预测。采用LangGraph,可以按程序员所熟知的“流程图”的方式框定Agent的执行流程,让Agent执行更透明一些。

2、Autogen是微软出品,侧重点在生成代码和执行代码。

3、Crewai是一个多智体框架,用于定义多个Agent相互协作来完成用户设定的任务,比如一个软件开发Agent应用场景中,有需求师、设计师、编码员等,就适合用Crewai。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/250545.html