作为一款功能强大的个人AI助理网关,OpenClaw能让你在Telegram、Discord、WhatsApp等多个平台无缝调用Claude、GPT-4、Google Gemini等顶级AI模型,且全程保障数据隐私安全。但是因为Openclaw无法支持Windows原生用户,只能通过WSL2配置,虽然现在网络上有很多的教程,但是翻了好多安装Openclaw的博文大多都是Mac/Linux安装的方法,Windows环境下的一般都一笔带过,考虑到Windows用户基数和大家使用习惯的问题,我还是决定出一集Windows环境下的详细攻略。本文将结合多篇实战指南的核心经验,从环境检查、安装部署、使用技巧到问题排查,为Windows用户提供一份详尽且可复现的安装使用手册,即使是零基础的程序设计人员也能轻松上手。

OpenClaw并非传统意义上的AI模型,而是一款"AI助理网关"工具——它本身不提供AI计算能力,是通过整合各类AI服务的API,为用户提供统一的调用入口和多平台交互能力,今年三月OpenClaw 以 245,119 颗 Star 登顶 GitHub 榜首,仅用 3 个月就超越了存在 40 年的 Linux 内核,成为 GitHub 有史以来最受欢迎的开源项目。其核心优势体现在三个方面:

- 多平台无缝集成:一次配置即可在Telegram、Discord、WhatsApp、iMessage等多个即时通讯工具中调用AI,无需切换应用;

- 多模型自由切换:支持Anthropic Claude、OpenAI GPT系列、Google Gemini等主流AI模型,可根据需求动态切换,避免单一平台依赖;

- 数据隐私自主可控:所有对话数据仅存储在本地设备或指定服务器,不经过第三方中转,解决了隐私泄露的后顾之忧;

- 高度可扩展:支持自定义插件、提示词模板、快捷键调用等功能,可根据个人需求打造专属AI工作流。

对于程序设计人员而言,OpenClaw不仅是日常办公的效率工具,更是二次开发的理想基座——通过其开放的API接口,可将AI能力快速集成到自己的项目中,实现自动化代码生成、文档解析、问题排查等场景。

与macOS和Linux不同,OpenClaw目前不支持原生Windows系统运行,必须通过WSL2(Windows Subsystem for Linux 2)实现兼容。这是因为OpenClaw依赖Node.js的部分底层模块,而这些模块在Windows原生环境中存在兼容性问题。因此,Windows用户安装OpenClaw的核心前提是:正确配置WSL2环境。

除WSL2外,还需满足以下系统要求:

- Windows系统版本:Windows 10 2004版及以上(建议Windows 11,兼容性更佳);

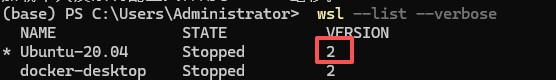

- WSL2版本:必须为Version 2(Version 1不兼容);

- Node.js版本:≥22(强烈推荐v24+,经实测v24版本能显著减少依赖报错);

- 硬件配置:至少4GB内存(推荐8GB+,避免WSL2内存不足)、1GB以上磁盘空间;

- 网络环境:需能访问海外网络(用于调用Anthropic、OpenAI等API);

- API密钥:至少准备一个AI服务提供商的API密钥(推荐Claude API,体验**)。

在开始安装前,需依次完成以下检查,避免后续踩坑:

1.3.1 检查Windows系统版本

按下Win + R,输入winver,查看系统版本是否满足要求:

- Windows 10:需为2004版(内部版本19041)及以上;

- Windows 11:无特殊版本限制,默认支持WSL2。

若版本过低,需通过Windows更新升级系统:设置 → Windows更新 → 检查更新,安装所有必要更新后重启电脑。

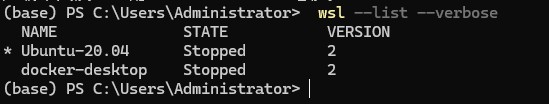

1.3.2 检查WSL2是否已安装及版本

按下Win + X,选择"Windows终端(管理员)",打开PowerShell;

执行以下命令查看已安装的WSL发行版及版本:

GPT plus 代充 只需 145wsl --list --verbose

若输出结果中"VERSION"列显示2,且存在Ubuntu等发行版,则可直接进入后续配置(只需要有Ubuntu-20.04这一行就行,下面是因为我安装了docker显示的docker桌面应用);

若显示1或无结果,则需按以下步骤安装/升级WSL2:

1.3.3 安装/升级WSL2(关键步骤)

启用WSL和虚拟机平台功能:

wsl --install

该命令会自动启用"适用于Linux的Windows子系统"和"虚拟机平台"功能,并下载安装Ubuntu发行版。

等待安装完成后,重启电脑;

升级WSL到Version 2(一般Win11默认安装2,Win10默认为1,所以Win10用户需要查看并更改):

GPT plus 代充 只需 145# 设置WSL 2为默认版本 wsl --set-default-version 2

验证WSL版本:

wsl --list --verbose

若输出中"VERSION"列显示2,则WSL2安装成功,如下所示。

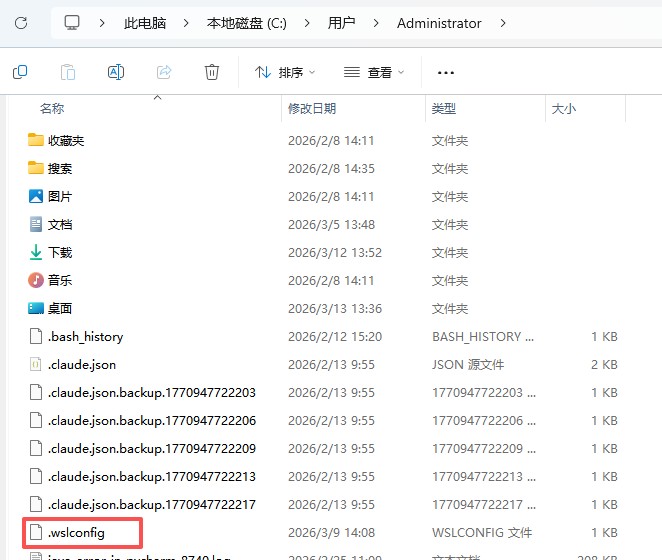

1.3.4 配置WSL2内存与处理器(避免后续卡顿)

WSL2默认内存分配较小(通常为2GB),运行OpenClaw时容易出现内存不足导致的卡顿或崩溃。需手动配置内存限制:

按下Win + R,输入%USERPROFILE%,进入用户目录;

新建文本文件,重命名为.wslconfig(注意无后缀名);

编辑文件内容如下(根据电脑配置调整,推荐内存至少4GB):

GPT plus 代充 只需 145[wsl2] memory=4GB # 分配给WSL2的最大内存 processors=2 # 分配给WSL2的CPU核心数 swap=2GB # 交换分区大小 localhostForwarding=true # 启用本地端口转发(便于访问WSL2中的服务)

保存文件后,重启WSL2使配置生效:

wsl --shutdown

再次打开Ubuntu终端即可加载新配置。

1.3.5 API密钥准备

OpenClaw需要接入具体的AI服务才能使用,建议优先准备Anthropic Claude的API密钥(体验最稳定),步骤如下:

- 访问Anthropic官网(https://www.anthropic.com/),注册并登录账号;

- 进入API控制台(https://console.anthropic.com/),创建API密钥;

- 保存密钥(格式类似

sk-ant-xxxxxxxxxx),后续配置时需用到。

若无法访问Anthropic,也可准备OpenAI API密钥(https://platform.openai.com/)或Google Gemini API密钥(https://ai.google.dev/),国内用户的话更推荐配置阿里云百炼(https://bailian.console.aliyun.com/)或者Minimax(https://www.minimaxi.com/)配置流程类似。

经过多位开发者实战验证,Windows环境下安装OpenClaw有三种可靠方案:WSL2+一键脚本(最快)、WSL2+npm全局安装(最灵活)、WSL2+Docker安装(最稳定)。以下将详细介绍每种方案的步骤、适用场景及注意事项。

这是最适合新手的安装方式,脚本会自动完成Node.js版本检查、依赖安装、配置文件创建等所有操作,全程无需手动干预,这部分较为简单,大家可以直接复制等待安装即可。

2.1.1 适用场景

- 首次接触OpenClaw,想快速体验核心功能;

- 对Linux命令不熟悉,希望减少手动配置;

- 无需自定义安装路径和配置文件位置。

2.1.2 安装步骤

打开Ubuntu终端(可通过开始菜单搜索"Ubuntu");

首先切换国内npm镜像源(避免依赖下载缓慢或失败):

GPT plus 代充 只需 145npm config set registry https://registry.npmmirror.com

执行一键安装脚本:

curl -fsSL https://openclaw.ai/install.sh | bash

脚本执行过程中会自动完成以下操作:

- 检查Node.js版本(若低于v22,会提示升级);

- 全局安装OpenClaw npm包;

- 创建配置文件目录

~/.openclaw/; - 配置系统环境变量。

安装完成后,初始化配置:

GPT plus 代充 只需 145openclaw onboard --install-daemon

该命令会启动交互式配置流程,按提示完成以下操作:

- 选择AI提供商(如Anthropic);

- 输入之前准备的API密钥;

- 配置消息渠道(推荐先选Telegram,配置最简单);

- 确认是否安装系统服务(建议选择"是",实现后台常驻运行)。

验证安装是否成功:

openclaw --version

若输出版本号(如v2026.2.24),说明安装成功。

启动OpenClaw服务:

GPT plus 代充 只需 145# 后台运行(推荐) openclaw start --daemon

2.1.3 常见问题与解决

脚本执行报错"curl: command not found":Ubuntu默认未安装curl,执行以下命令安装:

sudo apt update && sudo apt install -y curl

权限错误"EACCES: permission denied":npm全局目录权限不足,执行以下命令修复:

GPT plus 代充 只需 145# 创建专属npm目录 mkdir ~/.npm-global # 配置npm使用新目录 npm config set prefix '~/.npm-global' # 添加环境变量 echo 'export PATH=~/.npm-global/bin:$PATH' >> ~/.bashrc # 生效配置 source ~/.bashrc # 重新执行安装脚本 curl -fsSL https://openclaw.ai/install.sh | bash

Node.js版本过低:脚本提示Node.js版本低于v22,执行以下命令升级:

# 安装nvm(Node.js版本管理工具) curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.0/install.sh | bash # 生效nvm source ~/.bashrc # 安装Node.js 24(推荐版本) nvm install 24 # 设置为默认版本 nvm use 24 # 重新执行安装脚本 curl -fsSL https://openclaw.ai/install.sh | bash

该方案通过手动安装Node.js和OpenClaw,可自由选择安装版本、配置文件路径,且出现问题时便于排查,适合需要长期使用或自定义配置的程序设计人员,这一部分我会重点讲解。

2.2.1 适用场景

- 需自定义安装路径、配置文件位置;

- 想安装特定版本的OpenClaw;

- 后续可能进行二次开发或插件扩展;

- 一键脚本安装失败,需要手动排查问题。

2.2.2 安装步骤

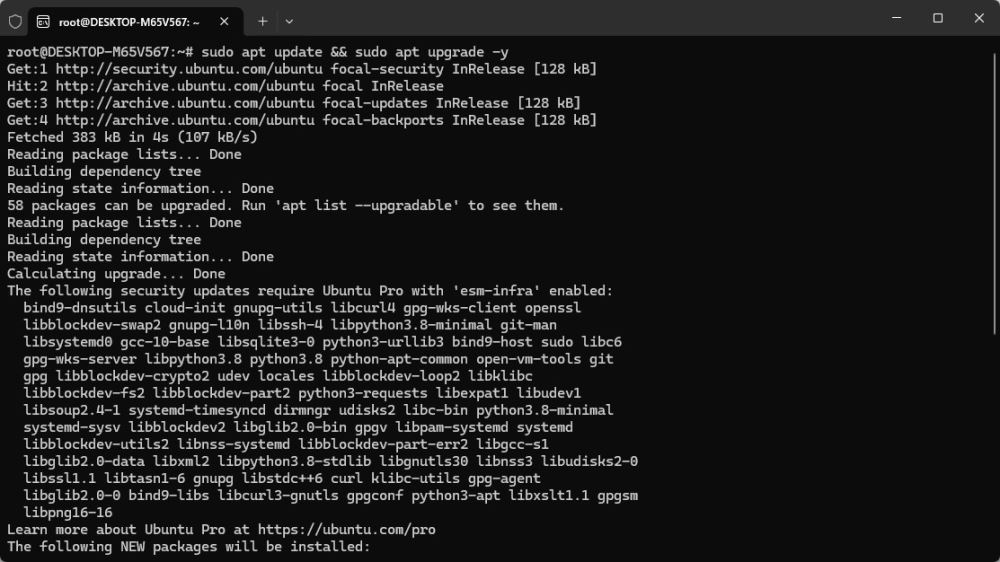

打开Ubuntu终端,更新系统包:

GPT plus 代充 只需 145sudo apt update && sudo apt upgrade -y

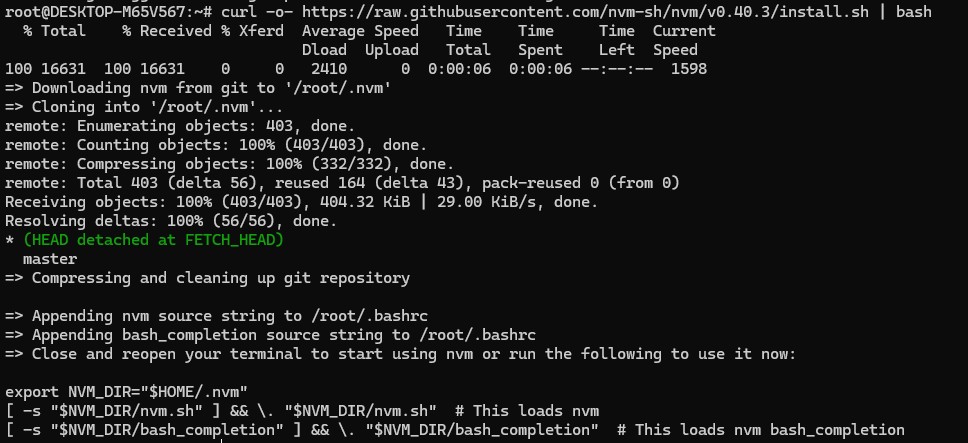

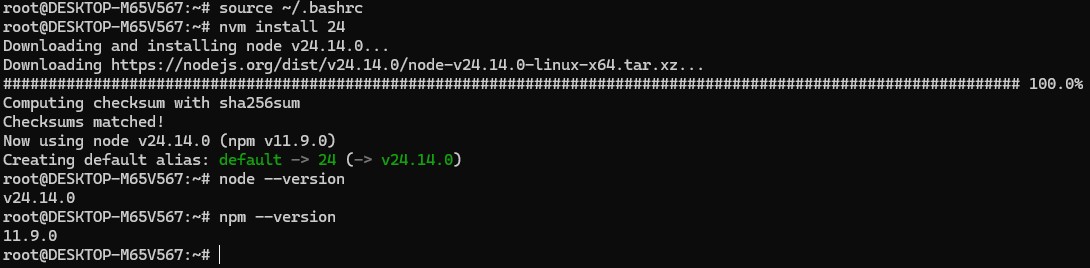

# 安装nvm(我使用的是最新版本0.40.3,各位也可以去官网下载自己喜欢的版本) curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash # 生效nvm配置 source ~/.bashrc # 安装Node.js 24 nvm install 24 # 设置Node.js 24为默认版本 nvm use 24 # 验证版本 node --version # 应输出v24.x.x npm --version # 应输出10.x.x或更高

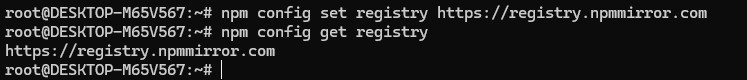

切换国内npm镜像源:

GPT plus 代充 只需 145npm config set registry https://registry.npmmirror.com # 验证镜像源 npm config get registry # 应输出https://registry.npmmirror.com/

全局安装OpenClaw:

npm install -g openclaw@latest

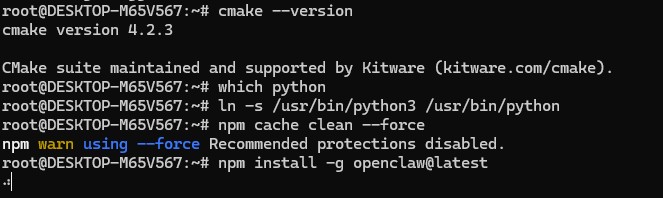

GPT plus 代充 只需 145npm error [node-llama-cpp] ✖ Failed to download cmake npm error [node-llama-cpp] It seems that "make" is not installed in your system. Install it to resolve build issues npm error [node-llama-cpp] To install "cmake", you can run "sudo apt update && sudo apt install -y cmake" npm error [node-llama-cpp] To install "make", you can run "sudo apt update && sudo apt install -y make"

在安装过程中我遇到了这个问题原因是系统缺少编译 node-llama-cpp 所需的构建工具(如 cmake, make, g++ 等),此外,由于预编译的二进制文件与我的系统不兼容,它尝试从源代码构建,但因为缺少工具而失败,所以我们需要安装 build-essential(包含 make, g++ 等)、cmake 和 git(这里需要注意的是cmake版本必须大于3.19,负责版本太低会导致安装失败),然后在使用上面的安装命令安装即可。

apt update apt install -y build-essential cmake git python3 npm cache clean --force

若需安装特定版本(如v2026.2.24),可指定版本号:

GPT plus 代充 只需 145npm install -g openclaw@2026.2.24

# 创建npm全局目录 mkdir -p ~/.npm-global # 配置npm使用该目录 npm config set prefix '~/.npm-global' # 添加到环境变量 echo 'export PATH=~/.npm-global/bin:$PATH' >> ~/.bashrc # 生效配置 source ~/.bashrc # 重新安装OpenClaw npm install -g openclaw@latest

初始化OpenClaw配置:

GPT plus 代充 只需 145openclaw onboard --install-daemon

按交互式提示完成以下配置:

启动/停止OpenClaw服务:

# 服务管理 openclaw gateway start | stop | restart | status # 配置管理 openclaw config validate openclaw config set

# 插件管理 openclaw plugins list | install

<地址>

| uninstall

<名称>

# 诊断 openclaw doctor [--fix] # 交互 openclaw dashboard # Web UI openclaw tui # 终端界面 # 飞书配对 openclaw pairing approve feishu

<配对码>

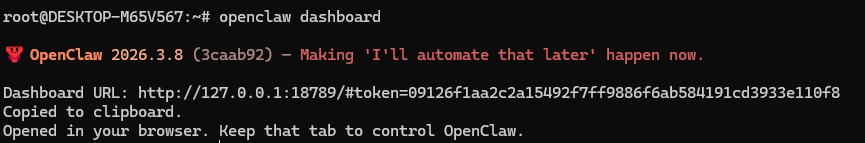

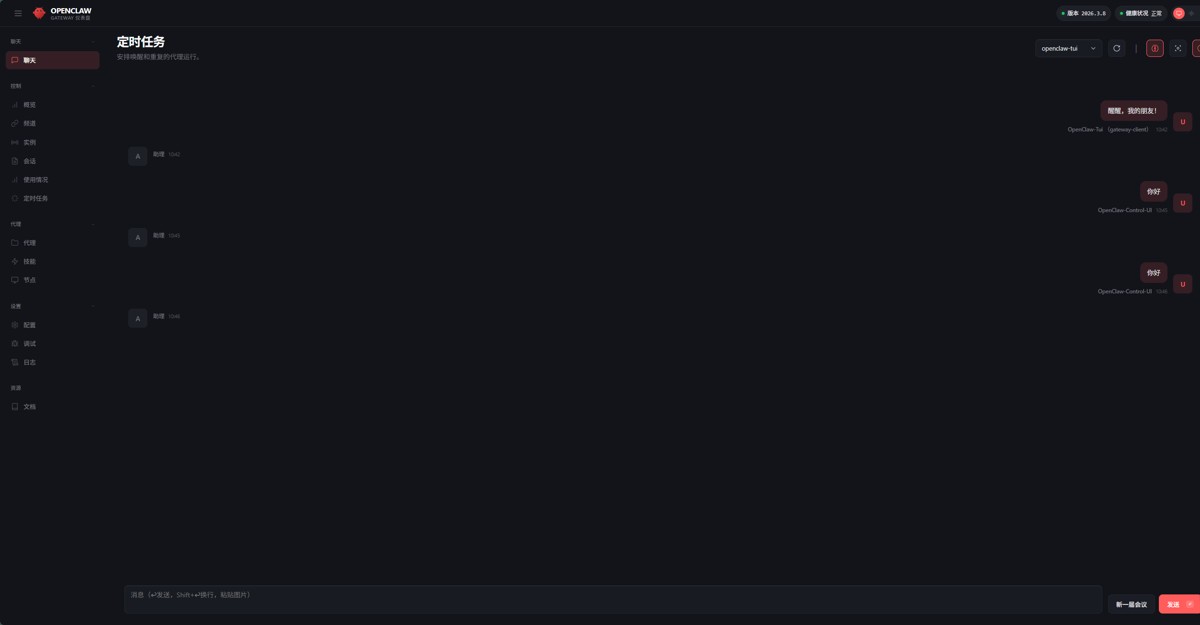

启动时也可以进入Web UI,杀掉之后输入openclaw dashboard。

就会请求打开浏览器,Web UI启动之后界面如下,因为我的key设置有问题,所以并没有返回内容,你的如果配置正确会正确返回:

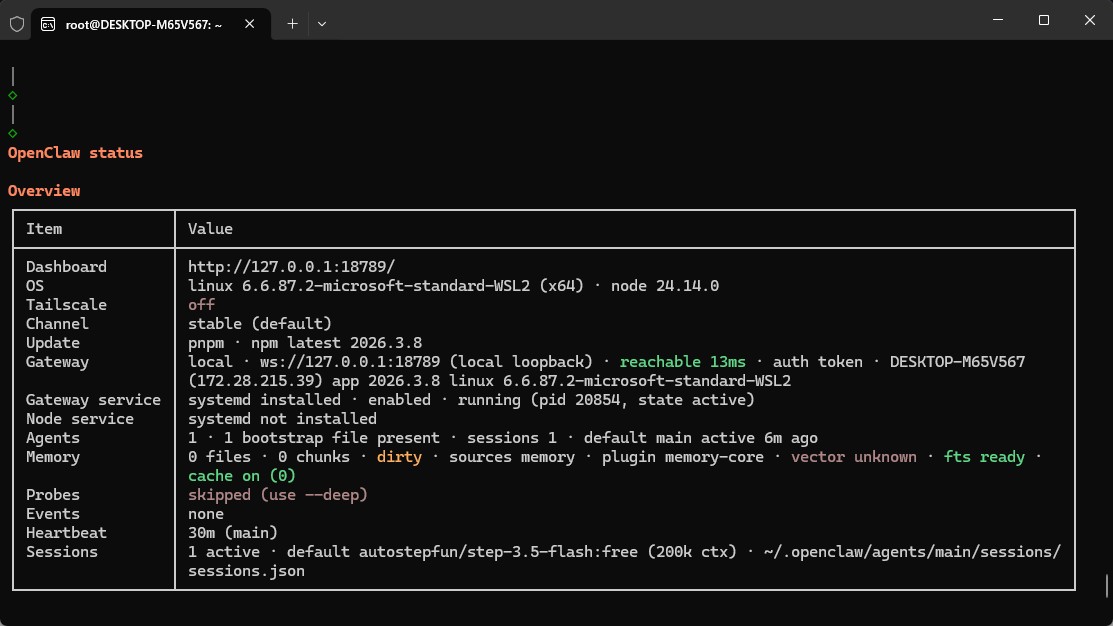

验证服务是否正常运行:

GPT plus 代充 只需 145# 查看服务状态 openclaw status # 若输出"OpenClaw is running (PID: xxxxx)",说明运行正常

2.2.3 配置文件位置与备份

npm安装方式的配置文件默认存储在~/.openclaw/目录下,包含API密钥、渠道配置、模型参数等关键信息,建议定期备份:

# 备份配置文件到用户目录 cp -r ~/.openclaw ~/openclaw-backup-$(date +%Y%m%d)

Docker安装方式通过容器隔离环境,避免了依赖冲突和权限问题,且可在任何支持Docker的设备上迁移,适合需要长期稳定运行或部署在服务器上的场景。

2.3.1 适用场景

- 需在多台设备上同步配置;

- 担心依赖冲突影响系统稳定性;

- 计划部署在Windows服务器上长期运行;

- 熟悉Docker操作,追求标准化部署流程。

2.3.2 安装步骤

在WSL2中安装Docker:

GPT plus 代充 只需 145# 更新系统包 sudo apt update && sudo apt upgrade -y # 安装Docker依赖 sudo apt install -y apt-transport-https ca-certificates curl software-properties-common # 添加Docker官方GPG密钥 curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo apt-key add - # 添加Docker软件源 sudo add-apt-repository "deb [arch=amd64] https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable" # 再次更新包索引 sudo apt update # 安装Docker CE sudo apt install -y docker-ce # 启动Docker服务 sudo systemctl start docker # 设置Docker开机自启 sudo systemctl enable docker # 添加当前用户到docker组(避免每次使用sudo) sudo usermod -aG docker $USER

执行完成后,关闭Ubuntu终端并重新打开,使权限生效。

安装Docker Compose:

# 下载Docker Compose二进制文件 sudo curl -L "https://github.com/docker/compose/releases/latest/download/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose # 添加执行权限 sudo chmod +x /usr/local/bin/docker-compose # 验证安装 docker-compose --version

创建OpenClaw数据目录:

GPT plus 代充 只需 145# 创建配置文件和数据存储目录 mkdir -p ~/openclaw-data/{config,data} cd ~/openclaw-data

nano docker-compose.yml

粘贴以下内容:

GPT plus 代充 只需 145version: '3.8' services: openclaw: image: openclaw/openclaw:latest container_name: openclaw restart: unless-stopped # 容器退出时自动重启 ports: - "3000:3000" # 端口映射(WSL2端口:容器端口) volumes: - ./config:/app/config # 配置文件目录映射 - ./data:/app/data # 数据存储目录映射 environment: - NODE_ENV=production # 生产环境模式 - ANTHROPIC_API_KEY=${ANTHROPIC_API_KEY} # 从.env文件读取API密钥 - OPENAI_API_KEY=${OPENAI_API_KEY} # 可选,OpenAI API密钥 - TZ=Asia/Shanghai # 设置时区 healthcheck: test: ["CMD", "curl", "-f", "http://localhost:3000/health"] # 健康检查 interval: 30s timeout: 10s retries: 3

按下Ctrl+O保存,Ctrl+X退出编辑。

nano .env

粘贴以下内容(替换为自己的API密钥):

GPT plus 代充 只需 145# Anthropic Claude API密钥 ANTHROPIC_API_KEY=sk-ant-xxxxxxxxxxxxx # OpenAI API密钥(可选,不使用可留空) OPENAI_API_KEY=sk-xxxxxxxxxxxxx

保存并退出。

启动Docker容器:

docker-compose up -d

该命令会自动拉取OpenClaw最新镜像,并启动容器。

查看容器运行状态:

GPT plus 代充 只需 145# 查看容器日志 docker logs -f openclaw # 查看容器状态 docker ps | grep openclaw

若日志中输出"OpenClaw Gateway started on port 3000",说明启动成功。

# 进入OpenClaw容器 docker exec -it openclaw bash # 执行初始化命令 openclaw onboard

按提示完成AI提供商和消息渠道配置,配置完成后退出容器:

2.3.3 Docker方式的优势与注意事项

- 优势:环境隔离,不影响WSL2系统;配置文件和数据通过目录映射持久化;支持快速迁移(复制

openclaw-data目录即可); - 注意事项:需开放Windows防火墙端口3000(便于访问Web界面);容器重启后配置不会丢失,但需定期备份

openclaw-data目录;升级OpenClaw时,执行docker-compose pull && docker-compose up -d即可。

选择建议:

- 若仅想快速体验OpenClaw功能,选择一键脚本安装;

- 若计划长期使用,且可能进行自定义配置或二次开发,选择npm全局安装;

- 若需部署在服务器上稳定运行,或担心环境冲突,选择Docker安装。

安装完成后,如何充分发挥OpenClaw的功能?以下将从提示词优化、多平台使用、快捷键配置、自定义插件等方面,分享实用技巧,帮助你打造高效的AI工作流。

提示词(Prompt)是影响AI响应质量的关键。OpenClaw支持自定义提示词模板,可根据不同场景预设指令,提升交互效率。

3.1.1 基础提示词结构优化

一个高质量的提示词应包含"角色定义+任务描述+输出格式+约束条件"四部分。例如,代码生成场景的提示词:

角色:你是一位资深Python开发工程师,擅长编写高效、易维护的代码。 任务:根据以下需求编写Python函数,实现批量处理CSV文件的数据清洗功能: 1. 去除空值行; 2. 标准化日期格式为"YYYY-MM-DD"; 3. 对数值列进行去重; 4. 输出清洗后的CSV文件到指定目录。 输出格式: 1. 先给出代码功能说明; 2. 提供完整可运行的Python代码; 3. 附加使用示例和注意事项。 约束条件: 1. 使用pandas库实现; 2. 代码需包含异常处理; 3. 避免使用过时的API; 4. 注释清晰,便于理解。

3.1.2 OpenClaw提示词模板配置

OpenClaw支持将常用提示词保存为模板,调用时直接选择,无需重复输入:

打开OpenClaw配置目录:

GPT plus 代充 只需 145cd ~/.openclaw/templates

创建提示词模板文件(如code_generator.tpl):

nano code_generator.tpl

粘贴上述提示词内容,保存退出;

3.1.3 多模型提示词适配

不同AI模型对提示词的响应风格不同,可针对性优化:

- Claude:擅长长文本处理和逻辑推理,提示词可详细描述背景信息和约束条件;

- GPT-4:代码生成和创造性任务表现优秀,提示词可强调输出格式和细节要求;

- Gemini:多模态支持较好,提示词可包含图像描述(需配合支持多模态的渠道)。

例如,针对Claude的长文本摘要提示词:

GPT plus 代充 只需 145请对以下长文本进行结构化摘要,要求: 1. 提取核心观点(不超过3点); 2. 梳理关键数据和案例; 3. 总结结论和建议; 4. 输出格式为Markdown列表,简洁明了; 5. 保留原文的关键术语,不添加主观评价。 文本:[在此粘贴长文本内容]

OpenClaw支持多种消息渠道,以下是常用渠道的配置和使用技巧:

3.2.1 Telegram渠道(推荐首选)

Telegram是OpenClaw支持最完善的渠道,配置简单且功能全面:

- 绑定Bot后,发送

/help可查看所有可用命令; - 切换AI模型:发送

/model anthropic/claude-3-sonnet或/model openai/gpt-4; - 调整模型参数:发送

/config temperature=0.7 max_tokens=2048; - 调用提示词模板:发送

/template 模板名称; - 清除对话历史:发送

/clear; - 查看服务状态:发送

/status。

3.2.2 Discord渠道配置技巧

- 进入Discord开发者平台(https://discord.com/developers/applications),创建应用;

- 启用"Bot"功能,获取Bot Token;

- 在OpenClaw配置中输入Token,授予Bot"发送消息"、"读取消息"权限;

- 在Discord服务器中添加Bot,使用

!openclaw前缀调用命令(如!openclaw 你好,请介绍一下自己)。

3.2.3 多渠道消息同步

若同时在多个渠道使用OpenClaw,可启用消息同步功能:

# 开启多渠道消息同步 openclaw config set sync.messages=true # 查看同步状态 openclaw config get sync.messages

启用后,在一个渠道的对话历史会同步到其他渠道,避免重复输入上下文。

对于Windows用户,可通过"WSL2端口转发+桌面快捷键工具"实现OpenClaw的全局调用,无需打开终端或聊天工具。

3.3.1 配置WSL2端口转发(关键步骤)

确保OpenClaw已启动,且端口3000已映射(Docker方式默认已映射);

在Windows浏览器中访问http://localhost:3000,可看到OpenClaw Web界面;

若无法访问,执行以下命令检查端口占用:

GPT plus 代充 只需 145# 在WSL2中查看端口3000占用情况 lsof -i :3000

若端口被占用,修改OpenClaw端口配置:

openclaw config set server.port=3001 openclaw gateway restart

然后在浏览器中访问http://localhost:3001。

3.3.2 设置Windows全局快捷键

使用PowerToys(Windows官方工具)设置全局快捷键,快速调用OpenClaw:

- 下载安装PowerToys(https://learn.microsoft.com/zh-cn/windows/powertoys/);

- 打开PowerToys,启用"Run"功能;

- 配置启动命令:

http://localhost:3000; - 设置快捷键(如

Ctrl+Alt+O); - 按下快捷键即可快速打开OpenClaw Web界面,直接输入问题进行交互。

OpenClaw支持调整AI模型的核心参数,以适应不同任务需求:

3.4.1 通过命令调整参数

在Telegram中发送以下命令调整参数:

GPT plus 代充 只需 145/config temperature=0.3 max_tokens=2048 frequency_penalty=1.0

3.4.2 预设参数模板

针对不同场景创建参数模板,例如:

# 创建代码生成参数模板 openclaw config set templates.params.code={"temperature":0.2,"max_tokens":4096,"top_p":0.7} # 调用模板 /config load code

OpenClaw支持通过插件扩展功能,程序设计人员可根据需求开发自定义插件,实现特定场景的自动化流程。

3.5.1 插件开发基础结构

OpenClaw插件采用Node.js开发,核心结构如下:

GPT plus 代充 只需 145// plugin-example.js module.exports = { // 插件名称 name: "example-plugin", // 插件描述 description: "示例插件:实现CSV文件解析功能", // 触发命令 commands: ["/parse_csv"], // 初始化函数 init: (openclaw) => { console.log("示例插件初始化完成"); }, // 命令处理函数 handleCommand: async (command, args, context) => ` }; } } }; // CSV解析函数 async function parseCSV(content) { const csv = require("csv-parser"); const results = []; return new Promise((resolve) => { require("stream").Readable.from(content) .pipe(csv()) .on("data", (data) => results.push(data)) .on("end", () => resolve(results)); }); }

3.5.2 插件安装与启用

将插件文件复制到OpenClaw插件目录:

cp plugin-example.js ~/.openclaw/plugins/

启用插件:

GPT plus 代充 只需 145openclaw plugin enable example-plugin

重启OpenClaw:

openclaw gateway restart

3.6.1 手动备份

GPT plus 代充 只需 145# 完整备份OpenClaw配置和数据 tar -zcvf openclaw-backup-\((date +%Y%m%d).tar.gz ~/.openclaw/

3.6.2 自动备份配置

通过WSL2的定时任务(cron)实现自动备份:

编辑crontab配置:

crontab -e

添加以下内容(每周日凌晨2点备份):

GPT plus 代充 只需 1450 2 * * 0 tar -zcvf ~/openclaw-backup-\)(date +%Y%m%d).tar.gz ~/.openclaw/

保存退出,cron会自动执行备份任务。

- 环境准备是关键:Windows用户必须先配置WSL2,且确保版本为2、内存分配≥4GB,这是避免后续卡顿和崩溃的核心;

- 安装方案选择:新手优先选择一键脚本,进阶用户推荐npm全局安装,服务器部署首选Docker;

- 国内用户注意事项:务必切换npm镜像源,否则依赖下载会极其缓慢;API调用需配置合规的海外网络环境;

- 常见问题预判:安装过程中若遇到权限错误,优先修复npm全局目录权限;若服务启动失败,查看日志排查端口冲突或API密钥错误。

- 渠道选择:日常使用优先选择Telegram,配置简单且功能全面;开发团队协作可使用Discord渠道;

- 提示词优化:针对不同场景创建提示词模板,减少重复输入;根据AI模型特性调整提示词结构;

- 参数调优:逻辑性任务(代码、推理)降低temperature,创造性任务(写作、设计)提高temperature;

- 数据安全:定期备份

~/.openclaw/目录,避免配置和对话数据丢失;不要在公共渠道分享敏感API密钥; - 性能优化:关闭不必要的消息渠道和插件,减少资源占用;定期清理对话历史和日志文件。

对于程序设计人员而言,OpenClaw的价值不仅在于日常使用,更在于其扩展能力:

- 二次开发:基于OpenClaw的API接口,将AI能力集成到自己的项目中,实现自动化工作流;

- 插件开发:针对特定行业场景(如数据分析、代码审计、文档生成)开发自定义插件,丰富功能生态;

- 模型集成:将私有AI模型(如本地部署的Llama、Qwen)接入OpenClaw,实现多模型统一调用;

- 贡献开源:参与OpenClaw开源项目(https://github.com/openclaw/openclaw),提交bug修复或功能PR,推动项目发展。

OpenClaw作为一款开源的AI助理网关,为Windows用户提供了一种"数据私有、多平台兼容、高度可扩展"的AI使用方案。虽然安装过程需要配置WSL2等额外步骤,但一旦部署完成,其带来的效率提升和使用灵活性绝对值得。

对于程序设计人员而言,掌握OpenClaw的安装与使用,不仅能提升日常工作效率,更能深入理解AI模型的集成与调用逻辑,为后续的AI应用开发积累经验。随着AI技术的不断发展,这种"自主可控"的AI使用方式将成为主流——而OpenClaw正是进入这一领域的绝佳起点。

以上就是Windows环境下OpenClaw本地部署全攻略的详细内容,更多关于Windows下OpenClaw本地部署的资料请关注脚本之家其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/248786.html