实测 SD 即使加入 ControlNet 和 LORA,也是难以企及 MidJ。看到有大佬爬取了 MidJ 的几万张图像 Fine-tune 开源的 SD,也是无法对齐 MidJ 的效果,Gap 会出现在哪里呢?

因为题主不会用SD,从门外汉角度得出了错误结论。

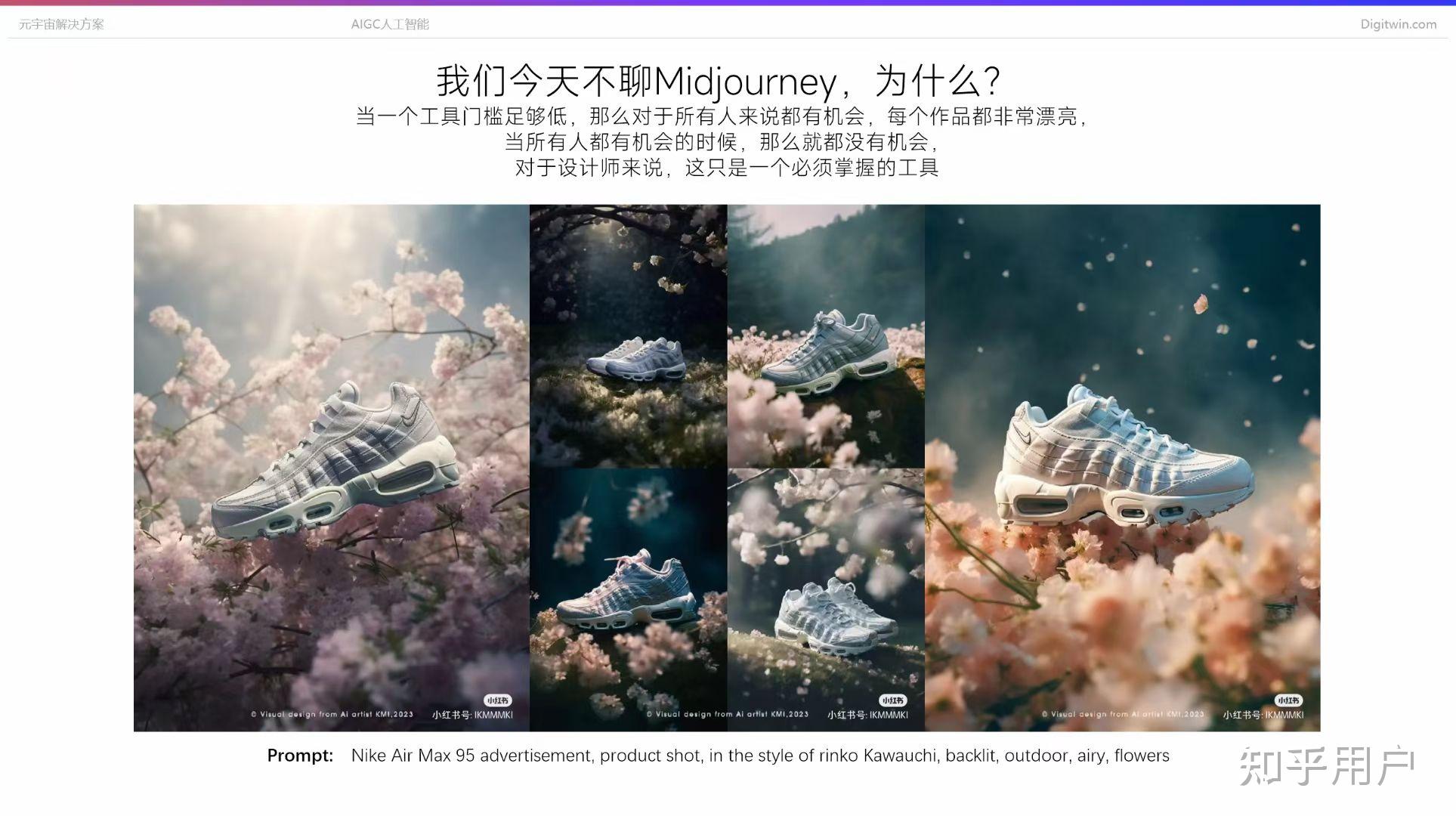

Midjourney特点是新手友好,但可控性差、细节优化难。下限高,但上限低。张张都精致唬人,但你想要调节细节时,会发现越调越歪,哪哪都不对劲,抽盲盒一样。

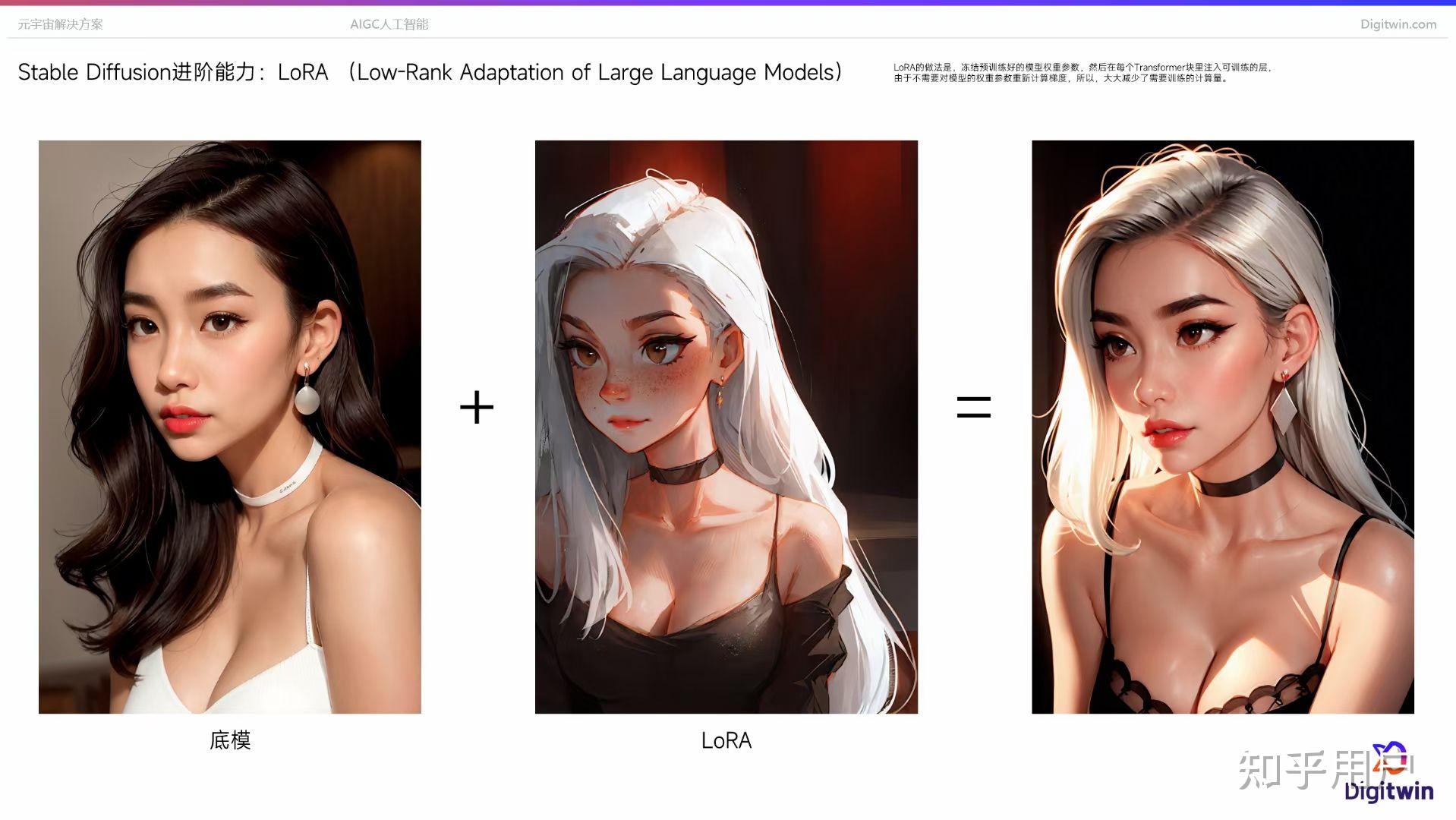

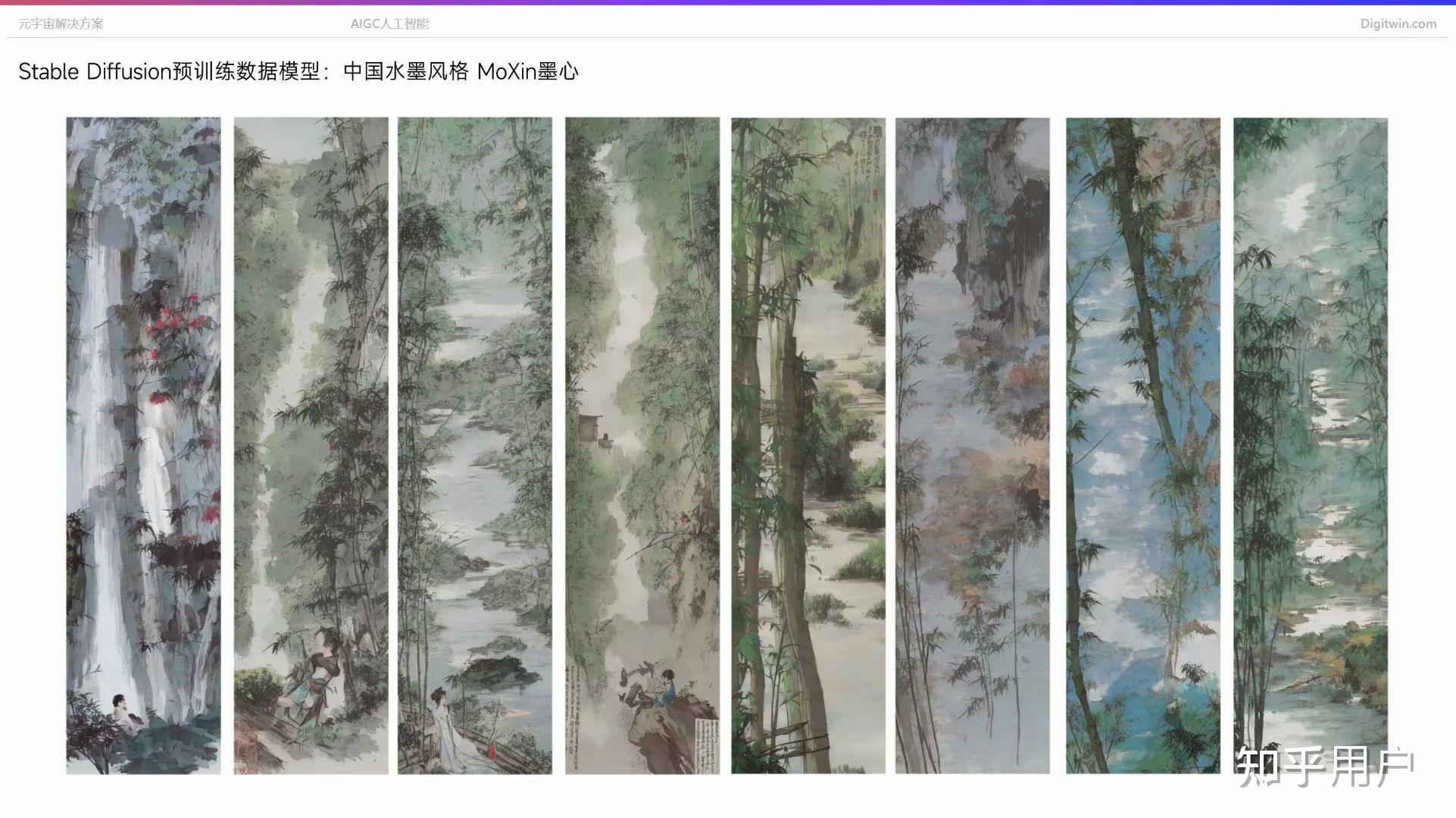

SD则能给使用者很大的探索优化自由度和局部调整的可能。下限低,但上限很高。在C站(http://civitai.com)上有很多大神的模型/插件,可用来搞出很多神级效果。SD能本地私有化部署,还能够精准局部调优,甚至能给模特穿衣服、给衣服找模特、制作海报这种需求,这些你指望midjourney是不可能的。

小结:mj可看做创意概念玩具,降低门槛、提高普通人的作画能力,但六脉神剑一样时灵时不灵;SD开始成为专业生产工具,给设计师等专业人士更高的效率和设计可能。

来看个设计大佬的感触:

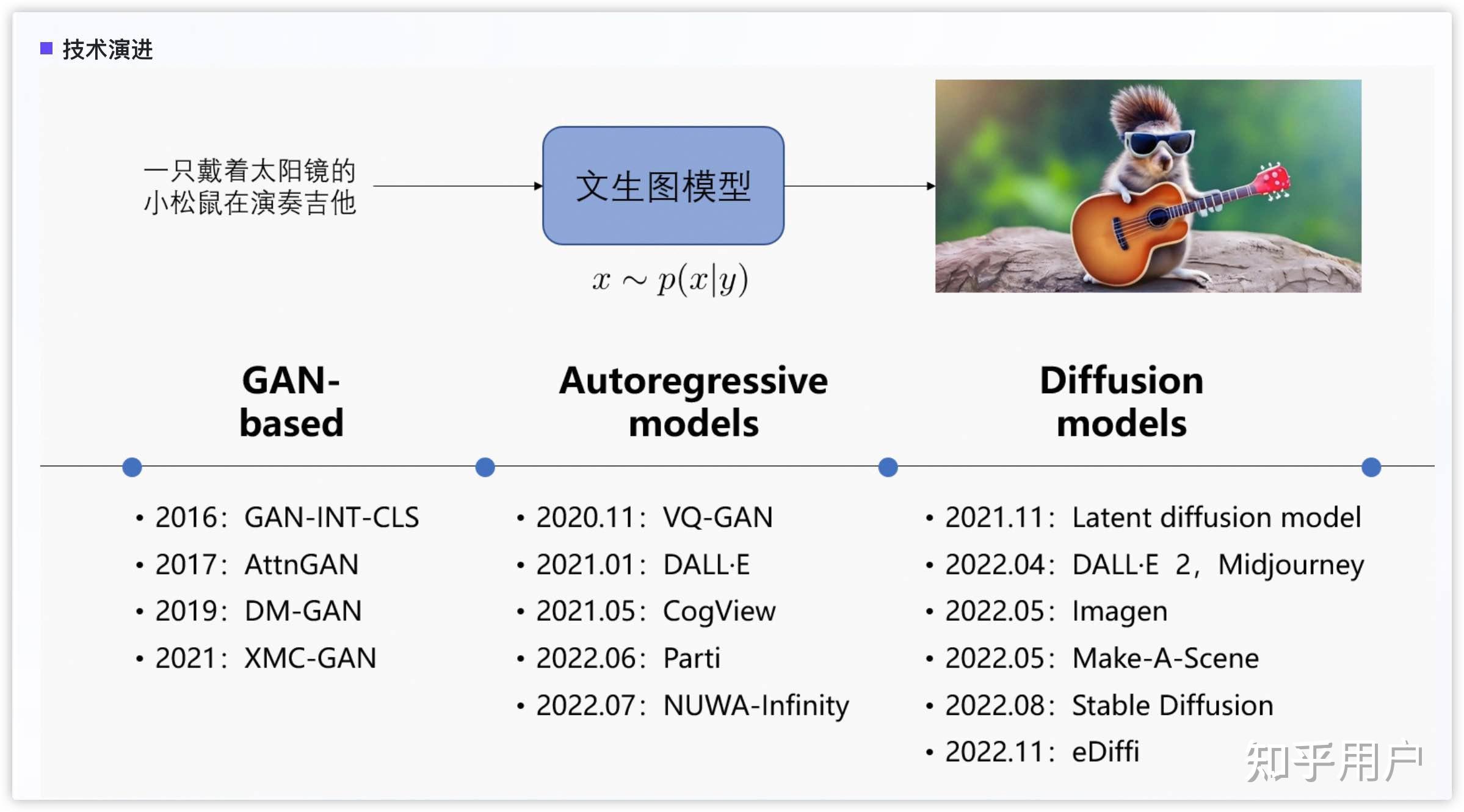

最后,二者是基于同样的底层原理的(diffusion model扩散模型),只是在产品化应用上,圈定了不同的用户群作为起点,走了不同的产品路线而已。相较之下,目前更看好SD的未来发展。

建议过段时间再来看看这个问题吧。

有人要设计大佬上面的PPT,已征求同意可以发,私我索要哈。

贴下大佬的视频号,日更各种AI相关的原理、应用、前沿探索,干货满满。

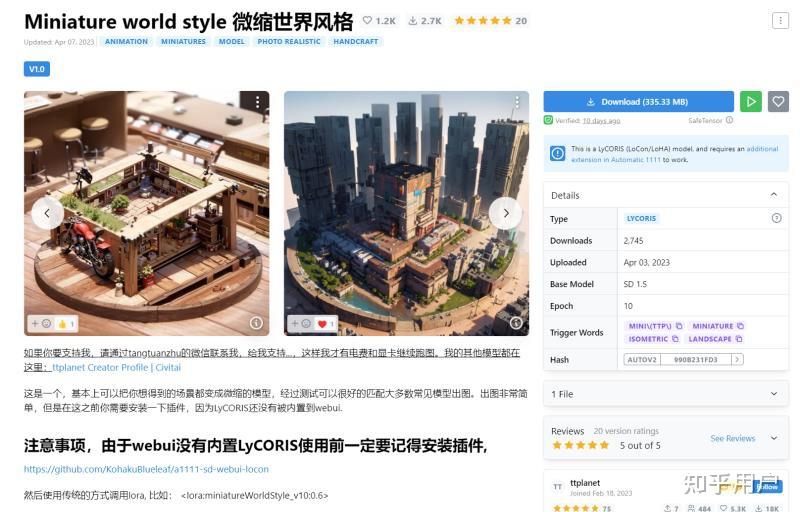

对SD效果感兴趣的,补充几张效果图,看看对细节的处理:

微缩世界的作者大神 @汤团猪 惊现在评论区,也回答了题目,大家可以围观

看了陆奇昨天的演讲,面对这波AI的每天一个新进化,真的不要让自己在观看中落伍,学习和行动起来最重要!

我发几张自己用SD做的图吧,目前MJ是做不到的。

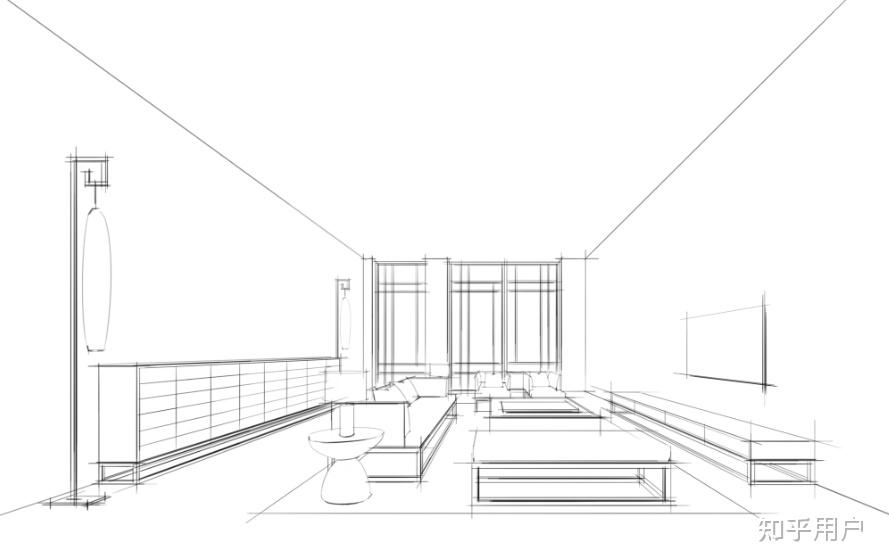

一、室内设计效果尝试

(1)———大厅草图

———Ai生成的效果图

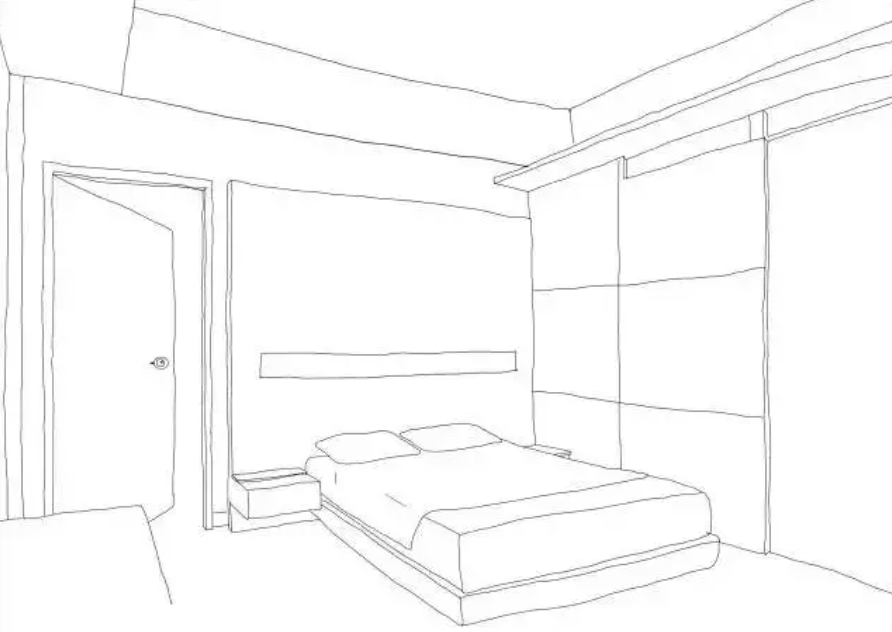

(2)———室内草图

———Ai生成的效果图

(3)———毛坯房图

———Ai生成的效果图(仅测试,时间关系没生成家具)

二、此外我也做了服装设计等领域的应用尝试,有兴趣的也可搜公众号:67号Lora

欢迎交流。

三、MJ我用得不多,目前生成应该不超过1000张图片的使用体验吧。可控性的确不理想,更适合创意图片的生成。使用要义差不多的咒语时,生成的图片好像更容易同质化,比如说,生成的山,可能都长得差不多,连山恋的形状都很雷同,可能是我用得还不够多吧。手机上没存图,就不放了。

四、SD插件比较丰富,模型也多,更大的乐趣在于自己训练模型,俗称炼丹。但本地训练对硬件要求比较高。我也炼过一些,3070TI显卡,8G独显,4000步的话大概一个小时吧。想训练得更好,还是需要耐心。云端训练我没试过,觉得可能更麻烦就没折腾。

五、用SD,基本每个星期都有插件更新或新插件,要保持持续学习的节奏,否则很快就跟不上,这可能也算是特殊乐趣的一种吧。

MJ的玩法变化不快,玩多了,多研究案例,很快就熟悉了,但它能生成的图片种类很丰富,要想玩得更好,可能还得专门研究一两个方向。

最后,奉上一张用MJ生成的图片。

生活折腾,找到自己的乐趣就好。

kandinsky更新到2.2了

给出了lora训练教程,加入了controlnet,可玩性更高了。

推荐一个模型,俄国人开发的

Kandinsky 2.1从我使用的感觉来看,基本接近Midjourney的风格,说明里看到使用了MoVQGAN,clip用的XLM-Roberta,支持多种语言,谁来解读一下,效果确实出乎意料地接近Midjourney,在tg上的机器人他们还提供了针对美学优化的artstation 4k 和 aminate这三个微调模型,人像和人体结构不太行,没有优化,运行起来需要近12G显存,这应该是我的显卡不支持fp16的缘故。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/247110.html