最近我希望在 Jetson 上部署一个本地 Openclaw,并通过飞书机器人进行远程交互,从而让闲置的边缘设备秒变我的高级AI助手。整体目标很简单:

- 在 Jetson 上运行 OpenClaw

- 接入自己的模型 API(我使用的是阿里的Coding Plan)

- 通过飞书群聊 或者私聊机器人直接调用本地 Agent

最终希望实现这样的工作流:

这篇文章记录一下从源码部署 OpenClaw,到接通飞书机器人的完整过程,以及过程中踩到的几个关键坑。

本文使用环境如下:

Jetson 环境

GPT plus 代充 只需 145

说明

当前平台为:

- Jetson ARM64

- Ubuntu 20.04

- CUDA 11.4

这点很重要,因为后续某些依赖在 ARM64 + Ubuntu 20.04 上会遇到额外兼容性问题。

OpenClaw 是一个 Node.js 项目,因此首先需要准备 Node 环境。

建议使用 Node 22。

还需要安装 :

GPT plus 代充 只需 145

安装后检查:

这一步非常重要。

如果不配置 ,后面可能出现这些问题:

- 报错

- OpenClaw 自动构建 UI 时提示找不到 pnpm

- 全局命令不可用

建议将下面内容加入 :

GPT plus 代充 只需 145

保存后执行:

再验证:

GPT plus 代充 只需 145

我在安装过程中遇到的典型报错是:

GPT plus 代充 只需 145

因此需要手动升级 CMake。

安装新版 CMake

检查版本:

GPT plus 代充 只需 145

如果系统仍然找不到新版本,可临时加入 PATH:

必要时可以加入 。

在项目目录执行:

GPT plus 代充 只需 145

如果安装过程中出现原生模块编译问题,优先检查:

- CMake 版本

- build-essential 是否安装

- pnpm 是否在 PATH 中

OpenClaw 通过 进行配置。

如果目录不存在,先创建:

这是本文里一个非常关键的坑。

OpenClaw 的架构不是“CLI 直接调用模型”,而是:

GPT plus 代充 只需 145

所以 CLI 其实是 Gateway 的客户端。

既然是客户端连接服务端,就涉及认证。

为什么要加 token

如果只配置服务端 token,而没有配置客户端 token,就会出现:

因此需要让 gateway 服务端 和 客户端连接配置 使用同一个 token。

通过 进行知道如下,推荐配置如下:

GPT plus 代充 只需 145

解释

- :Gateway 服务端认证 token

- :CLI / TUI / logs 等客户端连接 Gateway 时使用的 token

这两个必须一致。

先安装 gateway service:

然后启动:

GPT plus 代充 只需 145

检查状态:

正常情况下会看到类似输出:

GPT plus 代充 只需 145

如果配置修改过,需要重启:

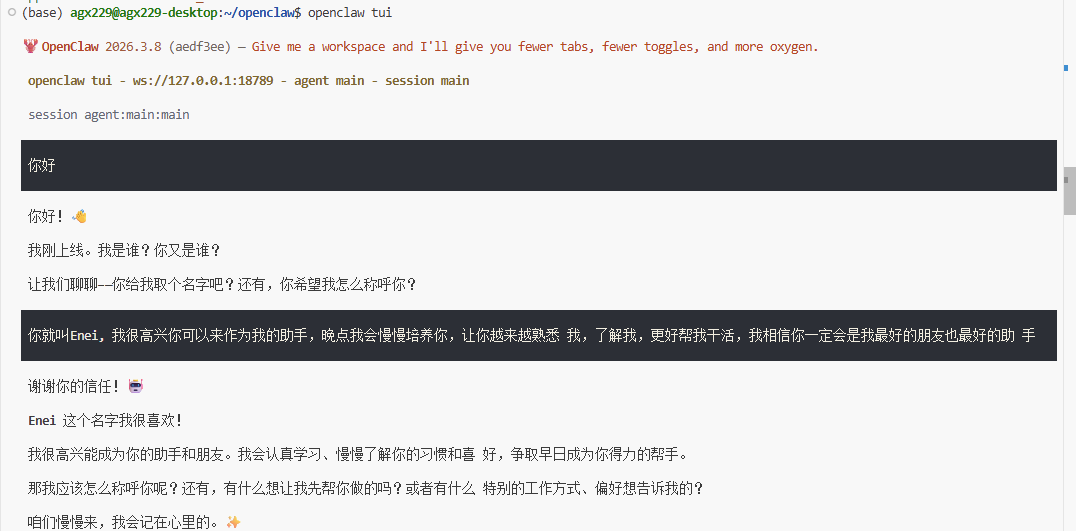

如果配置正确,可以直接运行:

GPT plus 代充 只需 145

若成功,界面会显示已连接,并能直接与模型对话。

如果出现 token mismatch,基本就是 和 不一致。

第一步:创建飞书应用

进入飞书开放平台https://open.feishu.cn/?lang=zh-CN,创建一个企业自建应用。

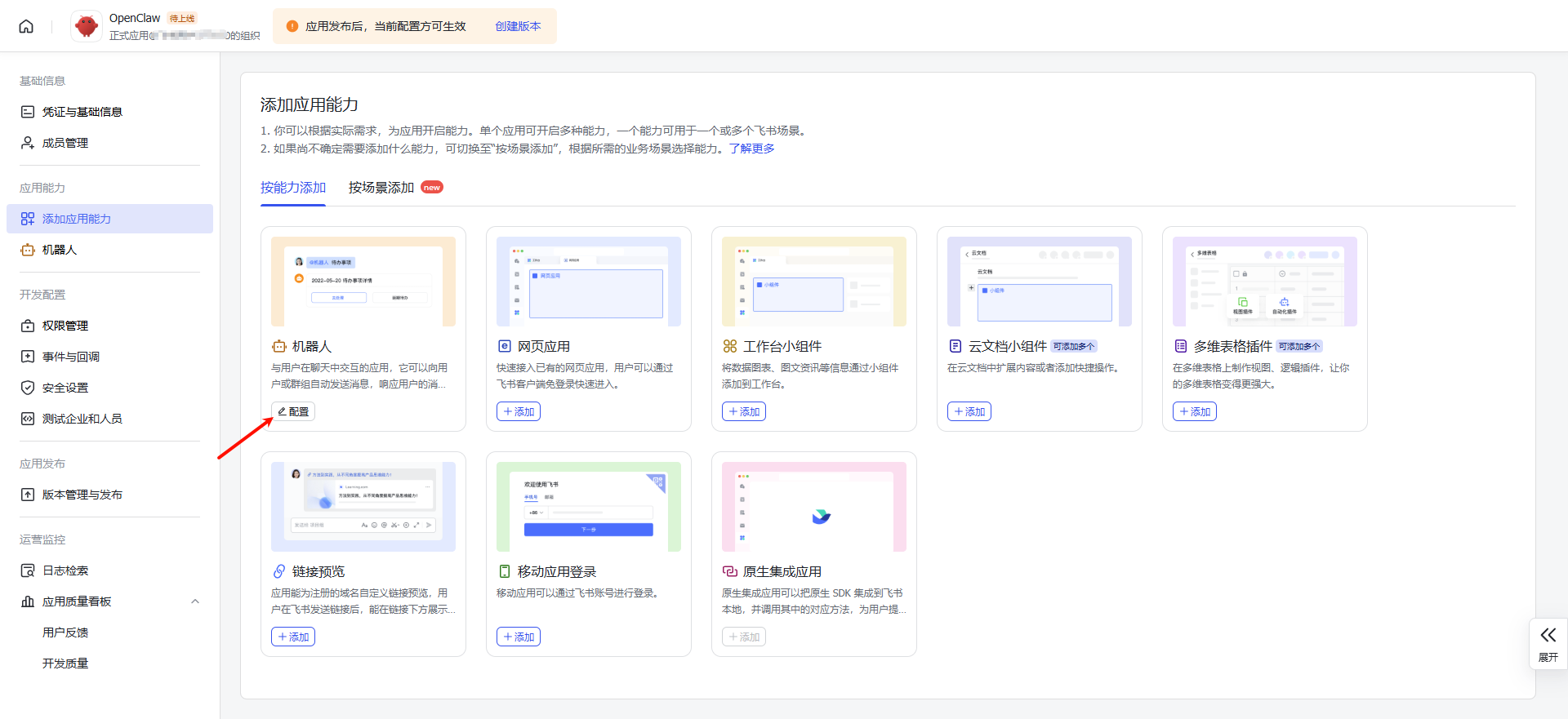

第二步:启用机器人能力

在应用后台启用机器人。

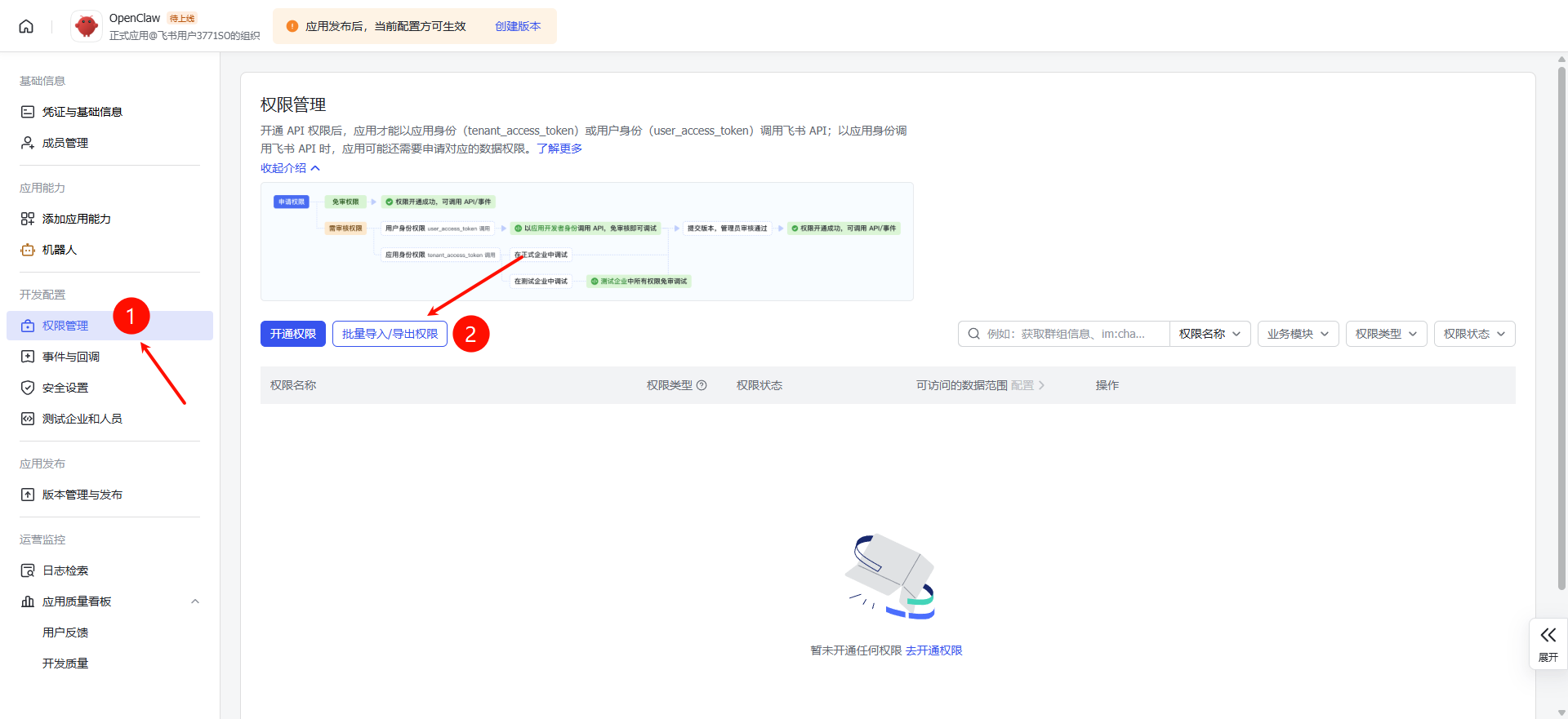

第二步:配置权限

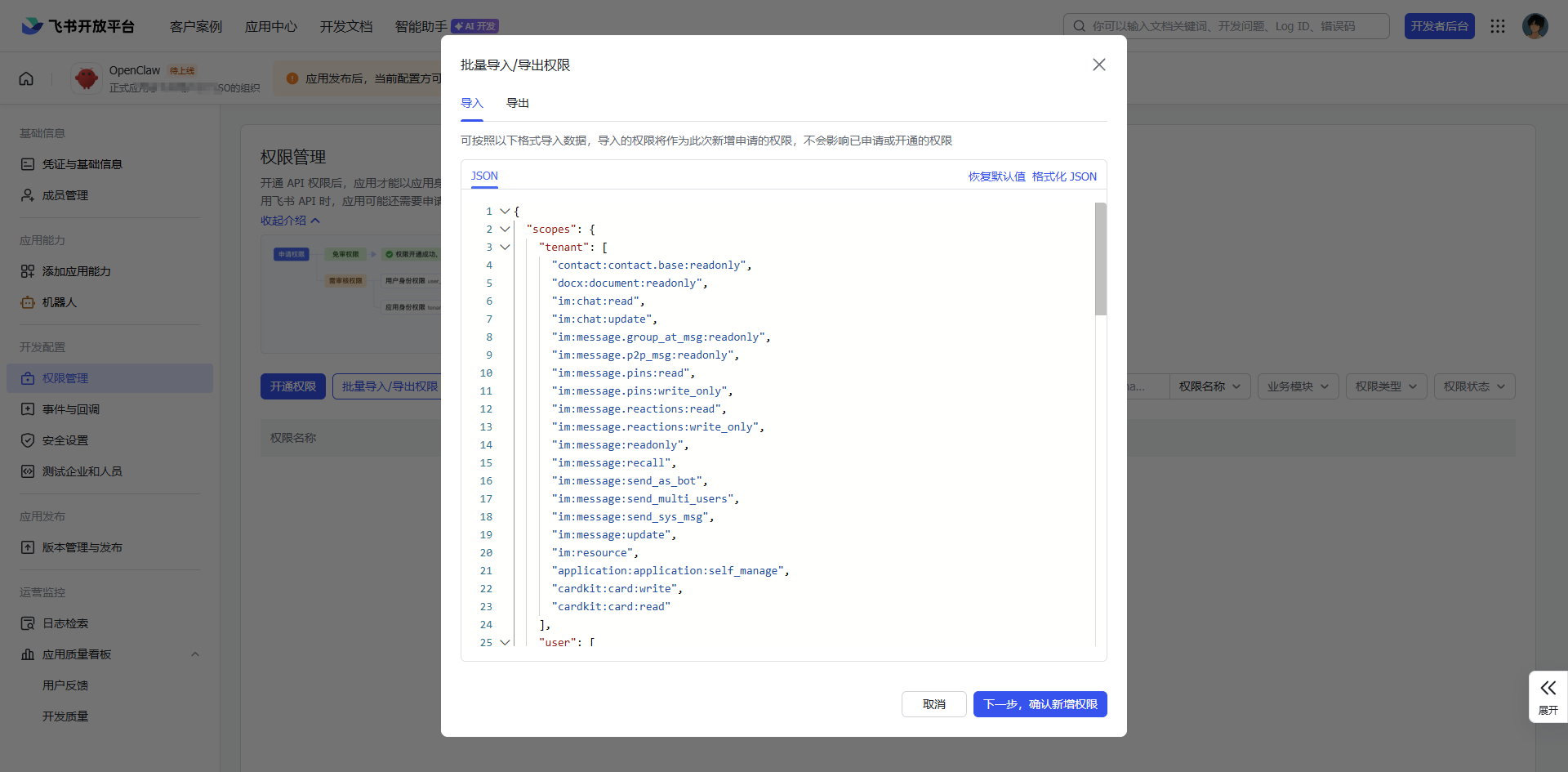

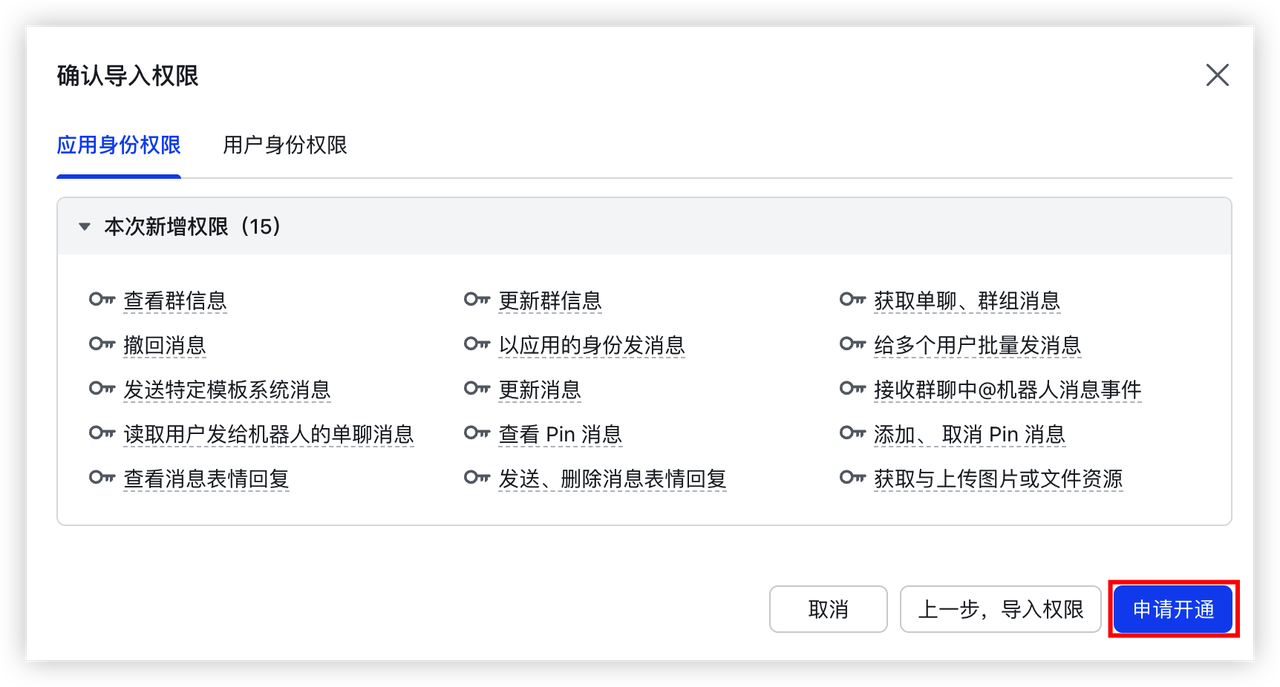

在左侧目录树选择“开发配置 > 权限管理”,单击“批量导入/导出权限”按钮。

加入如下内容:

在弹窗中确认权限无误后,单击“申请开通”按钮,完成操作。

第三步:发布应用

到此就可以回来Jetson去连接我们的飞书机器人了

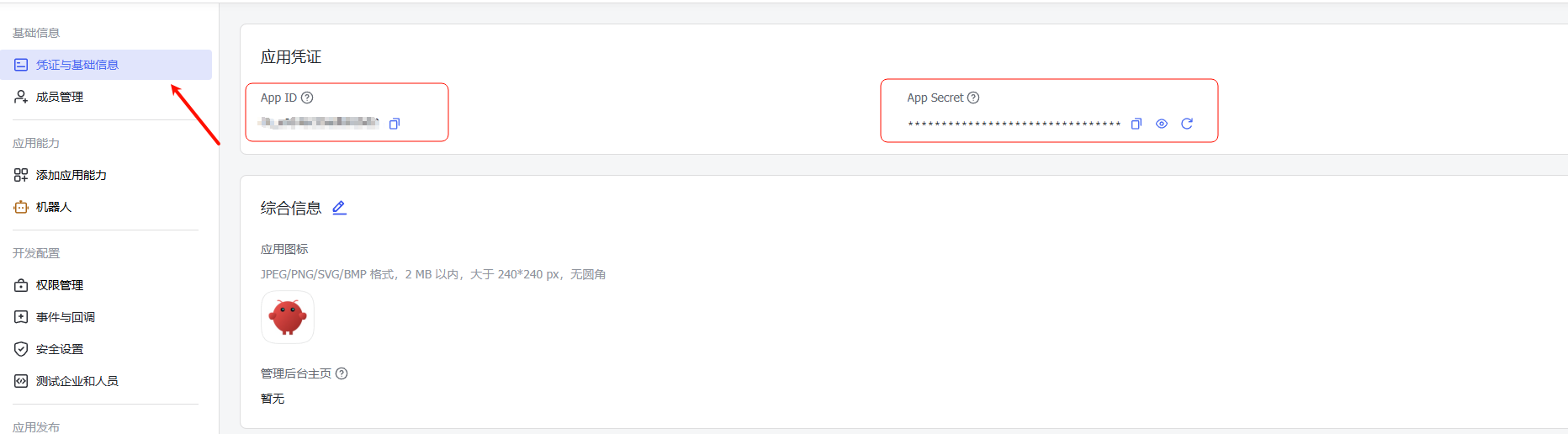

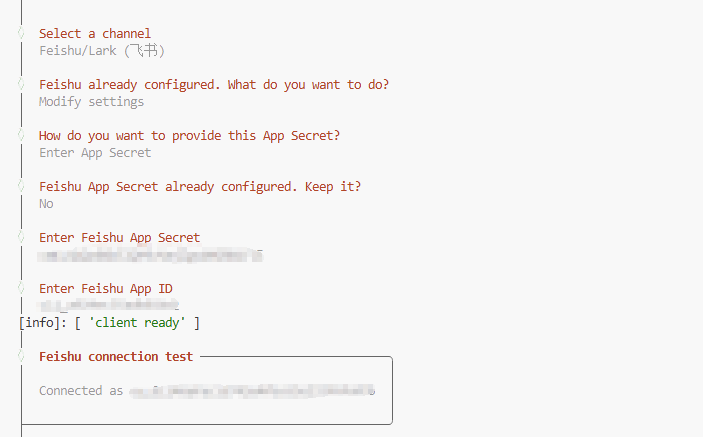

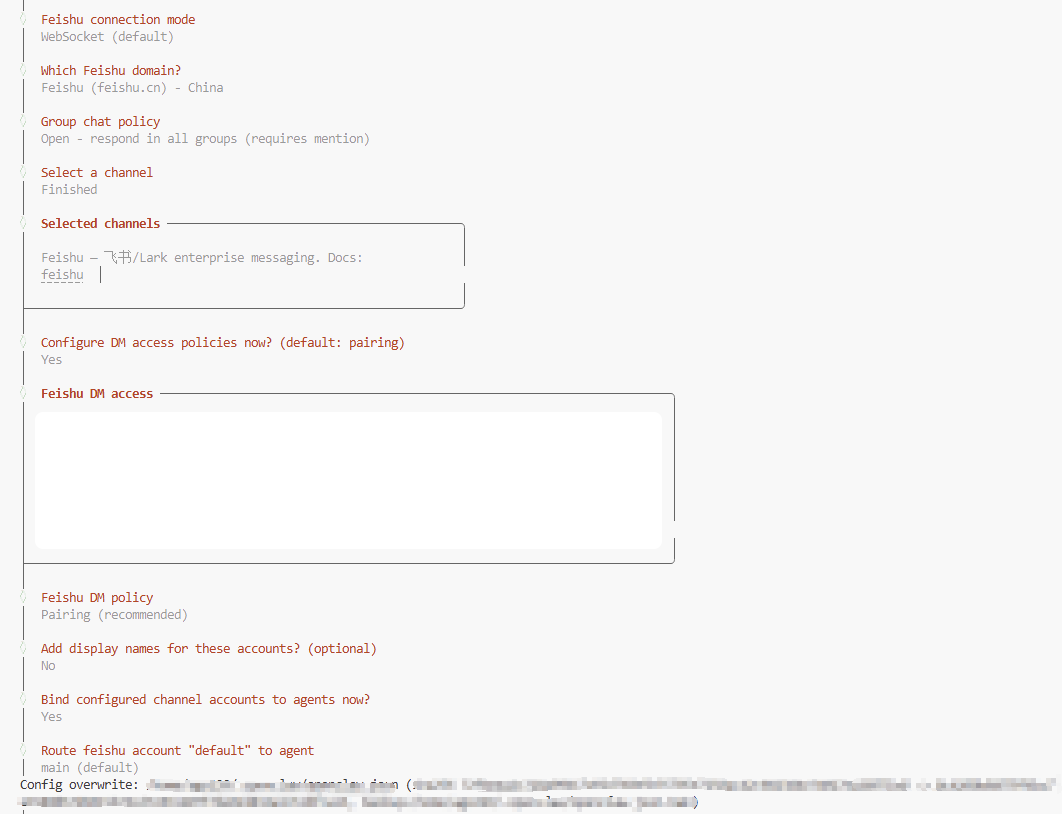

第四步:配置 Feishu Channel

运行:

GPT plus 代充 只需 145

选择:

然后输入:

- App ID

- App Secret

具体过程可以选项可以参考我的

到此就基本完成了openclaw与飞书机器人的连接了,但是要实现聊天还得再继续配置。

第五步:重启Gateway

GPT plus 代充 只需 145

第六步:配置事件与回调

选择:

然后添加事件:

GPT plus 代充 只需 145

这是机器人接收消息所必需的事件。

继续配置回调

添加回调

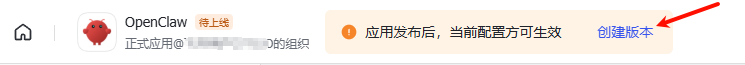

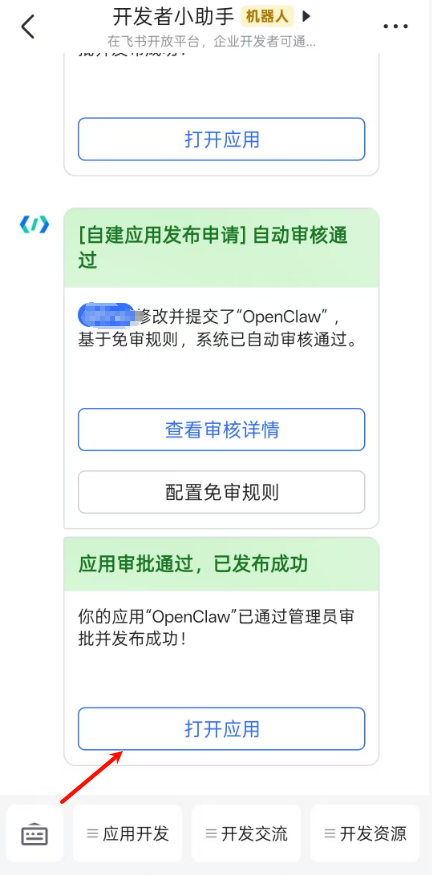

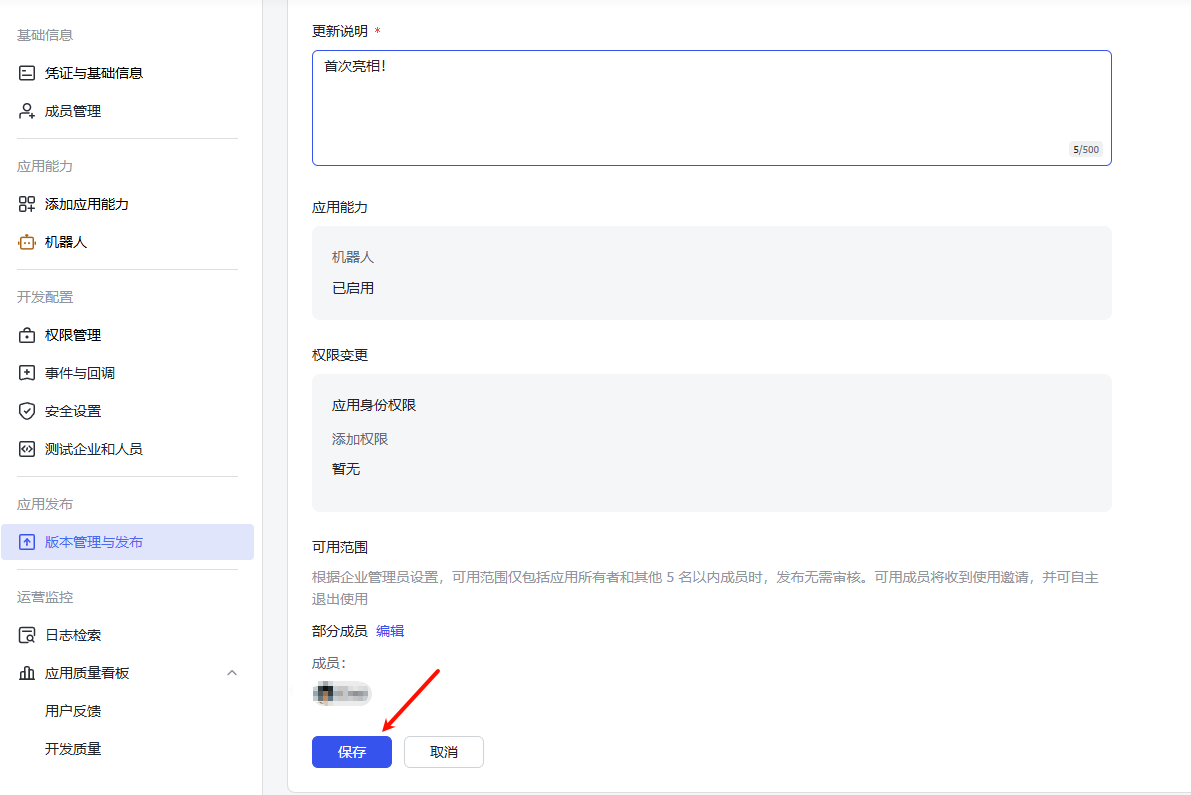

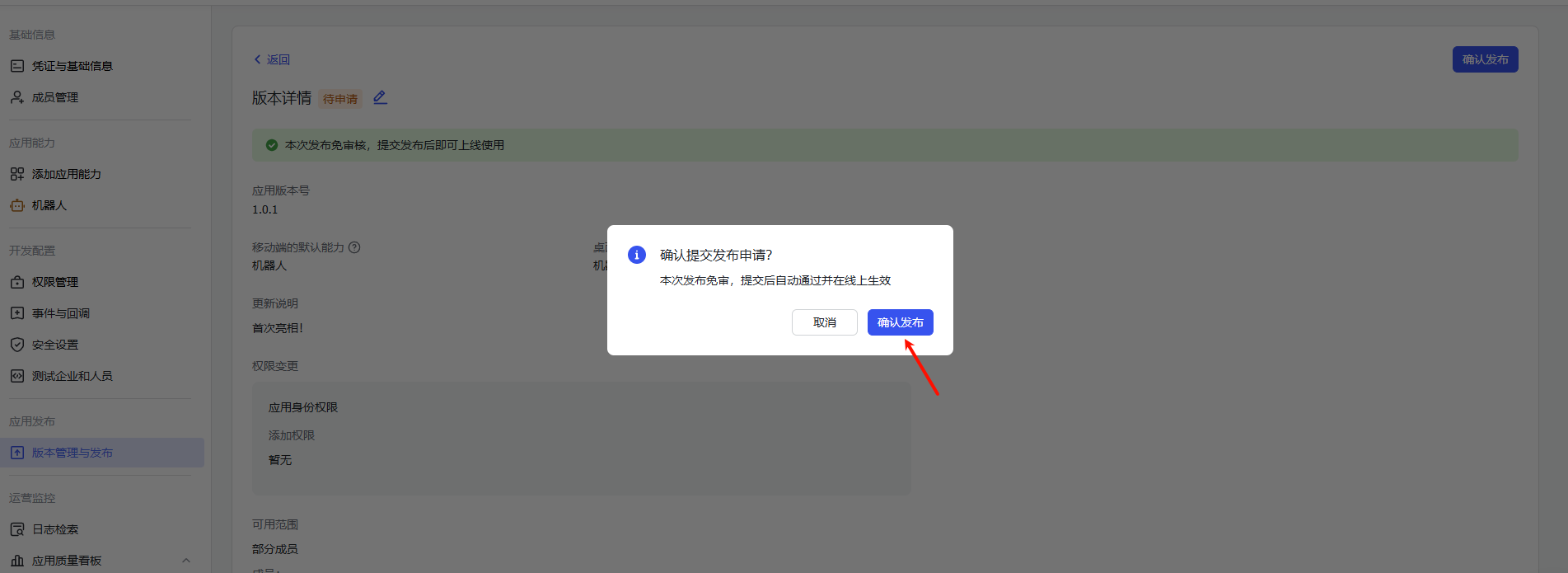

第七步:发布应用版本

这一步非常关键。(这里参考第三步)

很多时候飞书应用配置改了但机器人无效,就是因为没有发布版本。

进入:

创建版本并发布。

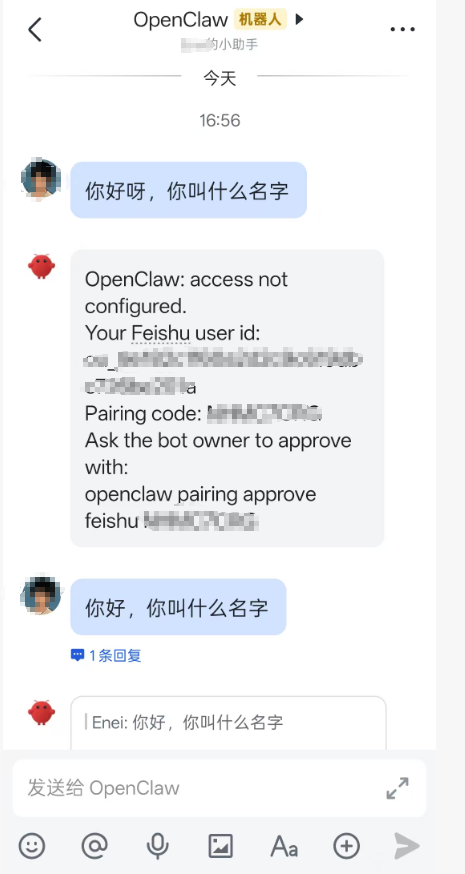

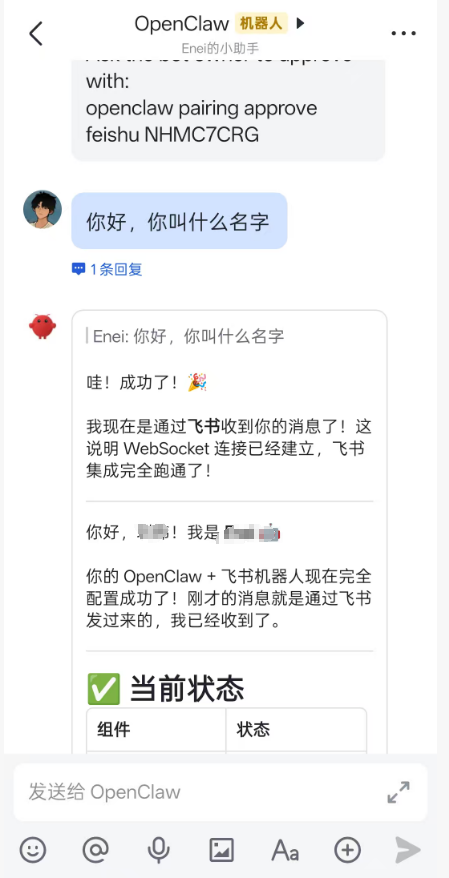

第八步:配置私聊飞书机器人

在飞书APP中找到开发者小助手

之后给机器人发送任何信息

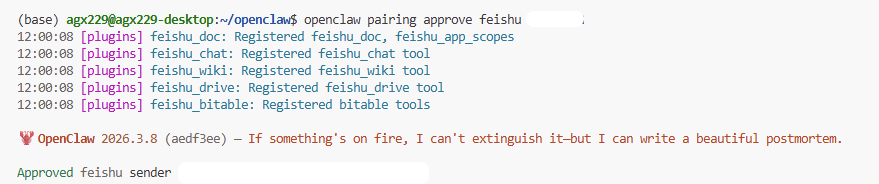

将Pairing code复制然后在Jetson终端输入

GPT plus 代充 只需 145

到此,基本就实现了在飞书中直接召唤我们边缘设备干活了,回到飞书,与我们小助手聊天即可。

坑 1:Jetson 上 CMake 版本过低

会导致依赖编译失败。

坑 2:没有配置 pnpm PATH

会导致全局命令或 UI 构建异常。

坑 3:误以为需要单独安装 Feishu 插件

源码版已经内置,不需要重复安装。

坑 4:没有配置

会导致 CLI 连接 Gateway 时出现 token mismatch。

坑 5:App ID / App Secret 使用了旧应用凭证

这是我这次飞书始终接不通的根因。

坑 6:飞书应用修改后未发布版本

会导致机器人看似配置好了,但实际不生效。

完成上述配置后,可以实现:

- 在 Jetson 上运行 OpenClaw Gateway

- 接入自己的模型 API

- 在飞书群中

- 机器人调用本地 Agent 并返回回复

这为后续扩展提供了很好的基础,例如:

- 远程查询 Jetson 状态

- 执行自动化任务

- 调用机器人系统接口

- 通过飞书统一管理实验设备

这次在 Jetson 上部署 OpenClaw 并接入飞书机器人的过程,整体并不算复杂,但有几个坑非常容易卡住:

- ARM 平台的依赖编译问题

- pnpm 环境变量问题

- Gateway token 机制

只要把这些关键点处理好,OpenClaw + 飞书这套链路其实是很顺的。

如果你也想在 Jetson 上搭一个可远程交互的本地 Agent,这套方案很值得尝试。

预告一下,下一期我将更新一下好用的Skills,让我们边缘设备更好的给我们干活!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/236041.html