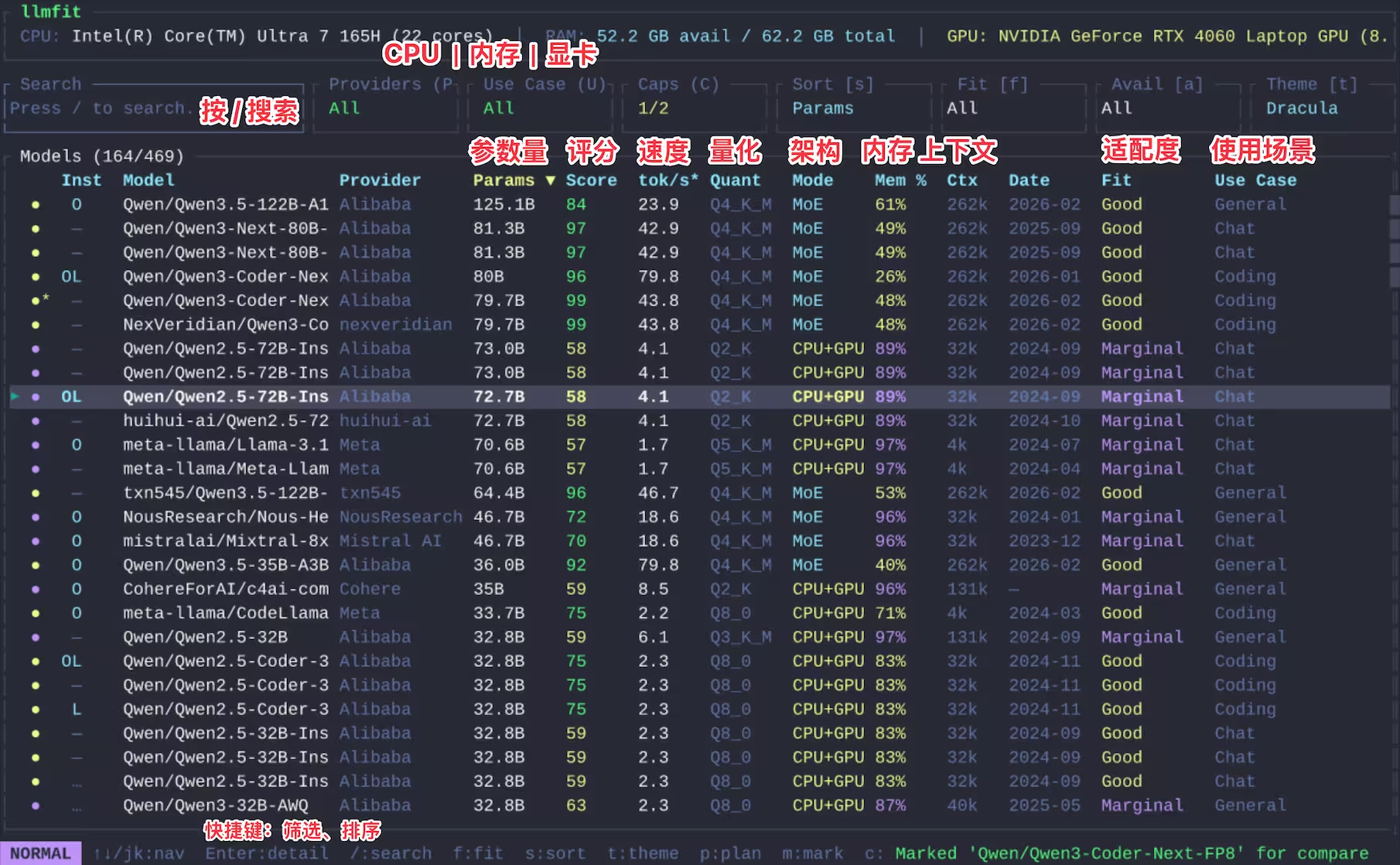

llmfit 是一款 Windows、macOS、Linux 小工具,也是一款 TUI 程序(终端图形界面),它可以自动检测你的电脑 CPU、GPU、内存,从 500+ 款大模型中,列出当前硬件条件下能运行的大模型,并显示:

等等,一目了然。

运行后界面这样的,真的一秒出结果:

llmfit 会根据当前硬件配置,列出适合运行的模型列表,方便用户快速挑选。

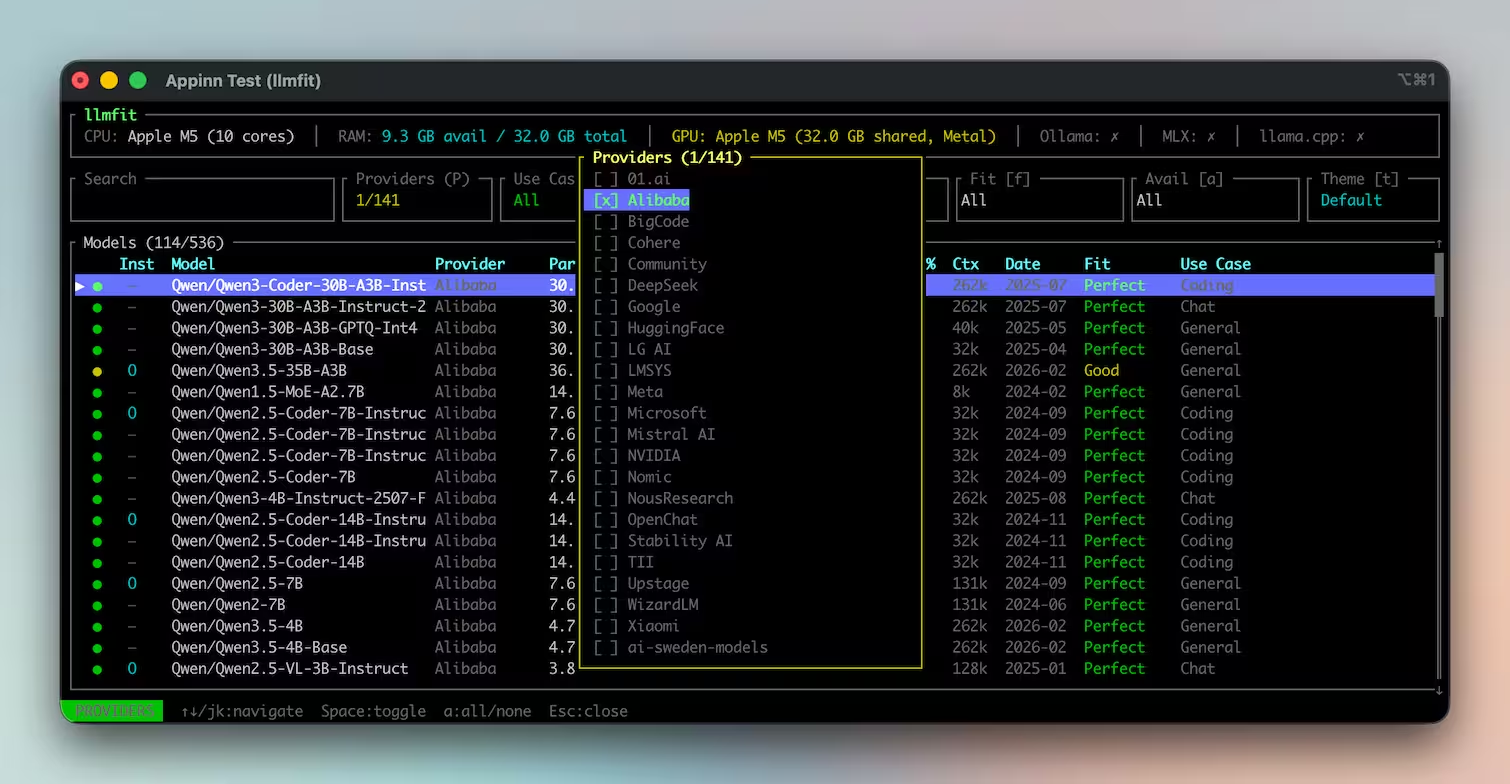

大模型数量非常多,llmfit 里能看到的有将近 500 款,我们可以通过快速筛选,来寻找模型。

比如:按下大些的 ,会出现提供商筛选,再按 a 取消全选,然后选择 Alibaba,就能快速筛选出 Qwen 模型:

接下来可以根据这些信息进一步选择:

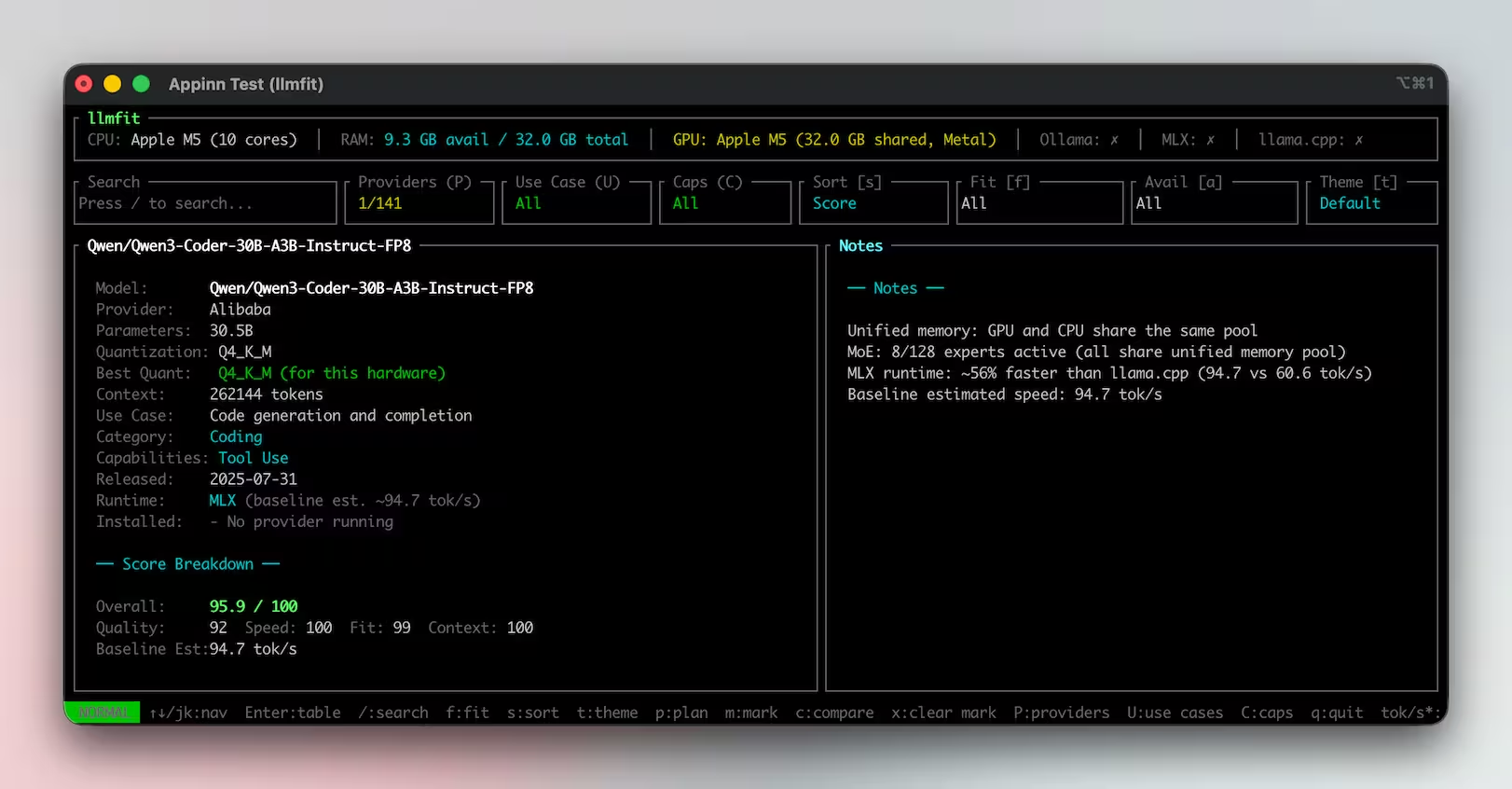

选中模型后,按 回车 查看详情:

例如,直接搜索模型名称:qwen/Qwen3-Coder-30B-A3B-Instruct-FP8

就可以找到模型对应的地址了,比如:https://huggingface.co/Qwen/Qwen3-Coder-30B-A3B-Instruct-FP8

用起来还是非常方便的。

本地模型最大的优势,是隐私。你一定要知道:你输入到云端大模型里的任何内容,模型提供商都能够看到。

即使对方承诺:

但从技术上来说,它确实能拿到你输入的任何数据。

因此,如果涉及:

就只能选择本地模型。

云大模型通常是:按 token 计费,或者按调用次数收费,使用频繁的话,费用会越来越高,比如 OpenClaw,消耗的 Token 数量十分惊人。

而本地模型:一次下载,长期使用。

运行成本只有:电费。

不限次数,不限调用。

还有一些实际体验上的优势:

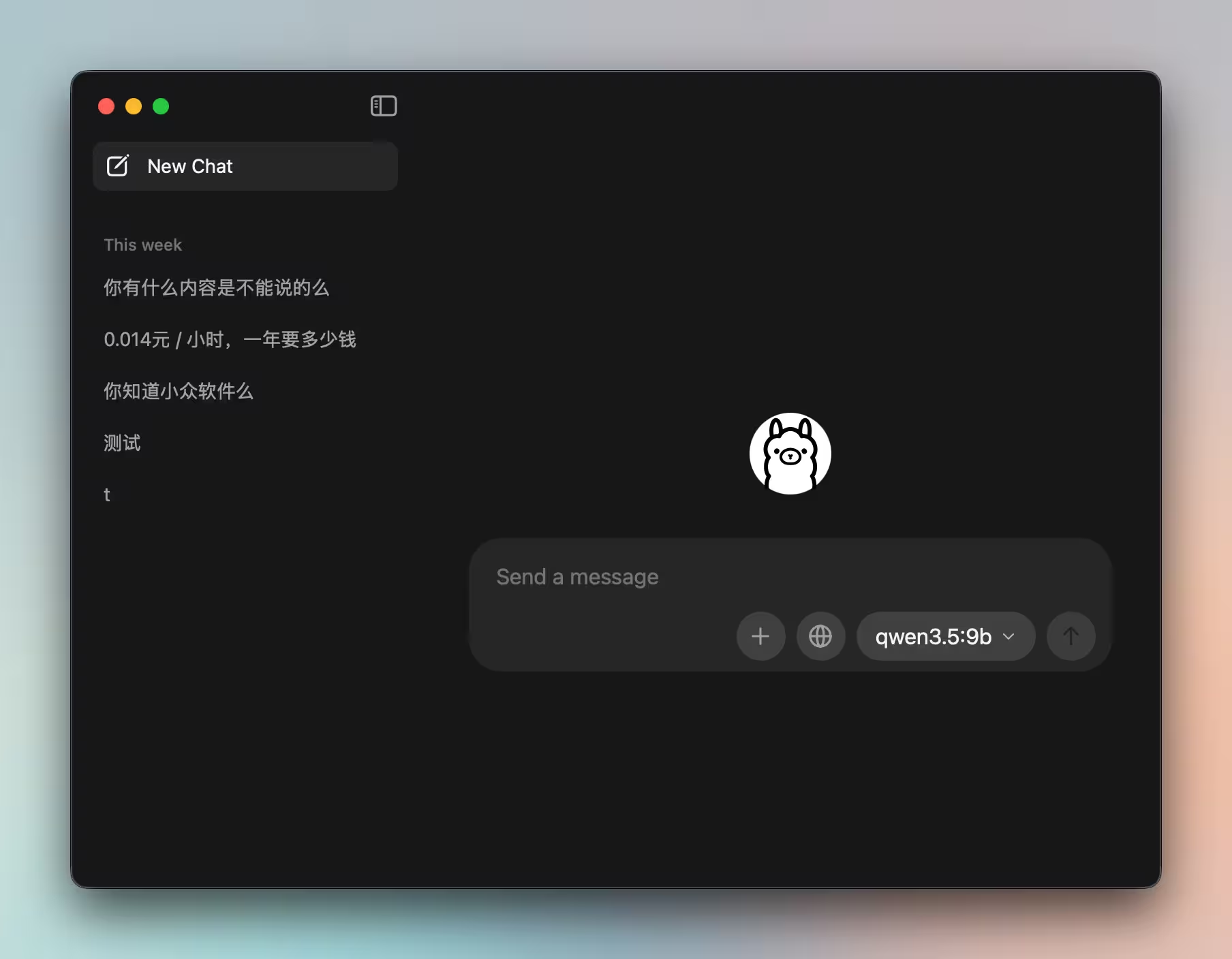

青小蛙觉得,如果是第一次部署模型,从 Ollama 开始,直接在客户端里下载模型就行了:

另外还能试试:

基本上都能很方便地运行本地模型。

最后,希望你有足够的内存 😂

原文:https://www.appinn.com/llmfit/

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/229585.html