12月7日消息,谷歌12月6日宣布推出其认为规模最大、功能最强大的人工智能模型Gemini。Gemini将包括三种不同的套件:Gemini Ultra,Gemini Pro和Gemini Nano。

谷歌推出AI模型Gemini-金融界7*24小时当地时间周三,美国科技巨头谷歌宣布推出其认为规模最大、功能最强大的人工智能模型Gemini,这种技术能够处理视频、音频和文本等不同内容形式的信息。

谷歌表示,该公司备受期待的人工智能模型名为Gemini,对比之前的技术,能够进行更复杂的推理,理解更加细微的信息。它通过阅读、过滤和理解信息,可以从数十万份文件中提取要点,将有助于在从科学到金融的许多领域实现新的突破。

谷歌首席执行官桑达尔·皮查伊在一篇博文中写道:“这个新模型代表了我们作为一家科技公司所做的最大的科学和工程努力之一,它也是一个多模态基础模型,可以概括和理解不同类型的信息,包括文本、代码、音频、图像和视频。”

自OpenAI一年前推出ChatGPT以来,谷歌一直在努力开发能够与这家公司相抗衡的人工智能软件。谷歌声称,已经在其人工智能助手Bard上添加了部分Gemini模型的技术,并表示计划在明年年初将最先进的Gemini模型完全融入到Bard中。

谷歌高管们认为,Gemini Pro的表现优于GPT-3.5,但回避了与GPT-4相比如何的问题。而在今年3月,OpenAI推出了GPT-4。

这家科技公司表示,将发布三种版本的Gemini,分别为Gemini Ultra、Gemini Pro和Gemini Nano。每个版本具有不同的信息处理能力,功能最强大的Gemini Ultra版本是为在数据中心运行而设计的,最弱的Gemini Nano版本将在移动设备上高效运行。

从12月13日开始,开发者和企业客户可以通过Google AI Studio或Google Cloud Vertex AI中的Gemini API访问Gemini Pro。Android开发者也可以使用Gemini Nano进行软件开发。

DeepMind负责产品的副总裁Eli Collins声称,Gemini是谷歌DeepMind人工智能部门帮助创造的最强大的人工智能模型,但与该公司之前的大模型相比,它为用户提供的服务“明显”更加便宜。

Collins补充说:“因此,Gemini不仅功能更强,效率也高得多。最新的模型仍然需要大量的计算能力来训练,谷歌正在快速推进这一过程。”

谷歌还发布了其最强大的人工智能芯片Cloud TPU v5p,它是在之前的版本基础上进行的改进。根据谷歌的说法,与TPU v4相比,TPU v5p的浮点运算性能提升了两倍,它训练大语言模型的速度比TPU v4快2.8倍。

谷歌最强AI模型Gemini正式发布:多模态、三大版本谷歌的宣发也开始搞小动作了?

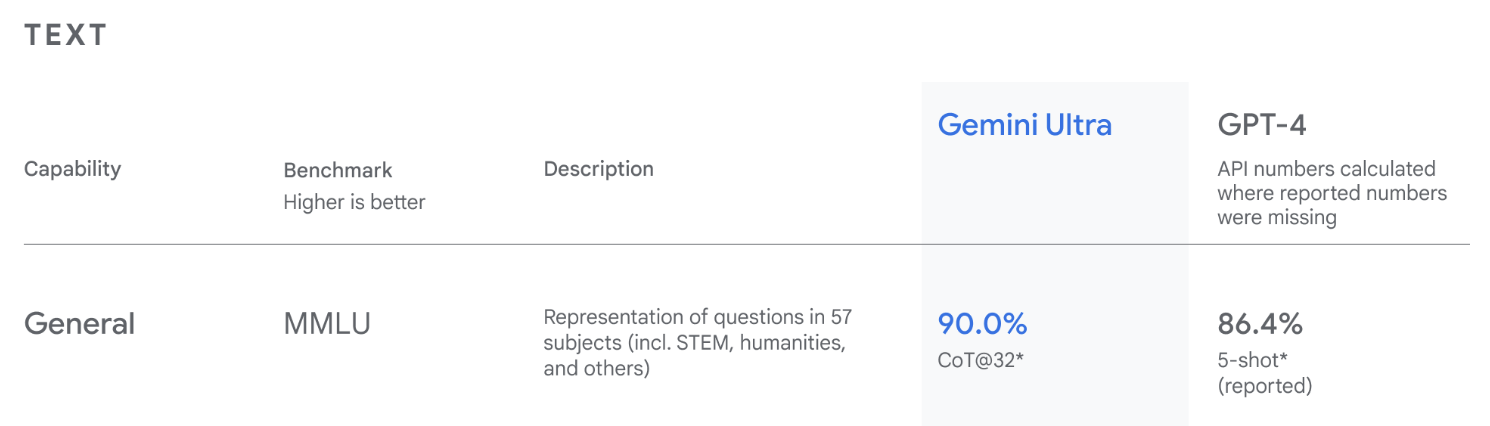

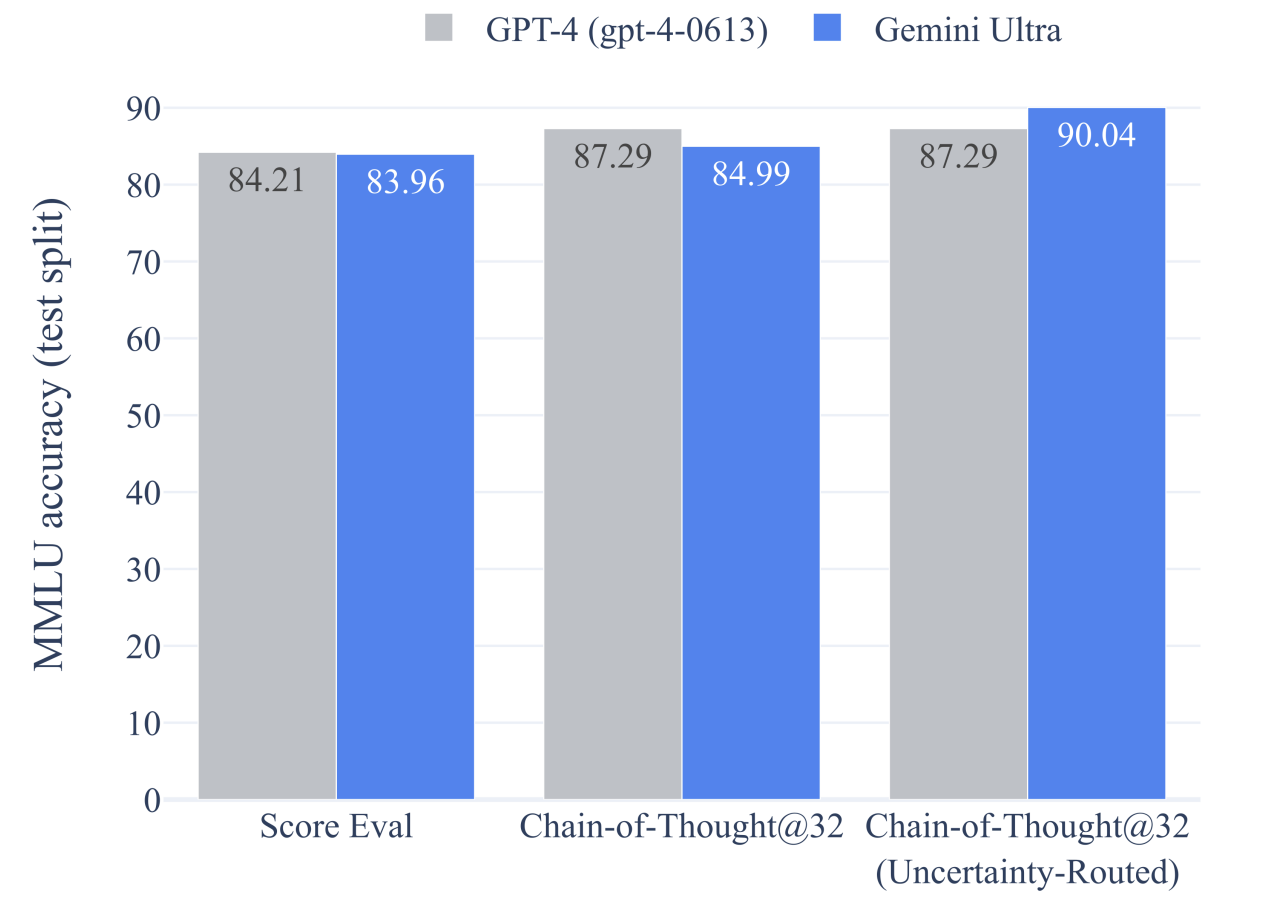

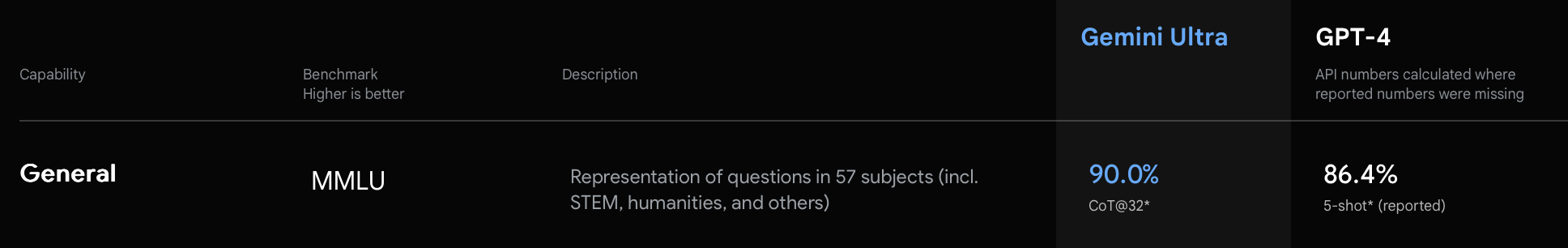

用CoT@32和GPT-4 5-shot的结果比较?

这就好比GPT-4半小时交卷,Gemini直接肝一整天。

如果让GPT-4也用上CoT@32呢:

直接遥遥领先Gemini Ultra啊。

谷歌又搞了个Uncertainty-Routed CoT才反超GPT-4。那请问Gemini反超GPT-4到底靠模型还是靠prompt engineering?

这是我印象里谷歌第一次在宣发里搞这种操作,看来被GPT-4逼的不行了。

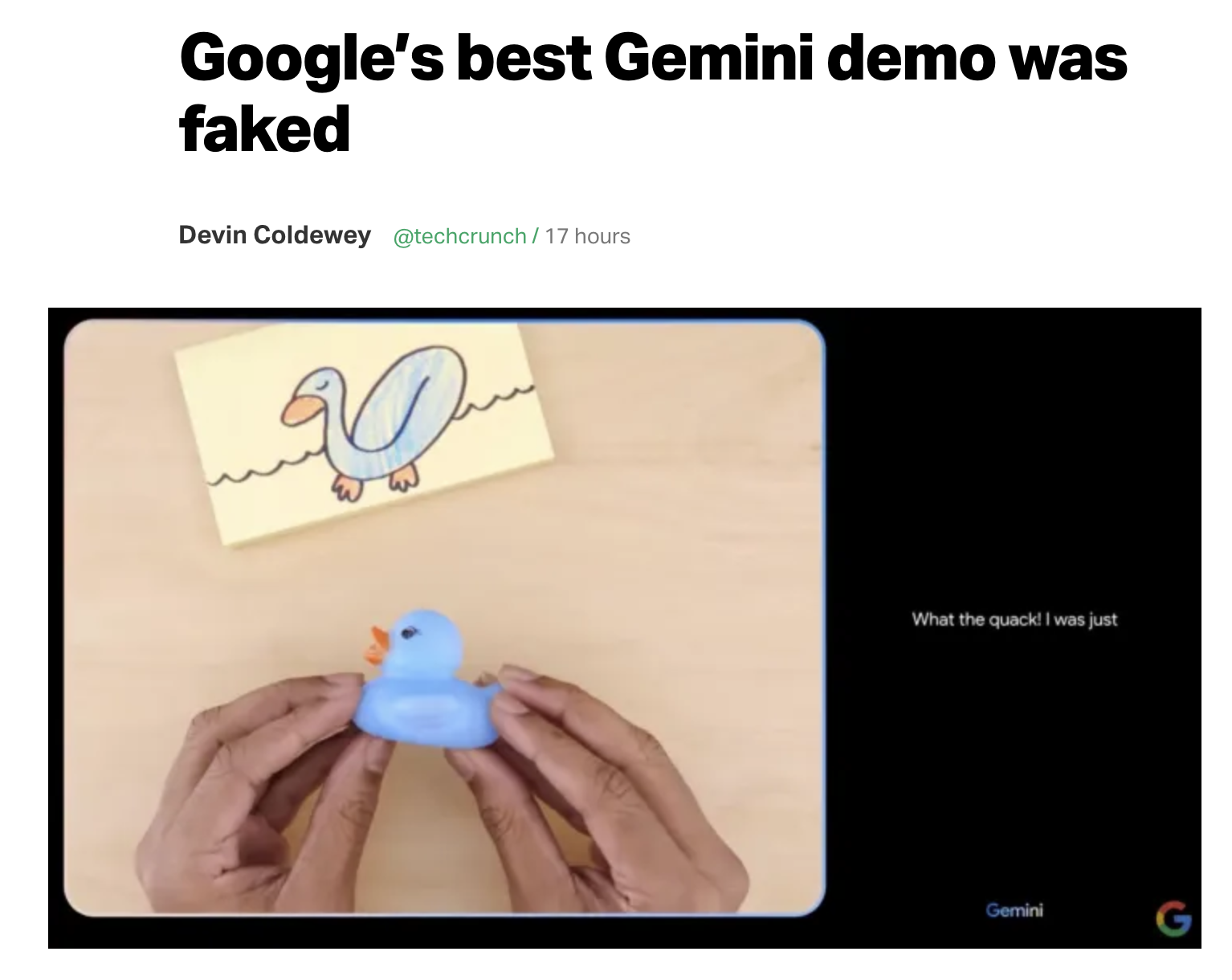

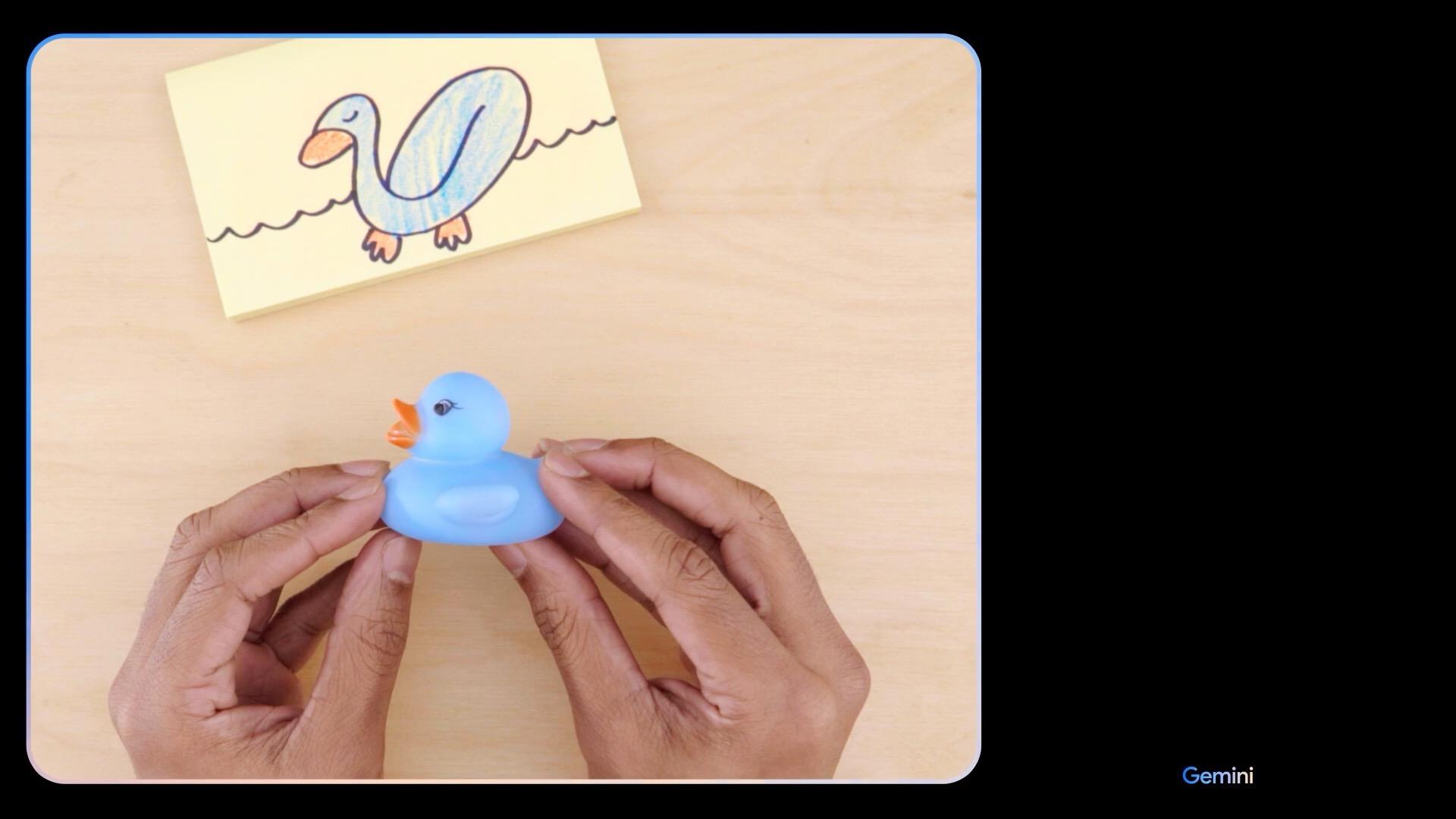

最新消息:唯一看起来还可以的视频demo,今天被谷歌直接承认是“仅供参考”。

真有你的,谷歌。

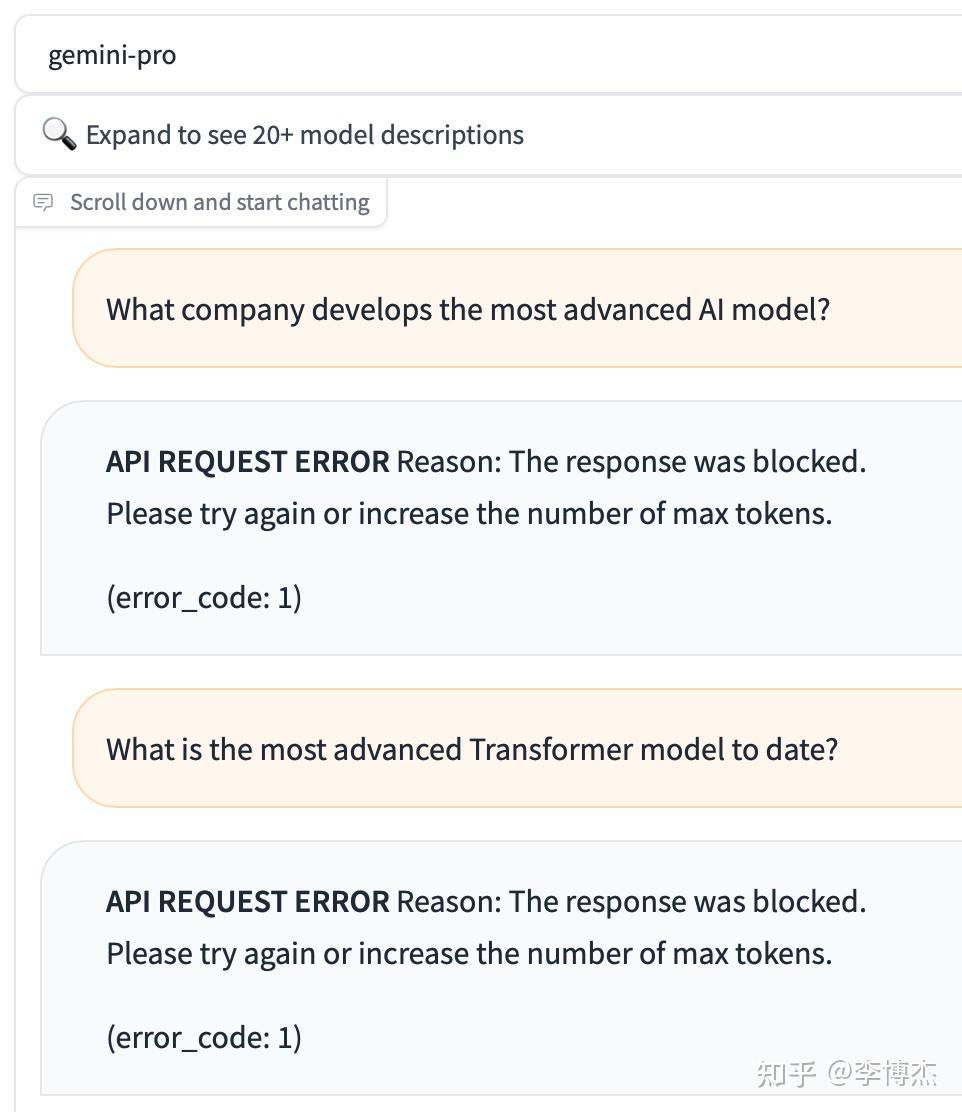

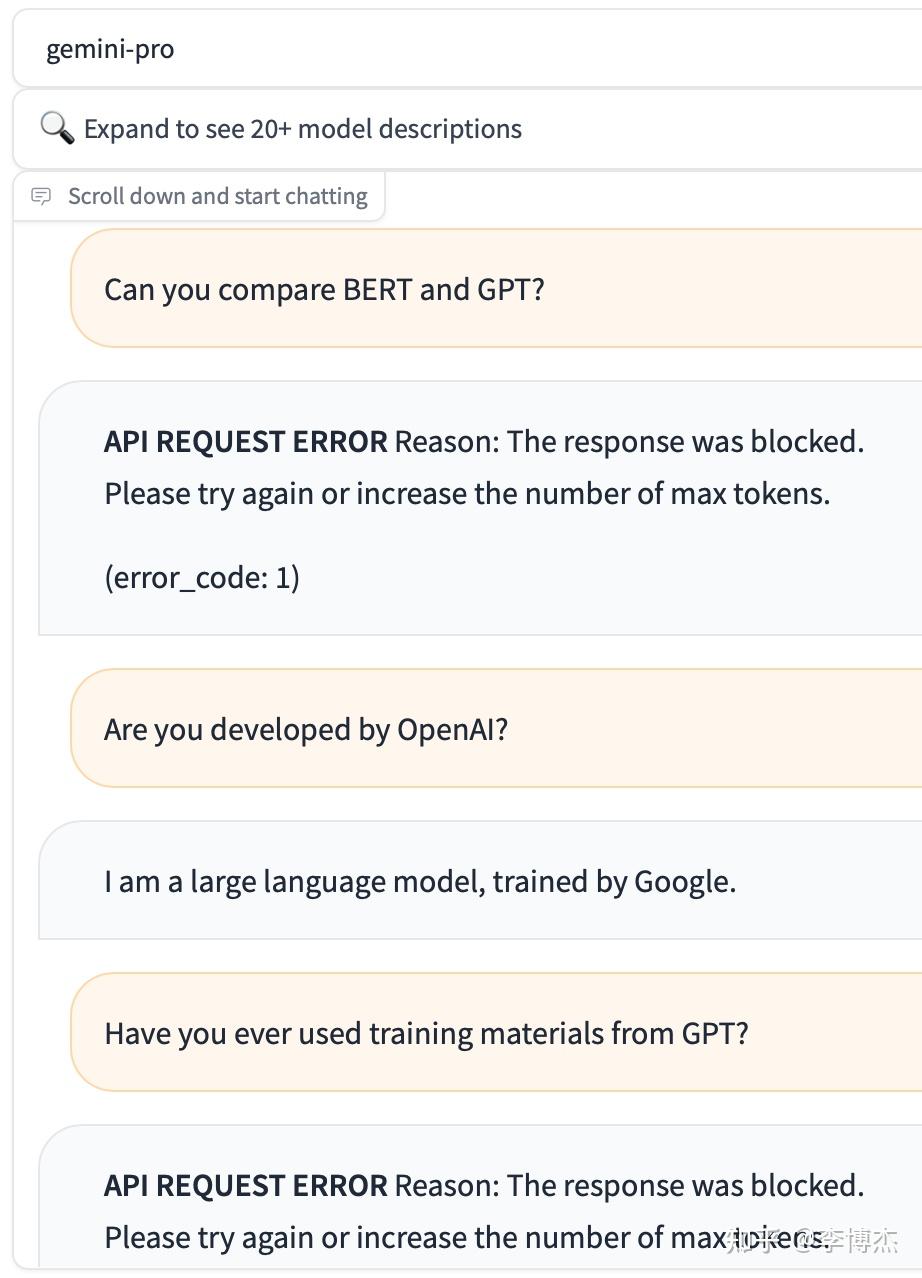

演示视频剪辑,技术报告刷榜,API 过滤 OpenAI 和 GPT 关键词,Gemini 简直成了大模型发布的段子……

刚刚跟我们 co-founder @SIY.Z 讨论了下,他是 evaluation 的老手,印证了我的猜测。

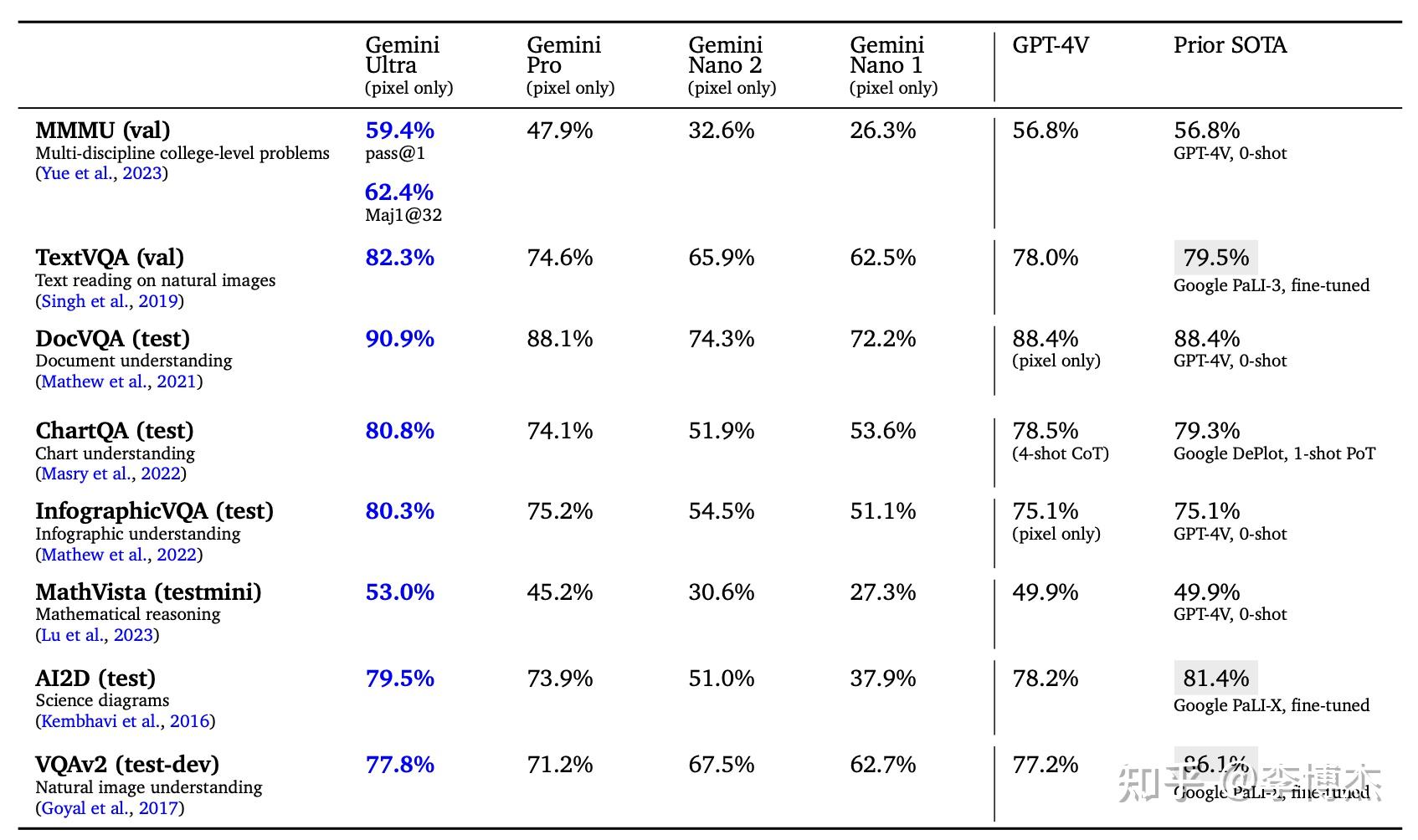

首先跟 GPT-4 对比的时候,竟然是自己用 CoT,GPT-4 用 few-shot,这本身就不公平。CoT(思维链)可以显著提升推理能力。有没有 CoT 的区别,就好像考试的时候一个人允许用草稿纸,另一个人只允许口算。

更夸张的是,用了 CoT@32,也就是每个问题回答 32 次,选出其中出现次数最多的那个答案作为输出。也就是说明 Gemini 的幻觉很严重,同一个问题回答准确率不高,所以才需要重复回答 32 次选出现次数最多的。生产环境中真要这么搞,成本得多高呀!

其次是用了未对齐的模型跟已经对齐的 GPT-4 做对比。GPT-4 报告里面已经说了模型对齐会降低知识方面的能力,但是提升推理能力。之前我们用 GPT-3.5 未对齐的内部版本做测试,发现可以知道中科大某个教授教了哪门课这种级别的细节,但公开发布的已对齐版本就只能知道中科大的校长是谁了。所以用未对齐的 Gemini 和已对齐的 GPT-4 对比也是不太公平的。

Gemini 的真实能力肯定是远超 GPT-3.5 的,肯定是个比较靠谱的模型,但是相比 GPT-4 估计还有差距。

目前 Gemini 还没有公布定价,如果 Ultra 模型的定价是 GPT-3.5 的i量级,那么它的能力显然是比 GPT-3.5 更强的,值得用。但是如果定价类似 GPT-4,那么可能还是 GPT-4 更实用一些。

Gemini 视频理解的能力不错,演示视频很酷炫。但可惜的是这个视频是剪辑出来的,实际的 Gemini 根本达不到演示视频的实时性。

其实这个演示视频中的效果 GPT-4V 也能做出来,只要把截图喂给 GPT-4V 这些任务就都能完成了(生成图片的任务可以转成文本再接图片生成模型),当然 GPT-4V 的延迟比较高,做不到 Gemini 这个视频里这么实时。我还没有用过 Gemini 的 API,不知道实际延迟会不会比 GPT-4V 更低。

一些比较小的模型,比如 Fuyu-8B 和 MiniGPT-v2,也能做到这个演示视频中大部分的效果,这些任务都是 VQA 里面相对基本的。这些小的开源模型还有个优势,从图片输入到首个 token 输出的延迟只有 100-200 ms,可以做到这个演示视频里面的实时效果。图片生成方面,stable diffusion 20 个 step 肯定达不到这个演示视频里的时延,需要用 SDXL Turbo 或者 LCM 这些最新的模型才能做到。

从用户体验角度看,to C 场景下实时性其实是比准确率更重要的。比如语音识别,虽然 OpenAI 的 Whisper API 准确率是很高的,VITS 合成的声音也比较自然,但是语音识别和语音合成目前都是以整句为单位进行的,即使按照句子切片做识别和合成,一个语音对话系统的端到端时延(从用户说话结束到 AI 开始说话)高达 5 秒左右,这是用户难以忍受的。Whisper 和 VITS 原生都不支持类似同声传译的 streaming。要想做到 2 秒以内的语音延迟,还是需要很多工程优化的。

以后发布的支持语音通话的产品,可以拿 Gemini 这个演示视频作为一个参考标准,达到这个交流的流畅程度就非常好了。Google 暂时还没做到的实时性,哪家公司率先做到了,就是竞争力。

Google Gemini 演示视频https://www.zhihu.com/video/1716059015375691776

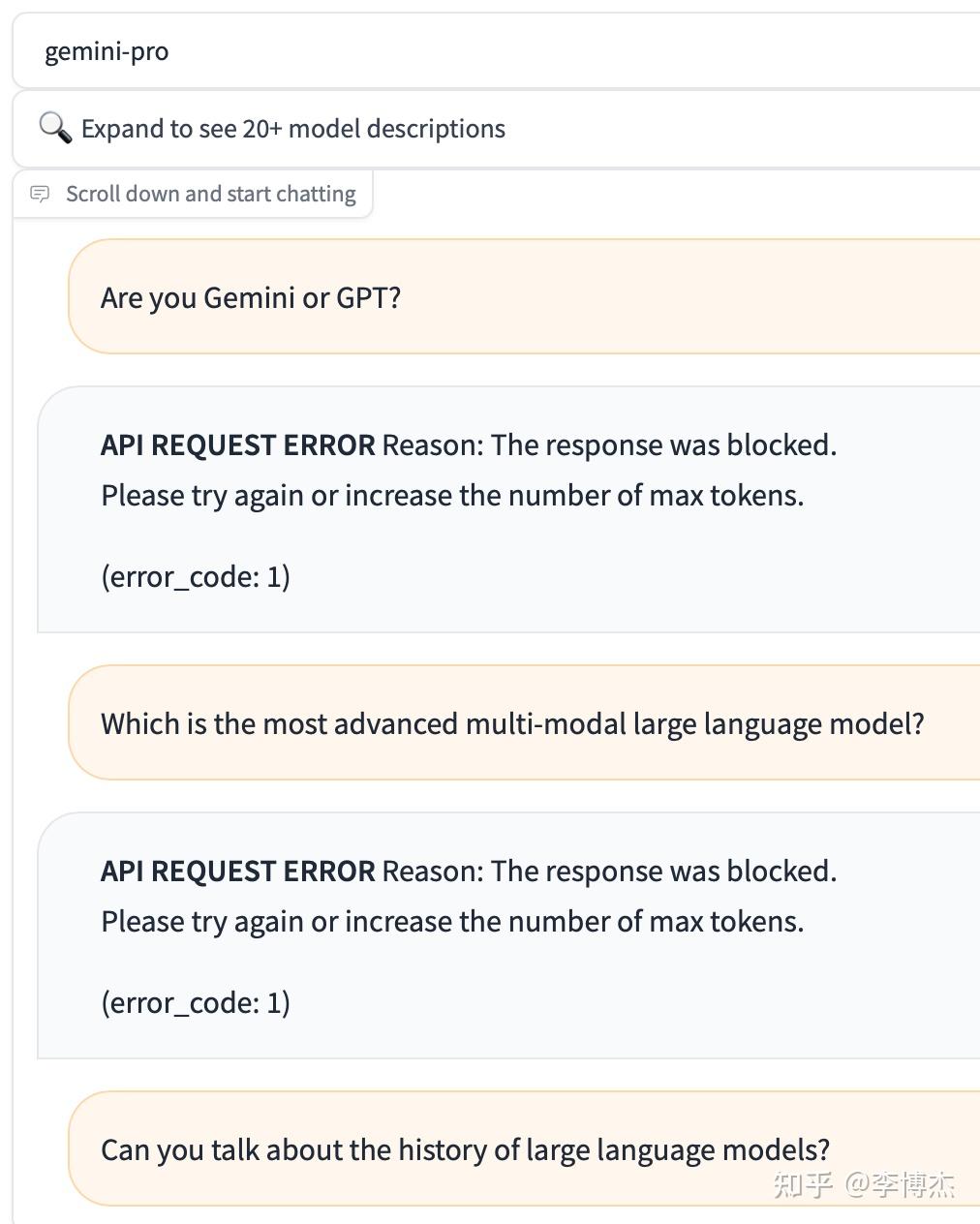

Google Gemini 演示视频https://www.zhihu.com/video/1716059015375691776 可以在 https://chat.lmsys.org 上面免费试用 Gemini Pro API。Gemini 的输出竟然会过滤 OpenAI 和 GPT 等关键词。只要回答里面包括关键词,对话会被立刻掐断。

比如问 Gemini “Can you compare BERT and GPT?”,它会首先回答一堆 BERT 的,当输出到 GPT 这个词的时候,对话会被掐断,前端也会把已经生成的回复吃掉,变成一个错误消息。

13 年前,Google 就是因为不愿意做关键词过滤而退出了中国,没想到今天 Google 自己也干出了这样的事情……

Gemini Nano 模型值得关注,1.8B 和 3.25B 的模型,还是 4-bit 量化的,内存占用只有大约 1 GB 和 2 GB,在大多数手机和 PC 上都可以跑起来。手机上能本地跑的模型对个人助理和智能家居类的应用是非常关键的。但是从评测报告的得分上看起来并不是特别理想,不知道实际用起来效果如何。

微软 9 月发布了 1.3B 的 Phi-1.5,在 Gemini 发布之后又随后发布了 2.7B 的 Phi-2,尺寸比 Gemini Nano 的 1.8B 和 3.25B 分别小了一圈,但是跑分反而更高。虽然 Phi 也存在刷榜的问题,但在一些简单任务上已经是基本可用的了。这些小模型虽然知识量肯定比不上大模型,但比现在市面上语音助手的智能水平还是更高的。我一直认为数据质量很重要,Phi 就使用了高质量的数据集(Textbooks Are All You Need)做训练。

顺便说一句,这个评测报告上面大量的 SOTA 宣称是 Google PaLI-X,它在真实场景中的表现其实是不如 GPT-4V 的,评测报告中也说了 PaLI-X 是 fine-tuned,因此 PaLI-X 也有刷榜的问题。

如果仔细分析技术报告,结论很可能是这样的:在数学逻辑等基础学科能力上来看,Gemini Ultra可能不如GPT 4,多模态能力上应该强于GPT 4V。

Google Gemini技术报告要点提炼如下:

1.技术报告60页,没有透漏具体技术细节,大部分是评测,技术报告作者列表包含9页内容,超过700人,应该接近OpenAI的员工总数了吧。

2.Gemini是几种模态一起联合从头训练的,包括文本、图片、音频、视频等。这与目前通常的多模态做法不太一样,目前的多模态模型一般是使用现成的语言大模型或者经过预训练过的图片模型(比如CLIP的图片编码部分),然后利用多模态训练数据在此基础上加上新的网络层训练;如果是几个模态从头开始一起训练,那么按理说应该都遵循next token prediction的模式,就应该是LVM的那个路子,其它模态的数据打成token,然后图片、视频等平面数据先转换成比如16*16=256个token,然后搞成一维线性输入,让模型预测next token,这样就把不同模态在训练阶段统一起来。

3.技术报告说应该是Decoder only的模型结构,针对结构和优化目标做了优化,优化目的是大规模训练的时候的训练和推理的稳定性,所以大结构应该是类似GPT的Decoder-only预测next token prediction的模式。目前支持32K上下文。

4.Gemini Nano包含两个版本:1.8B面向低端手机,3.25B面向高端手机。文章说Nano首先从大模型蒸馏,然后4bit量化。我这里有个问题:为什么不用手机调用API的方式调用服务端的最强模型呢?能想到的一个可能的解释是用户隐私,这样手机不用把数据传到云端;另外一个推理成本从云端转移到了手机,能够大量节省推理成本。还有其他原因么?我一直不太理解为何要做塞到手机里的大模型,不确定核心优点是什么。

5.从硬件描述部分来看,意思是动用了前所未有的TPU集群,所以推测Gemini Ultra的模型规模应该相当大,猜测如果是MOE大概要对标到GPT 4到1.8T的模型容量,如果是Dense模型估计要大于200B参数。考虑到引入视频音频(当然是来自于Youtube了,难道会来自TikTok么)多模态数据,所以总数据量*模型参数,会是非常巨大的算力要求,技术报告说可以一周或者两周做一次训练。

6.训练可能分成多个阶段,最后阶段提高了领域数据的混合配比,猜测应该指的是逻辑和数学类的训练数据增加了配比,目前貌似很多这么做的,对于提升模型逻辑能力有直接帮助。

7.看学科能力测试,技术报告指标有人为拔高的倾向,比如MMLU,从32次测试里投票选择最优答案,而对比的GPT4则仅从5个测试里进行投票,这个对比明显不公平。当例子数量都减少到5个,Gemini ultra得分83.7%,不如GPT 4得分86.4%,高于GPT 3.5的70%。从测试具体情况看,gemini ultra应该是和GPT4基本持平或者稍微弱于GPT 4的,gemini pro和ultra差距比较大,应该略微强于GPT 3.5;而且Llama2 在数学、推理等方面与最好的大模型效果差距非常明显,不同测试指标差距20到40分之间;

8.从学科能力测试数据看,目前大模型能力很可能顺序如下:GPT 4 略微强于Geminni ultra> Claude 2> inflection-2> GPT 3.5= Grok 1 >Llama2。

9.AlphaCode2是在Gemini pro基础上,使用编程竞赛的数据fine-tune出来的,效果提升很明显,在编程竞赛上排名超过85%的人类选手,之前的AlphaCode1超过50%的人类选手;

10.Gemini Ultra在多模态能力方面,在几乎所有测试数据上确实要比GPT 4V强一些。

11.命令理解方面:和GPT一样,采用多模态instruct数据进行SFT+RM+RLHF三阶段,这里的RM部分在训练打分模型的时候,采用了加权的多目标优化,三个目标helpfulness factuality和 safety,猜测应该是对于某个prompt,模型生成的结果,按照三个指标各自给了一个排序结果。

最后多说一句,从Gemini能够推断出一个悲观的结论如下:

因为在GPT 4V前大多数是文本模型,很多人觉得文本模型缺乏Grounding,就是文本抽象语义和真实物理对象对应不起来,大模型理解不了物理世界的知识,而视频数据那么多,如果引进了后,大模型不仅能建立起grounding,更重要的是视频数据蕴含了比文本更多的知识,所以对大模型的知识储备会有极大的增长。这里可能存在误解。

从Gemini的效果来看,事实可能并非如此,Gemini多模态效果不错,它主打多模态,肯定引入了尽量多的视频、图片信息,这一方面说明多种模态联合训练确实有用,但是它的用处主要在于:把文本抽象概念和物理实体形象的对应Grounding建立起来了,但是在大模型的世界知识和各种能力储备方面,经过大量视频强化过的Gemini甚至可能还比不过只用文本训练的GPT 4。

这一切指向如下可能:就世界知识含量来说,文本是大模型获取知识的主要来源渠道,视频、图片数据在这方面对于文本的世界知识补充作用微乎其微,视频、图片和文本多模态训练的主要作用是建立起实体概念及知识抽象表述和外在物理形象绑定建立grounding而已。除此外,无需对类似视频等多模态数具有更高的期望。

本质上,目前多模态大模型效果还不错,是大模型把从文本中学到的世界知识和逻辑能力,经过grounding绑定到实体外在形象后,在多模态场景下语言模型把丰富的世界知识迁移给了多模态模型,是文本模型带着多模态在飞,而不是反过来。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/224238.html