二、准备工作

操作系统:Windows。

硬件:至少 16GB 内存(推荐 32GB),若有 GPU(如 NVIDIA)可加速推理。

软件:安装 Git 和 Docker(可选,用于 AnythingLLM)。

三、步骤详解1. 安装 Ollama 并部署 DeepSeek 7B

Ollama 是一个轻量级框架,专为本地运行大语言模型设计。以下是安装和部署步骤:

下载 Ollama:访问 Ollama 官网,根据你的操作系统下载对应版本。

备注:下载可能需要搭梯子

如果你没有梯子,就用以下链接:

通过网盘分享的文件:OllamaSetup.zip

链接: https://pan.baidu.com/s/1o4zllBwweHN7JJLyphMKBQ

提取码: 66xn

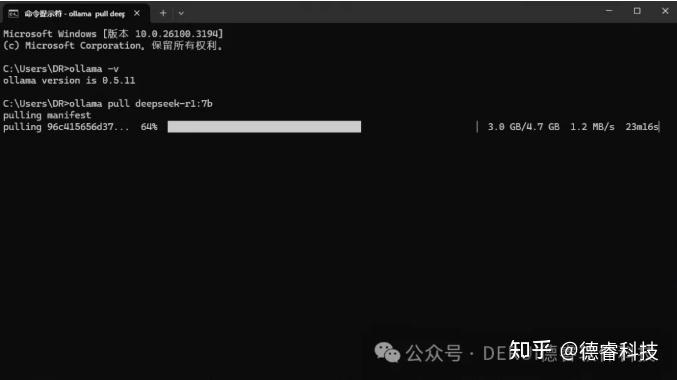

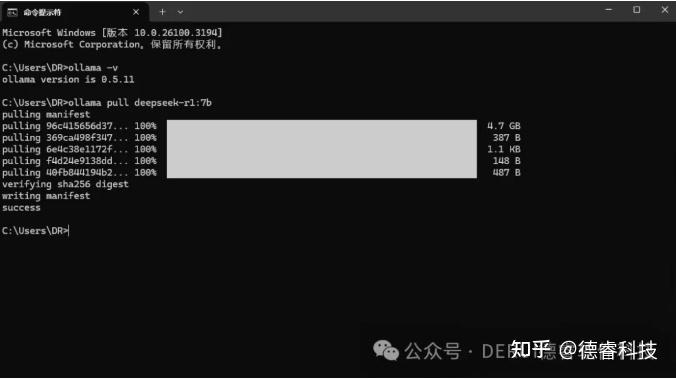

拉取 DeepSeek 7B 模型:安装完成后,打开终端,运行以下命令拉取 DeepSeek 7B 模型:

ollama pull deepseek-r1:7b

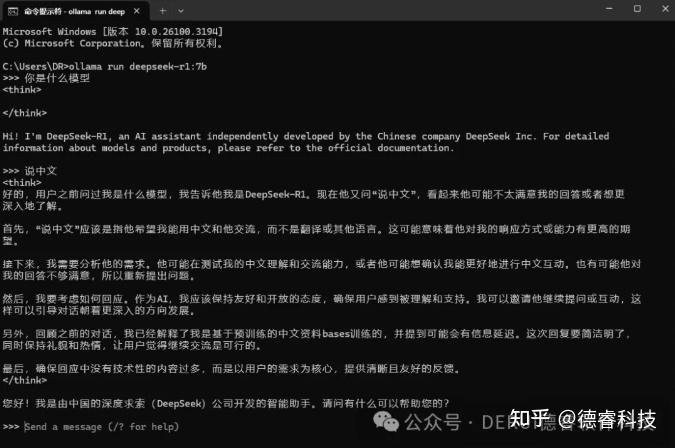

测试模型:输入以下命令启动模型并测试:

ollama run deepseek-r1:7b

在终端输入一句问话,例如“你是什么模型?”,观察模型是否正常返回回答。

2. 安装 AnythingLLM

AnythingLLM 是一个开源工具,提供友好的界面来管理知识库和与本地模型交互。

- 下载AnythingLLM:访问 AnythingLLM 官网,下载桌面版本(Windows/macOS/Linux 均支持)。

- 3. 配置 Ollama 与 AnythingLLM

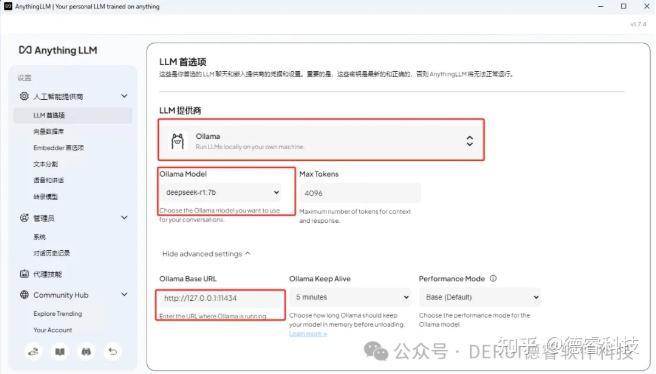

AnythingLLM 需要连接到本地运行的 DeepSeek 7B 模型:

打开 AnythingLLM 界面,进入“设置”(Settings)。

在“LLM Preference”(语言模型偏好)中选择“Ollama”。

设置“Ollama Base URL”为 http://127.0.0.1:11434。

在“Ollama Model”中选择 deepseek-r1:7b,保存设置。

4. 构建知识库并投喂数据

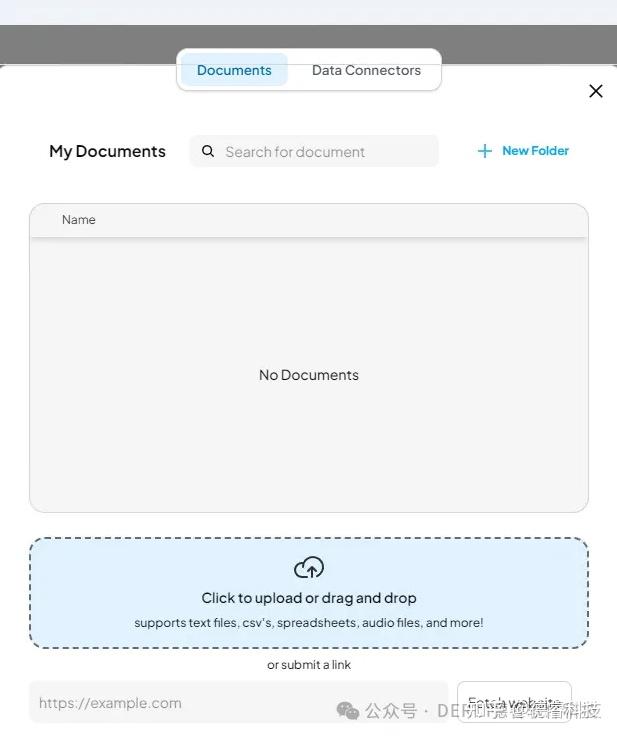

AnythingLLM 支持上传文档(如 PDF、TXT)并将其转化为可检索的知识库:

- 创建工作空间:在 AnythingLLM 主界面,点击“New Workspace”,命名你的知识库(例如“DR”)。

- 上传文档:点击工作空间右侧的“Upload”按钮,支持PDF、Markdown 等格式。上传完成后,AnythingLLM会自动将文档转为嵌入向量(embeddings),存储在本地。

通过本教程,您已成功在本地环境中部署了DeepSeek-7b模型,结合 AnythingLLM,构建了一个私有化智能知识库。后期通过不断的学习训练,行程匹配自己需求的大模型。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/223077.html