Ubuntu Server 24.04 LTS

在文件的最后添加下面两行

输入下面的命令更新并重启

继续执行命令

将cuda工具包下载好后(不要盲目追求新版,平台会不适配),在驱动所在目录执行(选择安装选项中,默认选中安装显卡驱动)

设置全局环境变量

重启使生效,指令测试

将cuDNN下载好后,在所在目录执行

更新cuDNN时,在apt-get update前删除旧版,比如

Miniconda3安装脚本

注:download.pytorch.org不挂代理的话速度很慢。截至2025年3月22日,pytorch不加--index-url参数默认即 whl/cu124,所以可以去掉--index-url参数以事先设置好的全局国内源下载。实时具体情况可在Start Locally | PyTorch查看。

注:访问不了github的小伙伴可以在网上搜索github换源方法

开始安装

- unsloth/DeepSeek-R1-Q4_K_M

- ollama拉取后,在blob内找到最大的文件,添加后缀.gguf

注:

- –optimize_config_path后面的文件夹位置相应换成你git clone ktransformers时的位置

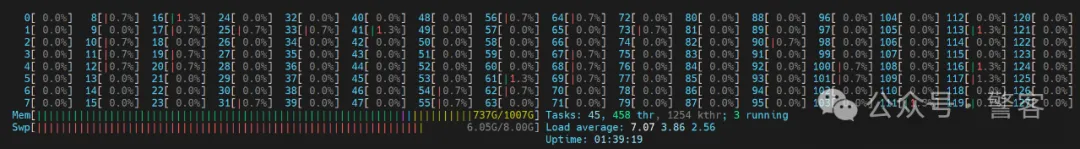

- The command args specifies how many cores to use (it’s ok that it exceeds the physical number, but it’s not the more the better. Adjust it slightly lower to your actual number of cores)

API兼容OpenAI和Ollama

测试每秒tokens在6-13tokens/s左右

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/220636.html