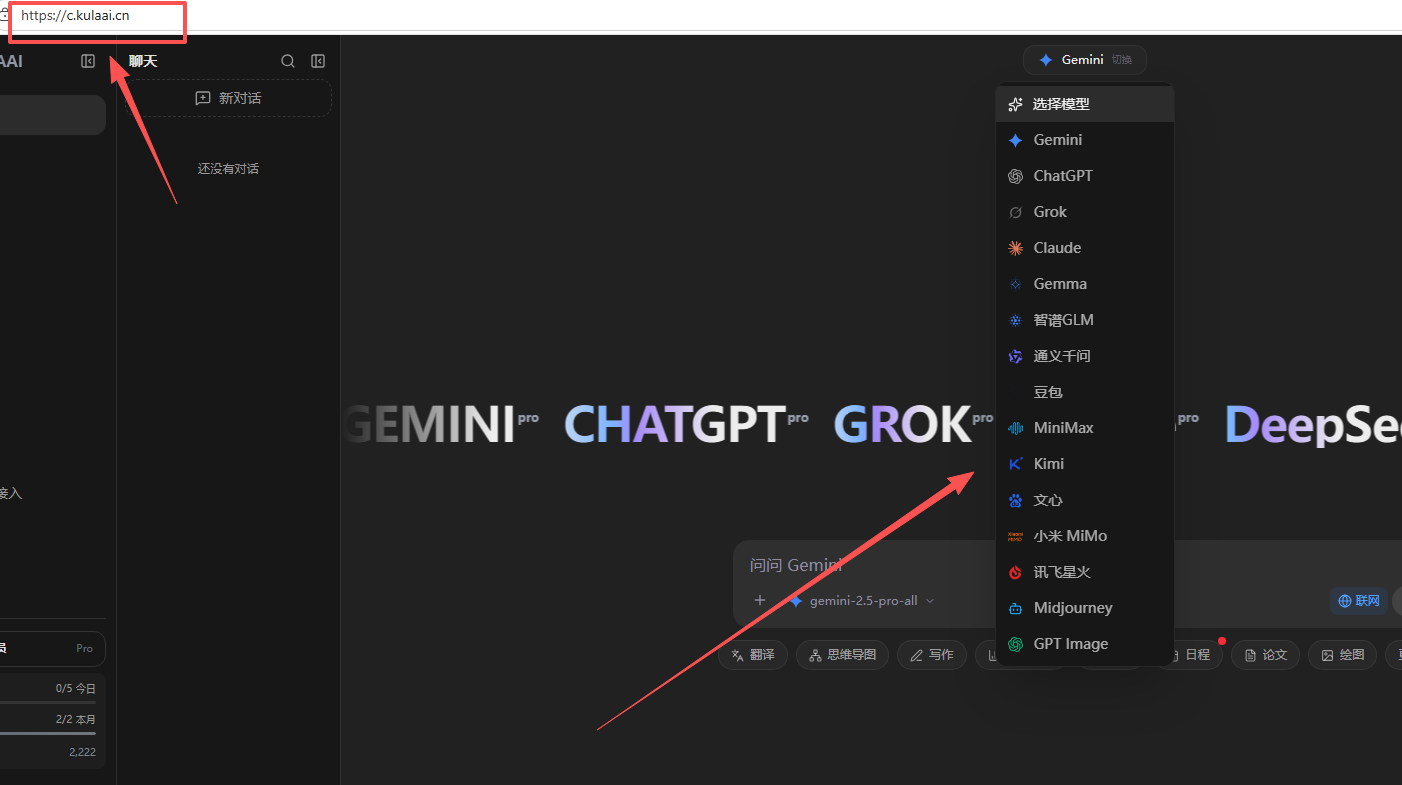

最近在AI模型聚合平台库拉(c.kulaai.cn)上对比了几款主流编程工具的调用数据,发现一个值得聊的话题:Claude Code的综合评分依然很高,但"性价比"这一项的排名在持续下滑。作为一个用了大半年Claude Code的开发者,今天说点实在的。

Claude Code的真实体验

先说好的部分。

Claude Code在复杂项目里的上下文理解能力,目前仍然是第一梯队。一个二十万行代码的项目,它能准确识别模块间的依赖关系,做跨文件重构的时候很少出现遗漏。这种深度推理能力,是Cursor和Copilot目前做不到的。

长文本处理也是强项。给它一个完整的API设计文档,让它基于文档生成对应的代码实现,准确率非常高。其他工具在这类场景下容易出现"前半段对、后半段跑偏"的问题,Claude Code基本不会。

代码审查方面,它能给出架构级别的建议,而不只是语法层面的纠错。这一点对中高级开发者来说价值很大。

但今年的痛点也是真的

Q1过后,三个变化让很多人开始犹豫。

第一,成本上涨。API调用价格涨了15%-20%,对于月均消耗几百万token的团队来说,成本增加是显性的。

第二,限制收紧。并行会话数缩减、高峰时段排队、上下文窗口分配策略调整。单个看都不致命,叠加起来体验下降明显。

第三,生态封闭性。Anthropic的模型不对外开放微调,和第三方工具的集成也在收紧。想做深度定制的团队,路越走越窄。

Codex是什么来头?

3月底OpenAI放出codex-plugin-cc,半天时间GitHub star突破3.2k。这个插件的核心意图很清晰:降低Claude Code用户迁移的成本。

Codex CLI本身的定位和Claude Code不同。它走的是终端轻量化路线——启动快、响应快、token消耗低。我实测下来,同样的代码生成任务,Codex的响应时间大约是Claude Code的60%,token消耗大概是65%。

这意味着什么?日常写业务代码、CRUD操作、脚本编写这类占开发者80%工作量的场景,Codex的效率反而更高。

安装流程实测

Codex的安装过程被设计得极其简洁,全程不到十分钟。

先确保本地Node.js版本在18以上。然后通过包管理器执行一行全局安装命令。安装完成后运行认证流程,填入OpenAI API密钥即可。如果你的账户有GPT-5.4或GPT-5.3-codex的调用权限,直接使用最新模型。

不需要配置环境变量,不需要安装额外依赖,不需要修改任何系统文件。这种零摩擦的安装体验,在CLI工具里算做得很好的。

对比:Claude Code vs Codex

没有绝对的优劣,只有场景的适配。

我的建议:不要二选一

今年Stack Overflow的调查数据显示,92%的专业开发者已经在使用AI编程工具,但只有28%只用一个。大部分人是两到三个混着用。

这背后有一个很现实的原因:模型能力在分化。GPT系列擅长通用推理,Claude系列在长文本上独树一帜,DeepSeek在中文场景性价比突出。指望一个模型解决所有问题,既不经济也不高效。

所以"多模型协同"成了今年开发者社区讨论频率最高的关键词之一。

但多模型并行有一个很现实的管理成本:每个平台单独注册、单独配置API、单独管理账单、单独排查故障。光是密钥管理就够头疼的了。

聚合平台的价值

这就是AI模型聚合平台存在的意义。

一个入口对接所有模型,一套API格式统一调用,一个后台看全部调用状态和费用明细。新模型上线了直接用,不用再去新平台走注册绑卡流程。某个服务出了问题,平台自动切换到备选方案,开发者几乎无感。

更实际的是成本优化。智能路由根据任务类型自动选择性价比最高的模型——简单补全用便宜的,复杂推理用贵的。比手动切换模型的效率高得多,对每天烧大量token的团队来说,这笔账算得过来。

2026年AI工具的碎片化只会更严重。模型越来越多,更新越来越快,版本分裂越来越频繁。单打独斗的模式已经扛不住了,聚合是不可逆的趋势。

最后说两句

Claude Code值不值得投入?值得,但不要all in。

把它放在你的工具箱里,作为处理复杂任务的主力。同时搭配一个更轻量、更便宜的工具来覆盖日常场景。然后通过聚合平台来统一管理,降低运维成本。

技术选型不是信仰问题。用对场景、控制成本、保持灵活,才是2026年AI编程最务实的策略。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/272345.html