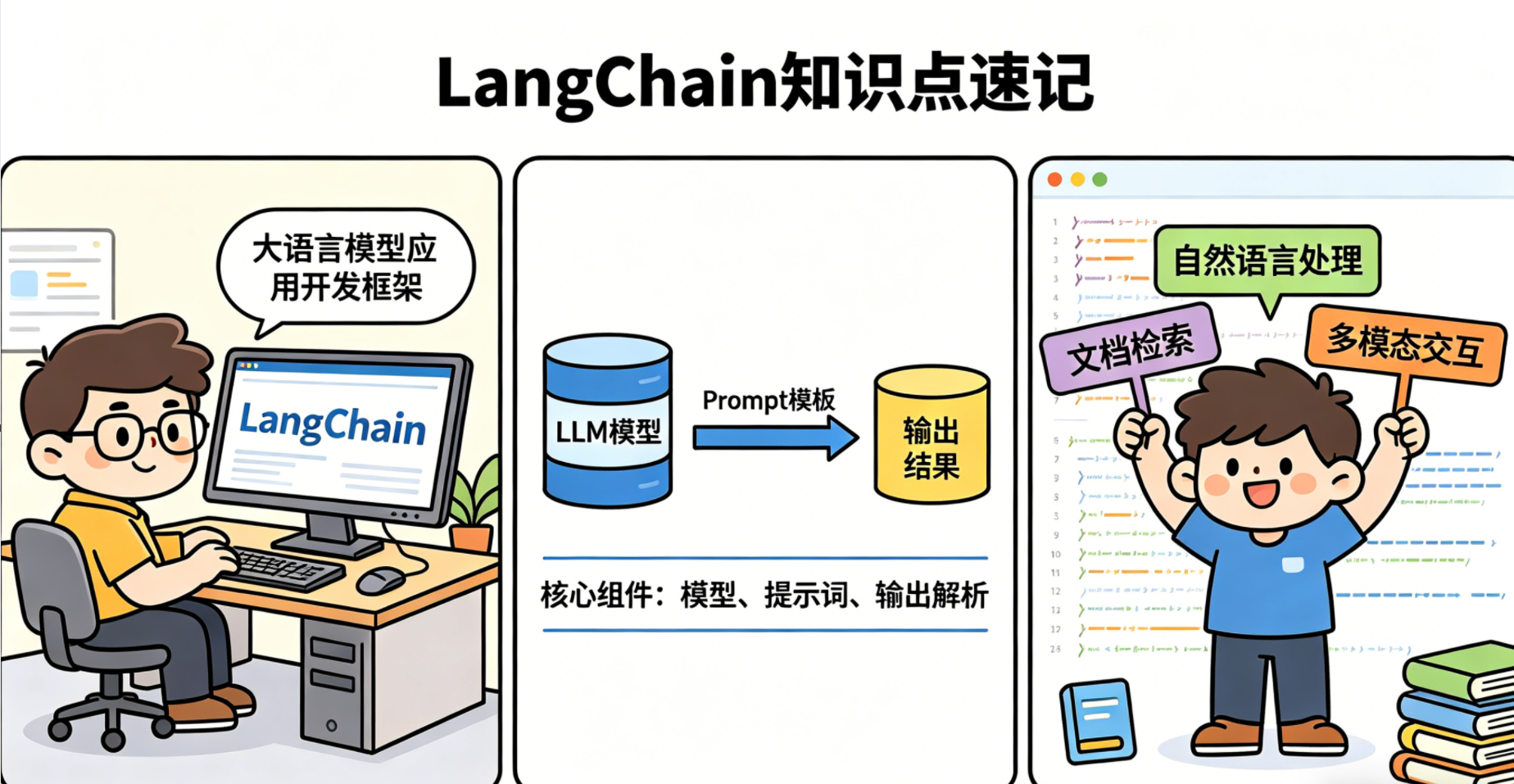

LangChain 是一个用于开发大语言模型 (LLM) 应用的开源编程框架,核心是通过模块化组件和流程编排,解决大模型 “只能聊天、不会做事、没有记忆、不懂数据” 的痛点,让 AI 连接现实世界。

关于LangChain、垂域大模型和智能体Agent这几个概念,它们不是独立的技术,而是构建企业级AI应用需要依次打通的三个环节。可以用一句话概括它们的关系:

LangChain是连接一切的“胶水”,垂域大模型是核心“大脑”,而Agent则是驱动“大脑”完成任务的“执行体系”。

🔗 一、LangChain:AI应用开发的“万能胶水”

LangChain并不是一个模型,而是一个开源框架,专门用来构建以大语言模型(LLM)为核心的应用程序。

一句话总结:LangChain = 大模型的工作流编排工具。

核心价值:它解决什么问题?

假如想让AI自动执行“读取文档 → 总结核心内容 → 翻译成英文 → 发送到邮箱”这个流程,直接调用大模型是无法完成的。LangChain的核心价值在于,它能将这些步骤串联成一个自动化的链(Chain),让大模型从单纯的“聊天机器人”变为可执行复杂任务的“决策中枢”。

核心概念速览

- Chain(链):将多个处理步骤串联起来的工作流。例如:搜索 → 总结 → 翻译。

- Agent(智能体):让模型自主决定调用哪些工具(Tools)以及执行的顺序。

- Tool(工具):Agent可以调用的外部能力,如搜索引擎、计算器、数据库等。

- Memory(记忆):为模型提供短期或长期的“记忆”能力,以维持对话的上下文连贯性。

- RAG(检索增强生成):从外部知识库检索相关信息,再让模型基于这些信息生成答案,能有效减少“幻觉”。

如何使用:一个最小化的示例

以下是一个使用LangChain读取本地文档并进行总结的代码示例:

from langchain.llms import OpenAI from langchain.chains.summarize import load_summarize_chain from langchain.document_loaders import TextLoader1. 初始化语言模型

llm = OpenAI(temperature=0)

2. 加载本地文档

loader = TextLoader(“report.txt”) documents = loader.load()

3. 构建总结链

chain = load_summarize_chain(llm, chain_type=“map_reduce”)

4. 执行并获取结果

summary = chain.run(documents) print(summary)

企业级实践与选型建议

LangChain在企业中的**实践正趋于模块化、容器化和可观测性,例如使用LCEL(LangChain表达式语言)构建管道,并用Docker和Kubernetes进行编排。对于多智能体系统(Multi-Agent System)的构建,有以下主流框架可供选择:

趋势预警:截至2025年,单Agent结合RAG仍是企业验证ROI的主流模式。多智能体系统建议从内部工具(如财报分析)等低风险场景开始试点。

🧠 二、垂域大模型:企业的“专属大脑”

企业自建垂域大模型的核心驱动力在于,通用模型在专业领域的知识和效率上都存在短板。

据Gartner预测,到2026年,75% 的企业将依赖领域大模型来优化其关键业务流程。

核心开发路径

目前主流的垂域模型开发路径并非从零训练,而是基于开源基座模型(如Llama、Qwen、DeepSeek等)进行二次开发。

- 检索增强生成(RAG):这是最快、成本最低的路径。不改变模型本身,而是通过外挂知识库,让模型在生成答案前先检索相关信息。此方案能快速落地,但无法让模型“学会”专业领域的推理逻辑。

- 微调(Fine-tuning):使用垂直领域的数据,对预训练模型进行进一步的参数更新。它能让模型“内化”行业知识,效果比RAG更深入。但此路线需要高质量的标注数据,且计算成本较高。

- 增量预训练:在大规模垂直领域语料上继续预训练。此路线能让模型“脱胎换骨”,成为真正的领域专家。但其成本极高,通常只有大厂或特定行业巨头才会选择。

实战:搭建本地企业智能引擎

一个常见的自建方案是使用 LangChain + vLLM + 国产模型(如Qwen)进行本地化部署,确保数据安全。

- 部署高性能推理引擎:使用vLLM部署本地模型服务,以获得高效的推理。

- 用LangChain连接模型:通过LangChain的

VLLMOpenAI接口,连接本地vLLM服务。 - 组装智能体:利用LangChain的

initialize_agent方法,为模型配备内部知识库检索、API调用等工具,构建一个功能强大的企业智能体。

🚀 三、智能体Agent:企业的“数字化员工”

如果说大模型是“大脑”,那么Agent就是让大脑能够感知环境、做出决策并执行行动的完整体系。

Agent核心架构:感知 → 规划 → 行动 → 记忆

Agent的核心架构通常包含四个模块:感知(接收用户指令和外部信息)、规划(将复杂任务分解为可执行的步骤序列)、行动(调用各种工具,如API、数据库、搜索引擎等)和记忆(存储历史交互信息,支持多轮对话和任务执行)。

企业级Agent的四种主流形态

根据2025年的市场观察,企业级Agent应用主要呈现四种形态。

- 形态一:技术编排流(如Dify等):以Dify为代表的开源框架,灵活性极高,能集成大量插件,适合拥有强力研发团队的企业。

- 形态二:模型生态流(如阿里百炼、百度千帆等):由云厂商提供,胜在通用性和易用性,能与办公软件无缝连接。适用于知识库问答、营销文案生成等场景。

- 形态三:独立极客流(“AI一人公司”):以小团队甚至个人开发者为主,优势是快和便宜,但存在架构和合规性风险。

- 形态四:企业自研流(深度定制):针对核心业务深度定制和集成的解决方案,优势是能完全自主可控,能无缝融入企业核心流程。

案例:Cisco的智能体平台

Cisco基于LangChain构建了一个多智能体(Multi-Agent)AI平台。该平台采用监督型架构,由一个“监督Agent”将复杂查询分解并路由给多个专业Agent协同处理。这个平台帮助Cisco在短短三周内将运营时间减少了20%,并实现了60% 的自动化案例处理率。

💎 总结

因此,企业正确的落地路径是:先用LangChain和RAG快速验证价值,再逐步深化垂域模型和Agent的应用。真正的竞争优势,来自于对自身业务的深刻理解、对高质量领域数据的掌控,以及将AI能力无缝融入核心业务流程的系统工程能力。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/265072.html