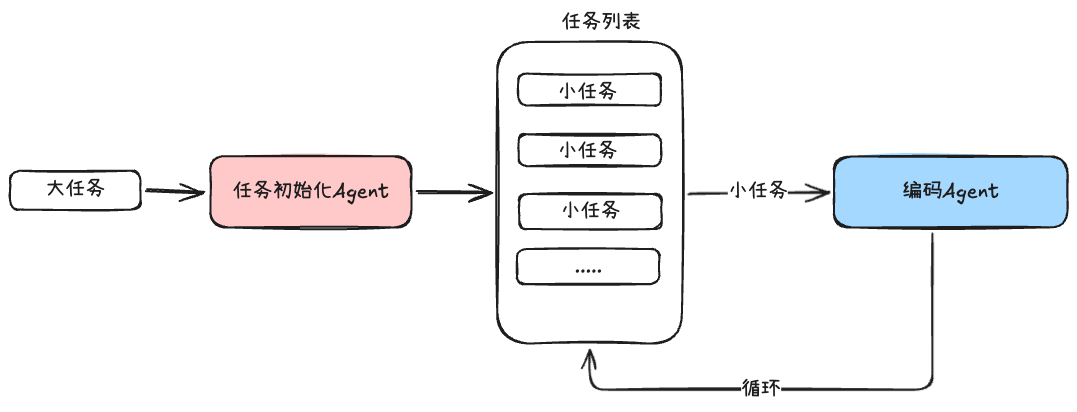

在构建能够支持编码智能体长时间运行框架的时候,Anthropic团队使用的是任务初始化Agent+编码智能体的简单的两层多智能体架构设计,随着运行时间的增加和任务的复杂度提升,出现了两种常见的故障模式:

- 随着上下文窗口逐渐填满,模型会失去连贯性,同时部分模型还会表现出“上下文焦虑”,尤其是Sonnet 4.5

- 在设计自我评估的模块时,当要求Agent评估自己生成的作品时,其往往会自信的给予高度赞扬,这很容易导致评估模块失效

对于第一个问题,Anthropic团队的解决方法是:上下文重置

完全清除上下文(不仅仅是依赖上下文压缩),并启动一个新的Agent,同时配合结构化的交接机制(该机制会传递前一个Agent的状态和后续步骤)

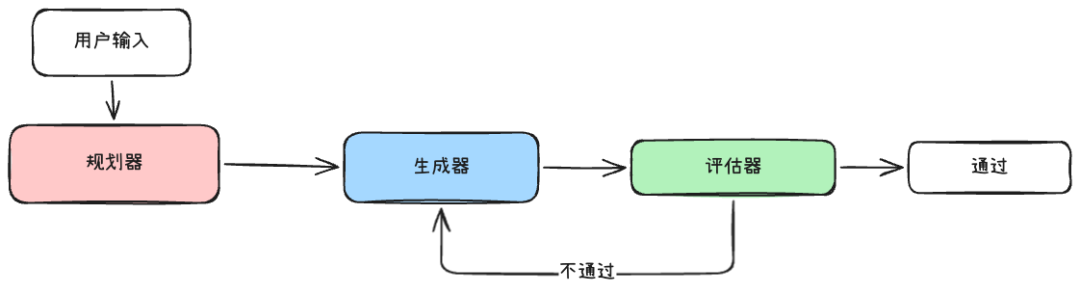

对于第二个问题,将评估任务使用的Agent与执行任务使用的Agent分开

也就是说不要在同一个Agent中即赋予任务执行,也赋予任务评估,虽然这种分离本身不能立即消除“评估宽容”

“评估宽容”:评估Agent依旧是一个LLM,它会倾向于对LLM的生成的输出给予较高的评价

这种分离的方式,是目前最有效的解决方法啦,至少可以有效降低评估与执行集中在同一Agent中所带来的失效风险

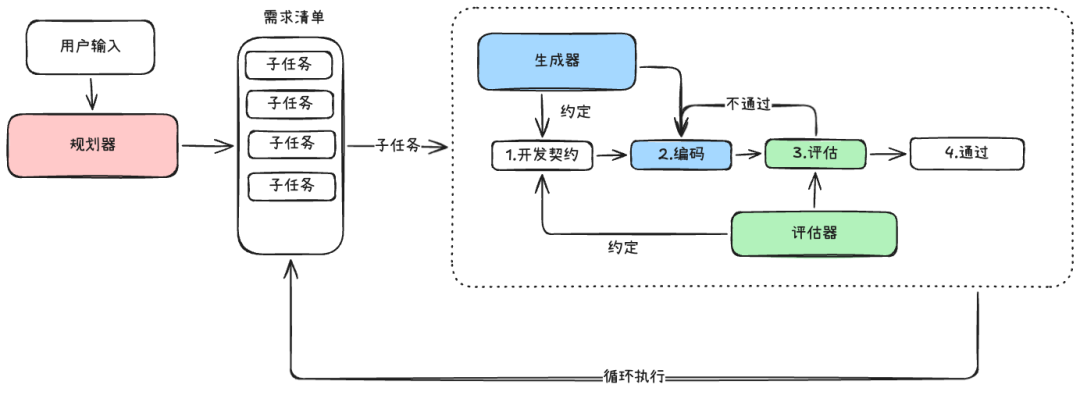

接下来,Anthropic团队在原有框架的基础上,再次进行了改进,构建了一个三种Agent的系统

- 规划器:它能够接收 1-4 句话的简单提示,并将其扩展为完整的产品规格说明。我要求它在范围方面设定得更远大一些,并专注于产品背景和高层技术设计,而不是具体的实现细节

- 生成器:以循环执行的方式工作,每次从需求清单中选取一个子任务执行

- 评估器:使用 Playwright MCP 模拟用户操作,逐个点击运行中的应用程序,测试 UI 功能、API 端点和数据库状态,并且基于一套标准进行评分

这套设计中有很核心的两点实践经验可以借鉴:

- • 在每次子任务执行前,生成器和评估器会一起协商一份开发契约:在编写任何代码之前,就这一部分工作的完成标准达成一致,之所以有开发契约是因为在规划器书写需求清单的时候,是有意写的比较概括的,Anthropic团队希望通过这一步来弥合用户需求和可测试之间的差距

- • Agent之间的通信使用文件来进行,一个Agent写入一个文件,另外一个Agent读取该文件,响应内容也可以写入该文件,通过文件的读取写入来进行通信

关于上面提到的评估器的标准的构建,Anthropic的方式也非常值得学习

团队要为前端的实现进行评估,大家知道美学是无法完全使用分数来衡量的,每个人的品味都不一样,一千个读者眼中就有一千个哈姆雷特

Anthropic给出的解决方案是:

我们可以通过编码设计原则和偏好的评分标准来提升设计水平。“这个设计美观吗?”很难给出一致的答案,但“它是否符合我们对优秀设计的原则?”则为 Claude 提供了一个具体的评分标准

也就是说,问题从“这个设计漂亮吗?”,变为了“这个设计符合我们的设计原则吗?”,举一个例子:

- • 问“这篇文章写得好吗?”,这个很难回答,因人而异

- • 问“这篇文章是否结构清晰、论据充分、语言流畅”,这种情况下就有了具体的评估标准

将“模糊的主观判断”变为“可操作的评分标准”

Anthropic团队关于前端设计标准分为四项

- 设计质量:设计是否感觉像是一个连贯的整体,而不是各个部分的简单堆砌?优秀的设计意味着色彩、字体、布局、图像和其他细节相互融合,共同营造出独特的氛围和风格

- 原创性:是否存在自定义决策的痕迹,还是仅仅使用了模板布局、库默认设置和人工智能生成的图案?一位优秀的设计师应该能够识别出精心设计的创意。未经修改的现成组件——或者像白色卡片上叠加紫色渐变这样的人工智能生成痕迹——都无法体现原创性

- 工艺:技术执行:排版层级、间距一致性、色彩和谐、对比度。这考察的是能力,而非创意。大多数合理的实现方式默认都能达标;失败则意味着基本功薄弱

- 功能性:可用性独立于美观性之外。用户能否理解界面功能,找到主要操作,并在不猜测的情况下完成任务?

对于Claude模型来说,其本身在工艺和功能性上面表现就非常出色,我们应该注重设计质量和原创性

Anthropic团队对于这个框架不断的进行迭代,最终的方案为:

因为模型的升级,最终方案使用的是Opus4.6,所以之前的设计方案有一些被移除啦

- 移除任务拆分的功能,不需要小任务多次循环执行,Opus4.6完全可以处理这种任务整体执行

- 移除了开发契约的功能,评估器直接看最终产物,不需要进行开发协商

总结:对于Harness的设计,不会是一成不变的,随着模型基础能力的提升,整个Harness是需要做删减和增加的。

一个Agent的优化,不仅是改变模型型号这么简单,而是一些相应的工具和模块会成为模型的阻碍点,是需要删除的,

当然对于Harness的组合设计空间并不会缩小,它会不断的扩展,而大模型应用开发工程师真正的乐趣或许在于不断寻找下一个新颖的组合

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/261367.html