自从AI智能体展现出在电脑上执行操作的能力以来,人们对其应用场景的想象不断拓展。例如,能否让AI智能体代替用户完成一些复杂的桌面软件操作任务?

然而,现有的一些智能体方案在操作图形用户界面时仍显笨拙。它们往往需要依赖特定的插件或技能库,执行复杂任务时不够流畅,这限制了其在严肃工作流程中的应用。

近期,明略科技发布了其全新进化的面向端侧设备的GUI-VLA智能体模型 1.0。该模型宣称能够不依赖传统的API接口,也不局限于浏览器环境,而是通过纯视觉方式直接理解并操作各类桌面软件和网页界面,旨在完成更复杂的图形化工作流。

简而言之,Mano-P 1.0被描述为一个纯视觉GUI操作模型,不依赖任何插件。其核心特点之一是支持完全本地运行,数据无需上传至云端。模型提供多种形态,声称可以覆盖不同的开发者需求。

- 项目开源地址:https://github.com/Mininglamp-AI/Mano-P/tree/main

据称,相比前代模型,Mano-P在能力上实现了显著提升。

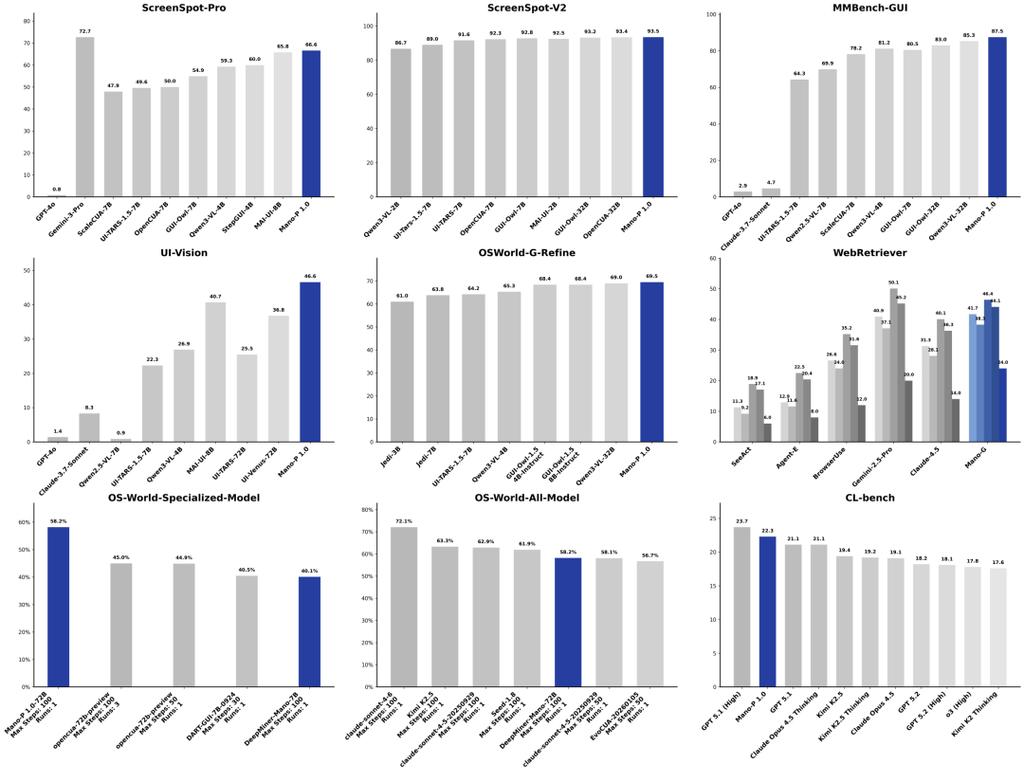

性能表现:在多基准测试中取得领先

根据发布的信息,Mano-P 1.0模型在多个多模态基准测试中达到了领先水平,覆盖了GUI定位、计算机使用评估、感知认知等多个维度。

在领域的权威基准测试OSWorld中,Mano-P 1.0-72B版本取得了58.2%的成功率,据称在所有专用GUI智能体模型中排名第一。信息显示,其领先第二名13.2个百分点。

报告还指出,在WebRetriever Protocol I测试中,Mano-P的得分超越了部分通用大模型的计算机使用版本。

在官方演示中,Mano-P完成了一套涉及视频生成、上传、分析、剪辑到二次评测的全流程自动化操作,过程中混合使用了网页和专业剪辑软件。

核心特点:强调本地化与隐私安全

当前许多计算机使用方案的基本流程是:截取屏幕信息,上传至云端服务器进行推理,再将操作指令返回本地执行。这意味着用户的屏幕数据需要离开本地设备。

Mano-P则采用了不同的路径,强调支持本地运行,数据完全不上传云端。它声称支持在配备Apple M4芯片和32GB内存的Mac设备上进行本地推理,所有任务数据均在设备内部处理。

性能方面,其4B量化模型在Apple M4 Pro芯片上,据称可实现较高的推理速度,峰值内存占用约为4.3GB。

这种设计旨在满足对数据安全、隐私保护有较高要求,或希望完全控制AI能力的应用场景。它通过本地化策略,将视觉理解与执行闭环于单一设备。

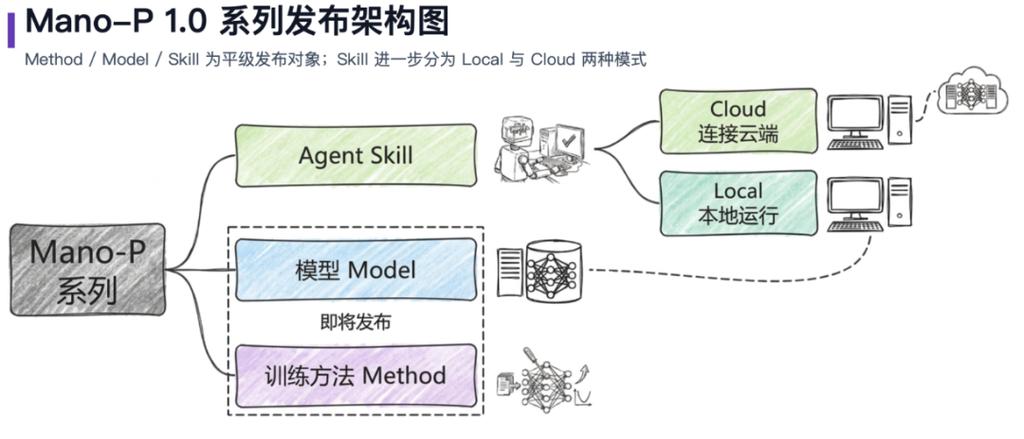

开源策略:分阶段释放能力

Mano-P采用全开源模式,并计划分三个阶段逐步释放其能力。

项目开源地址:https://github.com/Mininglamp-AI/Mano-P/tree/main

第一阶段的核心是“开箱即用”,目前已开源Mano-CUA Skill。此阶段主要面向智能体爱好者或开发者,目标是让他们能够利用该技能构建更智能的计算机使用任务工作流。

- mano-skill (Agent Skill 插件) —— 面向 Claude Code 和 OpenClaw 用户。安装后,当用户向 AI Agent 提出需要图形界面操作的需求时,Agent 可自主调用此技能完成任务,无需人工介入。这解决了当前 Agent 工作流中的一个关键痛点:涉及图形界面操作的环节通常需要人工干预,而 Mano-Skill 使该环节也能实现 AI 自主闭环。

- mano-client (Python SDK) —— 即将发布,面向需要在 Python 项目中深度集成图形界面自动化能力的开发者。支持异步调用、回调函数以及可编程的任务流控制。

三种形态共享同一套核心能力,为用户提供了从快速体验到深度集成,再到由 Agent 自主调度的不同入口。

在第二阶段,项目计划开源 Mano-CUA 的本地模型与 SDK 组件。

此阶段主要面向对安全性有高要求的开发者,使其能够直接使用可在 Mac 本地运行推理的 GUI-VLA 模型,以构建自定义技能或工具。关键在于,所有 CUA 操作均在本地 Mac 上执行,数据不会上传至外部服务器。

这是整个开源计划中的关键步骤。

- 72B 完整模型:旨在证明技术能力上限,即在 OSWorld 基准测试中取得 58.2% 成绩的模型。

- 4B 量化模型 (w4a16):专注于交付端侧体验,在 M4 Mac 上可实现 476 tokens/s 的预填充速度和 76 tokens/s 的解码速度,峰值内存占用仅为 4.3GB。

大模型证明了 Mano-P 模型的能力上限,小模型则专注于用户的端侧体验。两者互补,覆盖了从研究验证到生产落地的完整链路。

在最后阶段,团队计划开源训练方法本身,包括 Mano-P 模型所使用的训练方法、剪枝和量化技术。

Mano-Action 双向自增强学习框架是整个项目的核心技术基础。与传统单向预测方法不同,它采用 Text ↔ Action 循环一致性学习,使模型同时掌握两个方向的能力:

- Text → Action:根据自然语言描述,定位并操作界面元素。

- Action → Text:给定界面元素,准确描述其位置和功能。

双向互相增强使模型对图形界面的理解更加鲁棒。

训练过程分为三个递进阶段:

- SFT(监督微调):建立基础的图形界面理解与操作能力。

- 离线强化学习:在历史数据上进行策略优化,探索更优的操作序列。

- 在线强化学习:通过与真实环境的实时交互持续提升,实现自我进化。

配合“思考 – 行动 – 验证”循环推理机制,模型在每一步操作后都会验证结果,并在发现偏差时自动纠错调整。

在端侧优化方面,GSPruning 视觉 Token 剪枝是一项值得关注的技术创新。该方法通过保留全局空间锚点来维持网页结构骨架,同时识别语义异常值以捕获关键 UI 元素,在将视觉 Token 保留率压缩至 12.57% 的同时仍保持较高的任务成功率,使吞吐量提升 2-3 倍。

从 Skill 插件到模型,再到方法论,三步完成开源后,开发者将获得一套可从使用、定制到研发的完整技术栈。

Mano-P 整个项目采用 Apache 2.0 协议开源,完整客户端代码公开可审计,支持商业使用与二次开发。

目前市面上的图形界面自动化方案大致分为三类:

- 传统 RPA:基于坐标定位或元素选择器,界面变化即失效,维护成本高。

- 浏览器型 CUA:依赖 CDP,能力强但被限制在浏览器生态内。

- 云端 Computer Use:能力最强,但依赖云端 API,且主要面向 Web 场景。

Mano-P 与传统方案 CUA 对比

Mano-P 属于第四类——纯视觉 GUI Agent。其工作方式与人相似:观察屏幕、理解界面、然后决定输入,从而实现了无限制的跨平台通用性。总体而言,完全开源的 Mano-P 具备四大核心竞争力:

- 极致端侧性能:凭借对 M4 芯片的优化与算力扩展支持,Mano-P 支持模型本地开箱即用,彻底摆脱云端 API 束缚。

- 全场景视觉理解:采用纯视觉图形界面交互方案,打破浏览器局限,实现了跨桌面软件与复杂工具的全场景感知适配。

- 离线规划能力:依托完全离线的自主规划与纠错闭环,在无网络环境下也能确保业务逻辑的高效安全执行。

- 软硬一体方案:通过即插即用的模型硬件一体化部署,消除了复杂的底层环境配置,显著降低了 Agent 的落地门槛。

“Mano”一词来源于西班牙语,意为“手”,生动体现了模型在数字世界中作为“灵巧手”的核心能力。

为了解 Mano-P 模型中“P”的真正含义,我们与明略集团副总裁、多模态首席科学家赵晨旭老师进行了一次专访。

据明略科技官方解释,“Mano-P 这个科研项目里面最核心的一个概念——P 的含义代表的是 personal(个人)或者 party(组织)。”

Personalized AI 的开端

赵晨旭老师认为:“我们已经断定现在正处在两个时代的交界点上,可能好多人或者是一些开发者,或者是一些业内的人还没有意识到。是哪两个时代呢?就是 AGI 的时代和 Personalized AI 的时代。”

AGI 的叙事已深入人心:打造一个无所不能的通用智能体。赵晨旭老师解释了其中的逻辑:以 DeepSeek、GPT o1 为代表的路线,核心是基于事实性基础进行推理。对于有确定解或唯一解的问题,这种推理方式确实有效。但现实世界中,大部分问题恰恰是无解的或有多种解的。

“其实我们要找的是在这些解里面,对于个人或者对于某个组织、某个集体而言价值最大的那个解。”

每个组织和个人都有自己沉淀的经验和特有的偏好,依据这些“私有资产”进行推理,才能找到最优解。“所以我们区别于 AGI,我们管这个叫做 Personalized AI。”

若要具体说明何为 Personalized AI,文章开头展示的打麻将例子,正是其最生动的体现。

如果你用一个 AGI 模型帮你打麻将,因为它看过很多种麻将打法,它会实时判断并选择,无论哪一步它走的都是(它认为的)最优解,看上去特别像一个机器人。

但是如果你告诉它用“您的方式”去打这个麻将,AI 应该是按照您的习惯,您经常怎样胡牌、怎样记牌、怎样决定开杠或吃牌,然后用您的方式去打。这就是通用 AI 和 Personalized AI 的区别。

这个比喻似乎与当前热门话题——将同事、名人甚至前任的思维模式“蒸馏”成技能——在理念上有所呼应。当我们提出这个话题时,赵晨旭老师表示:“这其实就是你在打造你自己的 Personalized AI 的过程,只不过这些现在是以一种记忆或者文件的方式存储的,它并没有直接作用在 AI 的大脑里,没有给它形成参数化。但这已经是个性化 AI 的开始了。”

模型的技术历程

从操作浏览器到逐步实现 Personalized AI,其中的技术难度不言而喻。我们也请赵晨旭老师介绍了实现 Personalized AI 模型的三大技术突破。

去年首次在 Mind2Web 和 OSWorld 基准测试中取得领先成绩时,团队攻克的核心难题是在线强化学习。

“之前的那些强化学习的路径都是在一个虚拟的上下文里面去做强化……但是对于那种一步操作可能会直接影响整个周围的真实环境的这种情况,可能就不是那么合适了。”

团队引入在线强化学习后,模型能力显著提升,在 OSWorld 基准测试中取得专有模型第一名的成绩,并保持领先至今。

今年年初,团队探索出一种新的训练范式——双向强化学习。传统训练方式通常只建立自然语言到动作的单向映射,而新方法同时训练两个方向:自然语言→动作,以及动作→自然语言。两者相互促进,借鉴了视觉领域对抗生成网络的思想,取得了显著效果。

团队表示,仅使用一套训练集和一个模型,就在十个相关榜单上刷新了纪录,且未针对任何单一榜单进行专门优化或微调。

第三个突破聚焦于算力约束。为了让个性化 AI 真正部署到个人设备,模型必须在有限算力下完成推理乃至训练。团队采用视觉剪枝技术处理高分辨率屏幕截图:将图像序列化为 token 后,识别并剔除任务无关的冗余 token(例如界面中的留白区域),从而大幅降低计算量。这使得模型能够直接在 Mac 等终端设备上独立运行。

关于模型成功的评判标准,团队认为正在从榜单排名向实际应用效果迁移。当前更重要的目标是让模型被更多人实际使用。这也推动了其开源策略——只有开源,用户才能在本地针对自身场景进行优化,实现个性化 AI 的愿景。

团队构想了一个典型应用场景:通过 GUI 智能体替代人工进行软件测试。例如,在代码生成工具完成应用构建后,模型可依据产品需求文档自动访问网站、执行测试、检查错误或 bug,从而消除人工测试环节的瓶颈,实现“开发-测试-反馈-修复”的全程自动化循环。

基于这一构想,系统可实现全自动应用构建:用户输入自然语言需求,系统自动完成需求澄清、技术架构设计、代码生成、本地部署、API 测试、页面视觉检测与端到端 GUI 自动化测试。若测试失败,系统会自动定位问题、修复代码并重新验证,直至全部通过,全程无需人工干预。

从通用人工智能到个性化 AI,从追求普适能力到赋能个体需求,人工智能的发展方向正在发生演变。团队相信,个体与组织未来都能创造并拥有属于自己的个性化 AI。

关注“鲸栖”小程序,掌握最新AI资讯

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/260428.html