2026 年 4 月 10 日,OpenClaw 创始人 Peter Steinberger 在 X 上发文称,未来要让 OpenClaw 持续兼容 Anthropic 模型,“会变得更难”。

他同时贴出一封来自 Claude 的邮件截图。

邮件显示,Anthropic 以账户出现“可疑信号”、涉嫌违反使用政策为由,撤销了相关账号对 Claude 的访问权限。

邮件内容翻译如下:

你好,

针对与该账户相关的可疑信号进行内部调查后,我们认定该账户违反了使用政策。

因此,Claude 的访问权限已被撤销。

如需对这一决定提出申诉,请填写这份表单,或在这里进一步了解申诉流程。

此致

Anthropic 安全防护团队

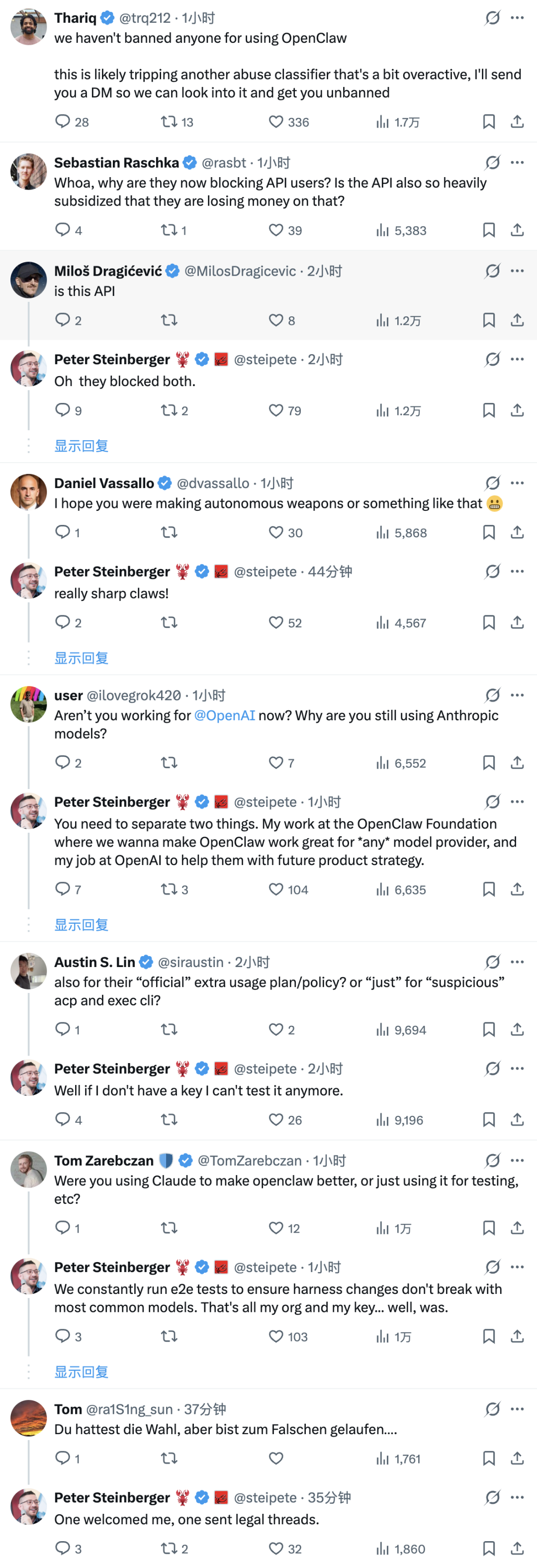

该帖迅速在 X 上发酵,也让外界再次把目光投向 Anthropic 与 OpenClaw 之间不断升温的摩擦。

帖子下回复呈现一边倒的批评:

1)多位开发者指出:“想象一下把生意建立在 Anthropic 模型上。”“Anthropic 想让开发者在其平台构建,却保留随时零解释封禁的权利。”

2)有人直言这是“经典 Anthropic 操作”,并称“OpenClaw + 本地 LLM 已成为唯一理智路径”“开源模型正在吃掉他们的午餐”。

3)部分用户提到自身遭遇类似封禁:“我只是用脚本跑 Claude -p 就被封了,申诉 10 天无回应。”

4)还有人讽刺:“Anthropic 正在上演 80-90 年代微软剧本,筑起壁垒却不回馈生态。”

5)多名开发者强调,此事凸显依赖封闭 AI API 的风险,呼吁加速转向开源模型和本地部署,以避免类似“突然断供”。

不过,事件并没有朝着“Anthropic 直接封杀 OpenClaw”的方向被坐实。

Anthropic 公开否认“因 OpenClaw 封号”,但 Peter 的账号和 key 确实被停了,这说明双方矛盾的重点已经不是能不能接入,而是第三方 agent 工具还能不能稳定、低风险地继续接入。

根据同一讨论串中展示的回复,Anthropic 员工 Thariq 表示,公司“没有因为使用 OpenClaw 而封禁任何人”,并称这更可能是另一个滥用识别分类器“有些过度积极”后造成的误判,后续会通过私信进一步核查。

至少从公开口径看,Anthropic 尚未把“使用 OpenClaw”本身直接定性为违规行为,但相关自动化调用模式显然已经进入平台风控的高敏感区。

这场争议的背景是,Anthropic 几天前刚刚对第三方工具调用 Claude 的方式进行了实质性收紧。自 4 月 4 日起,Claude 订阅额度将不再覆盖包括 OpenClaw 在内的第三方工具调用。继续使用这类工具的用户,要么改为购买折扣版的额外 usage bundles,要么转向使用 Claude API key。

Anthropic Claude Code 负责人 Boris Cherny 给出的解释是,第三方工具的使用模式并不是订阅产品最初设计要承载的场景,而平台需要优先保障自家产品和 API 用户的容量需求。

Business Insider 进一步援引 Anthropic 方面说法称,用户用 Claude 订阅去驱动第三方工具,本身就违反服务条款,而且这类工具给系统带来了“过大的压力”。

Peter Steinberger 则表示,很多用户原本就是为了 OpenClaw 才订阅 Claude,如果 Anthropic 切断这一路径,对双方都会是损失。他还称,自己和 OpenClaw 基金会董事 Dave Morin 曾尝试与 Anthropic 沟通,最终也只是把政策落地时间推迟了一周。

从表面看,这是一场账号封禁争议;但从更深层次看,这反映的是 agent 平台与模型厂商之间的结构性矛盾正在加剧。

OpenClaw 这类产品的核心价值,本来就是高频、多轮、持续自动化地调用大模型,帮助用户处理邮箱、日程、航班值机等复杂任务。

可在模型平台看来,这种用法既更吃算力,也更容易触发风控与滥用检测,还可能绕开官方产品路径,冲击既有的计费和容量管理体系。

OpenClaw 面临的难题,已经不只是“技术上能不能接 Claude”,而是“在 Anthropic 持续收紧边界后,还能不能稳定、合规、低成本地接入 Claude”。

云头条声明:如以上内容有误或侵犯到你公司、机构、单位或个人权益,请联系我们说明理由,我们会配合,无条件删除处理。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/256879.html