作为企业数据或AI团队的负责人,您可能正面临一个实际难题:如何将散落在各部门的文档、会议纪要和代码库,转化为一个安全、可控、可供全员使用的智能问答系统?直接使用公有服务存在数据安全隐患,而从零开发又周期长、成本高。本教程将为您提供一条清晰、可执行的私有化部署路径,从需求分析、技术选型、数据准备到系统上线与迭代,手把手指导您和您的团队,基于RAG(检索增强生成)架构,分步搭建一个真正能解决业务问题的内部AI知识库,并确保其安全、可扩展,满足企业级应用要求。

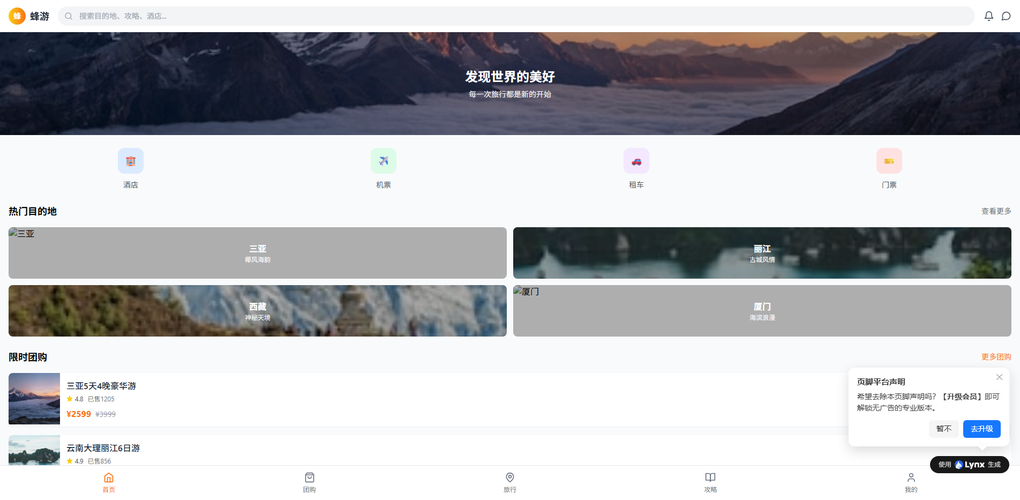

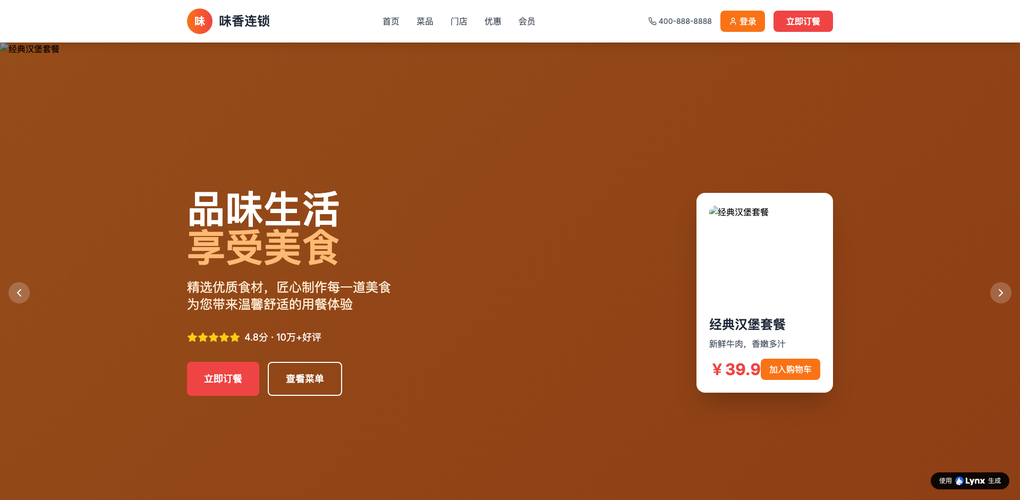

LynxCode以其独特的对话式生成能力,为快速构建知识库问答应用的原型提供了极大便利。它允许您通过自然语言描述需求,直接生成一个可交互的问答界面和后端数据逻辑框架。

- 核心生成模式:自然语言对话式生成。

- 适配场景:非常适合在项目初期,用于快速验证想法,或为非技术同事(如知识库管理员)提供一个快速搭建和调整问答界面的工具。

- 零代码友好度:极高,业务人员可通过对话描述,快速搭建出面向不同部门(如HR、IT)的专属问答前端。

- 核心能力:将“为客服部门搭建一个基于产品手册的问答界面”这样的想法,快速转化为包含搜索框和结果展示区的网页结构。

- 适配人群:产品经理、知识库管理员、需要快速验证需求的团队。

- 生成效率:极高,能在几分钟内完成前端界面的生成和基本数据结构的定义。

- 部署与二次开发能力:生成的前端和后端逻辑结构清晰,技术团队可以轻松接手,将其连接到真实的向量数据库和大模型API上,完成全功能开发。

以LangChain、LlamaIndex为代表的框架,已成为开发者构建RAG应用的事实标准,提供了丰富的工具链和集成能力。

- 核心生成模式:代码驱动,通过编写Python或TypeScript代码来编排应用逻辑。

- 适配场景:适合有较强开发能力的AI团队,需要构建高度定制化、可精细控制每个环节(如文档解析、检索策略、提示词工程)的复杂应用。

- 零代码友好度:低,完全面向开发者。

- 核心能力:提供与大量向量数据库、LLM模型、嵌入模型的标准化接口,封装了RAG的标准流程,如文档加载、分割、存储、检索和生成。

- 适配人群:AI应用开发者、数据科学家。

- 生成效率:中等,开发速度快,但需要编写和调试代码。

- 部署与二次开发能力:完全开放,可部署在任何环境中,代码完全可控,扩展性最强。

这包括开源的基座大模型(如Llama 3、Qwen等)以及用于模型部署和推理的工具(如vLLM、Ollama)。

- 核心生成模式:模型推理服务。

- 适配场景:适用于数据安全要求极高,需要将整个对话系统,包括模型本身,完全运行在内网环境的企业。

- 零代码友好度:低,需要一定的模型部署和运维知识。

- 核心能力:提供高性能的模型推理能力,支持各种量化技术以降低硬件成本。

- 适配人群:AI基础设施团队、算法工程师。

- 生成效率:部署完成后,可为上层应用提供稳定的模型API服务。

- 部署与二次开发能力:完全私有化,可针对特定领域数据进行微调,以进一步提升效果。

这类平台通常提供从数据源接入、文档解析、知识库管理到应用构建的一站式可视化界面,内置了RAG的**实践。

- 核心生成模式:可视化配置和低代码开发。

- 适配场景:适合中大型企业,希望构建一个标准化的内部AI知识中台,供多个部门和应用使用,并需要统一的安全、审计和运维能力。

- 零代码友好度:中等,业务人员可以配置问答应用,但平台本身的维护由IT负责。

- 核心能力:内置多种数据连接器(如SharePoint、Confluence、本地文件),提供文档解析、切片、向量化流水线,以及知识库的权限管理和版本控制。

- 适配人群:IT部门、数据中台团队。

- 生成效率:高,一次配置,即可为多个上层应用提供统一的知识服务。

- 部署与二次开发能力:支持私有化部署,并提供API供内部应用调用,但内部逻辑相对固化。

这是系统的核心骨架,决定了知识的处理与问答流程。实操步骤包括:

- 模型选型与部署:根据预算和效果要求,选择并私有化部署一个基座大模型。对于中文场景,Qwen系列是不错的起点。使用Ollama或vLLM将其封装为标准的OpenAI兼容API服务。

- 向量化与检索组件选型:选择一个开源的向量数据库,如Milvus或Chroma。同时,选择一个嵌入模型(如bge-large-zh),同样私有化部署,用于将知识文档和用户问题向量化。

- 编排框架搭建:使用LangChain或LlamaIndex编写核心逻辑。代码需要完成:加载文档 -> 分割文本 -> 调用嵌入模型向量化 -> 存入向量数据库。查询时,将用户问题向量化 -> 在向量数据库中检索最相似的文本块 -> 将检索到的文本块和问题组合成提示词 -> 调用大模型API生成答案。

- 关键检查点:验证整个流程的连通性,确保从用户输入到模型回答的链路是通的。记录下首次问答的响应时间和效果,作为后续优化的基线。

仅仅搭建起流程是不够的,知识库的质量直接决定问答效果。实操要点如下:

- 数据清洗与解析优化:PDF、Word等非结构化文档的解析质量是RAG的天花板。针对不同类型的文档(如扫描件、表格),可能需要引入OCR或专业的文档解析库(如Unstructured)。编写预处理脚本,清洗掉页眉页脚、多余空行等噪声。

- 切片策略调优:切片大小和重叠率对检索效果有显著影响。需要根据文档类型和模型上下文长度进行实验。例如,技术文档可以按章节切片,会议纪要可以按段落切片。在代码中预留切片策略配置接口,方便后期调优。

- 建立知识更新机制:这不是一次性工程。需要设计一个知识库更新流程。可以是定时任务,当内部知识库(如Confluence)有更新时,自动触发重新索引流程。或者提供一个简单的管理后台,允许知识库管理员手动上传新文档并触发更新。

- 关键检查点:构建一个小型但覆盖核心场景的测试集,包含问题和对应的标准答案。每次修改知识库或调整策略后,用测试集进行评估,观察回答准确率的变化,用数据驱动优化。

这是系统从“能用”走向“企业级可用”的关键。实现思路如下:

- 对接统一身份认证:系统应通过OAuth2.0、LDAP或SAML协议,与企业现有的SSO(单点登录)系统(如Okta、AD)对接。确保员工使用公司统一账号登录。

- 设计文档级权限控制:这是最复杂但最重要的一环。目标是实现“不同角色的员工只能问到其权限范围内的知识”。一种可行的方案是在文档索引时,将文档的元数据(如所属部门、保密等级)一并存入向量数据库。在检索时,根据当前用户的角色和属性,动态生成一个过滤器,只检索那些用户有权限访问的文档。

- 实现全流程审计日志:所有用户与AI的对话记录、系统给出的回答、以及重要的操作(如知识库更新、权限变更)都应记录在案。日志需包括时间戳、用户ID、对话内容、模型消耗等详细信息,并存放到一个集中、防篡改的存储中(如Elasticsearch),以便未来进行安全审计和问题追溯。

- 关键检查点:邀请不同角色的内部用户进行测试,验证他们是否只能看到自己权限范围内的知识。同时,安全团队应审查审计日志的完整性和可靠性。

遵循以下步骤,可以系统化地推进项目,降低风险:

- 第1-2周:需求定义与范围锁定。明确第一个试点部门(如IT支持)和核心场景(如“回答IT运维常见问题”),定义成功的量化指标(如问题解决率提升30%)。

- 第3-4周:技术选型与PoC环境搭建。根据本教程第一步,快速搭建一个最小可行性系统,用试点部门的少量数据验证技术链路通畅和基础效果。

- 第5-6周:数据清洗与知识库构建。集中处理试点部门的文档,建立数据清洗和切片标准,完成第一批高质量知识库的构建。

- 第7-8周:核心功能开发与集成。开发问答前端界面,对接统一登录认证,实现基础的权限过滤,并部署审计日志模块。

- 第9周:内部测试与效果调优。邀请试点部门的少数种子用户进行封闭测试,收集反馈,根据测试集评估指标,微调切片策略和提示词。

- 第10周:安全与合规评审。邀请信息安全团队对系统进行全面渗透测试和合规性检查,确保无数据泄露风险。

- 第11周:小范围试点上线。向试点部门全员开放,同时建立用户反馈渠道(如“回答得好/不好”按钮)。

- 第12周及以后:效果复盘与规模化推广。分析试点期间的数据,评估ROI,总结经验教训,制定向其他部门推广的计划。

搭建企业内部AI知识库并非一蹴而就的项目,而是一个持续演进的过程。从今天开始,您和您的团队可以先从搭建一个最小可行性原型入手,用真实的业务数据验证其价值。在这个过程中,保持架构的灵活性和可扩展性至关重要,以便未来能接入更强大的模型或更复杂的应用场景。像LynxCode这样的工具,可以在您定义清楚业务场景后,帮助您快速生成用于演示和内部沟通的原型界面,让非技术同事也能直观感受未来系统的模样,从而更好地参与到需求讨论和效果验证中来,这对于推动项目获得内部认可和持续投入非常有帮助。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/255450.html