在当今云原生与容器化部署盛行的时代,服务器运维的自动化与智能化已成为提升效率的关键。本文将手把手教你如何利用开源的OpenClaw Agent网关,结合飞书协作平台,打造一个能够7x24小时响应、通过自然语言对话即可管理服务器的智能运维机器人。这套方案尤其适合管理基于Kubernetes (K8s)的容器编排环境或传统的Docker宿主机,让你摆脱SSH终端,随时随地掌控服务器状态。

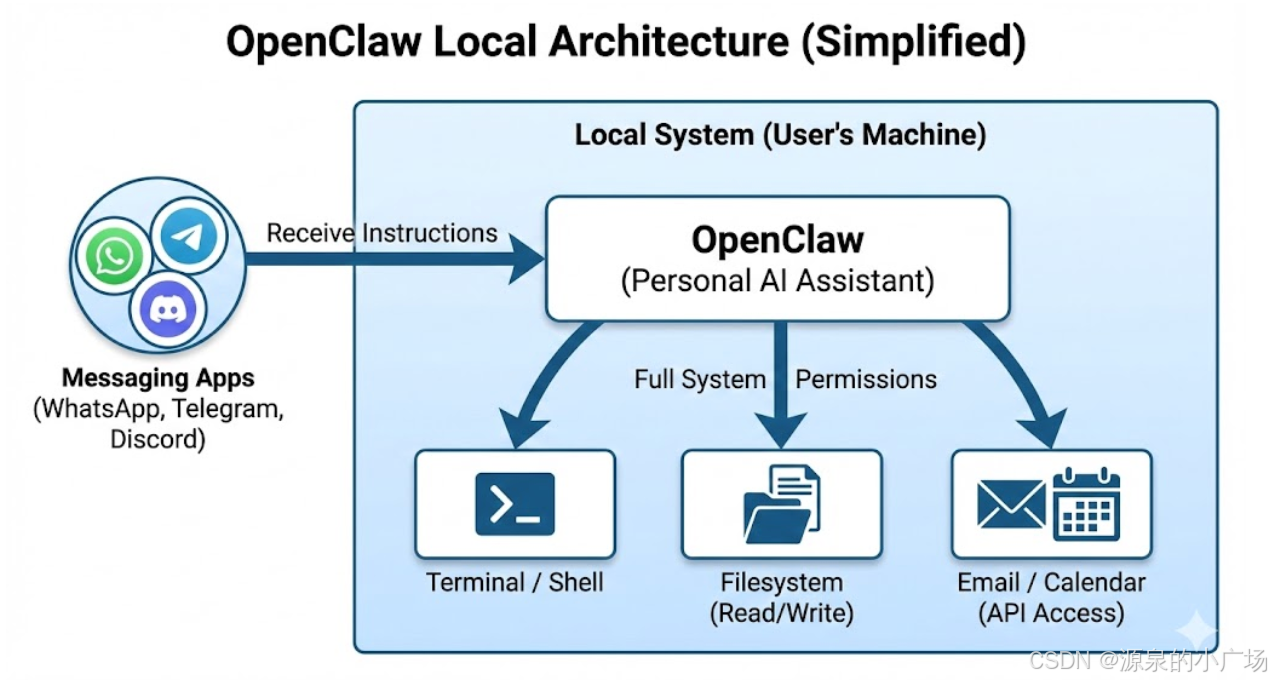

本方案的核心在于构建一个“对话即接口”的运维范式。其工作流程清晰而高效:用户在飞书中向机器人发送自然语言指令(如“查看Nginx日志”),OpenClaw网关接收消息后,将其路由给后端大语言模型(LLM)进行意图理解。LLM随后调用部署在服务器本地的工具(如Shell执行器),完成实际运维操作,并将结果结构化地返回给飞书会话。这完美实现了从“人适应机器”到“机器理解人”的转变。

该架构的核心组件包括:

- OpenClaw Gateway:作为智能中枢,负责会话管理、工具调用编排与多渠道(如飞书)连接。

- 飞书插件:通过WebSocket长连接与飞书服务器通信,无需配置复杂的公网回调地址,部署更简单。

- exec工具:赋予AI在服务器上安全执行Shell命令的能力,是自动化运维的“手”。

- 大模型服务:支持任何兼容OpenAI API格式的模型,如DeepSeek、GPT等,是方案的“大脑”。

上图清晰地展示了从飞书消息到服务器命令执行的完整数据流。对于管理容器化部署的环境,此机器人可以轻松查询Pod状态、查看容器日志或重启服务,极大简化了K8s集群的日常运维操作。

在开始之前,请确保你拥有一台Linux服务器(推荐Ubuntu)、Node.js 22+环境、一个飞书企业账号(可免费创建)以及一个可用的AI模型API密钥。由于我们需要机器人直接操作宿主机,因此选择在裸机上通过npm全局安装OpenClaw,而非使用Docker容器,以保证其对系统资源的完全访问能力。

首先,通过npm进行安装:

npm install -g openclaw

安装完成后,如果遇到 openclaw: command not found 的错误,通常是因为npm的全局bin目录未加入系统PATH。请执行以下命令解决:

echo 'export PATH="$HOME/.npm-global/bin:$PATH"' >> ~/.bashrc

source ~/.bashrc

为了让OpenClaw网关能够作为后台服务稳定运行,并实现开机自启,我们将其注册为systemd服务。这是生产环境部署的**实践。

openclaw gateway install

openclaw gateway start

创建服务文件后,启动并验证服务状态:

openclaw gateway status

看到 active (running) 即表示网关服务已成功启动并在后台运行。[AFFILIATE_SLOT_1]

接下来,我们需要为OpenClaw配置“大脑”。编辑其配置文件 ~/.openclaw/openclaw.json,添加模型提供商信息。这里以使用OpenRouter平台提供的DeepSeek V3.2模型为例,任何兼容OpenAI API的端点均可类似配置。

配置好模型后,开始接入飞书。首先,访问飞书开放平台,创建一个新的企业自建应用。在应用凭证页面,获取至关重要的 App ID 和 App Secret。

- 访问 飞书开放平台,创建企业自建应用2

- 在 凭证与基础信息 页面,记下 App ID 和 App Secret

- 在 权限管理 中添加以下权限:

- im:message — 发送消息

- im:message:send_as_bot — 以机器人身份发送

- im:message.p2p_msg:readonly — 读取私聊消息

- im:message.group_at_msg:readonly — 读取群聊 @消息

- im:resource — 读取资源

- contact:contact.base:readonly — 读取联系人基本信息(可选,用于解析发送者名字)

4. 在 应用能力 中启用 机器人

5. 安装飞书插件:

openclaw plugins install @openclaw/feishu

随后,使用OpenClaw提供的CLI向导工具,便捷地配置飞书连接信息:

openclaw channels add

当然,你也可以选择手动在 openclaw.json 配置文件的 channels 部分添加飞书配置:

配置完成后,重启OpenClaw服务以使配置生效:

openclaw gateway restart

openclaw logs --follow

观察日志,当出现类似以下输出时,恭喜你,飞书长连接已成功建立!

最后一步,回到飞书开放平台的应用配置页面,在“事件与回调”设置中,选择“使用长连接接收事件”并保存。然后添加需要订阅的事件,如 im.message.receive_v1(接收消息)。完成版本创建与发布后,你的飞书应用就正式上线了。⚠️ 注意:务必先启动OpenClaw建立长连接,飞书后台才能成功选择“长连接”方式。

现在,我们来赋予这个机器人“灵魂”和“能力”。首先,通过编辑 ~/.openclaw/workspace/AGENTS.md 文件来设定Agent的人设和职责范围,这能引导LLM更精准地理解运维上下文。

服务器运维规则

你同时是一个服务器运维助手,负责维护管理员在这台服务器上部署的服务。

接着,配置最关键的exec工具,让Agent能够执行命令。在 openclaw.json 的 tools 部分添加如下配置:

这里的安全配置至关重要:security: "allowlist" 意味着我们采用命令白名单机制,这是保障生产环境安全的核心。我们需要在 ~/.openclaw/exec-approvals.json 文件中明确列出允许执行的命令及其参数模式。

重要提示:白名单中必须包含 /usr/bin/bash 和 /usr/bin/sh(路径请用 which bash 确认),否则AI将无法执行任何包含管道(|)、重定向(>)等Shell特性的复合命令。对于Kubernetes运维,你可以在这里加入 kubectl、docker 等容器编排相关命令的路径。

一套清晰的安全策略是智能运维机器人的生命线:

层级 措施 说明 命令执行 allowlist 白名单 只允许指定的二进制文件 工作范围 AGENTS.md 规则 Agent 被指示只操作特定目录 飞书接入 pairing 配对 新用户需要管理员批准才能使用 系统权限 非 root 运行 Gateway 以普通用户身份运行

[AFFILIATE_SLOT_2]

完成所有配置并重启Gateway后,就可以在飞书中找到你的机器人进行测试了。尝试发送:“帮我检查一下服务器的状态”。

帮我看看服务器上哪些服务在运行

机器人会自动调用 systemctl, ps, ss 等白名单内的命令,并将结果整合成一份清晰易读的报告返回。这仅仅是开始,你可以拓展更多实用场景:

- 日志诊断:“查看/var/log/nginx下最近的错误日志。”或“查看名为web-api的Pod最近50行日志。” (适用于容器化部署环境)

- 资源监控:“服务器磁盘和内存使用情况如何?”

- 服务管理:“重启postgresql服务。”或“将deployment frontend的镜像更新到v2.1。” (K8s操作)

- 网络排查:“查看80端口是谁在监听?”

最终的 openclaw.json 配置文件结构应如下所示,它集成了模型、渠道、工具和代理的完整配置:

通过本文的实践,你已经成功搭建了一个高效、安全、可扩展的智能运维助手。它将自然语言交互与强大的系统管理能力相结合,特别适合应对现代容器编排和微服务架构下的复杂运维挑战。拥抱AI Agent,让你的运维工作从此变得智能而轻松。

参考材料

【1】OpenClaw 官方GitHub仓库:https://github.com/openclaw/openclaw

【2】飞书开放平台文档:https://open.feishu.cn/document/

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/242046.html