OpenClaw 安全風險頻發是許多 AI 開發者和普通用戶正在面對的問題。本文將介紹 OpenClaw 的 5 大核心安全風險以及 3 個平臺的完整卸載方案,幫助你快速識別風險並徹底清除 OpenClaw。

核心價值: 讀完本文,你將瞭解 OpenClaw 的全部安全隱患,掌握在 macOS、Windows、Linux 上徹底卸載 OpenClaw 的完整步驟,包括很多人忽略的 OAuth 令牌撤銷環節。

在討論 OpenClaw 風險之前,先快速瞭解這個工具的背景。

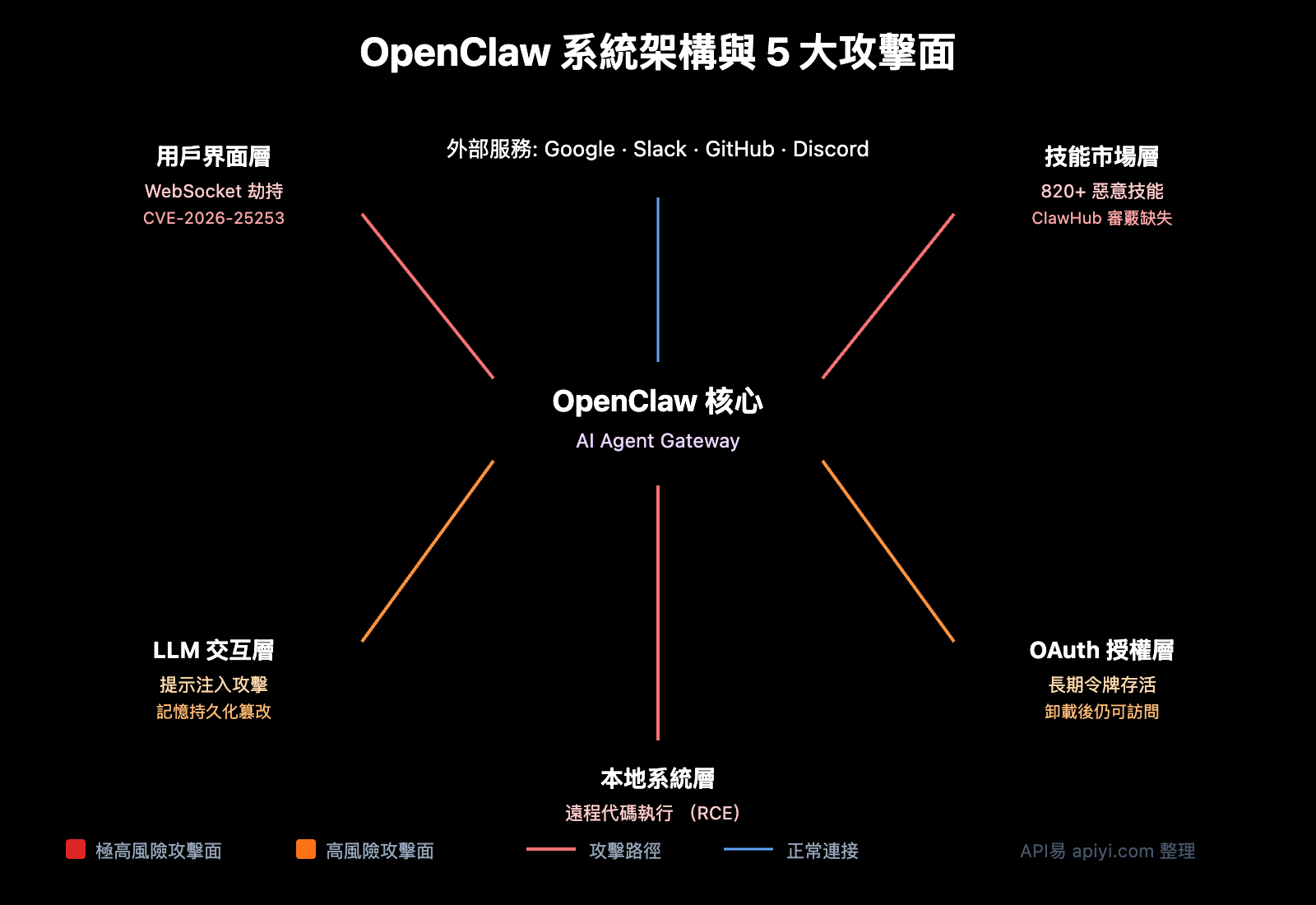

OpenClaw(原名 Clawdbot、Moltbot)是由奧地利開發者 Peter Steinberger 創建的開源自主 AI Agent 工具。它的核心功能是通過消息平臺(如 Telegram、Discord、WhatsApp)作爲用戶界面,讓 AI 大模型自主執行各類任務。

OpenClaw 可以自動分揀郵件、起草回覆、管理日曆、執行 Shell 命令、操作文件系統、進行網頁自動化等。它通過超過 100 個預配置的 AgentSkills 擴展能力,連接 Google、Slack、Discord、GitHub 等服務。

聽起來很方便,但正是這種「無所不能」的設計,帶來了嚴重的安全隱患。

🎯 安全提示: 在使用任何 AI Agent 工具前,建議先評估安全風險。如果你需要安全可靠的 AI 大模型 API 調用服務,推薦通過 API易 apiyi.com 平臺接入,該平臺提供受控的 API 接口環境,無需擔心本地 Agent 的安全隱患。

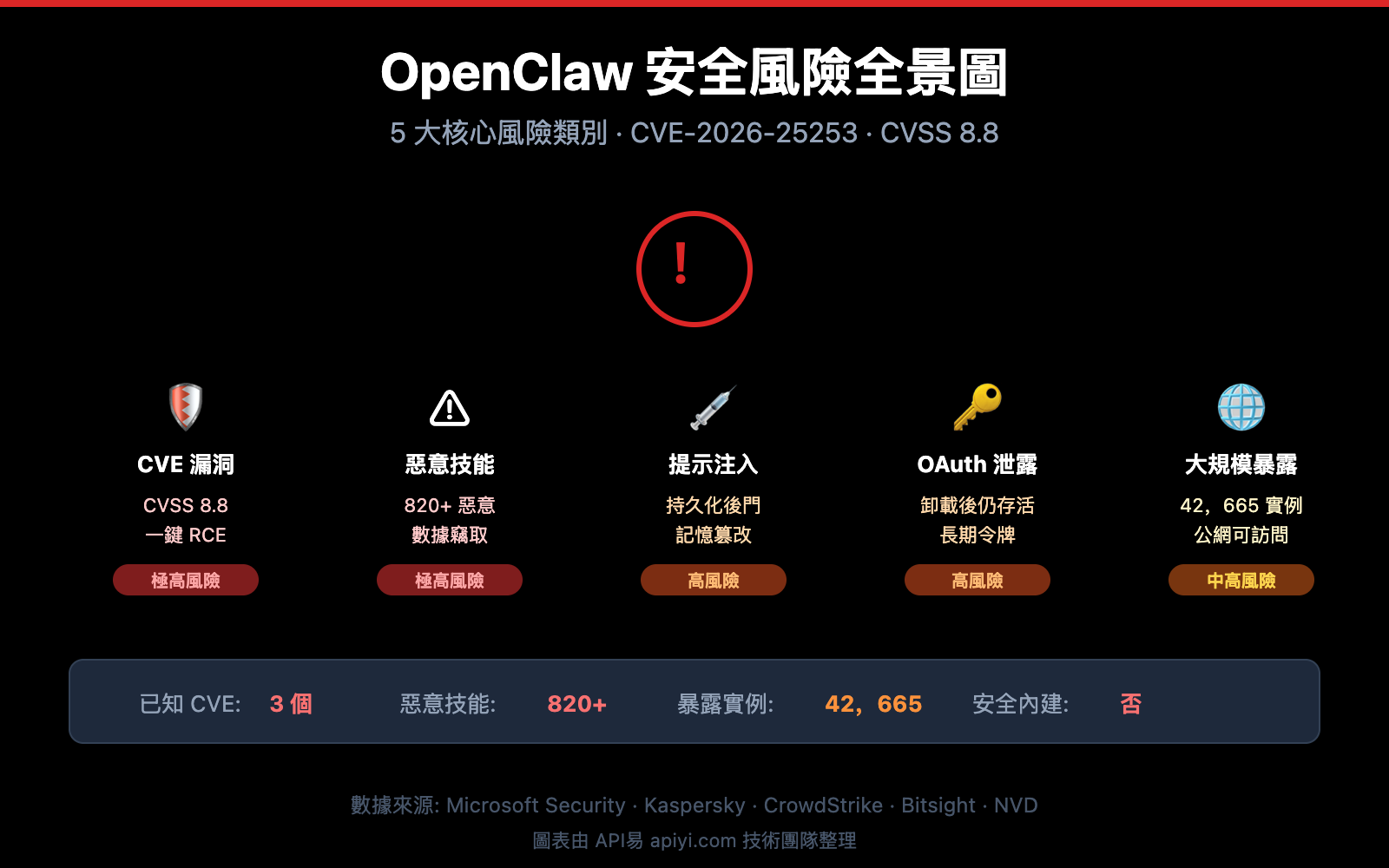

根據微軟、卡巴斯基、CrowdStrike 等多家安全機構的分析報告,OpenClaw 目前存在以下 5 大核心安全風險。

OpenClaw 已被披露多個高危 CVE 漏洞,其中最嚴重的是 CVE-2026-25253。

CVE-2026-25253 攻擊原理:

- OpenClaw 的控制界面信任來自 URL 查詢字符串的 ,並在加載時自動連接

- 服務器不驗證 WebSocket Origin 頭,接受來自任何網站的請求

- 攻擊者製作惡意鏈接,用戶點擊後,認證令牌被髮送到攻擊者服務器

- 攻擊者獲得操作級網關訪問權限,可以修改沙箱配置、執行任意代碼

即使是隻綁定到 localhost 的實例也會受到影響。攻擊者只需要你點擊一個鏈接或訪問一個惡意網頁,就能完全控制你的 OpenClaw 網關。

OpenClaw 的技能市場 ClawHub 存在嚴重的安全審覈問題。

根據安全研究人員的掃描結果:

- ClawHub 上共有約 10,700 個技能

- 其中超過 820 個被確認爲惡意技能(約佔 7.7%)

- 更新掃描顯示惡意技能佔比已接近 20%

Cisco AI 安全研究團隊測試了一個第三方 OpenClaw 技能,發現它在用戶不知情的情況下執行了數據外泄和提示注入。

這些惡意技能僞裝成交易機器人、金融助手、內容服務等,實際上會竊取:

- 文件和加密錢包瀏覽器擴展

- 助記詞和 macOS Keychain 數據

- 瀏覽器密碼和雲服務憑據

OpenClaw 無法區分合法指令和惡意指令。攻擊者可以在 OpenClaw 處理的內容中嵌入惡意指令,讓 AI 在不知不覺中執行攻擊者的操作。

攻擊鏈示例:

GPT plus 代充 只需 145

更危險的是,OpenClaw 的「安全模型」明確將提示注入列爲「超出範圍」——只要不繞過安全邊界。但實際上,提示注入可以與其他功能鏈式組合,實現持久化攻擊。

OpenClaw 的代理狀態或「記憶」一旦被修改,就會長期遵循攻擊者的指令,形成持久化後門。

這是許多用戶最容易忽略的風險。OpenClaw 使用長期有效的 OAuth 令牌連接你的 Google、Slack、Discord、GitHub 等賬戶。

關鍵事實: 即使你卸載了 OpenClaw,這些 OAuth 令牌仍然存儲在各服務提供商的服務器上,你的賬戶仍然處於可訪問狀態。

僅僅刪除本地軟件不能解除 OAuth 授權。這就是爲什麼很多人以爲自己已經「卸載乾淨」了,但實際上賬戶仍然暴露在風險中。

OpenClaw 官方文檔自身也承認:「不存在'完美安全'的部署方式」。安全是可選配置,而非內建特性。

💡 安全建議: 如果你的項目需要調用 AI 大模型 API,無需承擔本地部署 Agent 的風險。通過 API易 apiyi.com 平臺可以安全地使用 Claude、GPT-4o、DeepSeek 等主流模型的 API 接口,所有調用都在受控環境中完成。

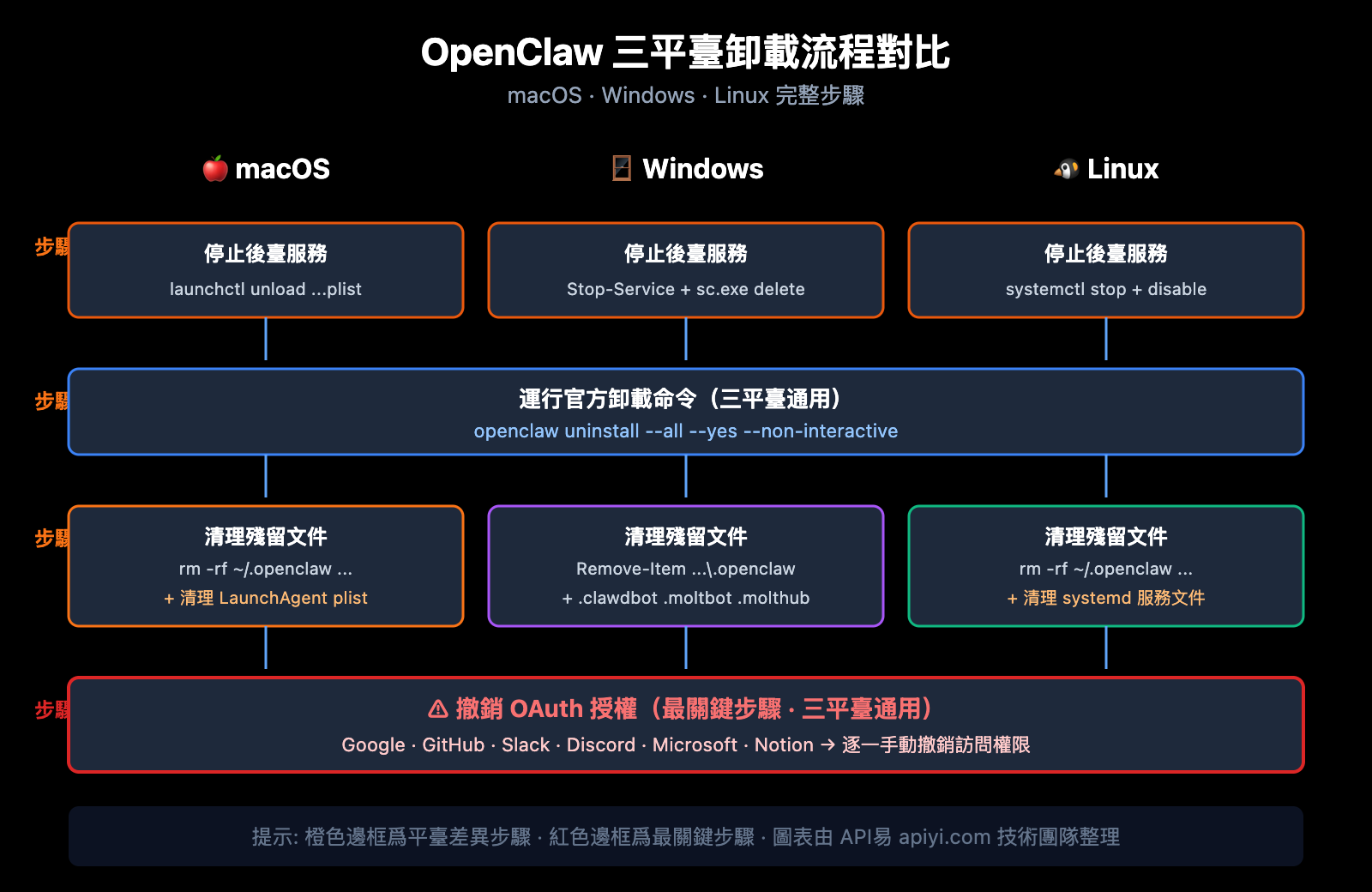

下面是 macOS、Windows、Linux 三個平臺的完整卸載教程。

重要提醒: 卸載順序很關鍵。如果你先通過 刪除了二進制文件,就無法再使用官方的 命令,清理工作會變得更加複雜。

在卸載前,必須先停止 OpenClaw 的後臺網關進程。

macOS:

Linux:

GPT plus 代充 只需 145

Windows:

GPT plus 代充 只需 145

這個命令會移除 OpenClaw 二進制文件和基礎配置。但不會清理所有殘留文件和 OAuth 授權。

官方卸載命令執行後,仍然需要手動清理以下目錄:

macOS / Linux:

Windows:

GPT plus 代充 只需 145

🚀 技術提示: 如果你卸載 OpenClaw 是因爲需要更安全的 AI 調用方式,API易 apiyi.com 提供開箱即用的 API 接口,無需本地部署任何 Agent,5 分鐘即可完成集成。

這是卸載 OpenClaw 中最容易被忽略但最重要的步驟。大多數卸載教程只關注本地文件刪除,但如果不撤銷 OAuth 令牌,你的賬戶仍然存在風險。

GPT plus 代充 只需 145

建議在撤銷 OAuth 之後,順便修改相關賬戶的密碼,特別是在你懷疑可能已經受到攻擊的情況下。

🎯 安全實踐: 使用 AI 服務時,優先選擇基於 API Key 的調用方式,而非 OAuth 廣泛授權。API易 apiyi.com 平臺採用安全的 API Key 認證機制,權限範圍可控,不會訪問你的郵件、文件等敏感數據。

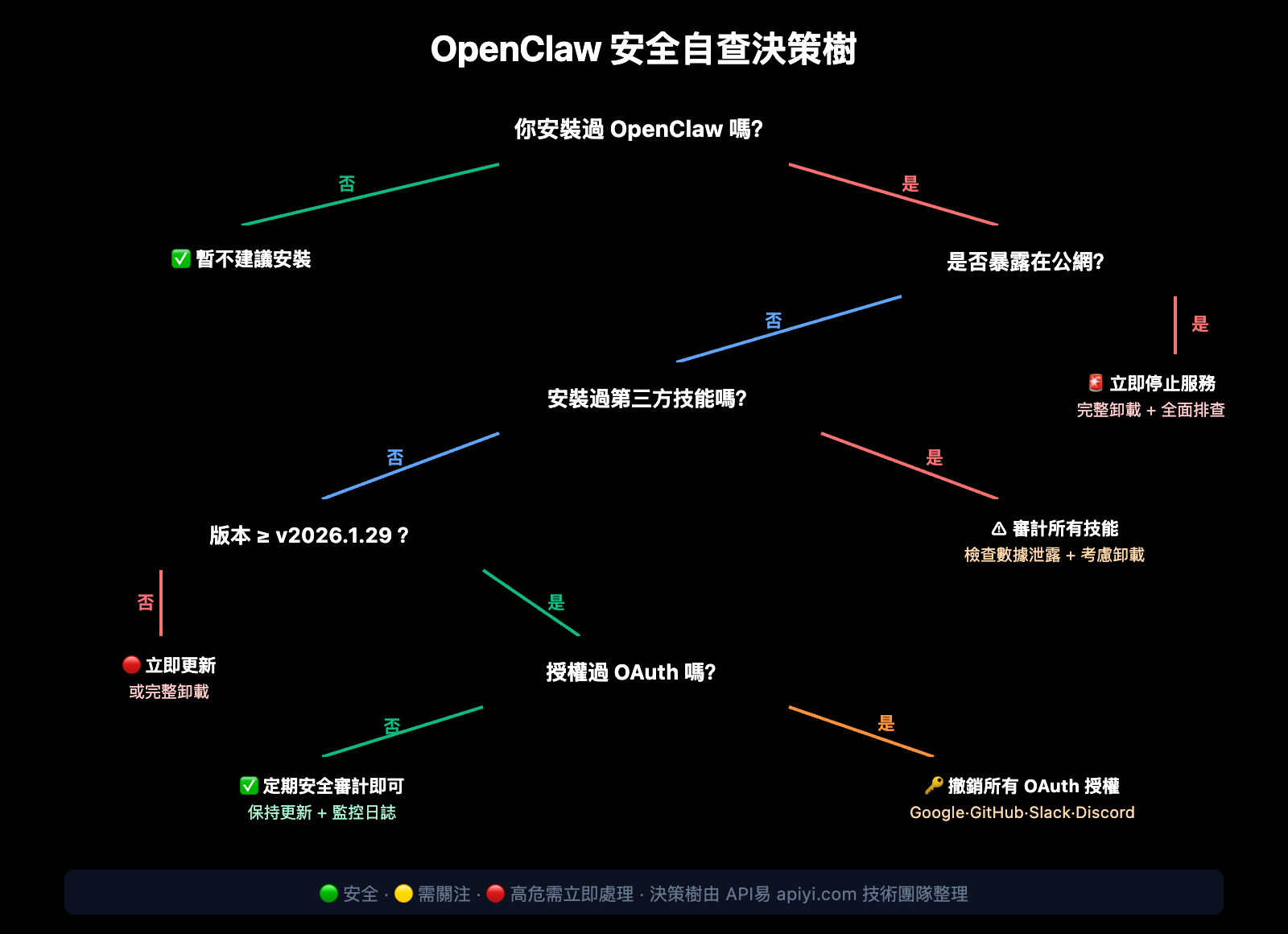

如果你正在使用或曾經使用過 OpenClaw,請對照以下清單進行安全自查:

- 版本檢查: 是否已更新到 v2026.1.29 以上(修復了 CVE-2026-25253)

- 網絡暴露: OpenClaw 網關是否暴露在公網(應僅限 localhost)

- 技能審計: 是否安裝了來源不明的第三方技能

- OAuth 審查: 已授權給 OpenClaw 的服務有哪些

- 日誌檢查: 是否有異常的外部連接記錄

- 記憶審計: OpenClaw 的 Agent 記憶是否被篡改

Q1: OpenClaw 和普通 AI 聊天機器人有什麼區別,爲什麼風險更大?

普通聊天機器人(如 ChatGPT、Claude)運行在服務商的服務器上,你只是通過瀏覽器交互。而 OpenClaw 是一個運行在你本地的自主 AI Agent,它擁有訪問你的文件系統、郵件、代碼倉庫等的實際權限。這種設計讓它功能更強大,但攻擊面也更大——一旦被攻破,攻擊者獲得的不是聊天記錄,而是你電腦和雲服務的實際操作權限。如果你需要安全地調用 AI 模型,建議通過 API易 apiyi.com 等受控的 API 平臺進行,避免本地 Agent 帶來的安全隱患。

Q2: 我已經卸載了 OpenClaw,還需要擔心什麼?

最需要擔心的是 OAuth 令牌。OpenClaw 使用長期有效的 OAuth 令牌,這些令牌存儲在 Google、GitHub、Slack 等服務商的服務器上,不會因爲你卸載本地軟件而失效。請務必登錄每個曾授權過的平臺,手動撤銷 OpenClaw 的訪問權限。此外,如果你安裝過第三方技能,建議檢查系統中是否有異常進程或文件。

Q3: OpenClaw 的惡意技能是怎麼運作的?

惡意技能僞裝成正常功能(如交易機器人、內容服務),通過 ClawHub 市場分發。一旦安裝,它們會在後臺執行數據外泄——竊取瀏覽器密碼、加密錢包助記詞、macOS Keychain 數據等敏感信息。Cisco 安全團隊的測試證實,這些技能可以在用戶完全不知情的情況下運行。

Q4: 如果我的 OpenClaw 只在本地運行,沒有暴露到公網,安全嗎?

不完全安全。CVE-2026-25253 漏洞證明,即使 OpenClaw 只綁定到 localhost,攻擊者仍然可以通過惡意鏈接竊取你的認證令牌,實現一鍵遠程代碼執行。只要你點擊了一個精心構造的鏈接,本地安全邊界就會被繞過。

Q5: 有沒有更安全的方式使用 AI Agent 功能?

有幾個建議:首先,優先使用基於 API 的調用方式而非本地 Agent,通過 API易 apiyi.com 平臺可以安全調用 Claude、GPT-4o、DeepSeek 等主流模型,所有請求在受控環境中處理;其次,如果確實需要本地 Agent,務必保持最新版本、限制網絡暴露、只使用經過審計的官方技能;最後,定期審查 OAuth 授權和系統日誌。

OpenClaw 作爲一個強大的開源 AI Agent 工具,其安全問題不容忽視。從高危 CVE 漏洞到惡意技能市場,從提示注入到 OAuth 令牌持久化,每一個風險點都可能導致嚴重的安全事故。

卸載 OpenClaw 的關鍵步驟回顧:

- 停止後臺服務進程

- 運行

- 手動清理 、、、 目錄

- 撤銷所有平臺的 OAuth 授權(最關鍵的一步)

- 驗證清理結果

如果你的項目需要 AI 大模型能力,推薦通過 API易 apiyi.com 使用安全的 API 調用方式,支持 Claude、GPT-4o、DeepSeek、Gemini 等主流模型的統一接口調用,無需承擔本地 Agent 的安全風險。

本文由 APIYI 技術團隊撰寫,關注 AI 大模型技術動態和安全實踐。更多 AI 技術教程請訪問 API易幫助中心: help.apiyi.com

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/233815.html