如果你对AI绘画感兴趣,可能听说过Stable Diffusion WebUI,它确实对新手很友好。但当你想要更精细地控制生成过程,或者想搭建一个可以重复使用、甚至分享给他人的自动化流程时,WebUI的固定界面就显得有些力不从心了。

这时,ComfyUI就登场了。它不是一个简单的“点按钮”工具,而是一个可视化的工作流设计器。你可以把它想象成乐高积木,每个积木(节点)都有特定功能,比如“加载模型”、“输入文字”、“生成图片”。通过连接这些积木,你就能搭建出属于自己的、独一无二的AI绘画流水线。

这篇文章的目标很简单:让你在10分钟内,零基础启动ComfyUI,并亲手生成第一张AI图片。 我们不会深究复杂的底层原理,而是聚焦于“怎么用起来”。你会发现,借助现成的镜像,这个过程比想象中简单得多。

传统部署ComfyUI需要配置Python环境、安装依赖、下载模型,步骤繁琐且容易出错。但现在,我们可以利用预置的Docker镜像,实现真正的“开箱即用”。

2.1 理解“镜像”的概念

你可以把“镜像”理解为一个打包好的、包含完整运行环境的软件快照。它里面已经装好了ComfyUI、Python、PyTorch以及所有必要的库和插件。你不需要关心它内部是怎么搭建的,只需要“运行”它,就能得到一个立即可用的ComfyUI服务。

我们使用的这个镜像,已经集成了ComfyUI核心以及ADetailer、ControlNet、AnimateDIFF等常用插件,省去了你后续手动安装的麻烦。

2.2 启动ComfyUI镜像

具体的启动步骤会根据你使用的云平台或服务器提供商而略有不同,但核心流程一致:

- 获取镜像:在平台的镜像市场或应用中心,搜索“ComfyUI”。

- 创建实例:选择该镜像,并根据你的需求配置服务器(建议选择带有GPU的实例,如NVIDIA T4或V100,生成速度会快很多)。

- 启动服务:实例创建完成后,平台通常会提供一个访问地址(一个URL链接)和端口号。

整个过程就像在应用商店安装一个APP,几分钟内就能完成。启动后,你通过浏览器访问那个提供的URL,就能看到ComfyUI的界面了。

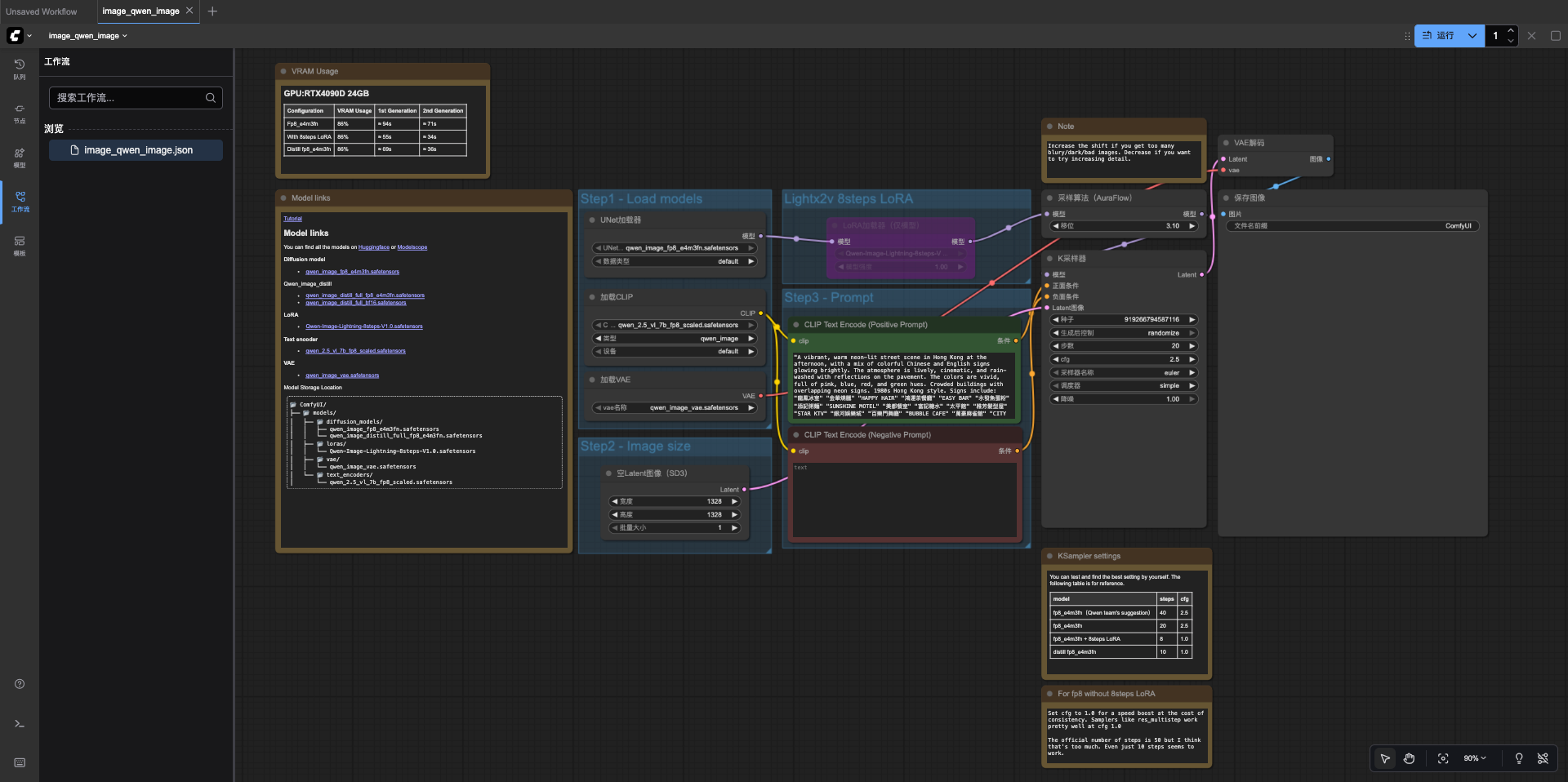

第一次打开ComfyUI,你可能会觉得界面有些复杂,到处都是按钮和空白区域。别担心,我们一步步来拆解。下图展示了ComfyUI的核心工作区:

主要区域可以理解为三块:

- 节点面板(左侧):这里是你的“积木箱”。所有可用的功能节点都分类存放在这里,比如 (加载模型)、(输入提示词)、(采样器)等。你需要什么功能,就从这里拖出来。

- 画布(中间大片区域):这是你的“工作台”。你将从左侧拖出的节点放在这里,并用“线”将它们连接起来,构建你的工作流。

- 生成控制与预览(右侧):这里通常有“Queue Prompt”(运行)按钮,点击它就开始执行你的工作流。下方会显示生成过程中的日志,以及最终生成的图片。

我们的目标,就是在这个画布上,搭建一个最简单的“文生图”流水线。

让我们动手搭建一个最基础的工作流,体验一下ComfyUI的魔力。这个工作流的逻辑是:加载模型 -> 输入描述 -> 生成图片 -> 保存显示。

4.1 第一步:载入AI绘画的“大脑”(模型)

所有的AI绘画都始于一个基础模型,它决定了画风、质量和知识库。

- 在左侧节点面板,找到 节点。你可以使用搜索框(快捷键 )快速查找。

- 将其拖拽到中间画布上。这个节点就是用来加载 Stable Diffusion 模型(如 SD1.5, SDXL)的。

- 点击节点上的 下拉菜单。你会发现镜像已经预置了一些常用模型。选择一个你感兴趣的,比如 (一个通用的SD1.5模型)。

4.2 第二步:告诉AI你想画什么(提示词)

现在我们需要输入描述,也就是“提示词”(Prompt)。这是控制生成内容最关键的一步。

- 在节点面板搜索 ,拖出两个到画布上。一个用于正面提示词(描述你想要的内容),一个用于负面提示词(描述你不想要的内容,如“丑陋的、模糊的”)。

- 连接线路:

- 将 节点的 输出,分别连接到两个 节点的 输入。

- 在正面提示词节点的 输入框里,用英文写下你的描述。例如:(杰作,**质量,一个女孩,美丽,细节丰富的眼睛,在花园里)。

- 在负面提示词节点的 输入框里,可以输入一些通用负面词,如:。

4.3 第三步:设定画布大小(潜在空间)

AI不是在像素空间直接作画,而是在一个叫“潜在空间”的地方工作。我们需要定义最终图片的尺寸。

- 搜索并拖出 节点。

- 设置参数:(宽度)设为 ,(高度)设为 ,(一次生成几张)设为 。这是一个常用的人物竖图尺寸。

4.4 第四步:启动“绘画引擎”(采样器)

这是核心的生成步骤,采样器负责根据你的提示词和模型,在潜在空间中“画出”图像。

- 搜索并拖出 节点。

- 连接所有线路,这是最关键的一步:

- 输入:连接 节点的 输出。

- 输入:连接 正面 节点的 输出。

- 输入:连接 负面 节点的 输出。

- 输入:连接 节点的 输出。

- 保持采样器参数默认即可(, , ),这对初次尝试来说是个不错的起点。

4.5 第五步:让图片“显影”(解码与保存)

采样器生成的是压缩的“潜空间”数据,需要解码成我们能看到的图片。

- 搜索并拖出 节点。

- 连接线路:将 节点的 输出,连接到 节点的 输入。同时,将 节点的 输出也连接到 节点的 输入。

- 最后,搜索并拖出 节点,将 节点的 输出与之连接。

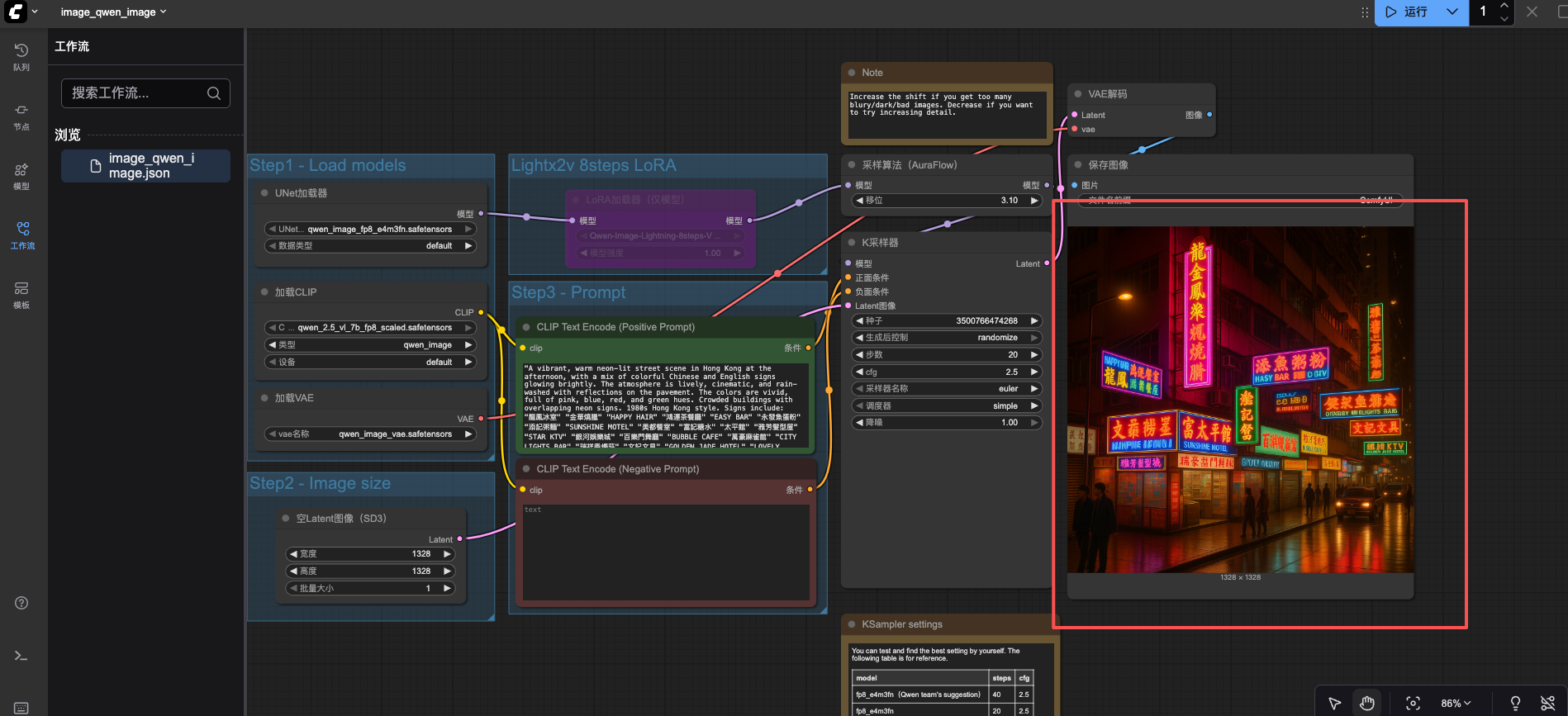

至此,你的第一个工作流就搭建完成了!它看起来应该像下图这样,一个清晰的从左到右的数据流:

4.6 第六步:运行并查看结果

- 检查所有连线是否正确、完整。

- 点击界面右上角的 【运行】 按钮。

- 稍等片刻,你会在右下角或者 节点上看到生成的图片!

恭喜你!你已经成功使用ComfyUI生成了第一张AI图片。这个简单的流程是所有复杂创作的基础。

手动搭建虽然有助于理解,但ComfyUI更强大的地方在于其工作流共享功能。社区有大量高手设计好的、功能强大的工作流(通常保存为 或 文件)。我们的镜像也预置了一些。

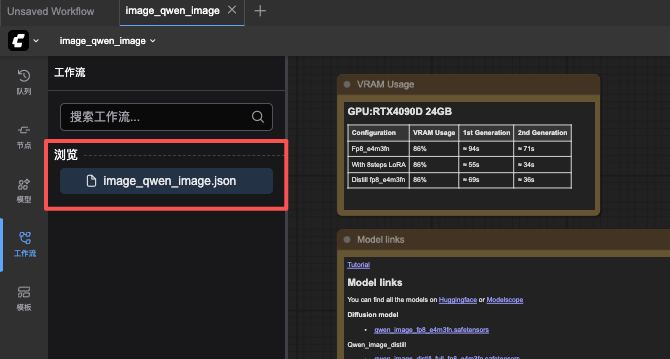

5.1 加载预置工作流

- 在ComfyUI界面中,找到 【Load】 按钮(通常在左上角或右上角)。

- 点击后,会弹出一个文件浏览器,里面应该已经有一些预置的工作流文件,例如 。

- 选择并加载一个。画布上会自动出现一个完整、复杂的工作流,可能包含了LoRA、ControlNet等多种高级节点。

5.2 理解与使用预置工作流

加载后,你不需要完全理解每个节点的作用。通常,这类工作流会有清晰的输入节点:

- 提示词输入:找到 节点,修改它的 内容。

- 图片输入:如果是一个“图生图”或“ControlNet”工作流,会有一个 节点,你可以上传自己的图片。

- 参数调整:找到 或类似的生成节点,你可以调整 (步数,影响细节和生成时间)、(提示词相关性,值越高越遵循提示词)等。

修改这些输入后,再次点击【运行】,就能基于这个强大的工作流生成图片了。 这是学习高级技巧最快的方式——直接使用和修改成熟的工作流。

通过本教程,你已经完成了从零到一的跨越:

- 理解了ComfyUI的核心价值:它不是另一个WebUI,而是一个可视化、可编程、可复用的AI工作流设计平台。

- 掌握了最简部署方式:利用预置的Docker镜像,绕过了所有环境配置的坑,实现了分钟级部署。

- 搭建了第一个工作流:亲手连接节点,理解了“文生图”的基本数据流(模型->提示词->采样->解码)。

- 学会了利用社区资源:通过加载预置工作流,能够快速使用高级功能。

接下来你可以探索的方向:

- 探索更多节点:尝试 (图生图)、各种 节点(控制姿势、线条)、 节点(参考图片风格)等。

- 调整参数:多试试 里不同的 (采样器)和 (步数),感受它们对出图速度和效果的影响。

- 安装自定义模型:将你从网上下载的 格式模型文件,上传到服务器镜像指定的模型目录(通常是 ),然后重启服务,就能在 节点里看到并使用了。

- 保存你的工作流:使用 【Save】 按钮,将你调试好的工作流保存下来,下次可以直接加载,实现真正的“可复现”。

ComfyUI就像给你的AI绘画能力装上了一套可视化编程工具,一开始可能觉得有点复杂,但一旦熟悉了这种节点式的工作方式,你将获得前所未有的控制力和创作自由。现在,你的AI绘画之旅已经正式开启了。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/229485.html