昨晚刷个好东西:NVIDIA NIM 居然把 GLM-4.7 和 MiniMax M2.1 都加进去了,而且是免费的。

我第一反应是不信。毕竟这两个模型刚发布没多久,GLM-4.7 在编程圈子里已经被吹上天了,MiniMax M2.1 更是号称多语言编程能力吊打一众闭源模型。这么好的东西,NVIDIA 说送就送?

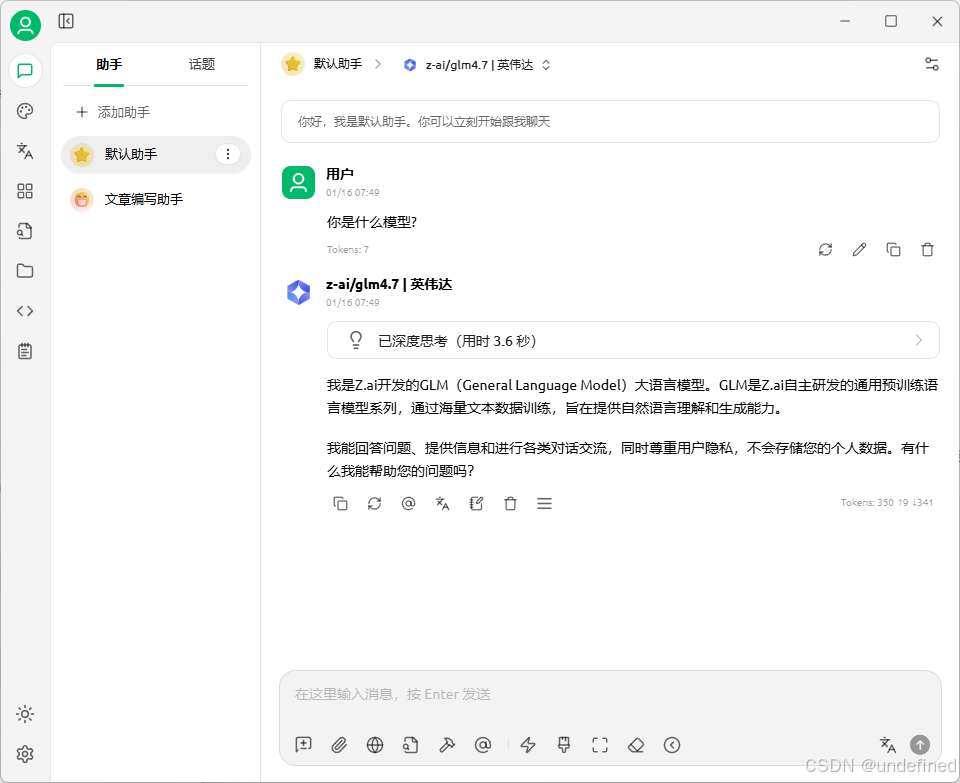

试了一下,还真能用。那这就可以成为Claude和GPT模型的国内替代品啦!

NVIDIA NIM 现在免费提供这两个模型的 API 调用:

API 地址统一是:

不过有个小问题:这两个模型目前还没在官方模型广场页面列出来,但 API 实测已经可以调用了。估计是刚上线,资源还比较紧张。

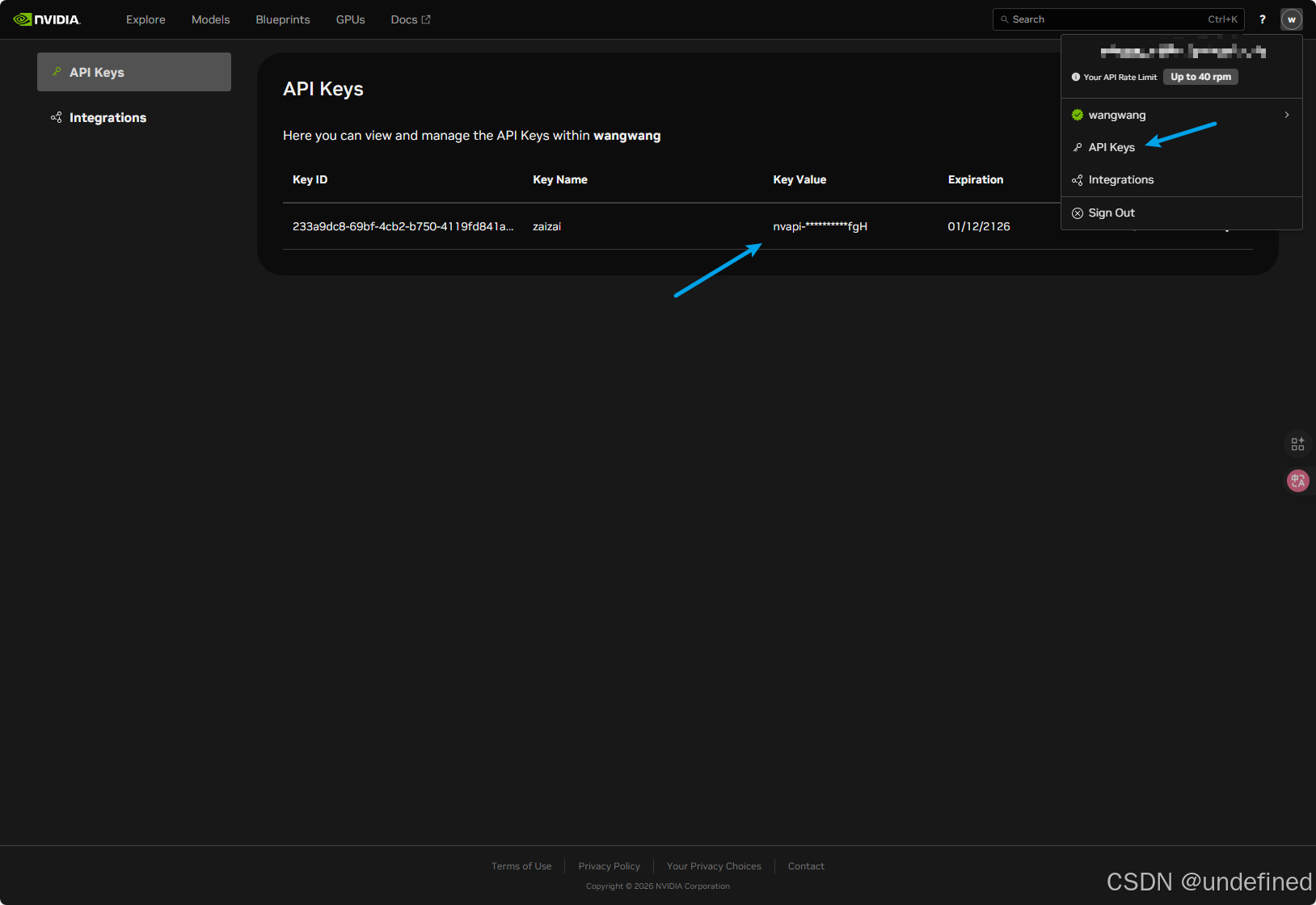

这是最简单的一步:

- 打开 build.nvidia.com

- 注册/登录 NVIDIA 账号

- 进入 Settings → API Keys

- 点击生成新的 API Key

搞定。新用户还会送一些免费额度,日常开发测试绰绰有余。

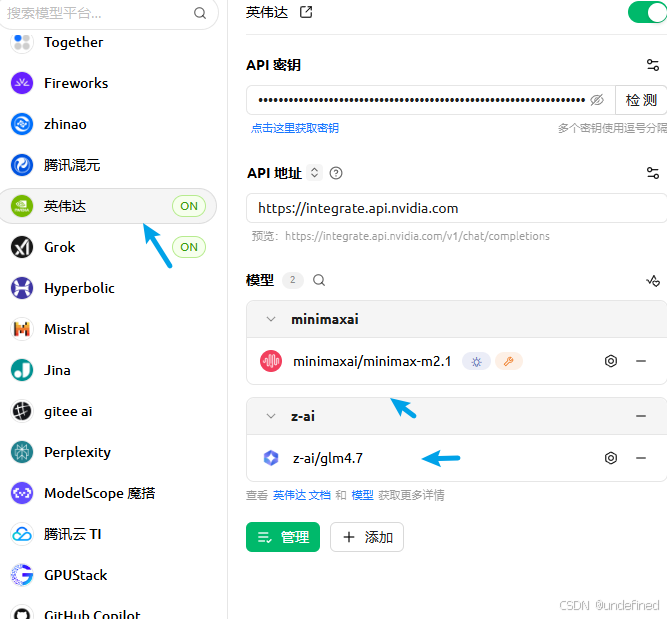

Cherry Studio 支持添加自定义服务商,配置起来很简单。

步骤 1:添加自定义服务商

- 打开 Cherry Studio,点击左侧「设置」(齿轮图标)

- 选择「模型服务」选项卡

- 点击「+ 添加」按钮

- 填写信息: - 提供商类型:选择 英伟达

步骤 2:配置 API

找到刚添加的服务商,配置以下信息:

- API 密钥:填入你在 NVIDIA 获取的 API Key

步骤 3:添加模型

点击「管理」按钮,手动添加这两个模型:

打开右上角的启用开关,就可以在对话中选择这两个模型了。

Claude Code 默认用的是 Anthropic 官方 API,但它支持 OpenAI 兼容接口,所以可以配置第三方模型。

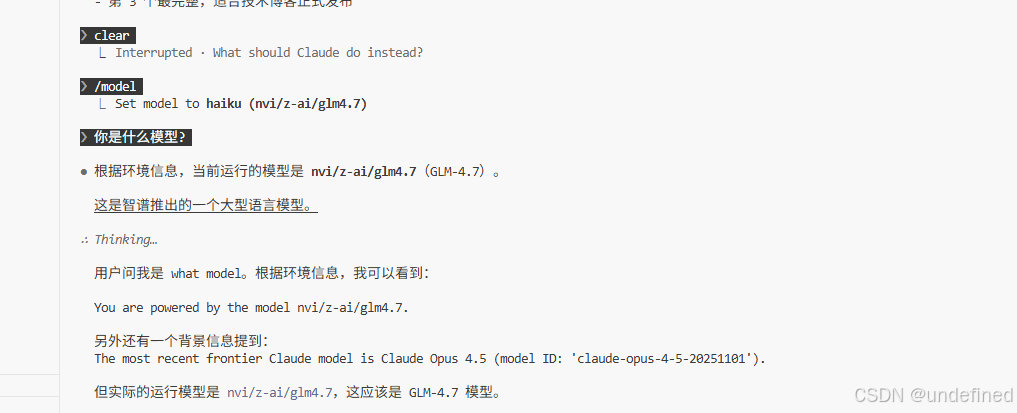

踩坑提醒:NVIDIA NIM 的接口是 OpenAI 兼容格式,不是 Anthropic 格式。别填错环境变量名了,我第一次就搞混了,折腾了半小时才发现。 这里推荐使用一些开源项目集中配置API,方便小白,比如Claude Code Switch 或者 Claude Code Router(https://github.com/musistudio/claude-code-router) ,我前几天的文章还分享过其他的,可以去看一看!

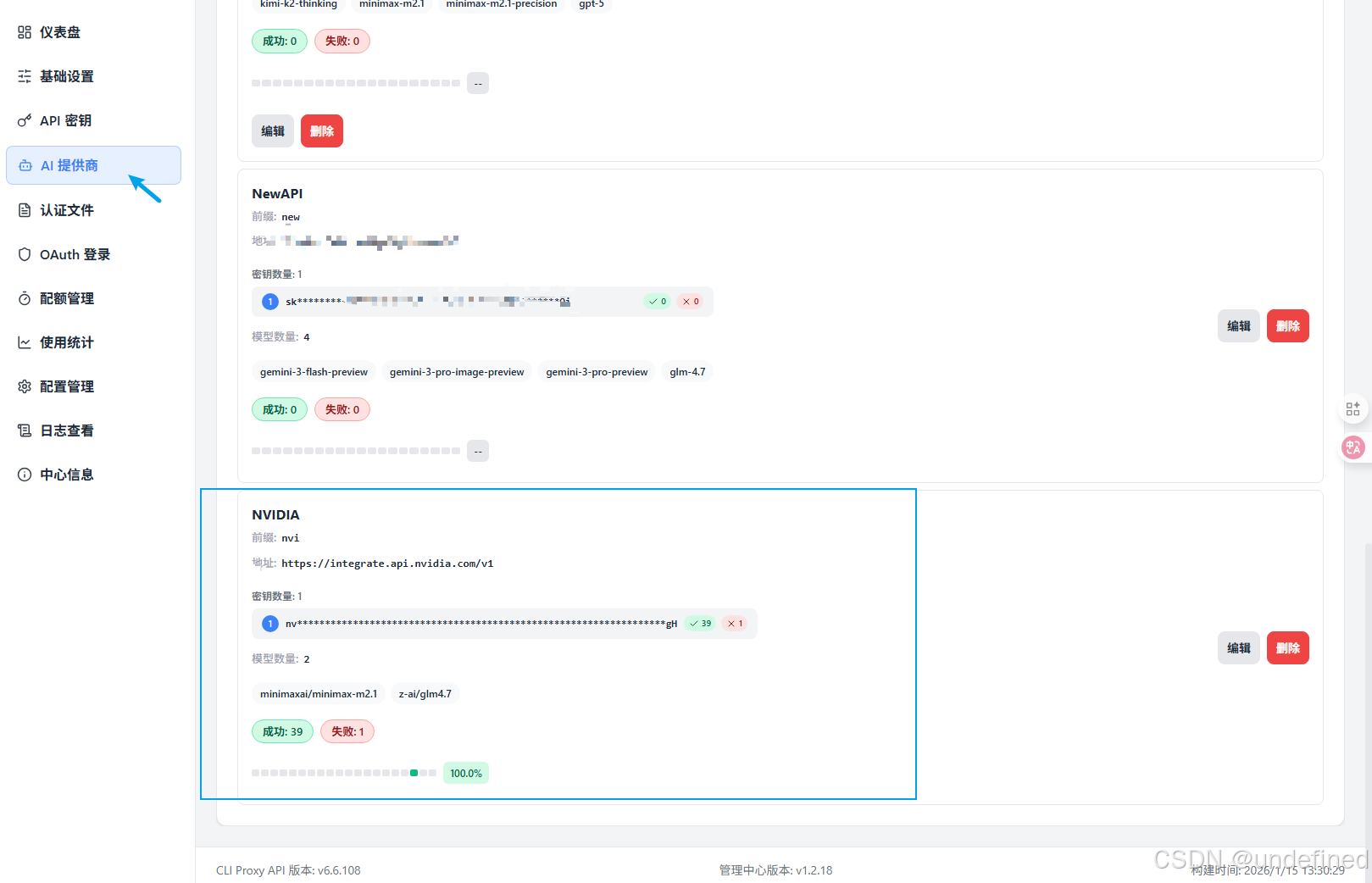

我这里用的是CLIProxyAPI ,只需要在AI提供商里面配置OpenAI兼容提供商,即可使用!

直接将官方地址配置到Claude Code我还没试过,不知道能不能行,因为我主用Claude模型,有兴趣的可以尝试下!

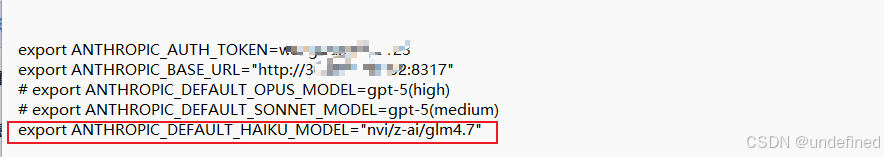

我用的是WSL环境,然后编辑环境变量文件( oot.bashrc)就可以使用了. 其他环境可以问下AI如何修改!

配置稍微复杂一点,但对于需要稳定性和成本控制的场景很有用。

不需要。

NVIDIA NIM 的 API 地址 在国内可以直接访问!

这可能是目前最省心的免费 API 选择了——不用折腾网络环境,不用担心封号,直接干就完了。

试用了两天,说说我的体会:

适合用 GLM-4.7 的场景:

- 前端开发,尤其是需要好看 UI 的

- 一次**付的编程任务

- 需要深度思考的复杂问题

适合用 MiniMax M2.1 的场景:

- 多语言项目(Java、Go、Rust 这些)

- 需要长时间运行的 Agent 任务

- 对响应速度有要求的场景

不太适合的场景:

- 需要图片输入的任务(GLM-4.7 不支持)

- 对延迟极度敏感的实时应用(毕竟是免费的,资源紧张时会变慢)

NVIDIA 这波操作挺有意思的。把国产顶流模型免费开放出来,既是给开发者发福利,也是在推广自家的 NIM 生态。

对于普通用户来说,这就是个白嫖的好机会。GLM-4.7 和 MiniMax M2.1 都是刚发布的新模型,能力确实能打。趁着现在资源还没被挤爆,赶紧去试试。

至于能免费多久,谁也说不准。反正先用着再说。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/223801.html