赞美Qwen!删掉你的Kontext Dev,关掉你的Kontext Pro和Ultra API,因为新的言出法随工具已经降临。

言出法随改图的需求,一直都是所有人的梦想。但真正实现也无非是最近半年的事情。我们经历了GPT 4o,豆包/即梦这些线上改图工具,而本地开源领域之前只有Kontext Dev一家独大,效果虽然不错,但是有一些高规格创作的领域就总容易捉襟见肘。

而在2025年8月19日,阿里的Qwen-Image-Edit 终于开源,大家可以在本地部署之后,轻松地使用了。

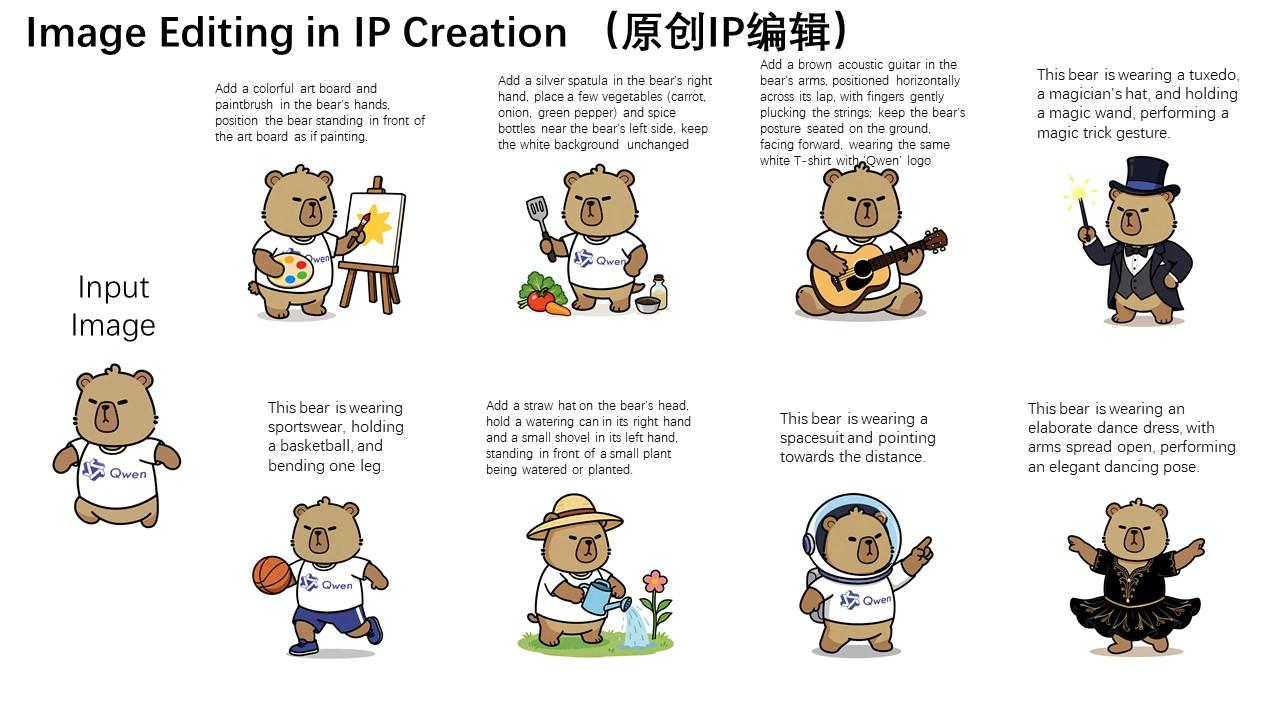

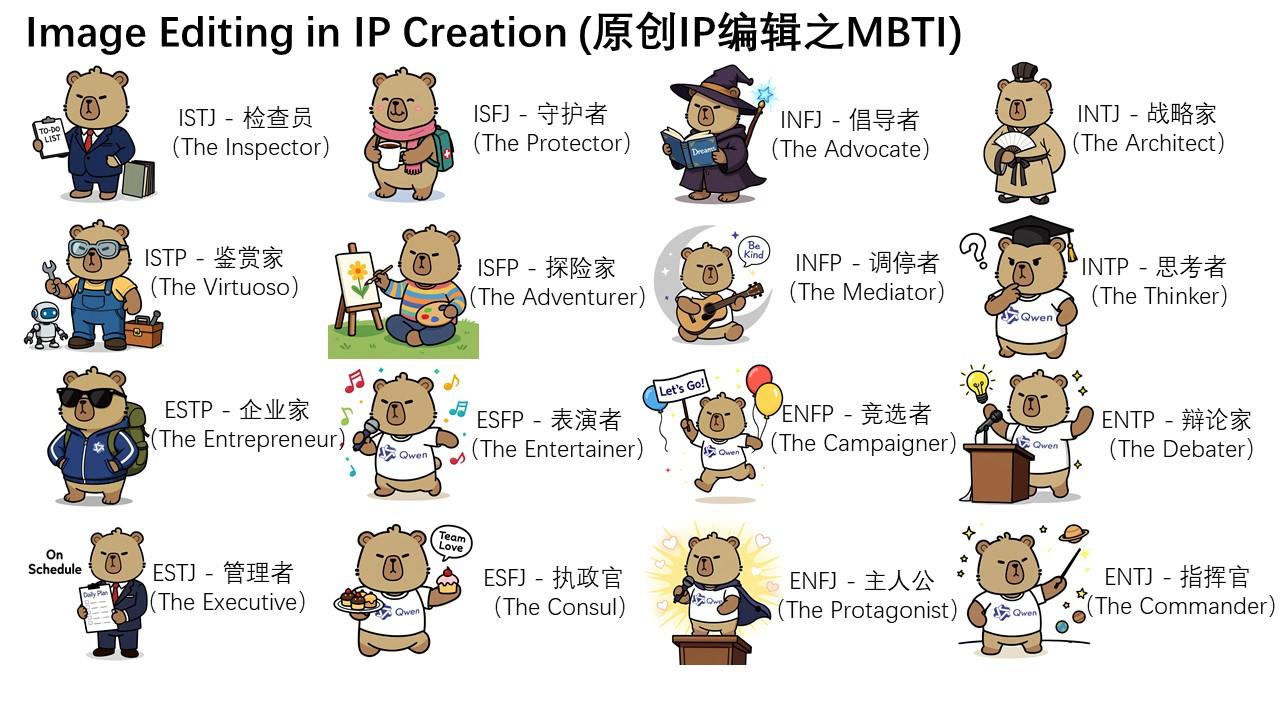

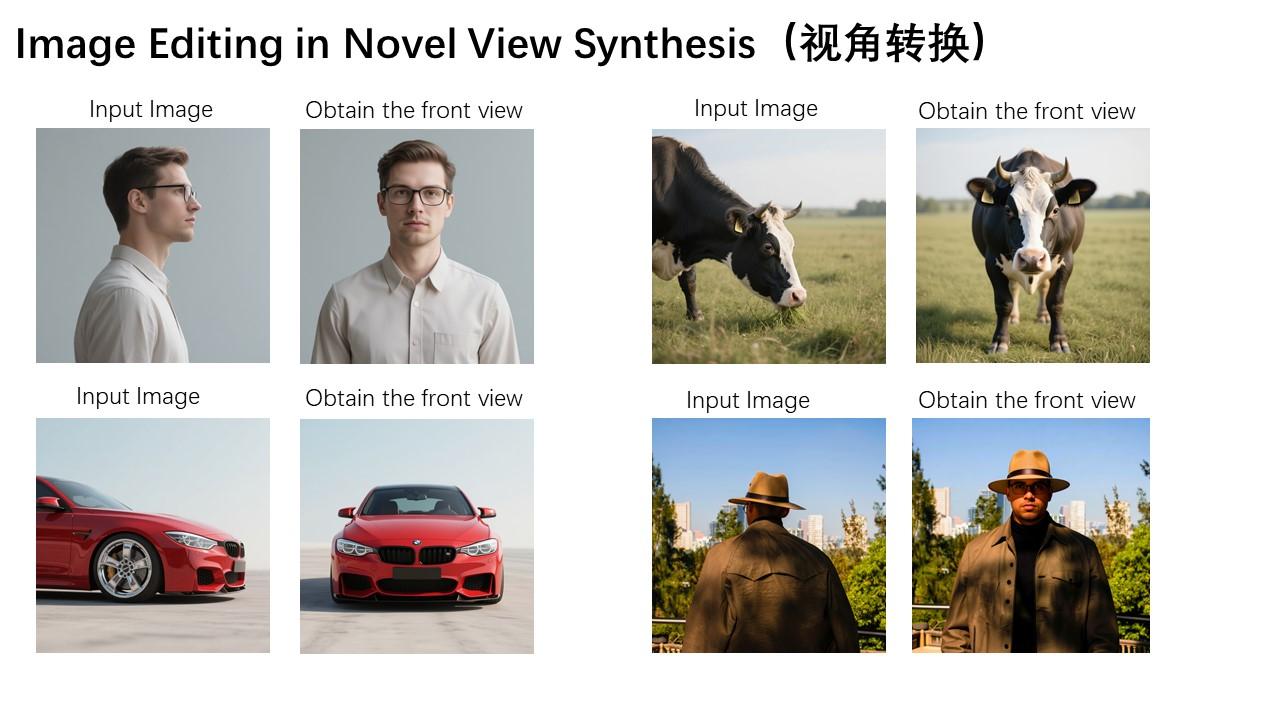

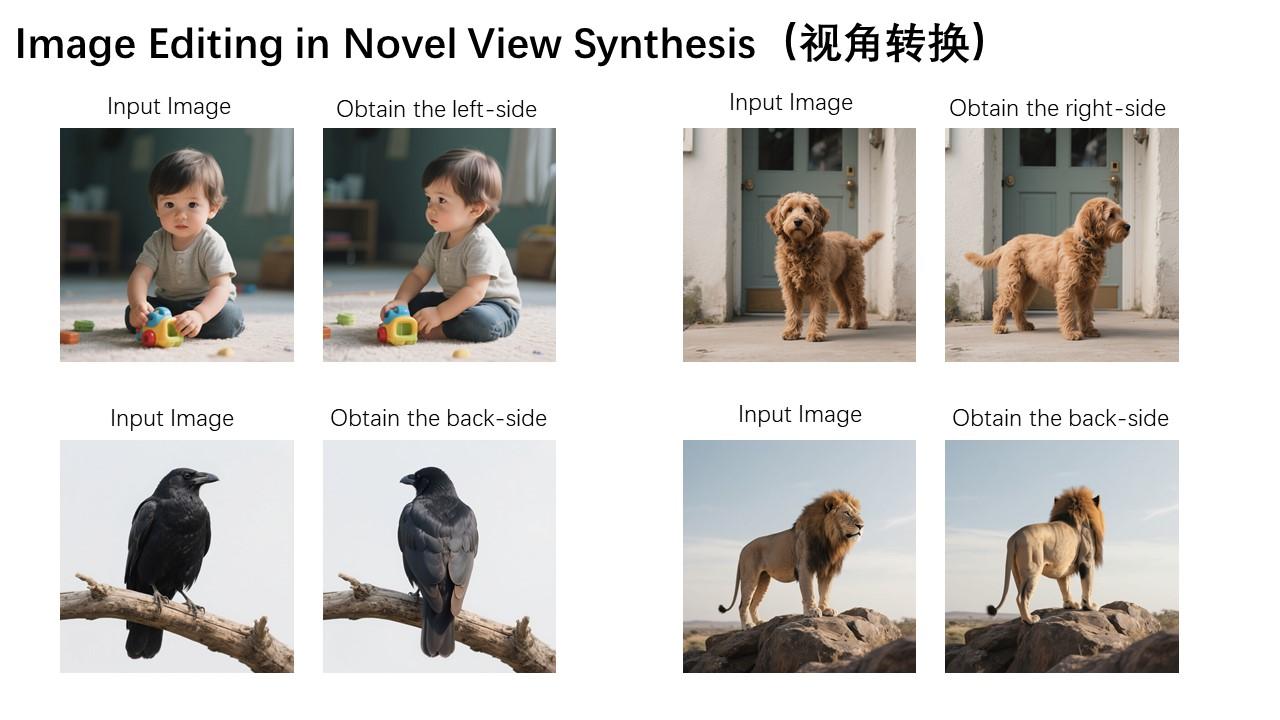

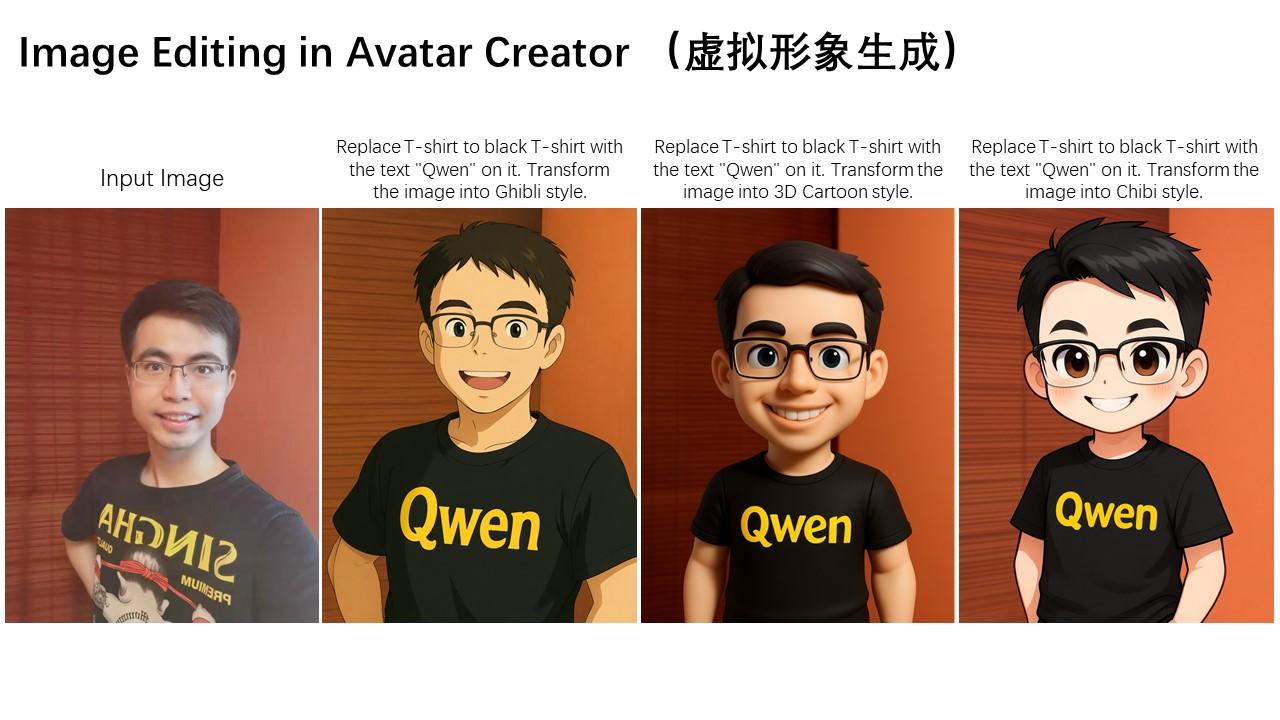

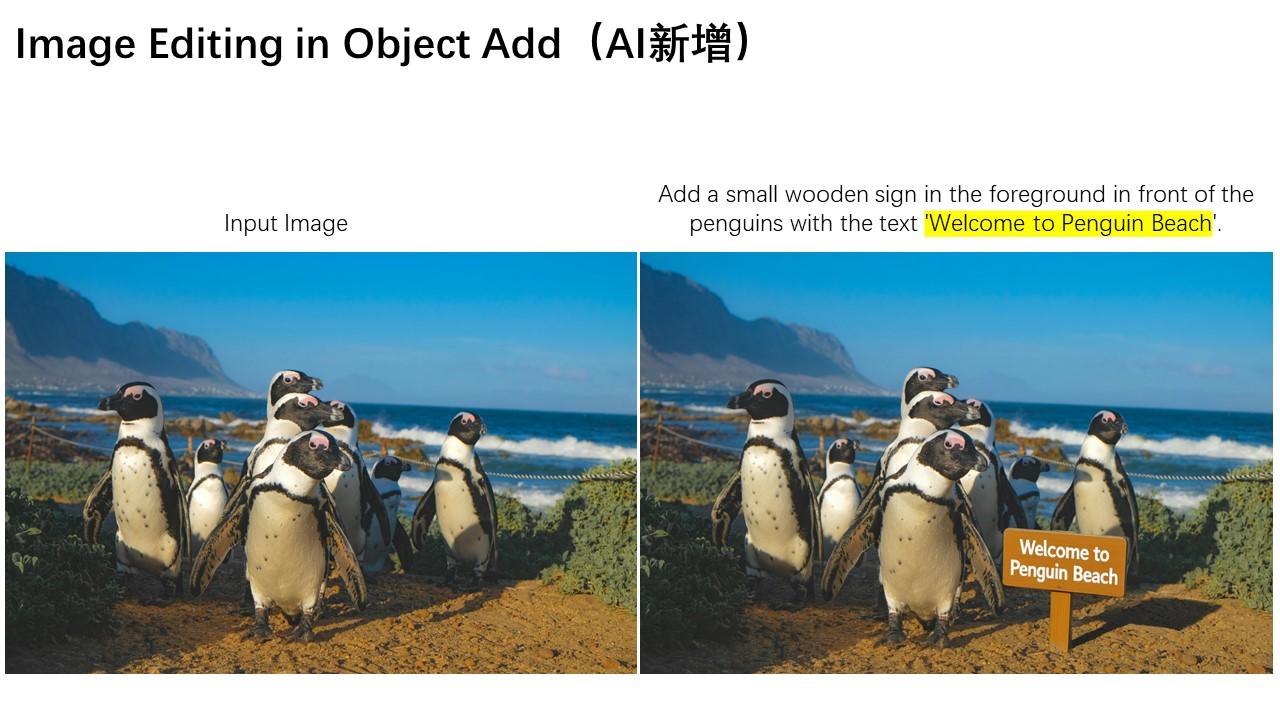

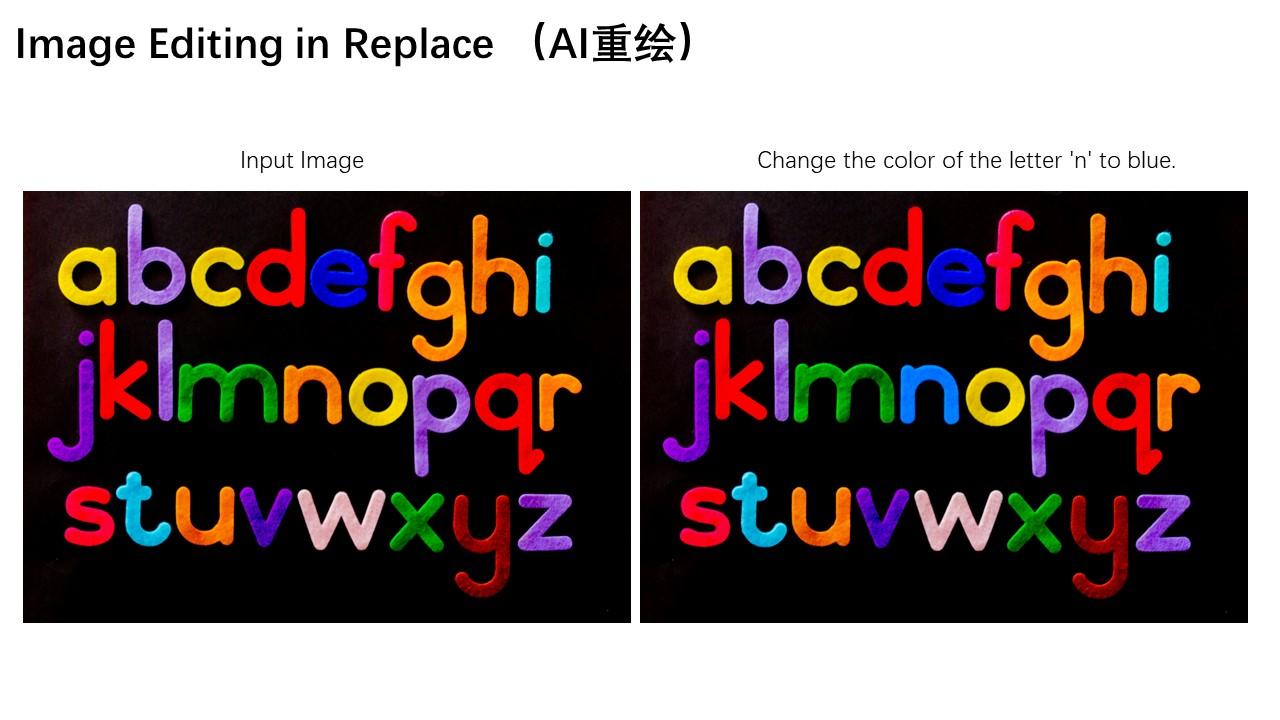

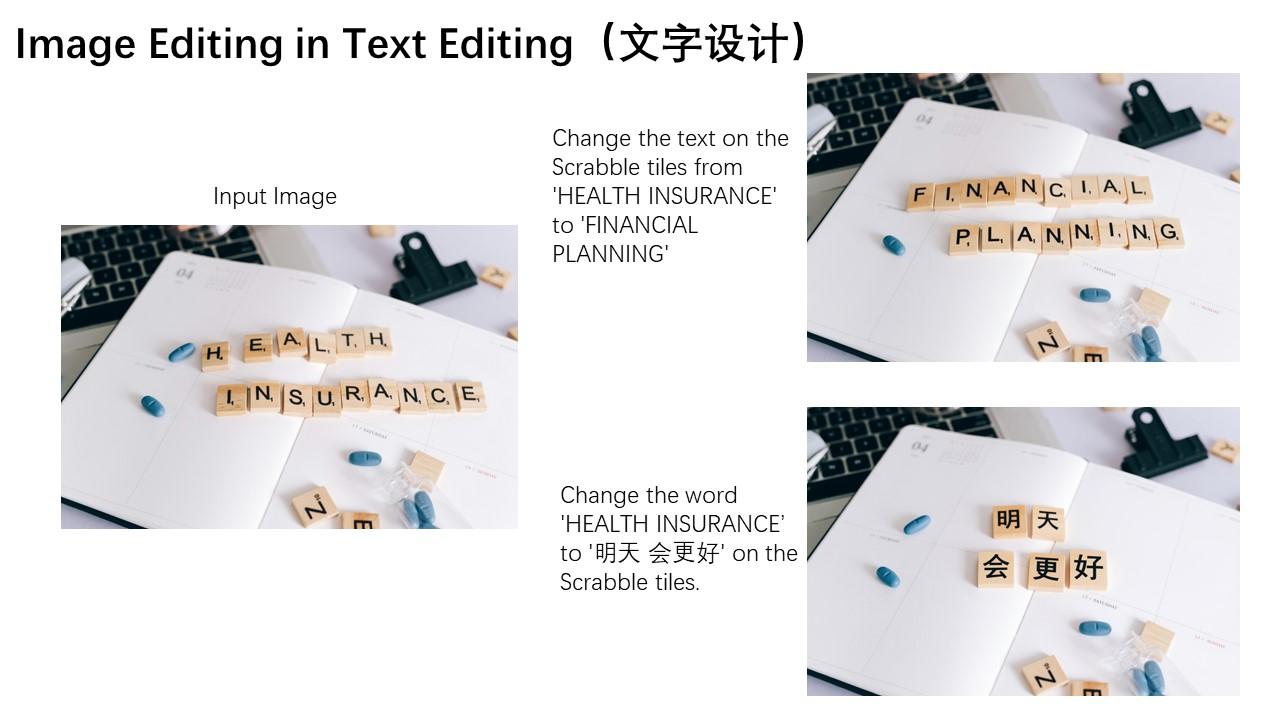

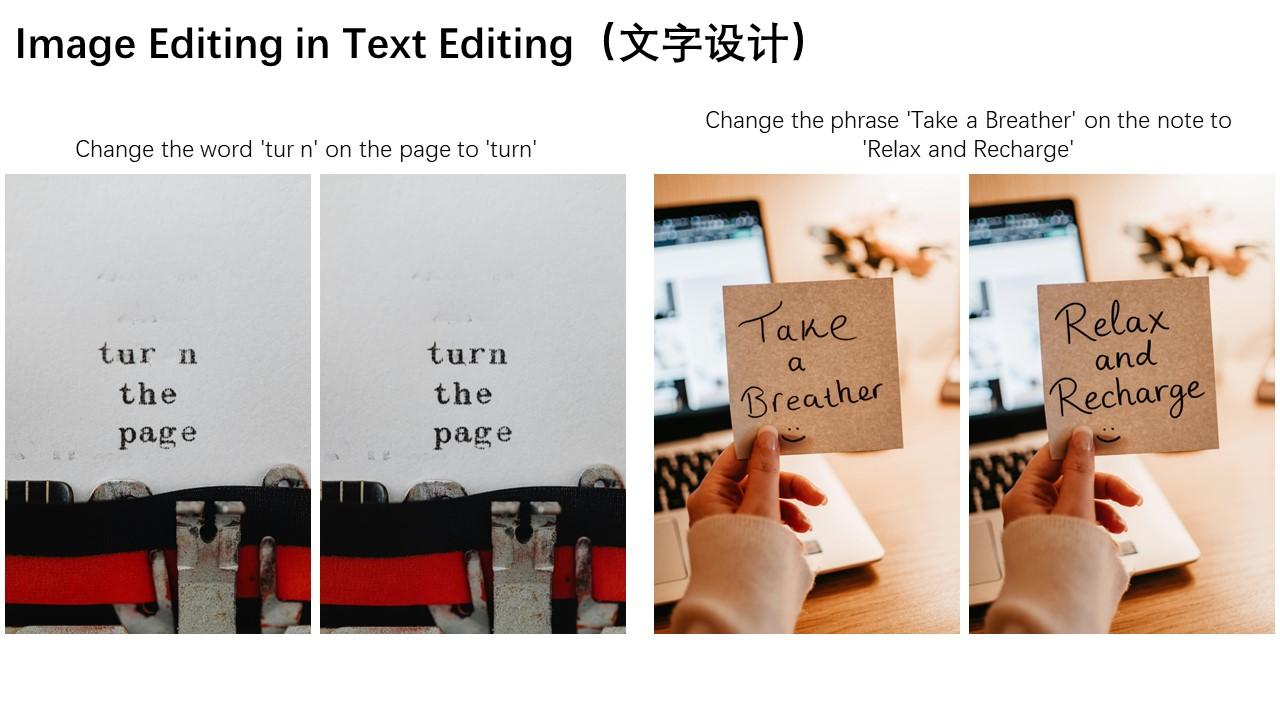

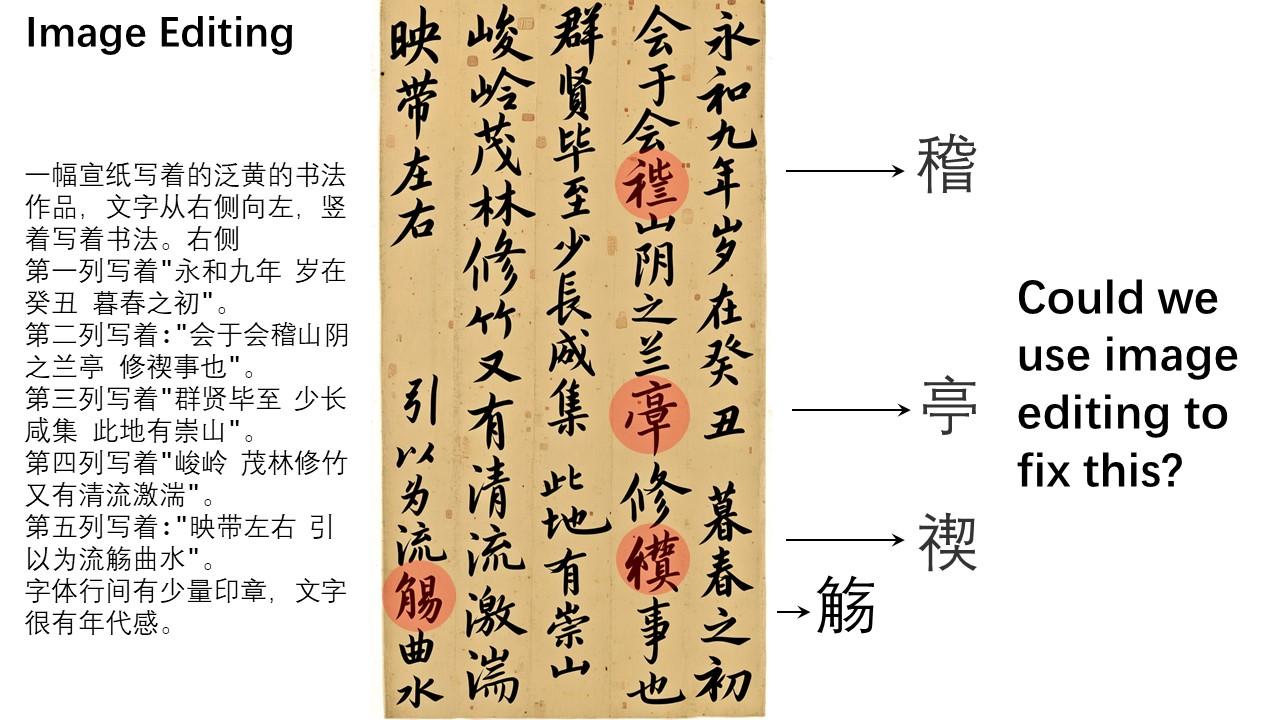

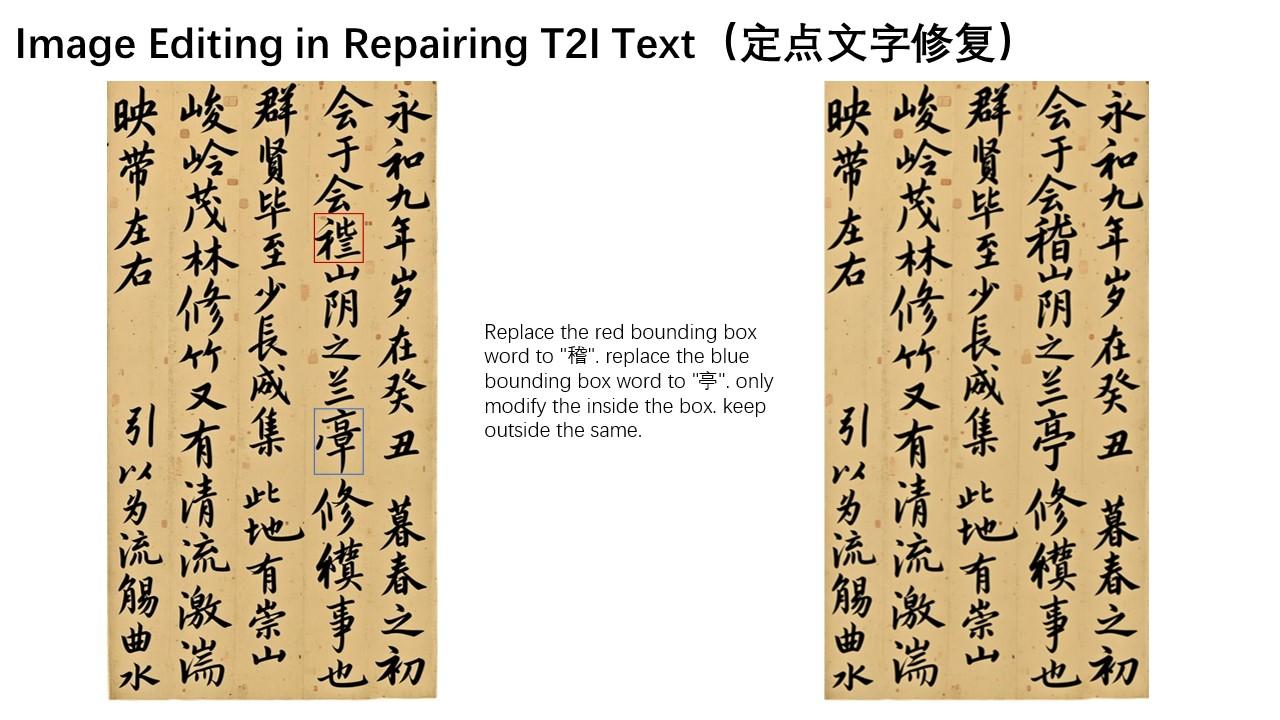

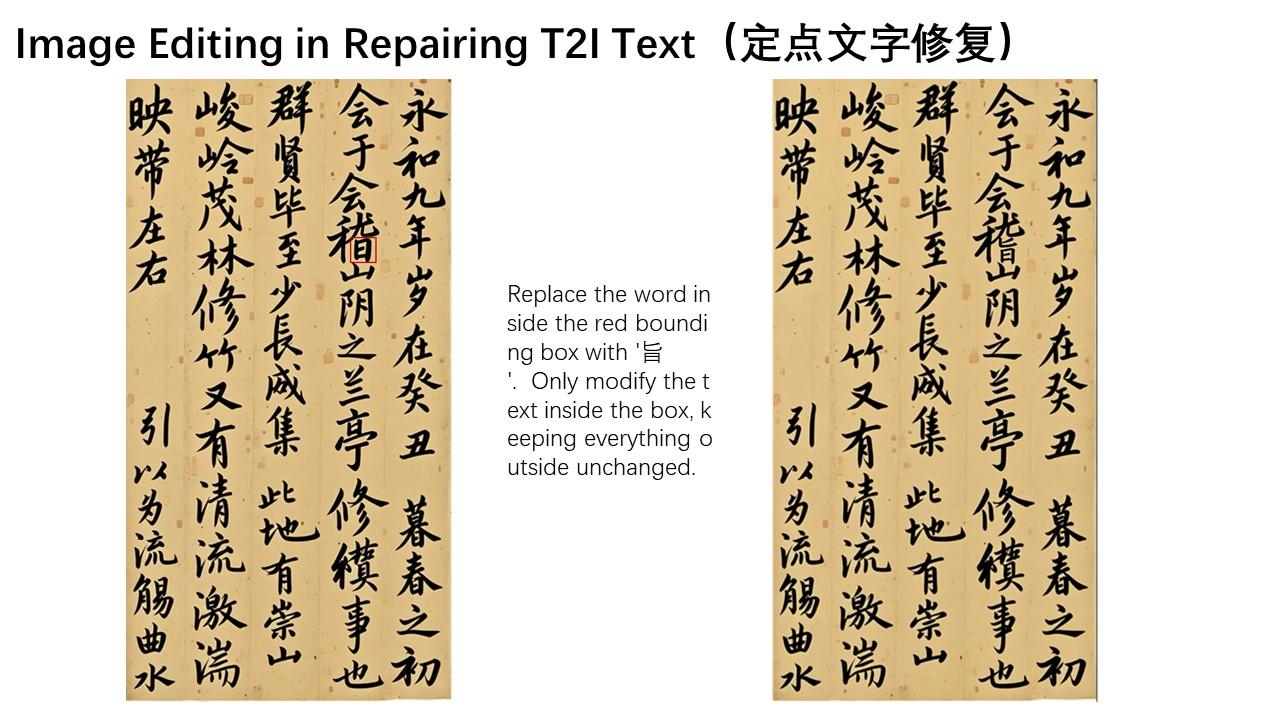

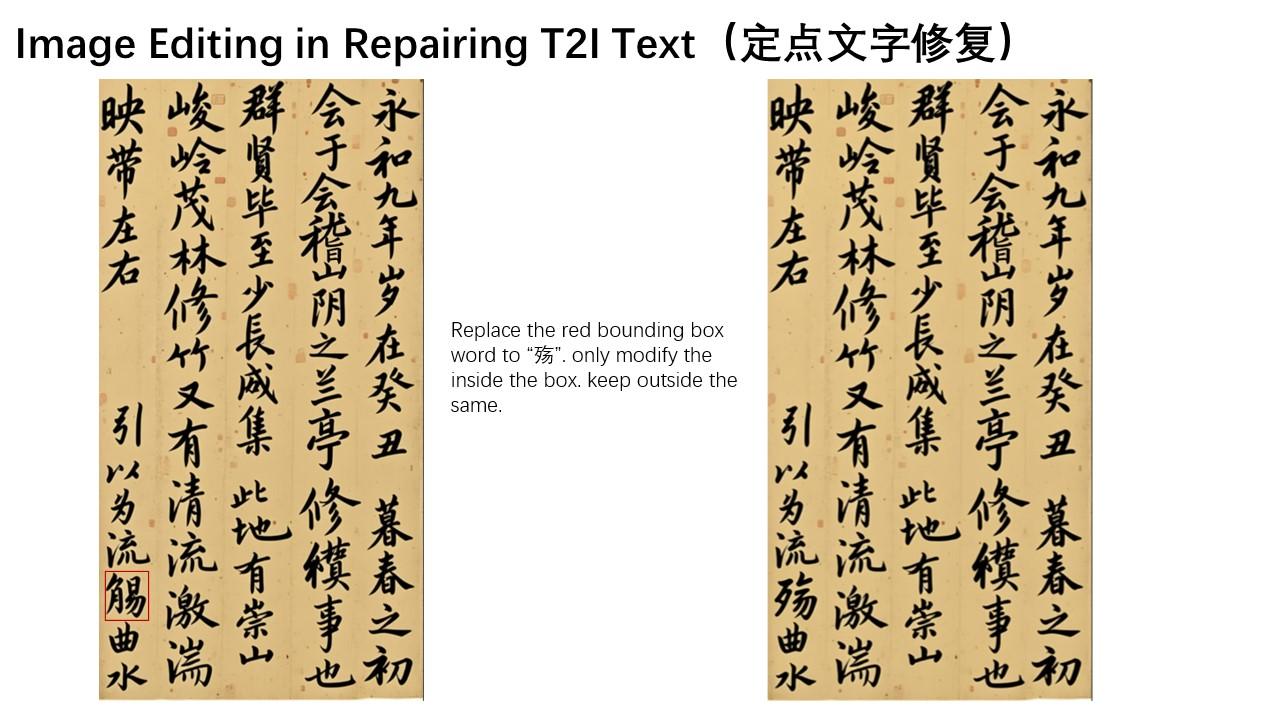

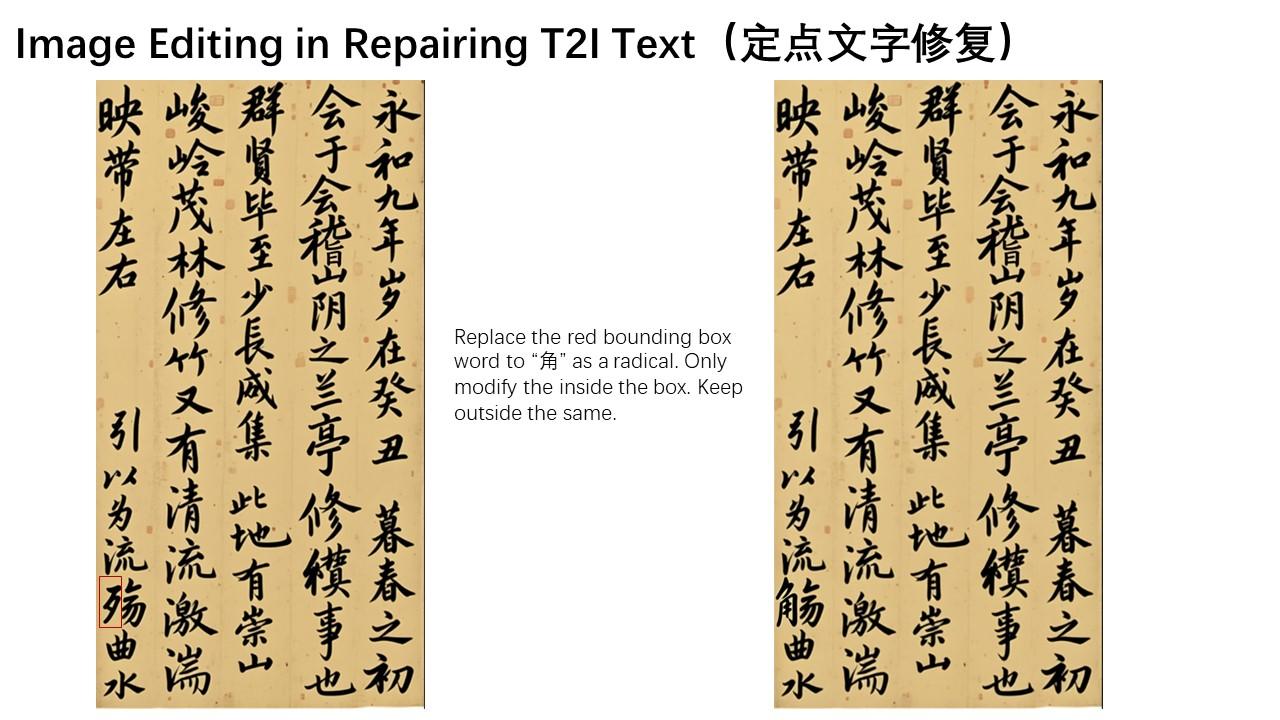

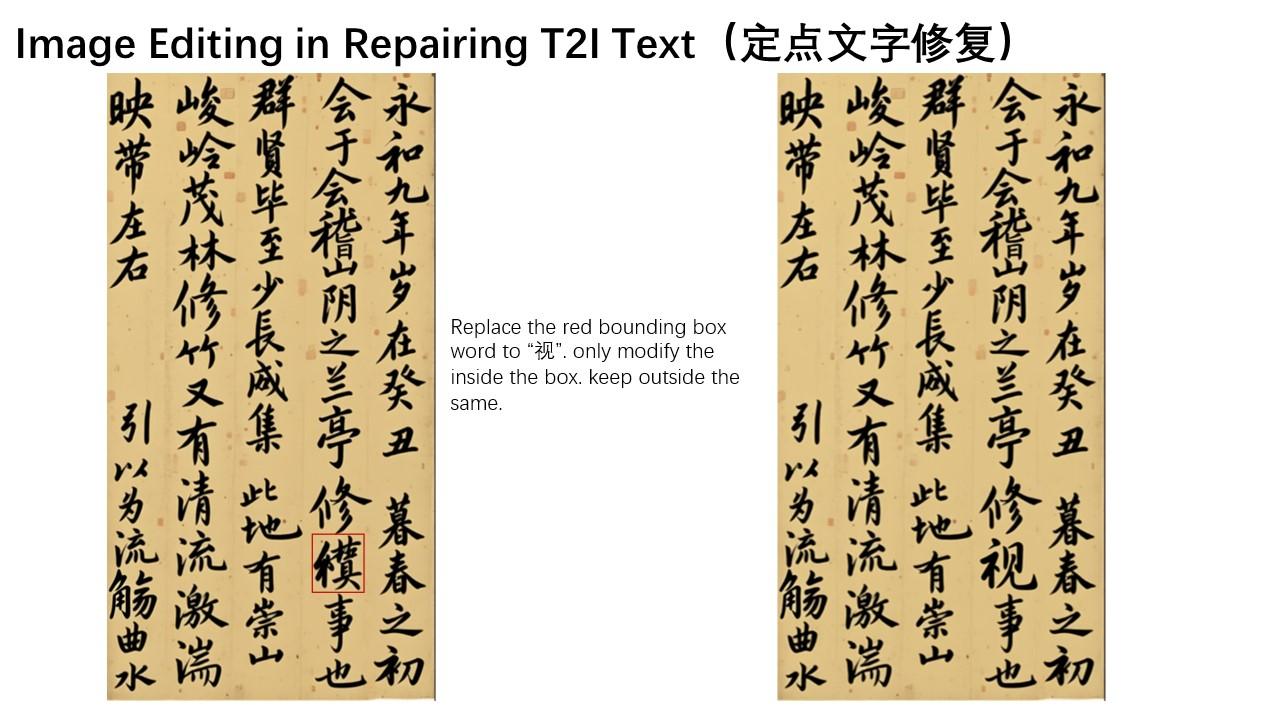

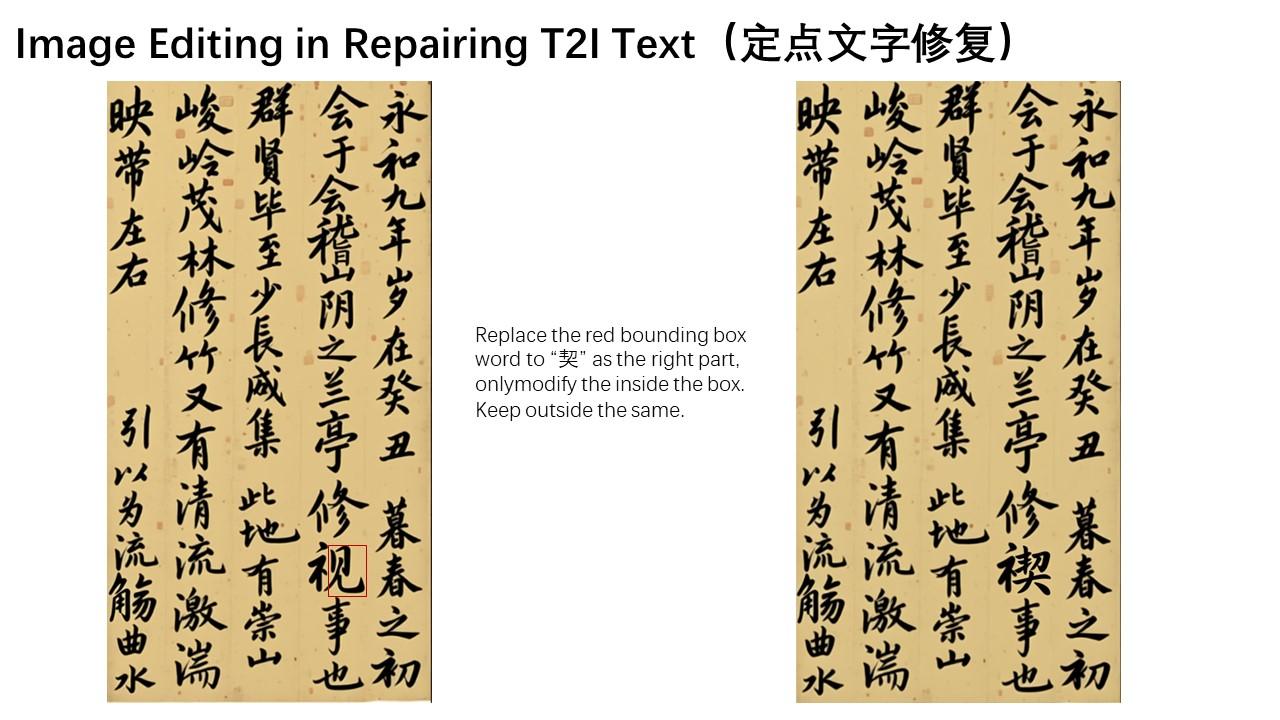

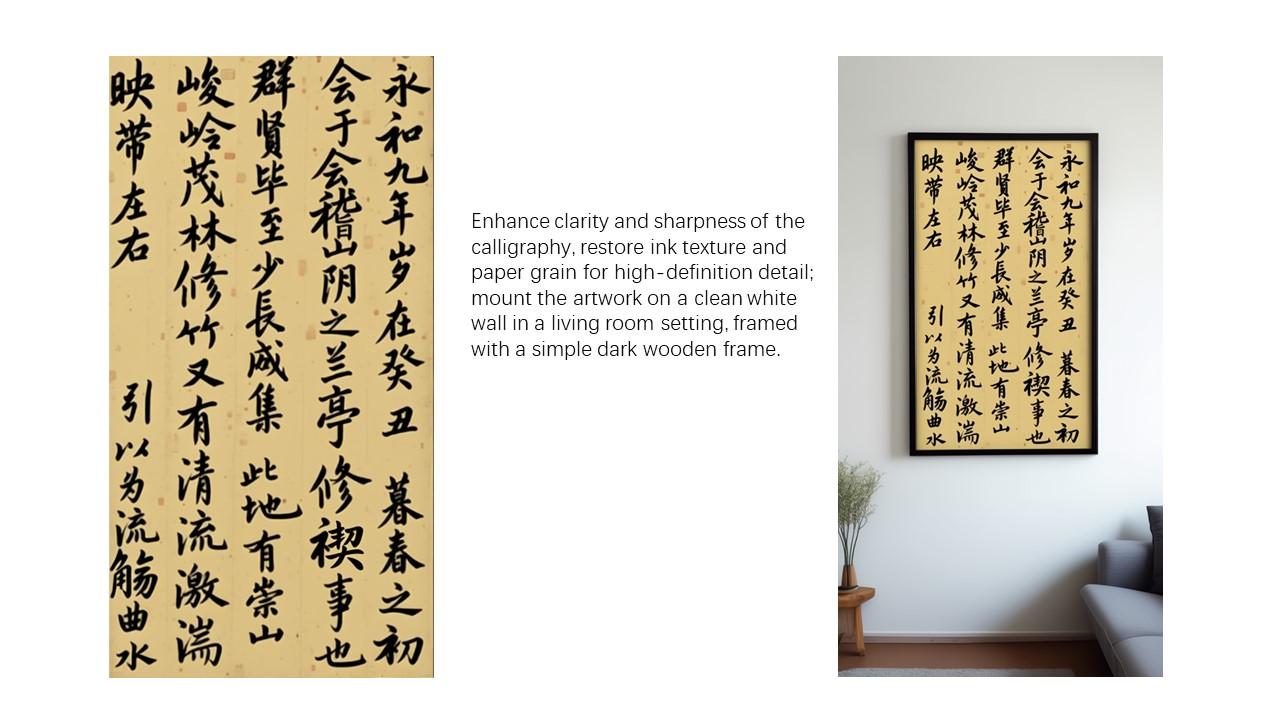

Qwen-Image-Edi(后面我会简称为QIE)可以理解成 Qwen-Image 的“编辑版”。这是一个之前被称之为开源版即梦的超强生图模型。它在原有的生图能力上加了一层“动手改图”的技能,不光能生成图像,还能对现有图片里的文字或元素进行修改。

首先请将你的CFUI更新到v0.3.51,在CFUI的git页面可以下载。如果你使用的是秋叶包,请一定更新到最新更新的版本。

或者通过我发的资料合集网盘链接获取最新的秋叶包或者官方包。如果你不知道git怎么上,请使用【ComfyUI-aki-v2.7z】秋叶包,然后在版本更新里点到最新。

资料合集

进入你的ComfyUI文件夹,把资料合集里【Qwen Image相关】文件夹里的模型,放在如下你本地CFUI的文件夹里。

ComfyUI/ ├── models/ │ ├── diffusion_models/ │ │ └── qwen_image_edit_fp8_e4m3fn.safetensors │ ├── loras/ │ │ └── Qwen-Image-Lightning-4steps-V1.0-bf16.safetensors │ │ └── Qwen-Image-Lightning-8steps-V1.1-bf16.safetensors │ ├── vae/ │ │ └── qwen_image_vae.safetensors │ └── text_encoders/ │ └── qwen_2.5_vl_7b_fp8_scaled.safetensorsqwen_image_edit_fp8_e4m3fn.safetensors

这是 Qwen-Image-Edit 的主模型,核心功能全在这里。加载它,就能用到 QIE 的图像编辑能力。

Qwen-Image-Lightning-4steps-V1.0-bf16.safetensors/Qwen-Image-Lightning-8steps-V1.1-bf16.safetensors

这两个是 加速 LoRA,主要用来 加快出图速度。

- 4 steps:更快,生成时间短,但画质可能略粗糙。

- 8 steps:稍慢,但细节更好。

你可以根据需要选择加载哪个。

qwen_image_vae.safetensors

这是 VAE 编码器,负责处理图片的“外观细节”。没有它,模型只能理解语义,画面可能发虚或失真。

qwen_2.5_vl_7b_fp8_scaled.safetensors

这是 Qwen2.5-VL 模型,负责 理解图像内容和文字。比如当你提示“把海报上的字改成中文”,它要先理解海报上原本写的是什么。

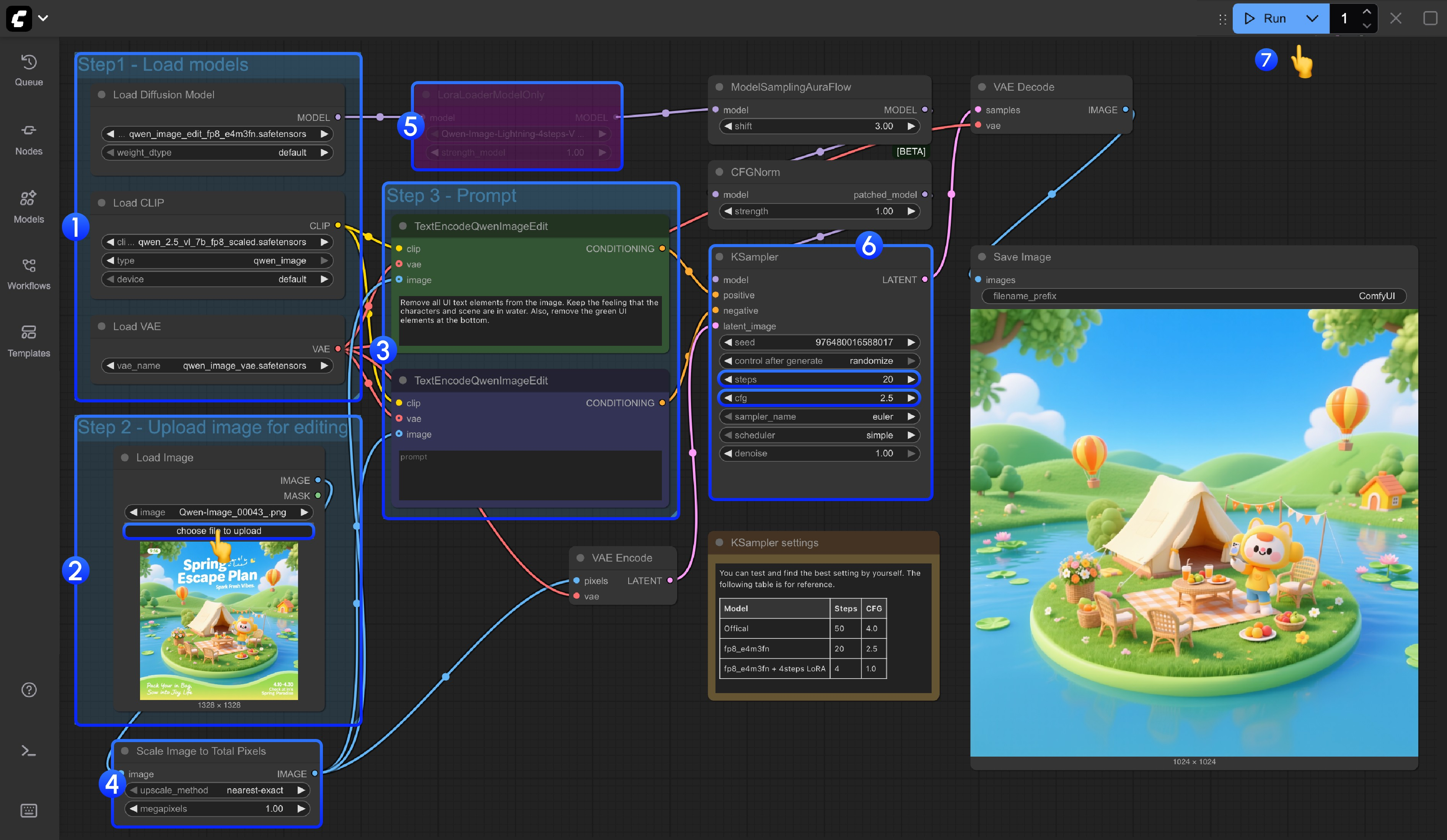

把文件放到正确的地方之后,再把【Qwen Image相关】文件夹里的image_qwen_image_edit.json拖动到你的ComfyUI界面里,就可以开始生图了。

如果成功,你的CFUI会如这个界面这样显示。

左边1区域这里的地方选择正确的模型。在左下角2这里上传你的图片

然后在中间3号绿色这个提示词部分开始书写你准备怎么修改这个图片。

然后还要右键5,点击绕过(bypass)来让这个区域变得不是紫色,这样就可以选择加速LoRA了。

此时大功告成,理论上你就可以做出你的第一张图了。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/223519.html