CSIG-DIAR 2020学术年会系列报道

一、金连文老师《手写及场景文字分析与识别的一些新尝试》演讲笔记

1.1 手写体签名鉴别:

1.1.1 总体趋势

- 传统仍然由于纯深度学习模型,原因有2

= 已有的训练数据集规模很小

= 需要寻求有效的数据增广方式

1.1.2 SynSig2Vec:一种新的深度学习笔迹鉴别新方法

- 只需要真实签名机器形变样本,无需仿冒签名来进行训练

- 提出AP loss,计算网络近似梯度

- 两个数据集的SOTA

1.2 古籍文档书写者笔记鉴别:

- 基于Unet的深度二值化

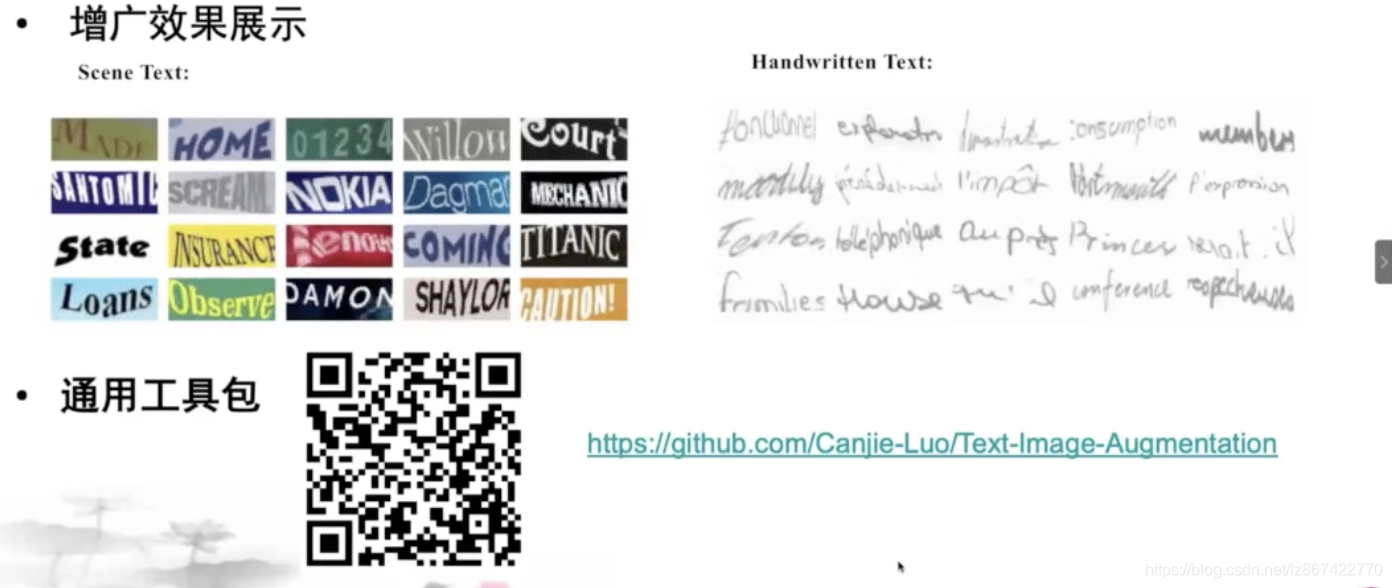

1.3 面向OCR的数据增广及数据合成新方法

- 弹性增广:使用Aster效果更优 ,开源工具包:https://github.com/Canjie-Luo/Text-Image-Augmentation

讯享网

- 增加语料:脱机手写数据合成新方法:关注金连文老师工作

二、白翔老师《2020年场景文字那些事》演讲记录笔记

几篇重点论文

2.1 场景文本检测

2.1.1 DB

2.1.2 Deep Relational Reasoning Graph Network for Arbitrary Shape Text Detection

- 基于Seglink

2.2 场景文本识别

2.2.1

- 基于语言模型

2.1.2 ![]()

- 将语义信息增加到encoder-decoder方法中

2.1.3 ![]()

- 对现有方法做了一些总结,将基于字符分割的方法与基于attention的方法结合在一起,在降低对字典的依赖性的前提下增加泛化性

2.1.4 ![]()

- 自动搜索架构

- 使用跟少的FLOPS,更少的参数量和更高的精度

2.3 端到端场景文本识别:趋势是如何获取弯曲文本的特征

2.3.1

- 使用boundry points做文字特征采样

- 特征更加有效

2.3.2 ![]()

- 检测时采用多尺度FCOS目标融合

2.3.3

- 使用轻量级分割来提取Proposals

- 对于任意形状的提升非常明显

4、场景文本问答VQA

三、文档理解、版面分析相关工作

3.1 背景知识

版面分析的三种任务:

1)表单理解:开放式,无key要求

2)收据理解:通过给定key,理解其中的value

3)文档图片分类

3.2 相关工作

主要有两类:

1)对文本信息和图像信息进行隐形融合:

- 结合预训练的NLP或cv模型的输出

- 使用标签样本监督学习

2)文本和图像信息的深度融合

- 端到端可训练的文本图像信息

- 大规模的未标注样本进行预训练

- 少量样本进行finetuning

3.3 LayoutLM

3.3.1 问题

1)为什么要联合训练?

- 因为现有的一些研究都是集中在单独的信息或者简单的使用内容向量和空间向量,但是没有将二者结合起来

- 文本相对位置和内容是在语义表示上是高度相关的=》存在局部不变形

2)不足且昂贵的标注数据,非标注数据充足

3.3.2 工作

1)数据流

文档 -> OCR/PDF parser -> 建模,将文本信息和位置信息建模为一个二维的向量->其中位置信息使用1000维的向量来表示,文本信息同样1000维的词向量表示,这样一个OCR预测就可以构成成了一个5*1000的二维向量

2)Architecture

3)自监督训练

3)自监督训练

4)下游任务

a)表单理解,开放式

- 任务:看作序列标注

- 数据:FUNSD,Form Understanding in Noisy Scanned Documents,https://guillaumejaume.github.io/FUNSD/

b)receipt理解,隐含key

- 任务:序列标注(B-I-O),标注values

- 数据:ICDAR 2019 Robust Reading Challenge on Scanned Receipts OCR and Information Extraction:https://rrc.cvc.uab.es/?ch=13&com=tasks

c)receipt理解,隐含key

四、文本检测与识别再思考

4.1 现状

1)基于深度学习的文本检测方法

2)基于深度学习的文本识别方法

4.2 再思考

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/118496.html