BCELoss:

- CE和BCE:CrossEntropy。 B:binary,即用于二分类问题

- 输入:

讯享网

- Sigmoid:

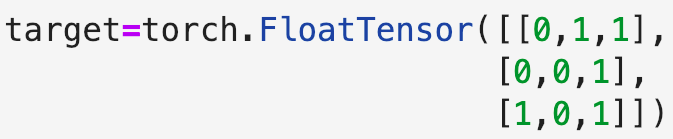

- 目标:

- 损失函数:

BCEWithLogitsLoss:

- 就是把Sigmoid-BCELoss合成一步

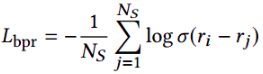

BPRLoss:

- 推荐系统领域有两个问题:Raking和Rating

- Ranking:Top-N的推荐

- Rating:预测物品打分

- 最新研究都是做排序的:

- 排序比较贴近实际

- 评分预测最后训练的模型会遇到过拟合问题(即,最后预测的评分都是一样的)

- 损失函数思想:让正样本和负样本之间的得分之差尽可能地大

- 公式:

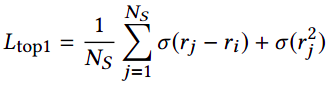

TOP1Loss:

- 一种启发式的组合损失函数

- 第一部分旨在将目标分数提升到样本分数以上

- 第二部分则将负样本的分数降低到零。第二部分其实就是一个正则项,但是并没有直接约束权重,它惩罚了负样本的得分。因为所有的物品都有可能作为某一个用户的负样本。

参考博文:https://blog.csdn.net/_/article/details/

https://blog.csdn.net/ch_/article/details/

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/63075.html