-

在矩阵中表达的作用

特征值和特征向量是矩阵分析中重要的概念,它们用来描述线性变换中的一些特性。

在矩阵中,特征向量代表了一个向量在进行线性变换后的方向不变,只发生了相应的缩放的性质。特征值则表示了这个缩放的比例因子。

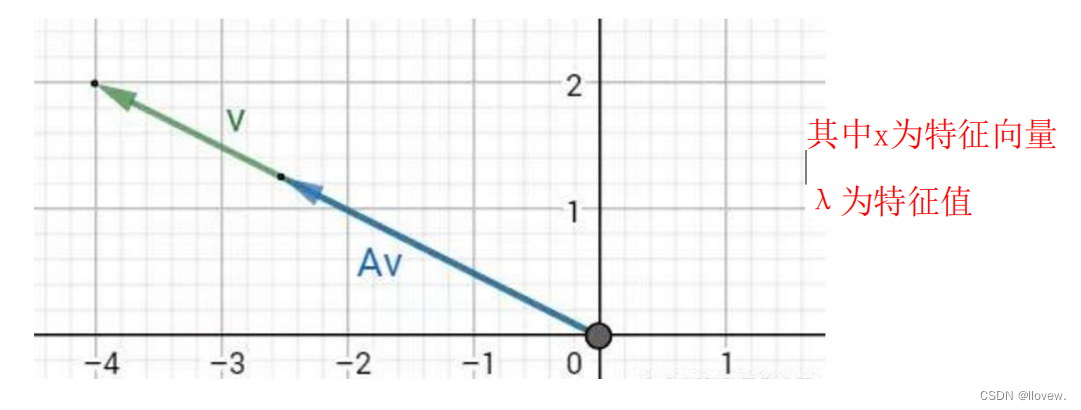

具体来说,对于一个矩阵A,如果存在一个非零向量v使得 A·v=λ·v,其中 λ 是一个标量,那么向量 v 就称为矩阵 A 的特征向量,而 λ 就是对应的特征值。

可以将特征向量理解为矩阵 A 在某个方向上的不变性,即不论如何变换,该方向上的向量都保持不变。而特征值则表示了这个不变性的程度,即在该方向上的缩放比例。

在机器学习中,特征值与特征向量的概念经常与降维和特征选择有关。通过计算矩阵的特征值和特征向量,我们可以找到对数据进行压缩或表示的最优方向,从而减少特征的数量或提取最具代表性的特征。

在降维问题中,数据特征比较多,使用特征值和特征向量对数据进行主成分分析以及压缩。

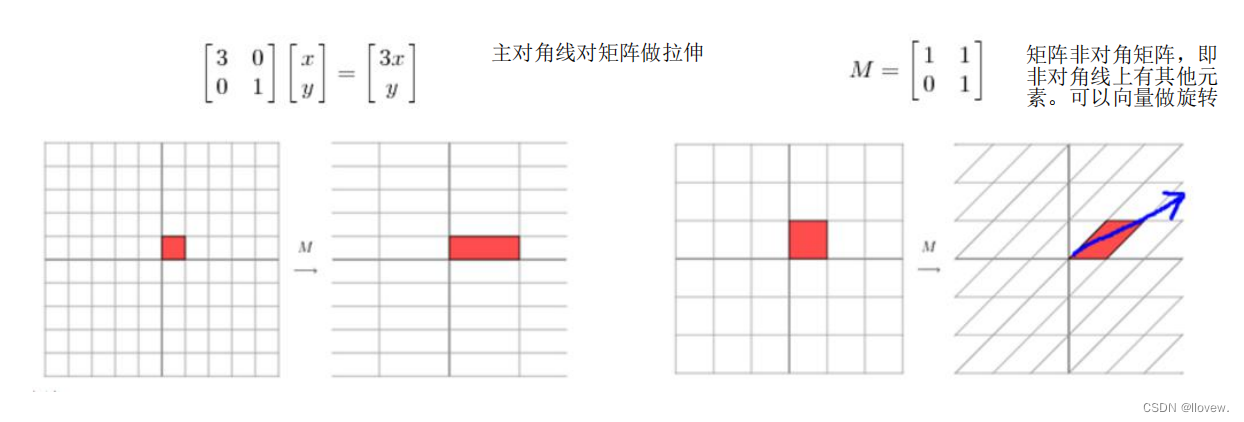

矩阵对向量可以进行拉伸和旋转。

-

特征值和特征向量描述了什么?

特征值和特征向量描述了线性变换中的一些重要特性。具体来说:

1. 特征向量:特征向量是指在线性变换下保持方向不变的向量。换句话说,当一个向量与矩阵进行乘法运算时,它的方向保持不变,只发生相应的缩放。特征向量可以用来表示矩阵变换中的稳定模式或不变性方向。

2. 特征值:特征值是与特征向量相关联的标量值,它表示特征向量在线性变换中的缩放比例。特征值可以告诉我们在特征向量方向上的变化程度或缩放因子大小。特征值可以为零、正数或负数,它们的符号和大小对于描述矩阵的特性非常重要。

总的来说,特征值和特征向量描述了矩阵线性变换中的不变性和缩放性质。它们为我们提供了关于矩阵的结构和特性的重要信息。在机器学习和数据分析中,特征值和特征向量经常用于降维、特征选择、图像处理、推荐系统等领域,以提取数据的最重要特征或减少数据的维度。

例如我们可以把方向当作是特征向量,在这个方向上用了多大力量就是特征值。

-

数学定义:

对于给定矩阵A,寻找一个常数λ和非零向量x,使得向量x被矩阵A作用后,所得的向量Ax与原向量x平行,并且满足Ax=λx

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/59891.html