背景

BN批量归一化是深度学习的一个标志性技术。通过假设数据都处于正态分布,将数据进行归一化,从而加快整个网络的训练性能

但是由于现在任务越来越复杂,导致我们没有足够显存去存放足够多的批量数据

当batch太小的时候,批量归一化效果就没那么好了

结构

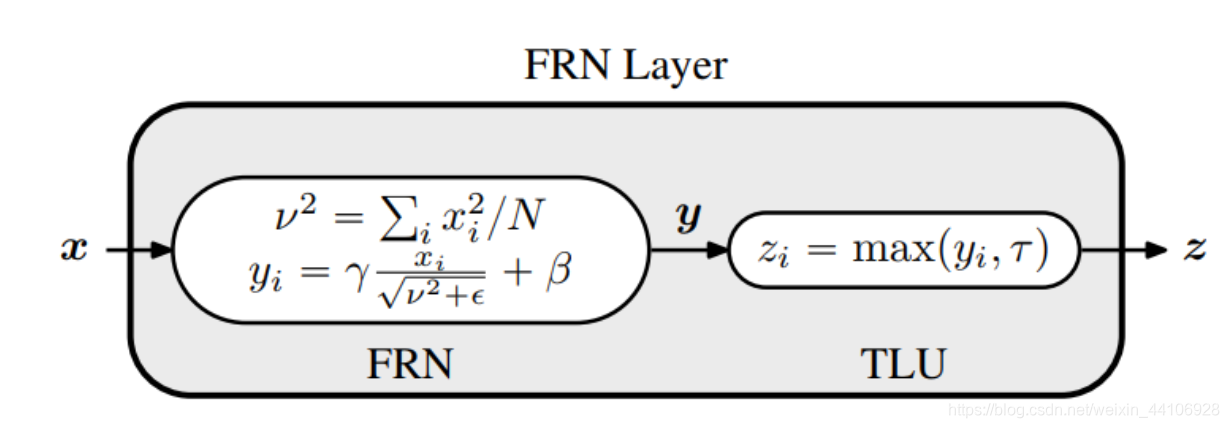

整个结构不复杂,就是通过一个公式计算,最后经过一个阈值限制输出

FRN的归一化维度是在(H,W)上,即对 每个sample,对应的每个channel进行归一化

epsilon 是一个很小的数值。对于常规操作设置为1e-6,但对于1x1卷积这个值效果不太好,作者也建议我们设置epsilon设置为可学习的参数

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/38671.html