OpenClaw 教程应该先回答一个直接问题:OpenClaw 到底适合拿来做什么?简单说,它适合把 AI 从“只回答问题”推进到“按规则执行任务”。它可以围绕 Agent、Skills、工具权限和执行环境,把搜索、读取文件、调用工具、处理流程、生成结果这些动作串起来。

但它不是万能自动化按钮。中文用户最容易踩的坑,是一上来就问“怎么自动跑业务”,却没有先定义任务边界。AI Agent 能执行,不代表每个业务动作都应该交给它执行。尤其涉及账号、文件、API、客户数据和社媒平台时,必须先有权限控制、日志记录和人工复核。OpenClaw 官方站点把它描述为可连接工具并执行任务的个人 AI 助手,GitHub 仓库也强调它是本地运行的 assistant 项目,这说明它的关键价值在“执行”,风险也来自“执行”。

所以这篇文章不把 OpenClaw 讲成神奇工具,而是把它当成一套执行系统来拆。你会看到入门前要准备什么,安装后先做哪些低风险任务,怎么理解 Agent 和 Skills,怎么设计自动化流程,什么时候适合接入 Jumei 的云控、账号环境和 SOP 执行能力。

如果你只是想找一个聊天机器人,OpenClaw 可能显得复杂。如果你已经有重复执行的流程,比如资料整理、网页检查、内容生产、社媒发布前检查、账号任务分配,它就更值得研究。后面如果要落到多账号运营,可以把 Jumei 放在账号环境和任务执行层。

OpenClaw 教程的核心不是“安装一个软件”,而是理解 AI Agent 的执行方式。传统 AI 对话通常停在建议层。你问一个问题,它给一个答案。OpenClaw 这类工具更接近执行层。你给它任务、上下文、工具和边界,它可以尝试把任务拆开,然后一步步完成。

这件事的价值在于减少重复执行。比如运营人员每天要检查资料、整理链接、生成摘要、对比页面、更新任务清单。过去这些动作需要人工在多个工具之间切换。Agent 模式可以把其中一部分流程串起来,让人把精力放在判断和复核上。

但边界也要说清楚。OpenClaw 不是业务策略本身。它不能替你决定哪个市场一定好,也不能保证某个社媒账号一定安全,更不能绕过平台规则。比较稳妥的理解是:它负责执行已经定义清楚的动作,人负责目标、规则、审核和异常处理。

中文用户做 OpenClaw 入门,建议先把它放在“辅助执行”位置。先让它做低风险任务,再逐步增加工具权限。

开始 OpenClaw 入门之前,先准备三类东西:任务、环境和规则。很多人失败不是因为工具难,而是因为任务本身没有被拆清楚。比如“帮我做社媒运营”太大,“读取今天的选题表,按账号分组生成发布检查清单”就更适合 Agent 执行。

环境也要提前想好。Agent 通常需要在某个目录里读取资料、生成文件或调用工具。这个目录里最好只放和当前任务有关的内容。不要把所有账号、密钥、客户资料和历史文件都放进去。权限越大,风险越大。

规则是第三个准备项。你要告诉 Agent 哪些事可以做,哪些事不能做,哪些动作必须先输出计划,哪些动作必须等人工确认。比如可以读取公开资料,可以生成草稿,可以整理表格;但不能直接删除文件,不能提交真实发布,不能改生产数据库。

如果你是跨境团队,还要额外考虑账号环境。浏览器、云手机、代理、登录状态和任务记录最好分开管理。OpenClaw 可以参与流程编排,但账号环境本身更适合交给专门的平台管理。需要移动端账号环境时,可以先看 Jumei 云手机能力,再判断是否适合接入真实任务。

OpenClaw 安装完成后,第一步不应该是接业务账号。更稳的做法是先跑三个测试任务。

第一个测试是读取本地资料。让 Agent 读取一个简单文档,然后总结成清单。这个测试可以验证它是否能正确理解文件、是否会遗漏关键信息、输出格式是否稳定。

第二个测试是生成结构化结果。比如给它一组标题,让它按优先级、意图、适合人群和下一步动作整理成表格。这个测试可以验证它是否适合做运营规划和内容管理。

第三个测试是半自动流程。比如让它读取一篇草稿,检查标题、关键词、内链和事实风险,然后输出修改建议,但不直接发布。

如果这三步都不稳定,不建议继续扩大自动化范围。先调整提示词、目录结构、权限边界和输出格式。OpenClaw 官方资料和 GitHub 项目都强调它可以连接工具执行任务,因此团队更要先小范围验证。

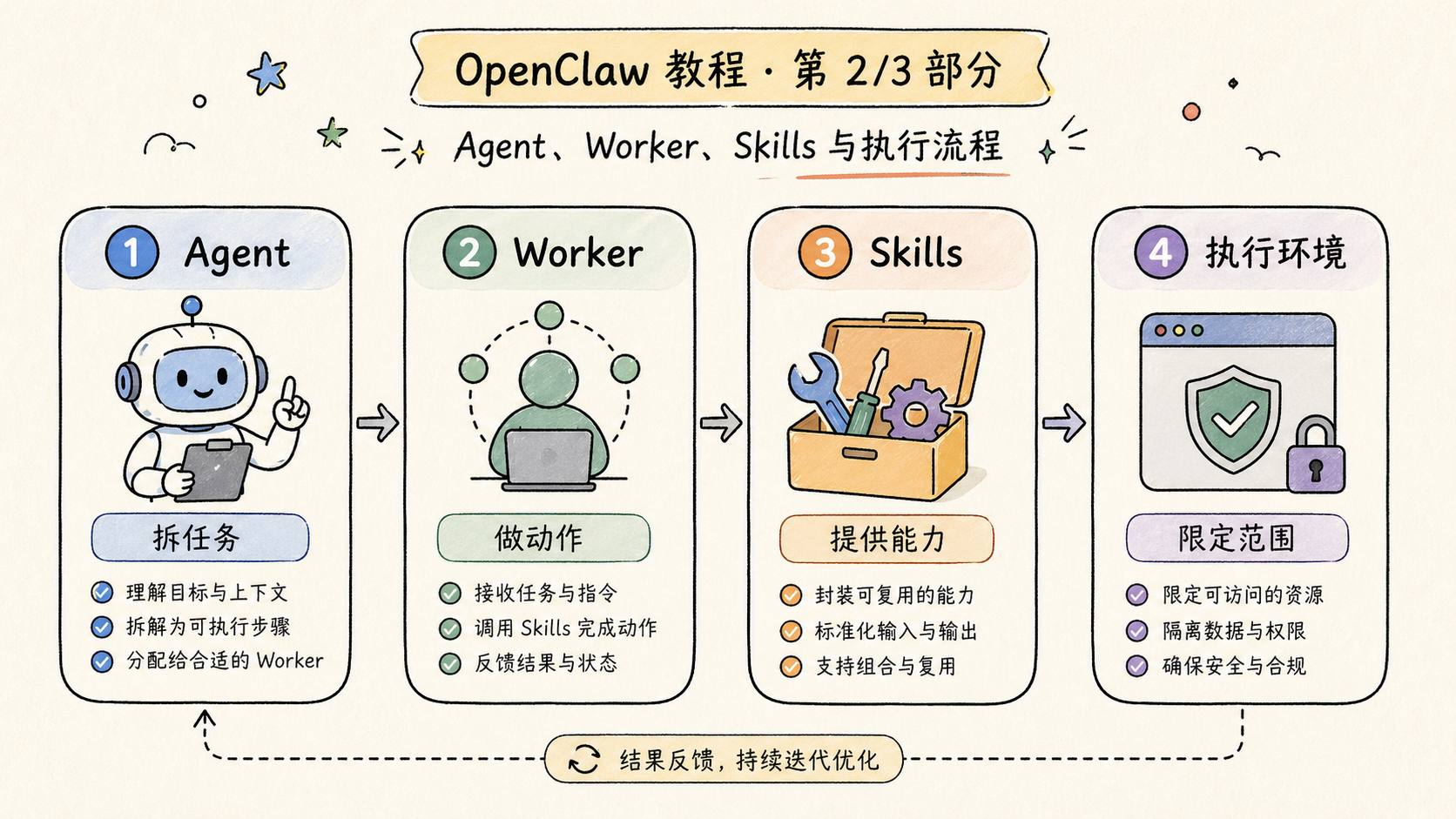

理解 OpenClaw 自动化,先要把几个概念分开。Agent 可以理解为执行任务的角色。它接收目标,拆分步骤,决定下一步要用什么工具。Worker 更像执行单元,适合处理具体任务。Skills 是能力包,告诉 Agent 某类任务应该怎么做、用什么工具、遵守什么规则。

执行环境则是 Agent 能看到和能操作的范围。它可能包括本地目录、浏览器、命令行、API、账号环境或第三方工具。这个范围越大,自动化能力越强,风险也越高。

对中文团队来说,最实用的做法不是一开始就追求复杂架构,而是按业务角色拆 Agent。比如内容团队有“选题分析 Agent”,运营团队有“发布检查 Agent”,技术团队有“部署检查 Agent”。每个 Agent 只拿自己需要的资料和工具。

这样做有两个好处。第一,问题更容易排查。第二,权限更容易控制。内容 Agent 不需要生产数据库权限,发布检查 Agent 不需要客户数据,线索整理 Agent 不需要服务器操作权限。

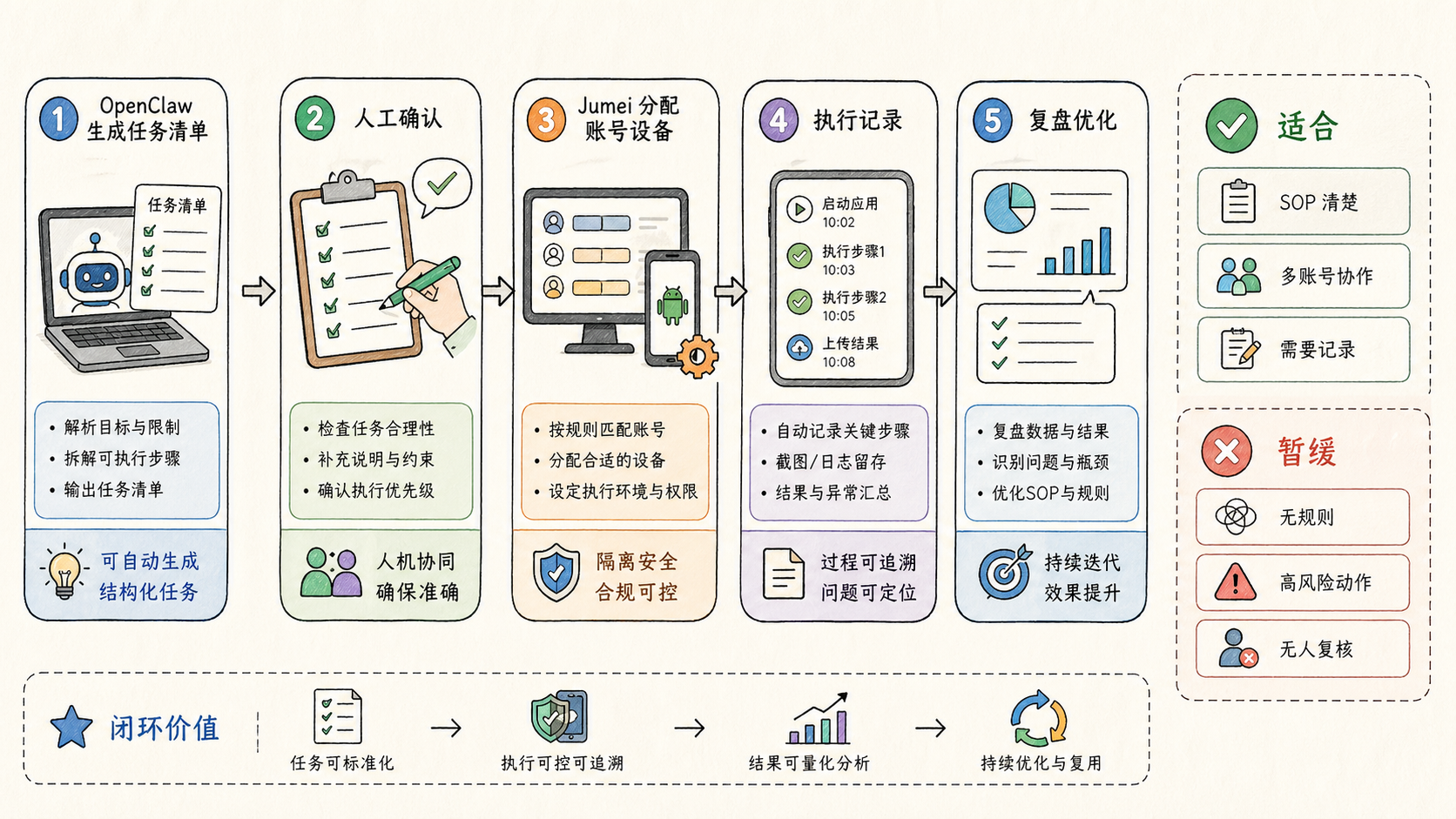

Jumei 这类平台可以放在执行环境层理解。它不是替代 OpenClaw 的 Agent 思考,而是给跨境团队提供账号、设备、移动端环境和 SOP 执行承载。当 Agent 需要把任务落到移动端社媒账号、私域动作或多账号流程时,Jumei 可以作为更可控的执行载体。如果任务涉及私域承接和线索记录,可以把 Jumei 获客与私域承接能力 放进后续流程设计。

OpenClaw 使用教程如果只讲命令和配置,价值有限。真正能落地的是把业务 SOP 变成 Agent 可以理解的执行步骤。

比如一个跨境社媒团队要做短视频账号矩阵。人工流程可能包括选题、写脚本、分配账号、检查素材、发布前复核、发布后记录数据。这个流程不能直接丢给 Agent 一句话完成,更合理的做法是拆成多个小任务。

这些动作里,有些适合 OpenClaw 做,有些必须人工复核。整理资料和生成检查清单适合自动化;是否发布、是否换账号策略、是否扩大投放,仍然应该由人判断。

这个顺序很重要。很多自动化失败,是因为团队跳过 SOP 定义,直接让 AI 接管执行。正确顺序应该是先把人工流程跑顺,再让 Agent 接手可重复部分。

OpenClaw 自动化更适合已经有稳定流程的团队。比如内容整理、仓库检查、运营日报、账号任务记录、线索归类。这些流程都有明确输入、明确输出和复核标准。

它不太适合流程还没定型的团队。如果你还不知道自己要做什么,只是希望 AI 自动探索所有方向,结果通常会很散。Agent 可以帮你试错,但不能替你建立业务判断。

还有一种情况也要谨慎:高权限、高风险、强合规任务。比如直接操作真实客户数据、改线上配置、批量登录账号、自动提交付款、自动发布敏感内容。这类任务不是不能自动化,而是需要更严格的权限、日志、审批和回滚。

对 Jumei 用户来说,比较现实的路径是把 OpenClaw 放在“流程规划和内容执行前检查”层,把 Jumei 放在“账号环境和移动端执行承载”层。前者负责把任务想清楚,后者负责让任务在多账号、多设备、多成员环境里可执行、可追踪、可复盘。团队还可以把 Jumei 官网 当成能力总览入口,再按需要拆到云手机、指纹环境和社媒矩阵流程。

第一个错误,是把 OpenClaw 当成人来管理。Agent 可以执行,但它没有业务责任。业务责任仍然在团队。谁允许它读文件,谁批准它调用工具,谁确认输出可以进入下一步,都要提前定好。

第二个错误,是一开始给太多权限。很多人为了省事,把目录、浏览器、API、命令行都打开。短期看方便,长期看很难排查。更稳的方式是按任务逐步授权。

第三个错误,是没有日志。自动化越复杂,越需要记录。至少要记录输入、执行步骤、输出文件、失败原因和人工修改点。没有日志,后面无法知道是提示词问题、资料问题、工具问题,还是业务规则问题。

第四个错误,是把一次成功当成稳定。Agent 偶尔完成一次任务,不代表可以批量执行。要看多次结果是否一致,出错后是否能恢复。

排查时可以按这个顺序看:

- 任务是否写得太大。

- 输入资料是否缺失。

- Agent 是否拿到了不该拿的权限。

- 输出格式是否提前规定。

- 是否有人工确认点。

- 是否记录了失败原因。

- 是否能回滚到上一步。

如果这些问题没有解决,不建议把 OpenClaw 接入真实账号或生产流程。先用样例数据跑通,再逐步扩大。

确认 OpenClaw 教程是否跑通,不是看你装没装成功,而是看它是否能稳定完成一个真实但低风险的任务。

一个合格的试运行结果,至少要满足五个条件。第一,任务输入清楚。第二,Agent 输出可复核。第三,结果能被人直接使用或少量修改后使用。第四,失败时能知道卡在哪里。第五,下一轮能根据记录继续优化。

如果你用它做社媒运营辅助,可以用一个小闭环测试:输入三条选题,让 Agent 生成账号分配建议、脚本检查清单和发布后复盘表。人工检查后,再决定是否接入真实账号环境。这个测试不涉及高风险动作,却能判断它是否理解你的业务流程。

如果你用它做 SEO 内容辅助,可以让它先读取关键词表、标题库和品牌语气,再生成提纲、事实检查清单和内容评分建议。真正发布前仍然要走人工或系统审核。Google Search Central 对 helpful content 的建议也强调内容应服务真实用户,而不是只为搜索引擎制造页面。

比较可靠的成功标志是:团队不再只说“AI 很聪明”,而是能说清楚它在哪个步骤节省了时间,降低了哪类漏项,保留了哪些人工审核点。

如果你只是学习 OpenClaw,本地试运行就够了。如果你要把它放到跨境社媒矩阵、私域引流或多账号执行里,就需要考虑 Jumei 这类平台。涉及项目本身能力时,应优先查看 OpenClaw 官方站点 和 OpenClaw GitHub 仓库,不要只根据二手教程判断功能边界。

结合方式不要一步到位。可以先让 OpenClaw 负责规划和检查,让 Jumei 负责账号环境、云手机、SOP 任务、执行记录和团队协作。这样分工更清楚,也更容易控制风险。

一个可落地的路径是:

这个路径的好处是人仍然掌握关键决策。Agent 负责减少重复整理,Jumei 负责承载多账号和移动端执行,人负责判断是否继续、暂停或扩量。

适合,但要从低风险任务开始。不要一上来就接账号、API 或生产环境。先做资料总结、表格整理、草稿检查这类任务,更容易建立正确理解。

先学任务边界。你要知道哪些事让 Agent 做,哪些事必须人工确认。然后再学 Agent、Skills、工作目录和工具权限。

不建议直接做。安装只是开始。真正上线前,还要经过样例任务、低风险试运行、人工复核和日志记录。

一般不适合这样理解。它更适合替代重复整理和检查动作,不适合替代市场判断、账号策略、内容方向和最终发布责任。

可以把 OpenClaw 理解为 Agent 编排和任务执行思路,把 Jumei 理解为跨境社媒账号、云手机、指纹环境和 SOP 执行承载。两者结合时,最好按“规划检查”和“环境执行”分工。

不是。Skills 越多,能力越多,风险和排查成本也越高。建议按任务需要安装,并给不同 Agent 设置不同范围。

不要只写概念。要写适用场景、操作步骤、常见错误、排查方法和成功标准。中文用户更需要知道“我下一步该怎么做”。

可以参与辅助流程,比如选题整理、脚本检查、任务分配和复盘建议。但真实账号环境、移动端执行和团队协作需要更严格的系统承载,不能只靠一句提示词完成。

OpenClaw 教程的重点不是把工具讲复杂,而是让中文用户知道它适合放在哪一层。它更像 AI Agent 的执行框架,适合处理有输入、有规则、有输出、有复核的重复任务。

真正落地时,先从小任务开始。先让它读资料、生成清单、检查草稿,再逐步接入更复杂的工具。不要一开始就给高权限,也不要把它当成业务负责人。

如果你的目标是跨境社媒矩阵、私域引流或多账号执行,OpenClaw 可以负责规划、拆解和检查,Jumei 可以负责账号环境、云手机、SOP 执行和团队记录。两者组合的价值,不在于“全自动”,而在于让流程更清楚、执行更可追踪、复盘更容易。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/282501.html