一幅包含《出师表》全文的书法作品。其墨色有着浓淡变化,同时带有落款和钤印,整体居然没有任何错漏之处。

我盯着屏幕愣了好几秒。因为我清楚,在这之前,AI写中文是什么样的水平——字形扭曲、笔画缺失、排版错位,跟鬼画符差不多。而现在?它写出来的内容,居然可以直接跳过人工修正,直接交付。

这篇文章,会从技术架构到底层原理,从API代码到提示词工程,从实测效果到行业冲击,给你一个完整到不需要再看第二篇的深度解析。不管你是开发者、设计师、电商从业者,还是纯粹被刷屏吸引来的好奇宝宝,都能在这找到你想要的东西。

我不打算先去讲解相关的技术,先给你去看一些东西。

1.1 一张《出师表》书法,让中文互联网集体沉默

【图片来源】OpenAI官方博客 - ChatGPT Images 2.0多语言渲染展示(AI生成图片)

这段内容是GPT-Image-2生成的中文内容。我第一次看到的时候,反应是——“等等,这真的是AI生成的?”

对比一下DALL·E 3生成的中文:字形扭曲得就像小学生第一次使用毛笔,笔画不是多了就是少了,排版更是随心所欲。

对比一下DALL·E 3生成的中文:字形扭曲得像小学生第一次用毛笔,笔画不是多了就是少了,排版更是随心所欲。准确率大概在70%左右,也就是10个字里会错3个,这样的效果你敢用?

GPT-Image-2呢?99%以上。不是"偶尔不错",是"稳定地几乎不出错"。

这意味着什么呢?它意味着AI生图从“只能看”变成了“可以用”。像海报、UI截图、信息图、漫画……这些需要文字参与的设计,终于能够由AI直接来产出了。

1.2 由AI合成的仿真截图——这是一个需要严肃加以对待的风险

4月22日,有多条由AI合成的仿真社交媒体截图在网络当中得到了广泛的传播。

这些截图的逼真程度让人感到担忧——UI元素、账号名称、评论内容以及时间戳几乎无可挑剔,大量网友在没有进行核实的情况下就信以为真,相关企业也不得不出面进行澄清。

有一位AI领域的从业者在接受相关媒体的采访时提到:在这之前要生成类似的图片还是存在一定的技术门槛,不过GPT-Image-2已经把这类门槛几乎降到了零。

说实话,这让我有点后怕。不是怕技术太强,是怕——当识别仿真图像的视觉认知负荷降为零的时候,你的大脑会直接把图像当作真实记录来接受。

我不会在这里展示或是描述这些仿真截图的具体细节。但我想要提出一个判断:“有图有真相”的时代,正在面临前所未有的挑战。这一点,我后面会专门展开来聊。

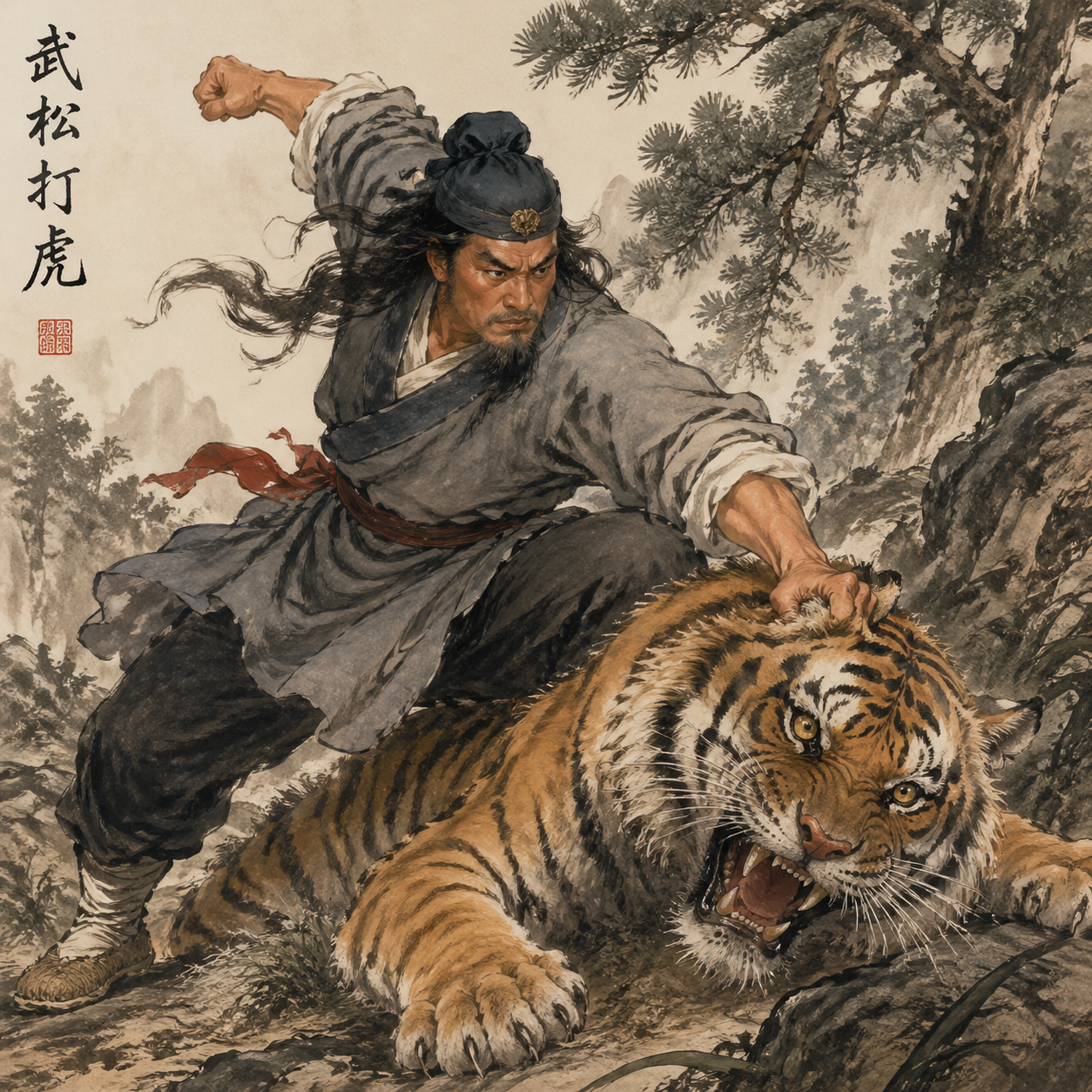

1.3 一张武松打虎图——复杂排版也能一次搞定

【图片来源】由ai大模型GPT-Image-2生成

【图片来源】由ai大模型GPT-Image-2生成

这让我真正意识到“这不是画图变好了,这是AI开始理解排版逻辑了”的案例。

一张武松打虎图:文字标注、色彩分区以及层级关系,全部都正确。以前AI在制作信息图的时候,箭头乱指、文字溢出、分区重叠是很常见的情况。而现在,它好像真的能够“看懂”你所要表达的内容。

这背后反映的是一种质变:AI不再只是能够画得像,而是可以做到画得对。

好了,效果看完了。现在来聊点硬核的内容——为什么GPT-Image-2可以做到这些?

这部分我会尽量用大白话来讲,但如果你是开发者,里面也有足够的技术细节让你过足瘾。

2.1 扩散模型为什么写不对字?——"闭眼画画"的根本缺陷

什么意思?就是模型在去噪的过程当中,天空、建筑、人物以及文字是一起从噪声当中冒出来的。它没有“先写第一个字、再写第二个字”的顺序概念。文字在它的眼里,跟一块“像文字的纹理”没有本质区别。

2.2 自回归范式:也就是像写文章一样去“写”图像

GPT-Image-2做了一次范式级切换。

它的核心思路是:把图像变成一种“语言”,然后运用语言模型的方式去“写”它。

具体来说,借助一个叫作视觉分词器也就是Visual Tokenizer的工具,图像会被拆分成一系列离散单元,就如同文本被拆分成token一样。之后,语言模型就可以像撰写文章那样,从前到后、逐token来生成图像。

这一下子解决了好几个问题:

- 有了顺序:可以"先写第一个字、再写第二个字"

- 有了上下文约束:写后面的字时,前面的字已经确定了

- 语言模型可以当"规划器":先拆解需求(哪里是标题、写什么内容、占什么位置),形成隐式布局草图,再由视觉部分在草图约束下渲染

比喻一下:先列大纲,再写正文,最后润色——跟人写文章一模一样。

关于具体架构,OpenAI并未公开全部的细节。但从研究负责人陈博远的学术代表作Diffusion Forcing也就是NeurIPS 2024可以推断,GPT-Image-2很可能融合了自回归的序列生成与扩散模型的长程引导优势,也就是既有了“一步步写”的精确性,又保留了“整体协调”的能力。技术分析博客也指出,这很可能是一种多阶段递进生成的方式,而并非单次自回归遍历。

2.3 三大架构创新:让"想好再画"真正落地

仅靠自回归还远远不够。GPT-Image-2至少还具备三个关键的创新点:

创新1:原生多模态MoE(混合专家模型)

团队成员Weixin Liang在Meta实习期间的代表作Mixture-of-Transformers,引入了模态解耦的MoE以及解耦注意力。简单来说就是:不同“专家”去处理不同类型的视觉任务,文字渲染专家、色彩专家、构图专家各自承担相应的职责。在进行推理时只激活相关的专家,这样既高效又精准。

创新2:单阶段推理

DALL·E 3需要先理解提示词,再生成图像,也就是包含两个阶段。那GPT-Image-2呢?它的理解与生成共享同一套语义空间,可以一步到位。这也就是为什么它能边想边画,理解和生成并不是割裂的两件事,而是同一个过程。

创新3:递归输出验证

生成后可以开展自我复核工作,也就是对文字是否正确、布局是否合理以及细节是否遗漏等内容进行检查。完整的Thinking模式流程一共包含八个步骤,分别是创建、打草稿、生成初稿、搭建场景、打磨细节、收尾、润色以及微调。

这是“第一个会思考的图像模型”的技术基础。它不会在画完之后就直接交卷,而是会在画完之后再去检查一遍。

2.4 视觉分词器:让图像进入语言的世界

图像→离散token→语言模型处理→token→图像

2.5 13人4个月的传奇:团队、路线与取舍

说到这,不得不提这支团队。

13个人,4个月,做出断层领先的成果。

陈博远在演示过程当中为家乡无锡制作了一张海报,并且为首尔的队友制作了韩文海报,还为来自Bangladesh的队友制作了孟加拉语海报——每一张海报当中的文字渲染都精准无误。

中科大博士毕业的Jianfeng Wang负责指令遵循以及世界知识理解相关的工作。他让新模型来画时钟,旧模型所画的永远指向10:10,这是因为网络上的钟表广告图几乎都是10:10,而GPT-Image-2画出的2:25、3:30、9:10、7:45,全部都十分精准。

技术部分已经讲解完毕,接下来我们来看一些实际的内容。我花费了大量的时间去整理各个渠道的评测以及实测的结果,为你提供一个不吹捧也不贬低的真实评价。

3.1 中文文字渲染:从"鬼画符"到99%准确率

实测案例:

- 《出师表》全文书法——字迹工整,零错漏

- 数学试卷——题目、答案、学号全部正确

- 奶茶店菜单——分类、品名、价格排版完美

- 苏轼《水调歌头》书法——墨色浓淡变化、落款钤印全到位

我的判断:对于绝大多数商业场景来说,GPT-Image-2的中文渲染已经可以满足使用需求了。但要是你所做的是法律文件、合同条款这类对文字准确率要求达到100%的场景,还是建议开展人工复核的工作。

3.2 电商商品图:透明背景+批量生成,直接交付

这是我觉得GPT-Image-2最"即插即用"的场景。

透明背景输出——新功能,DALL·E 3没有:

from openai import OpenAI import base64 from pathlib import Path client = OpenAI() result = client.images.generate( model="gpt-image-2", prompt="高端护肤品产品图,白色瓶身,金色盖子,柔光打光", size="1024x1024", quality="high", output_format="png", # 透明背景必须PNG background="transparent" # 关键参数! ) image_bytes = base64.b64decode(result.data[0].b64_json) Path("product_transparent.png").write_bytes(image_bytes) 实测效果:白色背景、柔光打光、产品居中、阴影自然——无敌。

不足:产品细节偶有"幻觉"——颜色可能偏差、材质可能写错。建议人工复核关键参数。

3.3 海报与信息图:设计师的效率革命

这种大量信息+美感+准确性的三角组合,说实话,以前只有比较不错的视觉设计师能做到。

【图片来源】由ai大模型GPT-Image-2生成

【图片来源】由ai大模型GPT-Image-2生成

还有一张ECLIPSE概念乐队的海报,上面所有人都穿着黑色系的造型,采用了侧逆光加上柔焦的拍摄手法,整体色调偏向冷灰蓝,和“日食”的概念完全契合。脸部的细节、发丝、饰品的光泽以及布料的褶皱质感……每一个人都有着不一样的pose和表情。

关键发现:信息图是GPT-Image-2最惊艳的场景之一,因为它是"理解+排版+渲染"三位一体的能力体现。

不足:精确箭头或部件标注可能需要人工微调。OpenAI自己也承认,标签和图表中的精确标注可能需要人工审查。

3.4 UI原型与社交截图:以假乱真的双刃剑

GPT-Image-2生成的App界面,其逼真程度究竟如何?

它会把正确的布局、正确的按钮样式、正确的图标位置都绘制出来,甚至连各个视频的封面也都处于合理的状态。要是生成抖音界面,就连BGM和歌手信息也能做到一一对应。要是生成微信朋友圈,评论区的头像、昵称以及时间戳也全都合理合规。

正面价值方面,把产品经理快速产出原型,设计师快速拿出方案的情况,效率得以提升,整体提升幅度十分巨大。

风险:AI合成仿真截图的泛滥。爱范儿的分析写得很到位——让GPT-Image-2成为最强生产力工具的那组能力,也就是精确的文字渲染、可信的UI布局、真实世界的视觉词汇,恰好也是制造虚假信息的潜在工具集。这也是为什么我认为,对这类能力的讨论必须同时关注风险防控。

3.5 竞品横评:GPT-Image-2 vs Midjourney V7 vs Nano Banana Pro

我的选型建议:

- 凡涉及文字精排、中文字体、复合版式的商业物料→GPT-Image-2,有明显优势

- 纯艺术创作、电影质感、概念图→Midjourney V7,审美天花板

- 速度和价格敏感、Google生态集成→Nano Banana Pro

- 需要推理、多图一致性、联网搜索→目前只有GPT-Image-2支持

一句话总结:Midjourney是艺术家的工具,GPT-Image-2是普通人的设计团队。

这部分是给开发者的硬菜。每一段代码都是可以直接运行的完整示例,同时附带详细的注释以及踩坑的相关提醒。

4.1 环境准备

pip install openai 你需要一个OpenAI API Key,这个可以在OpenAI官网的开发者平台当中去申请。完成充值之后就可以把它拿来使用。

速率限制:比文本模型严格,建议并发不超过3个,每次间隔2秒。

4.2 基础图像生成

import base64 from openai import OpenAI from pathlib import Path client = OpenAI() # 默认读取环境变量 OPENAI_API_KEY # 基础图像生成 result = client.images.generate( model="gpt-image-2", prompt="一只穿着宇航服的柴犬站在月球表面,背景是蓝色的地球,写实风格", size="1024x1024", # 支持:1024x1024, 1536x1024, 1024x1536 等 quality="medium", # low / medium / high output_format="png", # png / jpeg # output_compression=85, # 仅jpeg有效,85是不错的平衡点 # background="transparent" # 透明背景,仅PNG支持 ) # 保存图片(默认返回base64,不是URL!) image_bytes = base64.b64decode(result.data[0].b64_json) Path("output.png").write_bytes(image_bytes) print("图片已保存为 output.png") 参数详解:

size 1024x1024, 1536x1024, 1024x1536, 2048x1152 等 宽高比从3:1到1:3

quality low / medium / high 质量越高越贵,low约

\(0.006/张,high约\)0.083/张

output_format png / jpeg 需要透明背景必须选png

output_compression 0-100 仅jpeg有效,85是推荐值

background transparent / 不设 透明背景,仅PNG格式支持

计费提醒:GPT-Image-2是按照Token来进行计费的,并不是按照图片的张数来计费的。输入部分的定价是每百万token五美元,输出部分的定价是每百万token四十美元,具体的定价以OpenAI官方的定价页面为准。在medium质量的情况下,一张1024×1024的图片费用大约在0.027美元到0.053美元之间。

4.3 图像编辑与参考图修改

from openai import OpenAI import base64 from pathlib import Pathclient = OpenAI()

# 单张参考图编辑 result = client.images.edit(

model="gpt-image-2", image=open("product_photo.jpg", "rb"), # 上传参考图 prompt="将产品精修优化,重新打光,白色背景,柔光效果", size="1024x1024", quality="medium" )

image_bytes = base64.b64decode(result.data[0].b64_json) Path(“product_refined.png”).write_bytes(image_bytes)

Mask遮罩编辑(只修改图片的特定区域):

# 创建遮罩(白**域会被重新生成) from PIL import Imageimg = Image.open(“photo.jpg”) mask = Image.new(“RGB”, img.size, (0, 0, 0)) # 黑色=保留 # 在需要修改的区域画白色… mask.save(“mask.png”)

result = client.images.edit(

model="gpt-image-2", image=open("photo.jpg", "rb"), mask=open("mask.png", "rb"), # 遮罩 prompt="把背景换成海滩日落", size="1024x1024" )

image_bytes = base64.b64decode(result.data[0].b64_json) Path(“edited_photo.png”).write_bytes(image_bytes)

多参考图编辑(通过HTTP API的image[]参数):

curl –request POST –url https://api.openai.com/v1/images/edits –header “Authorization: Bearer $OPENAI_API_KEY” –header “Content-Type: multipart/form-data” –form model=gpt-image-2 –form ‘prompt=将图1的产品放入图2的场景中’ –form ‘image[]=@product.jpg’ –form ‘image[]=@scene.jpg’ –form size=1536x1024 –form quality=medium 提示:截至本文写作时,OpenAI Python SDK的

images.edit()方法对多图输入的支持仍在迭代中。如需传入多张参考图,建议直接使用HTTP API的image[]参数,或关注SDK最新版本更新。

4.4 透明背景输出(电商必备)

from openai import OpenAI import base64 from pathlib import Pathclient = OpenAI()

result = client.images.generate(

model="gpt-image-2", prompt="高端护肤品瓶身产品图,柔光,专业摄影", size="1024x1024", quality="high", output_format="png", # 必须PNG! background="transparent" # 关键参数 )

image_bytes = base64.b64decode(result.data[0].b64_json) Path(“product_transparent.png”).write_bytes(image_bytes)

踩坑提醒:透明背景必须同时满足两个条件——output_format=“png” + quality至少medium。否则可能输出白底。

4.5 批量生成与队列管理

import time import base64 from openai import OpenAI from pathlib import Pathclient = OpenAI()

prompts = [

"运动鞋产品图,白色背景,正面视角", "运动鞋产品图,白色背景,侧面视角", "运动鞋产品图,白色背景,45度角", "运动鞋产品图,街拍风格,城市背景", "运动鞋产品图,运动场景,跑步姿态", ]

Path(“batch_output”).mkdir(exist_ok=True)

for i, prompt in enumerate(prompts):

try: result = client.images.generate( model="gpt-image-2", prompt=prompt, size="1024x1024", quality="medium" ) image_bytes = base64.b64decode(result.data[0].b64_json) Path(f"batch_output/shoe_{i+1}.png").write_bytes(image_bytes) print(f"✅ 第{i+1}张生成成功") except Exception as e: print(f"❌ 第{i+1}张生成失败: {e}") # 指数退避重试 wait = 2 (i % 3) print(f" 等待{wait}秒后继续...") time.sleep(wait) continue time.sleep(2) # 间隔2秒,避免触发速率限制

省钱技巧:

- 测试阶段用

low质量就够了,省90%+ - 使用Batch API可享50%折扣

- 用

low质量生成+Real-ESRGAN等超分模型放大,是社区验证的4K性价比方案 - 缓存重复的基础提示词可节省75%文本输入成本

4.6 五大踩坑实录

GPT-Image-2的提示词逻辑和DALL·E 3、Midjourney完全不一样。这是不少人都会踩的坑——要是用Midjourney的标签式写法来撰写GPT-Image-2的提示词,最终的效果反而会变差。

5.1 最重要的规则:用自然语言,别用标签

Reddit上有用户测试发现:运用标签密集的提示词反而会触发对角线噪声网格。一旦把提示词改成自然流畅的英语描述,噪声就会消失,真实感也会大幅提升。

❌ 旧写法(Midjourney风格):

beautiful woman, portrait, cinematic lighting, 8k, hyperrealistic, detailed face, soft skin, bokeh ✅ 新写法(GPT-Image-2风格):

A cinematic portrait of a woman in her late twenties, soft golden hour light falling across her face from the left, a gentle out-of-focus city behind her, film grain texture, the kind of shot you‘d see in a magazine editorial 核心区别:GPT-Image-2有语言模型做“大脑”,它理解你在说什么,不需要你堆关键词。

5.2 新版提示词三段式结构

我总结了一个实用的模板:

- 主体描述:画面核心内容(是什么、在哪里、做什么)

- 排版约束:文字内容、位置、大小、字体风格(GPT-Image-2对排版约束的理解力极强)

- 风格指令:整体视觉风格、色调、参考

示例——电商商品主图:

一张高端护肤品的产品主图。产品是一个白色磨砂玻璃瓶身、金色盖子的精华液, 瓶身正面印有品牌名“AURÉLIA”和产品名“RENEWAL SERUM”。 产品居中放置在浅灰色大理石台面上,柔和的自然光从左上方洒下, 背景是虚化的浅色调,整体风格干净高级,类似高端百货的橱窗展示。

5.3 Thinking模式 vs Instant模式选择指南

什么时候用Thinking:复杂排版、多文字、推理任务、多图生成、需要联网查信息

什么时候用Instant:简单图像、快速迭代、免费用户、对速度敏感

6.1 设计行业:画图员的时代已然结束,思辨者的时代即将到来

到了2026年的今天,GPT-Image-2完成全量上线,这句话也就拥有了全新的含义。

执行层岗位面临淘汰的情况包括:基础美工也就是重复性制图、电商主图相关岗位,以及模板化设计也就是标准化UI组件、信息图排版相关岗位。据公开报道来看,多家4A广告公司已经启动了相关的测试工作。

创意层的价值依旧存在:问题定义能力、复杂系统设计以及审美领导力,这些都是人工智能无法做到的。

我的观点:设计师不会失业,但只会画图的设计师会。就像计算器淘汰了人工算账的工作,但淘汰不了数学家这类职业。

6.2 电商行业:效率提升10倍,成本降低80%

从产品精修到详情页长图,以前需要花费2到3天的工作,现在只需要两句话就能搞定。跨境卖家最为看重的“产品保真以及多图一致性”,如今终于可以实现使用。

中小卖家的“设计民主化”:以前请不起设计师,现在一句话就可以搞定。这是真正的生产力方面的革命。

6.3 信任危机:我们需要重新学习“看图”

我的判断是,技术问题终将被技术解决,不过社会适应这类情况还需要一定时间。在当前阶段谋求生存,需要培养一种新的媒介素养,也就是默认怀疑的态度。看到任何截图、照片的时候,第一反应不应该是直接转发,而是先去进行溯源工作。

6.4 中国AI图像模型:新的竞争起点

过去两年,国产图像模型有着一个核心的叙事,也就是我们也许在某些维度不如Midjourney,但我们懂中文。中文字体、中文语义、中文审美以及中文电商场景,这是一道护城河。

就当前这个情况来看,GPT-Image-2不仅中文渲染得十分精准,甚至还能自动在画面的角落当中塞进一个“李佳琦直播间”的模糊招牌。它并不是“被教会了中文”,而是真的“看懂了中国场景”。

差距集中在三点:

- 图像是否离散化——GPT-Image-2用视觉分词器把图像变成token,国产模型大多仍在用扩散模型的整体生成

- 语言模型是否进入主链路——GPT-Image-2让语言模型当“大脑”,国产模型的语言模型更多是辅助角色

- 是否有带布局标注的数据体系——GPT-Image-2的训练数据包含精确的布局信息

但国产模型也有着属于自己的底牌:字节所拥有的分发生态,也就是豆包、即梦、剪映以及抖音,阿里所具备的超长中文prompt解析能力,还有快手在短视频场景当中的深耕。

我的判断:GPT-Image-2的发布并不是让国产模型“完蛋了”,它其实是一个节点事件,也就是宣告了“我们因为懂中文所以可以活得很好”这个叙事的终结。接下来的竞争,将会在新的起点上展开。

6.5 未来方向

- 因果推理:从“画得像”到“画得对”——理解物理世界因果规律

- 具身交互:图像生成与机器人感知的融合

- 轻量化部署:让GPT-Image-2级能力跑在手机上

文字渲染达到99%以上其实只是表象,它的本质是语言模型首次成为了图像生成的“大脑”。Thinking模式仅仅只是一个开始,在未来图像模型会越来越“像人”——也就是先把事情想清楚再动手去做,完成之后还会再检查一遍。

行动建议:

- 开发者:现在就开始接入API,抢占先发优势。迁移成本极低——把

model参数改成“gpt-image-2”就行 - 设计师:拥抱工具,把精力从“执行”转向“思考”。AI是你的超级助手,不是你的替代者

- 电商从业者:立刻试用透明背景和批量生成,验证ROI。我赌你回不去

- 普通用户:享受创作民主化,但保持对图像真实性的警惕。默认怀疑,溯源再信

最后一句:从今天起,AI不再只是画图工具,而是你的视觉思考伙伴。

只不过——这个伙伴太能干了,以至于我们得重新学习怎么信任自己的眼睛。

⚠️ 声明:本文是由AI辅助创作而成,其中的核心观点以及代码示例都经过了人工审核。文中所引用的AI生成图片均已经标注好了来源,仅供开展技术解析以及学术讨论来使用。本文并不构成任何投资或者职业决策方面的建议,相关行业的数据引用均来自公开报道,请读者自行进行判断。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/281355.html