关键词:TRAE教程、Token成本优化、AI编程成本、上下文管理、AI Coding 提问技巧、AI IDE 使用技巧

很多人以为成本来自“模型太贵”,但真正的隐形大头其实是 —— Token 使用方式。

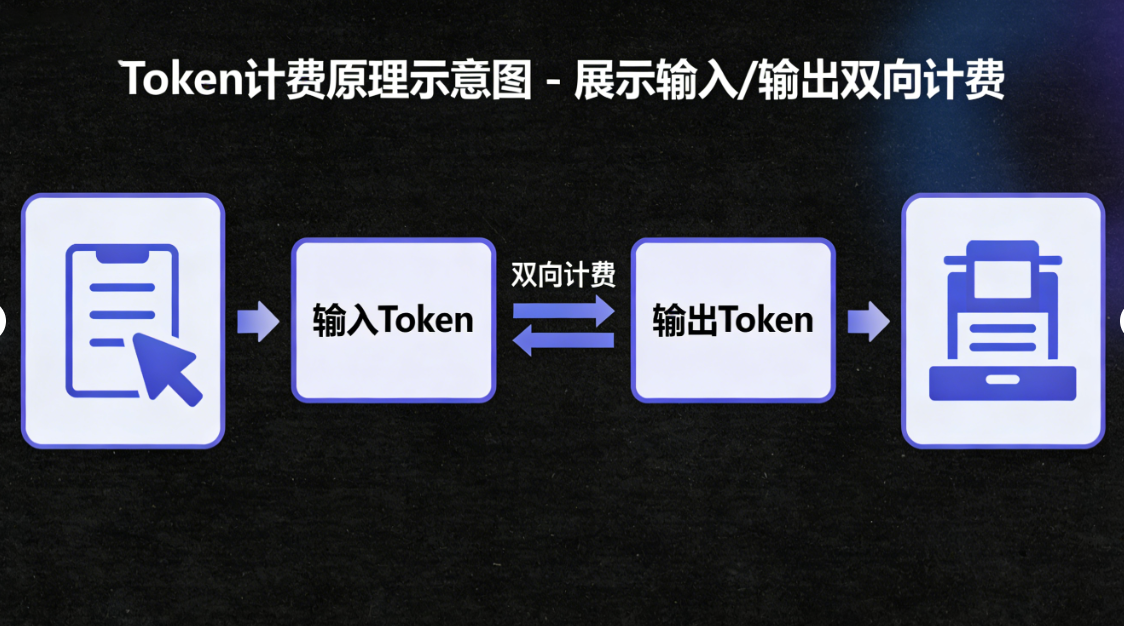

一次 AI 对话的费用本质上可以理解为:

总费用 = 未命中缓存的输入 Token × 输入单价- 输出 Token × 输出单价

- 缓存 Token × 缓存单价(如有)

Token 主要来自 3 个部分:

类型 来源 输入 Token 提问内容、历史对话、引用代码/文件 输出 Token AI返回内容、代码、工具调用 缓存 Token 长对话复用的上下文关键结论:

真正决定成本的不是“问了多少次”,而是- 上下文有多长

- 引用了多少文件

- 是否频繁返工

在讲技巧前,先给一个真正核心的结论:

会提问,比会省 Token 更重要。

每次问 AI 前,先问自己 6 个问题:

- 目标是否唯一

- 信息是否必要

- 指令是否清晰

- 角色是否设定

- 格式是否指定

- 是否提供示例

这 6 条几乎能减少 50% 无效对话。

长对话 = 隐形 Token 黑洞。

什么时候必须新开会话

- 切换任务(修 bug → 写文档)

- 聊了几十轮开始变慢

- AI 连续 3 次答错

正确做法

只带走 结论 + 核心代码,重新开始。

错误做法:

帮我看看整个项目 正确做法:

请检查 #UserService.login 函数 推荐习惯

少即是多,是黄金法则。

对比:

清晰 Prompt = 一次成功 = 少 Token

推荐结构

角色 + 任务 + 限制条件 + 输出格式 示例:

你是一名资深前端架构师, 使用 Vue2 + axios, 只修改 login 方法, 返回完整代码。 碎片对话非常耗费 Token。

错误模式

- 写组件

- 再问测试

- 再问优化

正确模式

一次打包:

创建 Button 组件:- TS + styled-components

- 支持 primary/secondary

- 编写 Jest 测试

减少交互次数 = 降低固定开销

AI 默认会:

- 解释

- 举例

- 寒暄

这些全部消耗 Token。

必加的一句话

只给最终结果,不要解释 或

仅返回代码 直接写代码 = 高返工风险。

正确流程:

/plan → 确认 → 再生成代码 复杂任务用:

/spec 生成: spec.md → tasks.md → checklist.md 这是避免 大规模返工 的关键。

长对话会让 AI:

- 遗忘重点

- 开始跑偏

- 成本飙升

解决方案:

定期压缩上下文

就像给会议纪要做总结。

不要每次都说:

- 用中文

- 按团队规范

- 遵守命名规则

直接写进:

这是长期节省 Token 的核心技巧。

大型项目中最浪费 Token 的内容:

- dist/

- build/

- 日志

- 覆盖率报告

建议添加 AI ignore 文件,类似 .gitignore。

从源头切断噪声。

不要所有任务都用最强模型。

工具本身已经做了很多优化:

- 智能死循环检测

- 上下文自动压缩

- 缓存命中优化

- 子 Agent 分层任务

- 模型定向优化

这些都在帮你默默降低成本。

真正省 Token 的本质只有一句话:

减少无效沟通。

核心手段:

- 精准输入

- 控制上下文

- 减少返工

- 合理选模型

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/281165.html