AI Agent,即人工智能智能体,是一种能够自主感知外部环境、理解用户目标、拆解复杂任务、调用外部工具、维护长期记忆、进行逻辑推理,并在执行过程中不断反思、修正、迭代,最终自主完成一整套复杂目标的人工智能系统。

与传统软件程序不同,Agent 不依赖硬编码的固定逻辑,也不局限于单一任务流程。它更接近一个具备独立决策能力的数字员工或数字助手,能够在模糊、开放、动态的任务环境中做出合理判断。而与早期基于规则或强化学习的智能体相比,基于大模型的现代 Agent 最大的突破在于:它拥有强大的自然语言理解能力、常识推理能力、跨领域泛化能力,以及对复杂意图的解析能力。

简单来说:

- 传统大模型更像是一个知识渊博的顾问,你问它答,不主动行动,像一个大脑;

- Agent是一个拥有大脑 + 眼睛(感知)+ 手(工具)+ 记忆(经验)+ 逻辑(规划)+ 自我修正(反思)的完整智能体,它不仅懂知识,还能动手完成任务。

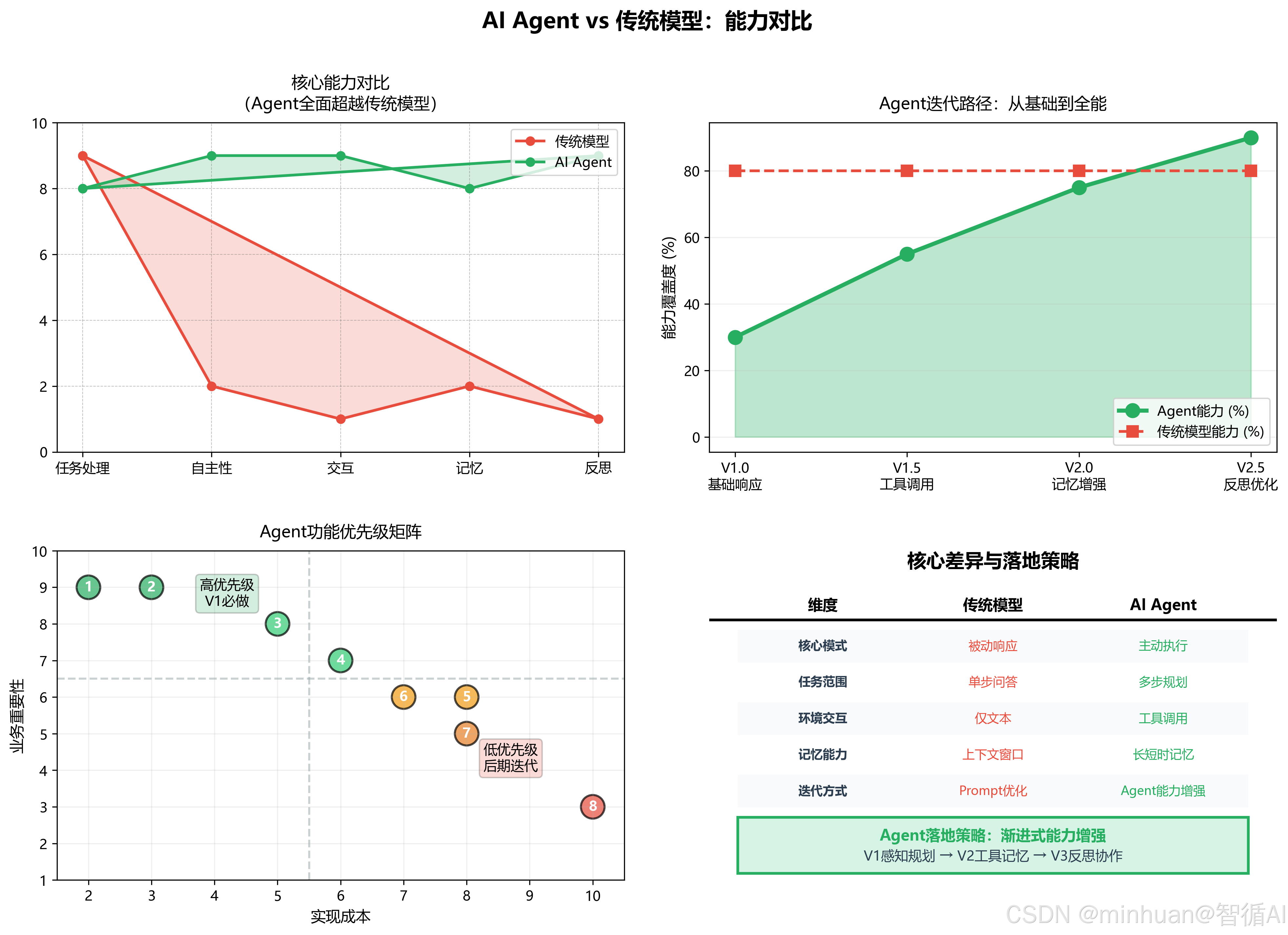

传统大模型的运行模式是典型的被动响应模式。用户输入一段 Prompt,模型基于上下文生成文本输出,整个过程是无状态的,模型不会主动追问、不会主动规划、不会主动调用外部能力,更不会对结果进行校验。这种模式在问答、摘要、创作等轻量任务中表现优秀,但在复杂任务,例如数据分析、代码工程、多步骤办公、信息检索等场景中,能力边界非常明显。

AI Agent 则构建了一套主动执行模式。它打破了 “一问一答” 的限制,将大模型从一个单纯的语言生成器升级为任务决策中枢。二者的核心差异体现在多个维度:

任务处理方式不同:

- 传统大模型只能处理单步、明确、信息完整的任务;

- 而 Agent 可以处理模糊、开放、多步骤、信息缺失的复杂任务,例如 “帮我整理一份月度运营报告,并从数据库中提取数据,生成图表并发送邮件”。

自主性不同:

- 大模型完全依赖用户引导,用户不继续提问则任务终止;

- Agent 具备自主决策能力,可以自主判断任务是否完成、是否需要补充信息、是否需要重试、是否需要调整策略。

环境交互能力不同:

- 大模型只能处理文本信息,无法与现实世界或数字系统交互;

- Agent 可以通过工具调用机制连接搜索引擎、数据库、代码解释器、API 接口、文件系统、自动化脚本,真正实现从理解到执行。

记忆与迭代能力不同:

- 大模型仅依赖有限长度的上下文窗口,无法长期存储经验;

- Agent 可以构建短期记忆、工作记忆、长期记忆,甚至形成经验库,在多次任务中持续优化行为。

容错与反思能力不同:

- 大模型一旦生成错误内容,不会自我修正;

- Agent 内置反思模块,能够判断输出是否合理、是否存在矛盾、是否满足目标,从而进行修正、回退或重新规划。

可以说,大模型是Agent的大脑,而Agent是让大脑真正行动起来的“身体与神经系统”。没有大模型,Agent缺乏智能核心;没有Agent,大模型只能停留在文本层面。

感知和理解能力:

- 接收用户输入、环境信息、系统状态、约束条件等多维度信息

- 通过大模型进行意图识别、实体抽取、关键信息提取、目标标准化等处理,将模糊的自然语言转化为清晰的任务目标

规划和推理能力:

- 以将一个复杂目标拆解为多个有序子任务,确定执行顺序、依赖关系、执行条件;

- 常见的规划方式包括链式思考(CoT)、推理行动(ReAct)、计划执行(Plan-and-Solve)

多类型记忆能力:

- 短期记忆对应对话上下文,用于维持当前任务连贯性;

- 工作记忆用于存储当前步骤的执行状态、中间结果、工具返回信息;

- 长期记忆通常基于向量数据库实现,用于存储历史任务、用户偏好、行业知识、经验总结;

工具使用能力:

- 通过函数调用(Function Calling)机制,Agent 可以自主选择并调用各类工具;

- 包括计算器、搜索引擎、代码解释器、数据库客户端、第三方 API、文件读写等;

反思与迭代能力:

- 它负责对每一步执行结果进行评估,判断信息是否充足、结果是否正确、逻辑是否合理;

- 如果执行失败或结果不达标,反思模块会触发重新规划、补充信息、修正参数,甚至回滚操作;

1.1 Python 编程

Python是当前 AI Agent 开发的绝对主流语言,几乎所有框架、工具链、模型接口均以Python为核心。想要构建稳定可用的智能体,必须具备扎实的 Python 基础,必须掌握:基础语法、函数、类、异常处理、文件操作、异步请求。

1.2 大模型基础原理

AI Agent基于大模型构建,因此必须理解大模型的基本工作机制。包括:Transformer 架构的基本思想、上下文窗口的作用与限制、Token 计算机制、Prompt 工程基础、模型微调的概念、检索增强生成(RAG)、函数调用(Function Calling)原理等。

不需要深入到矩阵运算与梯度下降级别,但必须理解模型为什么能理解语言、为什么会出现幻觉、如何通过提示词提升输出稳定性、如何控制模型行为。这些知识直接决定 Agent 的可靠性。

1.3 API 调用与网络请求

现代Agent几乎都通过 API 方式调用大模型服务,无论是开源模型部署服务,还是商用模型接口。因此必须掌握 HTTP/HTTPS 请求基础,能够使用 requests 或官方SDK完成模型调用、参数配置、响应解析、错误处理。

同时需要理解 API Key 管理、请求头构造、流式输出处理、超时设置、重试机制等工程细节。这些内容看似基础,却是 Agent 稳定运行的关键。

1.4 基础数据库与向量库

记忆系统是Agent的核心模块之一。短期记忆可以通过列表维护,但长期记忆与知识记忆必须依赖数据库与向量库。

需要掌握关系型数据库(如 SQLite、PostgreSQL)的基础使用,用于存储结构化记忆;同时需要掌握向量数据库,例如 FAISS、Chroma等,理解文本向量化、向量检索、相似度匹配的基本逻辑。向量库让Agent具备“长期记忆”与“知识检索”能力,是构建高级智能体不可或缺的基础。

1.5 简单前后端知识

如果希望将Agent交付给他人使用,需要具备基础的 Web 或界面开发能力。常用工具包括:

- FastAPI 用于构建后端接口;

- Streamlit 或 Gradio 用于快速构建可视化交互界面。

这类工具学习成本低、开发效率高,可以快速将命令行Agent升级为可交互的应用系统。

2.1高级提示词工程

基础提示词只能实现简单问答,而高级Agent需要复杂的系统提示词。包括:设计精准的System Prompt、使用Few-shot 示例提升格式稳定性、构建ReAct 范式提示词、实现Self-Consistency提升推理准确性、使用思维模板规范模型输出格式等。

提示词工程直接影响Agent的规划能力、工具调用成功率、反思效果,是高级智能体开发的核心技能。

2.2 工具封装与函数调用体系

工具是Agent的“手脚”,进阶开发者需要掌握工具封装规范、权限控制、参数校验、结果格式化、工具依赖管理等。

同时需要理解 OpenAI 风格 Function Calling、国产模型工具调用格式、Pydantic 数据验证等,确保工具调用稳定不报错。

2.3 检索增强生成(RAG)

RAG是解决模型幻觉、知识滞后的核心技术,也是企业级 Agent 的标配。进阶开发需要掌握文档加载、文本分块、向量化模型选择、检索策略优化、重排序机制、混合检索等内容。

2.4 智能体框架与流程编排

主流框架包括LangChain、LlamaIndex、LangGraph、AutoGen等。掌握框架可以大幅提高开发效率,避免重复造轮子。流程编排则用于控制多步骤任务执行,实现条件分支、循环、异常处理等复杂逻辑。

2.5 多智能体协作

高级阶段可以学习多智能体系统,构建角色化智能体团队,例如管理者 Agent、执行 Agent、反思 Agent、工具 Agent 等,实现复杂任务的分工协作。

2.6 安全对齐、幻觉抑制与评估

企业级Agent必须具备安全性与可靠性。需要学习内容审核机制、权限隔离、输出校验、幻觉检测、任务评估指标设计等,确保智能体在生产环境稳定、安全、可控。

2.7 工程化部署与运维

最终需要将Agent部署到生产环境,包括 Docker 容器化、环境变量管理、日志系统、监控告警、限流熔断、负载均衡、成本控制等。

构建AI Agent并不需要深度学习级别的复杂数学,但需要一定的逻辑与基础数学素养。包括:

- 基本逻辑推理能力,理解与或非、条件判断、任务依赖关系;

- 对概率与置信度有基础认知,理解模型输出的不确定性;

- 了解文本向量化的基本思想,理解高维向量空间的相似度计算;

- 理解图结构与任务流的基本概念,便于设计规划算法。

这些基础能够帮助开发者更深刻地理解 Agent 运行逻辑,而不是仅仅停留在调用接口层面。

4.1 LangChain

目前最主流、生态最完善的 Agent 开发框架,支持记忆、工具、规划、检索、多智能体等全模块能力,社区资源丰富,适合绝大多数场景。

4.2 LlamaIndex

侧重数据索引与 RAG 构建,对复杂文档、知识库场景支持极佳,适合需要高强度知识检索的 Agent。

4.3 LangGraph

基于 LangChain 扩展,专门用于构建循环、状态化、多步骤的 Agent 工作流,适合需要复杂控制逻辑的智能体。

4.4 AutoGPT

早期经典自主 Agent,以无限循环执行为特点,适合探索性任务,但生产环境需谨慎使用。

4.5 MetaGPT/ChatDev

多智能体框架,模拟软件团队协作,适合代码开发、项目构建等复杂团队任务。

4.6 OpenAI Swarm

轻量级多智能体框架,结构简洁、易于扩展,适合快速构建协作式 Agent。

4.7 Pydantic AI

基于 Pydantic 实现强类型输出,适合需要高度结构化、稳定格式的 Agent 系统。

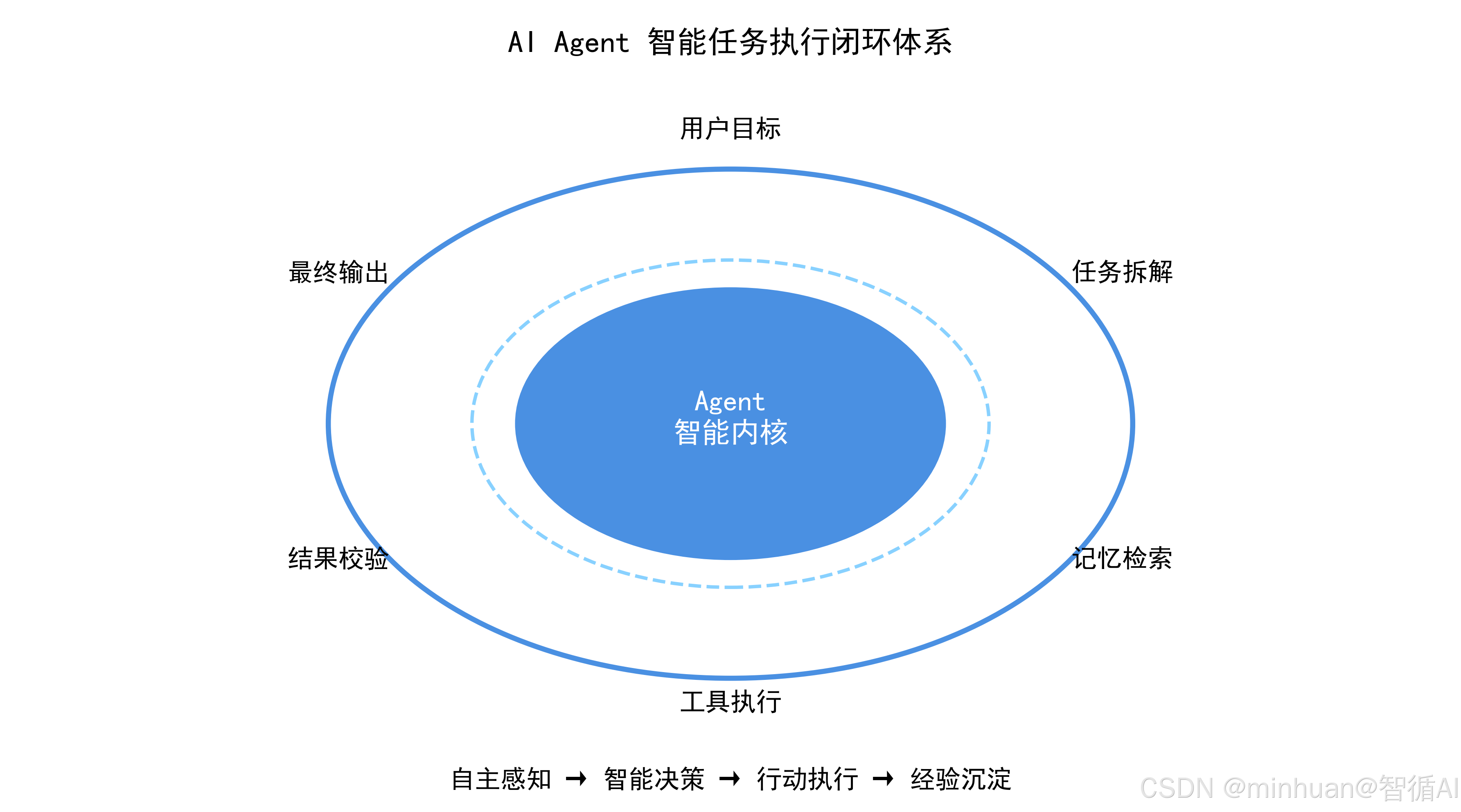

一个标准化、可工程化的 AI Agent 遵循固定的闭环执行流程,每一步都高度模块化、可替换、可扩展。

完整流程说明:

- 1. 用户目标输入

用户以自然语言形式提出任务,可能模糊、不完整、包含隐含需求。

- 2. 意图解析与目标确认

感知模块对用户输入进行解析,识别核心目标、约束条件、时间限制、输出格式要求,必要时主动追问补充信息。

- 3. 任务规划与步骤拆解

规划模块将总目标拆分为若干可执行子步骤,确定执行顺序、依赖关系、所需工具、信息来源。

- 4. 记忆读取与上下文加载

Agent 从短期记忆、工作记忆、长期记忆中加载相关信息,避免重复执行、保持任务连贯性。

- 5. 工具决策与行动选择

判断当前步骤是否需要调用外部工具。若需要信息检索、计算、数据查询等,则进入工具调用;若仅需推理,则直接由模型生成。

- 6. 工具调用或模型推理

执行工具调用,传入参数,获取返回结果;或直接进行语言推理,生成中间答案。

- 7. 结果收集与状态更新

将工具返回或模型输出存入工作记忆,更新任务状态,标记已完成步骤。

- 8. 反思与校验

反思模块判断当前结果是否满足要求、信息是否完整、逻辑是否合理、是否存在错误。

- 9. 任务完成判断

若达标,则整理结果并输出;若不达标,则返回规划模块重新调整步骤。

- 10. 最终输出与记忆存储

输出最终答案,并将本次任务经验存入长期记忆,完成整个闭环。

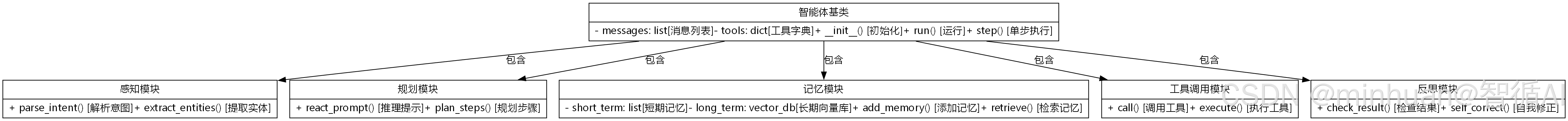

2.1 感知模块

- 感知模块是Agent的感官系统,负责将非结构化信息转化为结构化任务。

- 其核心功能包括意图分类、关键实体抽取、约束识别、目标检测、冲突检查等。

- 在复杂场景中,感知模块还可以接入多模态信息,如图像、语音、系统日志等,使智能体具备更全面的环境感知能力。

2.2 规划模块

规划是Agent的“思维中枢”。主流规划范式包括:

- CoT 链式思考:逐步推理,展示思考路径

- ReAct 推理 + 行动:思考 → 行动 → 观察 → 迭代

- Plan-and-Solve:先完整规划,再批量执行

- Self-Ask:主动提出子问题,补充信息

- 任务图规划:将任务表示为有向无环图,按依赖执行

规划能力决定智能体能否处理复杂、长流程、多依赖的任务。

2.3 记忆模块

记忆系统分为三层:

- 短期记忆:对话历史,限制在上下文窗口内

- 工作记忆:当前任务的中间状态、步骤结果

- 长期记忆:向量库存储的知识、经验、用户偏好

优秀的记忆管理可以显著降低 Token 消耗、提升任务连贯性、减少幻觉。

2.4 工具模块

- 工具模块是Agent的执行系统,包括工具注册、参数校验、权限控制、执行调度、结果解析。

- 工具可以是内置函数,也可以是远程 API,甚至是外部 RPA 系统。

- 工具调用的稳定性直接决定智能体是否可用。

2.5 反思模块

- 反思模块是高级Agent的自我修正系统,通过二次模型调用或规则校验,判断结果质量。

- 反思可以有效抑制幻觉、避免错误执行、提升可靠性。

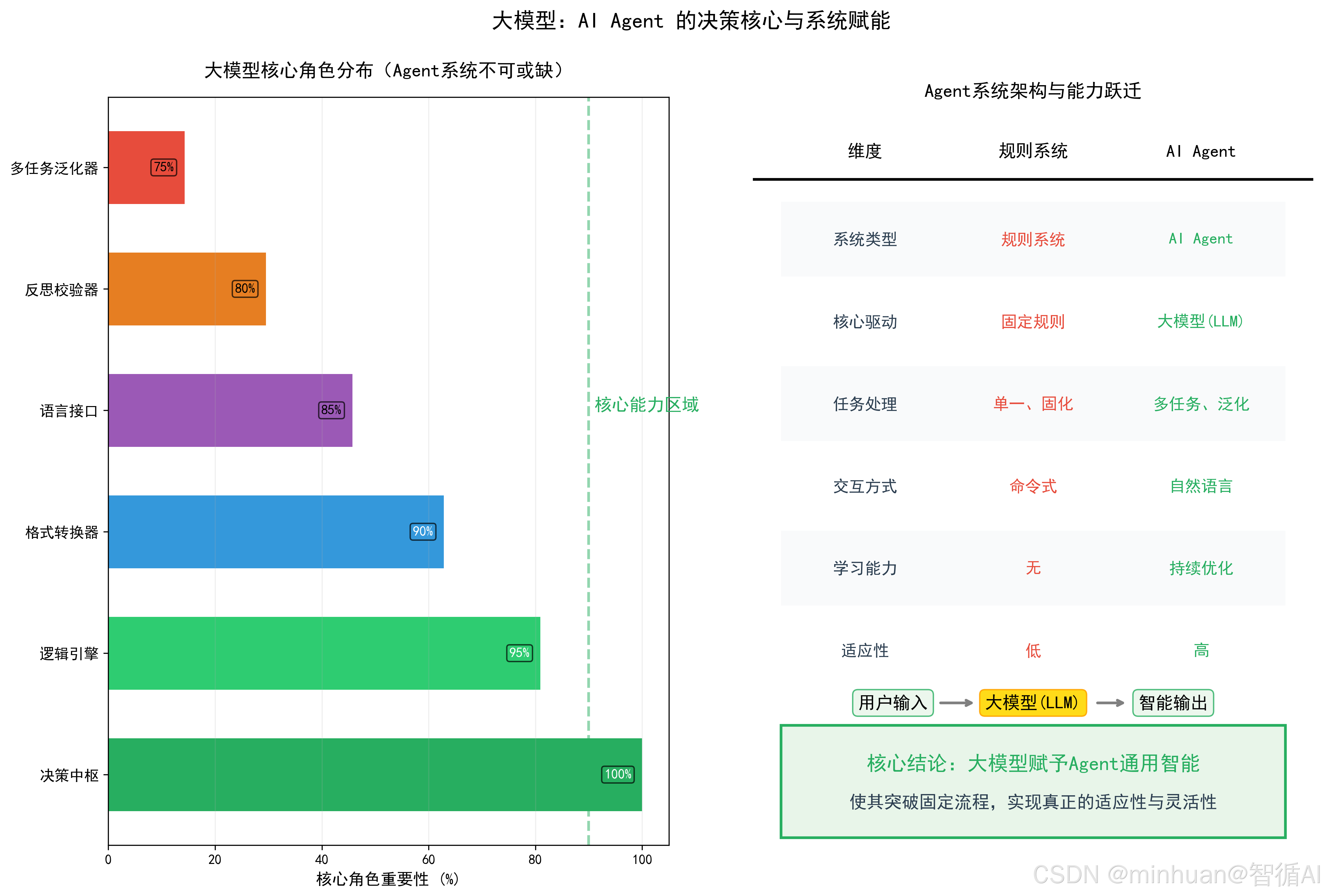

大模型是整个Agent系统的核心,没有大模型,智能体只能是规则系统。大模型承担以下关键角色:

- 决策中枢:决定任务如何拆解、工具如何选择

- 逻辑引擎:执行推理、判断、规划

- 格式转换器:将自然语言转为结构化工具调用

- 语言接口:与用户自然交互

- 反思校验器:判断结果是否合理

- 多任务泛化器:一套系统适配多种任务

大模型让Agent具备通用智能,使其不再局限于固定流程,而是真正具备适应性与灵活性。

搭建一个最小可用 Agent 架构,包含规划、工具、记忆、循环执行、反思逻辑,主要体现:

- 规划器逻辑:采用状态机模拟大模型决策,根据记忆状态判断下一步动作。

- 工具执行:定义计算器与搜索函数,通过映射表实现动态路由与本地执行。

- 记忆机制:利用列表存储对话历史与工具返回结果,为决策提供上下文支撑。

- 主循环控制:设定最大步数防止死循环,驱动“规划-行动-观察”闭环迭代。

import json import requests====================== 任务规划器 ======================

def call_llm(messages: list, tools: list = None) -> dict:

""" 任务规划器:根据当前对话历史,判断下一步应该做什么 - 首次调用:需要计算 + 搜索 - 收到计算结果:需要搜索 - 收到搜索结果:任务完成 """ last_msg = messages[-1]["content"] if messages else "" # 状态机:根据记忆内容决定下一步 has_calc_result = any("计算结果" in str(m) for m in messages if isinstance(m, dict) and "tool" in m.get("role", "")) has_search_result = any("AI Agent 正在" in str(m) for m in messages if isinstance(m, dict) and "tool" in m.get("role", "")) # 情况1:还没计算,先计算 if not has_calc_result: return { "content": None, "tool_calls": [{ "id": "call_1", "function": {"name": "calculator", "arguments": '{"expression": "12*9+34-10"}'} }] } # 情况2:已计算但还没搜索,执行搜索 if not has_search_result: return { "content": None, "tool_calls": [{ "id": "call_2", "function": {"name": "search_info", "arguments": '{"query": "AI Agent发展现状与未来趋势"}'} }] } # 情况3:两个工具都调用过了,生成最终回答 calc_result = "" search_result = "" for m in messages: if isinstance(m, dict) and m.get("role") == "tool": if "计算结果" in m["content"]: calc_result = m["content"] elif "AI Agent 正在" in m["content"]: search_result = m["content"] final_response = f"计算结果:{calc_result} {search_result}

综合以上:本次计算结果为132;AI Agent正从单智能体向多智能体协作演进,趋势是轻量化、可信化、行业化。”

return { "content": final_response, "tool_calls": [] } ====================== 工具定义 ======================

def calculator(expression: str) -> str:

""" 计算器工具,支持基础四则运算 """ try: # 安全提示:实际生产环境请勿直接使用 eval,可使用 ast.literal_eval 或专业计算库 res = eval(expression) return f"计算结果:{res}" except Exception as e: return f"计算失败,错误信息:{str(e)}" def search_info(query: str) -> str:

""" 模拟信息检索工具 """ return ( f"根据搜索结果:{query} —— " "AI Agent 正在从单一智能体向多智能体协作演进,企业落地场景包括客服自动化、数据分析、RPA 增强、代码工程等。" "未来趋势是轻量化、可信化、行业化与工程化部署。" ) 工具映射表

TOOL_MAP = {

"calculator": calculator, "search_info": search_info }

====================== Agent 主执行逻辑 ======================

def run_agent(task: str, max_steps: int = 5):

print(f"【Agent 启动】任务目标:{task} ”)

# 记忆系统(短期记忆 + 工作记忆) memory = [ {"role": "system", "content": "你是一个专业AI智能体,具备任务拆解、工具调用、反思修正能力。"}, {"role": "user", "content": task} ] for step in range(max_steps): print(f"============== 执行步骤 {step + 1} ==============") # 调用大模型进行规划与决策 llm_output = call_llm(memory) # 内容输出 if llm_output["content"]: print("Agent 输出:", llm_output["content"]) # 工具调用 tool_calls = llm_output.get("tool_calls", []) if not tool_calls: print(" 【任务完成】无后续工具调用”)

return # 执行所有工具 for call in tool_calls: func_name = call["function"]["name"] args = json.loads(call["function"]["arguments"]) print(f"→ 调用工具:{func_name},参数:{args}") tool_result = TOOL_MAP[func_name](args) print(f"← 工具返回:{tool_result} ”)

# 写入记忆 memory.append({"role": "tool", "content": tool_result}) print("【任务终止】达到最大执行步数") if name == “main”:

run_agent("计算 12*9+34-10,并介绍当前AI Agent的发展现状与未来趋势")输出结果:

【Agent 启动】任务目标:计算 12*9+34-10,并介绍当前AI Agent的发展现状与未来趋势

根据搜索结果:AI Agent发展现状与未来趋势 —— AI Agent 正在从单一智能体向多智能体协作演进,企业落地场景包括客服自动化、数据分析、RPA 增强、代码工程等。未来趋势是轻量化、可信化、行业化与工程化部署。

综合以上:本次计算结果为132;AI Agent正从单智能体向多智能体协作演进,趋势是轻量化、可信化、行业化。

【任务完成】无后续工具调用

- 盲目信任模型输出:不做校验直接执行,可能导致错误决策

- 工具调用格式不稳定:模型偶尔生成非法JSON,导致解析崩溃

- 上下文过长导致逻辑漂移:记忆过多使模型偏离任务主线

- 缺乏反思机制:错误执行后无法修正,形成错误链条

- 知识截止期问题:模型使用过时信息,导致结论错误

- 无任务边界限制:Agent 陷入无限循环,持续调用工具

- 权限过大:工具可删改文件、操作数据库,存在安全风险

- 记忆模块设计混乱:历史信息互相干扰,任务状态错乱

- 无异常捕获:任意一步报错即整体崩溃

- 模块耦合严重:难以维护、难以扩展、难以测试

- 无超时、重试、限流:API波动导致整体不可用

- 向量库分块不合理:检索精度低,RAG失效

- 提示词不稳定:相同任务多次运行结果差异巨大

- Token 消耗失控:长循环导致成本指数级上升

- 无日志记录:出问题无法追踪执行路径

- 用户隐私未脱敏:记忆存储敏感信息

- 工具越权调用:未做参数校验,可能被注入恶意指令

- 无内容审核:生成违法、违规、误导性内容

- 未做对齐约束:Agent自主执行危险操作

- 数据跨境风险:调用境外模型导致合规问题

- 无缓存机制:重复查询、重复计算,效率极低

- 同步阻塞调用:多工具场景响应极慢

- 模型选型不当:简单任务用复杂模型,成本高、延迟大

- 无进度反馈:用户无法感知执行状态

- 结果不可解释:无法说明决策依据,难以在企业落地

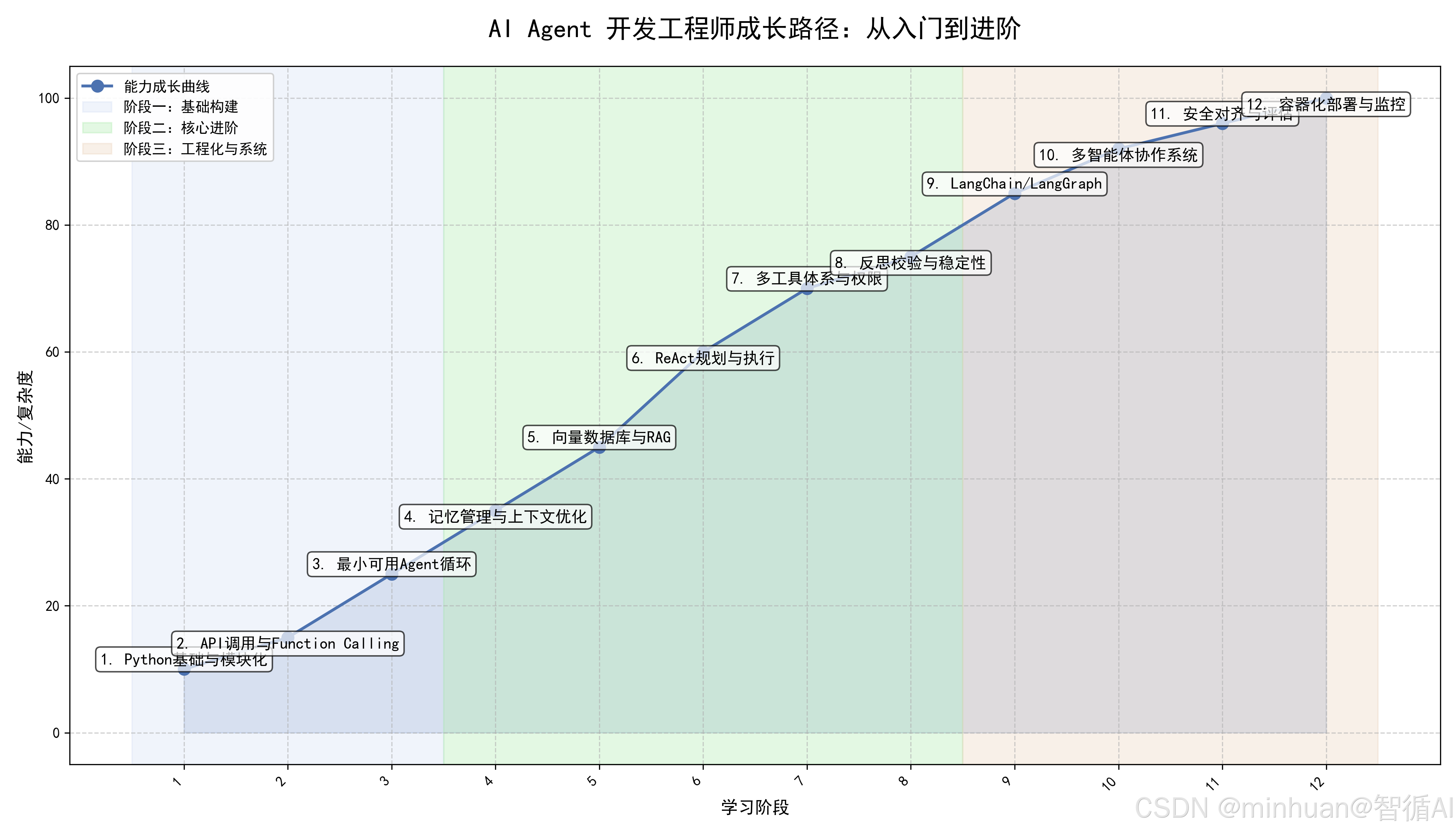

- 1. 掌握 Python 基础语法与模块化开发

- 2. 学习大模型 API 调用与 Function Calling

- 3. 实现最小可用 Agent,跑通循环执行

- 4. 加入记忆管理,优化上下文

- 5. 接入向量数据库,实现 RAG 增强

- 6. 基于 ReAct 构建规划与执行流程

- 7. 封装多工具体系,实现权限控制

- 8. 加入反思与校验模块,提升稳定性

- 9. 使用 LangChain/LangGraph 构建工程化 Agent

- 10. 学习多智能体协作,构建复杂系统

- 11. 实现安全对齐、幻觉抑制、评估体系

- 12. 容器化部署,接入监控与告警系统

按照该路径学习,可从零基础逐步了解AI Agent 开发所具备的各项能力,并具备独立构建企业级智能体的能力。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/270922.html