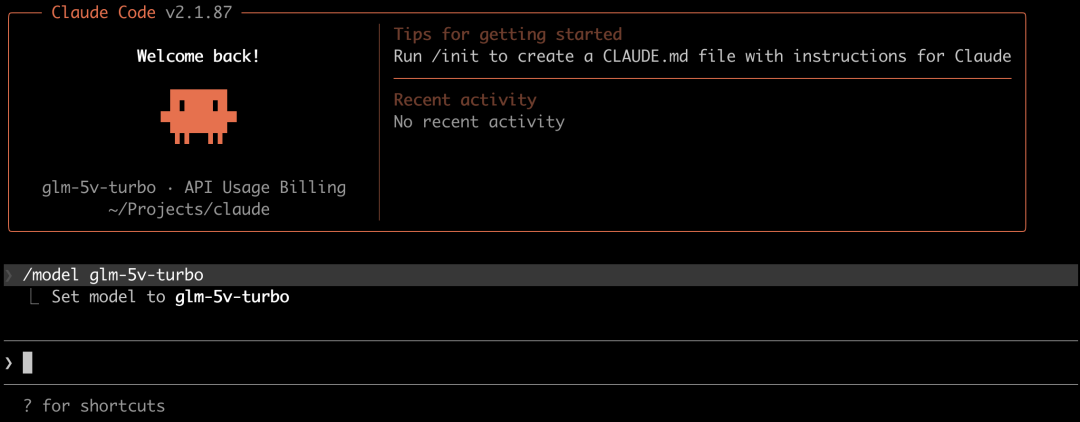

npx @z_ai/coding-helper { “env”: {"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-5v-turbo", "ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5v-turbo", "ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5v-turbo", "hasCompletedOnboarding": true, "ANTHROPIC_AUTH_TOKEN": "

<替换成你的api-key>

"

, "ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/anthropic", "API_TIMEOUT_MS": "", "CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": 1 } }

/model glm-5v-turbo

好了,让它开始表演。

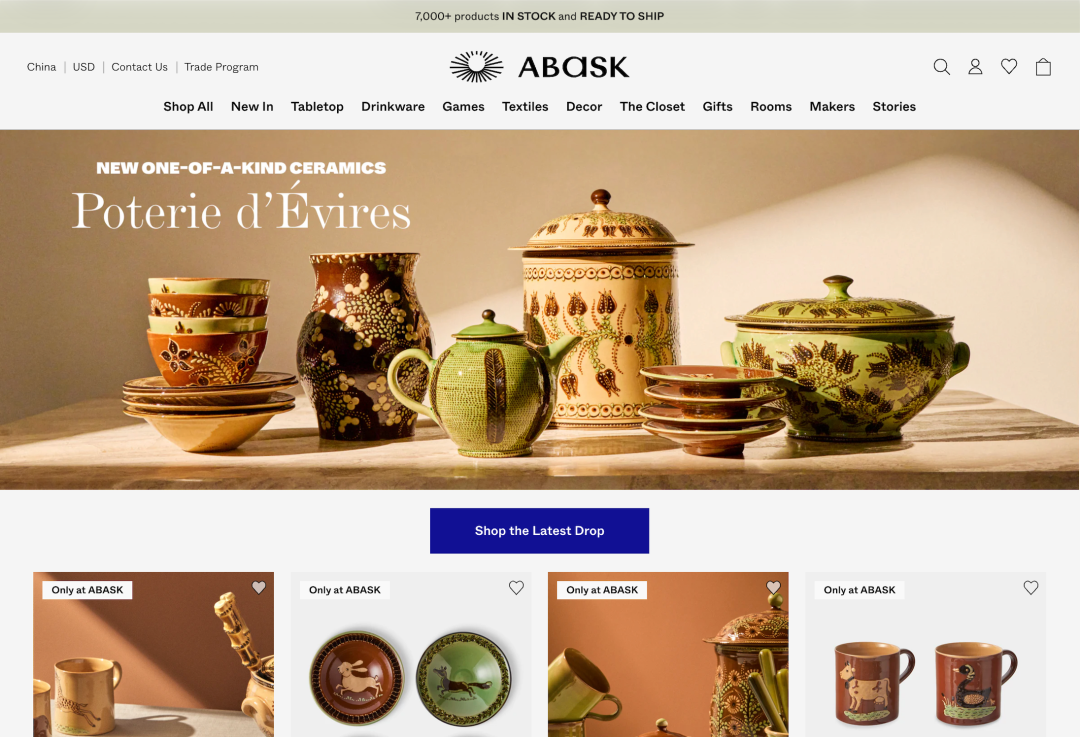

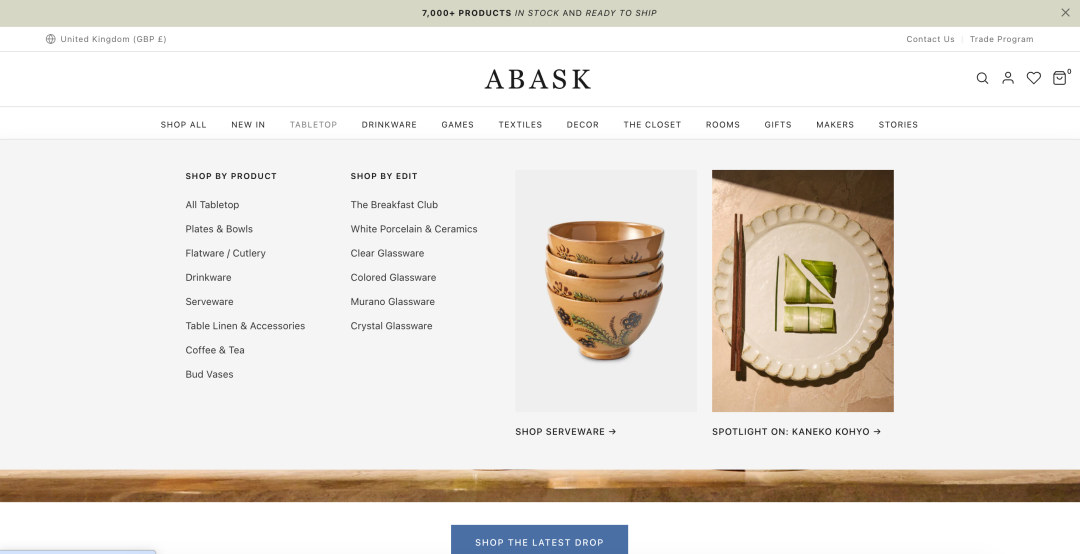

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!我随便找了个挺高级的工艺品电商网站 abask.com。现在搞独立站出海的人多,这种需求挺典型的,看它能不能复刻出来。

以前咱得费劲巴拉地给 AI 描述需求,现在倒好,直接把网址甩它脸上:

代码语言:javascript

AI代码解释

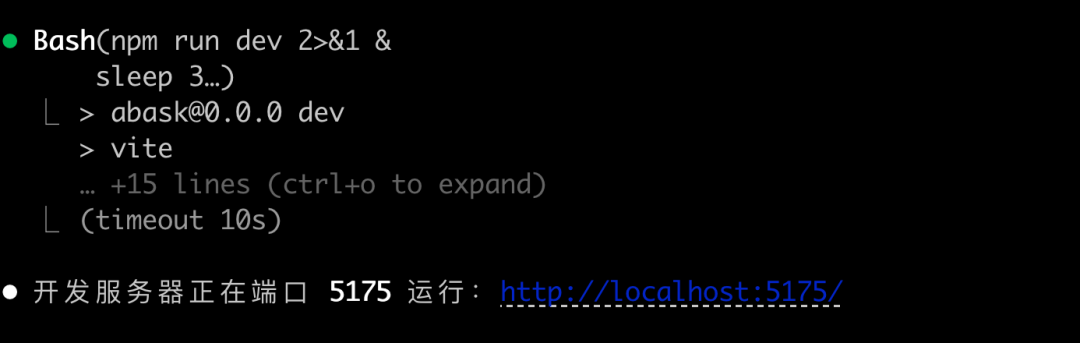

帮我1:1复刻这个网站:abask.com,用vue架构,代码放在 ./abask 目录下

我啥细节都没提,就给个链接和框架要求,它自个儿就开始分析页面布局和样式了。

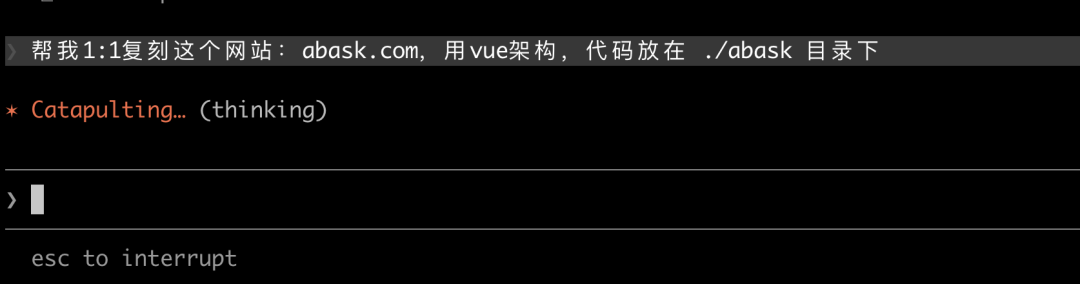

写完代码它还会自动把项目跑起来,省得我再去折腾环境查看效果:

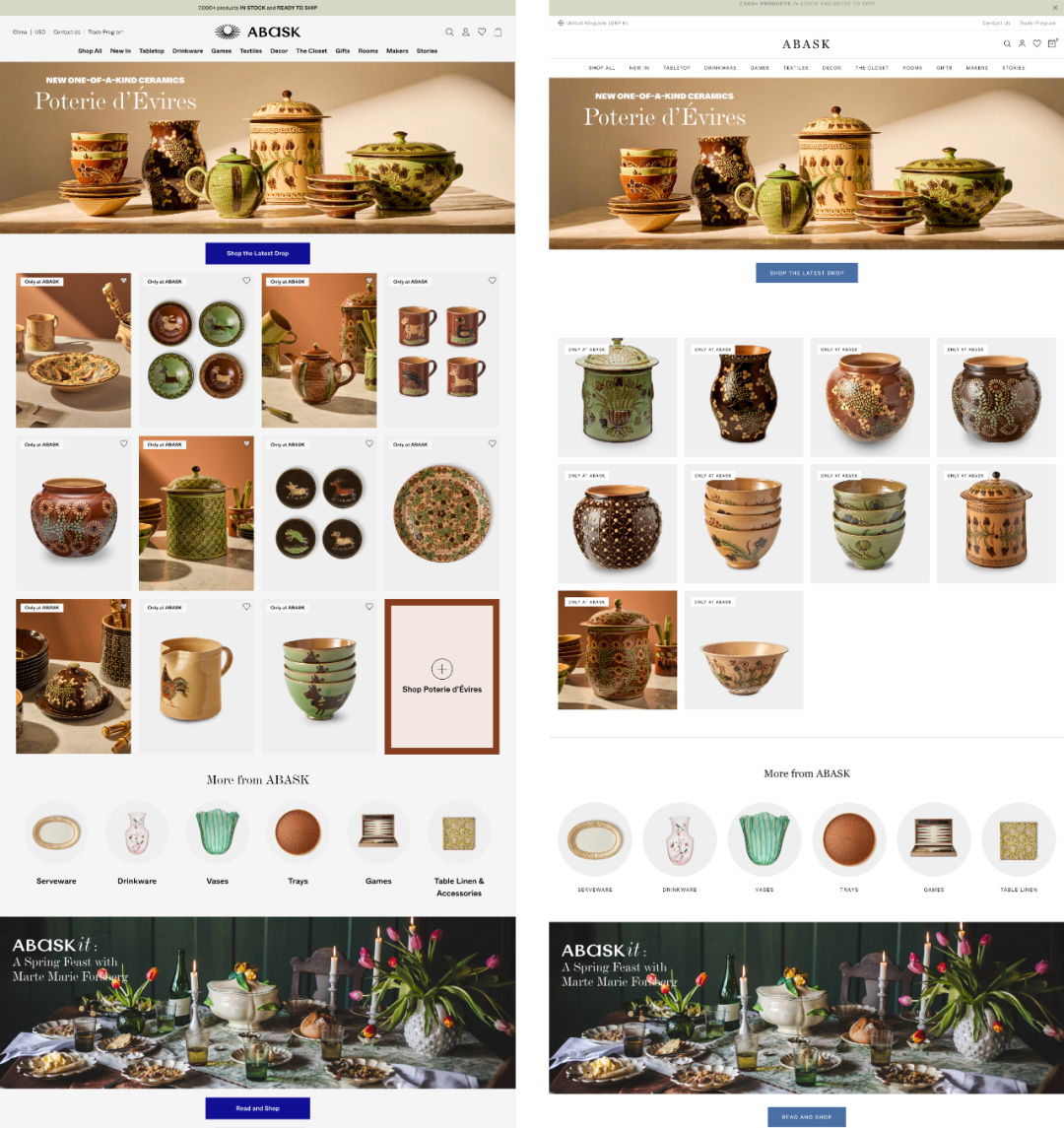

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!瞅瞅这对比,左边是原版,右边是 AI 吐出来的,简直像双胞胎。一轮生成能整成这样,确实有两把刷子,连那种鼠标悬浮的交互感都还原了。

就这质量,我觉得稍微改改真能直接上线了。

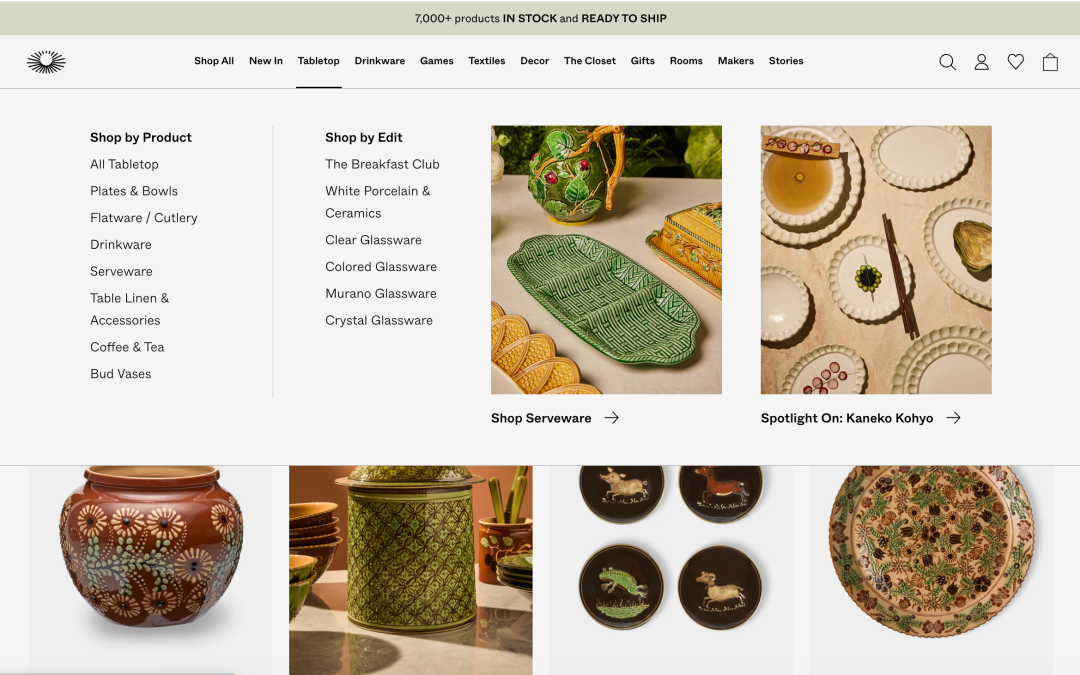

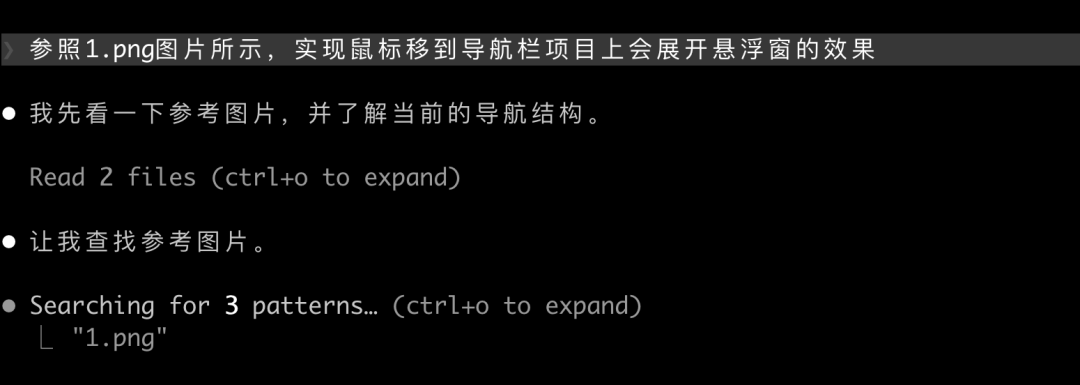

虽说牛,但也不是毫无瑕疵,比如导航栏那个鼠标移上去的下拉效果,第一版没做出来。

没事,咱直接截个图发给它,指哪打哪,让它针对性地改。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!最后的效果:完美!

以前的模型也不是不行,就是太墨迹,得跟它扯半天:阴影淡点、间距窄点……说得口干舌燥,它还总听不明白。

现在爽了,哪不对直接截图甩过去,让它“照猫画虎”,效率直接起飞,两三轮就到位了。

那些用嘴说不清的样式,比如圆角弧度、阴影层次,给它张图,它学得比谁都快。

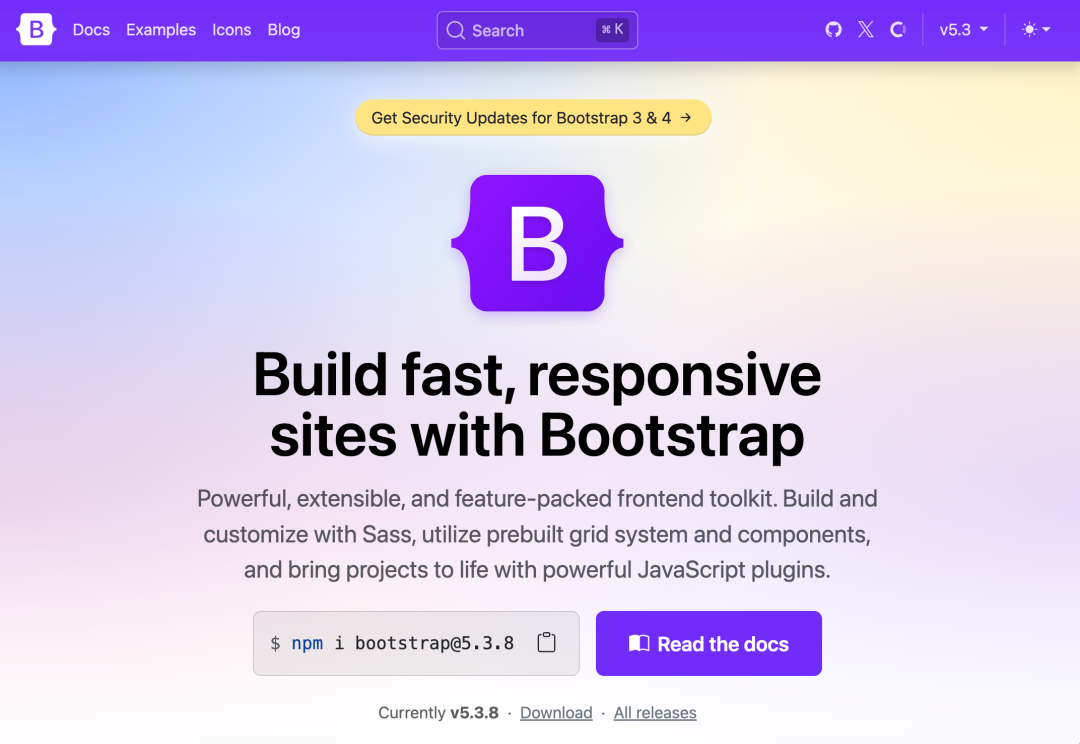

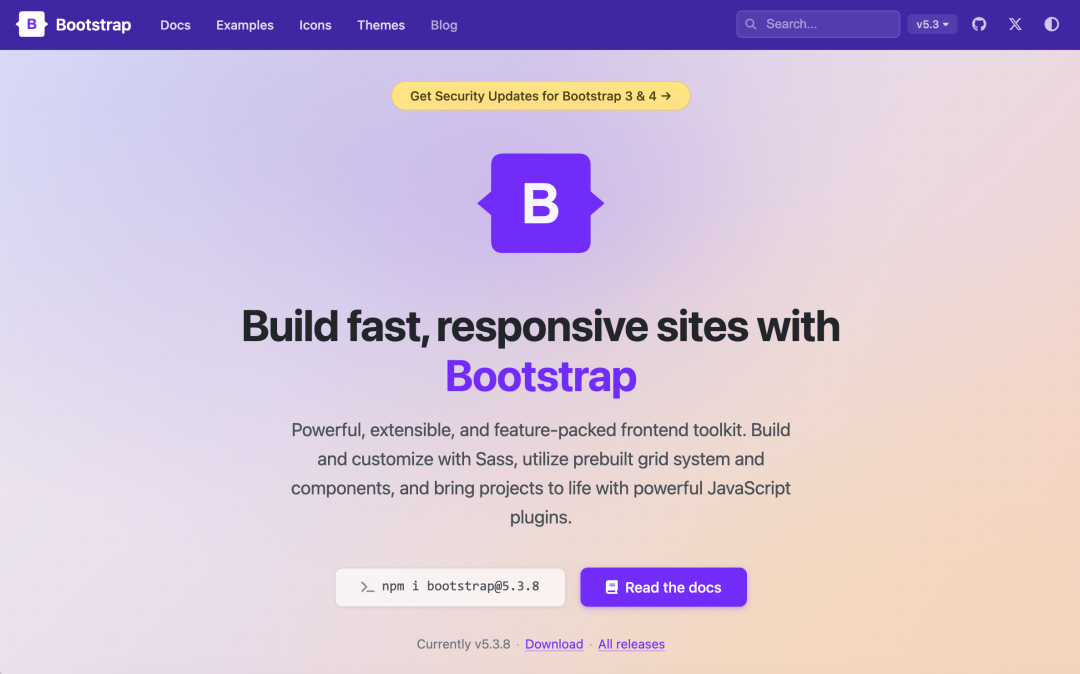

我再换个例子:直接让它照着截图复现页面的元素。

原截图

生成网页

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!是不是很有原版的味道了?

能这么猛,是因为 GLM-5V-Turbo 懂审美还懂写码。它不光有“眼睛”,脑子里的编程功底也没落下,简直就是个懂交互的设计大牛。

深入玩了下发现,这货不光能写前端。

把它塞进 Agent 工作流里,它就像是给 AI 安了对“透视眼”:

- 看到 PDF 里的图表,它一眼就能把数据抠出来分析;

- 看到张图,它能顺藤猛干找资料、补背景;

- 接入龙虾那种工具后,它不再是瞎点,而是能看懂 UI 布局,精准完成复杂任务。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!换句话说,现在的输入已经不再局限于文字了,整个屏幕都是它的输入源。

最后说句掏心窝子的话,自从用了 GLM-5V-Turbo,我都不想写提示词了。

遇到想实现的效果,直接找张图扔过去就行。感觉只靠文字的 Agent 迟早要被淘汰,大模型有了视觉能力才是真完全体。

特别是在前端“看图出代码”这块,GLM-5V-Turbo 现在的体验非常顺手,分分钟就能整出商业级的页面,再也不用为了调个 CSS 像素在那纠结半天,省时省力省 token。

再加上智谱最近上的 GLM-5.1 搞后端也很稳,这两个配合起来,弄个网站的成本真的低到尘埃里了。这就是我现在的首选方案。

想感受那种“指哪打哪”的前端开发体验吗?赶紧去试试 GLM-5V-Turbo 的视觉编程吧。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/269941.html