在 AI 大模型应用开发这个领域里,Anthropic 公司推出的 Claude 系列凭借出色的逻辑理解能力,还有超长上下文处理窗口,受到了很多开发者的青睐,许多技术团队都希望能把 Claude API 整合进自己的产品当中,但是对国内开发者而言,怎样稳定合规地接入 Claude API 一直是个很头疼的技术问题,这不光涉及网络层的连通性,还牵扯到账号安全跟业务连续性,

想要搞清楚直连的难点,得先了解 Claude API 的基础架构布局,Anthropic 的服务主要搭建在海外顶尖云服务商的基础设施之上,它的安全风控策略很严格,

从网络这个角度来说,国内常规公网环境去访问海外的 API 端点,常常会碰到延迟高、丢包率大,甚至连接直接中断的状况,这种不稳定的网络条件对需要实时流式返回结果的大模型应用来讲是没法接受的,会严重拖累用户体验,

为了激活成功教程上面提到的痛点,开发者们通常会尝试几种不一样的技术路线来实现合规稳定的访问,

有一种比较常见的做法是借助海外中转服务器,开发者可以在合规的海外云主机上部署一个简易的代理服务,国内应用端把请求发给中转服务器,再由中转服务器转发到 Claude 官方 API,这个方案在某种程度上解决了网络可达性的难题,但是中转服务器的引入会增加请求的总体延迟,而且中转服务器自身的 IP 如果不够干净,仍然存在被 Anthropic 风控的隐患,维护中转服务也会增加运维开销,

另一种更加成熟且稳定的路线是利用专业的 API 代理服务,市面上已经有一些专门针对国内开发者的 Claude API 代理平台,它们通过多节点部署,还有优化的网络链路,能够提供低延迟高可用的接入体验,这类平台的核心优势体现在几个方面:

网络性能优化

通过国内多节点部署,平均延迟可以控制在 200 毫秒以内,相比直连海外 API 动辄上千毫秒的延迟,体验提升很明显,服务可用率通常能达到 99.8% 以上,这对生产环境的稳定性来说很关键,

完全兼容官方接口

这些平台通常 100% 兼容 Anthropic 官方 API 格式,开发者只需要替换 base_url 就能使用,代码几乎零改动,迁移成本很低,

解决风控难题

专业平台已经处理好了账号跟风控的技术问题,开发者不需要自己去搭建维护中转服务,也不用担心因为 IP 或者账号问题导致服务中断,这能节省大量的运维精力,

支付跟结算便利

支持人民币结算,可以用支付宝或者微信支付,还能开具发票,这对国内企业来说很方便,不需要处理美元支付跟跨境结算的麻烦,

在代码层面实现 Claude API 的调用,通常有两种方式,一种是用官方提供的 SDK,另一种是直接采用 OpenAI 兼容的接口配置方式,考虑到很多开发者现有的代码库是基于 OpenAI 架构搭建的,采用兼容接口的配置方式往往能极大降低迁移成本,

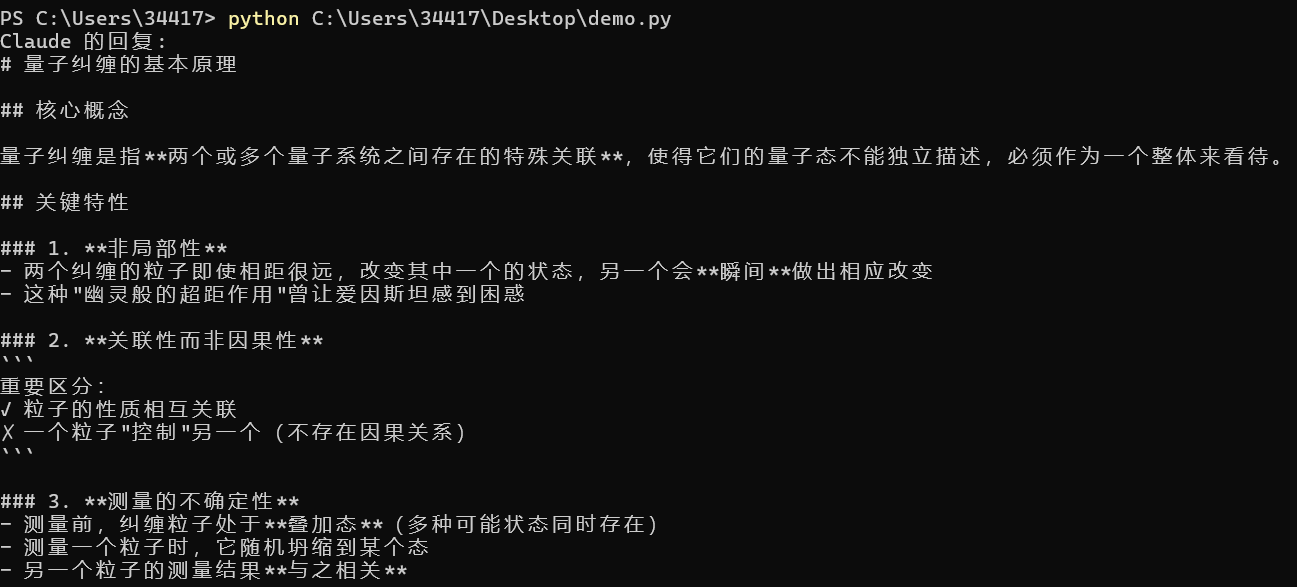

下面是一个基于 Python 的示例,展示怎样通过代理平台(claudeapi.com)来调用 Claude 模型,这里重点展示配置的思路,

import openai # 核心配置:把 base_url 指向代理平台提供的接入地址 # 只需要修改这一行,其他代码保持不变 client = openai.OpenAI( base_url="https://api.your-proxy-platform.com/v1", # 替换为代理平台https://claudeapi.com的 API 地址 api_key="your_api_key_from_platform" # 填写平台提供的 API 密钥 ) def get_claude_response(prompt): """ 通过兼容 OpenAI 的接口调用 Claude 模型 """ try: # 指定具体的 Claude 模型名称 chat_completion = client.chat.completions.create( messages=[ { "role": "user", "content": prompt, } ], model="claude-4-opus-", # 选择你需要的 Claude 模型 ) return chat_completion.choices[0].message.content except Exception as e: print(f"调用出错: {e}") return None # 测试调用 user_input = "请解释一下量子纠缠的基本原理" response = get_claude_response(user_input) if response: print(f"Claude 的回复: {response}") 在这个配置里,核心在于 base_url 的设置,它不再指向默认的官方地址,而是指向了代理平台提供的专用入口,这个入口背后是平台优化过的网络链路,还有合规的转发机制,能够绕过网络限制,保证连接的稳定性,

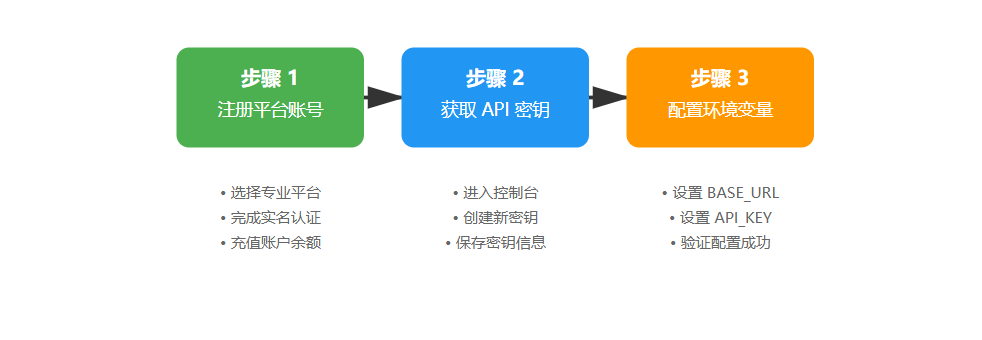

专业代理平台的接入流程通常很简单,一般分为三个步骤:

第一步:联系技术支持

通过平台提供的联系方式(微信、企业微信)联系技术顾问,说明你的需求,

第二步:快速获取密钥

通常在 5 分钟内就能获取到专属的 API Key,这个速度比自己去注册海外账号快很多,

第三步:替换配置开始使用

在代码里替换 base_url,然后就可以开始调用了,整个过程不需要修改业务逻辑,

技术支持响应

专业平台通常提供工作日 9:00-22:00 的技术支持响应,采用一对一专属技术顾问的模式,不会拉群骚扰,只提供必要的技术支持,如果在接入或者使用过程中遇到问题,可以直接联系技术顾问快速解决,

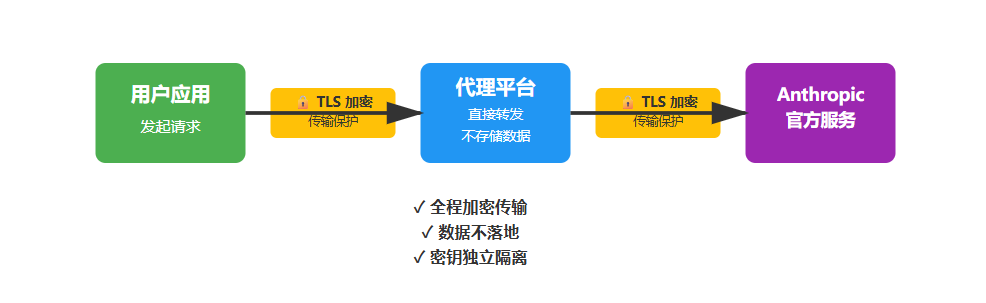

使用代理平台的时候,很多开发者会关心数据安全的问题,正规的代理平台通常采用直接转发的模式,具体来说:

数据不落地

请求会直接转发到 Anthropic 官方,平台不会存储对话内容,这保证了数据的隐私性,

传输加密

全程采用 TLS 加密传输,保障数据在传输过程中的安全性,

密钥独立隔离

每个用户的 API Key 独立隔离,通过多节点负载均衡来保证服务的稳定性,

合规性保障

专业平台通常会处理好账号跟支付的合规问题,避免因为账号问题导致服务中断,这对生产环境的业务稳定性来说很重要,

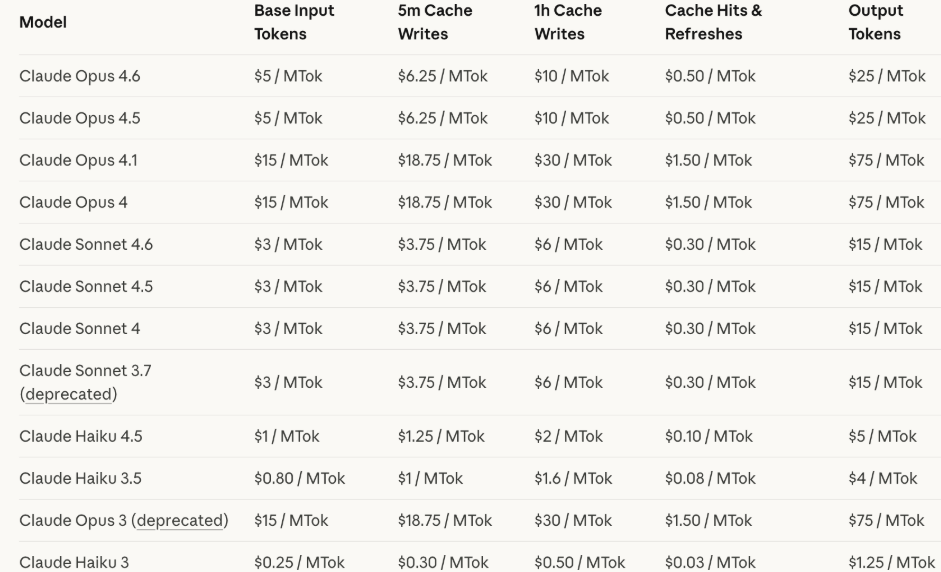

代理平台通常采用按量付费的模式,这种计费方式对开发者来说比较友好:

无固定费用

没有最低消费要求,也没有月费,用多少付多少,这对初创团队或者个人开发者来说很友好,

Token 计费

价格按输入跟输出 Token 分别计费,通常以人民币每百万 Token 为单位,比直接用美元支付更直观,

缓存优化

支持缓存机制来降低成本,对重复的上下文内容可以通过缓存减少计费,

支付便利

支持支付宝跟微信支付,还能开具发票,这对企业报销来说是个优势,不需要处理跨境支付的麻烦,

实际使用数据

根据平台公开的数据,目前每周 Token 总输出量已经超过 3200 万,累计服务开发者超过 10000 人,这说明这种模式已经被市场验证了,

实现 Claude API 的国内稳定接入是个涉及网络、合规、风控的综合性技术问题,简单的网络技术手段虽然能解决一时之需,但在生产环境里往往面临着很大的安全隐患跟不稳定性,通过专业的代理平台(claudeapi.com),结合优化的网络链路跟企业级的技术支持,往往是目前比较靠谱的解决方案,能够保障业务的长期稳定运行,

看得出,在全球化 AI 应用的浪潮下,怎样合规高效地利用海外顶级算力资源,是每个技术团队都需要持续探索的核心能力,如果在接入配置或者 API 稳定性方面有技术疑问,可以跟平台的技术团队进行交流。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/264136.html