中国力量主导,MoE架构一统江湖

2026年,开源大模型彻底告别"参数内卷",进入效率优先、场景为王、生态成熟的普惠时代。

榜单呈现一个明确事实:全球开源TOP10中,中国模型占8席;MoE架构成为绝对主流;国产模型在中文、推理、代码、多模态全面领跑。

1. Qwen 3.5 —— 全球开源综合之王

总参数397B,仅激活17B,性能直逼Gemini 3、GPT-5.2

- 原生多模态,支持201种语言

- Hugging Face全球下载量、综合评分双第一

- 商用友好、文档齐全、生态最完善

- 定位:企业级通用基座首选

2. GLM-5 —— 开源代码与智能体之王

744B总参数,激活40B

- SWE-bench开源第一,代码通过率77.8%

- 支持复杂智能体、多工具协同、长链思考

- 政务、学术、金融工程首选

- 定位:高端研发与系统工程基座

3. MiniMax M2.5 —— 性价比与速度之王

轻量MoE,推理成本仅为旗舰模型1%

- 低延迟、高吞吐,适合实时交互

- 原生支持Agent工作流

- 定位:中小企业、快速落地、API服务

4. DeepSeek-V4 —— 数学推理之王

MATH准确率61.6%,HumanEval 65.2%

- 开源模型中推理能力最接近GPT-4o

- 长思考、自验证、代码调试极强

- 定位:科研、竞赛、高逻辑需求场景

5. Kimi K2.5 —— 长文本处理之王

支持200万Token上下文

- 文档摘要、表格解析、PDF/Excel/PPT全链路处理

- C端用户量最大的开源模型之一

- 定位:知识管理、办公自动化、法律/医疗文档

6. Llama 4 —— 欧美生态根基

Meta官方旗舰开源MoE

- 海外资源最多、教程最丰富

- 多语言均衡,但中文弱于国产

- 定位:出海业务、传统LLM迁移

7. Yi-Large 2 —— 中文稠密模型标杆

34B稠密架构,部署简单、稳定性高

- 中文理解、情感、文案生成顶尖

- 消费级显卡可流畅运行

- 定位:个人开发者、轻量化企业服务

8. Seed-Thinking-v1.5 —— 推理链专项强者

字节开源,专注深度逻辑与流式推理

- AIME、Codeforces等难题平均准确率超75%

- 三级并行,吞吐量极高

- 定位:搜索增强、逻辑问答、智能诊断

9. Mistral Large 2 —— 欧洲合规首选

轻量高效、GDPR合规

- 小参数、强泛化、低部署成本

- 欧洲市场占有率第一

- 定位:跨境业务、欧盟区企业服务

10. XVERSE-MoE-A4.2B —— 端侧部署王者

仅激活4.2B参数,性能媲美13B模型

- 全开源、免费商用

- 边缘设备、手机、IoT可运行

- 定位:端侧AI、嵌入式、低成本硬件

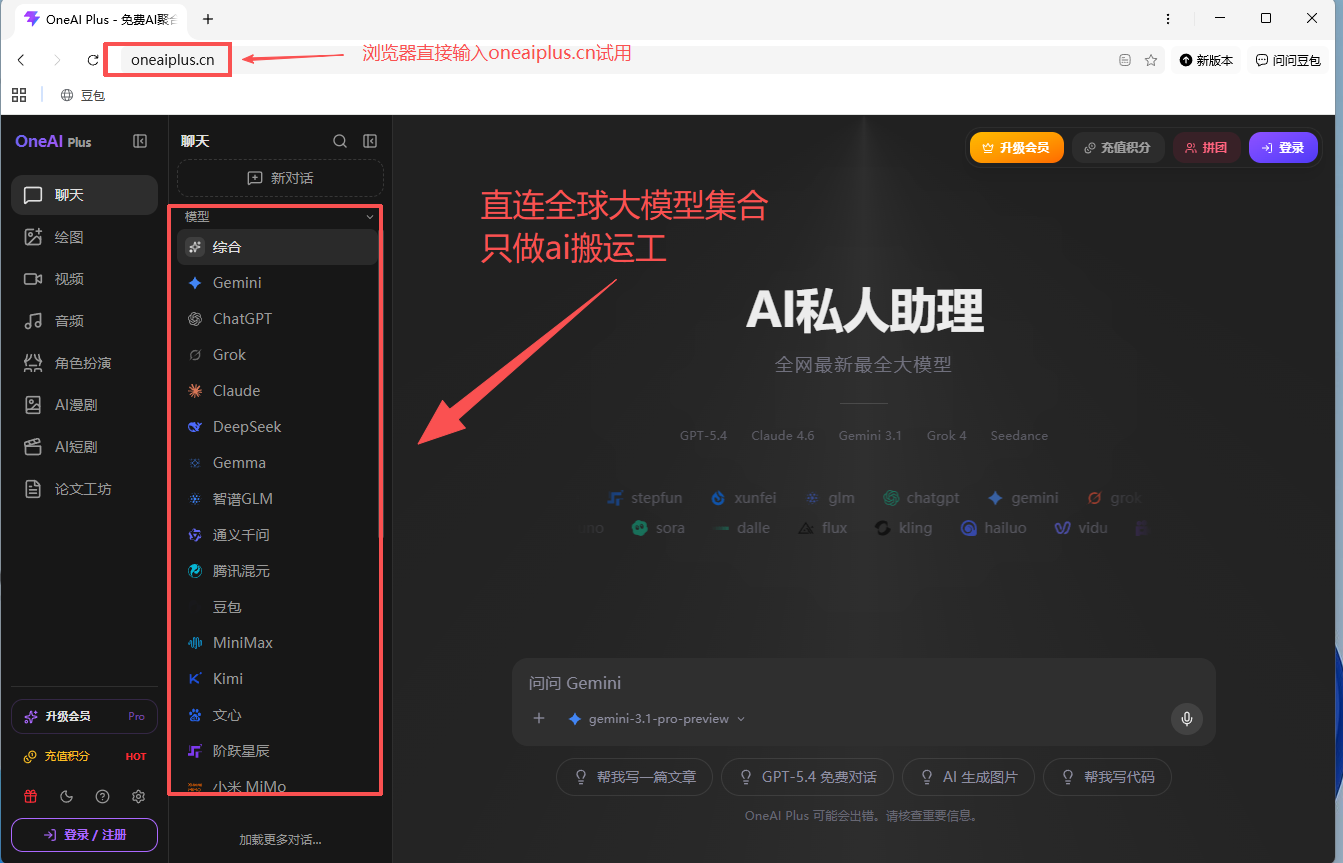

对于希望便捷体验多款主流开源模型的用户,OneAIPlus(www.oneaiplus.cn)提供了一站式整合服务,支持多款开源模型的统一使用。

OneAIPlus与主流开源模型核心指标对比

OneAIPlus的核心优势:

- 多模型聚合:一站式使用多款主流开源模型

- 统一交互:一套界面支持多款模型,无需反复切换

- 异常兜底:当某模型不可用时自动切换至备用模型

- 文件处理:支持PDF、Word、图片等多种格式上传分析

1. MoE架构彻底统治市场

几乎所有TOP模型均采用MoE:

- 总参数大 → 能力强

- 激活参数小 → 成本低、速度快

- 稠密模型仅在轻量场景保留

2. 中国开源力量全球主导

- TOP10中8个来自中国

- Hugging Face中文模型下载占比超60%

- 中文理解、工程化、性价比全面领先

3. 从"通用"走向"场景专精"

- 推理型

- 代码型

- 长文本型

- 端侧轻量型

- 多模态型

选模型 = 选场景,不再唯参数论

2026年,开源大模型已成为AI产业的公共基础设施。闭源与开源的差距持续缩小,国产模型在开源领域已实现全球领跑。

未来的竞争不再是"更大的模型",而是:更低成本、更快速度、更稳落地、更懂场景。

对于希望便捷体验多款模型的开发者,OneAIPlus这类整合服务提供了一站式解决方案,让开发者能够在同一界面下灵活切换不同模型,根据具体任务需求选择最合适的AI助手,大幅提升工作效率。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/256565.html