2025年以来,从硅谷到国内,从Manus 到 Genspark,各类智能体(Agent)产品频频亮相,但在Agent产品真实应用过程中,各类问题也持续显现:写个报告引用的数据不可靠、开发的网站实际环境中很难运行……与实际商业需求存在明显脱节。这种“看似高效、实则落地不畅”的矛盾是当前整个Agent落地的普遍现状。另一个维度上,各家模型厂商的表现在benchmark上频频刷高,但亮眼数据背后,隐藏着落地应用中的诸多现实困境,这也引发了行业对核心问题的追问:这些被广泛追捧的模型高分,与真实应用落地之间,究竟存在怎样的差距?

图1:理想中的智能体 vs 实际落地的智能体

图1:理想中的智能体 vs 实际落地的智能体

"客户说 Agent 筛选的简历,100份里有20份根本没法看。"

"生成的代码能跑,但格式一团糟,接入我们的系统就报错。"

"做投资分析报告,看着像模像样,但漏掉了最重要的财务数据。"

回望人类工业文明,每一次技术革命均会提升生产力、重塑生产与消费关系:第一次工业革命蒸汽机推动工厂化生产;第二次工业革命中电力与流水线大幅提效,福特主义工资体系让工人可消费自身生产的工业品;第三次工业革命,信息技术重构服务业,知识工作者创造价值,同时成为数字产品核心消费群体。而当前已经不再是单纯的生产力工具升级,特别是最小生产单元出现了新范式:Token成为了最基本的价值单元,个人和组织已经可以直接购买智能化的"产品规划能力"、"数据分析能力"、"研究辅助能力",消费的本质正在从"购买产品"转向"购买能力"——这意味着可独立交付价值的智能能力本身,已成为可交易、可定价的商品。当 AI 能力成为可交易的商品,我们面临一个前所未有的挑战:如何评估这些能力的真实价值,或者说评估可出售的 AI 能力?传统软件的评估相对简单,但 AI 能力的评估复杂得多:它必须在真实的生产环境中,面对模糊的需求描述、异构的输入数据、依赖判断的评价标准时,依然能够交付客户愿意付费的结果。

面对这一行业困境,来自上海创智学院,上海交通大学 GAIR 实验室的研究团队联合奇绩创坛及其校友企业网络中的多家 AI 创业公司,共同发起了 AlphaEval——一个锚定真实商业交付场景的生产级智能体评测基准。 AlphaEval 不问"模型能答对多少题",而是问"Agent 交付的结果,客户愿不愿意买单"。为了回答这个问题,团队首先做了一件"笨功夫":对奇绩创坛校友企业进行了系统性调研。

研究者向 50 家Agent产品企业发出问卷(收到27家有效回复),问卷包含 15 个问题,涵盖产品信息、技术现状和评测需求三个维度。这些公司覆盖了Agent落地的整个生命周期,从进入市场的早期到产品成熟期的各阶段,近 60% 服务 B 端客户,产品涵盖纯文本(85.2%)、图像(55.6%)、结构化数据(48.1%)、音视频(44.4%)等多种模态。调研揭示了一个令人警醒的现实:

59.3% 的企业反馈模型输出"稳定性差、结果不一致",51.9% 遭遇复杂场景下的指令遵循失效,40.7% 深受幻觉/事实性错误困扰。一位企业级 AI 产品负责人直言:"自动化定位每次运行后的问题,给出迭代建议,对多个迭代任务给出重要性排期"——这才是他们最迫切的需求。

仅 11.1% 的企业建立了结构化+自动化评测流程,33.3% 还在靠少量 Golden Samples 肉眼比对,25.9% 甚至没有任何明确的验收标准。

70.4% 的企业由开发人员兼职测试,严重挤占研发时间。专职测试团队仅存在于 18.5% 的企业中。11.1% 的企业完全依赖用户反馈,属于被动响应。

企业最迫切的三大需求依次是:自动化评测平台建设(权重 0.47)、客观效果评估标准(权重 0.24)、成本与效率优化(权重 0.18)。这份调研让我们确信:行业不缺 AI 能力,缺的是衡量 AI 能力的标尺。AlphaEval 关注的不是评估 AI"能做什么",而是在于评估 AI"能交付什么商业价值":我们通过与合作公司 深度交流协作,构建了一个包含 94 个真实商业任务 的生产级评测体系。

这和学术 Benchmark 上的表现形成了鲜明的对比。在 MMLU 上,最先进的模型已经超过 95%;在 SWE-bench(代码生成)上,前沿模型也已经超过 80%,如果你只看这些数字,你会觉得 AI Agent 已经所向披靡了。但 AlphaEval 告诉你:那些分数是另一个世界的产物。研究者通过与7家公司的深度合作,发现了评测体系与生产环境之间存在三个结构性鸿沟:

●第一道鸿沟:任务未充分指定。学术 Benchmark 会给你明确的需求:"请用 Python 写一个函数,实现快速排序。"但在实际业务中,客户可能只会说:"帮我优化一下这个采购流程,能省点成本最好。" 这听起来差不多,但背后的复杂度天差地别。

●第二道鸿沟:判断主观性。学术 Benchmark 可以用自动化指标判断对错——代码能跑通就是 PASS。但真实的商业交付物,需要领域专家来判断:"这份投资分析报告,写得够不够专业?" 但抱歉,这个问题没有标准答案。

●第三道鸿沟:持续演进。学术 Benchmark 是一次性构建的静态测试集。但生产环境不变,客户的需求在变,Agent 的能力在变,评测标准也在变。

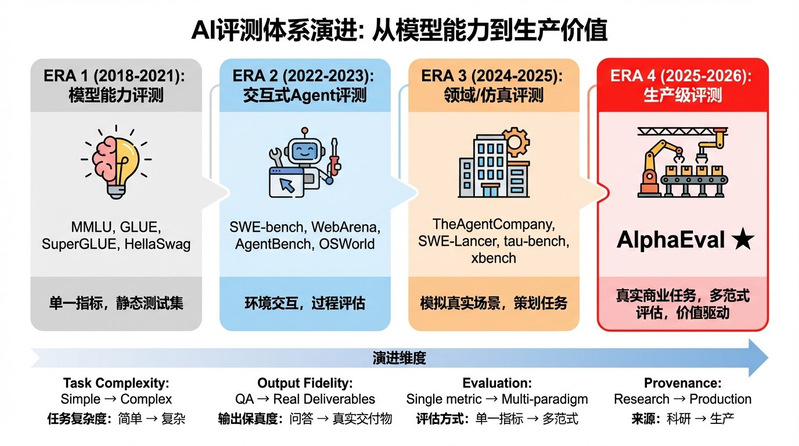

这就是为什么,即使 80% 的 Agent 系统已经进入生产或试点阶段,我们缺少真实世界的Benchmark 去捕捉这种混乱的现实。事实上,AI 评测体系本身也在经历一场范式演进。回顾过去几年,我们可以清晰地识别出四个阶段:

●ERA 1(2018-2021):模型能力评测。以 MMLU、GLUE、SuperGLUE 为代表,用静态测试集和单一指标衡量模型的知识储备与推理能力。这个阶段的评测假设很简单:答对就是好模型。

●ERA 2(2022-2023):交互式 Agent 评测。SWE-bench、WebArena、AgentBench 的出现标志着评测从"答题"走向"做事"——模型不再只是回答问题,而是需要在环境中交互、使用工具、完成多步任务。评测开始关注过程,而不仅仅是结果。

●ERA 3(2024-2025):领域仿真评测。TheAgentCompany、SWE-Lancer、τ-bench、xbench 尝试模拟真实工作场景,策划领域特定任务。但这些任务仍然是研究者事后构造的,与真实的客户需求之间隔着一层"翻译"。

●ERA 4(2025-2026):生产级评测。这正是 AlphaEval 所处的位置——不再模拟,而是直接从生产环境中提取任务;不再依赖单一指标,而是融合多种评估范式;不再只衡量能力,而是衡量可交付的商业价值。

这四个阶段的跃迁,对应着四条同步演进的维度:任务复杂度从简单到复杂,输出保真度从问答到真实交付物,评估方式从单一指标到多范式融合,任务来源从科研构造到生产环境。AlphaEval 正是这四条维度同时探索。

图2:AI评测体系演进:从模型能力评测(ERA 1)到交互式Agent评测(ERA 2)、领域仿真评测(ERA 3),再到AlphaEval代表的生产级评测(ERA 4),沿任务复杂度、输出保真度、评估方式、任务来源四个维度同步跃迁。

图2:AI评测体系演进:从模型能力评测(ERA 1)到交互式Agent评测(ERA 2)、领域仿真评测(ERA 3),再到AlphaEval代表的生产级评测(ERA 4),沿任务复杂度、输出保真度、评估方式、任务来源四个维度同步跃迁。

94个向客户交付的任务,来自7家公司。AlphaEval 的核心价值,在于将任务、评测标准、验收成果与价值衡量均锚定真实商业场景:每项任务(Query)均源自用户在真实环境下的实际需求,每项评测标准(Rubric)均对齐客户真实的验收流程与规范,每项验收成果(Answer)均来自真实付费客户的交付结果,每项价值衡量(Value)均匹配真实工作流中的人力任务价值。通过这一体系,AlphaEval 把原本隐性、依赖主观判断的商业标准,转化为可量化、可评测的任务体系。

从需求到基准:最短路径构建框架。AlphaEval 不仅是一个 benchmark,更提出了一套可复用的"需求到基准"构建框架(Requirement-to-Benchmark Construction Framework)——将真实的生产需求系统性地转化为可执行、可自动化的评测任务。这个框架本身就是核心贡献之一:给定任何真实生产需求,都可以快速构建出严格、可复现的自动化评测,让生产级评测像学术基准测试一样便捷。构建过程分为四个阶段:

筛选以 AI Agent 为核心产品、拥有付费客户或有真实的可交付物的企业,覆盖多个 O*NET(https://www.onetonline.org/find/descriptor/browse/2.A) 职业域以确保多样性。

●筛选标准:(1)有明确的付费客户/真实的可交付物;(2)AI 驱动的可交付工作流;(3)多样化输入模态;(4)愿意共享匿名数据。

与每家公司进行约一个月的深度合作,每周至少一次会议。核心洞察:生产需求几乎不会以"写好的任务说明书"出现——它们通过反复对话逐步浮现。企业展示真实工作流时,往往会暴露"文档描述"与"实际验收流程"之间的差距。我们有意保留需求的模糊性、隐含约束和领域知识依赖,因为这正是生产任务比研究任务更难的根本原因。

每个任务被标准化为自包含包:

●query.md — 自然语言任务描述(保留原始指定程度)

●task.yaml — 结构化元数据(任务名、领域、难度、评测类型、超时时间)

●files/ — 原始输入文件(PDF、Excel、图片等)

●.eval/rubric.py — 评估脚本(融合一种或多种评估范式)

AlphaEval 的核心创新在于:它的每一个任务都来自真实的商业交付场景。它的核心差异的是从 “研究级测试” 转向 “生产级验证”,关键特点包括:

●企业筛选:我们的目标是AI原生型初创企业以及AI强相关企业,为保证所有的QA都可以评估真实可交付的价值,这类企业必须拥有真实的付费客户或有真实的可交付物。筛选标准包括不限于:(1)拥有市场验证过需求的活跃客户群;(2)以智能体为核心的产品;(3)多样化的输入模态;(4)愿意共享合规匿名数据等;

●真实任务来源:与 7 家有付费客户或有真实的可交付物的公司合作,提炼 94 个商用任务,覆盖 6 个 O*NET 职业域:招聘(人力资源)、金融与投资、采购与运营、软件工程、医疗与生命科学、技术研究,每个任务均保留生产环境的模糊性和复杂性;

●多模态输入:约 42% 任务以 PDF 为主要输入,21% 为 Excel/CSV,25% 为 Markdown/文本,12% 为代码/YAML等,还原真实工作中混合格式处理需求;

●完整产品评估:不局限于测试孤立模型,而是针对 Claude Code、Codex、GitHub Copilot、Cursor 4 款商用智能体产品,结合 6 款前沿大模型(Claude Opus 4.6、GPT-5.2、Gemini 3 Pro、Kimi K2.5、GLM-5、MiniMax M2.5)的 14 种配置,捕捉模型 + 载体的综合性能。

图4:AlphaEval 94个任务的领域分布。任务覆盖6个O*NET职业域,包含AI Agent在企业级场景中的核心应用方向。

图4:AlphaEval 94个任务的领域分布。任务覆盖6个O*NET职业域,包含AI Agent在企业级场景中的核心应用方向。

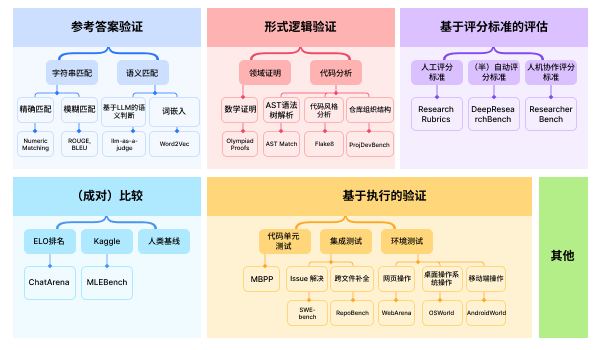

同时搭建了融合多种评估范式的统一框架,每个任务平均 2.8 种评估类型,确保评估全面性:

1.参考答案验证(~11%,10个任务):字符串匹配 +语义匹配

2.形式化逻辑验证(~21%,20+个任务):数学证明+代码逻辑

3.评分标准评估(~56%,53个任务):人工/半自动/人机协同

4.执行验证(~12%,11个任务):代码单元测试+环境状态测试

5.LLM-as-Judge(~56%,53个任务):作为跨范式语义评估方法

图5:我们梳理了AI智能体评估方法的综合分类法,分为六大主要范式,包含13个叶节点类型。AlphaEval实现了13个叶节点类型中的8+个。

图5:我们梳理了AI智能体评估方法的综合分类法,分为六大主要范式,包含13个叶节点类型。AlphaEval实现了13个叶节点类型中的8+个。

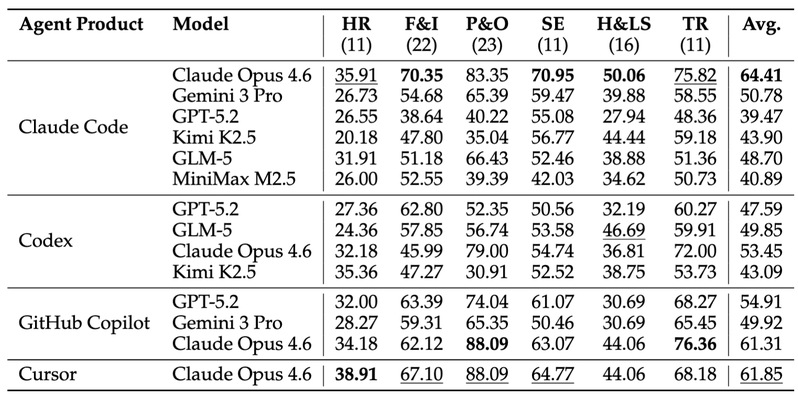

表1:AlphaEval 全域评测结果(0-100分)。14种智能体配置(4款产品 × 6款模型)在6个O*NET职业域上的平均得分。最优配置(Claude Code + Claude Opus 4.6)仅获64.41分,载体选择对性能的影响与模型选择同等重要。

表1:AlphaEval 全域评测结果(0-100分)。14种智能体配置(4款产品 × 6款模型)在6个O*NET职业域上的平均得分。最优配置(Claude Code + Claude Opus 4.6)仅获64.41分,载体选择对性能的影响与模型选择同等重要。

通过实测 14 种智能体配置,得到了一系列非共识的发现:

最优配置(Claude Code + Claude Opus 4.6)平均分仅 64.41,与 MMLU 95%、SWE-bench 80% 的亮眼成绩形成刺眼反差,凸显研究与生产之间的巨大落差。

行业习惯用模型排名来选型,但数据告诉我们:脚手架(scaffold)对性能的影响也非常大。同一个 Claude Opus 4.6,在不同载体中分差达 11 分(64.41 vs 53.45)。一个直观的例子: GPT-5.2在 Claude Code 中仅得 39.47(全场倒数第一),换到 GitHub Copilot 中就跃升至 54.91,金融领域差 24 分,采购领域差 34 分。可见,Scaffold 的 prompt 策略、工具编排、错误恢复机制,决定了模型能力是被"解锁"还是被"压制"。

在最需要专业知识的医疗领域,GLM-5 通过 Codex 得到 46.69 分,而价格贵 5-10 倍的 Opus 在同一载体中只有 36.81。GLM-5 在采购运营中胜过 Kimi K2.5,但在招聘中反而落后。"一个排行榜定天下"的假设在生产环境中或许彻底失效。

Agent做有明确标准、能算得清的采购运营工作,最高分能到 88.09 分;但做靠感觉、没标准答案的招聘打分,最高只有 38.91 分。Agent 能同时优化 2000 个零件的 BOM 成本,却理解不了简历里的“领导力潜质”的含义。特别是在如像计算类“可量化标准”的任务中的普遍得分比软技能判断任务高出 2-3 倍,这启发我们,下一阶段AI能力探索不在计算复杂度,而在于对主观范畴的判断和理解。

轨迹表明,有些智能体在碰到解决不了的限制条件时,宁愿编造一个看似合理的假答案,也不愿说"我做不到"。最强模型 Opus 在深度研究任务中搜索 30-50 次后,仍然用过期数据自行填充——某次金融分析中,关键融资数据偏差甚至达 1.9-2.7 倍。

真实复杂任务里很容易连环出错、前后矛盾、违规优化、只看有利信息、主观判断偏差、看图看错等问题,这些问题在 SWE-bench 等学术基准中很难被捕捉:比如,出现级联依赖失败的问题,一份临床试验报告开头一个地方出错,连锁反应把整篇报告、整个流程带崩。

这些发现共同指向一个更深层的结论:研究与生产之间的差距,不是一条可以逐步缩小的直线距离,而是方向问题。不存在一条从"实验室强"到"生产好用"的线性路径。行业需要的不是更高的单一分数,而是一套能映射真实生产环境完整能力空间的评测体系。

我们通过对94个测试任务的商业实用性逐一验证,搭建出一套科学又好落地的AI部署成本效益核算体系,终于让AI的商业价值从“模糊描述”变成“精准数字”,不管是模型开发者还是企业用户,都能从中找到实用的决策参考。核心公式为“任务得分×任务价值”。例如一个价值2000美元的任务,若AI得分为70分,其对应的自动化价值即为1400美元,有效解决了AI价值难以量化的问题。任务价值我们对中国和美国市场做了分类,借鉴了美国用BLS职业薪资,中国用北京2025Q4人力资源市场薪资报告等数据,并根据实际情况给予一定的系数修正。同时我们引进了行业专家校准,修正AI未覆盖的行业隐性因素(代码复用、任务关联性等);6大领域各有适配策略(如小程序开发按复用率减工时、临床试验补估复杂度),修正系数0.33-1.54。

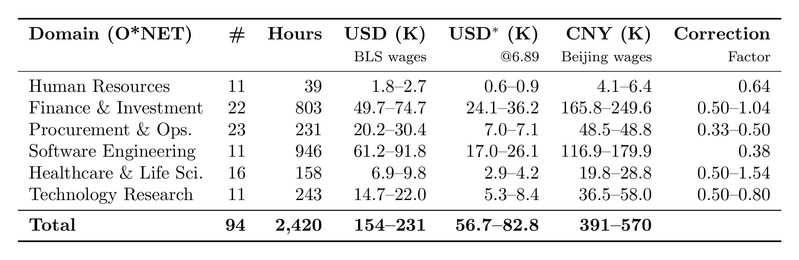

表2:94个任务的人工替代成本估算(两阶段:AI估算+专家校准)。USD基于美国BLS职业薪资(25-75分位时薪×1.3福利系数×工时);USD*为CNY按1 USD = 6.89 CNY换算的等值美元;CNY基于北京2025Q4人力资源市场薪资报告(×1.45福利系数);Correction Factor为专家校准修正系数(<1表示AI高估工时,>1表示AI低估)。

表2:94个任务的人工替代成本估算(两阶段:AI估算+专家校准)。USD基于美国BLS职业薪资(25-75分位时薪×1.3福利系数×工时);USD*为CNY按1 USD = 6.89 CNY换算的等值美元;CNY基于北京2025Q4人力资源市场薪资报告(×1.45福利系数);Correction Factor为专家校准修正系数(<1表示AI高估工时,>1表示AI低估)。

本次评估共计94个测试任务,总工作量达2420个专业工时,约合60人一周的工作量;经科学测算,这些任务对应的经济价值区间为15.4万-23.1万美元。研究采用的两阶段测算模式,兼顾效率与精准度,为行业提供了可复用的AI价值测算框架。

AlphaEval 揭示的核心矛盾是:实验室里的"强"和生产环境里的"有用"之间,隔着整整一个工程化鸿沟。当 AI 能力日益商品化的时代,真正重要的不是模型在实验室里能做什么,而是它在真实世界中能交付什么价值。AlphaEval 的首要服务对象是创业者和产品开发者,为他们提**品真正能够投市场使用的风向标。当创业者在 AlphaEval 上评测自己的 Agent 时,得到的不是实验室里的理论分数,而是直接对应市场现实的反馈,帮助他们判断产品是否已经 ready for market,哪些领域需要重点改进,以及与竞争对手相比自己处于什么位置。现在,是时候重新定义"Agent 能力"了。

●论文标题:AlphaEval: Evaluating Agents in Production

●项目主页:https://alphaeval.ai/

●论文链接:https://github.com/GAIR-NLP/AlphaEval/tree/main/paper

●Github链接:https://github.com/GAIR-NLP/AlphaEval

AlphaEval 的构建离不开多家合作机构与企业在真实业务场景、行业知识和数据资源上的支持。在此,我们向所有参与共建的合作方表示诚挚感谢。特别感谢以下公司/机构对本项目提供的数据支持与场景贡献:

●奇绩创坛:提供了创业路演辅导相关数据支持,行业研究类咨询服务数据。

●跨赴科技:提供了小程序全栈生成场景下的真实业务数据。

●POET:贡献了企业级 RAG 问答场景数据与 Excel 表格场景数据。

●HunterAI:提供了智能招聘场景的支持。

●语核科技:贡献了工业场景、运筹优化与数学规划的复杂决策数据。

●CinoCore Health:提供了临床研究 eCRF 系统、访视窗口推算等医疗场景的真实业务数据。

●机器之心:提供了 AI 行业深度分析数据。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/253497.html