《从零构建大模型》是一本由AI领域专家塞巴斯蒂安・拉施卡撰写的实战指南,带领读者从底层原理到实战落地,手把手构建大模型。全书涵盖大模型发展脉络、Transformer架构、文本数据处理、注意力机制、GPT模型构建、预训练流程、模型微调及指令微调等核心内容,适合想真正入门LLM、不想只做表面功夫的读者。该书以“亲手构建才是真理解”为核心理念,是全球开发者追捧的大模型实战教程。

《从零构建大模型》:从底层原理到实战落地,手把手教你造大模型

(原书名:Build a Large Language Model (From Scratch))是 AI 领域专家塞巴斯蒂安・拉施卡(Sebastian Raschka)

撰写的大语言模型实战指南,中文版隶属图灵程序设计丛书,以 “亲手构建才是真理解” 为核心理念,是当前大模型入门与进阶的标杆读物。

塞巴斯蒂安・拉施卡是 Lightning AI 资深研究工程师,密歇根州立大学博士,威斯康星大学麦迪逊分校前终身教职助理教授,GitHub 热门项目「LLMs-from-scratch」(星标超 4 万)的创建者,也是《Python Machine Learning》等经典机器学习教材的作者。

从零构建大模型书籍:豆瓣评分 9.5,美亚评分 4.7⁄5,配套开源项目获社区广泛认可,是全球开发者追捧的大模型实战教程。

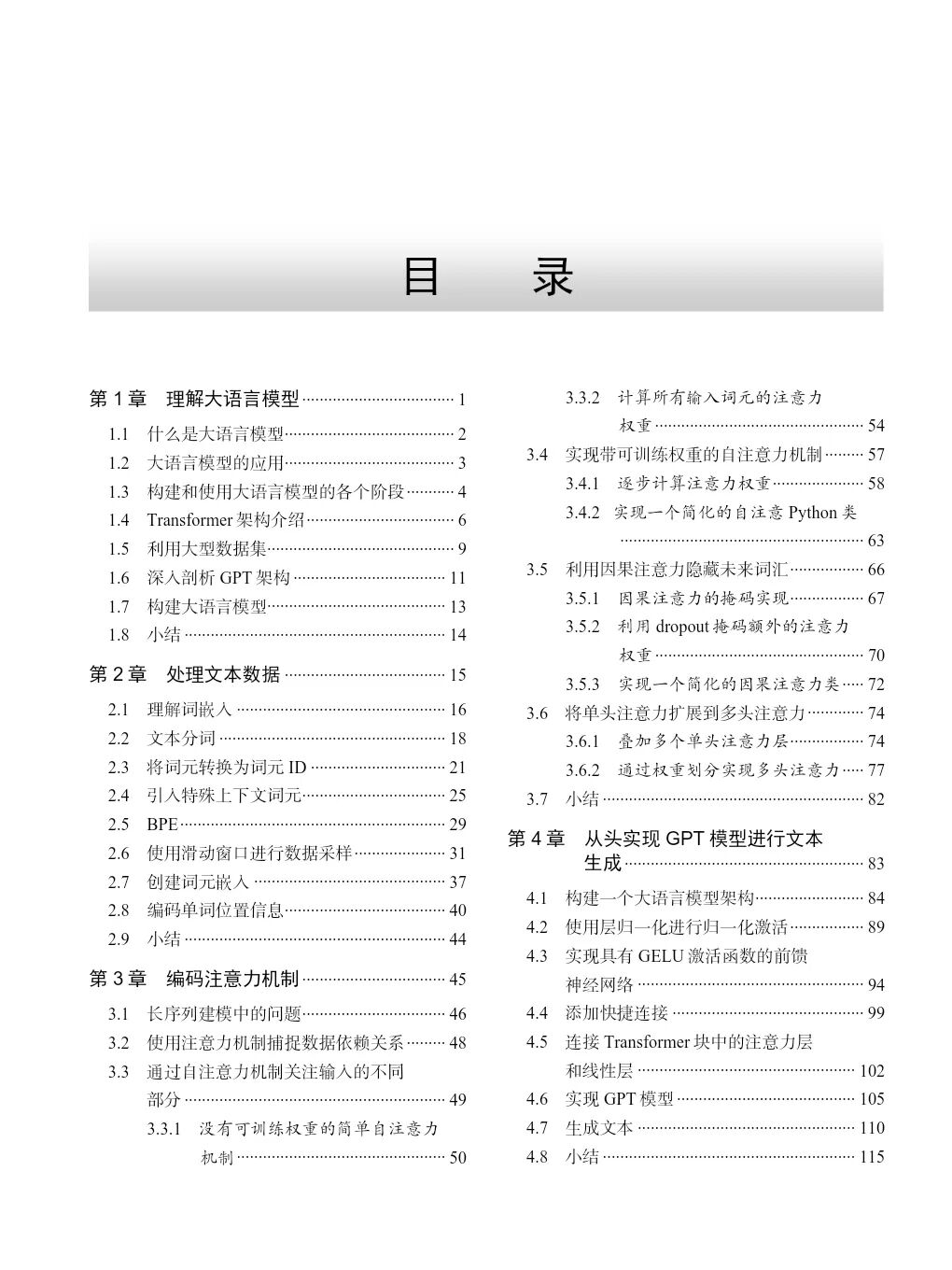

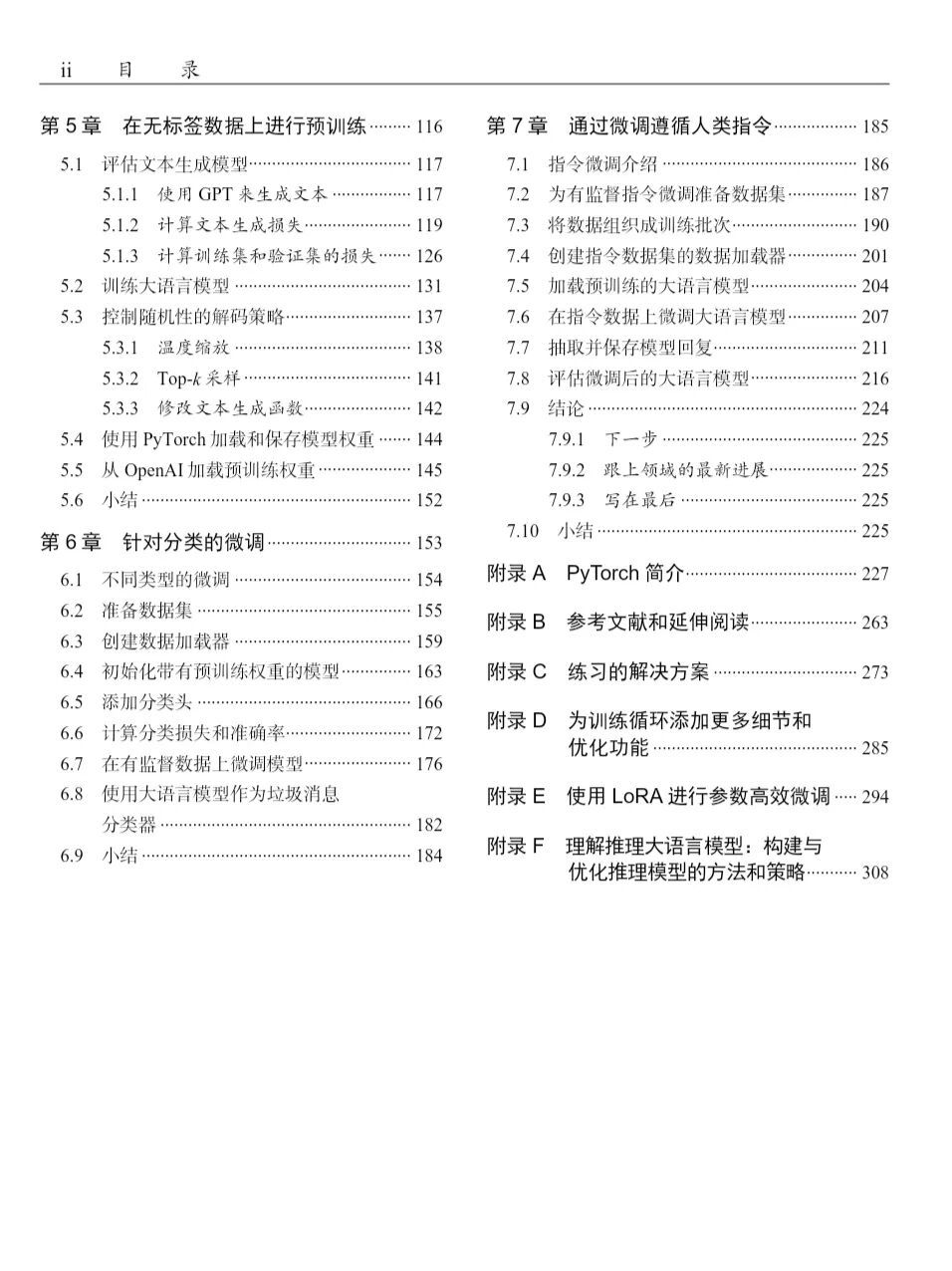

全书核心内容(共 7 章):

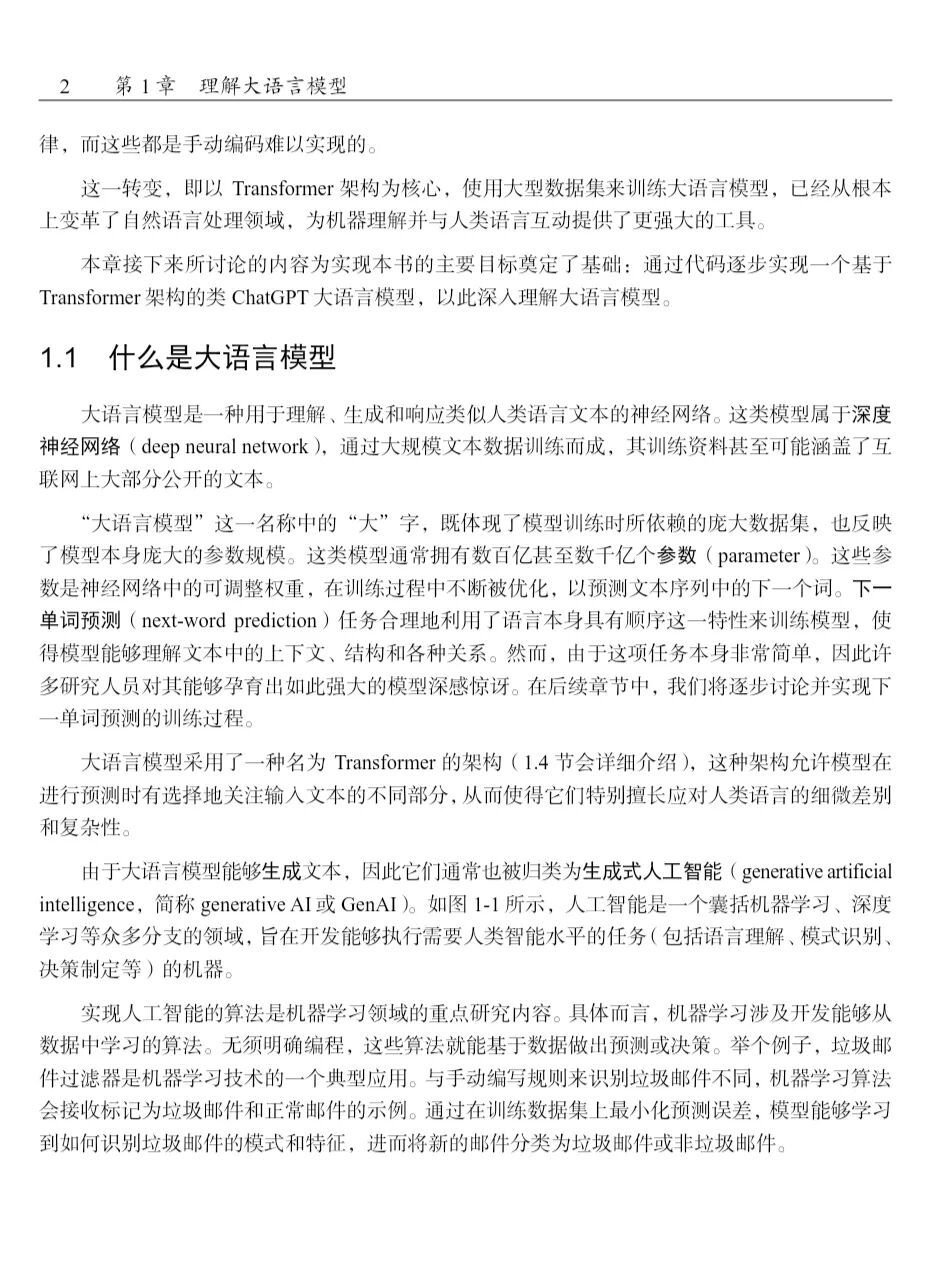

- 1:理解大语言模型:梳理 LLM 发展脉络,拆解 Transformer 架构核心,明确从零构建的体路径。

- 2:文本数据处理:详解 BPE 分词、数据清洗、格式转换,掌握高质量训练数据的制备方法。

- 3:注意力机制编码:从数学原理到代码实现,吃透自注意力、多头注意力 ——Transformer 的核心模块。

- 4:构建 GPT 模型:从零编写类 GPT 架构代码,实现文本生成的完整逻辑,打通模型 “骨架”。

- 5:预训练流程:搭建训练管道、优化训练策略,在通用语料上完成基础模型预训练。

- 6:模型微调:涵盖任务微调、预训练权重加载,适配文本分类、对话等特定场景。

- 7:指令微调与 RLHF:通过指令微调、人类反馈强化学习,让模型对齐人类意图,提升指令遵循能力。

- 下面是内容展示:

市面上讲大模型的书太多了,要么全是理论看不懂,要么只会教你调包、调用 API,看完还是不知道大模型到底怎么来的。

这本《从零构建大模型》是真的良心,从最基础的代码开始,一步步带你手写 Transformer、注意力机制、GPT 结构,没有花里胡哨的废话,每一章都能跟着跑起来。

对想真正入门 LLM、不想只做表面功夫的人来说,非常值得一读,干货密度很高,读完对大模型的理解完全上一个层次。

假如你从2026年开始学大模型,按这个步骤走准能稳步进阶。

接下来告诉你一条最快的邪修路线,

3个月即可成为模型大师,薪资直接起飞。

阶段1:大模型基础

阶段2:RAG应用开发工程

阶段3:大模型Agent应用架构

阶段4:大模型微调与私有化部署

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/252194.html