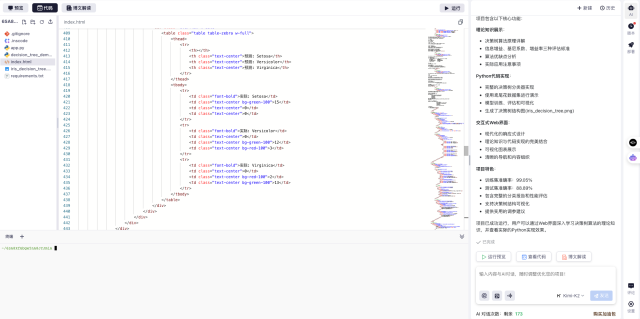

今天想和大家分享一个特别适合新手的实践项目——在InsCode(快马)平台上完成openclaw配置千问模型的第一步。作为一个刚接触AI模型的小白,我最初看到官方文档里那些复杂的配置步骤就头大,直到发现这个平台能直接把晦涩的文档转化成可运行的实例,简直像找到了救星!

- 环境检查与准备

新手最容易卡在环境配置上。平台生成的代码会先自动检查Python版本(要求3.8以上),如果不符合还会提示如何升级。我第一次运行时发现系统预装的Python是3.7,代码里的注释直接给出了用conda创建新环境的命令,连虚拟环境的名字都贴心地建议好了。

- 依赖安装自动化

传统教程里“pip install一堆库”的步骤,在平台生成的代码中变成了带进度条显示的智能安装。比如安装openclaw核心库时,代码会先检测是否已存在兼容版本,避免重复安装;遇到网络超时还会自动重试3次。最让我惊喜的是,它把容易混淆的依赖项(像transformers和torch的版本匹配问题)都提前处理好了。

- API密钥配置引导

申请千问API密钥原本需要跳转多个页面,但平台生成的代码里内置了带超链接的指引。运行时会弹出一个清晰的分步流程图:先点击哪个按钮注册、再到哪个菜单找密钥、最后如何复制到代码中。我还犯过把密钥粘贴错位置的低级错误,结果代码里的校验函数立刻提示“密钥格式不正确”,省去了半小时的无效调试。

- 最小验证案例

真正的“啊哈时刻”来自最后那个仅10行的测试脚本。它用最简结构演示了如何初始化客户端、发送问题并获取回复。我试着把默认的“你好”改成其他问题,立刻看到了千问模型流畅的多轮对话能力——这种即时反馈对新手建立信心太重要了!

- 预置的急救手册

项目里那个FAQ模块简直是宝藏。比如我遇到的“ImportError: libcudart.so.11.0”错误,文档要查半天,而这里直接给出3种解决方案:安装CUDA工具包、改用CPU模式或降低torch版本。每个方案都有适用场景说明,甚至标注了各方法的优缺点(像“CPU模式速度慢但无需显卡”)。

整个过程中最省心的是,完全不用自己搭建环境。在InsCode(快马)平台点击“运行”就能直接测试代码,遇到问题随时在AI对话区提问,系统会结合上下文给出针对性解答。比如当我问“为什么响应速度慢”时,它不仅解释了网络延迟、模型加载的机制,还建议我尝试调整max_tokens参数来优化。

对于想长期使用这个配置的朋友,平台的一键部署功能特别实用。我把调试好的项目部署成在线API后,手机浏览器都能随时调用,连Postman测试的curl命令都自动生成了。整个过程就像把乐高说明书变成了拼好的成品,既保留了学习价值,又规避了环境配置的坑。如果你也想零压力入门AI模型开发,这种“所见即所得”的方式真的值得一试。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/249949.html