当下,人工智能领域发展日新月异,新算法、大模型不断涌现,各类AI工具层出不穷。在这场激烈角逐里,OpenClaw凭借自身特性脱颖而出,不仅被爱好者赋予了一个亲切的昵称—龙虾,其本地部署也自成一派。它为何会有此昵称,本地部署又该如何操作?接下来,让我们一同深入探寻。

✅ 核心命名关联:“Claw”与龙虾的天然绑定

“Claw”意为螯钳,而龙虾具有代表性的特征就是一对螯钳,项目以此命名,是想让它像龙虾螯钳一样抓取任务、执行操作,这是“龙虾”昵称诞生的核心缘由。

✅ 视觉符号强化:官方图标奠定昵称基础

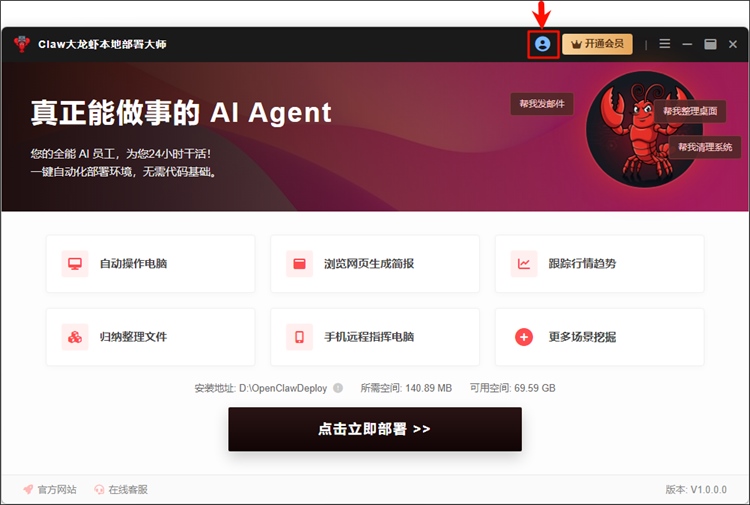

官方图标以红色龙虾为造型,呼应了名称中的螯钳意象,用户看到图标便会自然联想到龙虾,视觉设计与名称的结合,使得“龙虾 逐渐成为了大家常用的称呼。

✅ 社区文化发酵:“养龙虾” 让昵称深入人心

用户部署、调试、调教OpenClaw需投入时间精力,如同照料宠物。社区成员用亲切的口吻将这一过程称为“养龙虾”,也让该昵称在社区得到广泛认可与使用。

从官方仓库克隆源码至本地,安装所需语言环境与依赖库,手动配置环境变量与模型路径后运行脚本。此方法适合二次开发,但有依赖冲突风险,技术要求不低。

借助相关的部署软件/工具,它们能自动检测运行环境、安装依赖并下载预编译模型,用户仅需输入必要密钥完成配置便可便捷启动服务,有效降低技术门槛。

我推荐用Claw大龙虾本地部署大师,一款实用型AI Agent,可简化流程,实现自动化部署,低代码特性更是大幅降低了操作门槛,且注重数据隐私安全保护。

◾浏览器访问官网,下载安装包并运行,安装好后启动软件。

◾登录个人账号,若需解锁全部功能,需提前开通会员权限。

(1)环境与目录配置

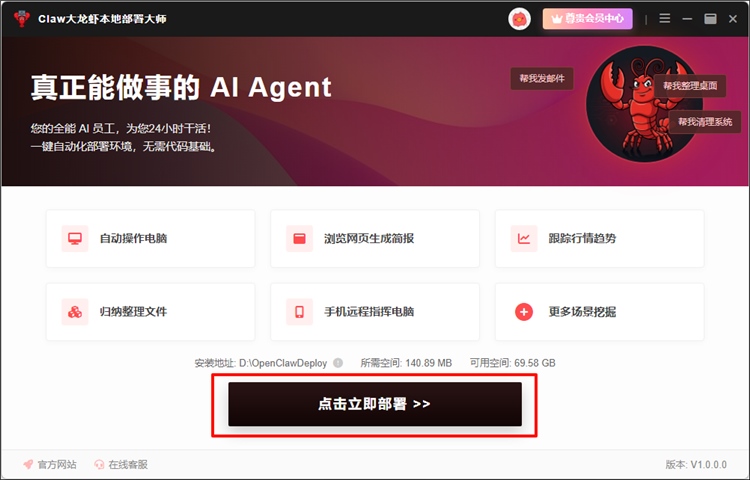

◾点击页面上的“点击立即部署”,系统会自动完成运行环境准备,无需手动操作。

◾配置工作目录,建议创建专用文件夹,不要选择「文档」或「桌面」,方便后续查阅。

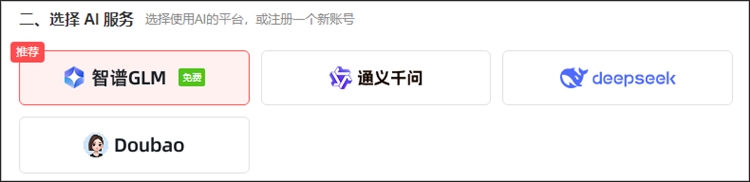

(2)AI服务与模型设置

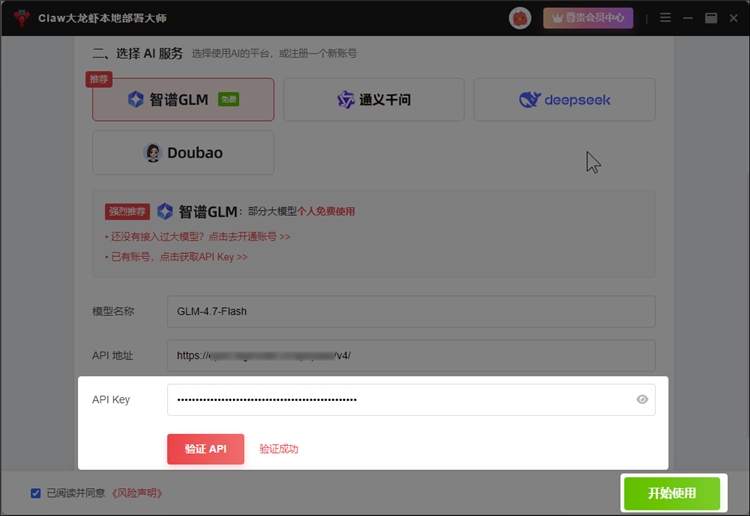

◾选择AI服务,目前提供智谱、通义千问、DeepSeek、豆包四种选择。

◾根据选定平台,输入对应模型名称(示例:GLM-4.7-Flash)。

◾开通模型权限:通义千问与豆包平台的模型在调用前需先开通对应使用权限。

(3)API Key获取操作

不同AI服务平台的API Key获取方式不同,具体步骤如下:

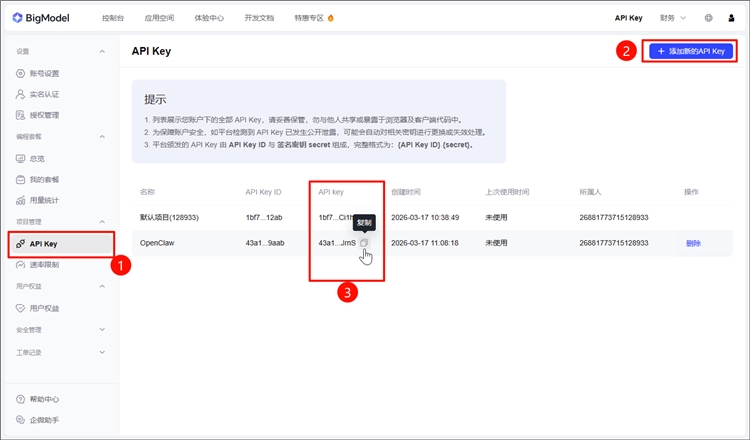

◾智谱:登录“智谱AI开放平台”,随后点击页面右上角“API Key”选择“添加新的API Key”,自定义密钥名称后复制生成的API Key。

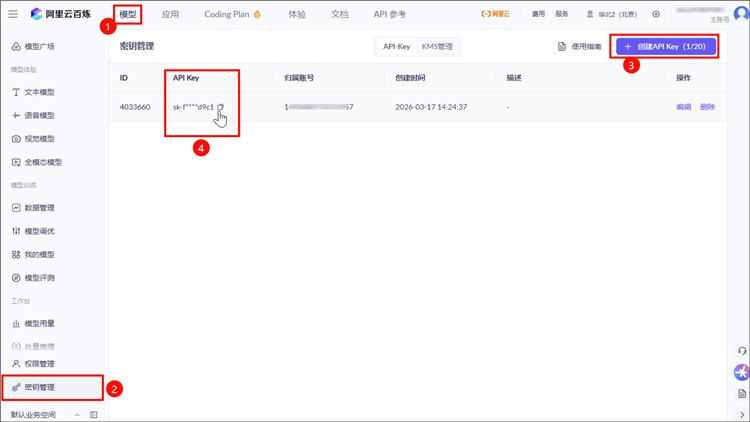

◾通义千问:登录“阿里云百炼平台”,接着选中“模型”界面左侧的“密钥管理”,再点击“创建API Key”,选择归属账号完成创建后直接复制API Key。

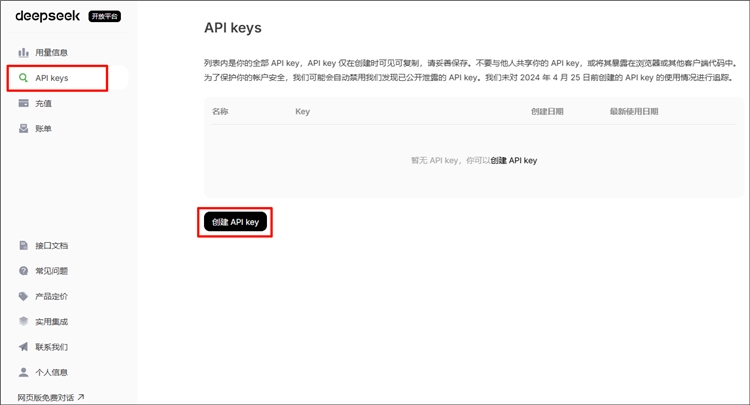

◾DeepSeek:访问“DeepSeek开放平台”并登录,进入到“API keys”界面后点击“创建”按钮,填写好名称后复制生成的密钥。

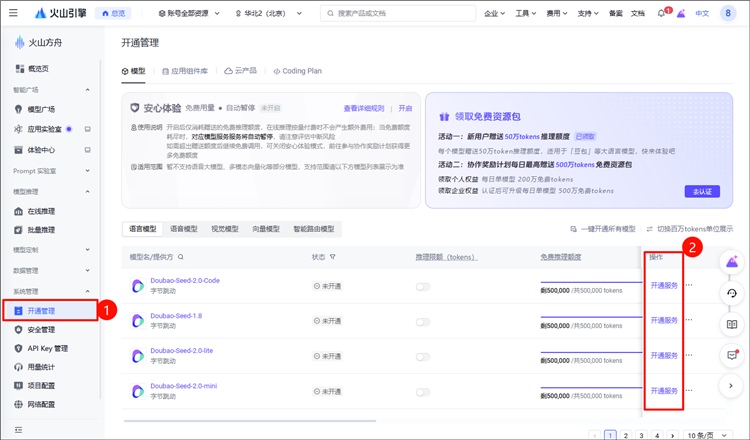

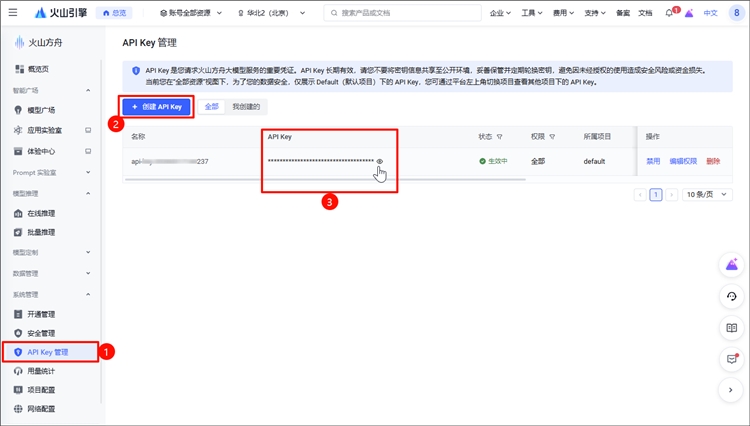

◾豆包:登录“火山方舟—火山引擎”,进入控制台后选择“API Key管理”,接着点击“创建API Key”,输入名称后复制对应的API Key。

(4)API验证与完成

◾将获取的API Key输入到对应位置后点击“验证API”按钮。

◾待页面显示“验证成功”后按下“开始使用”即完成部署了。

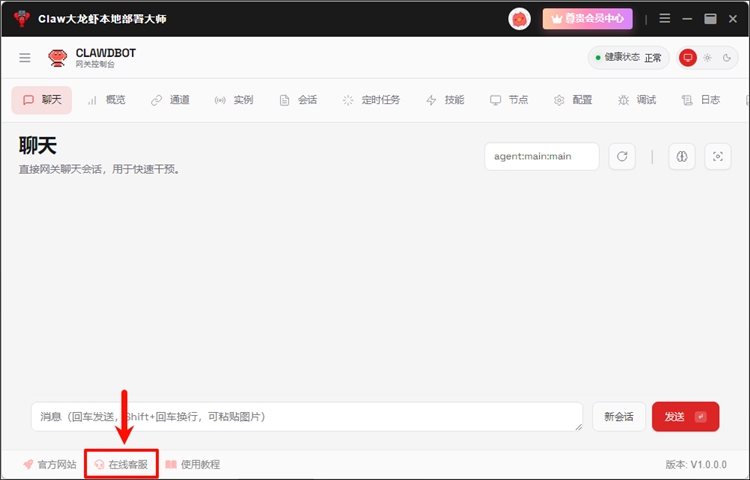

◾默认直接进入到聊天界面,还包含聊天、概览、通道等多个功能选项。

◾在界面底部输入消息并发送,归纳整理文件、提取关键信息等都能搞定。

◾若使用过程中遇到操作难题或技术问题可随时联系专业技术人员答疑解惑。

基于官方镜像构建容器,通过文件定义端口与数据卷映射。容器预装依赖,避免系统受影响,支持跨平台,但要掌握基础相关命令,适合需快速部署的团队环境。

使用venv或conda创建独立Python环境,隔离项目依赖。安装好指定版本库后运行程序,适合多项目并行,相比Docker更轻量,但需手动处理部分系统依赖。

阅读至此,相信大家已弄清OpenClaw“龙虾”昵称的由来,也掌握了多种本地部署的方法。这款开源AI智能体的核心价值在于让AI从单纯的“会聊天”升级为真正“能做事”,帮助解决现实中的各类问题。是不是很心动?那就赶紧上手体验一番吧!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/248467.html