“Meow-AI”是打造属于自己的本地轻量级大语言模型AI

- 2024-01-05:支持手动停止对话

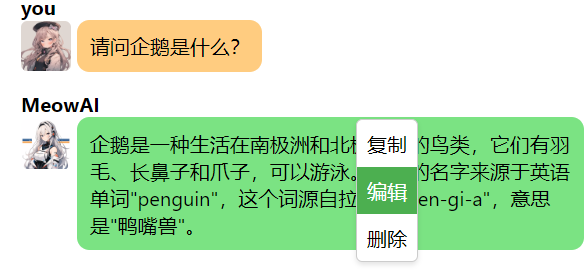

- 2024-01-19:支持编辑对话实现简单的手动微调

- 2024-01-23:支持配置导入/导出,支持自定义AI性格人设

- 2024-03-01:完全使用RWKV架构,实现更小的模型体积,降低运行内存和CPU占用

- 2024-04-26:优化整体架构

- 2024-07-08:支持扩展功能,支持微信自动聊天

- 2024-07-21:完成一键懒人运行包

1. 持续对话

2. 手动调整对话

注:手动添加修改更多的自己预设的对话,对后续的实现自己想要的聊天效果有很大帮助

3. 配置导入导出

4. 调教AI人设性格

5. 扩展功能

6. 一键懒人运行包

- 完成更多功能扩展

- 待续……

#使用transformers读取本地模型 model = AutoModelForCausalLM.from_pretrained(output_folder, trust_remote_code=True).to(torch.float32) tokenizer = AutoTokenizer.from_pretrained(output_folder, trust_remote_code=True) #文本预测 inputs = tokenizer(prompt, return_tensors=“pt”) output = model.generate(inputs[“input_ids”], max_new_tokens=1, do_sample=True, temperature=1.0, top_p=0.3, top_k=0, ) text=tokenizer.decode(output[0].tolist(), skip_special_tokens=True)#这个就是对于我们输入的文本进行预测后的结果其实实现对话聊天的效果基于文本的续写实现,基于已有的文本对下一个即将出现的字符进行预测。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/247418.html