用 Cursor 写代码的开发者,多多少少都踩过这几个坑:正在跑一个大型重构任务,Claude 3.5 Sonnet 突然触发速率限制,整个 Composer 流程卡死;想试试刚发布的 Claude 4.6 Opus,发现官方订阅根本没有入口;或者直连官方 API 延迟抖动,补全响应慢得像在等外卖。这些问题的根源都指向同一个地方——Cursor 默认的模型接入方式太死。本文记录的解法是:通过修改 Cursor 的 Base URL,将请求接入兼容 OpenAI 协议的 API 中转站,从而同时解决限流、模型选择和响应稳定性三个问题。

在动手配置之前,先把问题说清楚,方便你判断这套方案是否对症。

痛点一:主力模型限流

Cursor 的 Pro 订阅对 Claude 系列模型有请求频率上限,重度用户(尤其是跑 Agent 模式或大文件 Composer 的场景)很容易在工作日高峰期触发限制,被迫降级到响应质量更差的备用模型。

痛点二:无法使用最新模型

官方订阅的模型列表更新有延迟,而且部分新模型(如 Claude 4.6 Opus、GPT-5.3)在官方渠道需要等待灰度开放。通过自定义 Base URL 接入中转站,可以直接调用这些模型,不受官方订阅计划的限制。

痛点三:直连延迟不稳定

在某些网络环境下,直连官方 API 的响应时间波动较大,代码补全出现明显卡顿。中转站通常在多个地区部署了节点,请求会自动路由到响应最快的节点,实际体验比直连更稳定。

这里有一个很多教程没有提到的前提:在 Cursor 中使用自定义 Base URL 接入第三方模型,需要开通 Cursor 的 Pro 或以上订阅。免费版用户无法启用 Override OpenAI Base URL 功能。

如果你不想开通 Cursor 会员——用 Claude Code 替代

如果你对 Cursor 订阅费用有顾虑,或者只是想用 Claude 系列模型写代码,有一个更直接的替代方案:Claude Code。

Claude Code 是 Anthropic 官方推出的命令行 AI 编程工具,直接在终端中运行,无需任何编辑器订阅。它同样支持自定义 API Key 和 Base URL,配合中转站使用体验相当流畅,对于重度依赖 Claude 的开发者来说,很多场景下比 Cursor 更省心

Cursor 内置了一个 Override OpenAI Base URL 的配置项,允许开发者将所有 API 请求指向任意兼容 OpenAI 协议的接口地址。只要中转站实现了 /v1/chat/completions 等标准端点,Cursor 就能无缝对接,感知不到任何差异。

这套机制的好处在于:

- 零代码改动:不需要修改任何项目文件,只改 Cursor 设置

- 协议完全兼容:Claude、Gemini、DeepSeek 等非 OpenAI 模型,通过中转站统一转换为 OpenAI 协议格式,Cursor 可以直接调用

- 模型自由切换:在 Cursor 的 Models 列表中手动添加模型 ID,即可在 Composer 和 Chat 中随时切换

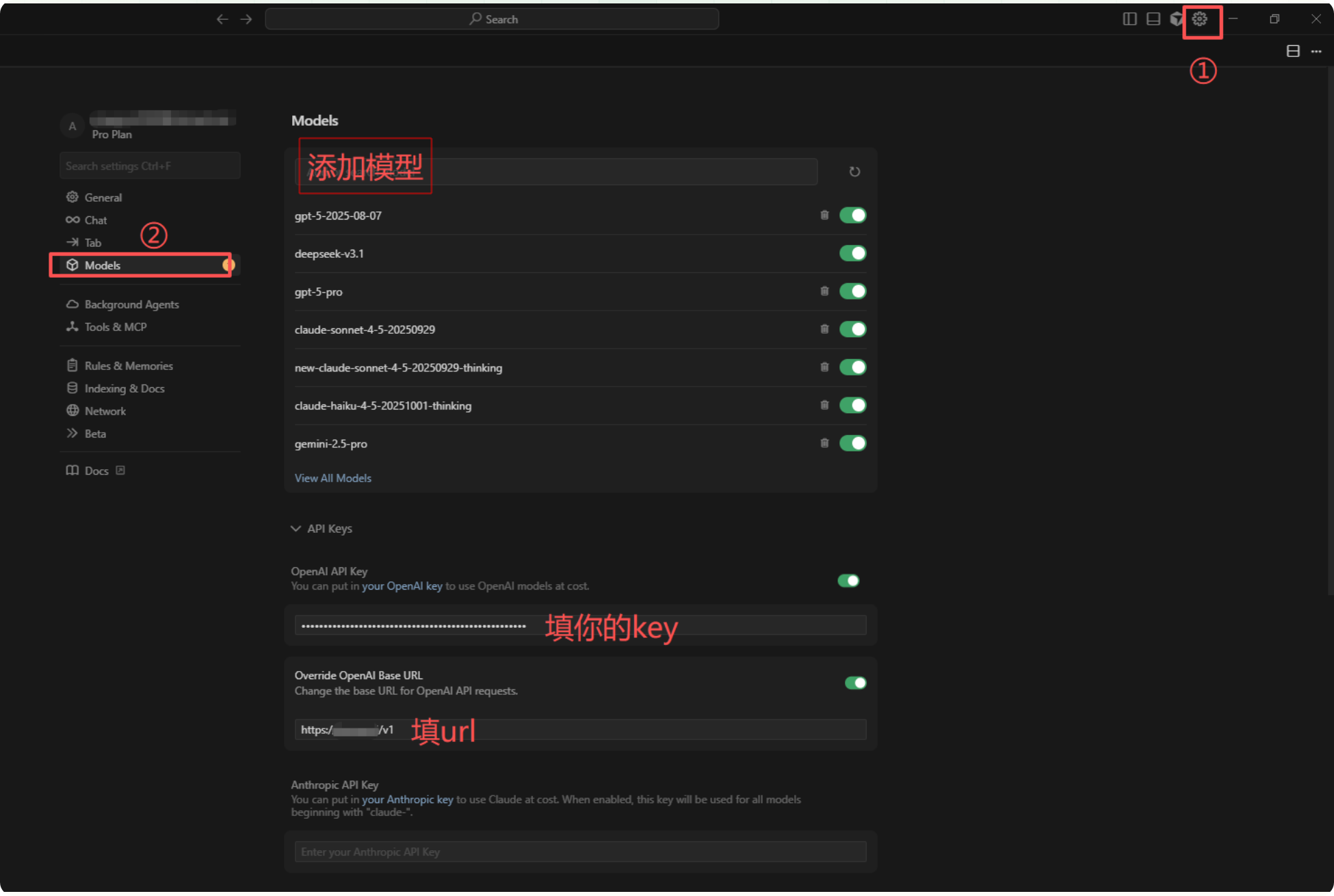

4.1 打开 Cursor 设置

点击 Cursor 右上角的齿轮图标,进入设置中心。

4.2 进入 Models 管理页

在左侧菜单选择 Models 选项卡,这里集中管理所有 AI 模型和 API 凭据。

4.3 关闭 Cursor 内置的同名模型开关(重要)

这一步是很多人配置后发现模型冲突或行为异常的根本原因。

当你手动添加第三方模型(如 claude-4-6-opus)时,必须同时关闭 Cursor 内置的对应 Claude 模型开关。 原因是:Cursor 内置的 Claude 模型走的是官方订阅通道,而你手动添加的同名模型走的是自定义 Base URL 通道,两者并存时 Cursor 的调度逻辑会产生混乱,可能出现:

- 以为在用中转站的模型,实际请求还是走了官方通道消耗订阅额度

- 模型列表中出现两个同名条目,切换时不确定用的是哪个

- 内置模型的开关状态影响自定义模型的响应行为

正确操作流程:

GPT plus 代充 只需 1451. 在 Models 页面,找到 Cursor 内置的 Claude 模型列表 (通常包含 claude-3-5-sonnet、claude-3-opus 等)

- 将你准备用中转站替代的模型对应开关全部关闭 例如:你要用中转站的 claude-4-6-opus,就把内置的所有 claude 开关关掉

- 再在输入框中手动添加你的自定义模型 ID: claude-4-6-opus

- 确认新添加的模型开关处于启用状态

这样可以确保 Cursor 中只有一个 Claude 调用入口,请求路径清晰,不会出现通道混用的问题。

4.4 添加目标模型 ID

在模型输入框中,手动添加你想使用的模型名称:

# 在 Cursor Models 输入框中填入以下模型 ID(每行一个)

claude-4-6-opus # Claude 4.6 Opus,适合复杂推理和大型重构 claude-sonnet-4-5 # Claude Sonnet 4.5,日常编程性价比较高 gpt-5.3 # GPT-5.3,代码补全和调试场景表现稳定 gemini-2.5-pro # Gemini 2.5 Pro,超长上下文场景适用 deepseek-v3 # DeepSeek V3,成本最低,适合高频简单任务

4.5 填写 API Key

在 OpenAI API Key 输入框中,填入你从中转站获取的 API Key,格式通常为 sk- 开头的字符串。

4.6 修改 Base URL(核心步骤)

勾选 Override OpenAI Base URL,将地址修改为:

GPT plus 代充 只需 145

注意末尾必须带 /v1,这是 OpenAI 协议的标准路径前缀,缺少会导致请求 404。

4.7 验证连接

点击 Verify 按钮,提示验证成功后,在 Cursor Chat 或 Composer 中选择你刚添加的模型,发送一条测试消息确认端到端连通。

如果你选择走 Claude Code 路线,配置同样简单。Claude Code 通过环境变量读取 API Key 和接口地址,以下是完整的初始化脚本:

# 第一步:安装 Claude Code(需要 Node.js v18+) npm install -g @anthropic-ai/claude-code第二步:设置环境变量,指向中转站

macOS / Linux 用户将以下两行加入 ~/.zshrc 或 ~/.bashrc

export ANTHROPIC_API_KEY=“sk-your-api-key-here” export ANTHROPIC_BASE_URL=“<https://api.88api.shop>";

Windows 用户在 PowerShell 中执行:

$env:ANTHROPIC_API_KEY = ”sk-your-api-key-here“

$env:ANTHROPIC_BASE_URL = ”<https://api.88api.shop>";

第三步:让环境变量立即生效(macOS/Linux)

source ~/.zshrc

第四步:进入你的项目目录,启动 Claude Code

cd /your/project/path claude

启动后,Claude Code 会进入交互模式,你可以直接用自然语言描述任务,例如:

GPT plus 代充 只需 145# 启动 Claude Code 后,直接输入任务描述即可 > 帮我重构 src/utils/parser.ts,把所有的 any 类型替换为具体类型,并补充 JSDoc 注释

> 分析整个 src 目录的代码结构,找出潜在的循环依赖问题

> 给 tests/ 目录下所有缺少单元测试的函数补充测试用例

Claude Code 会自动读取项目文件、执行修改、运行测试,整个过程不需要离开终端。对于习惯命令行工作流的开发者来说,这套体验比在编辑器里反复切换窗口要顺手得多。

配置完成后,如果你想对比不同模型在特定任务上的表现,以下脚本可以批量发送相同的代码问题并记录响应耗时和 Token 消耗:

import openai import time from typing import List, Dict初始化客户端,指向中转站地址

client = openai.OpenAI(

GPT plus 代充 只需 145api_key="sk-your-api-key-here", # 替换为你的真实 API Key base_url="

" # 中转站 Base URL

)

def test_model(model_id: str, prompt: str) -> Dict:

""" 向指定模型发送请求并记录响应时间 :param model_id: 模型 ID,如 "claude-4-6-opus" :param prompt: 测试用的代码问题 :return: 包含响应内容和耗时的字典 """ start_time = time.time() try: response = client.chat.completions.create( model=model_id, messages=[ { "role": "system", "content": "你是一位资深 Python 开发工程师,请给出简洁、可运行的代码答案。" }, { "role": "user", "content": prompt } ], max_tokens=1024, temperature=0.2 # 代码类任务建议低温度,输出更稳定 ) elapsed = round(time.time() - start_time, 2) content = response.choices[0].message.content return { "model": model_id, "status": "success", "elapsed_seconds": elapsed, "tokens_used": response.usage.total_tokens, "response_preview": content[:200] # 只取前 200 字用于预览 } except Exception as e: # 捕获异常并记录失败原因,不中断批量测试流程 return { "model": model_id, "status": "failed", "error": str(e) } def batch_test(models: List[str], prompt: str) -> None:

GPT plus 代充 只需 145""" 批量测试多个模型,打印对比结果 :param models: 模型 ID 列表 :param prompt: 统一的测试问题 """ print(f"测试问题:{prompt}\\n{'='*60}") for model in models: print(f"\\n▶ 正在测试模型:{model}") result = test_model(model, prompt) if result["status"] == "success": print(f" ✅ 响应耗时:{result['elapsed_seconds']}s") print(f" 📊 Token 消耗:{result['tokens_used']}") print(f" 📝 响应预览:{result['response_preview']}...") else: print(f" ❌ 请求失败:{result['error']}")

if name == “main”:

# 待测试的模型列表,按需增减 target_models = [ "claude-4-6-opus", "gpt-5.3", "deepseek-v3" ] # 用真实业务场景的代码问题作为测试 prompt,结果更有参考价值 test_prompt = """ 以下函数存在性能问题,请重构并说明优化点: def find_duplicates(lst): duplicates = [] for i in range(len(lst)): for j in range(i + 1, len(lst)): if lst[i] == lst[j] and lst[i] not in duplicates: duplicates.append(lst[i]) return duplicates """ batch_test(target_models, test_prompt)

验证失败(Authentication Error) 检查 API Key 是否复制完整,不要包含首尾空格或换行符。

模型未出现在 Composer 下拉列表 确认手动添加的模型 ID 右侧开关已打开,同时检查内置同名模型是否已关闭,两者并存会导致列表显示异常。

请求返回 404 Base URL 末尾缺少 /v1,标准格式为 https://api.88api.shop/v1,不带末尾斜杠。

切换模型后仍然消耗官方订阅额度 说明内置的 Claude 模型开关没有完全关闭,回到 Models 页面逐一检查内置模型列表,确保所有内置 Claude 条目均已禁用。

Cursor 接入第三方模型需要 Pro 订阅,这是一个绕不开的前提条件。如果你已经是 Cursor 会员,按本文的步骤配置中转站,记得关闭内置同名模型的开关,避免通道混用。如果你暂时不想开通 Cursor 订阅,Claude Code 是一个值得认真考虑的替代路径,终端原生、按量计费、Agent 能力完整,对于命令行友好的开发者来说上手成本很低。两条路的 API Key 都可以通过 88API 统一管理,不需要为不同工具维护多套账号体系

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/243479.html