最近在 vibe coding,买了智谱的 coding plan pro,挺好用的但是快被我用完了,所以打算再买一些,各位有什么见解?哪个模型最值得买?

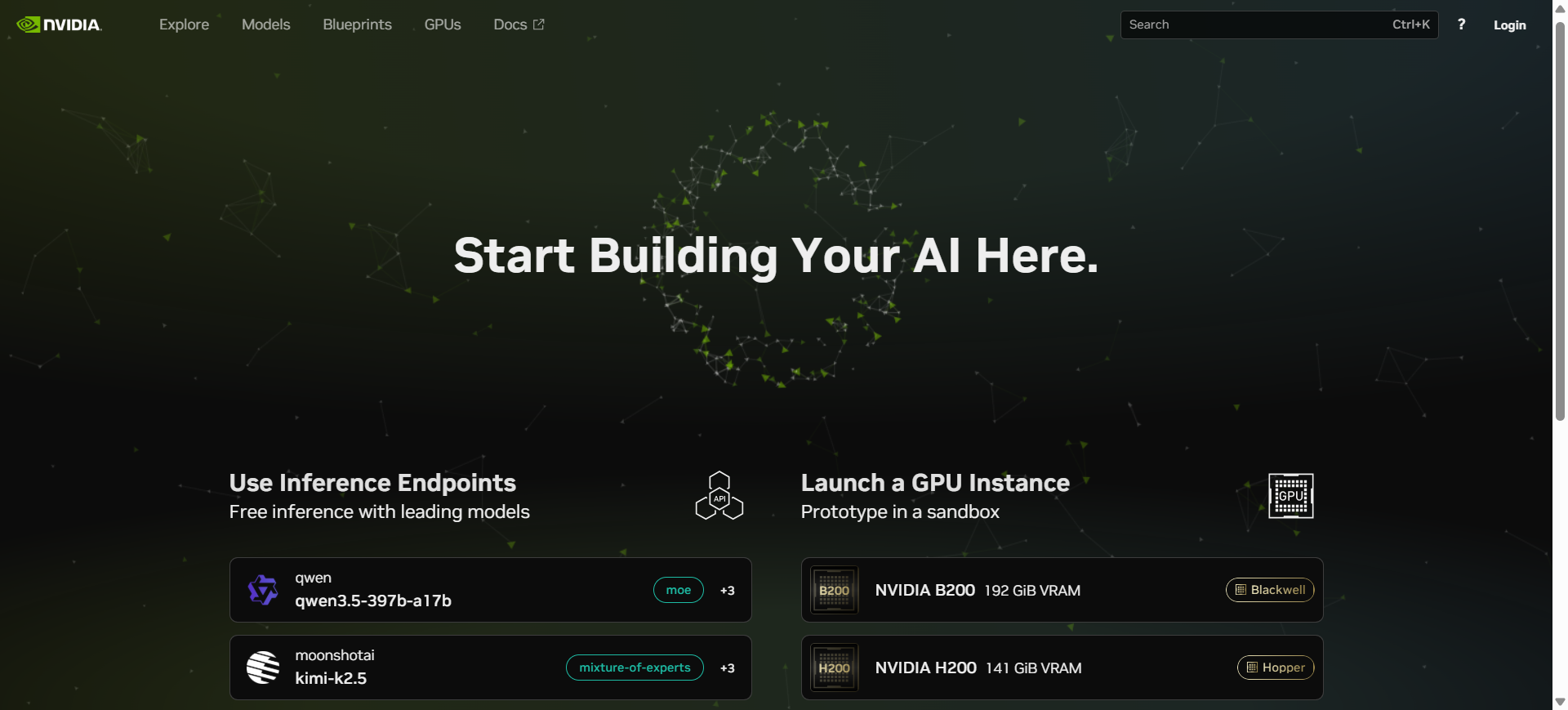

昨天上午刷GitHub,看到有人说英伟达NIM上了两个国产模型。我点进去一看:GLM-5 和Kimi K2.5。

关键是免费调用。

说实话,我第一反应是“真的假的”。但手比脑子快,已经点开http://build.nvidia.com开始注册了。

用了三天,现在来交个作业。

NIM全称NVIDIA Inference Microservices,英伟达的模型推理平台。

通俗点讲,就是个模型超市。以前上面只有Llama、Mistral、Gemma这些国外开源模型,现在货架上多了俩国产货:智谱的GLM-5和月之暗面的Kimi K2.5。

这两个都是年前发布的新模型。

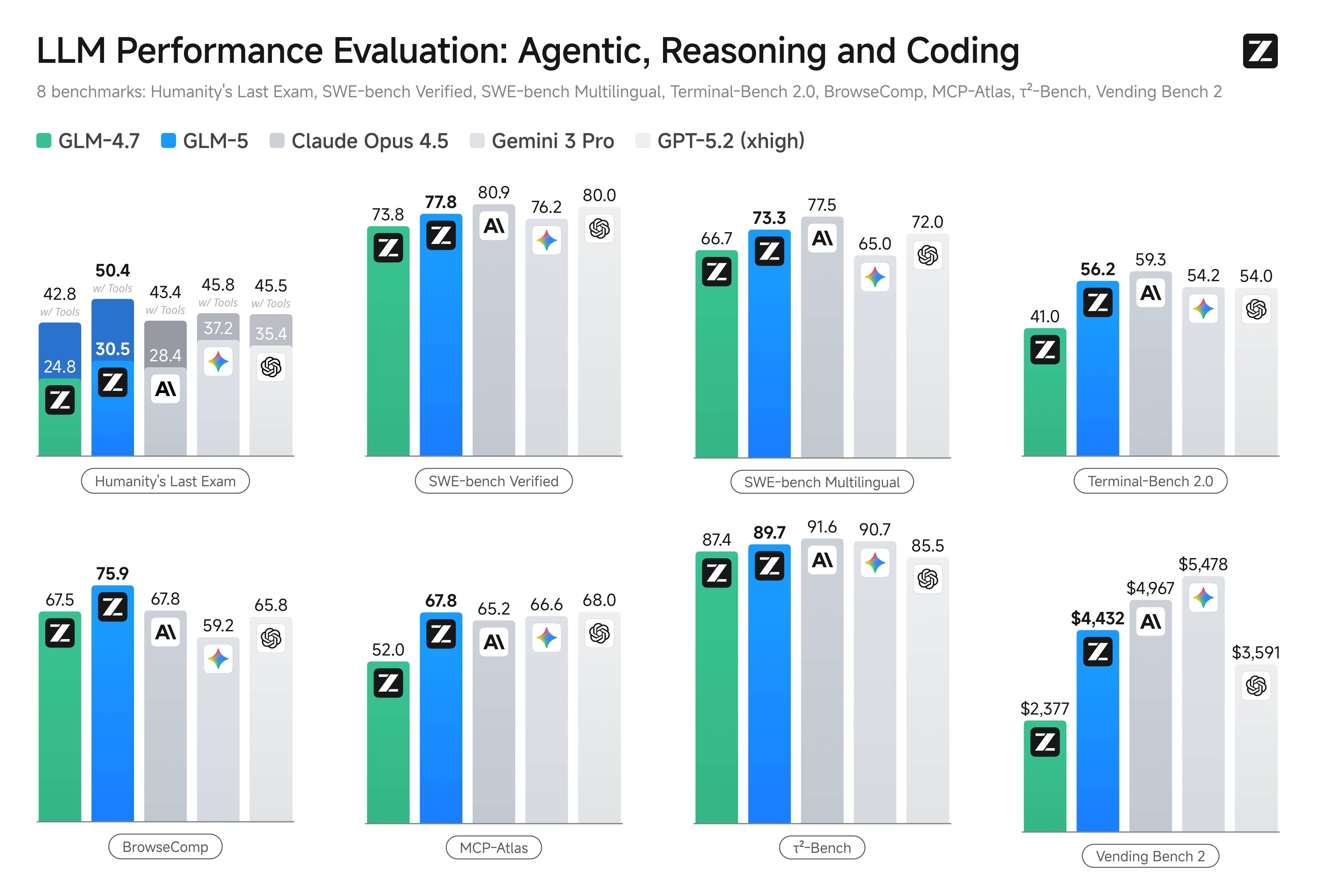

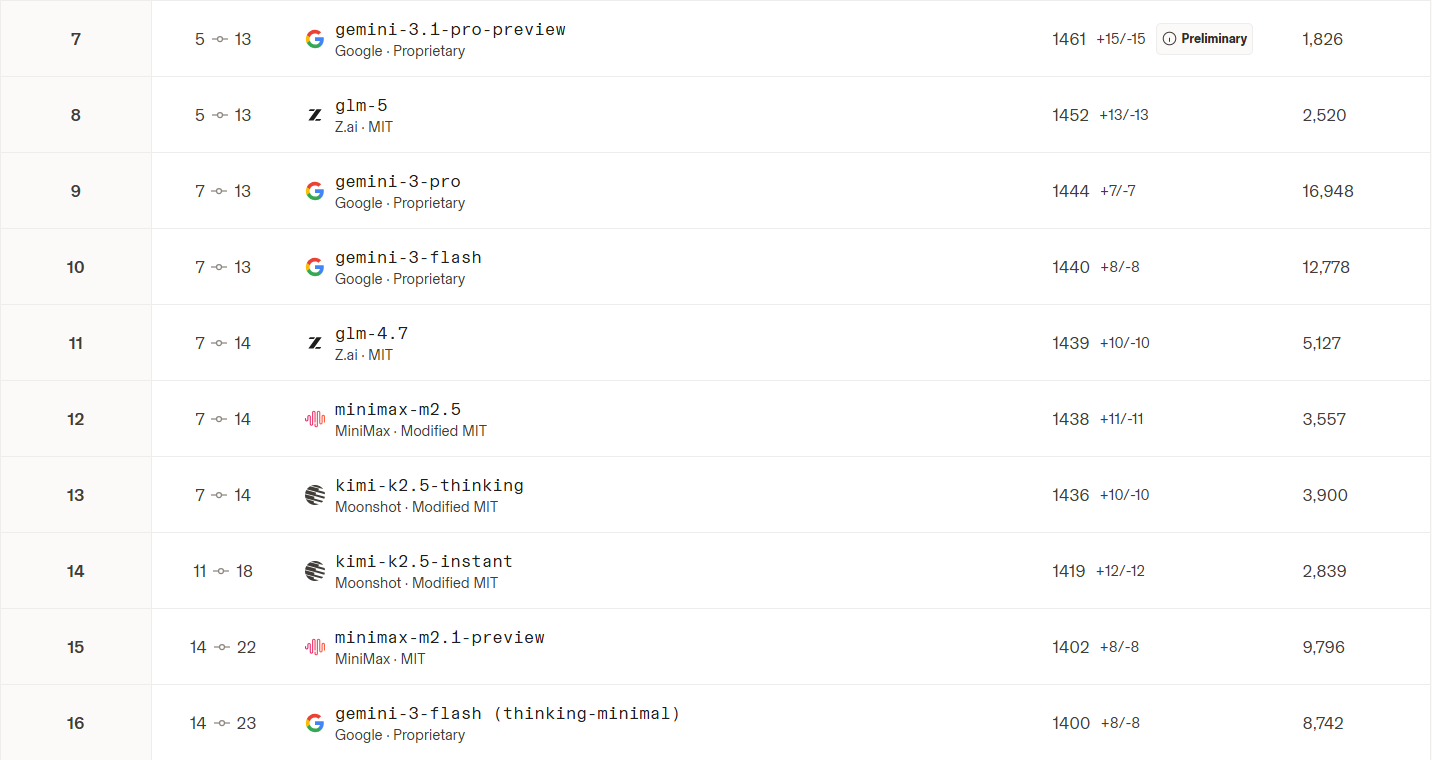

GLM-5是智谱的新旗舰,Kimi K2.5也是同期产品。WebDev Leaderboard排行榜上,GLM-5 和 Kimi K2.5 均有不错的排名。

属于国产模型的第一梯队。

现在英伟达把它们塞进NIM,没官宣,但API确实能用了。我上去看了眼,资源还挺抢手,有时候有点卡,不过个人用的话完全够。

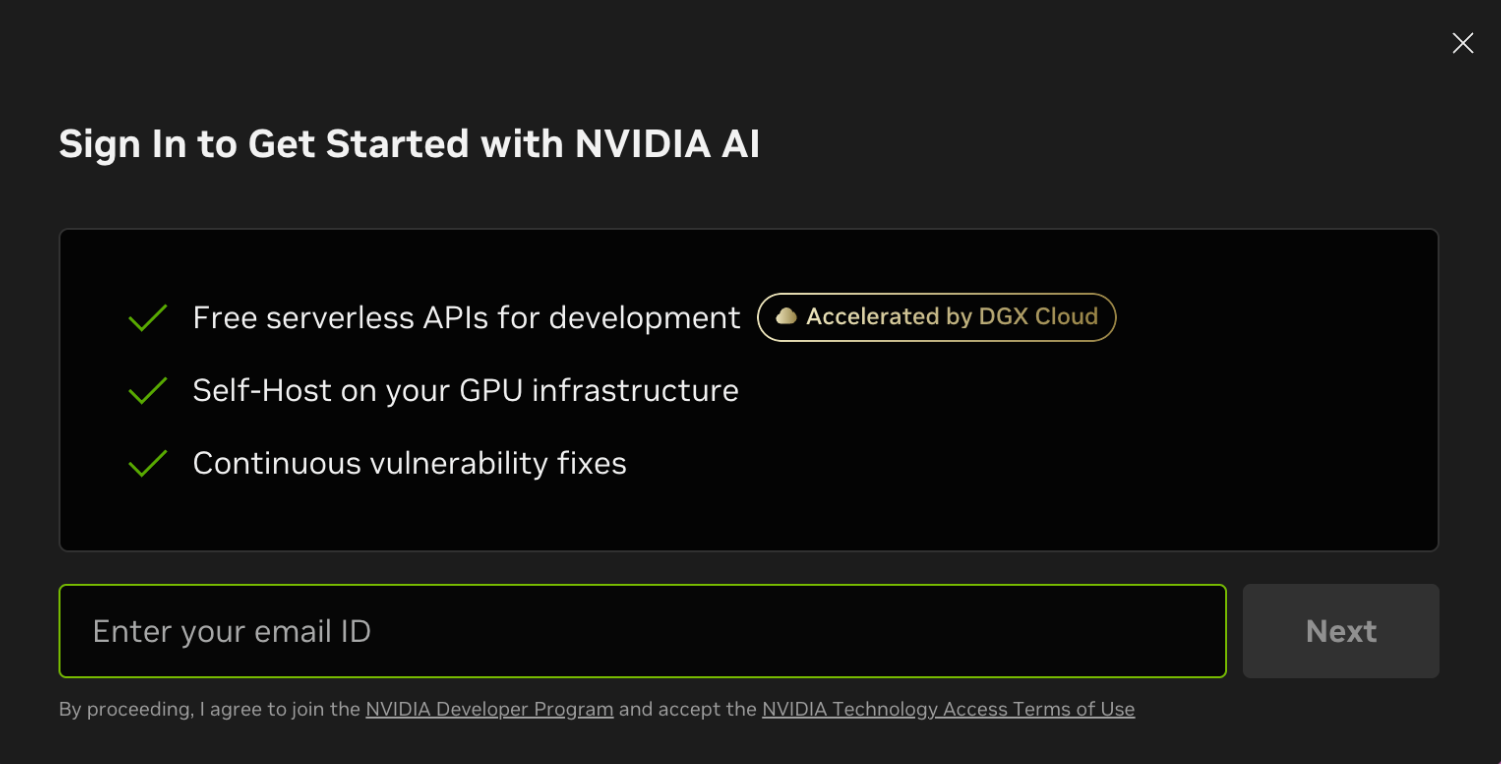

整个流程就三块:注册账号、拿API Key、配客户端。

打开http://build.nvidia.com,右上角点Login。输邮箱、设密码、Create Account。邮箱会收到6位验证码,填进去。起个账户名,搞定。

有个坑要注意:页面右上角有个Verify,必须点。然后输手机号验证。国内+86号码能用,亲测。

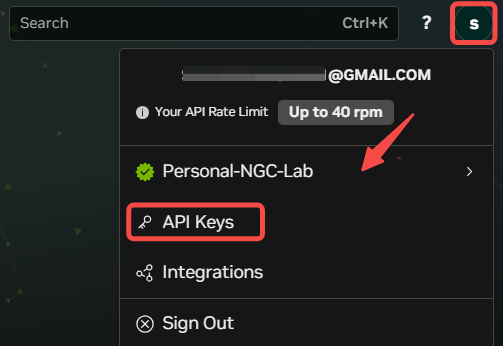

登录后,点右上角头像 → API Keys。

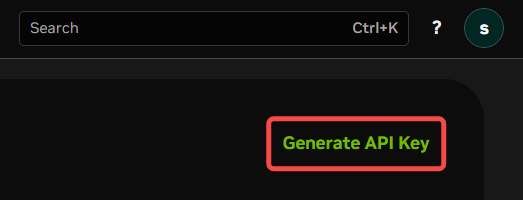

点击 Generate API Key。

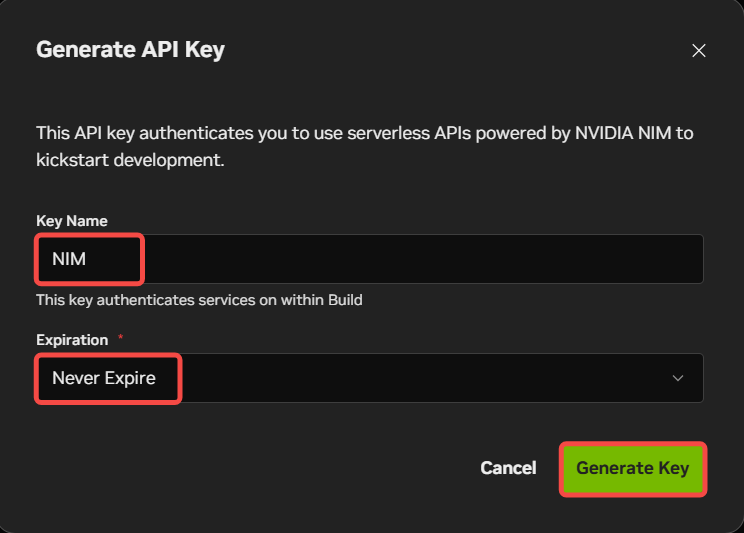

给Key起个名字,过期时间调成“Never”,也就是100年。

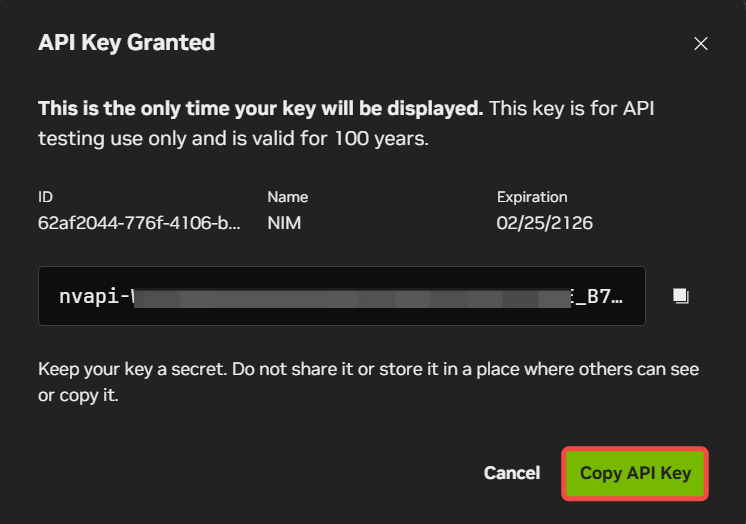

点Generate Key,你会拿到一串nvapi-xxx开头的字符串。

这玩意儿要保存好。 它能调用NIM上所有免费模型,包括今天说的这两个国产模型。

官网:https://www.cherry-ai.com/

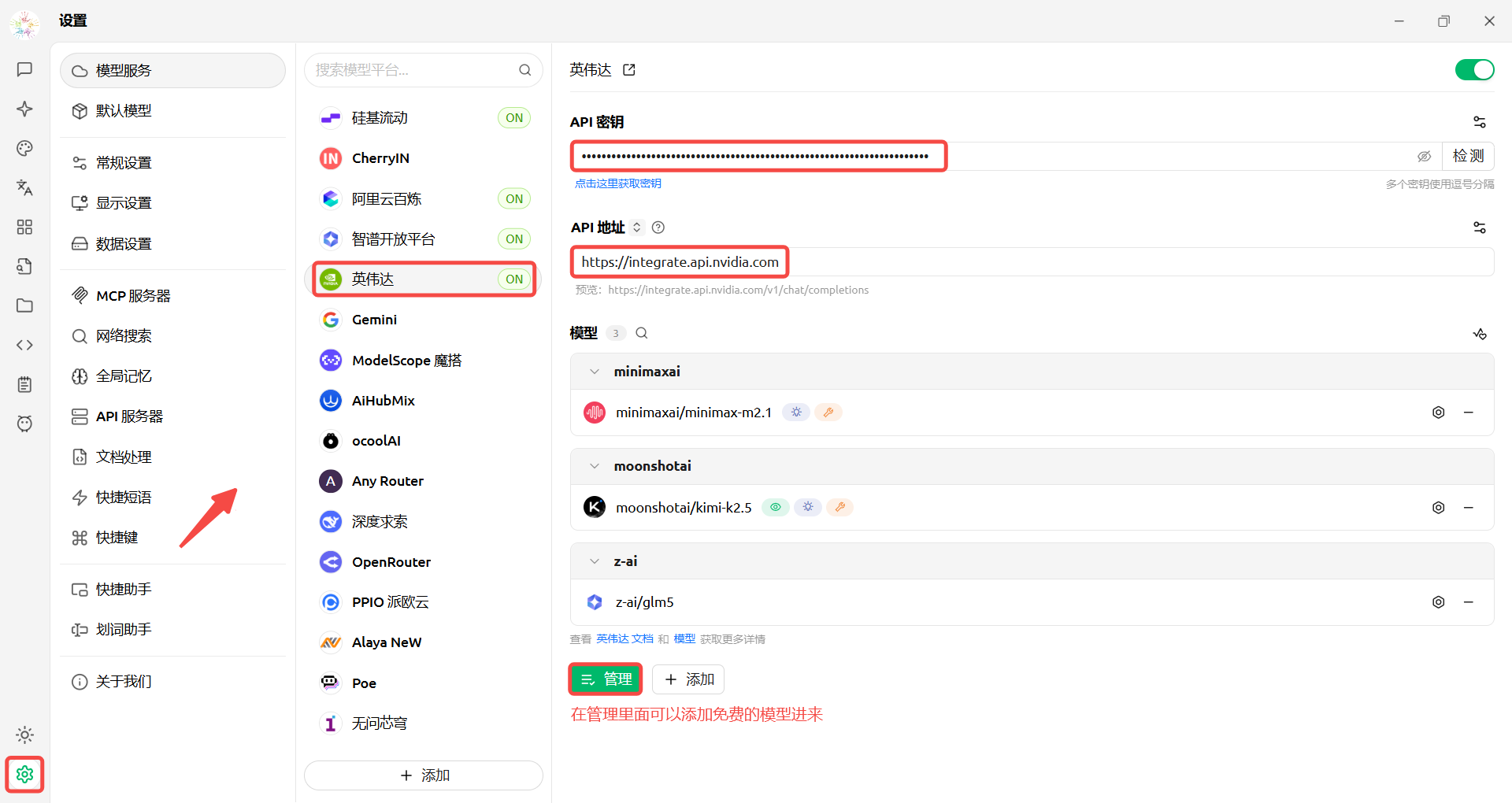

打开Cherry Studio,左下角点设置,模型服务选择“NVIDIA”。

配置参数:

- API密钥:粘贴刚才复制的nvapi-xxx

- API地址:https://integrate.api.nvidia.com

- 模型ID:我推荐这三个 - z-ai/glm5 - moonshotai/kimi-k2.5 - minimaxai/minimax-m2.1 minimax实际最新模型是m2.5,但是NVIDIA暂时没有,预计后续会更新出来,这里先使用m2.1。

保存,完事。现在就能开始对话了。

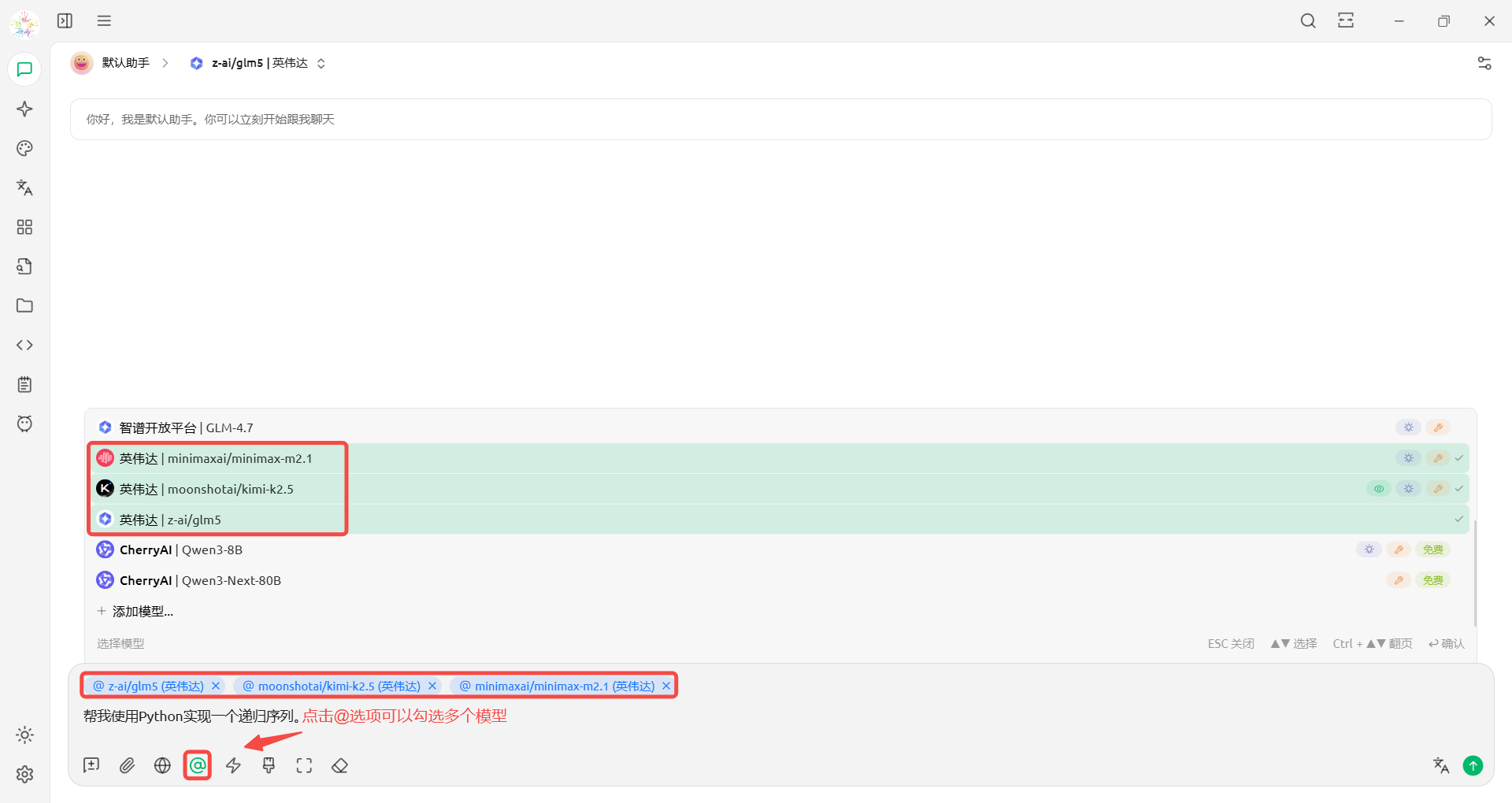

Cherry Studio 比较便捷的是一次可以同时与多个模型进行对话,底部勾选模型即可。

点击使用模型回答样式:横向排列,实现多个模型回答的效果对比。。

但也有坑:

- 资源紧张时会排队

- 高峰期速度明显下降

我的看法是:轻度使用没问题,想当主力工具还差口气。

如果你是开发者,想接API做产品,建议还是买官方的商业版。MiniMax、智谱、Kimi都有Coding Plan,价格不贵,稳定可靠,速度也快。

但如果你只是个人用户,想白嫖个大模型API放在客户端里日常使用,NIM这个方案挺香的。

英伟达这波操作挺良心的。把两个国产顶级模型免费开放给开发者,对AI生态是好事。GLM-5和Kimi K2.5都是第一梯队的大模型,现在能免费调用,机会难得。

资源有限,用的人越多体验可能越差。想白嫖的抓紧,手慢无。我建了个AI交流群,专门分享这种白嫖攻略和实用技巧。感兴趣的朋友关注后回复“加群”,我拉你进群。

01 用了Coding plan,再也不怕Openclaw半夜偷家了!

很多兄弟把 OpenClaw 配置好后,最爽的瞬间是看着 Agent 自动跑任务、安装各种SKills、自己修复错误。但最恐怖的时刻,往往发生在第二天早上。

当你端着咖啡点开Email时,全是token燃烧的账单,发现昨晚睡梦中,OpenClaw 的某个死循环 Agent 或者过度热情的重构脚本,在几个小时内疯狂调用 API,一夜之间烧掉了你几百甚至上千块的按量计费额度。

这就是“半夜偷家”,痛彻心扉。

以前玩 OpenClaw,大家只能用“按量付费(Pay-as-you-go)”,就像开着没有里程限制的跑车去送外卖,跑得越勤快,破产得越快。你不得不时刻盯着API用量,给 Agent 加各种限制,生怕它“发疯”。

但现在,风向彻底变了。

国内六大厂(MiniMax、千问、智谱、Kimi、豆包、千帆)纷纷推出的 Coding Plan(编程订阅套餐),本质上就是给 OpenClaw 装上了一个“无限里程保险”。

这些套餐不再是简单的“充值”,而是针对开发者工作流的“封顶保护”:

- 成本可控:无论你的 Agent 半夜跑了多少个文件、生成了多少行代码,只要还在套餐额度内(比如每月 1.8 万次或 9 万次请求),你的支出就是锁死的 ¥39 或 ¥149,绝不会多出一分钱。

- 性能解锁:订阅制往往伴随着更高的 TPS(生成速度) 和更长的 Context Window(上下文窗口)。这意味着你的 OpenClaw 可以更大胆地加载整个项目目录,更激进地进行全库重构,而不用担心“跑一步算一步钱”。

- MCP 原生支持:新套餐深度适配了 MCP(模型上下文协议),让 OpenClaw 调用本地工具、数据库、文件系统时更加稳定,不再需要为了省 Token 而**功能。

简单来说,Coding Plan 让你从“精打细算的会计”,变回了“随心所欲的架构师”。

今天,我们就抛开那些花哨的对比,单从 OpenClaw **搭档 的角度,深扒这六家套餐。看看在 config.yaml 的世界里,谁才是那个能让你大胆开启 auto-commit、放心让 Agent 通宵跑任务,且性价比最高的“最强数字员工”。

价格看完了,咱们挨个翻翻他们的牌子。看看花这几十块钱,到底买到了多少生产力。

这家的计费逻辑是最奇葩的,但也最懂重度极客。它不按“月”给你总次数,而是按“每 5 小时”来刷新!

- 资费与折扣:没搞低价噱头。入门版 Starter ¥29/月(40次/5小时),Plus 版 ¥49/月(100次/5小时)。

- 隐藏王牌(极速版):它单独开辟了一个 Highspeed(极速版) 战线!Plus 极速版 ¥98/月,最高配的 Ultra 极速版卖到了恐怖的 ¥899/月!

- 卖的是什么:卖的是 100 TPS 的生成速度(同类产品 3 倍)。写代码最烦什么?等!MiniMax 这个套路就是告诉大佬们:只要你钱给够,我给你服务器插上火箭。支持图像理解、联网搜索 MCP。

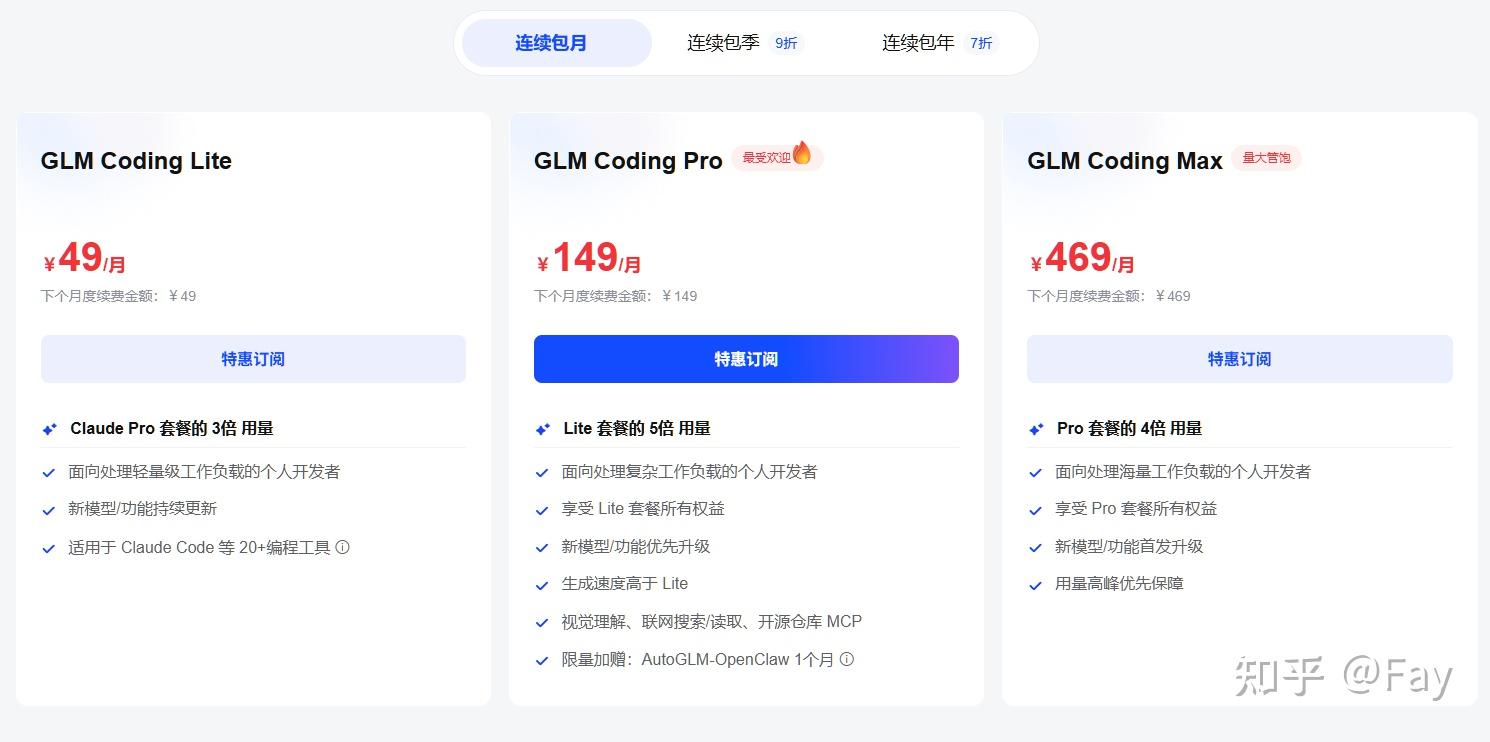

智谱的页面连装都不装了,直接把“Claude”写在脸上。

- 资费与额度:Lite 版 ¥49/月,Pro 版 ¥149/月(送 AutoGLM-OpenClaw 1个月),Max 版 ¥469/月。

- 核心打法:明确标榜 Lite 拥有“Claude Pro 套餐的 3 倍用量”,Pro 版是 5 倍!

- 适配度:适用 Claude Code 等 20+ 编程工具。这是摆明了要吃掉原版 Claude 嫌贵退坑的用户,主打一个“量大管饱,不用翻墙”。

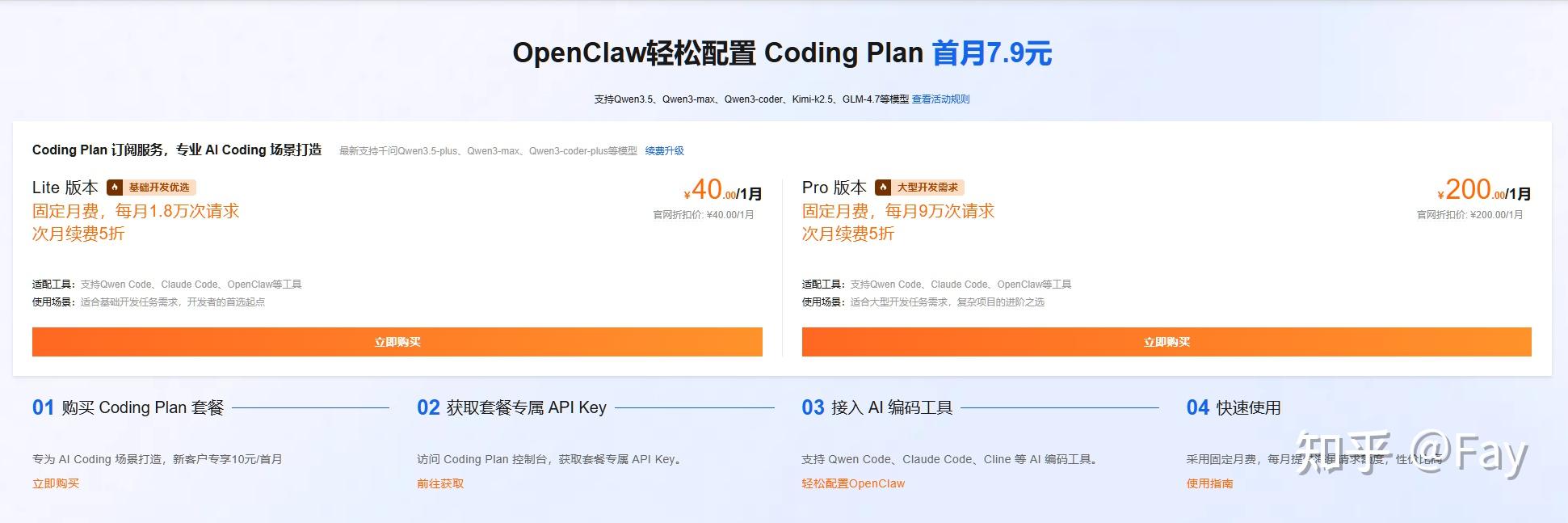

- 资费与折扣:Lite 版首月 ¥7.9(原价 ¥40),Pro 版 ¥200。次月续费打 5 折。

- 额度逻辑:简单粗暴,Lite 给你每个月 1.8 万次请求,Pro 给你 9 万次。对于普通开发者,1.8 万次用来跑一些日常的 Script 和前端页面,其实相当够用。

- 模型大乱炖:不光能调自家的 Qwen3.5-max 和 Qwen-coder,还能调 Kimi 和 GLM-4.7。

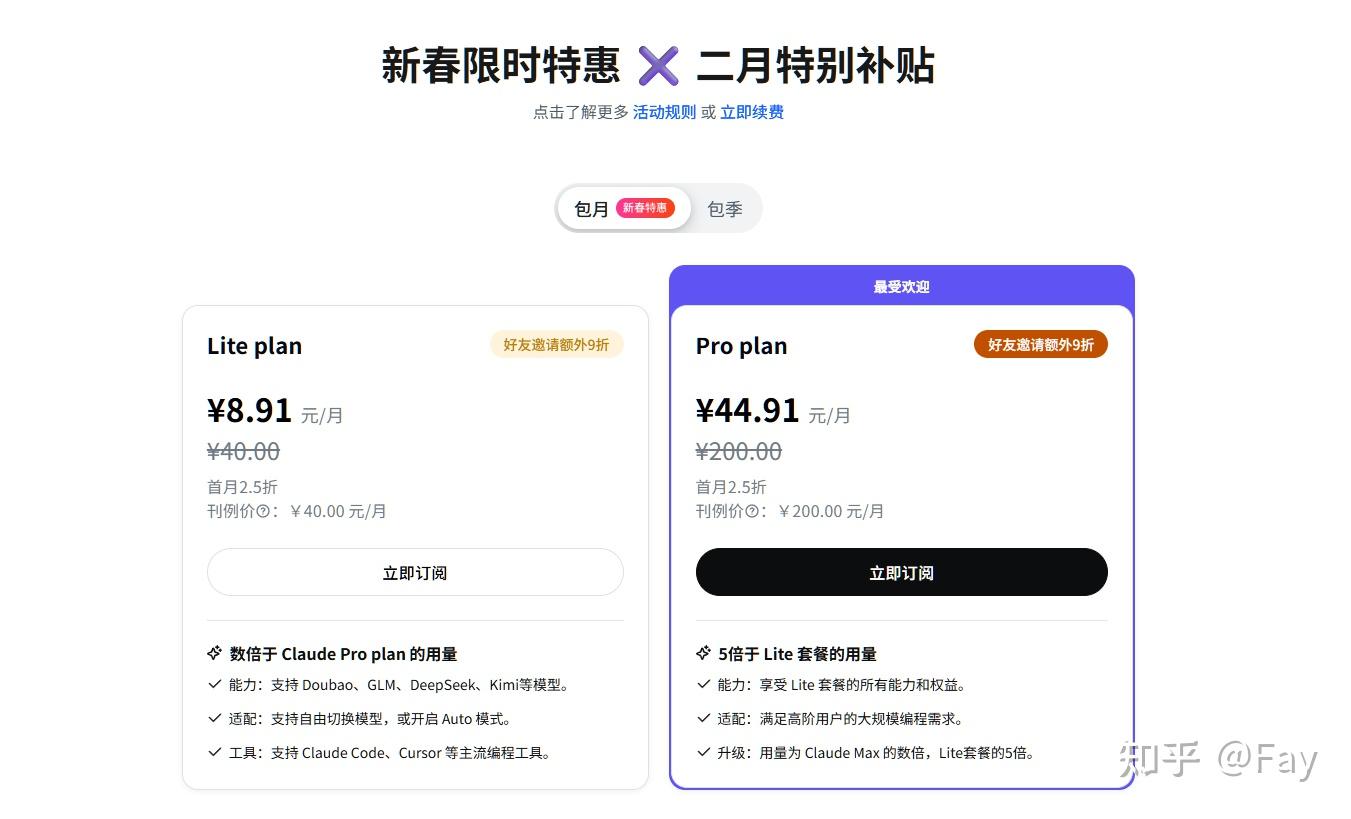

- 资费与折扣:新春限时特惠,Lite 版首月低至 ¥8.91(标价 ¥40),Pro 版首月 ¥44.91(标价 ¥200)。还能叠加好友邀请 9 折。

- 支持模型:极致的大乱炖。Doubao 自己的模型,加上 GLM、DeepSeek、Kimi。

- 特色:支持自由切换模型,或者开启 Auto 模式让系统帮你选。这对于不想费脑子选底层模型的全栈开发者是个懒人福音。

- 资费与额度:Lite 版首月 ¥9.9(1.8万次),Pro 版首月 ¥49.9(9万次)。

- 特色:和千问的打法几乎一模一样,适配 Claude Code,底层模型拉来了 GLM-4.7 和 MiniMax-M2.1 助阵。典型的“别家有的我也得有”

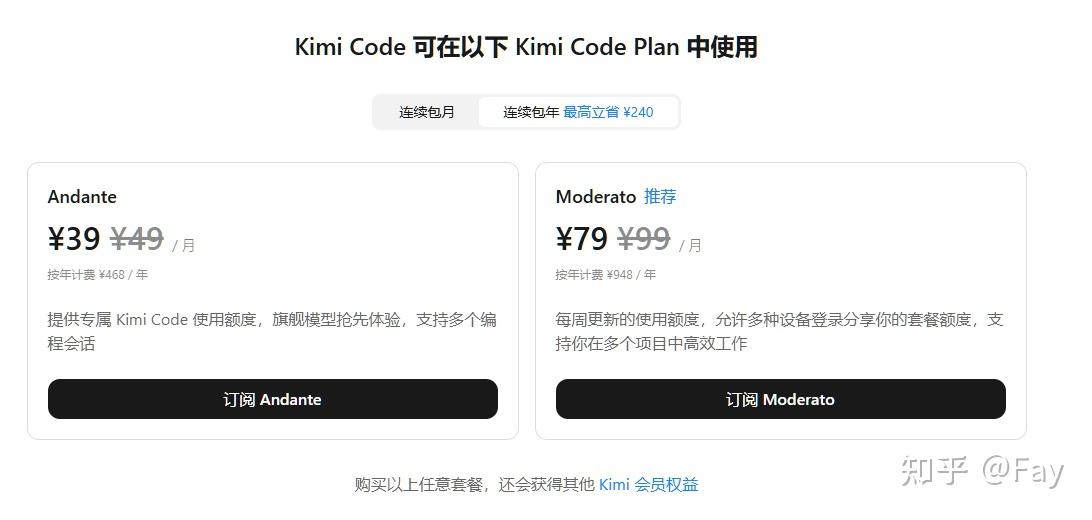

- 资费与折扣:Andante 降价到 ¥39/月,Moderato 降价到 ¥79/月。

- 核心玩法:Kimi 比较克制,不搞大乱炖。它卖的是专属的 Kimi Code 额度。Andante 支持多个编程会话抢先体验;Moderato 支持多设备登录和多项目高效工作(每周更新额度)。适合那些不需要乱接 IDE,直接在 Kimi 网页/APP 里搞定代码分析的玩家。

- 囊中羞涩的学生党 / 尝鲜白嫖怪: 闭眼去薅 豆包 (¥8.91)、千问 (¥7.9) 或 千帆 (¥9.9) 的首月羊毛!这加起来不到一杯星巴克的钱,够你深度体验各大模型一个月了。记得定个闹钟,下个月涨价前取消订阅。

- Claude/Cursor 重度依赖患者: 想完美平替,首选 智谱 Pro 版 或 千问 Pro 版。智谱的“5倍 Claude Pro 用量”极其诱人,且对 Claude Code 的 MCP 协议支持极好;千问的 9 万次请求也足够你跑通中型项目。

- 对延迟有强迫症的暴躁老哥 / 独立创客: 请直接给 MiniMax 极速版 打钱!如果你无法忍受慢吞吞的 Token 吐字速度,它那 100 TPS 的生成速度绝对让你直呼过瘾,当然,前提是你接受它那“每 5 小时”的防沉迷刷新机制。

最后灵魂拷问:如果 Cursor 和 Claude 明天彻底封锁了国内 IP,必须从这 6 家里选一个托付你的底层代码库,你会选哪家?

评论区见,看看哪家才是程序员心中真正的信仰!

用脚本测试了UCloud模型的性能,结果如下。使用的提示词:

假设人类可以瞬间传输物体但不能穿越空间,写一个发生在现代都市的微小说开头(约 200 字)。

| 模型 | 耗时(ms) | 输入token | 输出token | 总token | 消耗积分 | 积分/总token | token/s |

|---|---|---|---|---|---|---|---|

| MiniMax-M2.1 | 10798.52 | 62 | 922 | 984 | 13084 | 13.3 | 85.4 |

| MiniMax-M2.5 | 23368.59 | 65 | 1024 | 1089 | 14518 | 13.3 | 43.8 |

| claude-haiku-4-5- | 7050.20 | 55 | 331 | 386 | 6827 | 17.7 | 46.9 |

| claude-opus-4-5- | 44064.52 | 69 | 344 | 413 | 35715 | 86.5 | 7.8 |

| claude-opus-4-6 | 15505.67 | 70 | 436 | 506 | 44918 | 88.8 | 28.1 |

| claude-sonnet-4-5- | 12163.14 | 69 | 343 | 412 | 21369 | 51.9 | 28.2 |

| claude-sonnet-4-6 | 14835.92 | 70 | 395 | 465 | 24495 | 52.7 | 26.6 |

| deepseek-ai/DeepSeek-V3.2 | 16723.15 | 30 | 578 | 608 | 2402 | 4.0 | 34.6 |

| moonshotai/kimi-k2.5 | 4690.16 | 33 | 239 | 272 | 7025 | 25.8 | 51.0 |

| gpt-5.1 | 16370.12 | 40 | 293 | 333 | 5173 | 15.5 | 17.9 |

| gpt-5.1-codex-max | 34717.88 | 40 | 1945 | 1985 | 33852 | 17.1 | 56.0 |

| gpt-5.1-codex-mini | 6501.76 | 40 | 454 | 494 | 1593 | 3.2 | 69.8 |

| gpt-5.2 | 6823.59 | 40 | 220 | 460 | 5468 | 11.9 | 32.2 |

| gpt-5.2-codex | 30269.50 | 40 | 1189 | 1229 | 29018 | 23.6 | 39.3 |

| gpt-5.3-codex | 18391.89 | 40 | 245 | 285 | 6075 | 21.3 | 13.3 |

| gpt-5.4 | 13847.60 | 40 | 236 | 276 | 6319 | 22.9 | 17.0 |

| zai-org/glm-5 | 30755.36 | 30 | 1170 | 1200 | 28364 | 23.6 | 38.0 |

小模型和国内模型,速度还是可以的,倍率也还行吧。比较经济。Opus之类的巨无霸就太费了。舍不得。。。。。。

优云智算的新手套餐和Lite套餐也不错

优云智算

限流 50 RPM,日常够用。

积分额度 = 输入Token x 输入倍率 + 缓存创建Token x 缓存创建倍率 + 缓存命中倍率 x 缓存命中Token + 输出倍率 x 输出Token

| 模型名称 | 输入倍率 | 输出倍率 | 缓存创建倍率 | 缓存读取倍率 |

| MiniMax-M2.1 | 3.489 | 13.957 | 4.362 | 0.3489 |

| MiniMax-M2.5 | 3.489 | 13.957 | 4.362 | 0.3489 |

| claude-haiku-4-5- | 3.993 | 19.964 | 4.991 | 0.399 |

| claude-opus-4-5- | 19.964 | 99.8199 | 39.928 | 1.996 |

| claude-opus-4-6 | 19.964 | 99.8199 | 39.928 | 1.996 |

| claude-sonnet-4-5- | 11.978 | 59.892 | 23.957 | 1.198 |

| claude-sonnet-4-6 | 11.978 | 59.892 | 23.957 | 1.198 |

| deepseek-ai/DeepSeek-V3.2 | 2.678 | 4.018 | - | 0.268 |

| gpt-5.1 | 2.17 | 17.36 | - | 0.217 |

| gpt-5.1-codex-max | 2.17 | 17.36 | - | 0.217 |

| gpt-5.1-codex-mini | 0.434 | 3.472 | - | 0.0429 |

| gpt-5.2 | 3.0379 | 24.3039 | - | 0.304 |

| gpt-5.2-codex | 3.0379 | 24.3039 | - | 0.304 |

| gpt-5.3-codex | 3.0379 | 24.3039 | - | 0.304 |

| gpt-5.4 | 4.34 | 26.04 | - | 0.434 |

| moonshotai/kimi-k2.5 | 5.456 | 28.644 | - | 0.955 |

| zai-org/glm-5 | 5.357 | 24.106 | - | 1.339 |

阿里云百炼凭借首月7.9元、正价40元/月的极低门槛,以及聚合Qwen、GLM、Kimi和MiniMax四大顶流模型的丰富度,成为目前综合性价比最高的推荐方案;而联通云的限量免费名额和MiniMax 29元/月的起步价则提供了更极致的省钱选择。对于开发者而言,当前的选购核心指标已从单纯的价格竞争转向模型多样性与额度机制(如按月固定额度优于短周期滑动窗口限制)的博弈,建议优先尝试阿里云或腾讯云的首月优惠套餐,根据具体编程高频时段的用量需求再决定长期订阅方案。

调研时间:2026年3月9日 | 数据来源:各厂商官网及***息

Coding Plan 是国内各大云厂商和AI公司面向开发者推出的AI编程订阅套餐,以固定月费替代传统的按Token计费方式。订阅后可在 Cursor、Windsurf、Cline、Continue 等主流AI编程工具中调用大模型API,实现代码补全、生成、重构、问答等功能。

| 套餐 | 正价 | 首月优惠 | 月请求限额 | 支持模型 |

|---|---|---|---|---|

| Lite | ¥40/月 | ¥7.9 | 18,000次 | Qwen3.5-plus, GLM-5, Kimi-K2.5, MiniMax-M2.5 |

| Pro | ¥200/月 | ¥39.9 | 90,000次 | 同上 |

亮点:一个套餐聚合四大顶流模型(千问、智谱、月之暗面、MiniMax),可自由切换;首月价格极低,”百亿补贴”级别;月度额度按自然月计,无短周期滑动窗口限制。

| 套餐 | 正价 | 首月优惠 | 请求限额 | 支持模型 |

|---|---|---|---|---|

| Lite | ¥40/月 | ¥9.9 | ~1,200次/5小时 | 豆包Doubao-Seed-Code, DeepSeek-V3.2, GLM-4.7, Kimi-K2.5等(约6款) |

| Pro | ¥200/月 | ¥49.9 | 更高额度 | 同上 |

亮点:国内最早推出Coding Plan的平台之一;一个套餐可体验6个不同模型;有自研豆包编程模型Doubao-Seed-Code。 注意:额度采用5小时滑动窗口,非按月累计,高频使用可能触碰上限。

| 套餐 | 月价(涨价后) | 5小时限额 | 周限额 | 支持模型 |

|---|---|---|---|---|

| Lite | ¥49/月 | 80次 | 400次 | GLM-5, GLM-4.7 |

| Pro | 更高(未公开具体) | 400次 | 2,000次 | GLM-5, GLM-4.7 |

| Max | 更高 | 1,600次 | 8,000次 | GLM-5, GLM-4.7 |

注意:2026年2月12日起涨价30%+,取消首购优惠;仅支持自家GLM系列模型,模型多样性不足。连续包季享9折(Lite约¥132/季)。

| 套餐 | 月价 | 5小时限额 | 支持模型 |

|---|---|---|---|

| Starter | ¥29/月 | 40 prompts | M2.5, M2.1, M2 |

| Plus | ¥49/月 | 100 prompts | 同上 |

| Max | ¥119/月 | 300 prompts | 同上 |

| Ultra(极速) | ¥899/月 | 2,000 prompts | M2.5-highspeed |

亮点:入门价全网最低(¥29/月);按年订阅有额外折扣。 注意:仅支持MiniMax自家模型;Starter档位额度较紧(40次/5小时)。

| 套餐 | 正价 | 首月优惠 | 月请求限额 | 支持模型 |

|---|---|---|---|---|

| Lite | ¥40/月 | ¥9.9 | 18,000次 | GLM-5, MiniMax-M2.5, KAT-Coder-Pro等 |

| Pro | ¥200/月 | ¥39.9 | 90,000次 | 同上 |

亮点:价格策略与阿里云对标;支持多家模型。

| 套餐 | 首月优惠 | 支持模型 |

|---|---|---|

| Lite | ¥7.9 | 混元Hunyuan, GLM, Kimi, MiniMax |

| Pro | ¥39.9 | 同上 |

亮点:最新入局,有自研混元大模型加持;首月价格与阿里云对标。 注意:刚上线,具体正价和长期额度待观察。

| 套餐 | 正价 | 首月优惠 | 额度限制 | 支持模型 |

|---|---|---|---|---|

| Lite | ¥40/月 | ¥19.9 | 1,000次/5h, 6,000次/7天, 12,000次/月 | DeepSeek-V3.2, Kimi-2.5等 |

| Pro | ¥200/月 | — | 5,000次/5h, 30,000次/7天, 60,000次/月 | 同上 |

亮点:三级滑动窗口限额机制,灵活分配。 注意:月度总额度(12,000次)低于阿里云/百度(18,000次)。

| 套餐类型 | 价格 | 额度 | 支持模型 |

|---|---|---|---|

| 按次包 | ¥6.9 / ¥19.9 / ¥199 | 2,900万 / 5,900万 / 5.9亿积分 | DeepSeek, MiniMax, Kimi |

| 包月 | ¥49.9 / ¥199 / ¥499 | 700万 / 2,800万 / 7,000万积分/日 | 同上 |

亮点:积分制灵活,可按需选择按次或包月;中立云平台,不绑定单一生态。

| 套餐 | 首月优惠 | 支持模型 |

|---|---|---|

| Mini | ¥8.8 | KAT-Coder-Pro V1 |

注意:仅支持快手自研KAT-Coder单一模型,适合体验尝鲜。

| 套餐 | 价格 | 额度 | 支持模型 |

|---|---|---|---|

| Lite(免费) | ¥0(限量12,000名额) | 18,000次/月 | GLM-5, MiniMax M2.5, Qwen等 |

| Pro(免费) | ¥0(限量) | 90,000次/月 | 同上 |

| GLM-5专属 | ¥30/30天 | 不限tokens | GLM-5 |

亮点:限时免费活动,如有名额是绝对的零成本选择。

这两款属于独立IDE编程助手,与上述Coding Plan(API订阅套餐)定位不同:

| 产品 | 免费版 | 付费版 | 特点 |

|---|---|---|---|

| 通义灵码(阿里) | 基础版永久免费 | 专业版限时免费(原¥59/月),企业版¥79/人/月 | 深度集成阿里生态,目前个人专业版免费 |

| 百度Comate | 个人基础版免费 | 专业版¥59/月 | 独立插件,智能体模式,72元/月代金券 |

| 套餐 | 价格 | 额度 |

|---|---|---|

| 体验版 | 免费 | 250积分/2周 |

| Pro月付 | 9.95/月(~¥72) | 1,000积分/月 | | Pro年付 | 119.4/年(~¥860) |

1,000积分/月 |

注意:美元计价,价格在国内产品中偏高。

| 排名 | 厂商 | 正价 | 首月优惠 |

|---|---|---|---|

| 1 | 联通云 | 免费(限量) | ¥0 |

| 2 | MiniMax | ¥29/月 | — |

| 3 | 阿里云百炼 | ¥40/月 | ¥7.9 |

| 3 | 火山方舟 | ¥40/月 | ¥9.9 |

| 3 | 百度千帆 | ¥40/月 | ¥9.9 |

| 3 | 无问芯穹 | ¥40/月 | ¥19.9 |

| 3 | 腾讯云 | ¥40/月(预估) | ¥7.9 |

| 4 | 智谱GLM | ¥49/月 | 无(已取消) |

| 厂商 | 模型数量 | 模型列表 |

|---|---|---|

| 阿里云百炼 | 4+款 | Qwen3.5, GLM-5, Kimi-K2.5, MiniMax-M2.5 |

| 火山方舟 | ~6款 | 豆包Code, DeepSeek-V3.2, GLM-4.7, Kimi等 |

| 百度千帆 | 3+款 | GLM-5, MiniMax-M2.5, KAT-Coder等 |

| 腾讯云 | 4款 | 混元, GLM, Kimi, MiniMax |

| 无问芯穹 | 2+款 | DeepSeek-V3.2, Kimi-2.5 |

| 智谱 | 2款 | GLM-5, GLM-4.7(仅自家) |

| MiniMax | 3款 | M2.5, M2.1, M2(仅自家) |

| 厂商 | 额度机制 | Lite月总量 |

|---|---|---|

| 阿里云百炼 | 按月 | 18,000次 |

| 百度千帆 | 按月 | 18,000次 |

| 无问芯穹 | 滑动窗口 | 12,000次 |

| 火山方舟 | 5小时窗口 | ~1,200次/5h(无明确月上限) |

| 智谱 | 5小时+周 | 80次/5h, 400次/周 |

| MiniMax | 5小时 | 40次/5h |

推荐理由:

- 价格最优:首月仅¥7.9,正价¥40/月在业内属于第一梯队低价,且月度额度18,000次请求在同价位中最高。

- 模型最全:唯一一个在¥40/月的价位聚合了千问Qwen3.5、智谱GLM-5、月之暗面Kimi-K2.5和MiniMax-M2.5四大国产顶流模型,可随时切换,无需多平台订阅。

- 额度友好:按自然月计算18,000次请求,不设5小时/周等短周期滑动窗口限制,日常编程不容易碰到限额。

- 生态成熟:兼容Cursor、Windsurf、Cline、Continue等所有主流AI编程工具,配置简单。

| 场景 | 推荐 | 理由 |

|---|---|---|

| 极致省钱体验 | 联通云免费名额 / 通义灵码免费版 | 零成本入门 |

| 轻度使用、预算极低 | MiniMax Starter ¥29/月 | 全网最低月付正价 |

| 日常开发、综合性价比 | 阿里云百炼 Lite ¥40/月 | 模型全、额度足、价格低 |

| 重度编程、高频调用 | 阿里云百炼 / 百度千帆 Pro ¥200/月 | 9万次/月额度充裕 |

| 偏好字节生态 / 豆包模型 | 火山方舟 Lite ¥40/月 | 独有豆包Code模型 |

| 新产品尝鲜 | 腾讯云 Coding Plan Lite ¥7.9首月 | 混元模型 + 多模型聚合 |

对于大多数个人开发者,建议的策略是:先花¥7.9体验阿里云百炼Lite一个月,感受多模型切换的编程体验。如果觉得额度不够,再升级到Pro(首月¥39.9)。同时也可以关注联通云的免费名额活动,有名额就直接白嫖。

如果你只需要一个固定模型且预算极低,MiniMax Starter的¥29/月是目前最便宜的长期持有方案。但需要注意它40次/5小时的额度限制,对于高频编程场景可能不够用。

智谱GLM Coding Plan在2月涨价后性价比明显下滑,除非你对GLM-5模型有强依赖,否则不建议作为首选——同样的模型在阿里云百炼中也可以调用到。

- 阿里云百炼 Coding Plan 官方文档

- 火山引擎方舟 Coding Plan

- 智谱 GLM Coding Plan

- MiniMax Coding Plan

- 百度千帆 Coding Plan

- 腾讯云 Coding Plan

- 无问芯穹 Infini Coding Plan

- 优云智算 Coding Plan

- 腾讯 CodeBuddy 定价

- 博客园 - 2026年国内主流AI Coding Plan套餐全对比

- cndba - 国内大厂不同coding plan 套餐对比

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/243417.html