(来源:计算机畅想)

摘要

投资逻辑:

源自清华顶尖团队,全栈自研构建MaaS基石的大模型领军。公司由清华大学计算机系知识工程实验室(KEG)孵化。公司坚持全栈自主研发,构建了覆盖语言、多模态、智能体及代码模型的全方位MaaS平台,以云端部署和本地化部署两种方式提供服务。财务层面,公司营收呈现爆发式增长,2022-2024年复合年增长率超130%。尽管因高强度的战略性研发投入暂处于亏损阶段,但随着营收规模效应释放及运营效率提升,经营杠杆正逐步显现。

模型矩阵、人才优势、开源生态共振构筑护城河。据公司招股书,2024年公司在中国独立通用大模型开发商中收入位列第一,在所有通用大模型开发商中位列第二。公司核心壁垒在于:1)技术领先性:依托自研GLM框架构建了从端侧小模型到千亿旗舰模型的完整矩阵,多项指标对标国际SOTA;2)开源生态:累计开源模型下载量超4500万次,构建了活跃的开发者社区与硬件适配网络;3)人才优势:核心技术团队与清华KEG保持密切合作,有助于公司技术交流以及获取顶尖人才,确立可持续的技术迭代能力。

MaaS商业飞轮、端侧入口与全球化打开成长空间,迈向AGI。公司正向全球领先的AGI基础设施服务商演进,其增长逻辑清晰明确。1)商业化飞轮:随着MaaS平台规模效应显现,公司的模型服务可以降低推理成本提升毛利率,GLM 5打响2026年国产大模型涨价第一枪验证了该趋势。2)消费电子等AI终端:布局端侧Agent,AutoGLM实现跨应用自主执行,打开AI终端市场。3)全球化战略:公司积极输出主权AI基座模型,在中东及东南亚等新兴市场构建差异化竞争壁垒。4)继续增强通用大模型领域的研发能力,朝AGI发展的自我认知阶段及意识智能阶段迈进。

盈利预测、估值和评级

我们预测,2025/2026/2027年公司实现营业收入7.75亿/16.54亿/44.81亿元,同比+147.9%/+113.6%/+170.9%,归母净利润-50.37亿/-57.01亿/-58.67亿元,考虑公司是港股稀缺的纯大模型标的,给予2027年80倍PS,对应3585亿市值,目标价917港元。首次覆盖,给予“买入”评级。

风险提示

技术迭代不确定性风险;行业竞争加剧风险;商业化进展不及预期风险。

+

风险提示

AI业务拓展不及预期的风险,市场竞争加剧的风险,技术更新迭代的风险,政策性风险,大股东质押比例高的风险,投资收益导致业绩大降的风险。

详细内容欢迎访问:

报告目录:

报告正文:

01 公司概况:源自清华的AGI先行者,从MaaS基座迈向全球化布局

1.1 公司简介和发展历程

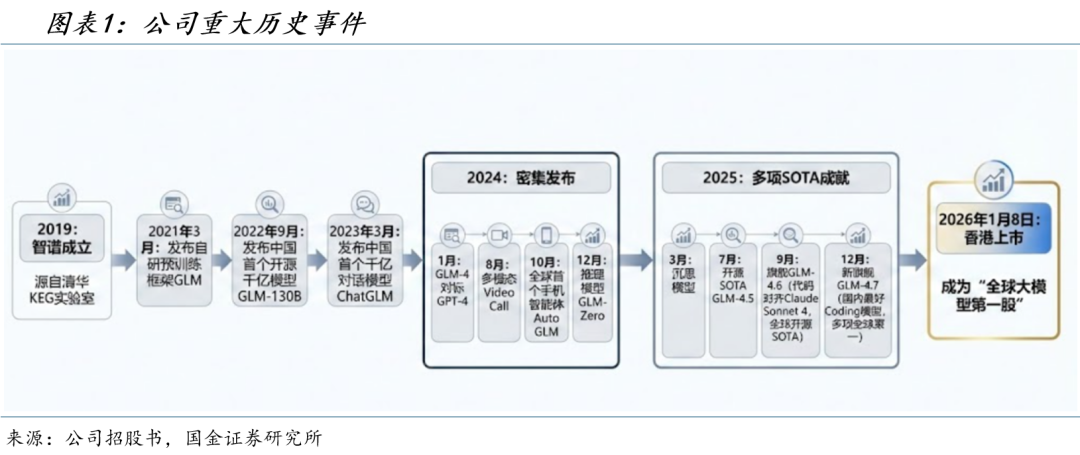

公司成立于2019年,由清华大学计算机系知识工程实验室(KEG)技术成果转化而来,具备从底层算法、预训练框架到国产硬件适配的大模型全链路自主研发能力。公司以“让机器像人一样思考”为愿景,以实现通用人工智能(AGI)为目标,极致专注探索人工智能上限,致力于用大模型实现甚至超越人类的语言、推理、视觉、听觉、工具使用等能力。公司连续三年实现收入翻倍增长,已经发展成为中国最大的独立大模型厂商。目前,GLM系列大模型应用于民生治理、工业制造、能源电力、金融、互联网、通信、消费电子、教育等行业,拥有超过270万的客户与开发者。

公司的发展历程标志着中国大模型技术的多次突破:

1.2 公司管理层分析

公司由一支精英科学家和工程师团队领导,具备极强的“学术+行业”背景:

•刘德兵博士(董事长):联合创始人,在大语言模型、机器学习和数据挖掘领域拥有近18年经验,主导过30余项重大科研项目。

•张鹏博士(首席执行官):联合创始人,负责日常运营与管理,是GLM系列模型的核心贡献者,致力于“知识+数据”双驱动的AI框架。

•李涓子教授(非执行董事):联合创始人,清华大学知识工程实验室(KEG)主任,在语义内容管理及搜索领域具有权威地位。

•张鈸院士(首席科学家):中国科学院院士,为基础AI理论和实际应用提供顶层指导。

•唐杰博士(联合创始人):清华大学计算机科学系教授,研究方向包括通用人工智能(AGI)、数据挖掘、社交网络、机器学习和知识图谱。

1.3 公司主营业务

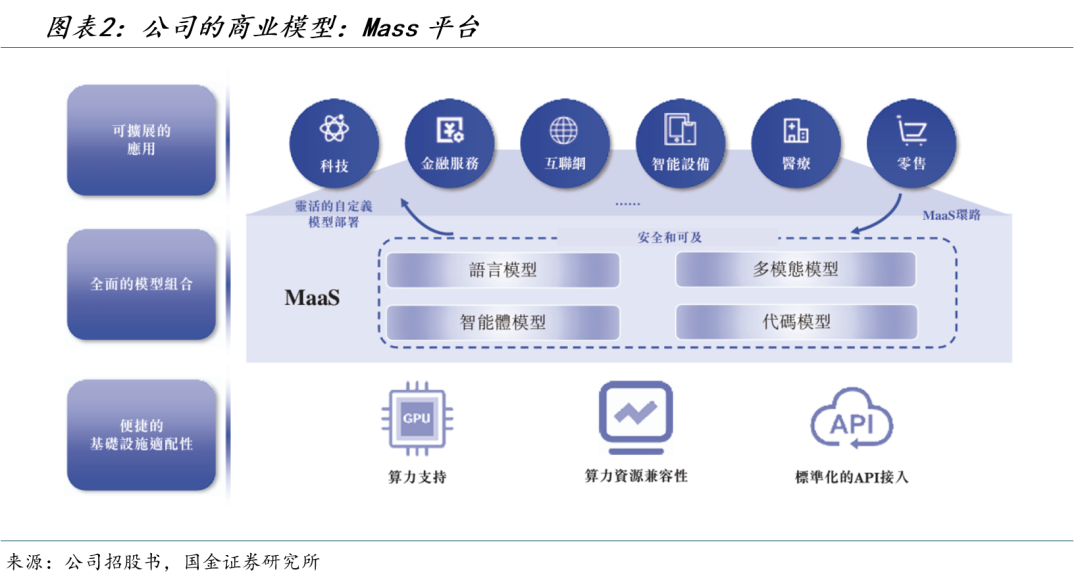

公司围绕一体化MaaS平台组织产品供应,通过云端和本地化两种方式交付智能服务。公司旗下MaaS平台主要提供四类模型:语言模型、多模态模型、智能体模型及代码模型,以及用于模型微调、部署及智能体开发的集成工具。

公司MaaS平台的主要优势为模型能力全面覆盖、应用场景广泛扩展性及多元化算力基础设施适应性:

全面的模型组合:公司模型矩阵涵盖语言模型(如GLM-4.5)、多模态模型(如图像生成CogView、视频生成CogVideoX)、智能体(AutoGLM)及代码模型(CodeGeeX)等,在语言、多模态、智能体及代码能力方面展示出行业领先的性能。从公司广泛而强大的产品组合中,客户和开发者总能找到最适合其特定需求的解决方案。

可扩展的应用:公司的模型及智能体旨在跨多样化硬件、跨应用场景、跨业务工作流程无缝进行工具调用并执行复杂任务,支持 AI 原生的多模态复杂对话及深度推理。MaaS 平台提供了一个智能体工作区,其中包含各种智能体模板及基于场景的解决方案。通过该智能体工作区,客戶可通过简化的模型微调、增量模型训练及提示工程,迅速定制智能体。

便捷的基础设施适配性:与算力基础设施合作伙伴携手共同设计先进的算力基础设施,使MaaS 平台能够提供集成计算、网络、训练通信以及推理加速能力。支持从 15 亿到 2300 亿参数的模型规模,并能够实现大规模、实时的跨云及芯片组部署。此适配性使模型能够扩展到大众使用设备,如手机、个人电脑及智能汽车终端。

公司的业务主要根据模型的部署方式划分为两种:

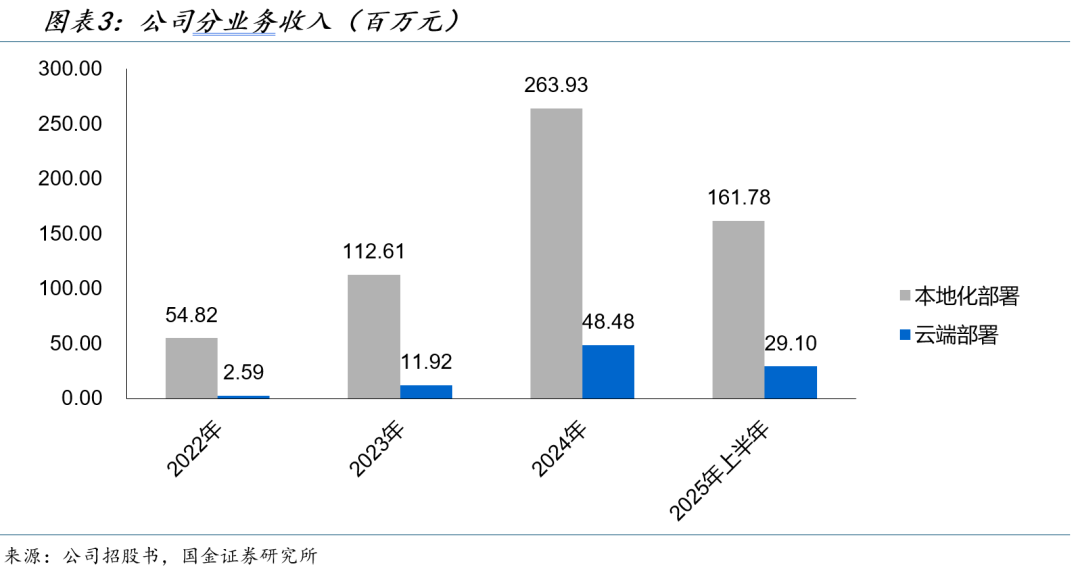

•本地化部署:模型托管在客户自己的基础设施内,使客户能够利用其专有或敏感数据,定制私域专属 AI 模型.为对数据安全及定性需求较高的大型企业及公共行业实体提供服务。2024年该业务贡献收入2.64亿元,占总收入的84.5%。

•云端部署:模型托管在云端基础设施上,适合寻求敏捷性和易于实施性的企业。客户无需昂贵的本地基础设施能够快速且经济高效地部署AI 解决方案。2024年收入为4,848万元,占总收入的15.5%。

1.4 公司财务状况

公司近年实现了收入的爆发式增长,但由于战略性研发投入巨大,仍处于亏损阶段:

• 营业收入:2022年至2024年分别实现收入5741万元、1.25亿元和3.12亿元,复合年增长率超过130%。

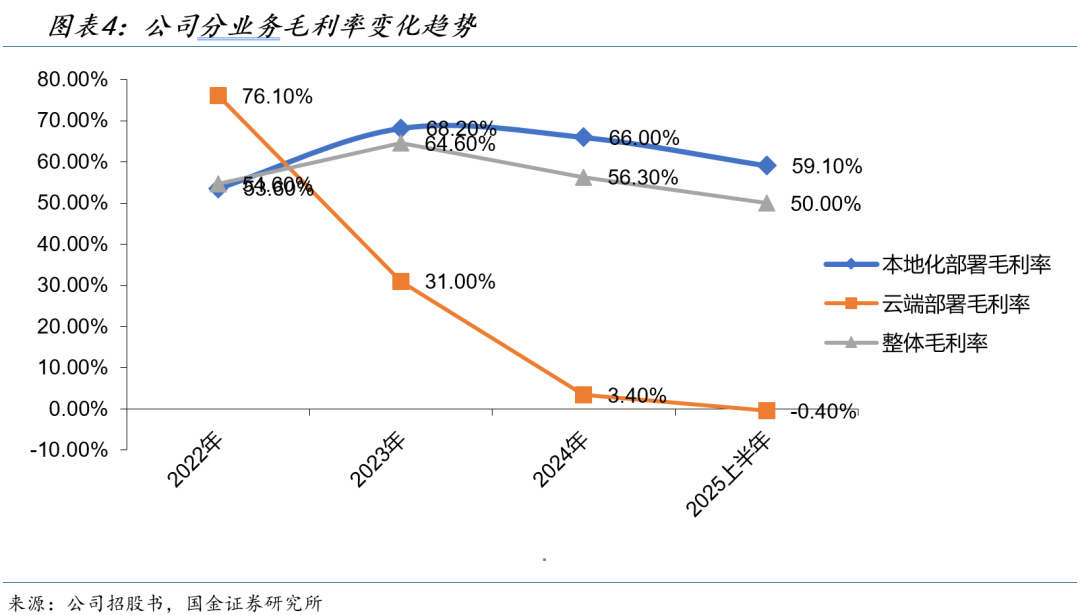

•毛利率:分业务看,本地化部署是公司盈利能力稳健的基石 ,该业务毛利率长期维持在较高水平,由2022年的53.6%增长到2023年的68.2%,主要是由于公司的模型多样化及性能提高,推动服务的成熟性提高及复杂性增加。云端部署毛利率2022年至今呈下降趋势,主要由于:1.随着市场竞争加剧,通过API接口访问模型服务的价格普遍下跌。2.公司采取了主动战略性降价,旨在吸引更多客户并迅速扩大市场占有率。

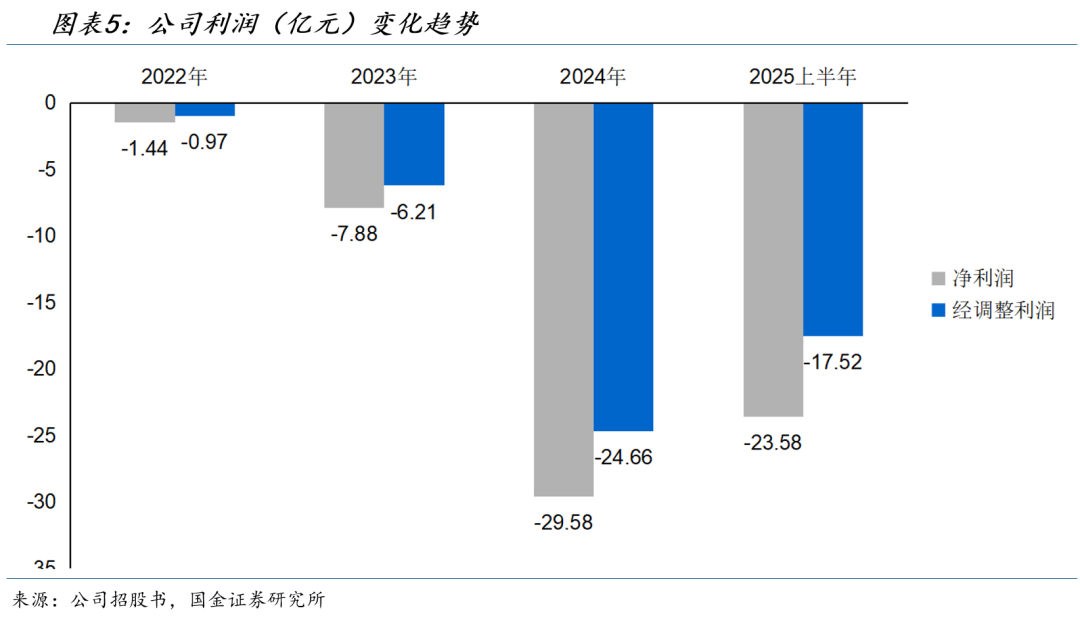

•净利润:公司的年内亏损从2022年的1.44亿元增加至2024年的29.58亿元。2025年上半年的净亏损为23.58亿元,较2024年同期的12.36亿元增长约90.83%。净亏损的增加主要由于公司在研发方面进行了重大投资,以支持先进模型的开发和基座模型的持续改进。

•各项费用率:

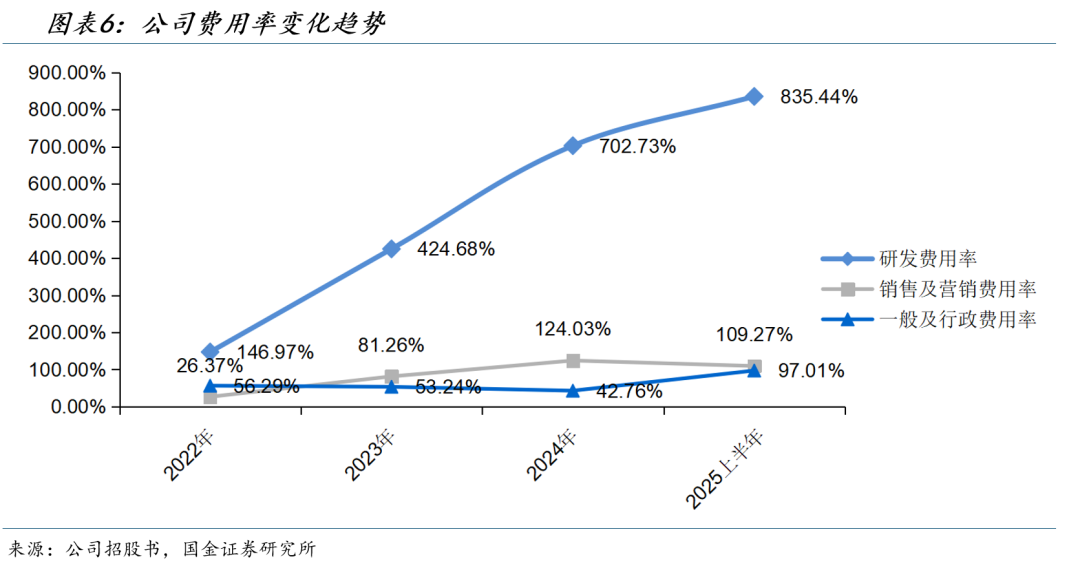

研发开支始终占据主导地位:研发开支率从2022年的146.97%迅速攀升至2024年的702.73%,主要由于公司投入大量精力进行基座模型的迭代及推进技术基础设施建设,反映了公司致力于探索智能上限的长期战略。

管理效率与经营杠杆初显:销售及营销开支随市场扩张波动,一般及行政开支率从2022年的56.29%整体呈下降趋势,至2024年降至42.76%,体现了公司实施了有效的成本控制措施并提升了运营效率。预期公司未来,随着收入的高速增长和运营效率的优化,各项费用率将持续下降。

02 行业格局:国产大模型商业化提速,独立厂商份额持续集中

2.1 行业发展状况

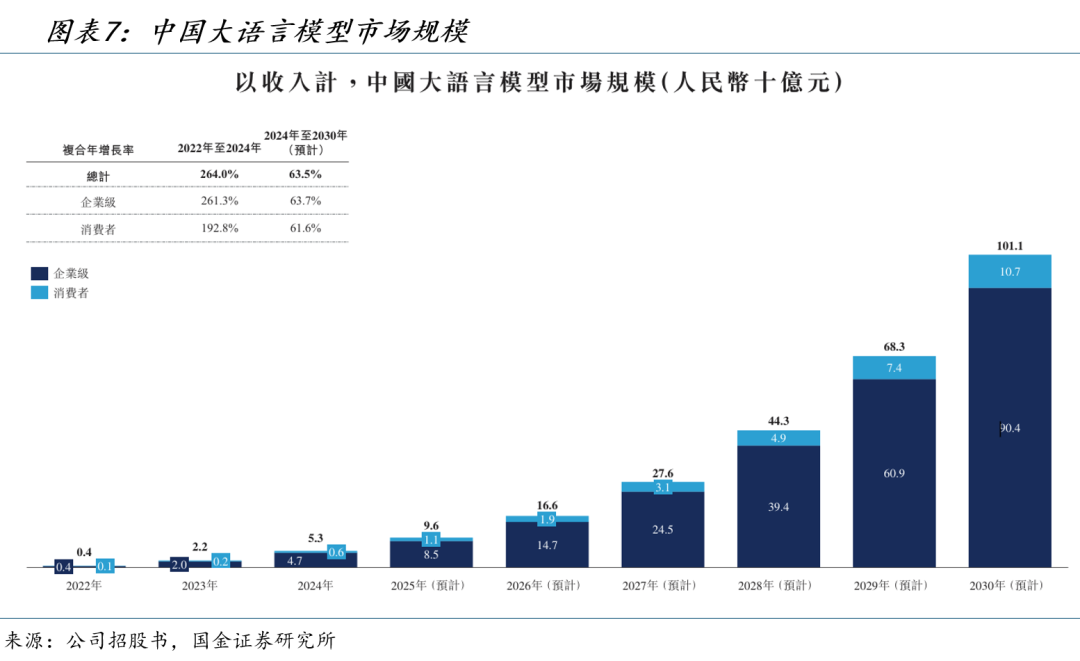

大语言模型(LLM)已成为引领AI行业范式变革的核心力量。据公司招股书,2024年中国大语言模型市场规模达53亿元,预计到2030年将增至1,011亿元,2024年至2030年的复合年增长率为63.5%。机构客户仍将是市场增长的核心,估计到2030年中国企业级大语言模型市场规模将达到人民币904亿元,2024年至2030年的复合年增长率为63.7%。行业正从简单的预训练阶段向对齐推理、自主学习及更高级的意识智能阶段演进。

大模型技术正从单纯的各类内容生成向具备深度逻辑推理与自主执行能力的Agentic AI跃迁。智能体(Agent)将重塑工作流: 根据 Gartner 的最新战略预测,到2028年,至少15%的日常工作决策将由代理型AI(Agentic AI)自主做出(2024年该比例为0%)。公司的 AutoGLM 能够跨应用执行复杂任务(如自主点餐、跨App协作),不仅是交互方式的革命,更标志着AI从“辅助工具”向“自主劳动力”的转变,极大提升了模型在B端复杂场景下的商业价值。

2.2 行业市场份额

中国大语言模型市场的参与者可分为独立提供商及非独立提供商。独立提供商从业务开展初期就具备大语言模型技术原生、大语言模型产品原生及大语言模型商业模式原生的特点;而非独立提供商则通常为涉足AI领域的科技巨头。与非独立提供商相比,独立提供商面临着非常不同的竞争动态。例如,非独立提供商利用其原有的多元化业务线,积累了庞大的用户群,这有利于其大语言模型产品的推广。然而,另一方面,如果科技巨头经营的业务线与客户自己的业务直接竞争,企业客户可能不愿意选择其提供的大语言模型产品。此外,若干行业的企业客户对进入或可能进入若干科技巨头的影响范围十分谨慎,且更倾向于采用“纯粹(pure-play)”提供商的 AI 解决方案。

根据弗若斯特沙利文的资料,按2024年收入计:

•公司在中国所有通用大模型开发商中位列第二,市场份额为6.6%。

•公司在中国独立通用大模型开发商中位列第一。

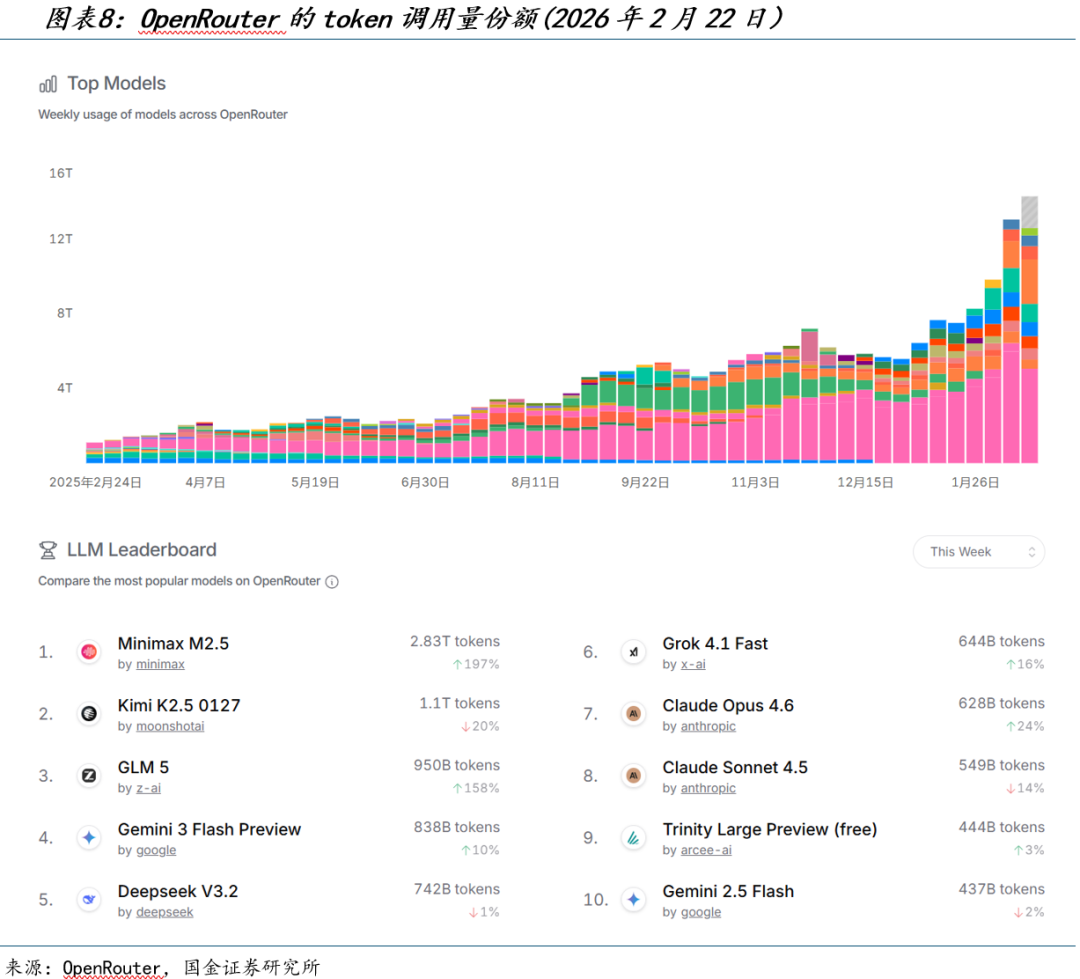

在海外的API聚合平台OpenRouter上,公司的模型也具备极强竞争力,2026年2月22日数据显示公司的GLM 5模型占据OpenRouter的token调用量位居第三名。

2.3 公司核心竞争力

2.3.1 大模型技术的领先性:

依托自主研发的大模型预训练框架 GLM,公司构建起全面的模型体系,可向客户提供多类型基座模型及快速定制化服务。其模型矩阵覆盖端侧小模型、经济型模型及千亿参数旗舰大模型等不同参数规模,能精准匹配特定客户需求;功能层面则涵盖对话、通用智能体、代码生成、图像理解、文生图/视频、语音交互等多元场景,实现对各类模型应用需求的全面覆盖。

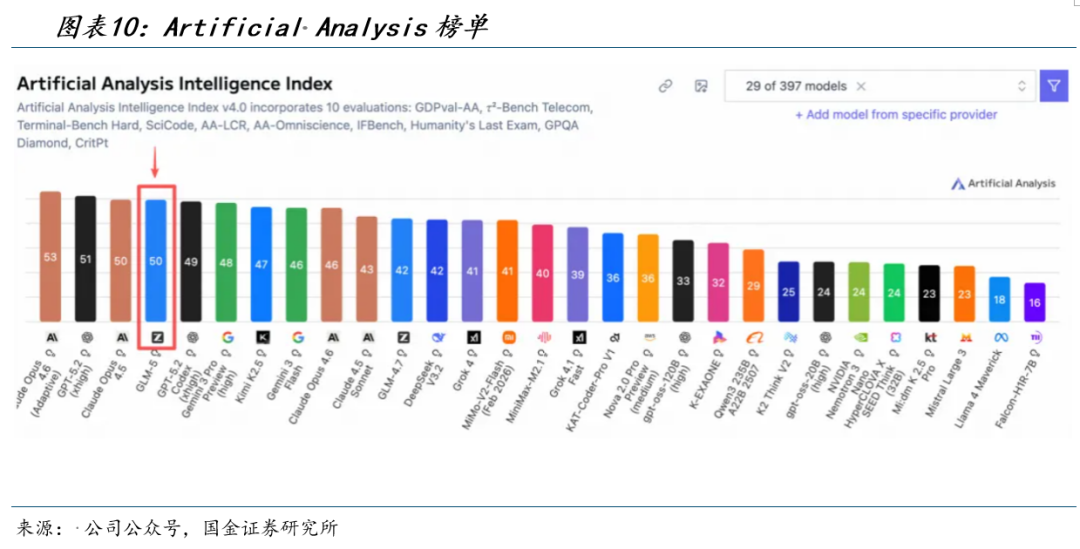

2025年12月28日,在全球知名的权威大模型评测榜单Artificial Analysis Intelligence Index(AA智能指数)中,GLM-4.7以68分综合成绩荣登开源模型与国产模型双料榜首、全球第六。Artificial Analysis Intelligence Index重点考核模型的知识储备、逻辑推理、代码生成及Agent(智能体)等核心维度,被业界公认为最能代表模型综合实力的风向标。

2026年2月12日,公司上线并开源GLM-5,在全球权威的Artificial Analysis榜单中位居全球第四、开源第一,排名超越国内其他大模型如Kimi、Qwen、MiniMax、DeepSeek等。在Coding 与Agent 能力上,取得开源SOTA 表现,在真实编程场景的使用体感逼近 Claude Opus 4.5,擅长复杂系统工程与长程Agent任务。

公司还发布了GLM-5技术报告,披露核心创新点,我们认为这彰显了公司的技术创新能力和开源精神,GLM-5实现性能大幅跃升主要得益于以下四大技术创新:

1)引入 DSA 稀疏注意力机制(DeepSeek Sparse Attention, DSA)。DSA 机制则使 GLM-5 能够根据Token 的重要性动态分配注意力资源。在不折损长上下文理解和推理深度的前提下,算力开销得以大幅削减。

2)构建全新的异步 RL 基础设施。基于 GLM-4.5时期 slime 框架“训练与推理解耦”的设计,公司的新基建进一步实现了“生成与训练”的深度解耦,将 GPU 利用率推向极致。

3)提出全新的异步Agent RL算法。公司研发的异步算法使模型能够从多样化的长周期交互中持续学习。这一算法针对动态环境下的规划与自我纠错能力进行了深度优化,这也正是 GLM-5 能够在真实编程场景中表现卓越的底层逻辑。

4)全面拥抱国产算力生态。从模型发布伊始,GLM-5 就原生适配了中国 GPU 生态。公司已完成从底层内核到上层推理框架的深度优化,全面兼容七大主流国产芯片平台:华为昇腾、、海光、、昆仑芯、沐曦与燧原。

2.3.2 学术底蕴与人才:

公司核心团队具有清华大学等顶尖科研机构和高校的专家背景。截至 2025年6月30 日,研发人员占比74%以上,公司的团队专注于自然语言处理、复杂系统中的高级决策、多模态语义分析等领域。核心技术团队与清华大学知识工程实验室 (KEG)保持着密切而持久的合作伙伴关系,形成了独特而强大的技术交流。这种联系植根于共同的学术血统,有助于在公司技术路线图中注入连续性和连贯性。这使公司能够系统地与KEG进行合作,以取得前沿研究成果,并确保高素质人才的稳定流入。截至2025年6月30日,公司的精英科研团队和学术顾问团队已发表约 500 篇顶尖高影响力论文,累计引用次数超过58000次。

我们认为清华大学背景是公司与国内其他大模型厂商最大的差异化竞争优势,也是我们认为其在基础模型迭代、长期技术壁垒构建与顶尖人才储备上,能持续领跑行业的核心信心所在。

2.3.3 基于开源战略构建充满活力的生态系统:

作为中国首家发布自研开源大模型的人工智能企业,公司于2023年跻身斯坦福大学全球最受欢迎开源大模型厂商前五,为中国唯一入选者。截至 2025年6月30 日,公司已开源 50 余个模型,累计下载量超 4500 万次,依托开源战略构建起活跃的开发者社区,持续强化行业影响力与全球品牌形象。

在产业链上游,公司与头部算力基础设施供应商深度合作,通过自研算子库等技术,实现模型与 40 余款国内外主流硬件芯片的兼容适配,形成高效的多元硬件环境模型训练能力,并为机构客户提供定制化芯算一体解决方案,拓展硬件合作网络。

在下游应用端,公司携手灯塔客户与行业伙伴打造标杆案例,同时通过行业网络发展项目“Z 计划”,为技术与资源有限的早期初创企业提供大模型及基础设施权限与定制化技术支持,助力其拓展长尾市场业务,推动大模型向新行业场景渗透。此外,公司积极开展地域合作,参与构建中国及东南亚地区的国家与城市级基座模型平台,凭借产业链协同与生态合作实现业务增长。

2.3.4 公司与其他主要独立大模型厂商的差异化定位

公司 vs MiniMax:B端全栈vs C端出海。 两者是港股仅有的两家纯大模型上市公司,但公司超八成收入来自本地化部署,客户以B端和G端为主,服务对数据主权高敏感的客户。MiniMax则以C端为主,商业化路径则主要为:订阅服务、应用内购买、企业API等。在出海方面,MiniMax超70%收入来自海外,智谱的海外业务拓张尚属于初期,目前更多集中在东南亚地区。截至2025年上半年,海外收入占比为11.6%

公司 vs DeepSeek:商业化vs 技术极致主义。 DeepSeek背靠量化基金幻方,不依赖外部融资,不需要追求短期商业化,做出巨大开源技术贡献。智谱则拥有完整的商业化闭环(从模型能力到实施交付)、成熟的政企客户网络、以及上市后的品牌信任度,使其能将技术能力有效转化为商业收入。

公司 vs Kimi(月之暗面):全栈模型矩阵 vs 垂直场景突破。 据36kr,Kimi押注"垂直Agent",试图用"深度研究"的专业标签切割出差异化赛道。2026年1月发布的K2.5亮点在于Agent集群能力。相比之下公司的差异化在于:1)模型矩阵的完整性——覆盖语言、多模态、智能体、代码生成全品类。

03 未来展望:双业务模式协同共振,规模效应拐点临近

随着大模型行业步入应用落地并行的下半场,公司正从单一的技术提供商向全球领先的AGI(通用人工智能)基础设施服务商演进。我们认为,公司未来的增长空间将主要由以下核心逻辑驱动:

3.1 商业化爆发:垂类渗透与MaaS生态的飞轮效应

高壁垒行业的本地化深耕: 公司在私有化部署领域拥有先发优势公司可以通过顶级高校背景以及模型+算力一体化解决方案让公司在政务、金融、能源等对数据主权高度敏感的行业筑牢护城河,提升大客户续费率与客单价。

MaaS平台的规模经济: 通过“模型定义算力、算力反哺模型”的策略,公司正在构建强大MaaS平台生态。公司上市募集的资金将进一步优化MaaS平台,提供最新的基座模型及训练/推理工具,通过降低模型微调和智能体开发的门槛,吸引更多开发者和企业客户,随着规模效应显现以及模型架构优化带来的推理成本下降,有望推动毛利率结构性改善,加速实现盈亏平衡。

2026年2月公司打响2026年国产大模型涨价“第一枪”:2月12日公司新一代旗舰模型GLM-5正式开源并上线,并发布涨价声明:因市场需求持续强劲增长,用户规模与调用量快速提升,为保障高负载下的稳定性与服务质量,公司决定对GLM Coding Plan套餐价格体系进行结构性调整,整体涨幅自30%起。据新浪网,海外版GLM-5定价涨幅高于国内:Coding plan订阅价格提高30%-60%,API调用价格提升67%-100%。

据上海证券报,GLM Coding Plan上线即售罄——国产AI编程模型的付费套餐被抢空,在行业中颇为罕见。我们认为,随着模型能力在应用端的实用性达到临界点,好用的大模型能带来生产力,用户付费意愿的提高水到渠成,同时公司的GLM Coding Plan提价仍供不应求,也验证了公司的模型能力具备极强竞争力,随着大模型持续迭代,公司的API服务具备巨大的商业化潜力。

3.2 消费电子与IoT:抢占AI终端入口

公司通过 GLM-Edge 系列端侧模型与 AutoGLM 智能体技术,展现出向智能设备(手机、PC、汽车)终端渗透的潜力。

颠覆性的人机交互体验:AutoGLM 是公司AI推出的Agent智能体,它为用户部署了一台智能体手机与智能体电脑。只需发布指令,它就能在云端帮用户执行App操作、网页任务和跨应用工作流。AutoGLM 将手机转变为“全能私人助理”,用户仅需语音指令即可完成跨App操作(如“帮我点一杯和昨天一样的咖啡并发给老板”)。这种无需依赖云端高并发的端侧能力,有望使公司成为手机等终端厂商的底层合作伙伴,开启新的收入增长极。

3.3 全球化布局:资本出海与技术输出双管齐下

公司正积极打破单一市场的局限,拓展国际版图。依托与沙特阿美旗下 Prosperity7 Ventures 等国际顶尖资本的合作关系(公司于2024年获得Prosperity7投资,成为中国首家获沙特国家背景基金投资的大模型独角兽),公司有望成为中东及东南亚国家构建“主权AI”的首选合作伙伴。不同于简单的API输出,公司正参与构建海外国家级与城市级基座模型平台,这种深度的基础设施输出模式,有助于在欧美巨头尚未完全垄断的新兴市场建立长期壁垒。

据新浪财经,全球AI巨头Open AI曾在一份名为《Chinese Progress at the Front》(中国在前沿领域进展)的官方报告中提到,围绕主权AI竞争,OpenAI认为公司已经成为自己的重要对手之一。由公司主导,来自东盟十国及10个共建“一带一路”国家共同发起了“自主大模型国际共建联盟”,帮助共建“一带一路”国家构建可控的国家级AI基础设施。目前,海外主权大模型已经落地多个国家,实现我国大模型技术出海的“零的突破”,展现了中国模型的技术形象。这不再是简单的软件出口,而是在帮助友好国家搭建自己的“数字主权大模型”,为中国在AI全球竞赛中守住了关键阵地。

3.4持续的技术迭代与AGI探索

公司将继续增强在通用大模型领域的研发能力,特别是向AGI(通用人工智能)迈进。公司认为,实现AGI的路线将遵循以下路径:

•预训练阶段。教会机器理解、书写并使用人类语言进行交流。

•对齐及推理阶段。将机器智能与人类意图对齐,并教会机器进行推理与规划。 这包括提升安全性,减少幻觉,并实现语言智能与图片、视频、语音和行动的 对齐。

•自主学习阶段。教会机器通过自我批评、自我反思及沉思,从而实现机器智 能从自身的思维和行动中进行学习。

•自我认知阶段。在人类监督的情况下,机器通过观察自身行为及自我解读,逐步形成其自主的态度及情感。

•意识智能阶段。机器开始对自身的内部状态及外部环境产生感知,表现出类似于 人类意识的特征(即使对人类而言,该概念亦很复杂)。

公司已开发出首三个阶段的大模型及智能体,如中国首个千亿规模大模型GLM-130B (预训练阶段)、中国首个开源大型聊天模型ChatGLM(对齐及推理阶段)以及中国首个具备 反思能力的AI agent AutoGLM – Rumination(自主学习阶段)。公司正站在AGI创新的前沿,朝着自我认知阶段及意识智能阶段迈进。

04 盈利预测与投资建议

4.1 收入拆分预测

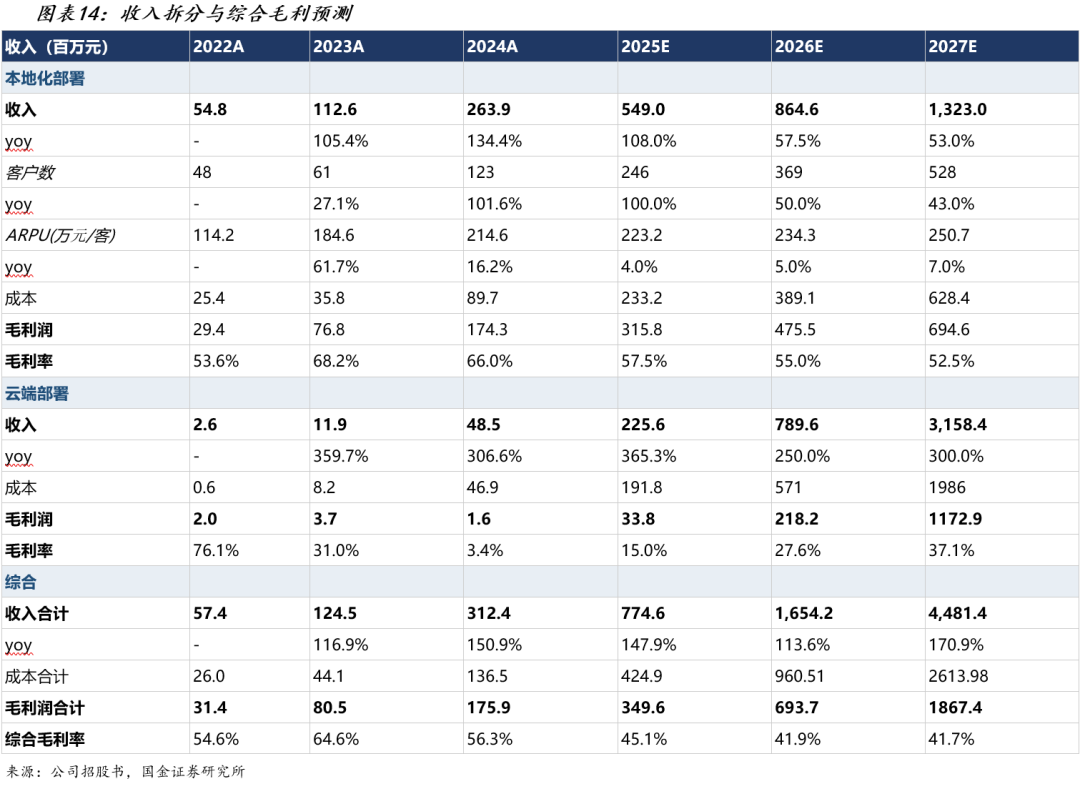

公司收入可拆分为本地化部署和云端部署两大业务板块,分别对应不同的商业逻辑与增长驱动因子。本地化部署面向大型机构客户,我们采用"客户数×ARPU"框架进行自下而上建模;云端部署面向机构与个人开发者的混合用户群体,公司披露的具体客户数仅含机构客户(2024年为5457家),因此我们采用收入增速法进行预测,并以机构客户数增长趋势作为辅助验证。

(一)本地化部署:客户扩张与单价提升双轮驱动

本地化部署面向对数据安全与定制化需求较高的大型企业及政务客户,收入由"客户数×单客户年均收入(ARPU)"决定。该业务具有项目制特征,客户黏性强、ARPU较高,构成公司当前核心收入来源。

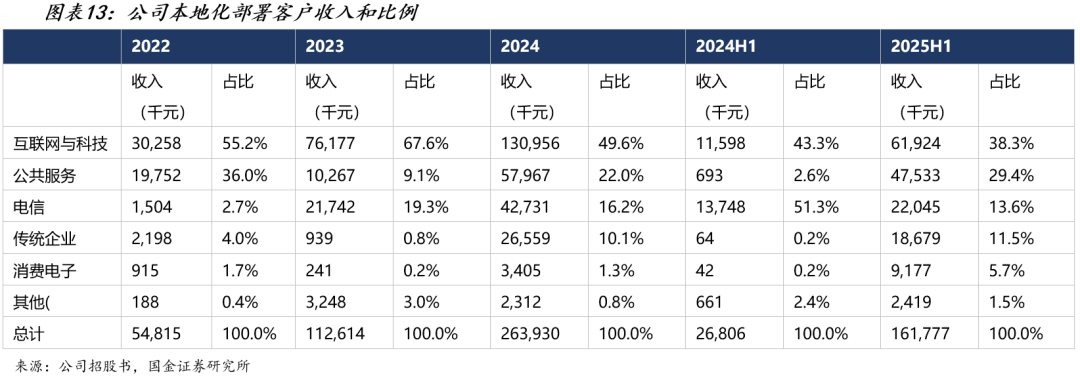

从客户行业垂直分布的演变看,公司本地化部署业务呈现从单一行业向多行业渗透趋势。2022年互联网与科技行业贡献了55.2%的本地化收入,具有较高的集中度;到2025年上半年,该比例已降至38.3%,公共服务行业从2024H1的仅69万元增长到2025H1的4,753万元,反映政务大模型需求正从试点走向规模化落地;传统企业从2024H1的6.4万元跃升至2025H1的1868万元,说明制造业、零售等传统行业的AI渗透正突破临界点;消费电子从2024H1的4.2万元增长至2025H1的918万元,与公司在端侧AI(AutoGLM)的布局形成呼应。

我们认为这种多行业渗透格局对公司的客户黏性具有积极意义,本地化部署客户一旦将大模型深度集成到业务流程中(如金融风控、政务审批、能源调度等),迁移成本极高。同时公司在互联网与科技行业的收入尽管占比下降,但绝对额从2022年的3,026万持续增长到2024年的1.31亿元,说明早期客户并未流失,而是在持续加大投入。这种"老客户不断追加、新行业持续涌入"的增长模式,为本地化部署业务的收入可预见性提供了坚实支撑。客户数方面,公司2022-2024年本地化部署客户数从48家增至123家。2025H1公司已签约95家客户。因此我们预计2025年客户数翻倍至246家(yoy+100%),预计2026年之后随着各行业客户渗透率提升、市场竞争格局趋稳,增速逐步回落,至2026年50%(369家)和2027年43%(528家)。

ARPU方面,我们根据本地化部署收入除以客户数得出2024年本地化ARPU约214.6万元/客,较2023年的184.6万元稳步提升16.2%。我们假设ARPU增速2025-2027年分别为4%/5%/7%,对应ARPU约223万/234万/251万元。增速假设的逻辑为:随着深度应用场景拓展(如Agent部署、多模态集成),客户投入意愿增强。

综合来看,我们预测本地化部署收入2025/2026/2027年分别为5.49亿/8.65亿/13.23亿元,同比+108%/+58%/+53%。

毛利率方面,本地化部署毛利率2022-2023年从53.6%提升至68.2%,反映模型成熟度提升带来的服务溢价增强以及交付标准化程度的提高。2024年小幅回落至66.0%,系新客户拓展过程中定制化需求增加及算力成本投入上升所致。2025H1毛利率为59.1%,较2024全年继续回落。我们预计本地化毛利率将呈下行趋势,2025/2026/2027年分别为57.5%/55.0%/52.5%,核心原因主要是随着模型参数规模持续扩大及推理复杂度提升,单项目算力成本攀升。

(二)云端部署:规模效应放大,收入高速增长

云端部署面向机构客户及个人开发者,用户通过API调用模型服务按量付费。该业务具有高度可扩展性,是公司中长期收入增长的核心引擎。招股书中披露的云端客户数仅统计机构客户(2024年为5457家),而公司官网称已有270万开发者。公司未分别披露机构和个人用户的收入贡献,因此我们基于收入增速法直接预测。

我们预测云端部署收入2025/2026/2027年分别为2.26亿/7.90亿/31.58亿元,对应同比增速+365%/+250%/+300%。增速假设的核心论证如下:

2025年(yoy+365%):增速较2024年的+307%有所提升,驱动力包括:1)大模型工具使用能力增强,企业级客户从试用走向生产部署:从概念验证阶段开始转为正式的生产级调用,单客户token消耗量显著提升;2)MaaS平台生态扩展:开源社区累计下载量超4,500万次的开发者生态持续转化为付费用户。

2026年(yoy+250%):驱动力包括:1)GLM-5于2026年初率先打响国产大模型涨价第一枪,2026年将体现定价提升带来的收入增长;2)Agent等高附加值场景爆发:智能体工作流的token消耗量远高于基础问答场景,AutoGLM等产品的商业化落地将带来增量需求。

2027年(yoy+300%):驱动力包括: 1)海外市场增量:公司在中东及东南亚的主权AI基座模型输出有望贡献云端API收入;2)推理需求的指数级增长:随着AI应用渗透到更多生产环节,总推理调用量将呈爆发式增长。

从机构客户数的维度做辅助验证:公司2024年机构客户5,457家,2025H1已达3,061家,机构客户仍保持快速增长。但机构客户数增速不等于收入增速——收入增长更多由存量客户的调用深度提升和单价上调驱动,而非单纯靠新增客户数量。这一特征与海外MaaS平台(如OpenAI API)的增长模式一致:客户数增长趋稳后,收入增长主要来自单客户价值的深挖。

毛利率方面,云端部署毛利率经历了较大波动:2022年为76.1%(基数小参考性有限),2023年降至31.0%,2024年进一步降至仅3.4%。展望未来,我们预计云端毛利率将触底回升,2025/2026/2027年分别为15.0%/27.6%/37.1%。毛利率修复的核心驱动力包括:

1)模型能力到达Agent效益临界点,用户付费意愿强化。随着模型能力从简单的文本生成,到自主完成复杂任务流的Agent,用户能用模型提高更多生产力。据财联社2026年2月报道,“大模型六小虎”中,在2025年已有智谱、月之暗面、MiniMax、阶跃星辰4家对部分API价格进行上调,百川智能、零一万物2家保持价格不变;阿里、字节、腾讯、百度等大厂则广泛采用阶梯定价策略。GLM-5整体涨幅自30%起,海外版涨幅高于国内:Coding plan订阅价格提高30%-60%,API调用价格提升67%-100%。

2)推理效率提升:模型优化和硬件升级有效降低单次调用的算力成本;大模型推理成本的下降受到多重技术创新的叠加驱动:模型层面技术优化,例如GLM-5引入DSA 稀疏注意力机制根据Token 的重要性动态分配注意力资源大幅削减算力开销。基于slime 框架“训练与推理解耦”的设计实现“生成与训练”的深度解耦,将 GPU 利用率推向极致。硬件层面,芯片的持续进步迭代也会降低单位算力成本,公司已完成GLM-5与多家国产芯片平台的原生适配,随着国产GPU性价比持续提升和供给放量,推理算力的成本有望进一步下探。

3)规模效应:随着调用量增长,摊薄运维人员等固定成本。云端API业务的成本结构中,除了随调用量线性增长的GPU算力成本外,还包含运维团队薪酬、平台基础设施维护等成本。当调用量上升时,这部分固定成本的单位分摊将下降。

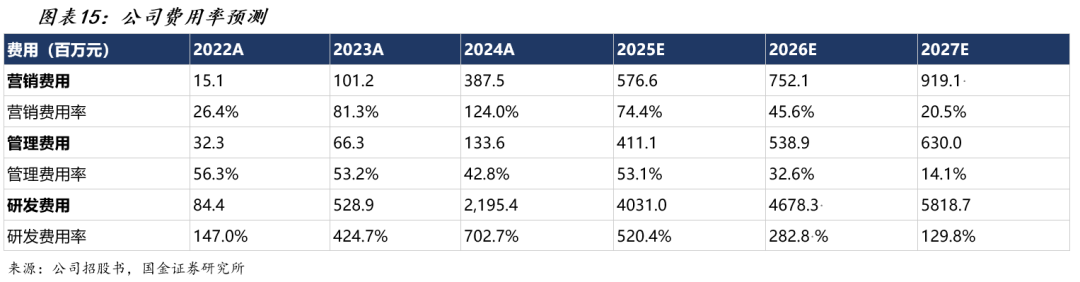

4.2 费用预测

公司三大费用规模预计持续扩张,但随着收入端高速增长,各项费用率均呈现显著下降趋势,经营杠杆效应逐步释放。

营销费用方面,2022-2024年公司营销费用从1514万元快速攀升至3.87亿元,费用率由26.4%大幅提升至124.0%,反映公司在商业化早期阶段进行了积极的市场拓展与品牌投入。从营销费用结构看,广告及营销开支是最大组成部分(2024年占61.3%),其次为工资成本(占24.2%)。2025H1营销费用208.6百万,其中广告营销支出同比增长18.5%(2025H1收入增长325%,显示获客效率有所提升)。我们预计2025年营销费用为5.77亿元(费用率74.4%),此后随着品牌认知度提升和获客边际成本下降,费用率进一步降至2026年的45.6%和2027年的20.5%。

管理费用方面,2024年管理费用1.34亿元,费用率42.8%。2025H1管理费用已达1.85亿元(费用率97.0%),大幅高于历史水平,预计主要因公司为IPO上市准备产生了大量中介及合规费用。我们预计2025年全年管理费用为4.11亿元(费用率53.1%),2026/2027年随着一次性上市费用消化和管理效率提升,管理人员扩张节制,费用率将分别降至32.6%和14.1%,对应绝对值5.39亿和6.30亿元。研发费用方面,研发投入是公司最核心的战略支出。2022-2024年研发费用从8,438万元急剧扩张至21.95亿元,费用率从147.0%攀升至702.7%。研发费用中,算力训练成本是最大组成部分(2024年占70.7%),其次为工资成本(占14.8%)和折旧摊销(占11.8%)。我们预计2025年研发费用为40.3亿元(费用率481.7%),2026/2027年分别为46.78亿/58.18亿元(费用率282.8%/129.8%)。核心假设为训练算力成本以及研发人员扩张,带来研发费用绝对值的大幅上升,反映GLM-5等旗舰模型的大规模训练需求。

4.3盈利预测与估值分析

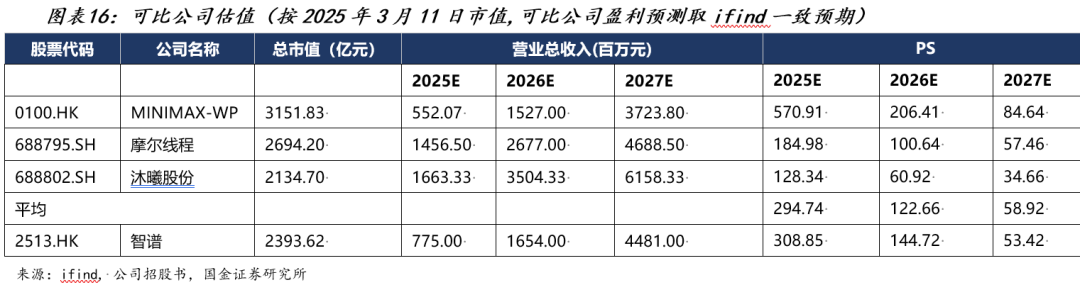

基于以上收入与费用端的核心假设,我们预测公司2025/2026/2027年营业收入分别为7.75亿/16.54亿/44.81亿元,同比增速分别为+147.9%/+113.6%/+170.9%,收入端呈现加速增长态势。利润端,受制于高强度研发投入,公司短期内仍将维持亏损,预计归母净利润2025/2026/2027年分别为-50.37亿/-57.01亿/-58.67亿元。

估值与投资建议方面,公司当前仍处于亏损阶段,传统PE估值框架暂不适用,建议以PS估值法为主要参考。我们选取MiniMax(港股大模型直接可比)、摩尔线程和(国产算力,同属国内AI产业新上市公司)作为可比公司。三家公司均处于商业化早期的高研发投入亏损阶段。

考虑到:1)智谱在模型矩阵、开源生态以及清华技术背景方面具有差异化优势;2)公司处于港股稀缺的纯大模型标的地位,稀缺性溢价合理。我们给予公司2027年收入80倍PS,对应市值约3585亿人民币,目标价917港币。首次覆盖,给予"买入"评级。

05 风险提示

- 技术迭代不确定性风险: 人工智能行业具有持续变化和技术突破快的特点,如果研发进展不及预期,可能影响公司竞争力。

- 行业竞争加剧风险。众多大模型厂商目前参与到市场竞争之中,若市场竞争进一步加剧,可能影响公司盈利能力。

- 商业化进展不及预期风险:大模型市场尚处于早期阶段,公司若无法持续将技术优势转化为符合市场需求的商业解决方案,公司收入增长可能放缓。

报告信息

证券研究报告:《公司深度研究:智谱:源自清华的大模型龙头,从MaaS基座迈向AGI》

对外发布时间:2026年3月14日

报告发布机构:股份有限公司

证券分析师:

刘高畅:SAC执业编号:S05

邮箱:liugaochang@gjzq.com.cn

李可夫:SAC执业编号:S09

邮箱:chenzhijing@gjzq.com.cn

刘琳琳:SAC执业编号:S02

邮箱:baoshuxian@gjzq.com.cn

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/242141.html