OpenClaw 提供了极简的 AI 助手交互能力,核心通过 “消息指令” 即可驱动 AI 完成各类操作,而实现这一切的前提,是完成模型接入与通讯渠道的基础配置。本文将完整拆解 OpenClaw 的两种配置模式、自定义大模型接入全流程,以及通讯软件的对接方法,帮助开发者快速完成 OpenClaw 的端到端部署与通讯配置。

OpenClaw 原生支持 onboard 和 dashboard 两种配置方式,分别适配快速上手与深度自定义两种场景,开发者可根据自身需求选择。

1.1 Onboard 快速配置模式

命令会直接打开 CLI 命令行配置界面,核心适配已提前准备好模型 API 密钥的用户,实现开箱即用的快速配置。

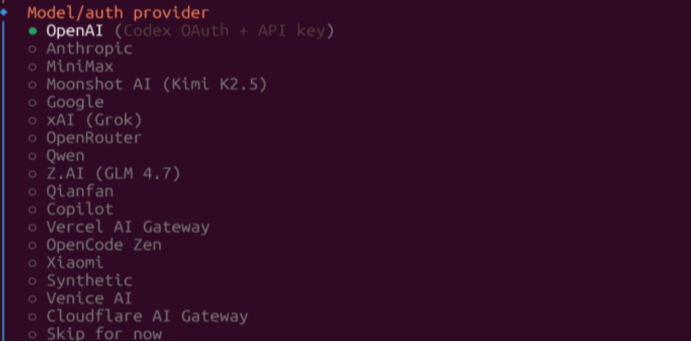

该模式内置了海内外主流大模型平台的适配选项,无需手动修改底层参数,只需按照命令行提示,选择对应的模型提供方、填入 API 密钥,即可完成基础配置。目前已原生支持的模型平台包括但不限于:

- OpenAI (Codex OAuth+API key)、Anthropic、MiniMax、Moonshot AI (Kimi K2.5)

- Google、xAI(Grok)、OpenRouter、Qwen、Z.AI(GLM 4.7)

- Qianfan、Copilot、Vercel AI Gateway、OpenCode Zen 等

1.2 Dashboard 可视化配置面板

对于需要修改底层配置、自定义模型接入,或是习惯可视化操作的用户,可通过 命令打开基于浏览器的可视化控制台(Control UI),完成全维度配置。

1.2.1 Dashboard 启动与访问

执行启动命令后,终端会返回对应的访问地址与配置信息,示例如下:

1.2.2 Dashboard 核心能力与安全说明

Dashboard 是面向管理员与使用者的本地 / 私有运维台,核心能力包括:查看 OpenClaw 运行状态、全量配置管理、事件与日志观察、模型对话调试、权限审批等。

官方安全重点提示:控制台涉及聊天、配置、执行审批等高权限能力,仅建议在本机或可信网络中访问,严禁作为公网开放服务暴露到不可信网络环境中,避免出现权限泄露风险。

尽管 Onboard 模式已适配多数主流模型,但对于 DeepSeek 等暂未原生支持的模型,或是通过第三方平台转发调用 GPT/Claude 等需要修改 base_url 的场景,就需要通过 Dashboard 完成自定义模型接入,以下是完整操作步骤。

2.1 前置准备

- 已成功启动 OpenClaw Dashboard 并可正常访问配置界面

- 已获取目标模型平台的 API 密钥、接口 Base Url、模型 ID(model_name)

- 确保部署 OpenClaw 的服务器可正常访问目标模型的接口地址

2.2 步骤 1:进入模型配置主界面

在 Dashboard 左侧导航栏,依次进入 -> 界面,该界面为全量模型服务商与模型实例的配置入口,支持自定义添加模型服务商与对应模型。

2.3 步骤 2:添加自定义模型服务商配置

在 Models 界面的 板块,点击 新增服务商配置,核心配置项填写规则如下:

填写完成后,先点击 保存配置,再点击 使配置生效。

2.4 步骤 3:添加具体模型实例

完成服务商配置后,在同界面的 板块,点击 新增具体的模型实例,核心配置项如下:

- Id:填写目标模型在对应平台的完整模型 ID(部分平台称为 model_name、checkpoint),示例:

- Name:自定义模型名称(可使用缩写,后续可作为别名使用),示例:

- 补充配置:可根据模型特性填写 Context Window(上下文窗口)、Max Tokens(最大生成长度)、推理相关参数等,非必填项可保持默认。

同样完成后执行 + 操作,使模型实例配置生效。

2.5 步骤 4:Agent 端模型绑定与默认配置

模型配置完成后,需要在 Agent 中绑定对应模型,才能让 OpenClaw 正常调用,操作步骤如下:

- 在 Dashboard 左侧导航栏,依次进入 -> 界面

- 找到 配置项,按 的完整格式填写,示例:,该配置为 OpenClaw 默认调用的主模型

- 在 配置板块,点击 ,新增已配置的完整模型名称,并在 项中填写自定义模型简称,示例:,用于后续快速切换模型

- 完成后执行 + ,使 Agent 模型配置生效。

2.6 补充:模型快速切换方法

完成上述配置后,可通过两种方式快速切换 OpenClaw 使用的模型:

- 指令切换:在对话框中直接输入以下命令,即可即时切换

GPT plus 代充 只需 145

- 自然语言切换:直接通过自然语言指令,让 OpenClaw 自动完成模型切换,无需手动输入命令。

Channels 是 OpenClaw 的对外通信层,核心负责将 AI 助手接入用户已有的沟通渠道,完成消息的收发与指令交互,是实现 “给 OpenClaw 发消息” 的核心模块。

3.1 已支持的通讯平台

从生态覆盖来看,OpenClaw 已完成全球主流通讯平台的适配,包括:

- 国际主流平台:WhatsApp、Discord、iMessage、Microsoft Teams

- 扩展渠道:Matrix、Zalo、WebChat 等

- 国内常用平台:目前仅原生支持飞书、钉钉两大办公通讯软件,可直接将 OpenClaw 接入到对应应用中,实现企业内的 AI 助手交互。

3.2 配置入口

Channels 的完整配置同样在 Dashboard 中完成,进入 -> 界面,即可选择对应通讯平台,按照平台的官方接入文档,完成应用创建、密钥配置、webhook 地址对接等操作,即可实现 OpenClaw 与通讯软件的打通,后续直接在通讯软件中发送消息,即可驱动 OpenClaw 执行对应指令。

- Dashboard 控制台具备高权限操作能力,严禁对公网开放,仅可在本机或可信内网环境访问,避免配置与执行权限泄露;

- 模型 API 密钥仅保存在 OpenClaw 本地配置中,请勿将密钥上传至公网代码仓库、或泄露给不可信第三方;

- 自定义模型接入时,需确保 Base Url 地址可正常访问,接口兼容模式与目标平台一致,否则会出现模型调用失败的问题;

- 通讯渠道对接完成后,需做好消息权限管控,避免无关人员向 OpenClaw 发送高风险执行指令。

本文完整讲解了 OpenClaw 的两种配置模式、自定义大模型的全流程接入方法,以及通讯渠道 Channels 的对接逻辑。通过 Onboard 模式可实现主流模型的分钟级快速配置,而通过 Dashboard 可视化面板,则可完成任意兼容 OpenAI 接口规范的大模型接入,同时打通主流通讯软件,实现 “发消息指令驱动 AI” 的核心能力。

- OpenClaw 官方远程网关文档:https://docs.openclaw.ai/gateway/remote

- OpenClaw 控制台 UI 官方文档:https://docs.openclaw.ai/web/control-ui

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/236410.html