在AI Agent开发领域,OpenClaw以其强大的自动化能力迅速成为焦点。然而,高昂的API调用成本常常成为开发者探索其潜力的最大障碍。本文将为你揭示一套完整的后端架构方案,通过巧妙地整合NVIDIA的免费NIM API与本地网关中间件,实现OpenClaw的零成本、高性能调用,彻底释放你的AI生产力。

最近,AI和技术圈内最热门的话题莫过于

OpenClaw

。这款工具能够将AI从简单的聊天机器人,进化为能够自动调研、撰写报告、执行脚本和管理项目的“数字员工”。然而,强大的功能背后隐藏着一个严峻的现实:

Token 消耗速度,堪比烧显卡。

。以一个典型任务为例:

“帮我调研一下 Docker 的竞品生态”

。在OpenClaw中执行这个任务,会触发一个复杂的后端处理流程:主Agent进行任务分解与规划,子Agent执行网页抓取与资料收集,随后进行多轮总结与交叉验证,最后自检、重写并输出报告。这一系列操作背后消耗的计算资源是惊人的:

开发者的真实体验往往是:初次使用时惊叹于其智能,随后为快速消耗的Token余额感到焦虑。使用OpenAI官方API不仅费用高昂,还存在严格的风控和封号风险;而部署本地大模型如Ollama,则需要至少70B参数模型和48G以上显存,对大多数开发环境来说门槛过高。因此,

成为了所有OpenClaw用户的核心诉求。OpenClaw 很香,但普通人根本烧不起。

幸运的是,一个被许多开发者忽略的“隐藏福利”能够完美解决这一难题。答案就是:

。英伟达为了推广其AI推理平台,为每个开发者账户提供了免费的API调用额度,最关键的是,这些API完全兼容OpenAI的格式标准。✅ NVIDIA NIM(Inference Microservices)

这意味着什么?简单来说:

。这相当于为OpenClaw安装了一个“官方外挂”,让你能够:

- 免费用上顶级云算力,无需自购昂贵显卡

- 享受企业级的服务稳定性与可靠性

- 避免OpenAI严格风控导致的封号风险

- 自由选择包括GLM-4、Llama 3在内的多种强力模型

组合起来的技术优势显而易见:

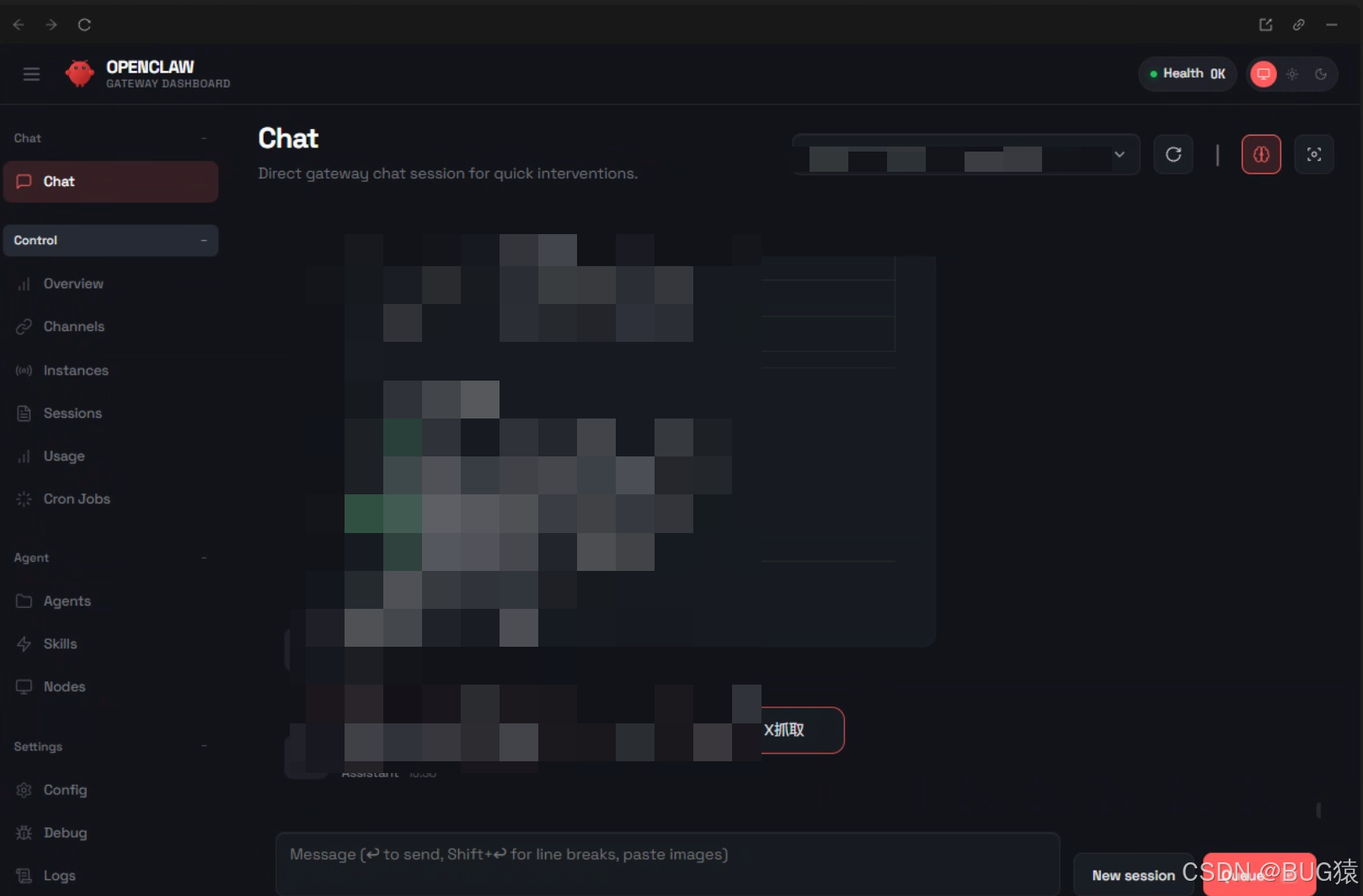

。从此,开发者可以真正实现:Agent任务随意跑,Token成本不再愁。要实现稳定、可管理的免费调用,我们设计了一个三层后端架构,而不是在代码中硬编码API密钥。这个架构的核心思想是:通过本地网关中间件实现模型路由与负载管理。

其中,NVIDIA NGC作为模型源,Cherry Studio扮演关键的本地网关角色,负责协议转换、请求转发和简单的负载均衡。这种设计不仅提高了系统的可维护性,还便于未来扩展多账号轮询等高级功能。[AFFILIATE_SLOT_1]

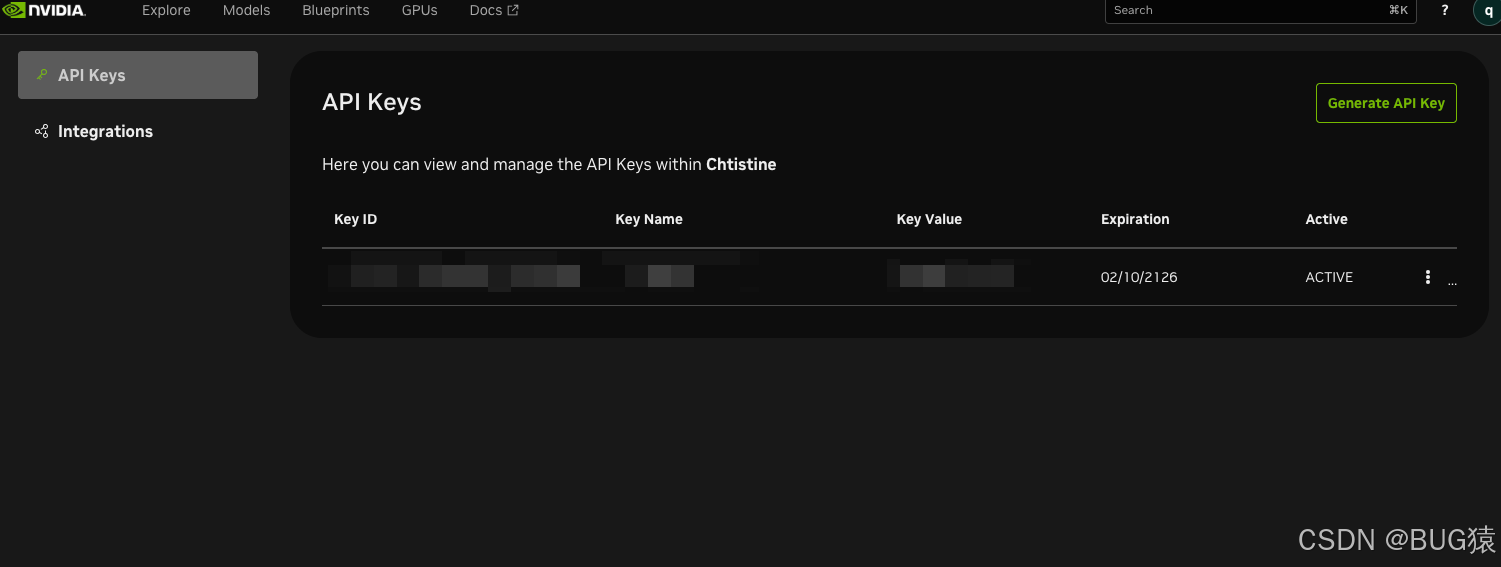

首先,我们需要获取最关键的凭证——NVIDIA API Key。以下是详细步骤:

步骤1:注册NVIDIA Cloud账户

访问官网:

- 点击右上角“Login”,使用邮箱注册

- 创建账户时点击

✅ Create Account - 完成邮箱验证(6位验证码)

- 设置你的NVIDIA Cloud账户名

关键步骤:手机号验证

注册完成后,务必点击右上角的

完成手机验证。目前支持国内手机号,且无需绑定信用卡,审核相对宽松。⚠️ Verify

步骤2:生成API Key

- 点击头像 → 选择

API Keys - 点击

➕ Generate API Key - 配置参数建议:

- 名称:如

- 过期时间:设置为

以避免频繁更新

✅ 100 年(等于永久) - 名称:如

- 点击

生成密钥生成的密钥格式类似:

⚠️ 重要提醒:此密钥仅显示一次,请立即妥善保存至密码管理器或本地加密文件。为什么需要Cherry Studio?因为OpenClaw默认配置可能只支持标准OpenAI端点。Cherry Studio作为API网关中间件,能够将任何兼容的API转换为OpenAI格式,简化后端集成。

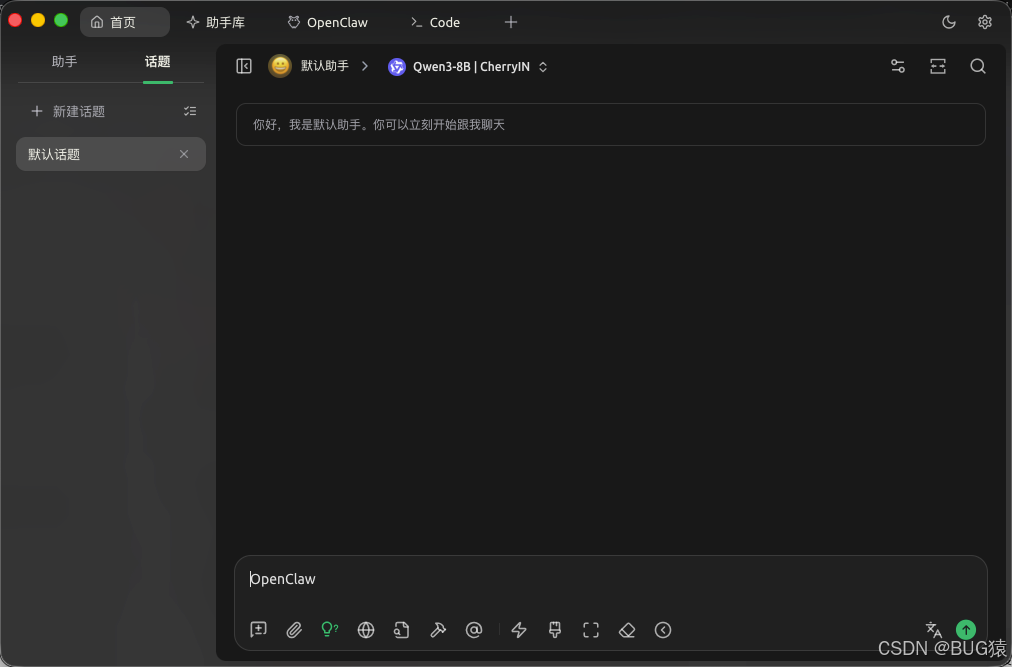

- 下载安装:从Cherry Studio官网或GitHub下载对应系统的客户端。

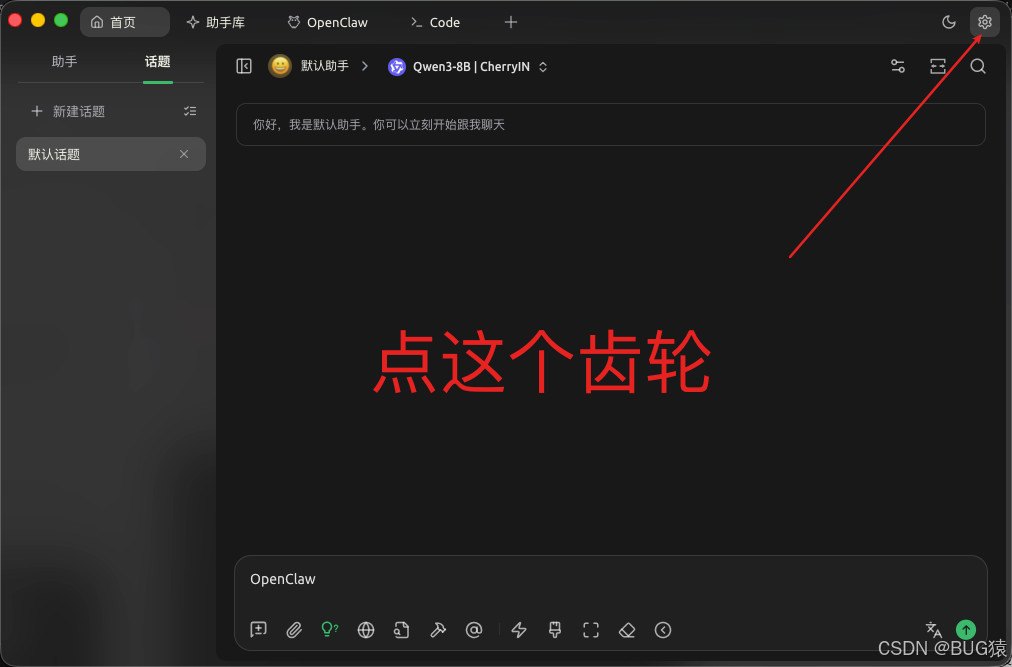

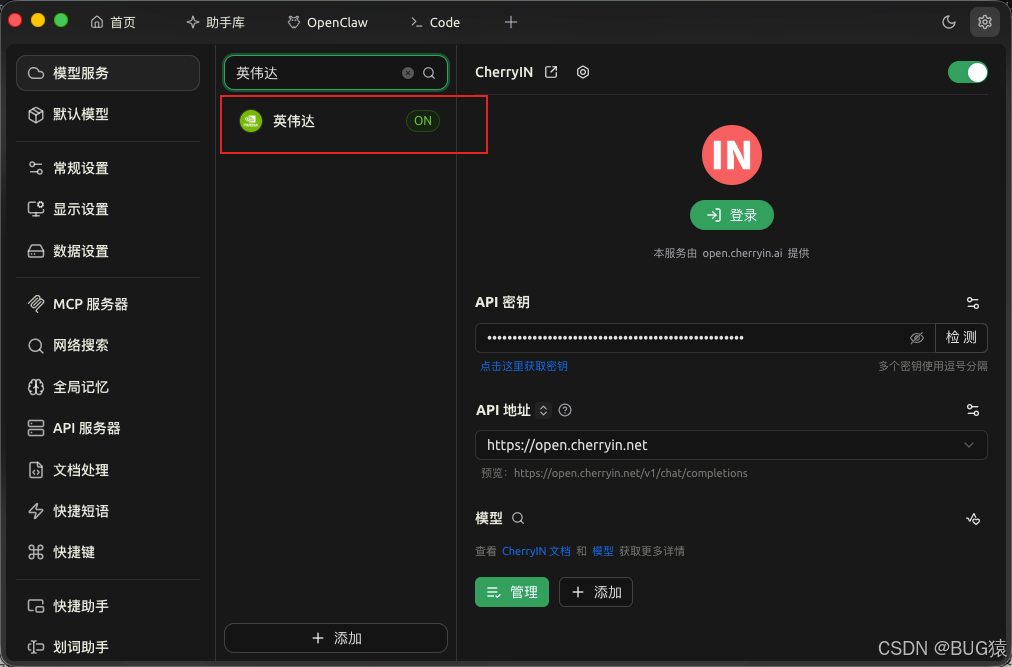

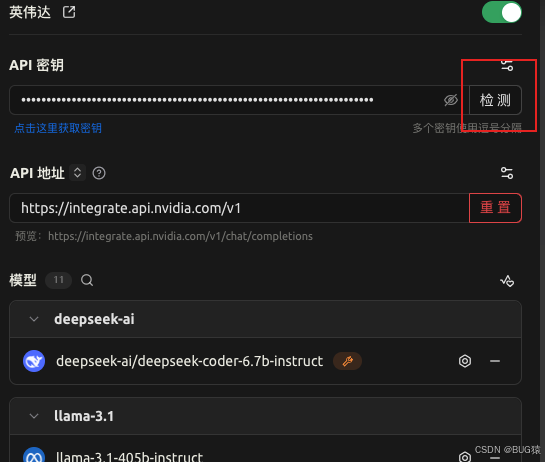

- 添加模型服务:

打开设置 → 模型服务。

点击“+”添加,配置如下:

- 供应商类型:搜索“英伟达”

- 名称:

- API域名:(NVIDIA标准端点)

- API密钥:粘贴你的

点击“检查链接”确认连接成功。

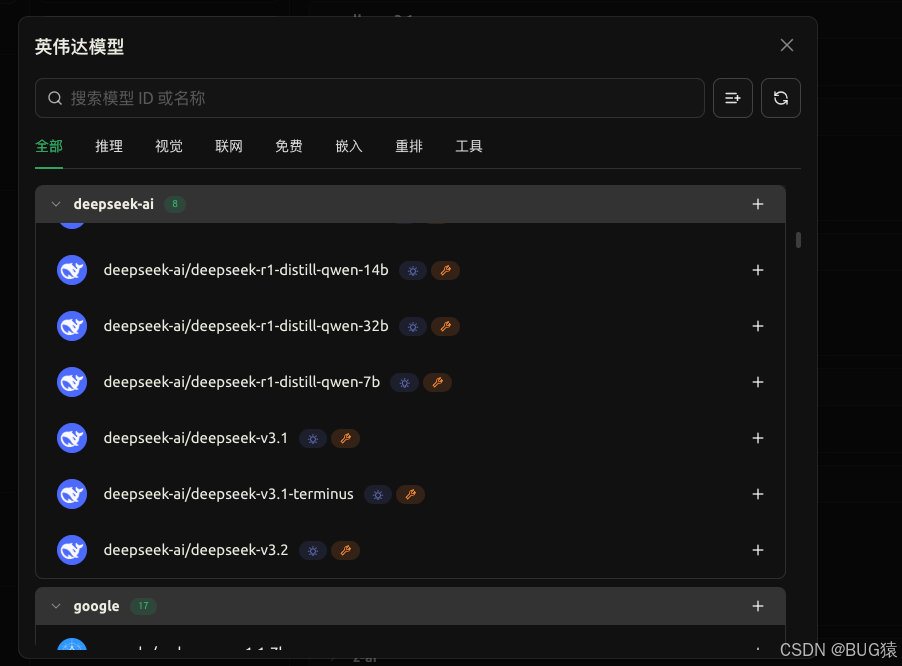

- 添加模型ID:在模型列表中添加:

- 启动本地服务:在设置中确保本地服务器模式已开启,默认端口为或。此时你的本地地址就成为了一个完全兼容OpenAI格式的代理网关。

- 供应商类型:搜索“英伟达”

现在,我们将OpenClaw接入这个“免费燃料”系统。

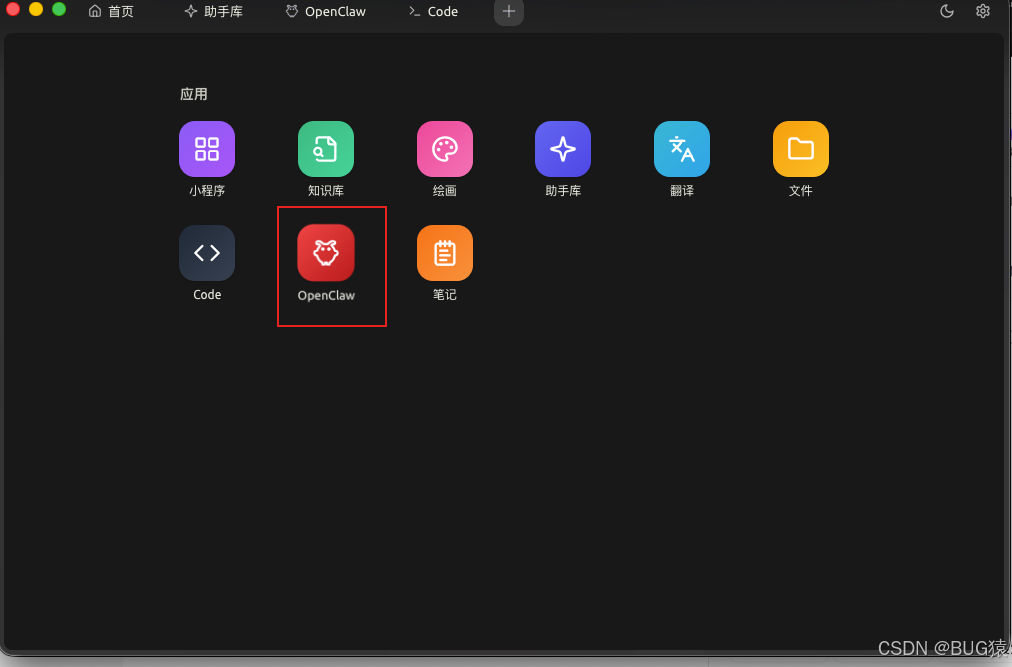

- 在Cherry Studio首页点击加号:

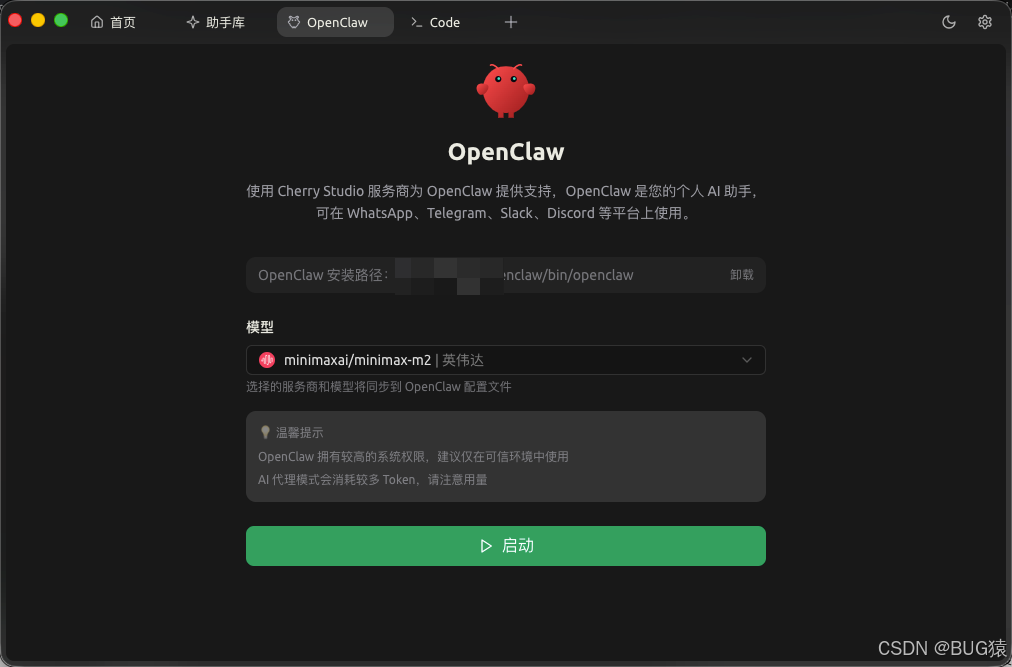

- 安装OpenClaw:

选择之前添加的NVIDIA模型,推荐使用GLM-4-9B(最新开源模型,效果优秀)。如追求速度,可选择更小的模型。 - 启动OpenClaw:点击启动后,将打开OpenClaw的聊天界面。

提示:如需更换模型,在管理页面关闭后重新选择启动即可。

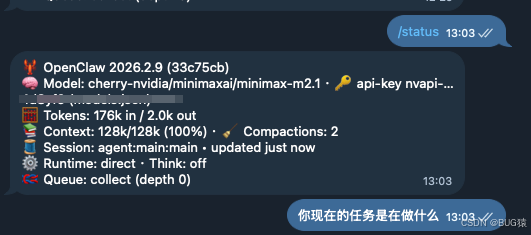

验证配置:

使用/status命令检查,输出如 所示即表示配置成功。现在,你拥有了一个7×24小时在线的AI助手,能够:

所示即表示配置成功。现在,你拥有了一个7×24小时在线的AI助手,能够:自动管理邮箱、日程、提醒事项 例如:每天整理收件箱、提醒重要事件、生成摘要。

自动化浏览器任务 / 网页监控 让 OpenClaw 监控网页变化(新闻、价格、公告等),一有更新就抓取并提醒你。

跨平台个人助理 连接 Telegram / Slack / WhatsApp,对话即可让它处理任务、发送消息、调用外部API。

多渠道工作流整合 输入一句话,它可以协调多个服务(邮件→日程→任务列表→提醒)。

在实际部署中,可能会遇到以下常见问题:

- 401 Unauthorized错误:通常是因为模型名称格式错误。NVIDIA的模型名必须包含组织前缀,正确格式是,而不是。

- 上下文长度限制:NIM提供的模型通常支持8K或128K上下文。如果OpenClaw报“Context Limit Exceeded”,请在配置中限制或为4096,防止溢出。

- 连接稳定性:虽然NVIDIA服务稳定性较高,但仍建议在Cherry Studio中配置重试机制,并监控API调用成功率。

对于需要更高可用性的生产环境,可以考虑部署多个NVIDIA账户并通过Cherry Studio实现简单的负载均衡。[AFFILIATE_SLOT_2]

通过 NVIDIA NIM(基础设施) + Cherry Studio(网关中间件) + OpenClaw(应用层) 这套组合拳,我们成功构建了一条零成本的AI Agent开发流水线。这不仅仅是节省费用,更是对云计算资源的合理化利用。

从后端架构的角度看,这种模式展示了现代微服务架构的灵活性:通过抽象和封装,将不同的服务提供商无缝集成到统一的应用生态中。随着AI即服务(AIaaS)模式的普及,掌握这种API集成与中间件部署能力,将成为后端开发者的重要竞争力。

现在,是时候释放OpenClaw的全部潜力,让你的AI项目在零成本的前提下全速前进了。

✅ Generate Key - 下载安装:从Cherry Studio官网或GitHub下载对应系统的客户端。

所示即表示配置成功。现在,你拥有了一个7×24小时在线的AI助手,能够:

所示即表示配置成功。现在,你拥有了一个7×24小时在线的AI助手,能够:

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/232778.html