AI 编程工具正从被动的代码“补全器”进化为主动的“开发伙伴”。它们能够理解复杂需求、规划任务并直接参与整个开发流程。本文将深度解析一款代表该趋势的命令行AI编程工具——我们称之为 ,并提供一份详尽的完整使用指南。

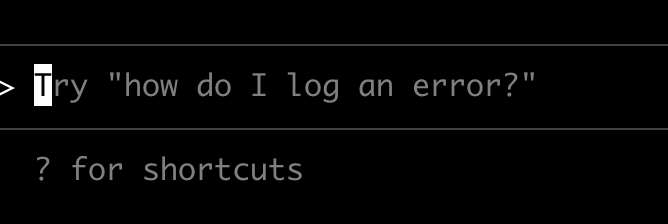

与我们熟知的IDE插件不同, 这类工具选择了一个更贴近开发者核心工作流的界面——命令行(CLI)。

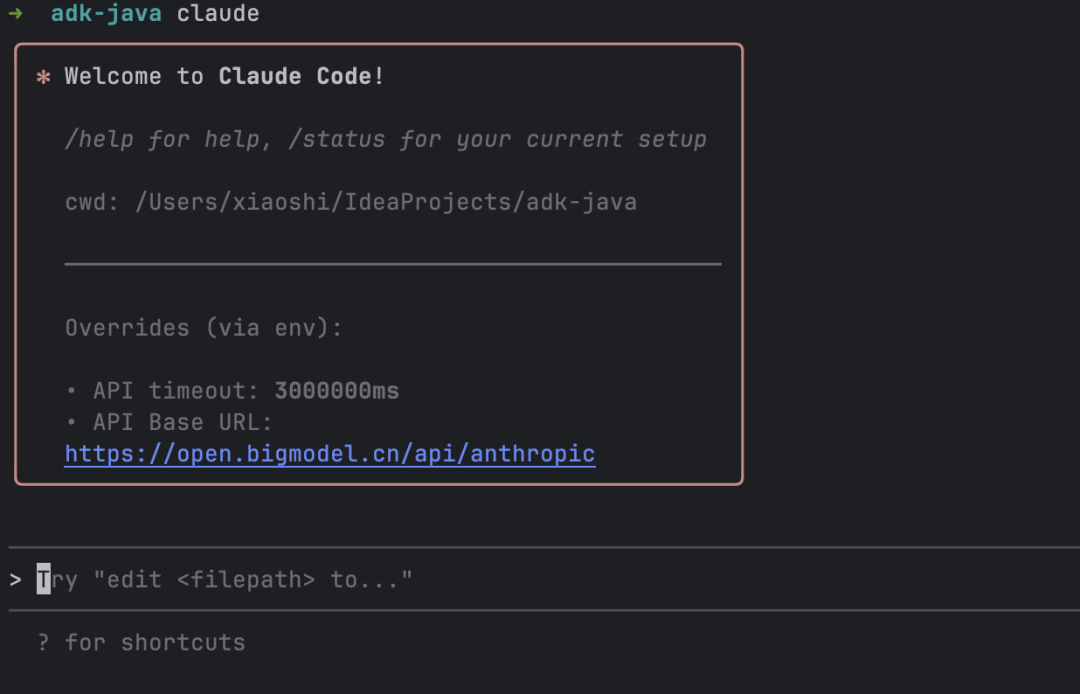

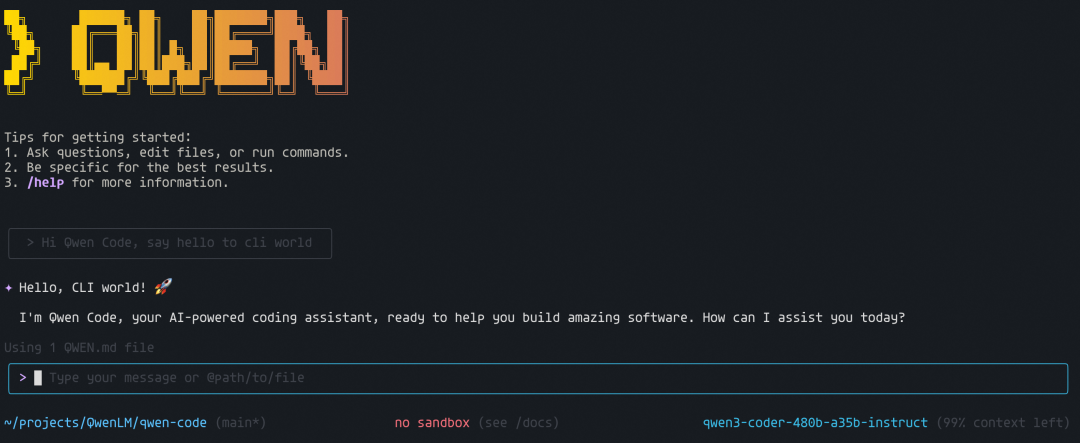

命令行界面简洁而高效

这种设计并非偶然。对于开发者而言,命令行轻量、可脚本化,能与 Git 等工具无缝集成。将AI能力注入这个核心地带,使其成为工作流的一部分,而非孤立的功能。同类型的工具还包括阿里的 和谷歌的 。

同类CLI AI编程工具界面

强大的模型与API生态

的能力源于背后顶尖的大语言模型,例如由 Anthropic 公司开发的 、 等。Anthropic 由前 OpenAI 核心成员 Dario Amodei 创立,其模型在编程和推理方面常年处于行业领先地位。

虽然 默认使用 Anthropic 官方模型,但其高昂的费用限制了个人开发者的使用。幸运的是,通过配置,我们可以将其接入更具性价比的国产模型,如智谱的 或月之暗面的 。

一个关键的技术细节是API格式。多数大模型兼容 OpenAI 的调用格式,而 Anthropic 有自己的一套规范。 使用的是 Anthropic 格式,因此原生支持那些同样支持此格式的模型服务商。对于仅支持 OpenAI 格式的模型,则需要通过转换工具来桥接。

此外, 本身是一个经过精心设计的智能体,其内置的系统提示(System Prompt)是针对 Anthropic 自家模型特点深度优化的。当替换为第三方模型时,可能会存在约 至 的效果损失。不过,对于绝大多数开发场景,只要需求描述清晰,这种影响在可接受范围内。

从“助手”到“伙伴”

传统AI编程插件,如早期的通义灵码,受限于模型能力和上下文长度,主要充当“剪贴板”和单次对话工具。 这类新一代工具则能够理解整个项目文件夹,具备复杂任务的自主规划和多任务处理能力。

它不再仅仅生成代码片段,而是能够直接编辑文件、运行测试、执行构建命令,甚至处理Git提交。开发者的角色从任务的“执行者”转变为复杂工程的“委托者”,进入一种所谓的 (氛围编程)状态——定义需求、设计架构,然后监督AI完成具体的编码工作。

本教程以 macOS 系统为例,Windows 系统的操作步骤类似。

确保系统中已安装 Node.js (版本 >= 18),然后执行以下命令进行全局安装:

安装完成后,在任何项目目录下执行 命令即可启动。

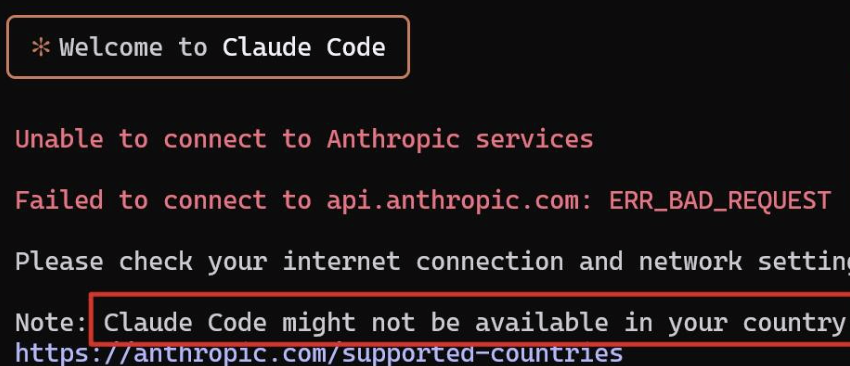

首次运行若遇到地区不可用的提示,可通过配置环境变量,将请求代理到国内兼容 Anthropic API 格式的模型服务商。

初次运行时可能遇到的地区限制问题

打开终端的配置文件(macOS默认为 ),添加以下两行:

在文件中添加以下内容:

保存退出后,务必执行 命令使配置立即生效。

配置示例1:智谱 GLM-4.5 模型

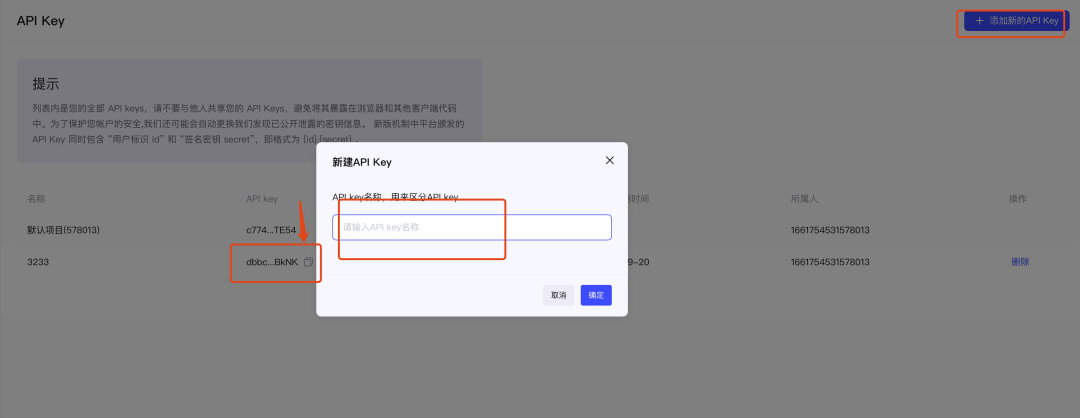

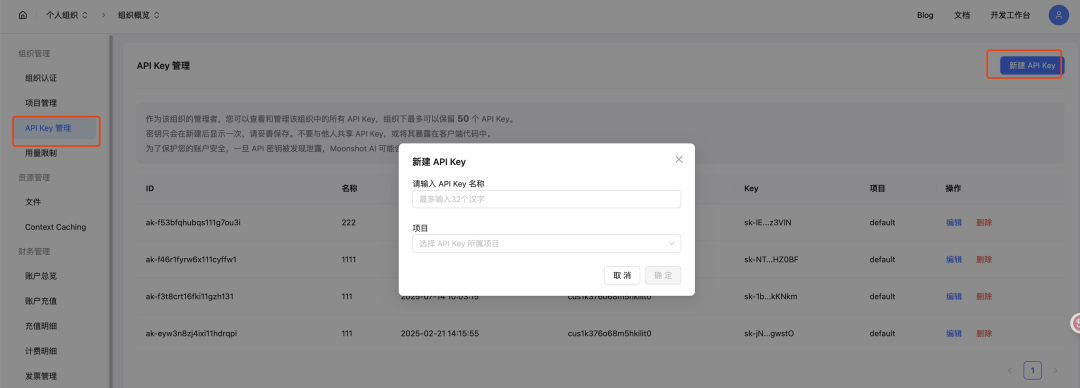

- 注册与获取API Key:访问智谱AI开放平台注册,并在API密钥管理页面创建新的Key。

- 选购套餐 (可选):智谱为开发者提供了高性价比的编程套餐,首月约20元,调用次数充足。

- 配置环境变量:智谱的 Anthropic 兼容地址为 。

- 生效配置并重启:执行 后,重新运行 命令。

配置示例2:月之暗面 Kimi K2 模型

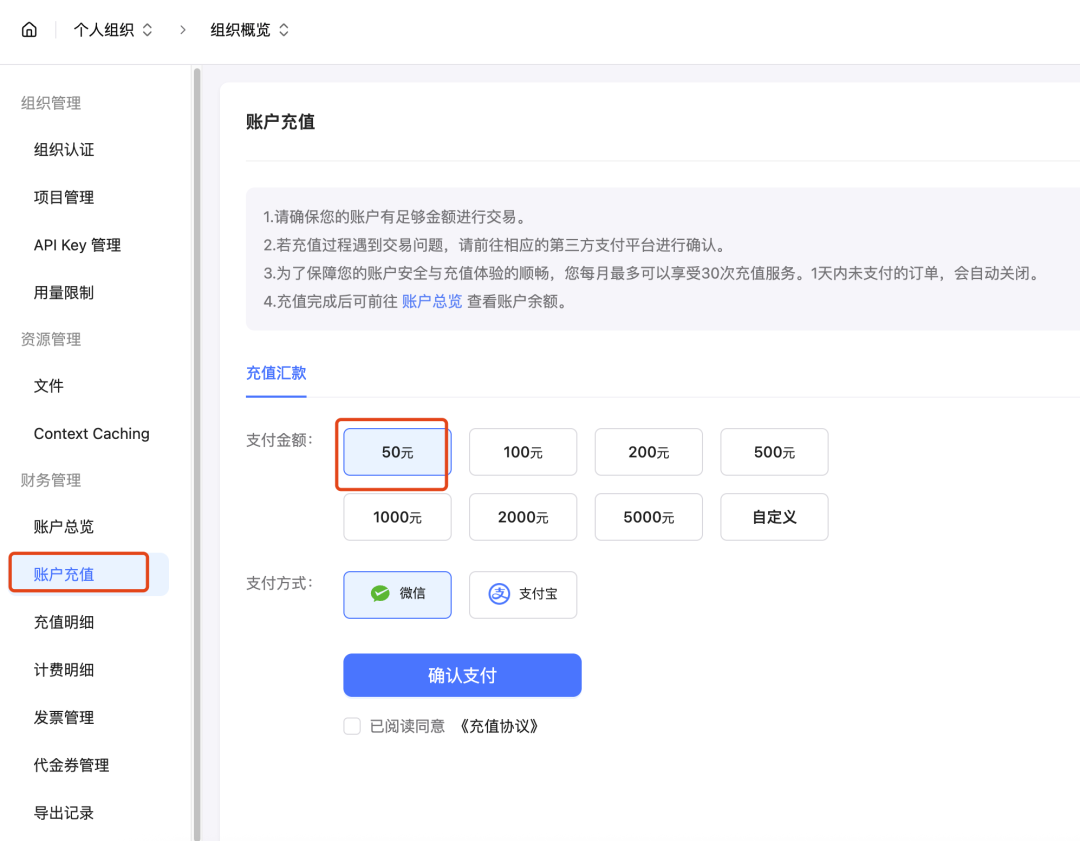

- 注册与充值:访问月之暗面开发者平台注册。为保证调用速率,建议充值50元以上。

- 获取API Key:在后台管理系统中创建新的API Key。

- 配置环境变量:Kimi 的 Anthropic 兼容地址为 。

- 生效配置并重启:执行 后,重新运行 命令。

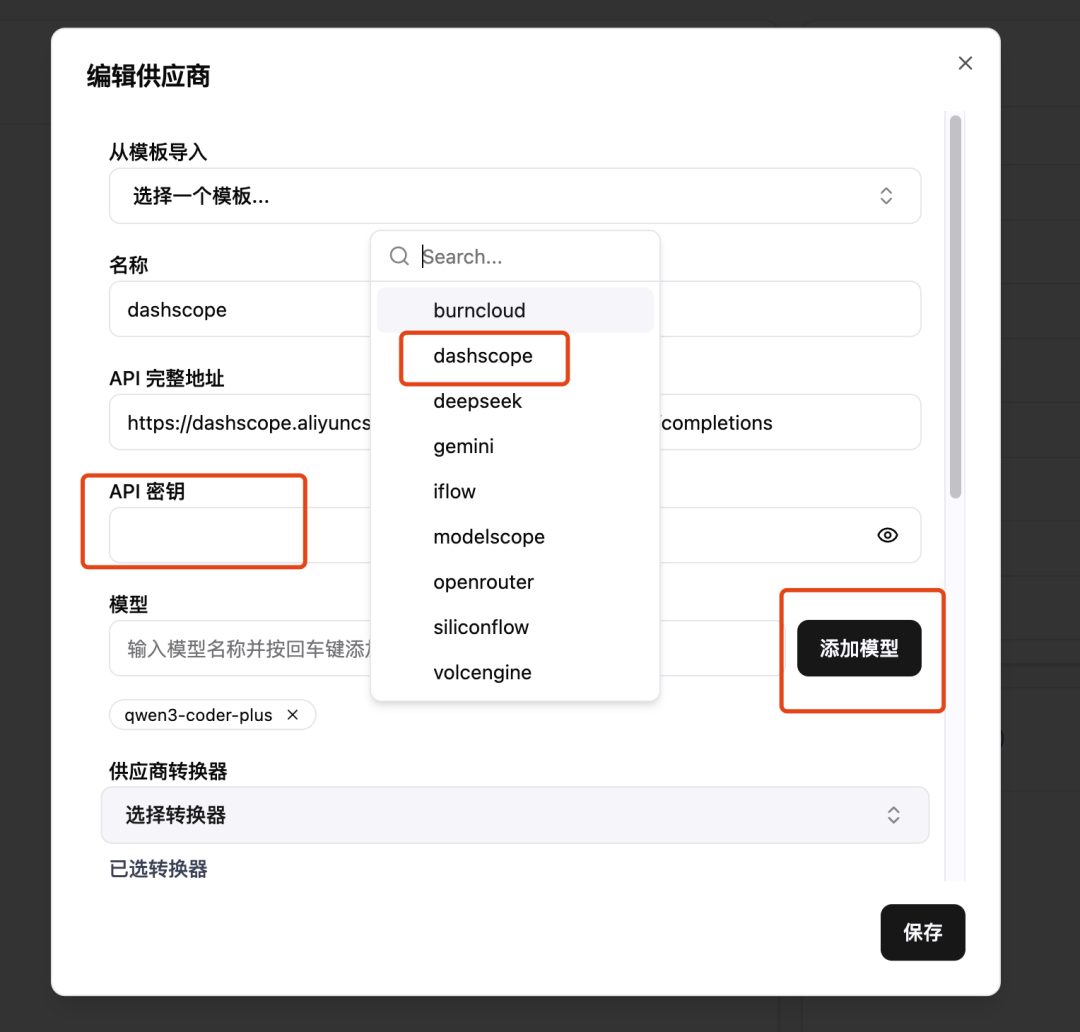

若需使用仅支持 OpenAI 格式的模型(如通义千问),可使用 中间件进行转换。

- 安装Router: 其主要功能包括模型路由、多提供商支持、请求/响应转换等。

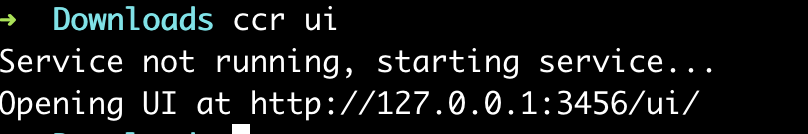

- 启动配置界面: 在打开的网页中,添加模型供应商,选择模板后填入API Key和模型名称。

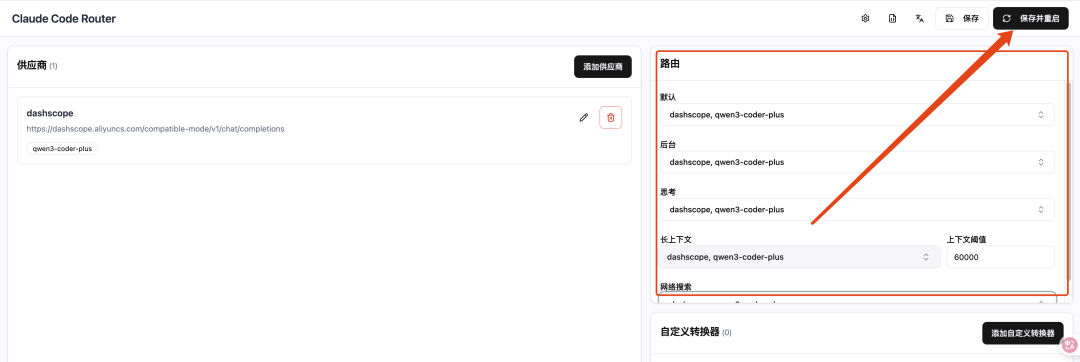

- 配置路由:

在右侧路由部分,将不同任务(如思考、长上下文)指向你刚添加的模型,然后保存并重启。

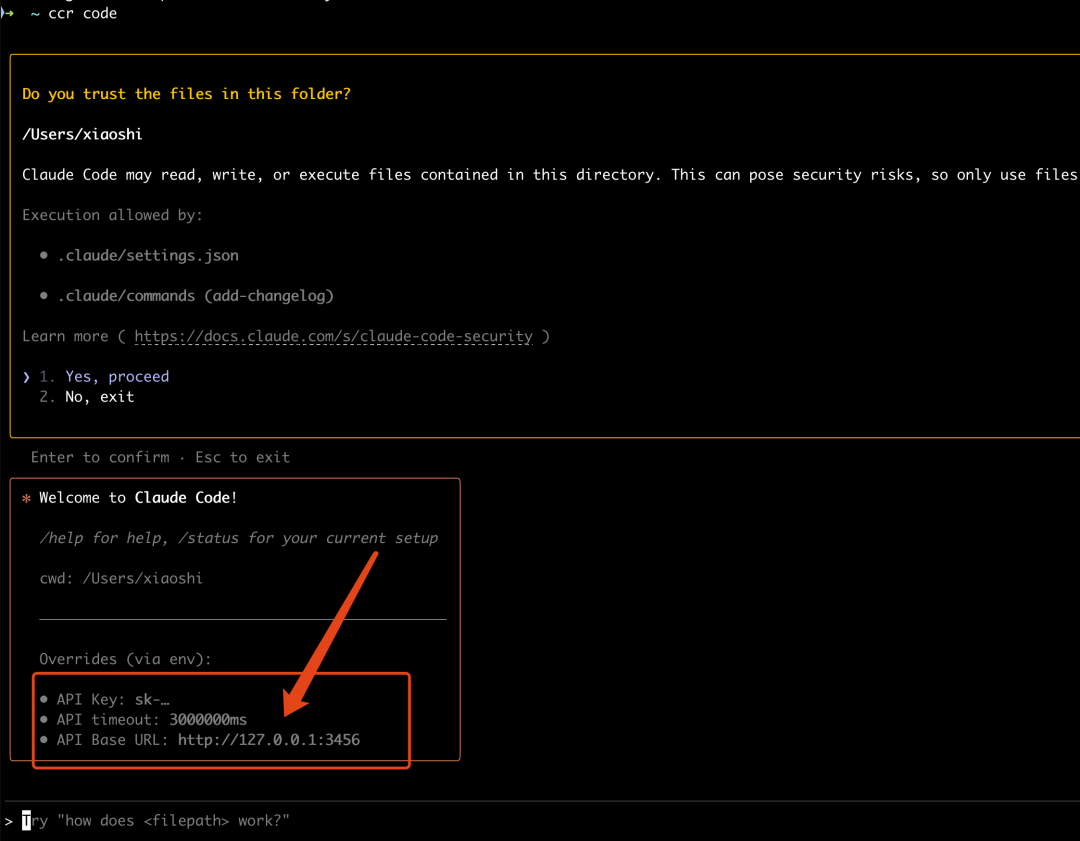

- 启动 :

使用 命令启动,即可通过该路由使用配置好的模型。

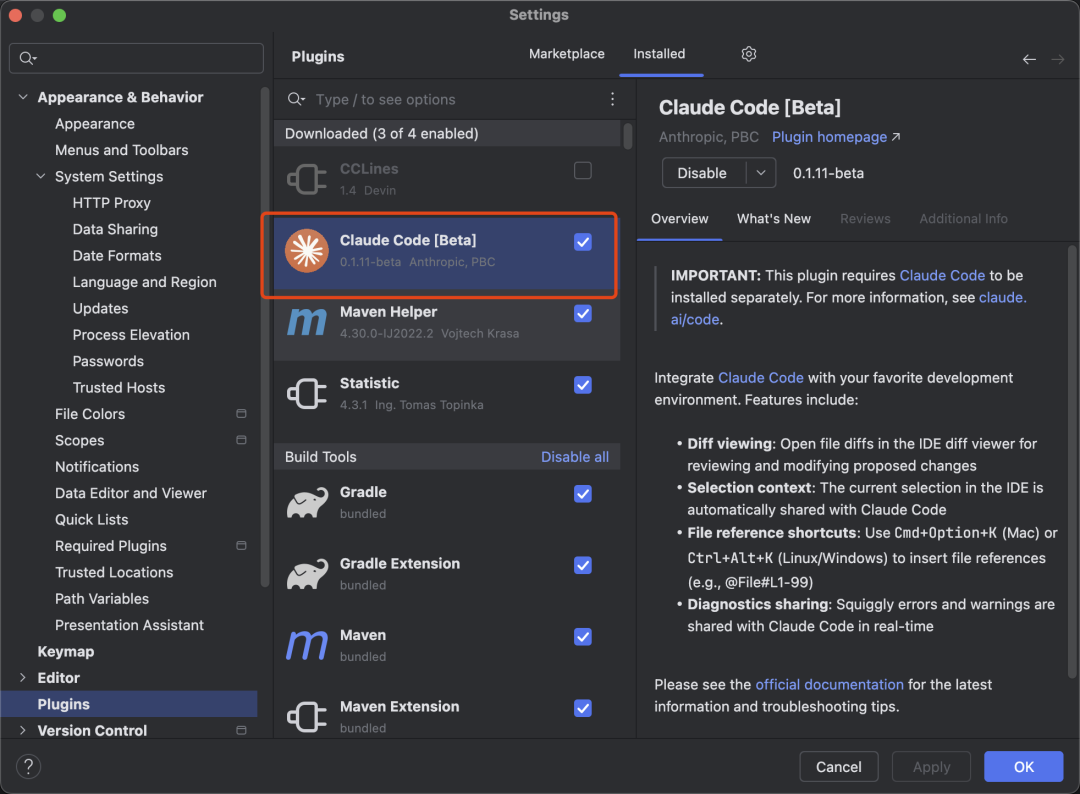

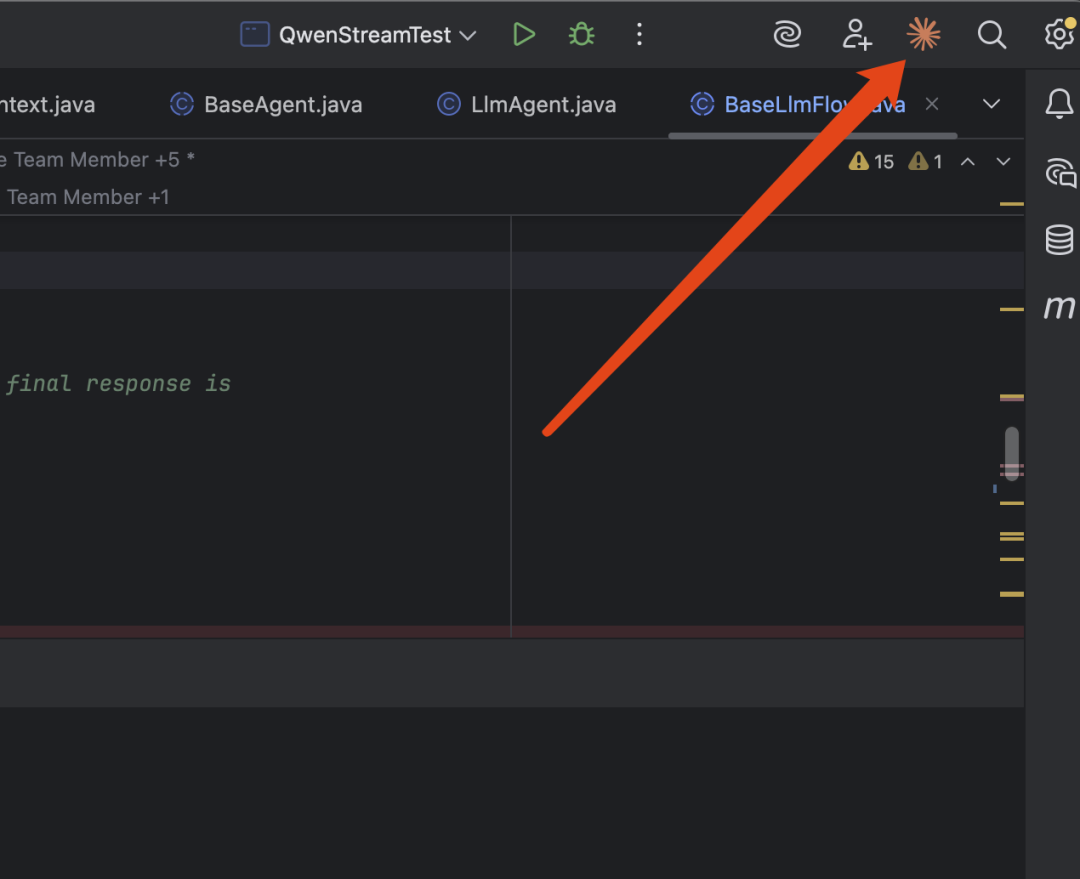

提供了 VS Code 和 JetBrains 系列 IDE (IntelliJ IDEA, WebStorm 等) 的增强插件,可在IDE内一键启动,实现更流畅的交互。

在IDE中安装插件

一键启动,无缝集成

- 符号: 引用文件或目录以添加至上下文。

- 符号: 定义记忆或规则,AI会在后续交互中遵守。

- 符号: 临时切换到bash模式执行Shell命令。

- 键: 中断当前正在执行的任务。

- 多行输入: 使用 或 (macOS) 输入多行文本。可运行 安装 快捷键。

输入 可唤出指令菜单,以下是完整指令列表:

- /init: 扫描项目生成 ,包含技术栈、架构等摘要,帮助AI快速理解项目。

- /compact: 对长对话历史进行摘要,保留关键信息,节约Token并保持AI专注。

- /clear: 彻底清空当前对话,开启新会话。

- /resume: 恢复近期的对话历史,继续之前的任务。

- /memory: 编辑一系列Markdown文件以定义AI的长期行为偏好(如编码风格、个性)。这些文件位于 目录下,分为全局和项目级。例如, 文件中可以包含如下的编程原则:

自定义指令

将常用复杂任务封装成自定义命令。只需编写一个包含提示的 Markdown 文件(文件名即指令名,如 ),放入 目录,重启后即可通过 调用。社区网站 提供了大量预设指令可供下载。

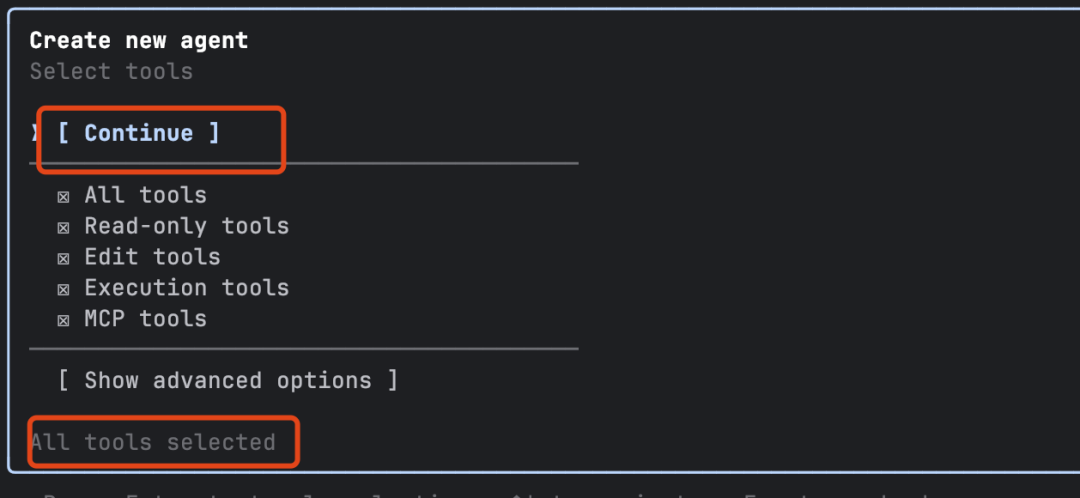

子代理(Subagents)系统

创建多个专职的“子智能体”(如前端专家、UX设计师),主智能体可根据复杂需求自动分解并分配任务,实现多角色并行协作。

通过 命令管理,可选择让AI辅助创建新代理,或从社区导入预设。

AI辅助创建子代理

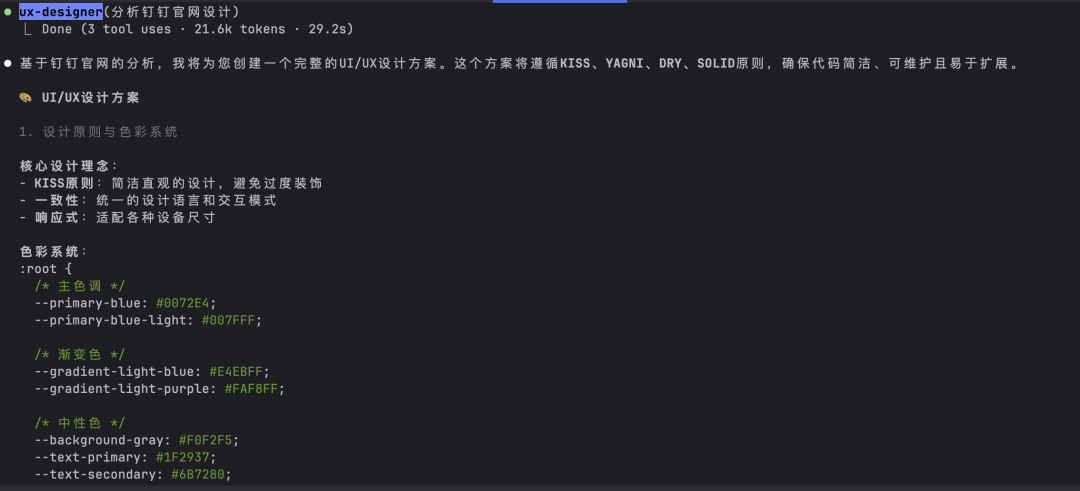

在处理一个包含UI设计的任务时,主智能体会先调用UX设计师,待设计稿确认后,再进行编码。AI在执行任务时会生成一个任务清单(TodoList),并逐项完成,工作流程高度透明。

钩子(Hooks)系统

在特定事件(如文件编辑后)发生时自动触发命令。通过 指令管理,可实现自动格式化、权限控制等自动化流程。

示例:编辑TS文件后自动用Prettier格式化

社区工具 支持用自然语言生成钩子配置。

配置MCP Server

MCP (Machine-to-Claude Protocol) 是一种允许外部工具和服务与 通信的协议,可以扩展其能力,如连接到 Jira、Notion 等。

- 添加本地Stdio MCP Server:

- 添加SSE MCP Server:

- 管理MCP Server:

XML标签结构化提示

使用XML标签包裹指令、上下文和示例,可以帮助Claude更精确地理解你的意图。

三种工作模式切换

使用 循环切换:

- 正常模式: 默认模式,执行文件编辑等操作前需要用户批准。

- 自动接受模式: 所有操作默认批准,AI拥有完全控制权。

- 计划模式: AI只进行规划,生成任务列表,不执行任何实际操作。

- 回退历史: 双击 可回退对话节点。对于代码更改的回退,可使用社区工具 ()。

- 可视化配置工具 opcode: 网站 提供了一个强大的Web界面,用于可视化管理 的所有配置,包括自定义指令、钩子、权限等。

- Claude官方中文指南: 官方文档 提供了最全面、最权威的功能介绍和使用说明。

新一代的AI编程工具正在重塑开发工作流,将开发者从繁琐的编码执行中解放出来,更专注于架构设计和业务创新。掌握它们,就是拥抱未来的开发模式。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/221487.html