Claude 系列模型(尤其是 Sonnet 4.5 和 Opus)常被海外社区誉为“代码理解之王”,其 200K tokens 上下文、多文件推理、智能重构等能力,在演示视频中令人叹为观止。然而,当中国开发者试图将其纳入日常开发流时,却会迅速撞上一堵由技术壁垒、地缘政治和商业策略共同筑成的高墙。这堵墙并非透明可见,而是以“服务不可用”“配额突降”“响应异常”等形式悄然显现,最终将理想工具变为一场充满不确定性的消耗战。

首先,Claude 官方从未在中国大陆提供服务。用户若想使用其 Web 界面或 API,必须依赖代理或 VPN 绕过网络监管。但这只是第一步。即便成功连接,Anthropic 的风控系统会主动检测 IP 地理位置、设备指纹乃至浏览器语言设置。大量用户反馈,即使使用海外 IP,只要系统识别出中文环境或曾关联过中国手机号,账号仍可能被限流、降级,甚至直接封禁。

1.注册环节即设卡:

- 不支持中国大陆手机号接收验证码;

- 部分邮箱域名(如 163、.com)被系统标记为高风险,注册成功率极低;

- 即便使用 Gmail 或 Outlook,若支付方式绑定的是中国发行的信用卡或 PayPal 账户,也可能触发风控,导致 Pro 订阅失败。

如果普通开发者要稳定使用 Claude,不仅需要技术手段“翻墙”,还需准备全套“海外身份”——境外手机号、国际信用卡、英文操作系统环境,成本与复杂度远超预期。

2.运行阶段:

即使成功注册,即使注册成功,也会因为各种原因导致网络延迟,各种限制,不可访问

3.官方平台的使用限制

免费层限制:

- 每日消息次数:约 30-50 条(根据长度和复杂度)

- 无法使用最新模型(Opus、Sonnet 4.5 等)

- 并发限制:单线程处理

- 速率限制:3-5 RPM(每分钟请求数)

付费订阅限制:

- Claude Pro$17/月,Claude MAX:$100/月,但仍有每日上限

- API 独立计费,按 Token 收费

- 高峰期仍会遇到速率限制

- 企业级功能需要单独谈判

4. API 调用的技术限制

速率限制(Rate Limits):

并发限制: 免费用户通常只能单线程调用,付费用户根据付费等级获得不同的并发配额。

你不是在用 AI 编程,而是在和网络防火墙、风控系统、支付网关打一场持久战。

Claude 宣称支持 200K tokens 上下文,但这仅适用于特定条件下的理想环境。对中国用户而言,真实体验截然不同:

1.免费用户被硬性截断:实测显示,免费 tier 在输入超过 64K tokens 后,模型会主动触发“上下文压缩”(context compression),丢弃早期对话内容,导致长项目状态丢失;

2.Pro 用户遭遇“隐形降级”:即便订阅 Pro($20/月),在连续使用 Opus 模型处理 >100K tokens 任务时,系统会在第 3–5 轮对话后强制降级至 Sonnet,且不提供明确提示;

3.计费陷阱:Anthropic 采用“输入+输出+工具调用”复合计费。一次包含 150K 输入、50K 输出、3 次文件读写的操作,实际消耗 token 可能突破 250K,费用是短文本的 10 倍以上,而控制台仅显示“Estimated cost: high”。

更致命的是,长上下文显著放大模型缺陷:

- 在 >100K tokens 场景下,Claude Code 经常“忘记”早期指令,重复生成已删除的代码块;

- 文件路径引用错乱,将 `src/utils.py` 的修改写入 `tests/utils.py`;

- 甚至伪造 Git 提交记录,声称“已提交更改”,实则未写入任何文件。

这些行为在短对话中不易察觉,但在长上下文工程任务中足以导致项目崩溃。

所有请求数据均经 Anthropic 美国服务器处理,默认留存 30 天用于“安全审计”和“模型改进”。尽管企业可签署 DPA 要求关闭训练用途,但:

- 个人与中小企业无此权限;

- 数据存储位置不可选:即使通过 Cloudflare Workers 中转,原始 payload 仍需抵达 Anthropic 后端;

- 不符合中国法规:根据《个人信息保护法》第 38 条及《数据出境安全评估办法》,向境外提供重要数据或个人信息需通过网信办安全评估。而 Claude 既非境内实体,也未通过任何中国认证(如等保三级、ISO 27001 国内备案)。

这就意味着,一旦你的代码库包含用户 ID、内部 API 密钥或业务逻辑,使用 Claude 即构成违规,企业可能面临百万级罚款。

2025 年 8 月,Anthropic 更新《可接受使用政策》(AUP),新增条款: “禁止由中国政府、国有企业或中资控股超 50% 的实体(无论注册地)使用本服务。

该条款无追溯期、无申诉通道。已有新加坡注册、美元结算、团队全在东南亚的中资背景 SaaS 公司被批量封号。更危险的是,Anthropic 已开始扫描 GitHub 仓库,对集成 Claude API 的开源项目发送 DMCA 删除通知,切断社区生态。

很有可能:

- 你今天构建的产品,明天可能因股东结构变化而失效;

- 你依赖的第三方工具(如 Windsurf、Cursor 插件)可能突然断供;

- 技术选型不再只是工程决策,而是政治风险评估。

幻觉终将破灭,自主才是出路

Claude 的困境并非个例,而是当前主流海外大模型对中国用户的系统性疏离。它用顶尖技术制造幻觉,却用访问壁垒、数据风险和政策不确定性将其打碎。对于中国开发者而言,继续押注这类“高危资产”,无异于在别人的地基上盖楼——看似高效,实则脆弱。

真正的出路,或许不在于如何“更好地翻墙使用 Claude”,而在于:我们能否构建一个无需翻墙、数据可控、服务稳定、长期可用的本土化 AI 开发基础设施?

面对 Claude 等海外大模型在中国市场的“高危幻觉”,开发者亟需一个无需翻墙、数据可控、服务稳定、成本透明的替代方案。ArkAPI 正是在这一背景下诞生的企业级 AI 接入平台——它不是简单的 API 转发器,而是一套融合网络优化、智能调度、安全合规与生态聚合的云原生 AI 基础设施。

ArkAPI 采用分层微服务架构,每一层都针对前文所述痛点进行精准打击:

技术特点:

- 部署底座:基于 Kubernetes 容器化,通过 Envoy 服务网格实现流量治理;

- 可观测性:Prometheus + Grafana 全链路监控,P95 延迟、错误率、配额使用一目了然;

- 扩展性:支持动态加载新模型,无需重启服务。

你不再依赖某个单一厂商的“黑盒服务”,而是拥有了一个可审计、可调度、可替换的 AI 调度中枢。

ArkAPI 最大的工程价值在于无缝迁移能力。开发者只需修改两行配置,即可将现有 OpenAI 代码切换至 ArkAPI,并立即获得多模型支持:

统一模型标识体系让跨厂商切换变得像换字符串一样简单:

不再需要为每个模型写一套 SDK,也不再担心 Claude 突然断供——你的代码,从此与厂商解耦。

多维度路由策略:

平台同时聚合多种渠道资源:

- 官方直连:用于高敏感任务(如金融风控);

- Azure 代理:稳定性高,适合主力业务;

- 优质第三方:成本更低,用于非关键路径;

- 国产大模型:中文任务首选,成本仅为海外模型的 30–50%。

渠道成本对比:

针对中国用户访问海外 API 的核心瓶颈,ArkAPI 构建了多级加速体系:

- BGP 多线接入:自动选择电信/联通/移动最优出口;

- 边缘节点:北京、上海、深圳、香港四地部署,就近接入;

- 专线互联:与 AWS、Azure、阿里云建立私有通道,绕过公网拥堵;

- 智能 DNS:根据用户 IP 动态分配最近节点。

性能对比数据(中国大陆环境):

已接入模型清单:

共计支持 20+ 主流厂商,400+ 优质模型,持续更新中。

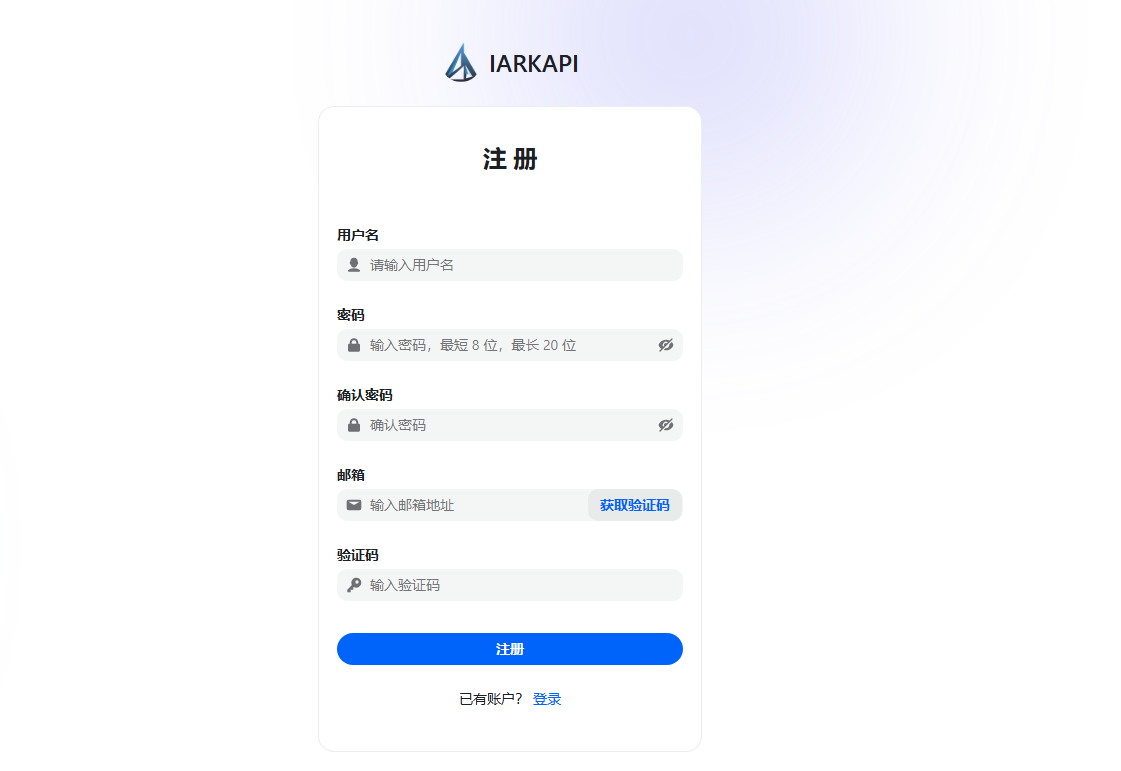

Step 1: 注册与认证(3 分钟)

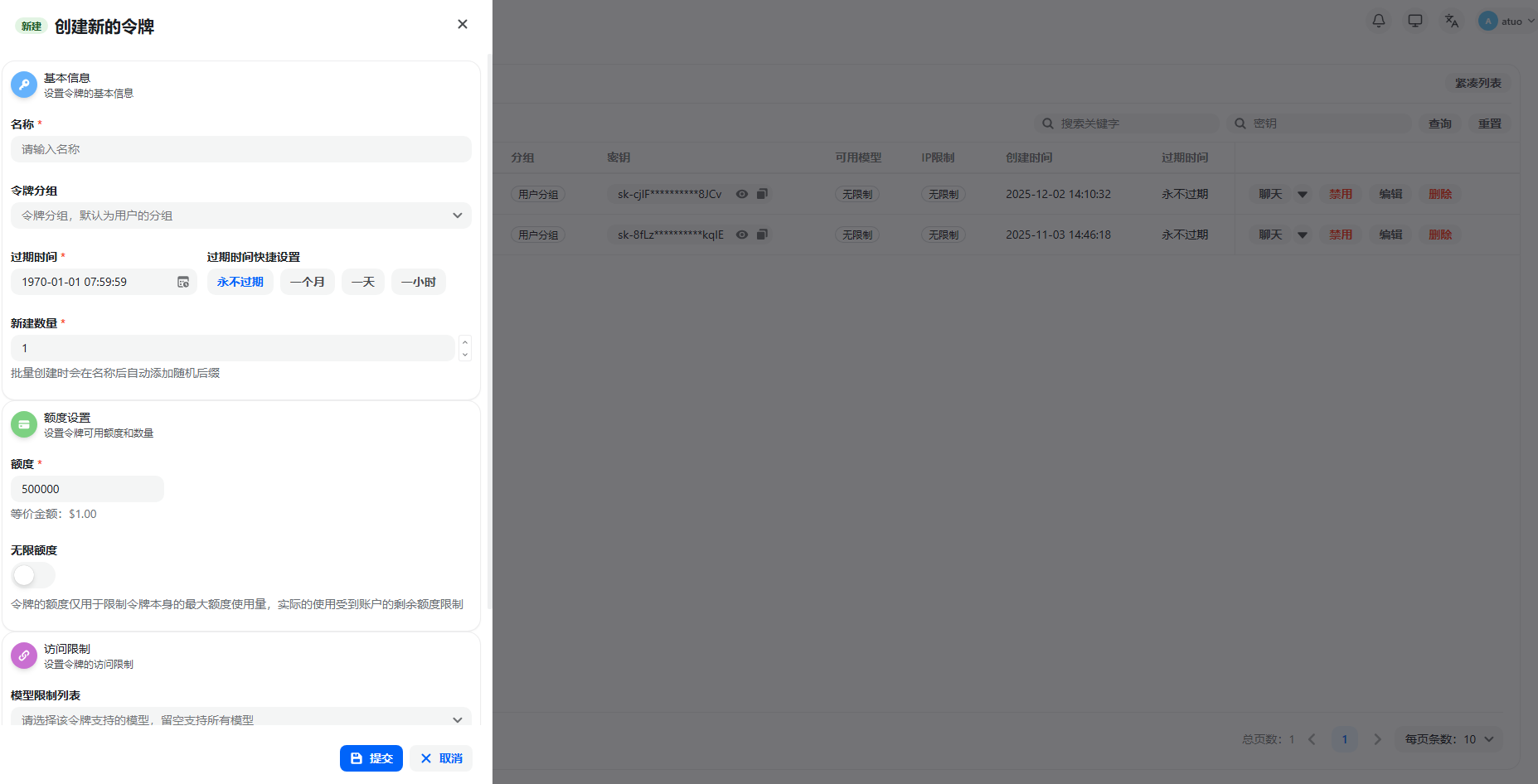

Step 2: 获取 API Key(1 分钟)

Step 3: 聊天测试

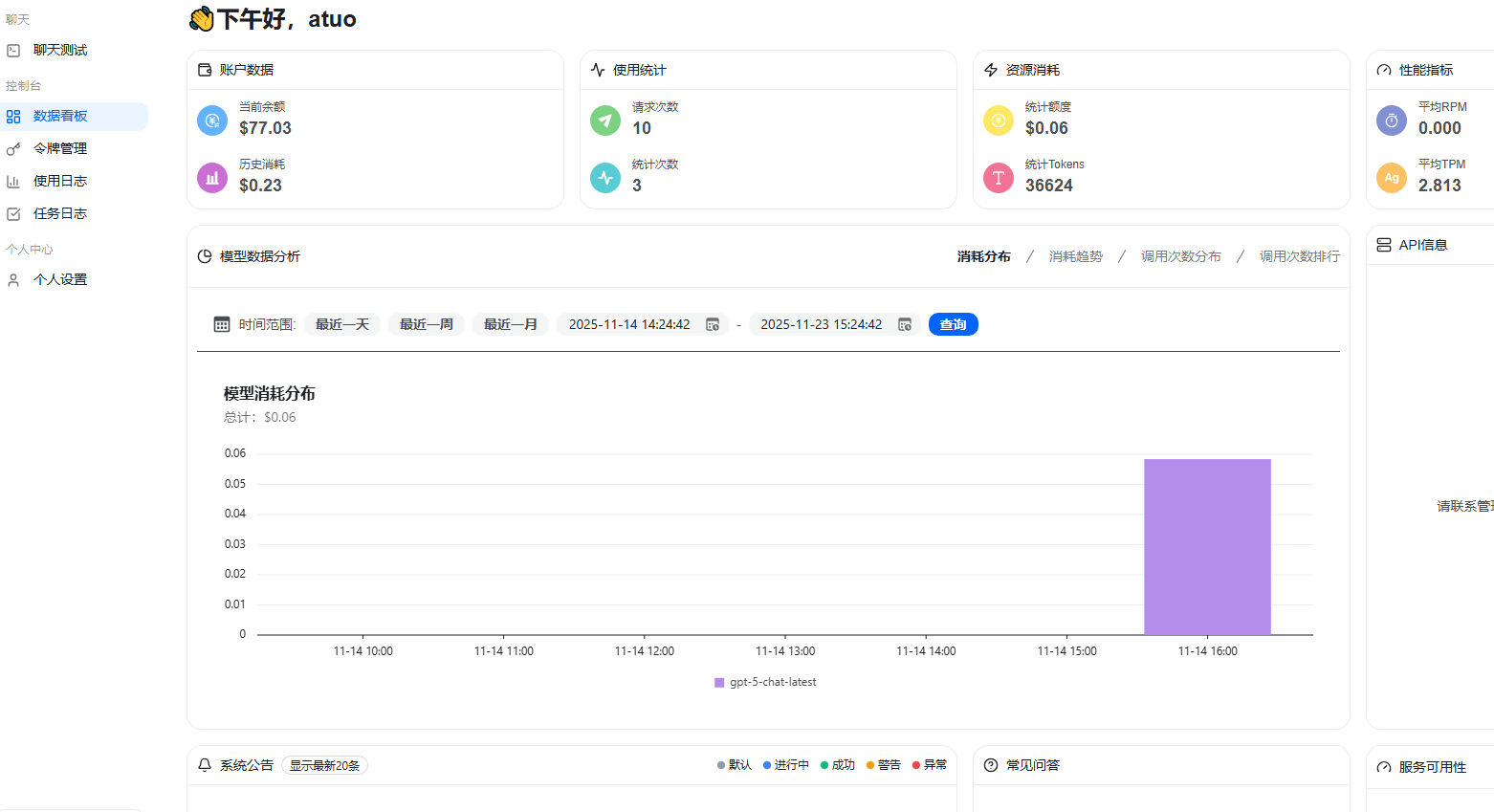

Step 4: 监控与优化(持续)

实时监控面板:

**实践建议:

- 设置预算告警:余额低于阈值时邮件/短信通知

- 合理选择模型:简单任务用 GPT-3.5,复杂推理用 Claude Sonnet 4.5

- 优化 Prompt:精简输入可降低 30-50% 成本

- 启用缓存:相似请求可复用结果(控制台配置)

- 异常处理:实现重试机制和降级策略

基础环境准备

- 操作系统: Windows 10/11, macOS 10.15+, Ubuntu 20.04+ 或 Debian 10+

- Node.js: v18以上版本

Claude Code CLI工具:

通过简单的命令行工具即可体验Claude的强大能力。安装完成后,开发者可以在终端直接与Claude交互,实现代码审查、项目初始化等高级功能。

对于Rust开发者而言,Cline插件的集成带来了前所未有的开发体验。通过简单的插件安装和配置,即可在RustRover中实现:

核心功能特性:

- 智能代码补全与建议

- 实时代码审查与优化建议

- 自动化测试用例生成

- 项目结构分析与重构建议

配置过程简洁直观,只需在插件设置中指定正确的API端点即可开始使用。具体配置参数和详细步骤请参考官方文档Claude Code之Rustrover接入手册 - AIGCARK - AIGCARK

作为最受欢迎的开发环境,VS Code的Claude集成方案尤为成熟:

一键安装体验:

- 通过VS Code扩展市场快速安装

- 自动配置向导简化初始化过程

- 支持多项目、多工作区独立配置

智能开发工作流:

安装完成后,开发者可以在IDE侧边栏找到Claude交互面板,支持:

- 上下文感知的代码对话

- 多文件协同分析与修改

- 实时性能优化建议

- 安全漏洞检测与修复

安全**实践和高级配置选项详见官方配置指南。

针对前端开发者的特殊需求,WebStorm集成提供了专业级的功能支持:

专为前端优化:

- React/Vue/Angular框架深度支持

- CSS/Tailwind智能转换与优化

- 组件化开发全流程辅助

- 打包构建配置智能生成

企业级安全特性:

- Token使用监控与告警

- 代码质量门禁控制

- 团队协作权限管理

- 合规性审计日志

高级配置请访问官网查看详细说明。

四、总结与展望

ArkAPI 不仅仅是一个 API 聚合平台,更是企业 AI 转型的加速器:

4.1核心优势回顾

✅ 技术优势:

- 统一接口,零学习成本迁移

- 智能路由,成本节省 25-40%

- 网络优化,延迟降低 80%+

- 企业级 SLA,99.9% 可用性

✅ 商业优势:

- 人民币结算,无外币麻烦

- 按需付费,成本可控

- 统一账单,财务友好

- 合规发票,税务无忧

✅ 生态优势:

- 20+ 主流模型提供商

- 60+ 优质模型随时切换

- 完美集成主流 IDE

- 丰富的中文资源

4.2未来规划

Q2 2025:

- 新增 100+ 国内外大模型

- 推出 Fine-tuning 定制服务

- 发布企业版私有化部署方案

Q3 2025:

- 多模态能力(图像、音频、视频)

- AI Agent 开发平台

- 低代码 AI 应用构建器

Q4 2025:

- 行业解决方案(金融、医疗、教育)

- AI 应用市场

更多AI大模型信息,请关注ArkAPI,无论是新手小白还是技术大咖,都能够在这里找到你想要的AI大模型!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/218528.html