最近多模态大模型(LMM)的发展真是让人应接不暇。前几天不管是 DeepSeek-OCR 还是腾讯混元 OCR,都还在专注于文档解析这一垂直领域。

智谱 AI 前段时间放出一个“王炸”——GLM-4.6V-Flash。

为什么说它是王炸?

- 9B 参数量:这是我们本地部署党的福音,消费级显卡(如 4090 甚至更低显存的卡)完全跑得动。

- 原生视觉函数调用(Native Visual Function Calling):这可是个新鲜词。以前我们做 Agent,通常是“看图 -> 转文字 -> 思考 -> 调工具”。现在 GLM-4.6V-Flash 可以直接把图片、截图无法转换的视觉信息作为参数传给工具!

- 前端代码生成神器:扔给它一张网页截图,它能给你吐出像素级还原的 HTML/CSS 代码。这就有点厉害了。

今天我们就来盘一盘这个新模型,顺便聊聊怎么本地部署。

核心亮点速览

在主要多模态基准测试中取得同规模下的 SOTA 性能之外,GLM-4.6V 还带来了一系列重要特性,官方称之为“原生多模态工具使用(Native Multimodal Tool Use)”的全面进化:

1. 原生多模态工具调用 (Native Multimodal Function Calling)

支持基于视觉的原生工具调用。这就意味着,图片、截图和文档页面可直接作为工具输入,无需中间转成文本;而工具返回的图表、检索图像和渲染页面等视觉输出,也能被模型理解并融入推理链,实现从“感知→理解→执行”的完整闭环。

2. 图文交织内容生成 (Interleaved Image-Text Content Generation)

不仅是生图或生文,它能生成高质量的混合内容。GLM-4.6V 能理解文档、用户输入以及工具检索图像构成的多模态上下文,并生成连贯的图文交织内容。模型在生成过程中甚至可主动调用搜索与检索工具,自行“裁剪”关键视觉信息,生成丰富且视觉支撑强的长文报告。

3. 视觉网页搜索 (Visual Web Search)

这是一个端到端的搜索分析工作流:

- 意图识别:自动判断是需要搜图还是搜文。

- 多模态理解:阅读搜索结果中的文字和图片。

- 推理与回答:融合视觉和文本线索,给出一个图文并茂的最终答案。

4. 前端还原与视觉编辑 (Frontend Replication & Visual Editing)

这对前端开发者绝对是“生产力革命”。

- 像素级复刻:上传截图或设计稿,直接识别布局、组件色彩,生成高保真 HTML/CSS/JS 代码。

- 交互式修改:你可以直接圈选截图的一个按钮,用大白话下令:“把这个按钮左移一点,换成深蓝色”。模型就能自动定位代码并修改。

5. 多模态文档与长视频理解

模型拥有 128K 的超长上下文窗口。

- 海量文档:实测可以一次性吃透约 150 页的复杂文档或 200 页 PPT。

- 长视频:能处理 1 小时长的视频,不仅能做全局总结,还能回答诸如“进球发生在几分几秒”这种细节问题。

本地部署实践

虽然它是 9B 的模型,但官方已经适配了 vLLM 和 SGLang 两个最强推理后端。

首先看一眼官方给出的性能对比图,在同尺寸模型中确实能打:

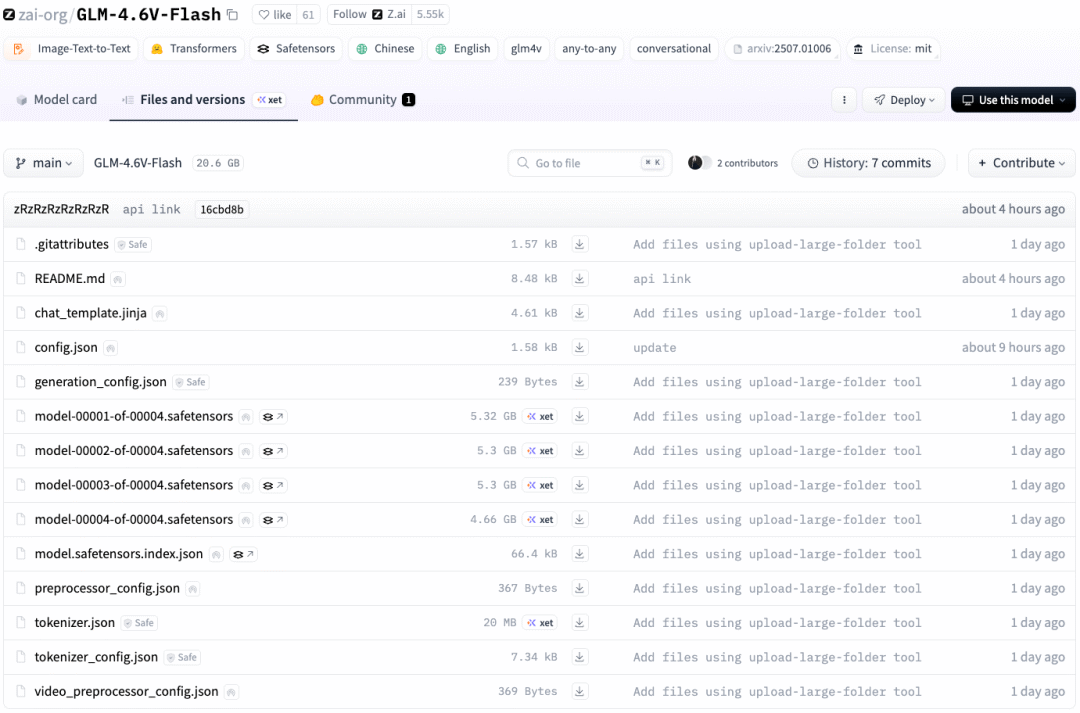

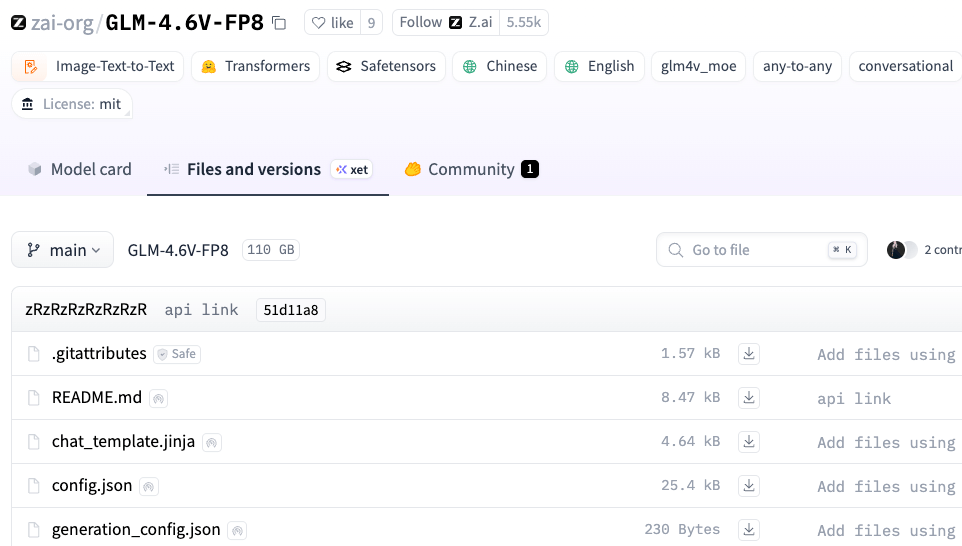

另外,除了我们重点介绍的 Flash (9B) 版本,官方还提供了 FP8 版本的仓库(主要是针对 106B 大模型的量化或特定优化版本),有兴趣且显存充裕的同学可以关注:https://huggingface.co/zai-org/GLM-4.6V-FP8/tree/main

但对于绝大多数个人开发者,我们主力还是玩转 GLM-4.6V-Flash。

1. 环境准备

要跑起来这个新模型,你的环境库得够新:

如果你用 vLLM(推荐生产环境):

你需要安装最新的 vLLM(建议 0.6.4.post1 及以上,官方文档说是 >=0.12.0,但目前 vLLM 最新也就是 0.6.x,这里官方可能指的是适配并未发布的版本或笔误,建议直接上 nightly 版本):

如果你用 SGLang(视频任务推荐):

GPT plus 代充 只需 145

2. Python 代码体验 (Transformers)

如果你不想折腾推理引擎,只想快速写个 Python 脚本体验一下,可以使用 库。

3. vLLM 本地部署(Docker 方式)

依然推荐使用 Docker 部署,干净卫生。由于模型比较新,建议拉取 镜像。

GPT plus 代充 只需 145

性能评测与注意事项

官方坦诚地列出了一些“已知问题”(Fixed and Remaining Issues),这一点非常刷好感:

- 纯文本 QA 还有提升空间:这个版本的技能点主要点在了“视觉多模态”上,纯文本能力后续会加强。

- 偶尔“过度思考”:处理复杂 Prompt 时可能会啰嗦。

- 计数准确性:数数这种经典难题,依然是 LLM 的弱项。

推荐配置参数:为了复现**效果,官方建议解码参数设置为:

- : 0.6

- : 2

- : 0.8

- : 1.1

总结

GLM-4.6V-Flash 是一个体量虽小(9B)但野心很大的模型。它不仅仅是“能看懂图”,而是试图让模型学会“用视觉去操作”。

对于需要 UI 代码生成、复杂文档解析 或者 视觉 Agent 开发的朋友,强烈建议本地部署玩一玩。

后面我会找时间做一期深度实测,看看它写前端代码到底有多强!

为什么AI大模型成为越来越多程序员转行就业、升职加薪的首选

很简单,这些岗位缺人且高薪

智联招聘的最新数据给出了最直观的印证:2025年2月,AI领域求职人数同比增幅突破200% ,远超其他行业平均水平;整个人工智能行业的求职增速达到33.4%,位居各行业榜首,其中人工智能工程师岗位的求职热度更是飙升69.6%。

AI产业的快速扩张,也让人才供需矛盾愈发突出。麦肯锡报告明确预测,到2030年中国AI专业人才需求将达600万人,人才缺口可能高达400万人,这一缺口不仅存在于核心技术领域,更蔓延至产业应用的各个环节。

深耕科技一线十二载,亲历技术浪潮变迁。我见证那些率先拥抱AI的同行,如何建立起效率与薪资的代际优势。如今,我将积累的大模型面试真题、独家资料、技术报告与实战路线系统整理,分享于此,为你扫清学习困惑,共赴AI时代新程。

我整理出这套 AI 大模型突围资料包【允许白嫖】:

- ✅从入门到精通的全套视频教程

- ✅AI大模型学习路线图(0基础到项目实战仅需90天)

- ✅大模型书籍与技术文档PDF

- ✅各大厂大模型面试题目详解

- ✅640套AI大模型报告合集

- ✅大模型入门实战训练

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

包含提示词工程、RAG、Agent等技术点

全过程AI大模型学习路线

市面上的大模型书籍确实太多了,这些是我精选出来的

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/216470.html