- OpenClaw 是什么

- OpenClaw 能做什么

- 国内使用 OpenClaw 的四种方案

- 四种方案横向对比

- 模型选择指南:不同场景用什么模型

- 2026 主流模型价格与性能对比

- 成本控制:如何省钱

- OpenClaw vs Cursor vs Claude Code

- 常见问题(FAQ)

- 总结与行动建议

- 参考资料

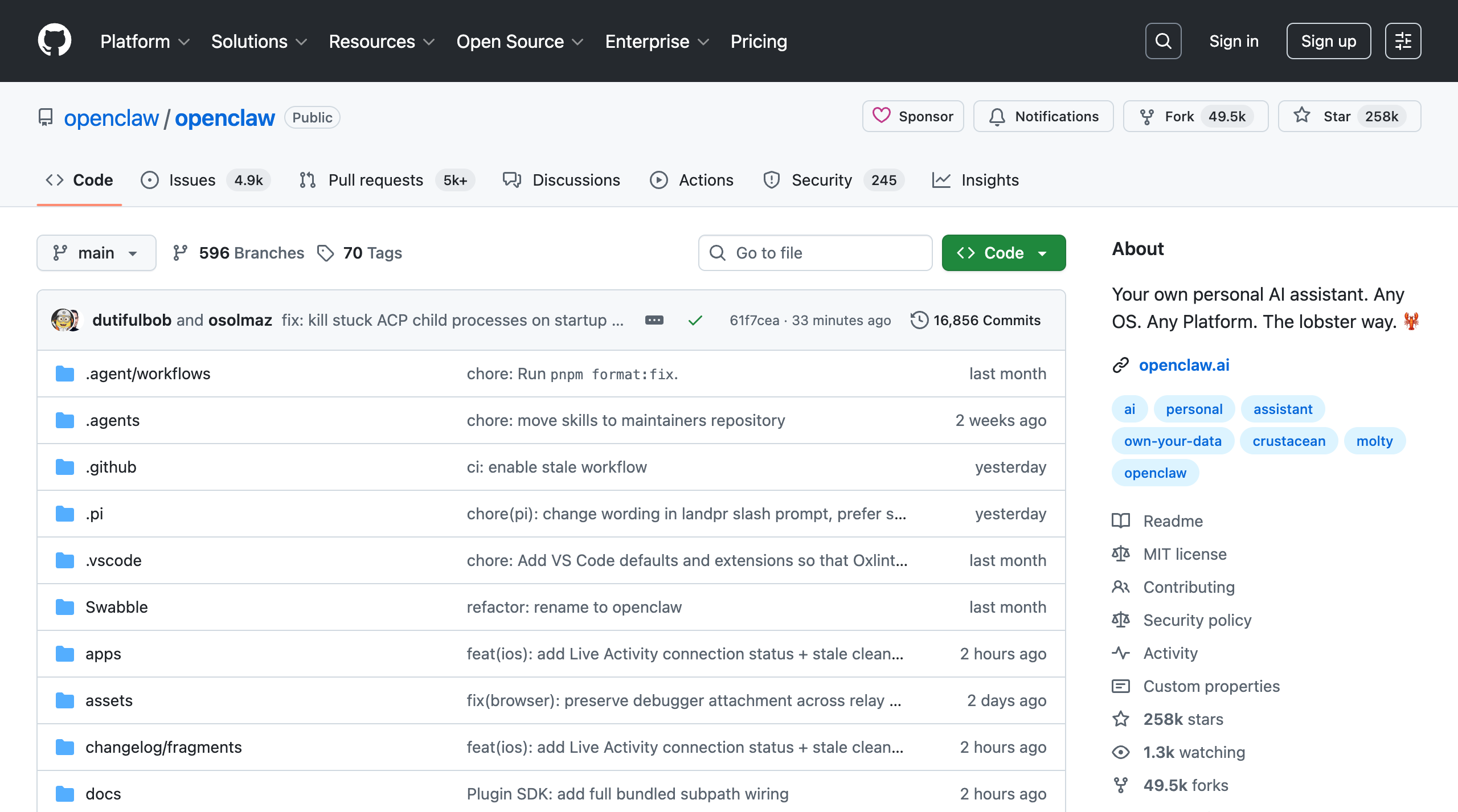

OpenClaw(前身 Clawdbot)是由 Peter Steinberger 创建的开源 AI Agent 平台,2026 年 1 月爆火,GitHub Star 数在两个月内突破 24 万,成为有史以来增长最快的开源项目之一。

和 ChatGPT 等聊天工具不同,OpenClaw 不只是”能聊天”——它是一个真正能动手干活的 AI 代理:

- 跨平台运行:支持 Telegram、Discord、Slack、飞书、钉钉、WhatsApp、iMessage 等 20+ 通讯平台

- 任务执行:不只回答问题,能操作电脑、发邮件、管理文件、浏览网页、写代码

- 持续记忆:记住上下文和用户偏好,不会”失忆”

- 多 Agent 协作:可以配置多个角色各司其职

- 完全开源:代码透明,数据存储在你自己的设备上

2026 年 2 月,OpenClaw 创始人宣布加入 OpenAI,项目移交给开源基金会运营,社区生态进一步扩大。阿里云、腾讯云、火山引擎均在第一时间推出了一键部署方案。

OpenClaw 的使用场景远比你想象的广:

OpenClaw 本身只是一个”执行框架”,它的智能来自后端的 AI 模型。国内开发者接入 AI 模型主要有四种方案:

直接对接 DeepSeek、Qwen、GLM 等国产模型的官方 API。

优点:

- 无需特殊网络配置,国内直连

- 部分模型有免费额度

- 中文能力强

缺点:

- 只能用单一厂商的模型

- 部分复杂任务效果不如 GPT/Claude

- 各家 API 格式不完全统一

适合:预算有限、主要处理中文任务、不需要海外模型的用户。

通过阿里云百炼、腾讯云、火山引擎等平台的 OpenClaw 一键部署服务。

优点:

- 部署简单,一键搞定

- 有技术支持和 SLA 保障

- 内置部分模型

缺点:

- 绑定特定云厂商

- 模型选择受限于平台提供的范围

- 需要额外付云服务器费用

适合:企业用户、需要稳定运维保障、已有云服务器的团队。

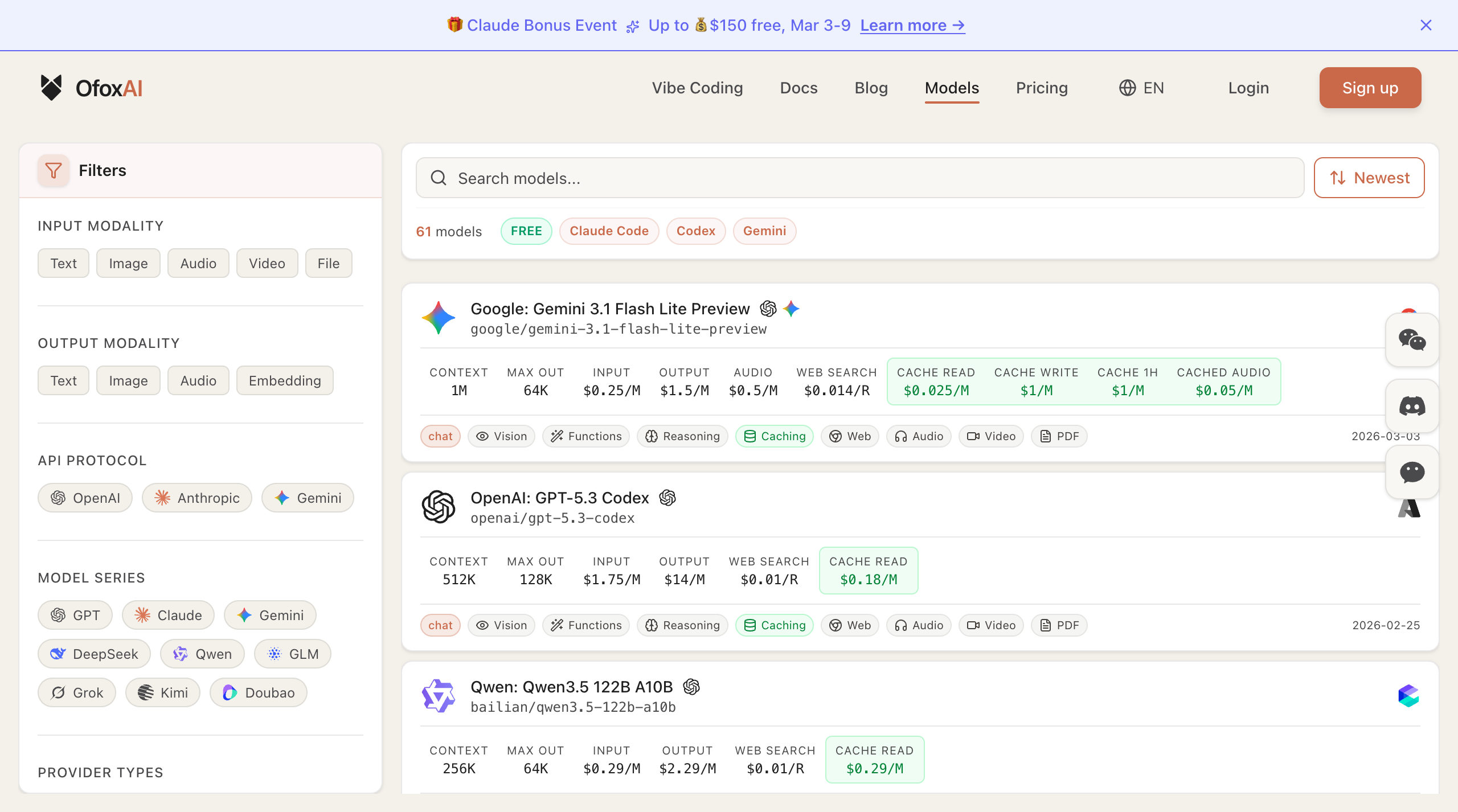

通过 Ofox 等 API 聚合平台接入,一个接口同时使用国内外 100+ 模型。

优点:

- 一个 API Key 用所有模型(GPT、Claude、Gemini、DeepSeek 等)

- 国内阿里云/火山云加速节点,低延迟

- 人民币结算,支持支付宝/微信

- OpenAI 兼容协议,配置简单

- 模型故障自动切换

缺点:

- 依赖第三方平台

- 比直连官方 API 略贵(但省去了海外支付、网络等成本)

适合:需要使用海外模型、追求灵活性和稳定性的开发者和团队。

自己搭建海外服务器,代理转发 OpenAI/Anthropic 等官方 API。

优点:

- 完全自主可控

- 无第三方依赖

缺点:

- 需要海外服务器(每月额外成本)

- 需要自己维护稳定性和安全性

- 不支持国产模型

- 技术门槛高

适合:有运维能力、对数据安全要求极高的技术团队。

推荐:大多数开发者选择「国产模型 + API 聚合平台」组合——日常简单任务用 DeepSeek/Qwen(便宜),复杂任务切换 Claude/GPT(效果好),通过 Ofox 统一管理。

选对模型是控制成本和提升效果的关键。以下是针对 OpenClaw 不同使用场景的模型推荐:

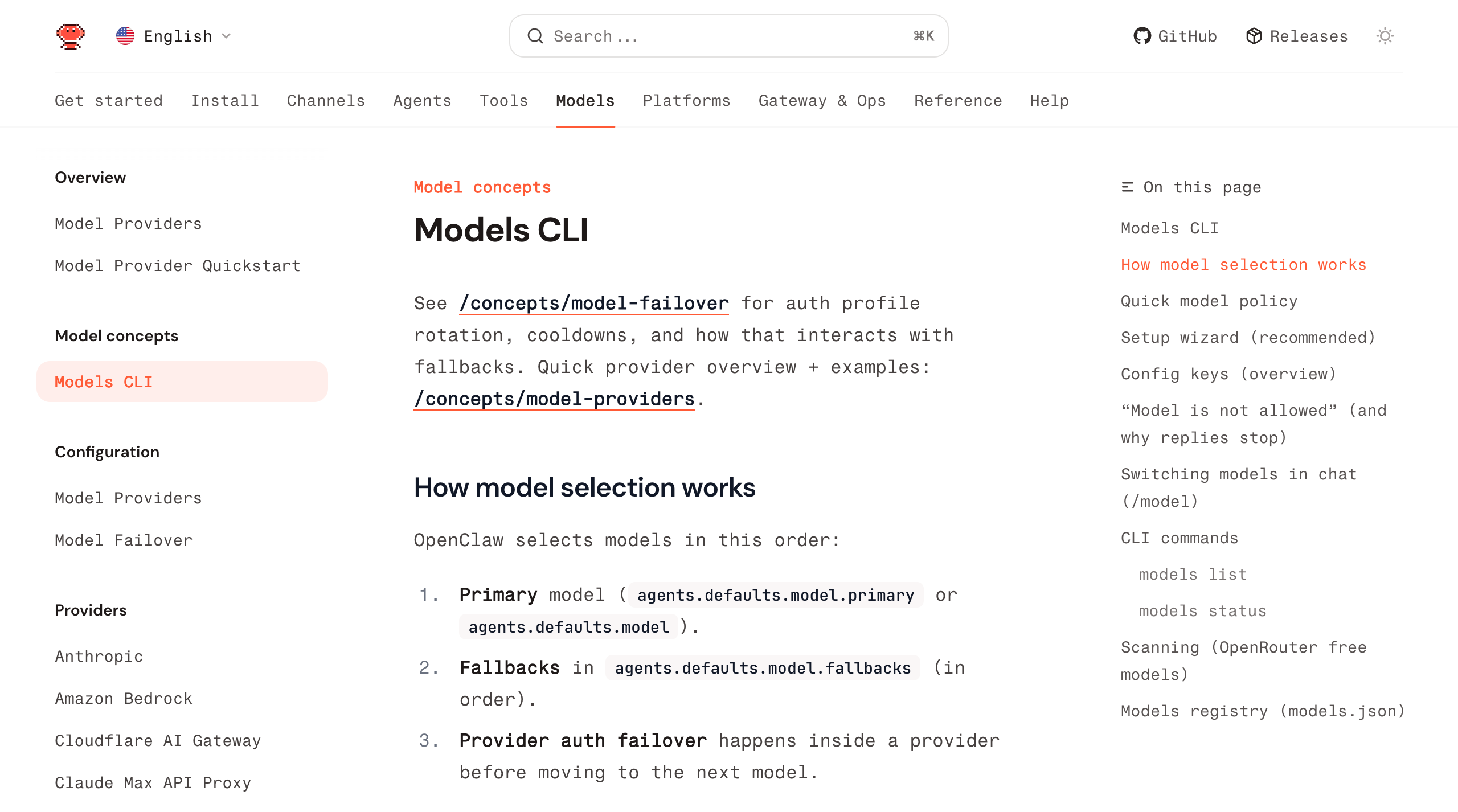

不要只绑定一个模型。推荐配置 OpenClaw 的 模型 fallback 机制:

- 主模型:Claude Sonnet 4.6 或 GPT-4o(日常使用)

- 强力模型:Claude Opus 4.6(遇到复杂任务自动升级)

- 经济模型:DeepSeek V3.2 或 GPT-4o-mini(简单任务降级省钱)

- 备用模型:Gemini 3 Flash(主模型故障时兜底)

通过 Ofox 这样的聚合平台,一个 API Key 即可在这些模型间自由切换,无需分别注册和管理多个账号。

以下价格基于 2026 年 3 月的公开数据,单位为人民币/百万 token:

💡 省钱提示:80% 的日常任务用 Sonnet/4o 级别模型就够了,只有复杂推理才需要 Opus/5.2。合理分级可以将月均成本降低 60% 以上。

将任务按复杂度分为三级,对应不同模型:

- L1 简单任务(70% 的请求):DeepSeek V3.2 / GPT-4o-mini → 成本约 ¥2-3/百万 token

- L2 常规任务(25% 的请求):Claude Sonnet / GPT-4o → 成本约 ¥15-40/百万 token

- L3 复杂任务(5% 的请求):Claude Opus / GPT-5.2 → 成本约 ¥50-225/百万 token

这样加权平均成本比全部用旗舰模型低 70% 以上。

多个平台提供注册免费额度,合理利用可以在开发测试阶段零成本:

- DeepSeek 官方:注册赠送额度

- Google Gemini:免费 tier 额度充足

- Ofox:注册赠送免费额度,覆盖所有模型

在 OpenClaw 配置中设置每日/每月 token 预算上限,超出后自动降级到经济模型或暂停非关键任务。避免 Agent 无限循环导致成本失控。

精简系统 prompt,减少不必要的上下文传递。OpenClaw 的记忆系统会自动压缩历史对话,但合理设置记忆保留策略也能显著减少 token 消耗。

这三个工具经常被拿来比较,但其实定位完全不同:

简单总结:

- 只需要写代码 → Cursor 或 Claude Code

- 需要 AI 全面协助工作 → OpenClaw

- 需要 7×24 自动化 → OpenClaw

- 需要跨平台协作 → OpenClaw

很多开发者的做法是:编码用 Cursor/Claude Code,其他任务用 OpenClaw,两者互补而非替代。

OpenClaw 支持 macOS、Linux 和 Windows(WSL)。推荐配置:Node.js 20+、4GB+ 内存。Mac 用户可以通过 Homebrew 安装,Linux 用户可以用 Docker 一键部署。阿里云、腾讯云也提供了一键部署镜像。

日常中文对话和简单任务,国产模型(DeepSeek、Qwen)完全够用且更便宜。需要复杂推理、代码生成、英文任务时,GPT/Claude 效果更好。推荐通过 API 聚合平台同时接入两类模型,按需切换。

OpenClaw 有完善的权限控制机制——你可以限制 Agent 能访问的平台、能执行的操作类型、能使用的 token 额度。建议初期设置严格的权限白名单,熟悉后逐步放开。所有操作都有审计日志可追溯。

通过 API 聚合平台(如 Ofox)的团队功能,可以一人注册全员共享,每个成员的用量独立统计。管理者可以设置成员额度上限、查看详细用量报表、控制可用模型范围。

完全支持。OpenClaw 的语言能力取决于后端模型。DeepSeek V3.2、Qwen3.5、Claude Sonnet/Opus 等模型的中文理解和生成能力都非常强。系统配置和 Agent 角色定义也可以完全用中文。

OpenClaw 作为 2026 年最受关注的开源 AI Agent,正在改变人们与 AI 协作的方式。国内开发者使用 OpenClaw 的**路径:

- 快速体验:本地安装 OpenClaw,接入 DeepSeek 免费 API,跑通基本对话

- 日常使用:注册 Ofox 获取统一 API Key,配置混合模型策略(日常用 Sonnet,复杂任务用 Opus)

- 团队推广:部署到云服务器,接入飞书/钉钉,配置多 Agent 分工协作

- 持续优化:根据用量数据调整模型分级策略,控制成本

OpenClaw + API 聚合平台的组合,让每个人都能拥有一个 7×24 在线、能力全面的 AI 助手。

- OpenClaw 官方文档 - 安装、配置、API 参考

- OpenClaw GitHub 仓库 - 源码和 Issue 讨论

- Ofox AI API 文档 - API 接入和模型列表

- Ofox OpenClaw 集成指南 - OpenClaw 专属配置教程

- 阿里云 OpenClaw 部署方案 - 一键部署教程

- OpenClaw Wikipedia - 项目背景和发展历程

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/213739.html