经典网络结构总结--MobileNet系列

MobileNet

mobilenet是Google提出的。

优点:体积小,计算量小,适用于移动设备的卷积神经网络。

可以实现分类/目标检测/语义分割;

小型化:

卷积核分解,使用1xN和Nx1的卷积核替换NxN的卷积核。

采用bottleneck结构 ,以SqueezeNet为代表

以低精度浮点数保存,例如Deep Compression

冗余卷积核剪枝及哈弗曼编码。

mobilenet v1:

参考了传统的VGGNet等链式架构,都以层叠卷积层的方式提高网络深度,从而提高识别精度。缺点:梯度弥散现象。

(梯度弥散:导数的链式法则,连续多层小于1的梯度会使梯度越来越小,最终导致某层梯度为0)

要解决什么问题?

在现实场景中,诸如移动设备,嵌入式设备,自动驾驶等等,计算能力会受到限制,所以目标就是构建一个小且快速的模型。

用了什么方法解决问题(实现):

在MobileNet架构中,使用了深度可分离卷积替代传统卷积。

在MobileNet网络中引入两个收缩超参数:宽度因子,分辨率乘子。宽度因子可以降低参数,计算量;分辨率只改变计算量。

还存在什么问题:

MobileNet v1的结构过于简单,是类似于VGG的直筒结构,导致这个网络的性价比其实不高。如果引入后续的一系列ResNet,DenseNet等结构(复用图像特征,添加shortcuts)可以大幅提升网络的性能。

深度卷积存在潜在问题,训练后部分kernel权值为零。

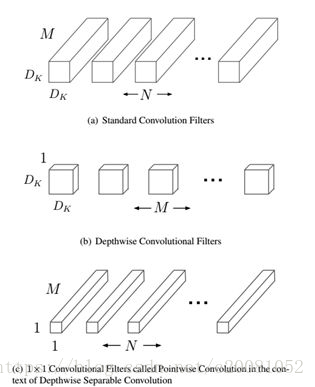

深度可分卷积思想?

实质上就是将标准卷积分成了两步:depthwise卷积和pointwise卷积,其输入和输出都是相同的。

depthwise卷积:对每个输入通道单独使用一个卷积核处理。

pointwise卷积:1×1卷积,用于将depthwise的卷积的输出组合起来。

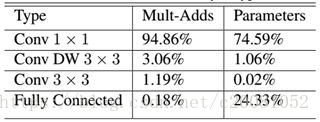

MoblieNet的大多数计算量(约95%)和参数(75%)都在1×1卷积中,剩余的大多数参数(约24%)都在全连接层中。由于模型较小,可以减少正则化手段和数据增强,因为小模型相对不容易过拟合。

引言

卷积神经网络(CNN)已经普遍应用在计算机视觉领域,并且已经取得了不错的效果。图1为近几年来CNN在ImageNet竞赛的表现,可以看到为了追求分类准确度,模型深度越来越深,模型复杂度也越来越高,如深度残差网络(ResNet)其层数已经多达152层。

图1 CNN在ImageNet上的表现(来源:CVPR2017)

然而,在某些真实的应用场景如移动或者嵌入式设备,如此大而复杂的模型是难以被应用的。首先是模型过于庞大,面临着内存不足的问题,其次这些场景要求低延迟,或者说响应速度要快,想象一下自动驾驶汽车的行人检测系统如果速度很慢会发生什么可怕的事情。所以,研究小而高效的CNN模型在这些场景至关重要,至少目前是这样,尽管未来硬件也会越来越快。目前的研究总结来看分为两个方向:一是对训练好的复杂模型进行压缩得到小模型;二是直接设计小模型并进行训练。不管如何,其目标在保持模型性能(accuracy)的前提下降低模型大小(parameters size),同时提升模型速度(speed, low latency)。本文的主角MobileNet属于后者,其是Google最近提出的一种小巧而高效的CNN模型,其在accuracy和latency之间做了折中。下面对MobileNet做详细的介绍。

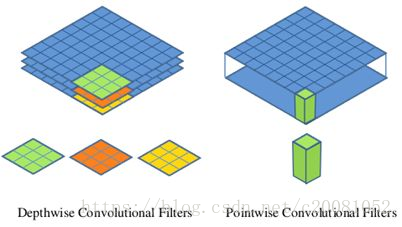

Depthwise separable convolution

MobileNet的基本单元是深度级可分离卷积(depthwise separable convolution),其实这种结构之前已经被使用在Inception模型中。深度级可分离卷积其实是一种可分解卷积操作(factorized convolutions),其可以分解为两个更小的操作:depthwise convolution和pointwise convolution,如图1所示。Depthwise convolution和标准卷积不同,对于标准卷积其卷积核是用在所有的输入通道上(input channels),而depthwise convolution针对每个输入通道采用不同的卷积核,就是说一个卷积核对应一个输入通道,所以说depthwise convolution是depth级别的操作。而pointwise convolution其实就是普通的卷积,只不过其采用1x1的卷积核。图2中更清晰地展示了两种操作。对于depthwise separable convolution,其首先是采用depthwise convolution对不同输入通道分别进行卷积,然后采用pointwise convolution将上面的输出再进行结合,这样其实整体效果和一个标准卷积是差不多的,但是会大大减少计算量和模型参数量。

图1 Depthwise separable convolution

图2 Depthwise convolution和pointwise convolution

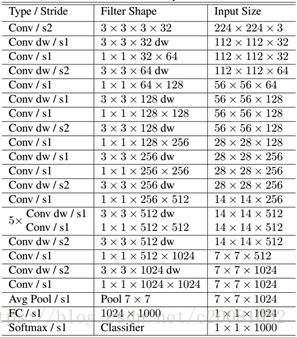

MobileNet网络结构

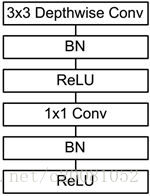

前面讲述了depthwise separable convolution,这是MobileNet的基本组件,但是在真正应用中会加入batchnorm,并使用ReLU激活函数,所以depthwise separable convolution的基本结构如图3所示。

图3 加入BN和ReLU的depthwise separable convolution

表1 MobileNet的网络结构

表2 MobileNet网络的计算与参数分布

MobileNet到底效果如何,这里与GoogleNet和VGG16做了对比,如表3所示。相比VGG16,MobileNet的准确度稍微下降,但是优于GoogleNet。然而,从计算量和参数量上MobileNet具有绝对的优势。

表3 MobileNet与GoogleNet和VGG16性能对比

MobileNet瘦身

前面说的MobileNet的基准模型,但是有时候你需要更小的模型,那么就要对MobileNet瘦身了。这里引入了两个超参数:width multiplier和resolution multiplier。

MobileNet的TensorFlow实现

TensorFlow的nn库有depthwise convolution算子tf.nn.depthwise_conv2d,所以MobileNet很容易在TensorFlow上实现:

class MobileNet(object): def __init__(self, inputs, num_classes=1000, is_training=True, width_multiplier=1, scope="MobileNet"): """ The implement of MobileNet(ref:https://arxiv.org/abs/1704.04861) :param inputs: 4-D Tensor of [batch_size, height, width, channels] :param num_classes: number of classes :param is_training: Boolean, whether or not the model is training :param width_multiplier: float, controls the size of model :param scope: Optional scope for variables """ self.inputs = inputs self.num_classes = num_classes self.is_training = is_training self.width_multiplier = width_multiplier # construct model with tf.variable_scope(scope): # conv1 net = conv2d(inputs, "conv_1", round(32 * width_multiplier), filter_size=3, strides=2) # ->[N, 112, 112, 32] net = tf.nn.relu(bacthnorm(net, "conv_1/bn", is_training=self.is_training)) net = self._depthwise_separable_conv2d(net, 64, self.width_multiplier, "ds_conv_2") # ->[N, 112, 112, 64] net = self._depthwise_separable_conv2d(net, 128, self.width_multiplier, "ds_conv_3", downsample=True) # ->[N, 56, 56, 128] net = self._depthwise_separable_conv2d(net, 128, self.width_multiplier, "ds_conv_4") # ->[N, 56, 56, 128] net = self._depthwise_separable_conv2d(net, 256, self.width_multiplier, "ds_conv_5", downsample=True) # ->[N, 28, 28, 256] net = self._depthwise_separable_conv2d(net, 256, self.width_multiplier, "ds_conv_6") # ->[N, 28, 28, 256] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_7", downsample=True) # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_8") # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_9") # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_10") # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_11") # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 512, self.width_multiplier, "ds_conv_12") # ->[N, 14, 14, 512] net = self._depthwise_separable_conv2d(net, 1024, self.width_multiplier, "ds_conv_13", downsample=True) # ->[N, 7, 7, 1024] net = self._depthwise_separable_conv2d(net, 1024, self.width_multiplier, "ds_conv_14") # ->[N, 7, 7, 1024] net = avg_pool(net, 7, "avg_pool_15") net = tf.squeeze(net, [1, 2], name="SpatialSqueeze") self.logits = fc(net, self.num_classes, "fc_16") self.predictions = tf.nn.softmax(self.logits) def _depthwise_separable_conv2d(self, inputs, num_filters, width_multiplier, scope, downsample=False): """depthwise separable convolution 2D function""" num_filters = round(num_filters * width_multiplier) strides = 2 if downsample else 1 with tf.variable_scope(scope): # depthwise conv2d dw_conv = depthwise_conv2d(inputs, "depthwise_conv", strides=strides) # batchnorm bn = bacthnorm(dw_conv, "dw_bn", is_training=self.is_training) # relu relu = tf.nn.relu(bn) # pointwise conv2d (1x1) pw_conv = conv2d(relu, "pointwise_conv", num_filters) # bn bn = bacthnorm(pw_conv, "pw_bn", is_training=self.is_training) return tf.nn.relu(bn)完整实现可以参见GitHub。

总结

本文简单介绍了Google提出的移动端模型MobileNet,其核心是采用了可分解的depthwise separable convolution,其不仅可以降低模型计算复杂度,而且可以大大降低模型大小。在真实的移动端应用场景,像MobileNet这样类似的网络将是持续研究的重点。后面我们会介绍其他的移动端CNN模型。

mobilenet v2:

mobileNet v2主要引进了两个改动:Linear Bottleneck和Inverted Residual Blocks.

关于 Inverted Residual Blocks:

MobileNet v2结构基于inverted residual.其本质是一个残差网络设计,传统Residual block是block的两端channel通道数多,中间少;

而本文设计的inverted residual是block的两端channel通道数少,block内通道数多。另外保留了深度可分离卷积

关于Linear Bottlenecks:

感兴趣区域在ReLU之后保持非零,近似认为是线性变换;

ReLU能够保持输入信息的完整性,但仅限于输入特征位于输入空间的低维子空间。

对于低纬度空间处理,把ReLU近似为线性转换。

v1与v2对比:

相同点:

都采用Depth-wise(DW)卷积搭配Point-wise(PW)卷积的方式来提取特征。这两个操作合起来被称为Depth-wise Separable Convolution,之前在Xception中被广泛使用。这样做的好处就是理论上可以成倍减少卷积层的时间复杂度和空间复杂度。

不同点:

2. v2在DW卷积之前新加了一个PW卷积。这么做的原因是,因为DW卷积由于本身的计算特性决定它自己没有改变通道数的能力。上一层给它多少通道,它就要输出多少通道。所以如果上一层给的通道数本身很少的话,DW就只能在低维空间提取特征,因此效果不够好。

现在v2为了改善这个问题,给每个DW之前都匹配了一个PW,专门用来升维,定义升维系数为6,这样不管输入通道数是多是少,经过第一个PW升维之后,DW都是在相对的更高维进行辛勤工作的。

v2去掉了第二个pw的激活函数,作者称之为Linear Bottleneck。原因是作者认为激活函数在高维空间能够有效的增加非线性,而在低维空间则会破坏特征值,不如线性效果好。第二个PW主要功能就是降维,因此按照上面的理论,降维之后不宜再使用ReLU6.

mobileNet v3

高效的网络构建模块:

v3是神经架构搜索得到的模型,其内部使用的模块有:

1. v1模型引进的是深度可分离卷积;

2. v2引进的是具有线性瓶颈的倒残差结构;

3. 基于squeeze and excitation结构的轻量级注意力模型;

- MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Application

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/17884.html