摘要

无雾图像是许多视觉系统和算法的先决条件,因此单图像去雾在计算机视觉中至关重要。在这个领域,基于先验的方法已经取得了初步的成功。然而,它们经常在输出中引入令人讨厌的伪影,因为它们的先验很难适应所有情况。相比之下,基于学习的方法可以产生更自然的结果。尽管如此,由于缺乏与训练样本相同场景的成对雾蒙蒙和清晰的室外图像,它们的除霾能力有限。在这项工作中,我们试图通过将去雾任务分为两个子任务,即可见性恢复和真实性改进,来融合基于先验和基于学习的方法的优点。具体来说,我们提出了一个两阶段弱监督去雾框架RefineDNet。在第一阶段,RefineDNet在恢复可见性之前采用暗通道先验。然后,在第二阶段,它对第一阶段的初步去雾结果进行细化,以通过对未配对的模糊和清晰图像进行对抗性学习来提高真实性。为了获得更合格的结果,我们还提出了一种有效的感知融合策略来混合不同的去雾输出。大量实验证实,具有感知融合的RefineDNet具有出色的除霾能力,也可以产生视觉上令人愉悦的结果。即使使用基本的骨干网络实现,RefineDNet也可以在室内和室外数据集上优于监督除雾方法以及其他最先进的方法。为了使我们的结果具有可复制性,相关代码和数据可在https://github.com/xiaofeng94/RefineDNet-for-dehazing.

1.介绍

在雾霾条件下,由于大气气溶胶颗粒的散射,图像的能见度严重降低,使得许多计算机视觉应用难以进一步感知和理解,如物体检测、识别和ADAS(高级驾驶员辅助系统)。因此,除雾,特别是单图像除雾,是非常有价值的,并且在过去十年中得到了广泛的研究[1]-[7]。

现有的去雾方法可以大致分为两类,即基于先验的方法和基于学习的方法。第一类方法依赖于广泛接受的大气散射物理模型,Koschmieder定律[9]。在我们的情况下,该定律可以定义为,.

这里,x是指像素的位置。I(x)和J(x)分别是表观亮度(雾状图像)和固有亮度(清晰场景)。A是表示大气中环境光的全局大气光。t(x)是固有亮度在大气中的透射,并且它可以被进一步建模为,

![]()

其中β是消光系数,并且d(x)是x的场景深度。由于Koschmieder定律中有两个以上的未知变量,我们无法仅使用输入的模糊图像来精确定位它们。因此,基于先验的方法的研究人员提出了各种先验作为额外的约束,以找到J(x)的适当解。这些先验通常旨在恢复物体相对于环境光的对比度。由于可见性是由对比度决定的,因此基于先验的方法可以生成具有高可见性的去雾结果。尽管这些先验在特定情况下表现良好,但它们不能适应所有情况,从而过度增强对比度,产生不需要的伪影,例如光晕和色块。

与基于先验的去雾方法不同,基于学习的方法学习估计A和t(x),或者通过监督学习直接从输入模糊图像中恢复J(x)。 由于它们采用了卷积神经网络(CNNs),根据[10],卷积神经网络天生能够生成几乎没有伪影的图像,因此这些方法能够产生令人满意的真实性的去雾结果。然而,他们的训练过程需要来自相同场景的大量清晰和模糊的图像对,而在现实世界条件下,这些图像对很难大量收集。因此,他们经常进行权衡,并通过在有基本深度信息的室内场景中应用Koschmieder定律来合成模糊图像。由于室内合成图像和真实世界的室外图像之间存在一定的差距,基于学习的方法可能会过度拟合合成数据,并且它们去除真实雾霾的能力有限。

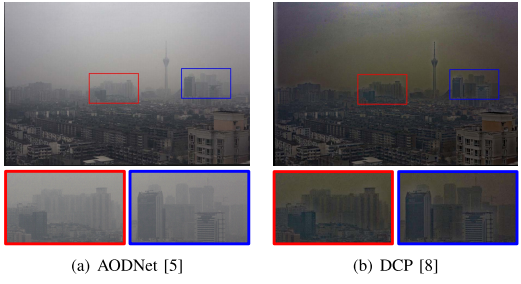

图1。基于学习和基于先验的方法的缺点。(a) 是通过基于学习的方法AODNet[5]生成的。(b) 由基于先验的方法DCP[8]生成。AODNet的结果在视觉上更好,但包括更多的雾度,而DCP以引入伪影为代价去除了更多的雾。红色和蓝色方框突出显示了它们的差异。

有趣的是,由于这两类方法的特点,基于先验的方法在恢复可见性方面相对更好,而基于学习的方法在提高结果的真实性方面更可取。图图1提供了(a)基于学习的AODNet[5]和(b)基于先验的DCP[8]的去雾结果来说明这一现象。正如我们所看到的,DCP的结果雾度较小,但伪影较多,而AODNet的结果真实度较高,但雾度较多。在附录A中,我们对基于先验和基于学习的方法的偏好提供了一些理论解释。

为了进一步改善除雾效果,利用这两类的优势是一个自然的想法,但令人惊讶的是,这样一个简单的想法在文献中很少被探索。在这项工作中,基于上述发现,我们提出了一个两阶段弱监督去雾框架RefineDNet(Refinement dehazing Network),以合并这两类的优点。

具体而言,在第一阶段,RefineDNet通过DCP产生初步结果来恢复输入模糊图像的可见性。我们在框架中嵌入DCP去雾,以实现端到端的训练和评估。在第二阶段,RefineDNet通过使用两个细化器网络对初步去雾图像和传输图的质量进行细化,从而提高了它们的真实性。 在训练过程中,我们通过在未配对图像上使用鉴别器的对抗性学习来更新细化器网络。这种对未配对数据的弱监督有利于去雾,因为可以从现实世界中收集大量未配对的图像来训练我们的模型。通过这种方式,RefineDNet比在模拟图像上训练的监督方法更适合处理真实世界的雾状图像,并且可能会过度拟合这些数据。

除了精细的去雾图像外,RefineDNet还使用模糊输入和精细传输重建另一个去雾图像。由于精细化和重建的去雾图像是以不同的方式生成的,因此它们不太可能在所有区域中都执行相同的操作。在某些地区,它们中的任何一个都有可能胜过另一个。因此,在其中任何一个图像中融合更好的区域都可以提高性能。为此,我们提出了一种感知融合策略来融合细化的和重建的去雾图像。在这种策略中,更大的权重被分配给更接近自然图像的区域。为了获得这样的权重,我们利用了图像质量评估(IQA)领域的强大功能。

通过两阶段去雾策略,RefineDNet将去雾任务分为两个子任务,即可见性恢复和真实性改进,并利用先验和学习分别处理这两个子任务。由于先验和学习是在RefineDNet的不同阶段使用的,因此它们不同,不会相互影响。因此,RefineDNet具有基于先验和基于学习的方法的优点。此外,RefineDNet只需要在细化阶段去除伪影,因此其学习遇到的去模糊性较小。因此,它有幸拥有稳定的弱监督,并规避了监督方法所面临的数据缺乏问题。为了支持我们的说法,我们表明,即使使用基本的骨干网络实现,RefineDNet也能够在室内和室外数据集上优于最先进的监督方法。此外,由于RefineDNet没有现成的户外训练集,我们使用RESIDE[11]的图像构建了一个未配对的户外训练数据集RESIDEUnpaired。

这项工作的主要贡献总结如下:

- 我们提出了一个两阶段的弱监督框架RefineDNet,该框架首先采用基于先验的DCP来恢复可见性,然后使用GAN来提高真实性。结果表明,RefineDNet集成了基于先验和基于学习的去雾方法的优点,并产生了具有高可见性的视觉效果。此外,由于两阶段去雾策略,RefineDNet拥有有效的弱监督,具有未配对的模糊和清晰的图像,这避免了监督方法缺乏配对数据的问题。

- 我们提出了一种新的感知融合策略来融合不同的去雾结果。我们的实验结果表明,该策略是有效的,在各种数据集中都有性能提升。

- 我们还用6480张户外图像构建了一个必要的非配对数据集,以促进弱监督除雾方法的相关研究。

本文的其余部分组织如下。第二节回顾了相关工作。第三节详细描述了所提出的具有感知融合的RefineDNet。第四节介绍了实验结果和消融研究。最后,第五节总结了本文。

2.相关工作

这项工作与基于先验和基于学习的去雾方法以及生成对抗性网络(GANs)有关。由于近年来对GANs进行了广泛的探索,我们主要综述了它们在去雾方面的应用。

A.基于先验的去雾方法

在文献中,已经探讨了各种先验或假设。Fattal[1]将Koschmieder定律[9]中的J(x)分解为表面反射率系数和遮光因子,他通过假设遮光因子和透射独立来求解所有未知变量。Tan[12]基于他们的观察,构建了具有能量函数的马尔可夫随机场(MRF),即清晰的图像具有更高的对比度,并且Koschmieder定律的大气散射项(第二项)在小区域内平稳变化。根据Tan的观察[12],Tarel和Hautiere[13]定义了大气幕,并提供了其封闭形式的解决方案。后来,He等人[8]提出了上述暗信道先验(DCP)来估计传输图。Salazar Colores等人[14]将DCP与数学形态学运算(如侵蚀和膨胀)相结合,以有效地计算透射图。Meng等人[3]将DCP推广到边界约束,并将该约束与加权上下文正则化一起采用,以获得优化的传输图。最近,Liu等人[15]提出了非局部全变差正则化(NLTV)来细化通过边界约束获得的初步传输图。

此外,还研究了Koschmieder定律不同部分的分布。Nishino等人[16]分析了场景反照率和图像深度的分布,然后应用因子MRF[17]对它们进行联合估计。Fattal[18]发现,自然图像小块中的像素通常在RGB颜色空间中表现出称为颜色线的一维分布。具体地说,模糊图像的颜色线具有唯一的偏移。Berman和Avidan[19]指出,无雾图像可以用几百种不同的颜色很好地近似,像素可以根据颜色分组为簇。在雾度条件下,每个聚类的像素在RGB空间中变成雾度线。因此,去雾等于识别那些雾线。最近,基于图像块的像素聚集在椭球区域而不是颜色线的观察,Bui和Kim[20]提出了在最大化去雾像素的对比度之前的颜色椭球。

B.基于学习的除雾方法

随着细胞神经网络的普及,该领域出现了基于学习的方法。Cai等人[4]提出了一种称为DehazeNet的端到端CNN,用于从模糊图像中估计传输图。Ren等人[21]利用多尺度信息,通过使用粗尺度网络和细尺度网络来预测传输。不同的是,Li等人[5]通过重新制定Koschmieder定律,将透射和环境光这两个未知变量合并为一个变量。然后,他们构建了AODNet来估计这个变量。在[22]中,Zhang等人采用了AODNet的公式,并提出了一种称为FAMED Net的快速准确的多尺度去雾网络来估计同一变量。后来,Ren等人[23]提出了门融合网络(GFN),将白平衡、对比度增强和伽马校正产生的三个中间结果合并为去雾结果。Santra等人[24]用细胞神经网络构建了一个贴片质量比较器(PQC),以获得**的去雾贴片。最近,基于大气照明对YCrCb颜色空间的照明通道的影响比色度通道更大的发现,Want等人提出了AIPNet[25],它采用多尺度细胞神经网络来恢复模糊图像的Y通道。Liu等人[26]以迭代的方式解决了去雾问题。对于每次迭代,通过变分模型对输入进行优化,然后将其放入CNN中,以生成输出作为下一次迭代的输入。Liu等人[27]构建了一个具有几个剩余密集块[28]的网格网络和一个通道式注意力机制来消除雾霾。所有这些方法都依赖于对图像的监督,而我们的方法对未配对的数据进行弱监督。

C.GANs去雾

GAN起源于[29],在训练过程中,生成器和鉴别器以对抗性的方式进行最大化游戏。许多研究[30]-[32]已经证明,GANs在图像生成和恢复领域具有优越性。对于去雾,GAN在[33]中首次引入,其中去雾图像由网络根据Koschmieder定律生成,并由鉴别器进行判断。后来,Zhang等人[6]提出了更复杂的结构来生成Koschmieder定律的未知变量,并采用了一个鉴别器来联合判断传输图和去雾输出。Li等人[34]在没有任何物理模型的情况下,采用条件GAN直接生成除雾结果。继Li等人的工作[34]之后,Qu等人[7]提出了增强块、多尺度生成器和多尺度鉴别器,以进一步增强结果。尽管涉及GANs,但所有这些去雾方法仍然需要成对的训练数据。作为利用不成对数据的先驱,DisentGAN[35]使用三个生成器从模糊输入中生成去雾图像、透射图和环境光,然后使用多尺度鉴别器进行对抗性训练。我们的方法也专注于使用未配对的图像进行训练,但它通过分别恢复可见性和提高真实性来解决去雾问题。

3.提出的框架

在本节中,将详细介绍了提出的RefineDNet。我们首先介绍了它的总体架构,然后回顾了如何获得DCP的初步去雾结果,这对RefineDNet至关重要。之后,对感知融合进行了详细介绍。最后,对损失函数进行了描述。

A.总体框架

我们将去雾任务分为两个子任务,即可见性恢复和真实性改进,并提出了弱监督框架RefineDNet。我们的动机是双重的。首先,我们发现,基于先验的方法更有可能以引入伪影为代价来消除模糊,而基于学习的方法则善于产生视觉上令人愉悦的结果,但模糊程度更高。因此,将这两种方法的优点结合起来应该是有希望的。其次,基于监督学习的方法需要清晰和模糊的图像对,这在现实世界条件下很难获得,而使用未配对数据的弱监督可以适当地解决这个问题。

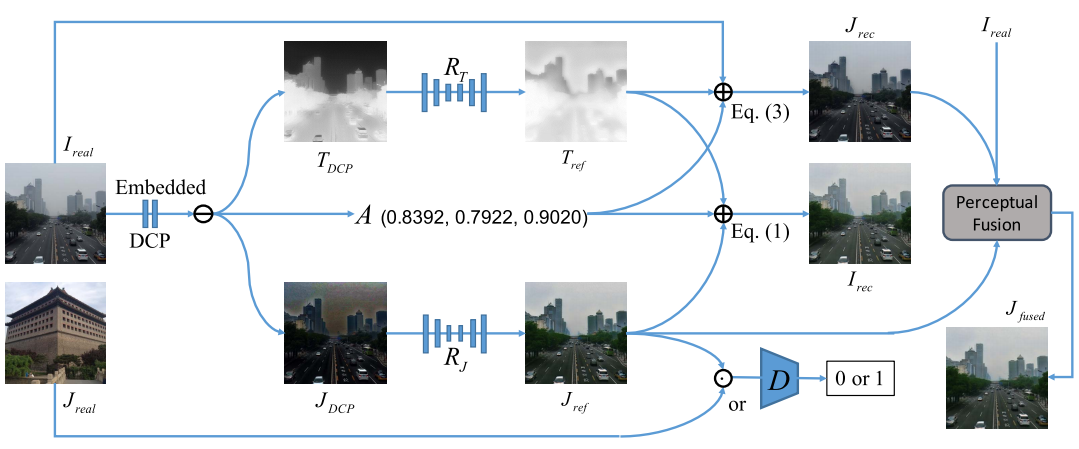

图2。RefineDNet概述。![]() 代表两个精炼厂网络。 D指的是鉴别器。

代表两个精炼厂网络。 D指的是鉴别器。![]() 是未配对的输入图像。

是未配对的输入图像。![]() 分别是

分别是![]() 的精化结果。A是环境光,括号中的数字分别是A的R、G、B通道的值。

的精化结果。A是环境光,括号中的数字分别是A的R、G、B通道的值。![]() 是通过等式(3)重建的去雾图像。

是通过等式(3)重建的去雾图像。![]() 是通过等式(1)重建的模糊图像。感知融合的轮廓如图3所示。

是通过等式(1)重建的模糊图像。感知融合的轮廓如图3所示。

1) 两阶段框架:如图2所示,RefineDNet包括两个阶段。在第一阶段,它采用DCP来生成环境光A、初步去雾图像![]() 和透射图

和透射图![]() 。在第二阶段中,

。在第二阶段中,![]() 由精炼网络

由精炼网络![]() 精炼为

精炼为![]() ,

,![]() 由另一精炼网络

由另一精炼网络![]() 精炼为

精炼为![]() 。注意,DCP阶段嵌入在我们的框架中,因此

。注意,DCP阶段嵌入在我们的框架中,因此![]() 是RefineDNet在推理中的唯一输入。此外,图2表明天空区域的

是RefineDNet在推理中的唯一输入。此外,图2表明天空区域的![]() 值大于其真实值。然而,天空区域的放大

值大于其真实值。然而,天空区域的放大![]() 值不会影响除雾结果,附录B对此进行了详细讨论。

值不会影响除雾结果,附录B对此进行了详细讨论。

2) 弱监督学习:在训练过程中,为了确保Tref得到适当的细化,我们根据Koschmieder定律(即方程(1)),使用Tref、Jref和A将模糊输入重建为Irec。然后,通过最小化Ireal和Irec之间的距离来更新精炼器RT。关于我们可以以这种方式更新RT的原因,请参阅附录C。此外,还有一个用D表示的附加鉴别器,它接收Jref或清晰样本Jreal,以实现对抗性学习。由于不要求Jreal必须取自模糊输入Ireal的同一场景,因此整个框架是弱监督的。在RefineDNet中,D在弱监督方面发挥着至关重要的作用。如果没有D,我们就无法进行对抗性学习,因此,RJ将不会得到适当的更新。

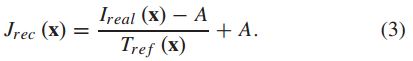

3) 除雾结果融合:在RefineDNet中,尽管Jref是一个去雾图像,但它不适合任何物理模型。为了获得更合格的结果,我们通过将Koschmieder定律重新表述为,

然后,我们为IQA采用强大的特征来计算权重,以融合Jref和Jrec作为所使用的最终去雾输出Jfused。 基于这些特征的IQA度量可以生成接近人类感知的有效判断,因此我们将我们的融合策略称为感知融合。第III-C节详细阐述了这一策略。基于这些特征的IQA度量可以生成接近人类感知的有效判断,因此我们将我们的融合策略称为感知融合。第III-C节详细阐述了这一战略。

4) 网络结构:为了证明RefineDNet的()动机模体主题)motif而不是骨干网络的有效性,我们采用了CycleGAN[31]提供的基本骨干网络来实现RT、RJ和D,而不包含现代最先进的除雾管道中流行的任何多尺度或其他定制结构[6]、[7]、[23]、[35]。具体而言,![]() 是一个U-Net[36],它包括8个下采样和8个上采样卷积层。RJ是一个具有9个残差块的ResNet[37]。D是具有5个卷积层的CNN。

是一个U-Net[36],它包括8个下采样和8个上采样卷积层。RJ是一个具有9个残差块的ResNet[37]。D是具有5个卷积层的CNN。

B.初步DCP结果

DCP[8]嵌入RefineDNet中,以实现端到端的训练和推理。在本节中,我们简要介绍了如何获得带有嵌入DCP的RefineDNet的初步除雾结果,即![]()

![]()

1) 暗通道提取:对于输入RGB图像I,我们计算表示为![]() 的通道最小值图像。然后,我们将核大小为5×5的最大池化应用于

的通道最小值图像。然后,我们将核大小为5×5的最大池化应用于![]() 的加法逆,然后得到池化结果的加法逆作为暗通道图像

的加法逆,然后得到池化结果的加法逆作为暗通道图像![]() 暗通道的提取可以公式化为,

暗通道的提取可以公式化为,

![]()

其中![]() 是指I的R、G、B通道之一。

是指I的R、G、B通道之一。

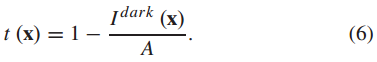

2) 传输估计:我们得到了Koschmieder定律两边的黑暗通道,

![]()

其中![]() 分别是图像I和J在像素x处的暗通道。 根据DCP的假设,即自然图像的大多数非天空斑块中的像素至少在一个颜色通道中具有接近零的强度值,

分别是图像I和J在像素x处的暗通道。 根据DCP的假设,即自然图像的大多数非天空斑块中的像素至少在一个颜色通道中具有接近零的强度值,![]() 然后

然后

如果A是已知的,则可以相应地获得![]() 。 此外,我们使用了一个引导滤波器来使

。 此外,我们使用了一个引导滤波器来使![]() 平滑。引导滤波器也嵌入到我们的框架中,并使用一个平均池化来实现,内核大小为19×19,步长为1。

平滑。引导滤波器也嵌入到我们的框架中,并使用一个平均池化来实现,内核大小为19×19,步长为1。

3) 环境光估计和去雾图像:至于A,由于图像中的大像素值(例如,天空区域的像素值)非常接近环境光,所以![]() 中最亮的0.1%像素被拾取,并且它们在I(x)的颜色通道中的值被平均为A。对于获得的

中最亮的0.1%像素被拾取,并且它们在I(x)的颜色通道中的值被平均为A。对于获得的![]() 可以通过反转Koschmieder定律来获得,如等式(3)。

可以通过反转Koschmieder定律来获得,如等式(3)。

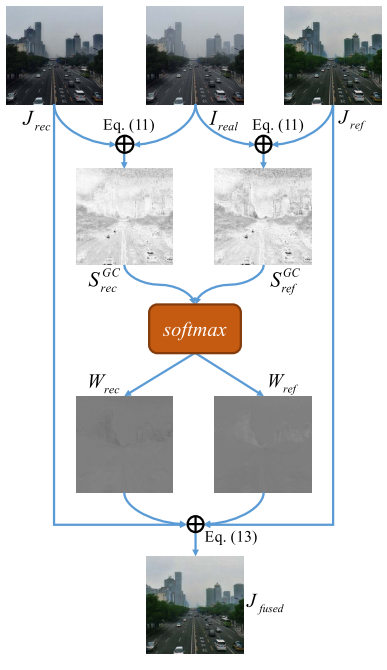

C.感知融合

由于Jref和Jrec是以各自的方式产生的,因此在某些地区,它们中的任何一个都很可能比另一个更好。从这个意义上说,如果Jrec和Jref中的任何一个的更好区域被分配有更大的权重,我们可以通过融合Jrec与Jref来获得更好的结果。

由于Jref和Jrec都是具有良好可见性的去雾图像,因此它们与任意归一化权重的融合不应损害可见性。因此,我们基于图像的真实性来融合它们。由于Ireal是一幅具有高真实性的自然图像,因此Ireal和Jref(或Ireal与Jrec)的相似性图是Jref(或者Jrec)真实性的信息指标。从这个意义上说,我们应该给Jrec(x)和Jref(x)中的任何一个分配更大的权重,这在相似性图中具有更大的对应值。为了获得合适的相似度图,我们采用了两个特征,即LMN颜色空间(ChromMN)的梯度系数(GM)和色度信息,这两个特征在IQA领域被广泛采用。

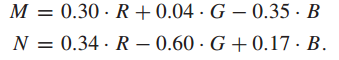

1) 特征提取:根据IQA研究[38]–[41],GM是在YIQ颜色空间的Y通道(亮度通道)中计算的,ChromMN是指LMN颜色空间的M和N通道[42],[43]。因此,为了获得GM,我们首先使用YIQ的定义来计算YIQ的Y通道,

![]()

然后,图像的GM被计算为G(x)=![]() ,其中x是该图像的像素,Gx(x)和Gy(x)是其在y通道中x处的偏导数。 对于ChromMN,我们如下计算LMN颜色空间的M个和N个通道,

,其中x是该图像的像素,Gx(x)和Gy(x)是其在y通道中x处的偏导数。 对于ChromMN,我们如下计算LMN颜色空间的M个和N个通道,

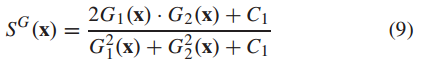

2) 相似性计算:我们计算了与GM和ChromMN的相似性,以评估去雾结果的真实性。给定标记为G1(x)和G2(x)的两个图像的GM值, 像素x处的相似度![]() 被定义为,

被定义为,

其中C1被设置为160,如[39]中所建议的。

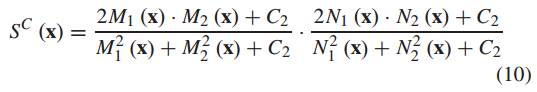

关于ChromMN,假设从第一图像计算M1(x)和N1(x),从第二图像导出M2(x)或N2(x)。像素x处的相似度![]() 计算为,

计算为,

其中C2被设置为130,如[40]中所建议的。

我们考虑![]() ,并将总体相似性映射

,并将总体相似性映射![]() 定义为,

定义为,

![]()

其中,α是用于调整GM和ChromMN之间的相对重要性的参数。根据之前的IQA研究[40],我们在实验中设置了α=0.4。

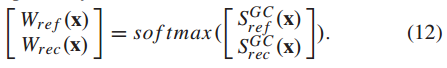

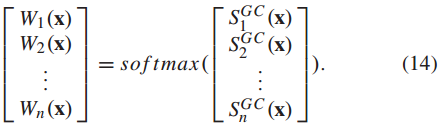

3) 融合权重:在这一步中,我们将相似性转换为融合权重。假设![]() 是像素x处的

是像素x处的![]() 的相似性值, 并且

的相似性值, 并且![]() 是

是![]() 在像素x处的相似度值,在像素x处的

在像素x处的相似度值,在像素x处的![]() 的权重被定义为

的权重被定义为![]() 的softmax。我们将权重分别记为Wref(x)和Wrec(x)。因此

的softmax。我们将权重分别记为Wref(x)和Wrec(x)。因此

注意Wref(x)+Wrec(x)=1。

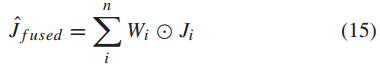

最后,我们将Jref和Jrec与它们的权重进行融合,使用的最终结果Jf定义为,

![]()

其中![]() 是指像素化产品。 图3展示了我们感知融合的轮廓。其疗效在第IV-C节的消融研究中进行了讨论。

是指像素化产品。 图3展示了我们感知融合的轮廓。其疗效在第IV-C节的消融研究中进行了讨论。

4) 适应融合多种结果:感知融合可以容易地适应于融合两个以上的去雾结果。假设J1、J2、,。。。,和Jn是要融合的n个去雾结果。对于Ji(i∈1,2,…,n),我们根据等式(11)计算Ji的相似性映射![]() 和模糊输入

和模糊输入![]() 。然后,对于像素x,Ji(x)的融合权重是定义为,

。然后,对于像素x,Ji(x)的融合权重是定义为,

最后,所使用的融合图像![]() 被导出为,

被导出为,

其中![]() 是指逐像素乘积。

是指逐像素乘积。

图3。知觉融合的轮廓。Ireal是模糊的图像。Jrec和Jref分别是重构的和细化的去雾结果。![]() 是它们的相似性图,Wrec和Wref是它们在融合中的权重。

是它们的相似性图,Wrec和Wref是它们在融合中的权重。![]() 是最终的融合结果。

是最终的融合结果。

D.损失函数

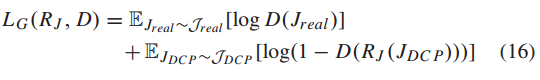

RefineDNet的损失函数包括3个项,即GAN损失LG、重建损失Lrec和身份损失Lidt。它们的定义如下,我们在第IV-C节中证明了它们的有效性。

GAN损失最初用于以对抗性的方式更新生成器和鉴别器[29]。在我们的案例中,LG用于监督![]() 和D。它被定义为,

和D。它被定义为,

其中![]() 是所有可能的Jreal的集合, 并且

是所有可能的Jreal的集合, 并且![]() 是指所有可能的

是指所有可能的![]() 的集合。

的集合。

采用重建损失对重建的模糊图像进行正则化。如第III-A节所述,我们将Lrec定义为Ireal和Irec之间的距离,即,

![]()

其中Ireal是模糊输入,Irec是通过等式(1)获得的,并且![]() 表示距离度量。

表示距离度量。

应用身份丢失来抑制可能由细化器RJ引入的伪影。一般来说,当输入是真实世界的清晰图像时,这个term鼓励RJ输出与其输入类似的东西。通过这种方式,RJ不太可能通过添加额外的纹理来欺骗鉴别器。我们将Lidt定义为,

![]()

其中![]() 是一个距离度量,与等式(17)中出现的距离度量相同。

是一个距离度量,与等式(17)中出现的距离度量相同。 ![]() 可以是L1范数或L2范数。在我们的实验中,我们用L1和L2训练了RefineDNet,发现所获得的模型表现出几乎相同的性能。这表明没有必要故意选择度量形式L1或L2来训练RefineDNet。有关更多详细信息,请参阅第IV-C节。默认情况下,我们报告使用L1训练的RefineDNet的结果。

可以是L1范数或L2范数。在我们的实验中,我们用L1和L2训练了RefineDNet,发现所获得的模型表现出几乎相同的性能。这表明没有必要故意选择度量形式L1或L2来训练RefineDNet。有关更多详细信息,请参阅第IV-C节。默认情况下,我们报告使用L1训练的RefineDNet的结果。

整体损失函数:结合所有损失项,整个目标被公式化为,

![]()

其中λ是指示LG的权重的超参数。λ的默认值设置为0.02。

5.结论

在这项工作中,我们提出了一个简单而有效的两阶段弱监督去雾框架RefineDNet,用于两个目的,即融合基于先验和基于学习的方法的优点,并解决缺乏配对训练图像的问题。为了获得更合格的结果,我们还提出了一种感知融合策略来融合RefineDNet的不同输出。根据实验结果,RefineDNet可以在室内和室外数据集上使用基本骨干网络实现最先进的性能。对其组件进行了深入研究,并证明其有效。此外,我们构建了一个包含6480张户外图像的不成对数据集,这有利于弱监督除雾的进一步研究。未来,我们将探索定制的结构和先验,以改进RefineDNet。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/61486.html