目录

参考链接

一、什么是ResNet?

二、网络中的亮点

三、为什么采用residual?

两种问题:

1.梯度消失和梯度爆炸

2.退化问题

解决方法

四、残差学习

五、ResNet的网络结构

ResNet中两种不同的ResNet block

网络结构

六、ResNet-layers模型完整代码

1. BasicBlock

2. BottleNeck

3. ResNet

4. 搭建ResNet-34、ResNet-50模型

5. 网络结构可视化

6. 查看Pytorch官方源码

7. split_dataset.py

8. train.py

【附录:ResNet_layer模型代码】

参考链接

【DL系列】ResNet网络结构详解、完整代码实现

你必须要知道CNN模型:ResNet

6.1 ResNet网络结构,BN以及迁移学习详解

【深度学习】ResNet网络详解

ResNet详解

一、什么是ResNet?

ResNet网络是在2015年由微软实验室中的何凯明等几位大神提出,论文地址是《Deep Residual Learning for Image Recognition》;是在CVPR 2016发表的一种影响深远的网络模型,由何凯明大神团队提出来,在ImageNet的分类比赛上将网络深度直接提高到了152层,前一年夺冠的VGG只有19层。斩获当年ImageNet竞赛中分类任务第一名,目标检测第一名。获得COCO数据集中目标检测第一名,图像分割第一名,可以说ResNet的出现对深度神经网络来说具有重大的历史意义。

Resnet在cnn图像方面有着非常突出的表现,它利用 shortcut 短路连接,解决了深度网络中模型退化的问题。相比普通网络每两层/三层之间增加了短路机制,通过残差学习使深层的网络发挥出作用。

二、网络中的亮点

1.超深的网络结构(超过1000层)。

2.提出residual(残差结构)模块。

3.使用Batch Normalization加速训练(丢弃dropout)。

三、为什么采用residual?

在ResNet提出之前,所有的神经网络都是通过卷积层和池化层的叠加组成的。

人们认为卷积层和池化层的层数越多,获取到的图片特征信息越全,学习效果也就越好。但是在实际的试验中发现,随着卷积层和池化层的叠加,不但没有出现学习效果越来越好的情况,反而出现

两种问题:

1.梯度消失和梯度爆炸

梯度消失:若每一层的误差梯度小于1,反向传播时,网络越深,梯度越趋近于0

梯度爆炸:若每一层的误差梯度大于1,反向传播时,网络越深,梯度越来越大

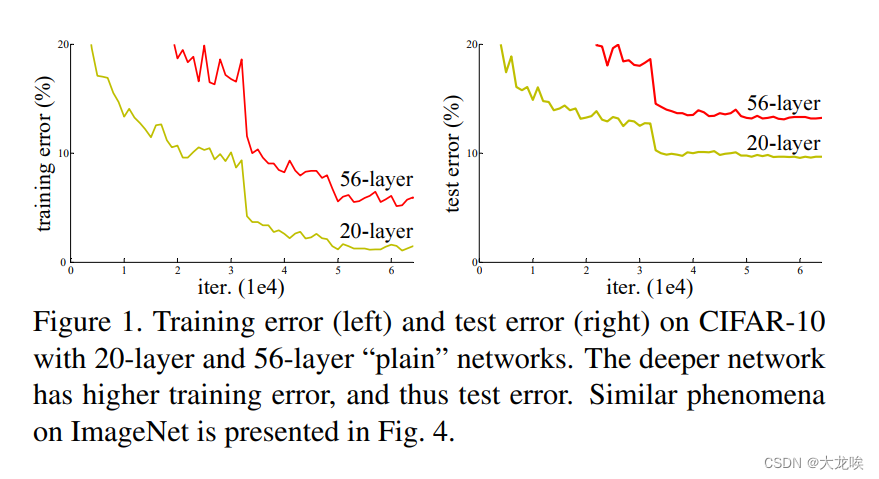

2.退化问题

随着层数的增加,预测效果反而越来越差。如下图所示

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/50101.html