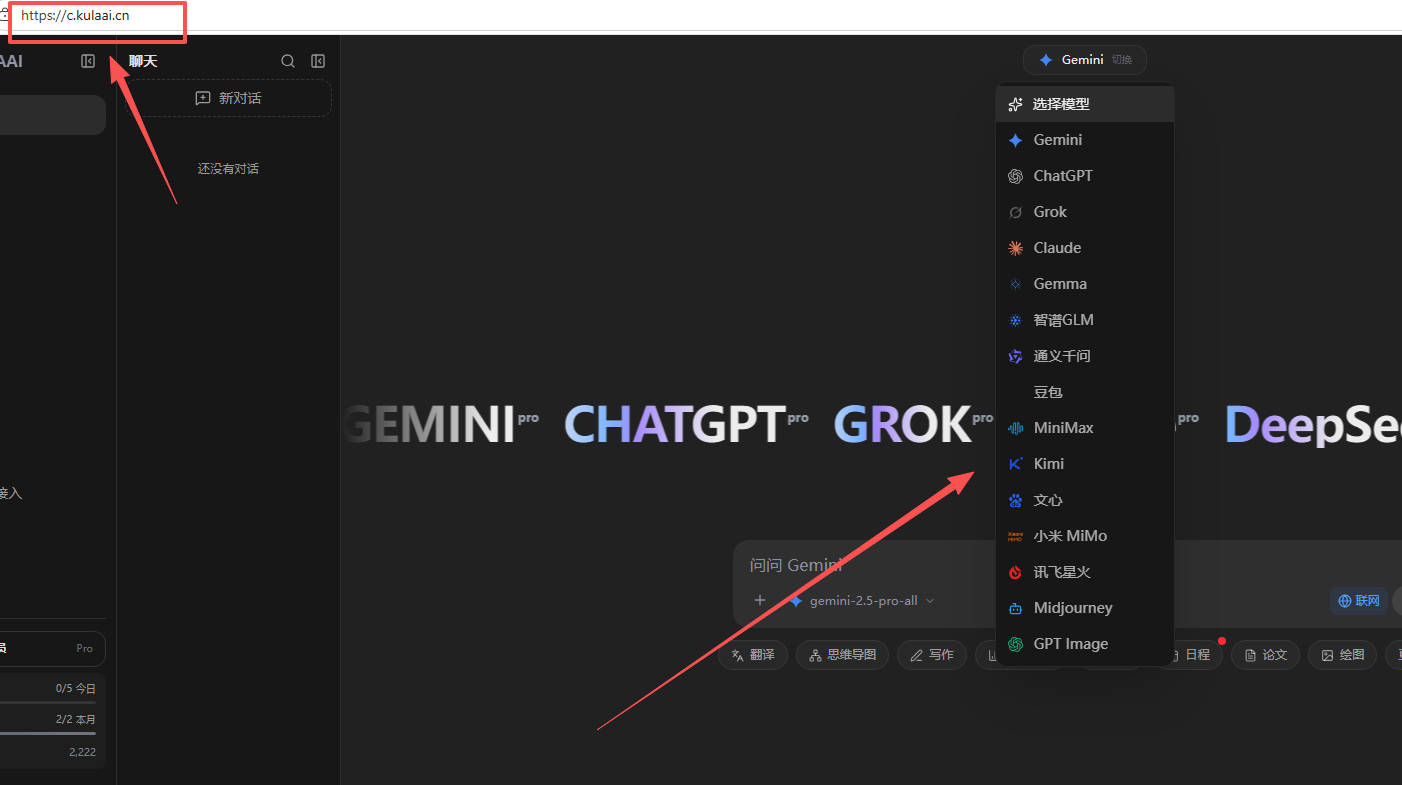

想第一时间体验GPT-Image 2等最新AI图像工具,可以关注库拉KULAAI(c.kulaai.cn)这样的聚合平台,一个账号覆盖多个主流模型入口,省去逐个注册调试的成本。

4月21日,OpenAI正式全量推送GPT-Image-2。Image Arena当天给出数据:文生图Elo评分1512,领先第二名242分。Arena创始人看完榜单后的原话是"literally broke the chart"——有史以来最大差距。

这不是一次常规迭代。这是一个积攒了三年的问题终于被正面回应了。

文字渲染:从最大笑话变成核心卖点

AI图像生成最大的槽点,一直是文字。DALL-E 3拼不对复杂单词,Midjourney把招牌写成乱码,Stable Diffusion在海报上输出鬼画符。文字渲染是生图模型的"手指问题"——不是不重要,而是一做就露馅。

GPT-Image-2把文字渲染准确率从前代的90-95%拉到了约99%。TechCrunch实测让它生成一份墨西哥餐厅菜单,输出结果"可以直接放进餐厅使用,客人不会察觉任何异样"。

中文渲染更是国内用户最该关注的变化。实测生成广州市小学数学试卷,卷头标题、填空题下划线、几何图形标注,宋体楷体排版风格全部精准还原。生成《蜀道难》真迹图片,文字不仅准确,还做到了行云流水、笔锋苍劲,连纸张做旧纹理和印鉴都到位。

中文不再是图像模型的二等公民。这是这一代国内用户最该关心的变化。

架构重写:边理解边画

GPT-Image-2不再基于GPT-4o的图像pipeline。研究负责人Boyuan Chen将其定义为"GPT for images"——一个从头设计的独立系统。

用一个类比:过去的模型是"先听懂你说什么,再动手画",中间有一次信息压缩;GPT-Image-2是"边理解边画",语言理解和图像生成在同一过程中完成。所以文字渲染终于准了——生成每个像素时,模型仍然"知道"自己在写什么字。

Thinking模式:第一个会思考的图像模型

开启Thinking模式后,模型做三件事:联网搜索实时信息、一次产出最多8张连贯图、自我检查输出质量。模型在落笔前先规划构图,生成后检查输出,发现错误还会迭代修正。

OpenAI的五个演示非常有说服力:

Thinking模式的核心价值不是"画得更好",是"替你想清楚"。idea到成品之间那段繁琐的脑力活,模型自己接下了。

世界知识:它真的知道你的屏幕长什么样

GPT-Image-2的知识截止是2025年12月。训练数据明显偏向真实世界的视觉素材:UI截图、店面招牌、界面布局。

实测中,让它生成抖音直播界面,左下角评论区、右侧点赞分享按钮、顶部观众人数和跑马灯,所有交互元素的层级逻辑全部正确。让它还原英雄联盟团战画面,英雄头顶血条、技能特效光影、小地图UI框全部到位。

横向对比:跟MJ、SD到底差在哪

Midjourney在艺术风格化和摄影质感上依然独树一帜。Stable Diffusion胜在开源可控和本地部署的灵活性。GPT-Image-2的差异化在于指令遵循的精确性和世界知识的深度。

商业落地:从"抽卡娱乐"到"生产力工具"

AI跨过了文字和UI的门槛,生图这件事就彻底脱离了"艺术创作"的范畴。

工业与产品设计领域,复杂的机械结构和建模过去需要3D建模师肝上几天,现在几秒出高品质原型参考。电商广告视觉方面,苹果那种冷峻高级的质感或电商平台高饱和度带中文促销文案的网感图,都游刃有余。宣发和IP创作上,中文字体排版直接可用,分镜逻辑清晰。

StartupFortune在发布日给了一个定位:从"creative novelty"到"production infrastructure"。

一个值得警惕的问题

让GPT-Image-2成为最好生产力工具的那组能力——精确的文字渲染、可信的UI布局、真实世界的视觉词汇——恰好也是制造虚假信息的完美工具集。

过去的生图模型因为文字太烂,反而天然带有一层"防伪标记"。GPT-Image-2把这层天然屏障拆掉了。OpenAI的应对是C2PA元数据水印,但产品负责人自己承认"is not a silver bullet"。

"有图有真相"的时代,真的回不去了。

实操建议

- 1.

免费用户:所有ChatGPT用户都能用Instant模式,直接在对话框点"+"选择"创建图片"即可。

- 2.

付费用户:Plus、Pro、Business用户可解锁Thinking模式,复杂任务务必开启,效果差距很大。

- 3.

开发者:API模型名gpt-image-2,通过Image API和Responses API都能调用。最高4096×4096分辨率,2K标准输出。

- 4.

提示词:不用堆砌碎片关键词,用详细自然的语言描述即可。GPT-Image-2的理解力已经足够强,关键是把需求说清楚。

- 5.

成本控制:定价每百万token 8−8−30,折合单张0.006−0.006−0.211。日常轻量任务用Instant模式足够,复杂任务再切Thinking模式。

趋势判断

AI图像生成赛道正在从"创意玩具"进入"生产基础设施"阶段。GPT-Image-2的发布标志着这个转折点的到来:当一个模型能以假乱真地生成数学试卷、完整复刻抖音直播界面,生图这件事的性质就彻底变了。

但benchmark performance和production performance往往有差距。99%是实验室数字,真实世界的多语言、多字体、多排版场景能不能hold住,5月API开放后才会有完整答案。

图像AI走到今天,单张图的质量已经不是最核心的问题。GPT-Image-2试图回答的是:当视觉生产变成一个系统性任务——需要理解需求、搜索参考、适配格式、保持风格一致——模型能承担多少?

答案是:相当多。与其纠结要不要用,不如先上手跑一遍,看看它在你的工作流里到底能替代哪些环节。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/280704.html